Transformer核心:自注意力机制解析

1. LLM核心技术架构与演进

大语言模型(LLM)的核心技术架构主要围绕Transformer展开,其演进体现在架构优化、训练范式创新和效率提升等多个方面。

1.1 基础架构:Transformer

Transformer架构摒弃了循环神经网络(RNN)和卷积神经网络(CNN),完全依赖自注意力机制(Self-Attention)来捕捉序列中的长距离依赖关系,为后续LLM的爆发奠定了基石。其核心公式如下:

# 简化的自注意力计算逻辑(伪代码)

def scaled_dot_product_attention(Q, K, V, mask=None):

"""

Q: 查询矩阵 (Query)

K: 键矩阵 (Key)

V: 值矩阵 (Value)

"""

d_k = Q.size(-1) # 键向量的维度

scores = torch.matmul(Q, K.transpose(-2, -1)) / math.sqrt(d_k) # 计算注意力分数

if mask is not None:

scores = scores.masked_fill(mask == 0, -1e9)

attention_weights = F.softmax(scores, dim=-1) # 应用Softmax得到权重

output = torch.matmul(attention_weights, V) # 加权求和得到输出

return output, attention_weights

1.2 主流模型结构与关键优化

当前主流LLM(如GPT系列、LLaMA、Qwen等)主要采用Decoder-only架构,专注于自回归文本生成。近年来涌现的关键优化技术包括:

| 技术类别 | 代表技术 | 核心目的与原理 | 影响与示例 |

|---|---|---|---|

| 注意力机制优化 | 分组查询注意力 (GQA) | 将查询头(Q)分组,每组共享相同的键(K)和值(V)头,在保持性能的同时显著减少推理时的KV缓存内存占用和带宽压力。 | LLaMA-2 70B后引入,Qwen2.5系列采用,是实现高性能长上下文推理的关键。 |

| 计算效率优化 | FlashAttention | 通过算子融合(Fusion)和巧妙利用GPU内存层次结构(SRAM vs HBM),避免在注意力计算过程中将庞大的中间矩阵写回慢速显存,从而大幅提升训练和推理速度并降低内存消耗。 | 已成为训练千亿参数模型的标配,VLLM等推理框架深度集成。 |

| 位置编码演进 | 旋转位置编码 (RoPE) | 通过绝对位置编码实现相对位置感知,能更好地建模序列中token的相对位置关系,并理论上支持更长的上下文长度外推。 | 被LLaMA、GPT-NeoX、Qwen等众多主流模型采用。 |

| 高效微调技术 | 低秩适应 (LoRA) | 在微调时冻结预训练模型权重,仅向模型注入可训练的低秩分解矩阵,从而以极小的参数量(通常<1%)达到接近全参数微调的效果,大幅降低计算和存储成本。 | 成为个人开发者及企业适配LLM到下游任务的核心技术。 |

1.3 核心训练与对齐范式

现代高性能LLM的构建普遍遵循 “预训练 -> 指令微调 -> 人类反馈强化学习 (RLHF)” 的三阶段范式。

- 预训练:在海量无标注文本数据上进行自监督学习(如因果语言建模),让模型学习通用的语言知识和世界知识。这是计算和资源消耗最大的阶段。

- 指令微调 (Instruction Tuning):使用高质量的指令-输出配对数据对模型进行有监督微调,教会模型理解并遵循人类指令。这是激发模型泛化能力和对话能力的关键步骤。

- 基于人类反馈的强化学习 (RLHF):通过人类对模型输出的偏好排序数据训练一个奖励模型,然后利用强化学习(如PPO算法)优化模型,使其输出更符合人类价值观和偏好,解决“对齐”问题。

2. LLM发展现状与生态格局

2.1 国内外发展态势

全球LLM发展呈现 “美国引领,中国追赶,全球多极” 的格局。

| 地区 | 代表模型/机构 | 特点与现状 |

|---|---|---|

| 美国(引领) | OpenAI (GPT-4/4o/4o-mini)、Anthropic (Claude 3)、Google (Gemini)、Meta (LLaMA系列) | 技术原创性强,在基础模型架构、Scaling Law探索、多模态、Agent能力上持续领先。开源与闭源生态并存(如LLaMA系列推动开源繁荣)。 |

| 中国(积极追赶) | 百度(文心一言)、阿里(通义千问)、智谱AI(GLM)、深度求索(DeepSeek)、月之暗面(Kimi)等 | 依托庞大的应用场景和数据优势,在中文理解和处理、长上下文、特定垂直领域(如办公、法律)应用落地迅速。技术路径上紧跟国际前沿并进行本土化创新。 |

| 欧洲及其他地区 | Mistral AI (Mistral、Mixtral)、Cohere等 | 专注于高效模型架构(如混合专家模型MoE)、多语言能力或企业级解决方案,在开源和商业化应用上寻求差异化突破。 |

2.2 技术前沿与突破方向

当前LLM的技术突破主要集中在以下几个方面:

- 上下文窗口极限拓展:从早期的2K、4K tokens,发展到如今支持128K、200K甚至1000K(如Kimi Chat)的超长上下文。这依赖于高效的注意力算法(如FlashAttention)、位置编码优化和工程改进。

- 多模态能力融合:LLM正从纯文本模型向能够理解和生成图像、音频、视频的“大模型”演进。技术路径包括将不同模态编码器与LLM对齐(如CLIP)、或从头训练统一的多模态架构(如Flamingo)。

- 推理与规划能力增强:通过思维链 (Chain-of-Thought, CoT) 提示、程序辅助推理(Program-aided)等技术,显著提升模型在数学、逻辑、代码等复杂任务上的分步推理能力。

- 模型效率与轻量化:除了前述的LoRA,量化(Quantization)(将模型权重从FP16降至INT8/INT4)、模型剪枝(Pruning) 等技术使得百亿参数模型可以在消费级GPU甚至手机上运行,极大降低了部署门槛。

3. LLM主要应用场景与落地实践

LLM的应用已从早期的聊天机器人,广泛渗透到各行各业,其落地主要通过以下技术路径实现:

3.1 核心应用范式

- 提示工程 (Prompt Engineering):通过精心设计输入提示(Prompt),直接激发基础模型或指令微调模型完成特定任务,如文本分类、摘要、翻译等。这是成本最低的应用方式。

- 检索增强生成 (RAG):解决模型知识陈旧或产生“幻觉”的问题。通过外部知识库检索相关信息,并将其作为上下文提供给LLM,使生成内容更准确、可信。广泛应用于智能客服、企业知识库问答等场景。

# RAG 简化流程示例 def rag_pipeline(query, knowledge_base, llm_model): # 1. 检索:从知识库中找到与query最相关的文档片段 retrieved_docs = retriever.search(query, knowledge_base, top_k=3) # 2. 增强:将检索结果与原始问题组合成新的提示 augmented_prompt = f"基于以下信息回答问题:

{retrieved_docs}

问题:{query}"

# 3. 生成:LLM基于增强后的提示生成答案

answer = llm_model.generate(augmented_prompt)

return answer

```

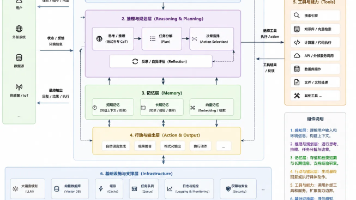

3. 智能体 (AI Agent):赋予LLM使用工具(搜索、计算器、API)、规划任务、记忆和反思的能力,使其能够自主或半自主地完成复杂工作流。这是当前最前沿的应用方向之一。

* 垂直领域Agent:如金融分析Agent、法律文书审核Agent、医疗诊断辅助Agent等,深度结合行业知识。

* 通用助理Agent:如AutoGPT、Devin(AI程序员),能够理解复杂目标并拆解执行。

3.2 行业落地案例

| 行业领域 | 典型应用场景 | 具体案例/价值 |

|---|---|---|

| 办公与创作 | 智能文档处理、代码生成与补全、营销文案创作、PPT生成 | Microsoft 365 Copilot、GitHub Copilot 极大提升白领和开发者的工作效率。 |

| 教育 | 个性化辅导、作业批改、课件生成、语言学习伙伴 | 可提供24/7的答疑解惑,根据学生水平自适应调整教学内容和难度。 |

| 金融与法律 | 智能投研报告生成、风险合规审查、合同条款审阅与起草 | 快速处理海量非结构化文档(财报、法律条文),提取关键信息,辅助专业决策。 |

| 医疗健康 | 病历信息结构化、医学文献摘要、患者问答预诊、药物研发辅助 | 加速科研信息提取,为医生提供诊断参考,提升医疗服务可及性。 |

| 能源与制造 | 设备故障诊断与预测、运维知识库问答、供应链优化分析 | 利用行业报告和实时数据,优化生产调度和能源分配。 |

4. 未来趋势与挑战

4.1 技术趋势

- Scaling Law 的持续探索:模型参数、数据量和计算量同步增长是否能带来性能的持续突破,以及寻找更优的缩放规律是核心研究方向。

- 从感知到认知与行动的演进:未来的LLM将不仅限于理解和生成,而是具备更强的世界模型、因果推理和复杂规划能力,向通用人工智能(AGI)迈进。

- 专用化与小型化并存:一方面会出现针对科学、医疗等领域的超大规模专用模型;另一方面,更高效、更轻量、性能更强的“小模型”将通过知识蒸馏、架构创新等方式满足边缘侧和低成本部署需求。

- 多智能体协作系统:多个具备不同技能的AI Agent协同工作,完成社会级复杂任务,将成为重要的研究与应用范式。

4.2 主要挑战

- 幻觉与事实性:模型生成内容看似合理但不符合事实,这在关键领域(如医疗、新闻)是致命缺陷。需结合RAG、更好的对齐训练和实时事实核查来缓解。

- 安全与伦理对齐:如何确保模型不被用于生成有害内容、避免偏见歧视、保护用户隐私,是贯穿模型开发全生命周期的重大挑战。

- 巨大的资源消耗:LLM的训练和推理消耗巨大的算力和电力,其碳足迹引发对可持续性的担忧。推动绿色AI、开发更高效的算法和硬件是当务之急。

- 评估体系不完善:如何全面、公正地评估LLM在通用能力、专业领域、安全性、价值观等方面的表现,尚未形成公认的标准体系。

参考来源

- 国内外大语言模型领域发展现状与预期

- AI大语言模型的基础知识与前沿发展

- LLM大语言模型综述

- AI Agent 的发展现状、行业结构与趋势分析

- AI前沿技术:大语言模型LLM

- 2023年最新LLM大语言模型综述文章

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)