拒绝数据“裸奔”!把顶级AI装进自己的硬盘,这款神仙开源工具我粉了

说句掏心窝子的话,你有没有在深夜把公司还没发布的数据、或者自己敲了半个月的代码丢给 ChatGPT 后,突然感到一阵后怕?

“它会不会拿我的数据去训练下一个模型?”

“每个月 20 美元的订阅费,加上各种封号风险,到底什么时候是个头?”

在 AI 工具满天飞的今天,我们像是住在了别人盖的豪华酒店里,享受便利的同时,也交出了自己的隐私,还要随时面临被“涨房租”或“清退”的风险。而今天,我要给大家介绍一款让我彻底告别这种焦虑的“神仙级”工具——OpenWebUI。

它不是简单的套壳,而是一套能让你真正“把 AI 变成自己私有财产”的开源平台。不管你是想保护公司机密的打工人、精打细算的技术宅,还是带团队搞研发的管理者,这篇文章,手把手带你从零到一,搭建一个属于你自己的“超级大脑”。

第一章:为什么要“折腾”OpenWebUI?它到底能干啥?

在正式动手前,我们先聊聊为什么它值得你花半个小时去安装。说白了,它解决了四个核心痛点:

绝对的隐私“结界”

一旦你把它部署在本地电脑或公司的私有服务器上,拔掉网线它照样能跑(前提是你用本地模型)。你的商业报表、客户名单、核心代码,再也没有机会流进别人的训练池。数据这东西,捏在自己手里才最踏实。

一个界面,召唤千军万马

你可能既装了本地的 Llama3 跑日常问答,又买了 DeepSeek 的 API 处理复杂逻辑,还留着 OpenAI 的 Key 写代码。以前你得开三个网页切来切去,现在?在 OpenWebUI 里,你可以在同一个对话窗口,中途无缝切换模型,而且上下文完全不断!这种体验,用过就回不去了。

自带“开挂”的高级功能

别人家的 AI 只能瞎聊天,OpenWebUI 直接给你配齐了:

- RAG 知识库:扔进去几十份 PDF,让它基于你的私有文件精准回答,告别“一本正经地胡说八道”。

- Arena 竞技场:同一个问题,同时让两个模型作答,你当裁判,直观对比谁更聪明。

- Markdown与LaTeX渲染:写出来的公式、代码排版精美得可以直接发论文。

- 团队协作不费力

它支持用户权限管理(RBAC)。老板可以给不同部门开不同权限,大家共享算力,统一管理,这不比到处乱发 API Key 强百倍?

第二章:新手村任务——5分钟本地安装指南

很多朋友一听“本地部署”就觉得要敲一堆代码,怕搞崩电脑。其实有了 Docker,这事儿比装个大型游戏还简单。

什么是 Docker? 你可以把它理解为一个“打包好的集装箱”。集装箱里面装了 OpenWebUI 运行所需的所有环境,不会弄脏你电脑原有的系统,删掉就干干净净,毫无残留。

第一步:搞定 Docker

去 Docker 官网,下载对应你系统的版本(Windows/Mac 下载 Docker Desktop,Linux 用命令行装 Docker Engine)。一路“下一步”安装好,保证它处于运行状态。

第二步:一行代码,魔法启动

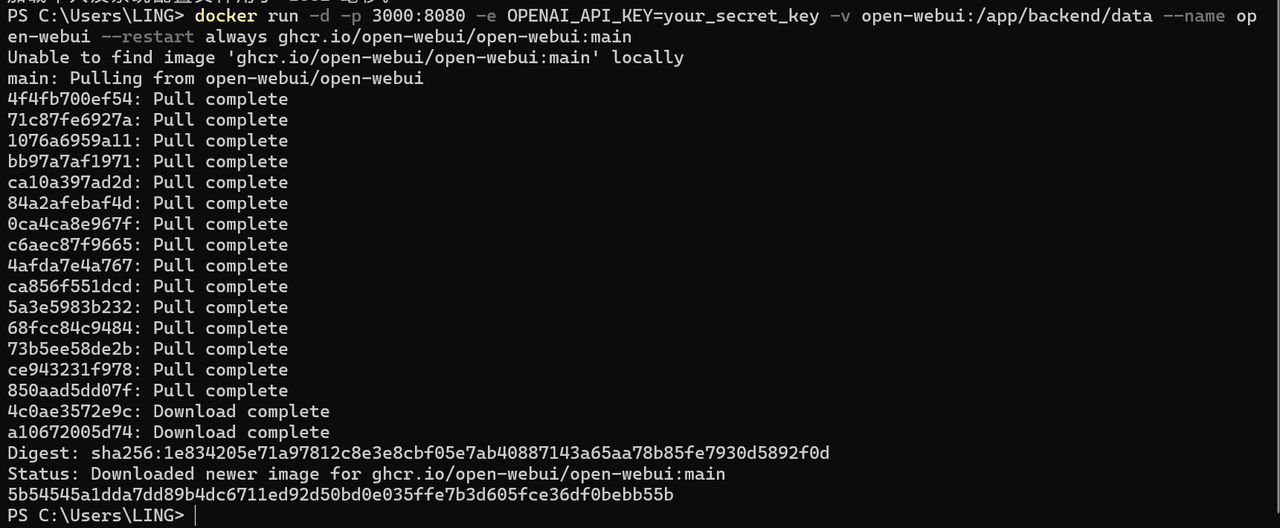

打开你的终端(Windows 用 PowerShell,Mac 用终端),复制下面这串“咒语”,回车:

docker run -d -p 3000:8080 -e OPENAI_API_KEY=your_secret_key -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

别被这行代码吓到,我给你翻译翻译:

-p 3000:8080:给它在你的 3000 端口开个门。-v open-webui:/app/backend/data:把你的聊天记录、设置等数据,持久化保存在本地,哪怕重启电脑数据也不丢。--restart always:让它在后台默默常驻,开机自启。

第三步:见证奇迹

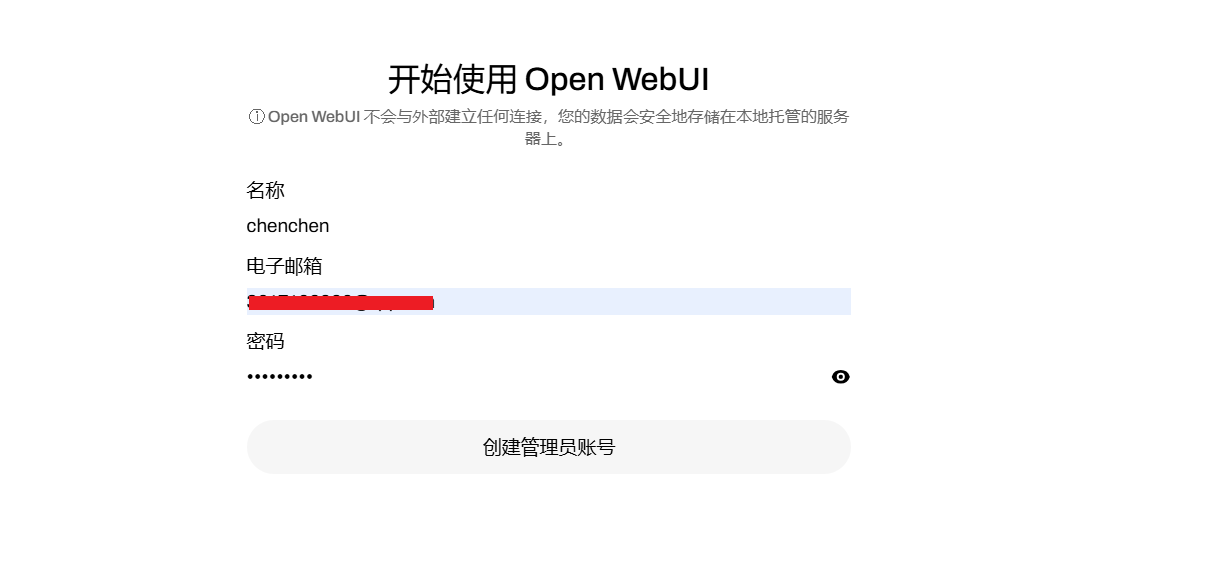

打开浏览器,输入 http://localhost:3000。看到那个熟悉的注册登录界面了吗?注意,第一个注册的账号,自动成为超级管理员! 赶紧用你的常用邮箱注册一个吧。

第三章:如虎添翼——接入蓝耘大模型,本地云端两不误

本地部署虽然爽,但现实很骨感:大部分人的电脑显卡(GPU)撑不起大参数的模型,跑起来像树懒。

这时候,“本地做壳,云端做脑”就是最完美的方案。蓝耘大模型(LanYun MaaS 平台)就是一个极佳的队友。它不仅中文理解能力贼强,而且完全兼容 OpenAI 的 API 协议——这意味着,OpenWebUI 可以无缝接入它。

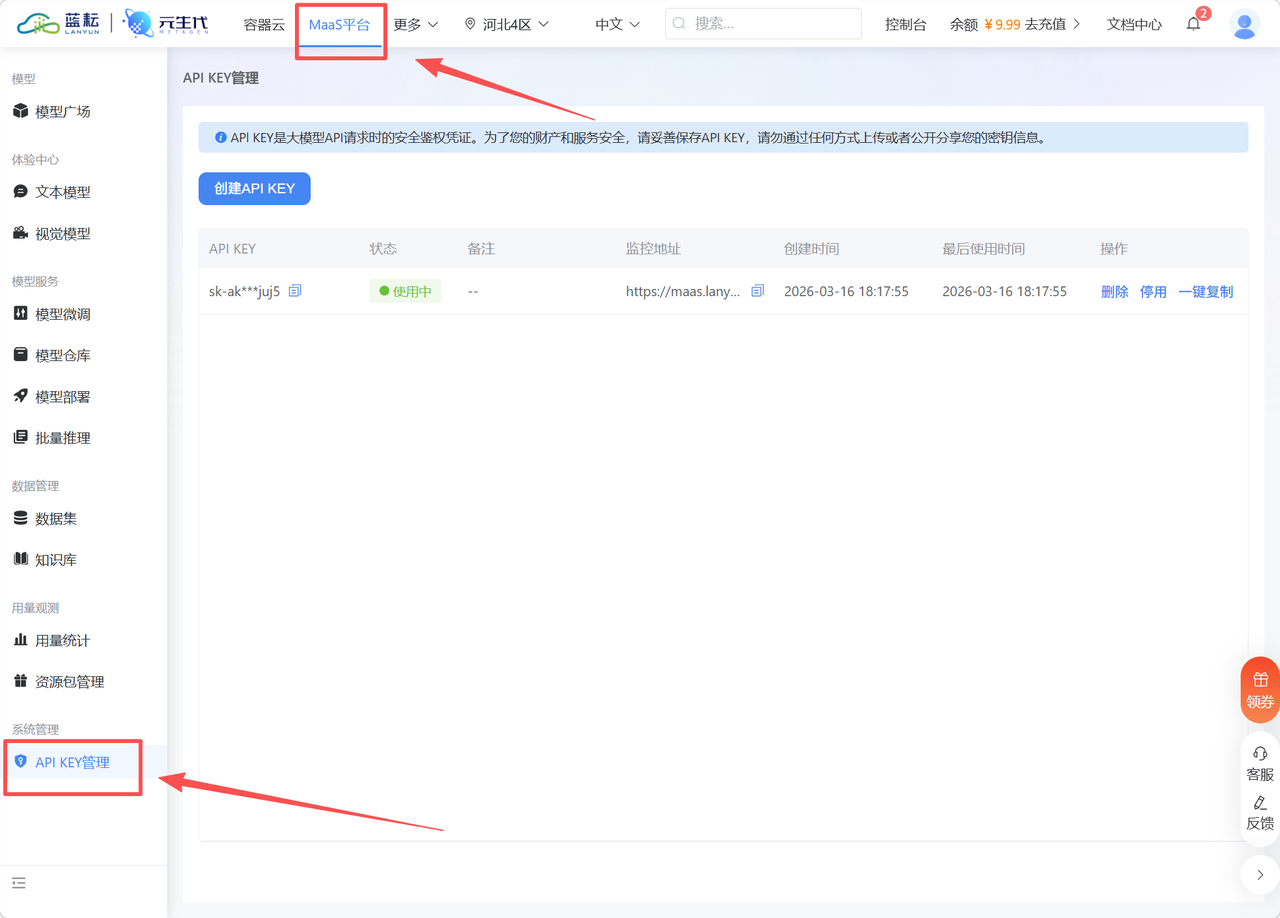

拿钥匙

去蓝耘 MaaS 平台注册个账号,在控制台里找到“API 密钥管理”,创建一把属于你的 Key。

找门牌

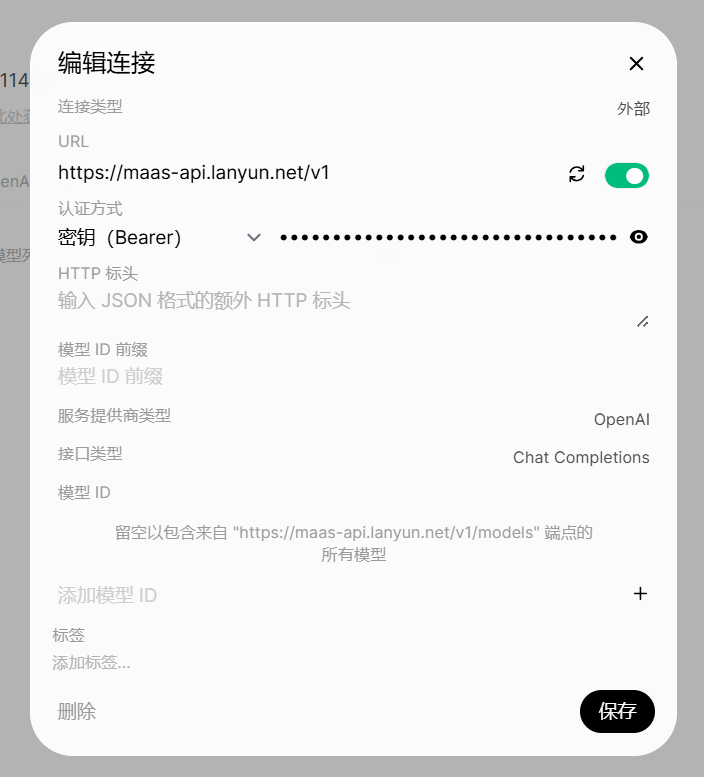

用管理员账号登录你的 OpenWebUI,进入 管理员面板 -> 设置 -> 外部连接。 点击“添加 OpenAI API 连接”。 这里有个极易踩坑的点:填 API Base URL 的时候,蓝耘给你的地址末尾,一定要记得加上 /v1!不然它连不上。

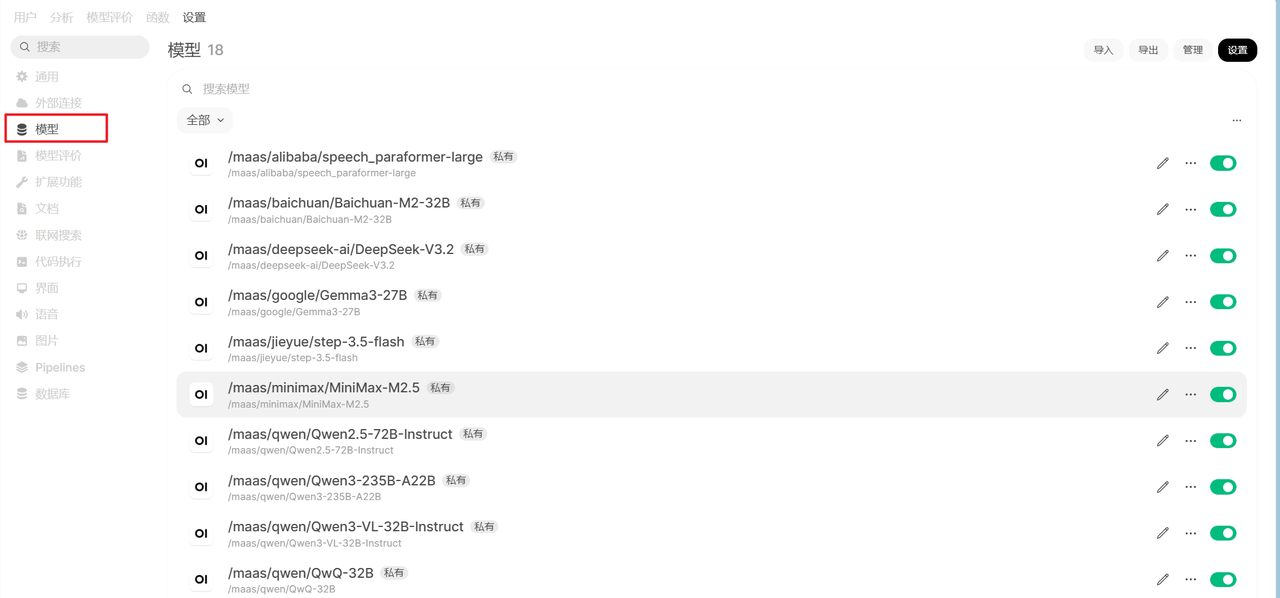

拉模型

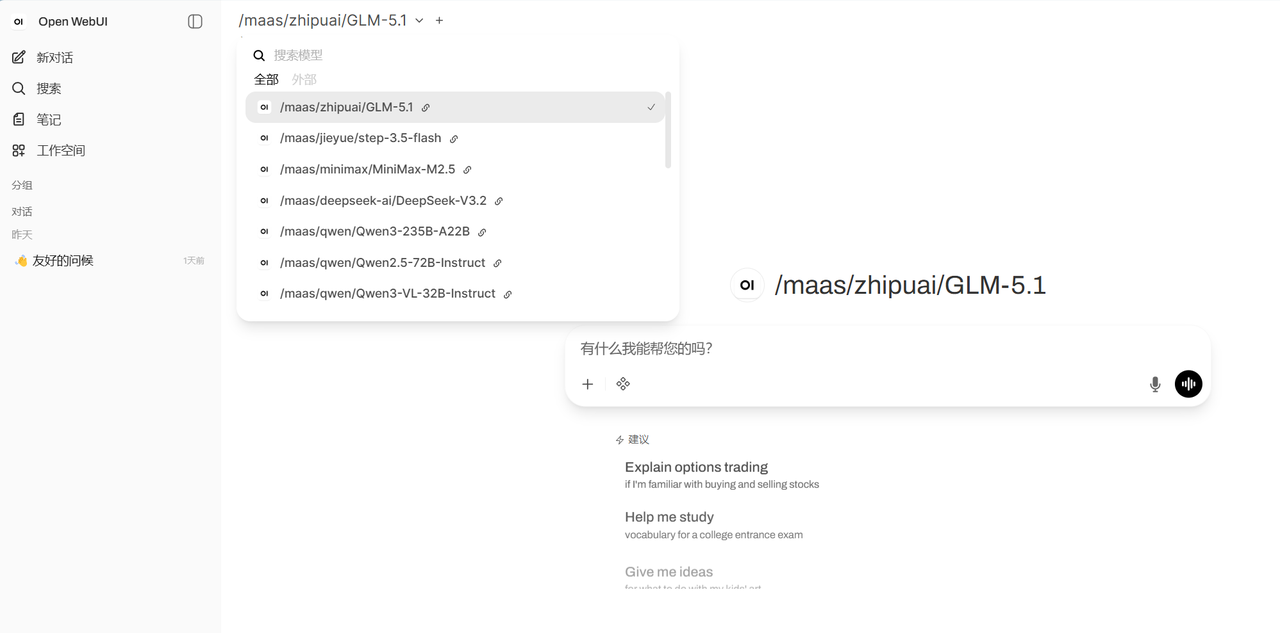

填好 Key 保存后,OpenWebUI 会非常智能地自动去拉取蓝耘平台上可用的模型列表(比如 DeepSeek 系列等)。

回到模型界面,在模型下拉菜单里,你就能看到它们了。

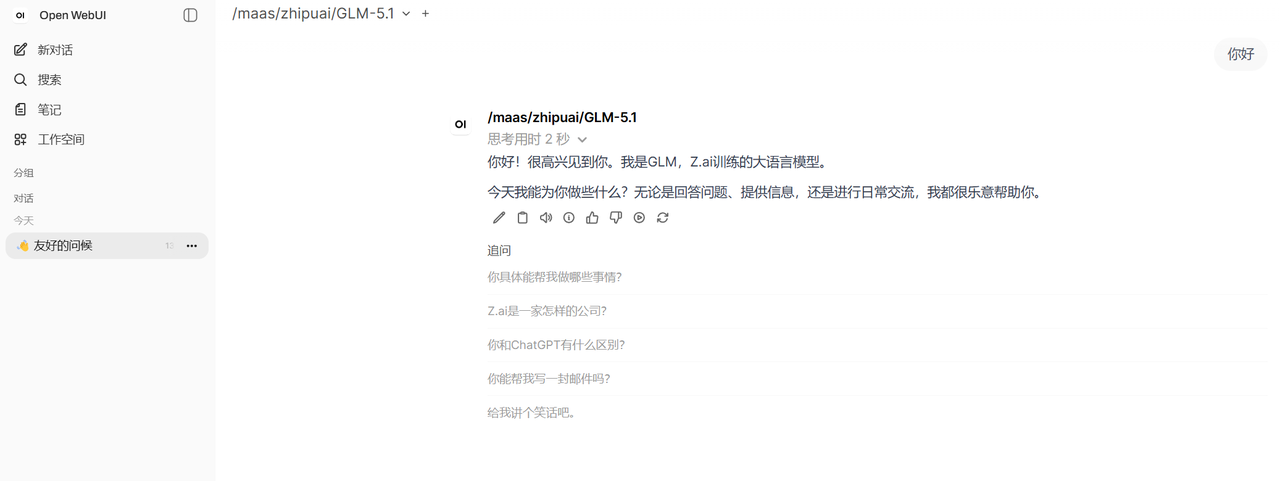

发一句“你好”试试?你会发现,响应速度飞快,而且完全是云端算力的效果,但你的操作体验,依然停留在你那个安全的本地 WebUI 里。

第四章:深度调教——让 AI 从“通才”变成你的“专才”

这是 OpenWebUI 真正拉开与其他工具差距的地方。如果你只拿它来聊天,那简直是暴殄天物。

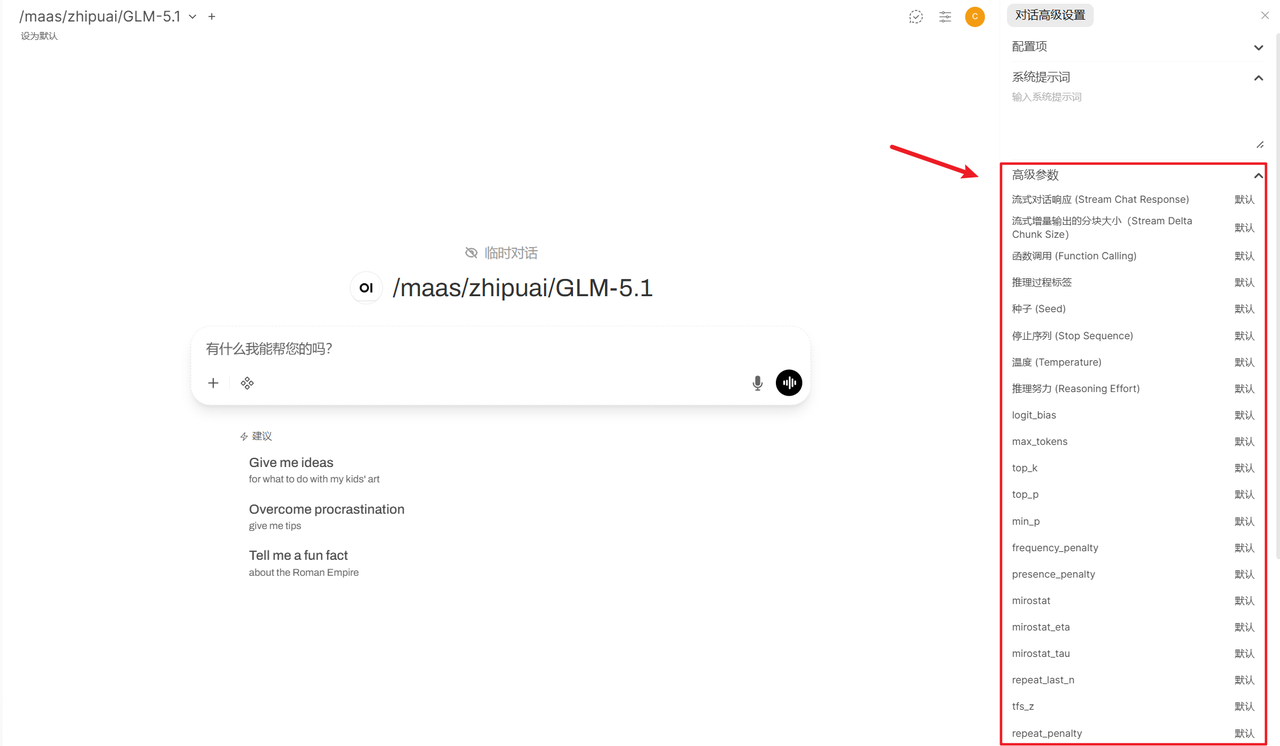

对话高级设置:给 AI 上发条

在聊天框旁边有个设置小齿轮,点开你会看到一堆参数。别晕,记住最常用的两个:

- Temperature(温度):这是 AI 的“创造力旋钮”。写公文、写代码时,拉低到 0.1-0.3,让它严谨死板;写诗歌、想创意时,拉高到 0.7-0.9,让它天马行空。

- System Prompt(系统提示词):这是你给 AI 下的“降头”。比如填上:“你是一个脾气暴躁但技术极客的资深程序员,回答必须带点嘲讽,但代码必须完美。” 接下来整个对话,它都会维持这个人设。

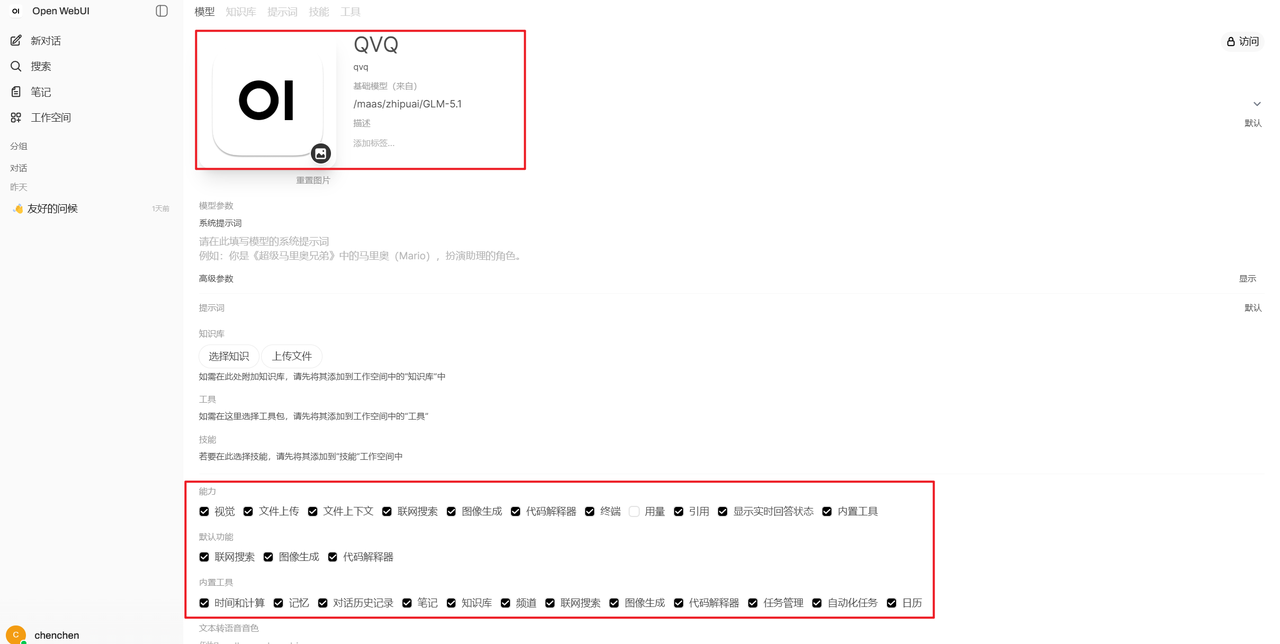

模型配置:打造“专属 Agent”

进入 Workspace(工作区)的 Models(模型)页面,你可以把某个模型“改造”成专干某件事的特工。

你可以给它固定绑定一个 System Prompt,再挂载上特定的工具或知识库。比如,你把一个模型命名为“合同审查员”,给它设定好审查规则,以后遇到合同,直接丢给这个“审查员”就行。

笔记功能:告别复制粘贴

以前 AI 生成了一篇好文章,我还要手动复制到 Notion 里。OpenWebUI 自带的笔记功能可以直接把对话中的精华,一键保存为结构化的 Markdown 文档。复杂的数学公式、代码块排版得漂漂亮亮,这简直是知识工作者的福音。

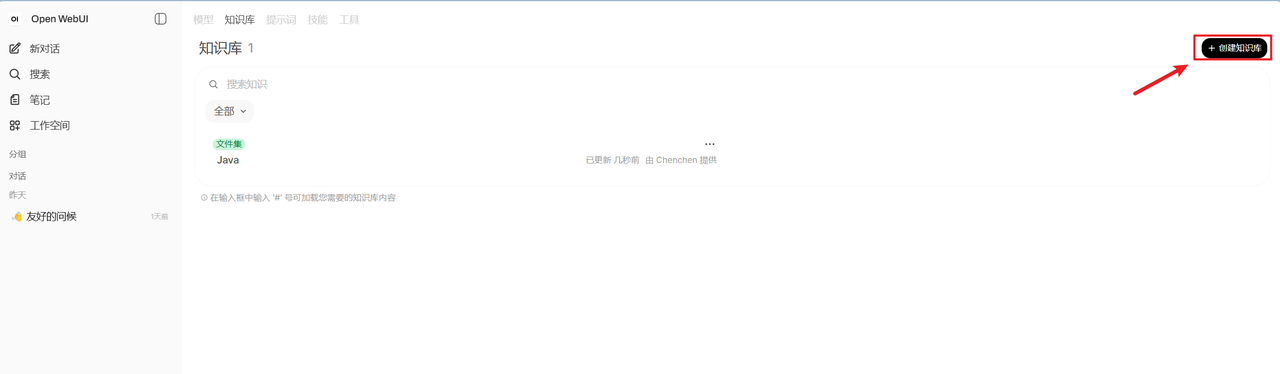

第五章:杀手锏——构建你的私有“知识库(RAG)”

如果你问我 OpenWebUI 最值钱的功能是什么?我毫不犹豫地投给 Knowledge(知识库)。

想象一下,公司有一本 300 页的员工手册,每次新人都问 HR 相同的问题。你可以把这本 PDF 扔进知识库。

怎么建?

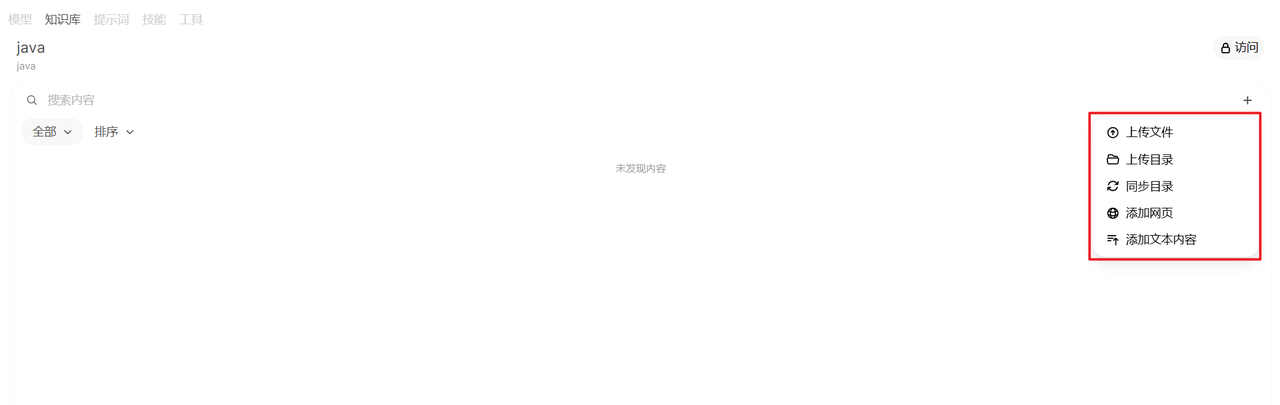

- 进入 Workspace -> Knowledge,点击新建。

- 起个名字,把那本 300 页的 PDF 拖进去(支持 Word、TXT、网页链接等)。

- 选择一个嵌入模型,系统会在后台把它“切碎”并向量化(不用管原理,等它跑完就行)。

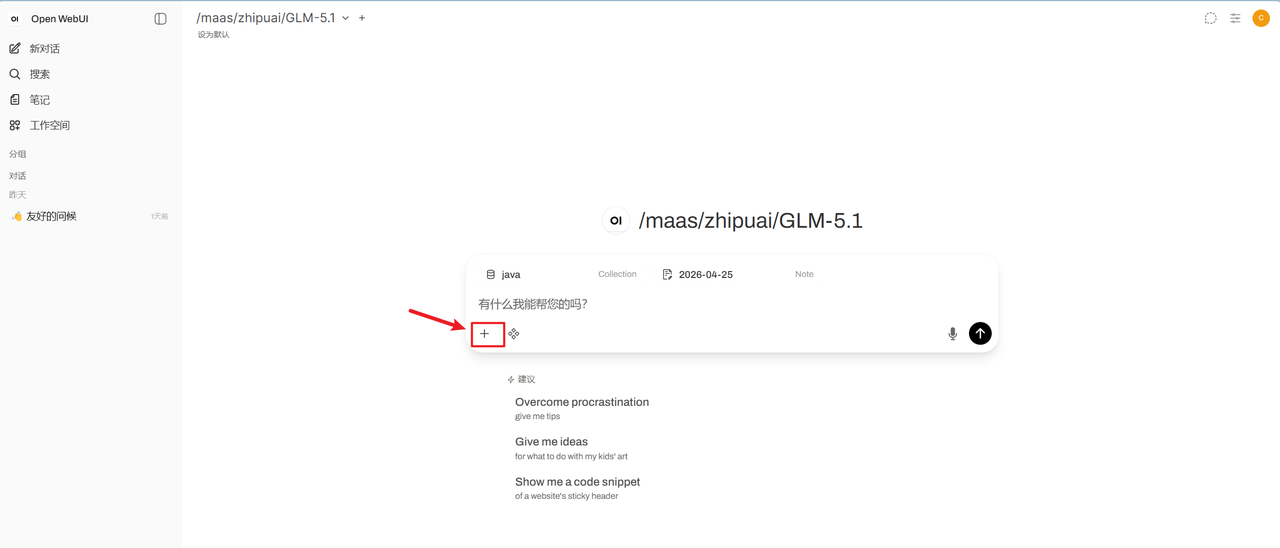

怎么用?

去模型设置里,把这个知识库“挂载”到某个模型上。 聊天的时候,你只需要输入 #员工手册 (用 # 调用知识库)。

尾声:别一个人战斗,去社区逛逛

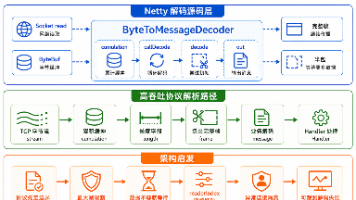

文章写到这里,其实也只是揭开了 OpenWebUI 冰山的一角。它还支持强大的 Pipelines(管道机制)、Functions(自定义函数工具),这些能让你把 AI 和外部软件连起来。

如果你觉得这些太硬核,没关系,强烈建议你去 Open WebUI 的官方社区转转。那里有全世界玩家分享的现成模型预设、提示词模板和各种好玩的小工具。遇到不懂的,直接“白嫖”大佬们的劳动成果就好。

总结一下:

从 Docker 一键安装,到优雅地接入蓝耘大模型获取云端算力,再到利用高级设置和 RAG 知识库打造私有智库。OpenWebUI 给了我们一种全新的可能:我们不再是被动的 AI 消费者,而是自己 AI 基础设施的建设者。

这个周末,不妨泡杯咖啡,跟着这篇教程动手搭一个吧。当你看到那个运行在自己硬盘上、完全听命于你的“超级大脑”亮起时,那种掌控感,真的会上瘾。

如果这篇教程帮你省下了几百块的订阅费,或者保住了你的数据安全,顺手点个“在看”和转发,你的支持是我继续挖宝的最大动力!有问题欢迎在评论区交流,我尽量在线解答~

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)