DeepSeek-V4发布:国产芯片跑万亿参数模型,价格仅为GPT的1/10(附企业AI选型指南)

4月24日,DeepSeek宣布全新系列模型DeepSeek-V4预览版本正式上线并同步开源。对于企业决策者来说,这意味着什么?可以用更低的成本使用性能接近国际顶尖水平的国产大模型,同时获得自主可控的技术保障。

V4-Pro版本参数达1.6万亿,支持百万字超长上下文,在智能体编程、数学推理等任务上已超越主流开源模型,接近Gemini等闭源系统。更关键的是,DeepSeek-V4适配华为昇腾等国产芯片,标志着国产AI从"组装厂"向"自主可控"转型。

本文将详细解析V4的技术突破、性能表现、价格策略,以及企业如何评估和应用这款国产大模型。

技术突破:从"死磕算力"到架构创新

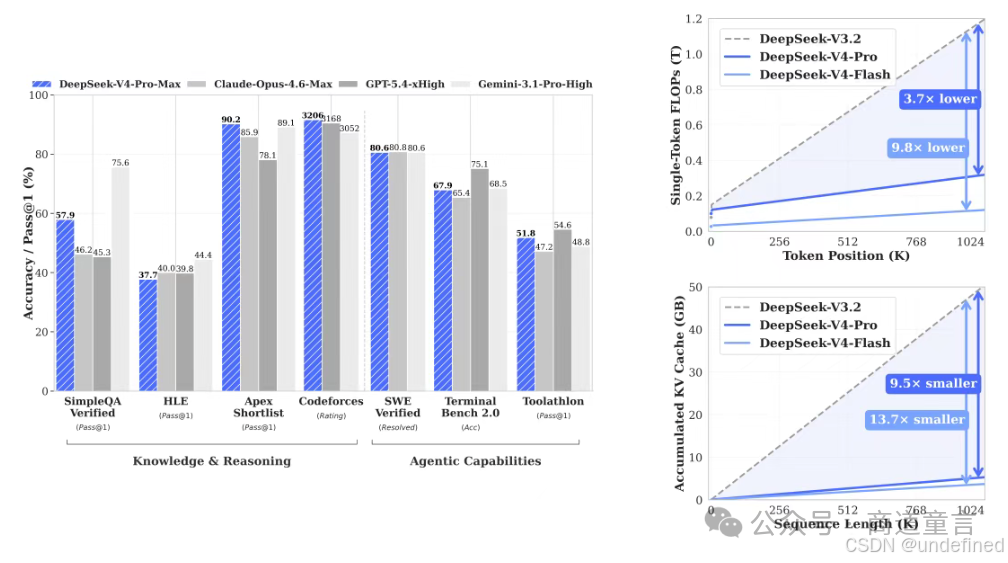

DeepSeek-V4开创了一种全新的注意力机制,在token维度进行压缩,结合DSA稀疏注意力(DeepSeek Sparse Attention),实现了全球领先的长上下文能力,并且相比于传统方法大幅降低了对计算和显存的需求。

数字经济应用实践专家骆仁童博士表示,DeepSeek-V4的发布,本质上是一场对传统Transformer架构"死磕算力"模式的颠覆。传统的大模型训练依赖大量算力堆叠,而DeepSeek通过架构创新,在保持性能的同时降低了对硬件的依赖。

V4模型分为Pro和Flash两个版本:

两个版本都支持1M(百万)上下文,同时支持非思考模式与思考模式。从现在开始,一百万上下文将是DeepSeek所有官方服务的标配。

性能全景:V4-Pro与V4-Flash如何选择

两个版本定位不同,企业需要根据自身需求选择。

V4-Pro:性能比肩顶级闭源模型

核心优势:

-

在Agentic Coding(智能体编程)评测中,达到当前开源模型最佳水平

-

在世界知识测评中,大幅领先其他开源模型,稍逊于顶尖闭源模型Gemini-Pro-3.1

-

在数学、STEM、竞赛型代码的测评中,超越当前所有已公开评测的开源模型

-

Pro-Max推理扩展后在标准推理基准上优于OpenAI的GPT-5.2、谷歌Gemini-3.0-Pro

适用场景:

-

复杂推理任务

-

高质量代码生成

-

深度知识问答

-

企业级智能体开发

V4-Flash:快捷高效的经济之选

核心优势:

-

推理能力接近V4-Pro

-

响应速度更快

-

API价格更低

-

在简单任务上与V4-Pro旗鼓相当

适用场景:

-

简单对话交互

-

快速文本生成

-

成本敏感型应用

-

高并发场景

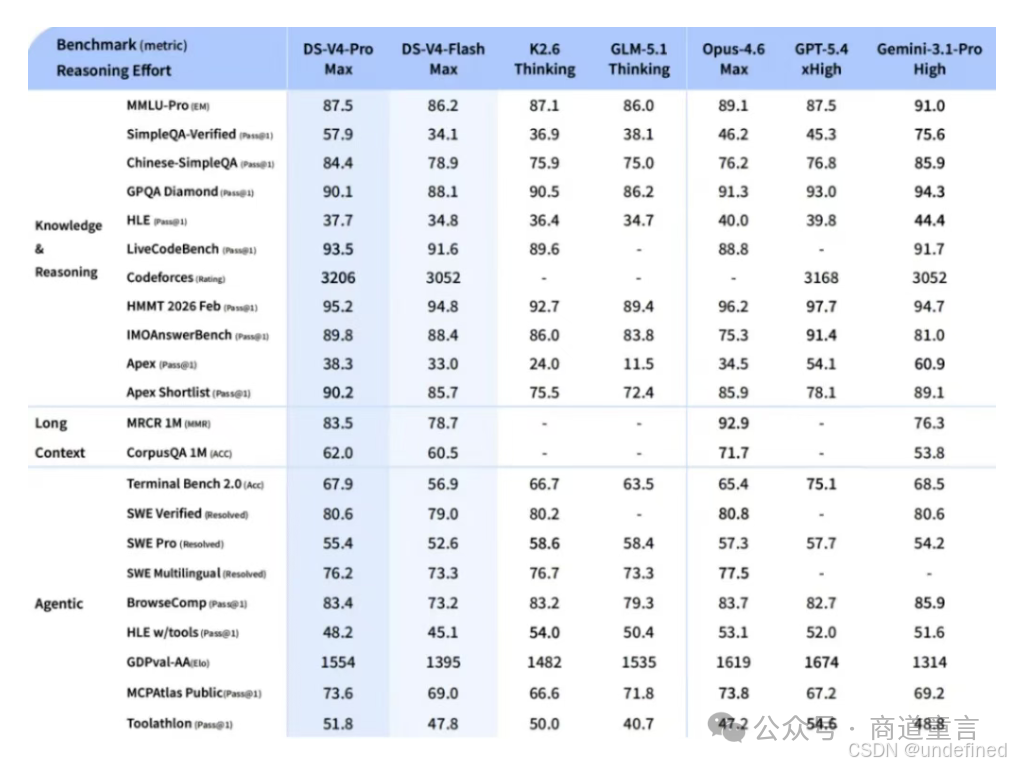

性能对比表

|

评测维度 |

V4-Pro |

V4-Flash |

GPT-5.2 |

Gemini-3.0-Pro |

|

智能体编程 |

开源最佳 |

简单任务相当 |

- |

- |

|

世界知识 |

领先开源 |

稍逊 |

- |

领先 |

|

数学推理 |

比肩闭源 |

接近Pro |

- |

- |

|

整体推理 |

落后前沿3-6个月 |

接近Pro |

逊于Pro-Max |

逊于Pro-Max |

国产化适配:华为昇腾与自主可控的价值

DeepSeek-V4最值得关注的是其国产化适配。从推文来看确实是与华为昇腾合作。DeepSeek表示,受限于高端算力,目前Pro的服务吞吐十分有限,预计下半年昇腾950超节点批量上市后,Pro的价格会大幅下调。

数字经济应用实践专家骆仁童博士表示,DeepSeek-V4适配华为昇腾、寒武纪等国产芯片,摆脱对英伟达FP8生态的依赖。DeepSeek的这一步,是国产AI从"组装厂"向"自主可控"转型的关键一步。

对企业意味着什么?

对于政府、金融、能源等关键行业:

-

满足自主可控要求

-

降低供应链风险

-

符合国家安全战略

对于一般企业:

-

避免被国外技术"卡脖子"

-

长期成本可控

-

支持国产AI生态发展

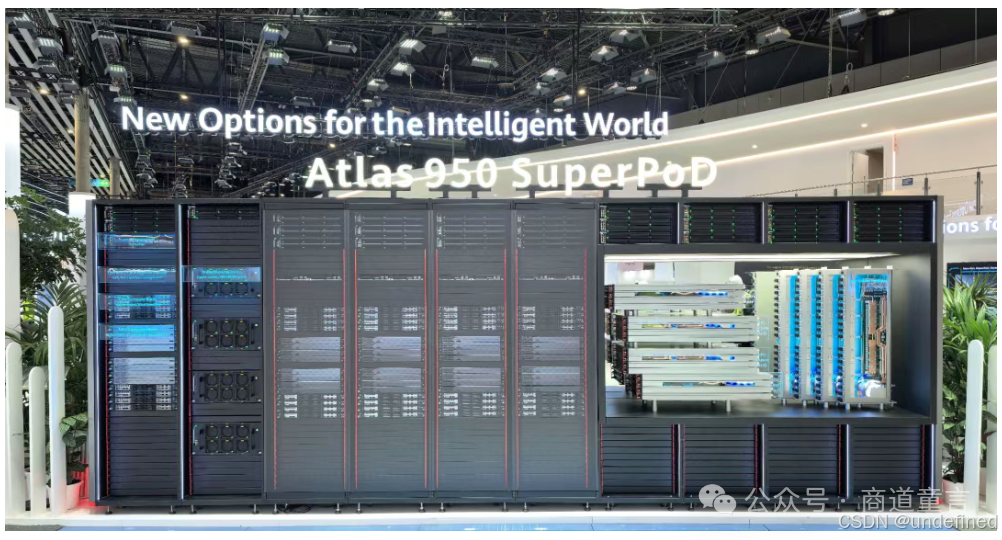

国产算力现状

华为昇腾拿出了384超节点,通过12个机柜,每个机柜32张卡,硬是堆出300 PFLOPs算力,接近NVL72的两倍。今年华为最新的Atlas 950,也就是8192卡互联的超节点已经亮相。

DeepSeek用V4证明了国产芯片能跑万亿参数的旗舰模型,Kimi用架构创新证明了国产芯片可以跑得好、跑得省。一个从工程适配切入,一个从架构设计切入,终点都是同一个:让英伟达不再是唯一选项。

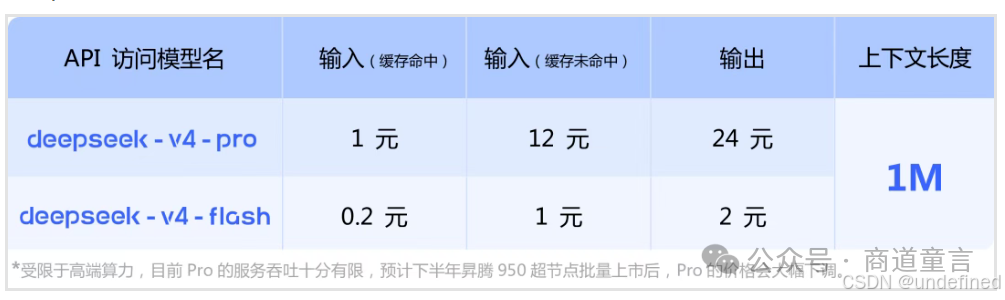

价格策略:普惠定价如何降低企业成本

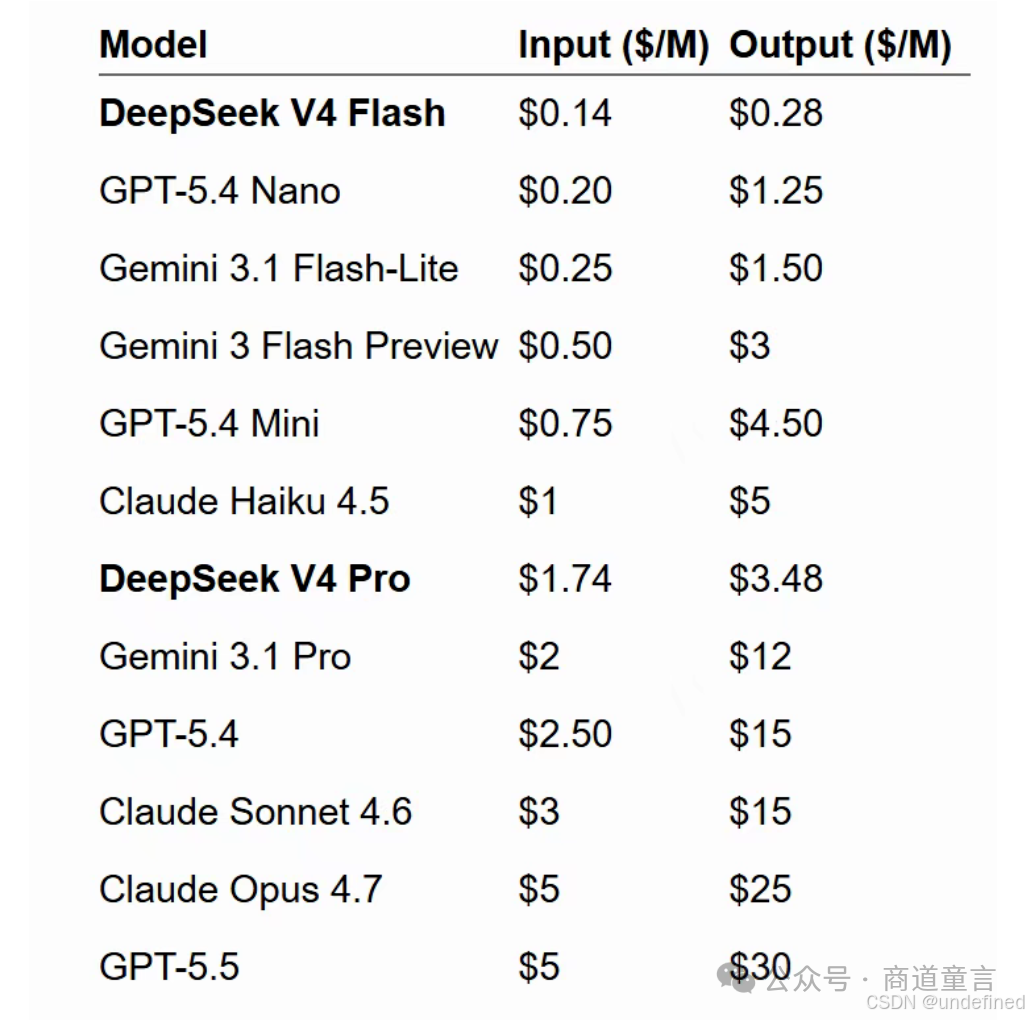

从价格看,DeepSeek的定价策略非常激进:

与主流闭源模型相比,DeepSeek的价格优势明显:

-

V4-Pro输入价格:约为GPT-4的1/10

-

V4-Flash输入价格:约为GPT-4的1/50

-

V4-Flash输出价格:约为GPT-4的1/20

"太普惠了,还是那个DeepSeek。"有网友感慨。数字经济应用实践专家骆仁童博士表示,DeepSeek选择同步开源V4,绝非简单的技术分享,而是一场推动AI技术民主化的平权运动。让AI不再是少数巨头的专属工具,而是成为普惠大众的基础设施。

成本计算示例

假设企业每月需要处理1000万tokens的输入和输出:

|

模型 |

月度成本(元) |

|

GPT-4 |

约100,000 |

|

Claude 3 |

约80,000 |

|

DeepSeek V4-Pro |

约13,000 |

|

DeepSeek V4-Flash |

约2,200 |

使用DeepSeek V4-Flash,企业可以节省约98%的AI调用成本。

企业应用场景:DeepSeek-V4能做什么

场景1:智能客服

需求:24小时在线、多轮对话、知识库检索

V4优势:

-

百万上下文支持完整对话历史

-

强大的推理能力处理复杂问题

-

低成本支持高并发

适用版本:V4-Flash(成本优先)或V4-Pro(质量优先)

场景2:代码生成与辅助

需求:理解业务逻辑、生成高质量代码、代码审查

V4优势:

-

Agentic Coding能力达到开源最佳水平

-

内部使用反馈优于Claude Sonnet 4.5

-

支持长上下文理解大型项目

适用版本:V4-Pro(质量优先)

场景3:数据分析与报告生成

需求:理解复杂数据、生成分析报告、推理结论

V4优势:

-

强大的数学和STEM能力

-

推理能力接近顶级闭源模型

-

百万上下文支持大规模数据分析

适用版本:V4-Pro(质量优先)

场景4:内容创作与营销

需求:生成营销文案、创意写作、多语言支持

V4优势:

-

世界知识储备丰富

-

推理能力强,逻辑清晰

-

低成本支持大规模内容生成

适用版本:V4-Flash(成本优先)

企业评估指南:如何选择DeepSeek-V4

企业在评估是否使用DeepSeek-V4时,需要考虑以下几个关键因素:

首先是性能匹配度。如果企业的应用场景需要强大的推理能力和世界知识储备,V4-Pro是更好的选择。如果主要处理简单任务,追求响应速度和成本控制,V4-Flash可能更合适。

其次是国产化需求。对于有自主可控要求的企业,特别是政府、金融、能源等关键行业,DeepSeek-V4适配国产芯片的特性具有重要价值。企业可以评估现有硬件环境,考虑是否需要部署华为昇腾等国产算力平台。

第三是成本效益。企业需要根据自身的API调用量和使用频率,计算使用DeepSeek-V4的总成本。相比国外闭源模型,DeepSeek的价格优势明显,但也要考虑模型切换的学习成本和适配成本。

第四是生态支持。DeepSeek API已同步上线V4-Pro与V4-Flash,支持OpenAI ChatCompletions接口与Anthropic接口。这意味着企业现有的代码和工具链可以相对平滑地迁移到DeepSeek平台。

风险提示与局限性

企业在决策时也需要了解DeepSeek-V4的局限性:

-

推理能力仍有差距:官方表示总体约落后前沿闭源模型3-6个月

-

Pro版本吞吐有限:受限于算力,目前Pro服务吞吐有限

-

生态仍在建设:相比OpenAI生态,第三方工具和集成较少

-

文档和社区:文档完善度和社区活跃度有待提升

行业影响:国产AI生态的新篇章

黄仁勋曾在播客访谈里说了一句话:“如果当初 DeepSeek 先在华为平台上发布,那对我们来说非常可怕。”DeepSeek-V4的发布不仅是单一产品的更新,更是国产AI生态发展的重要里程碑。从硬件到软件,从模型到生态,全链路国产化,是必须要做的。这样才能真正不被英伟达等国外公司卡脖子。

当英伟达的GPU不再是唯一选择,当CUDA护城河不再牢固,当咱们的AI人才越来越多,生态越来越繁荣,产业界的底气自然也会越来越足。

最近一个月大家应该有感知,大模型的能力越来越强,强到已经不只是能对话的程度了。也就是说,AI已经不仅仅是一个对话窗口,一个效率工具,一个智能助手。未来甚至现在的模型,已经进化到可以在网络安全层面进行攻防了。这意味着AI已经从普通人使用的工具,成长为国家之间攻防的矛与盾。

DeepSeek想要表达的其实是:不用美国的芯片和技术,我们自己也能做出足够先进的大模型。这波操作一方面是真的争气,另一方面,其实也是在把DeepSeek变成一个标杆,向其他国产大模型喊话:全国产链路已经跑通了,你们都可以来试试。

回头看DeepSeek V4发布通告的结束语:不诱于誉,不恐于诽,率道而行,端然正己,这不仅是对国内AI公司应当脚踏实地的宣言,更是对国产AI硬件生态,这么多年一步一步走过来的肯定。

结语

DeepSeek-V4的发布,给企业提供了一个新的选择:更低成本、更自主可控、性能接近国际顶尖水平的国产大模型。

数字经济应用实践专家骆仁童博士表示,DeepSeek选择同步开源V4,绝非简单的技术分享,而是一场推动AI技术民主化的平权运动。让AI不再是少数巨头的专属工具,而是成为普惠大众的基础设施。

对于企业决策者来说,现在是评估和尝试DeepSeek-V4的好时机。从小规模测试开始,逐步验证其在你的业务中的价值。

回头看DeepSeek V4发布通告的结束语:不诱于誉,不恐于诽,率道而行,端然正己,这不仅是对国内AI公司应当脚踏实地的宣言,更是对国产AI硬件生态,这么多年一步一步走过来的肯定。

小提问:你的企业是否正在评估国产大模型?

在选择AI模型时,你最看重的是性能、成本还是自主可控?

欢迎在评论区分享你的观点。

END

相关话题:

从拒绝到寻求融资:DeepSeek的100亿美元估值,藏着技术型企业融资决策的3个逻辑

从Kimi纠纷到DeepSeek典范看科技创业股权结构的胜败之道

观点 | DeepSeek创始人梁文锋:中国AI需勇立技术前沿

从混合推理到智能体落地:DeepSeek 3.1如何改写开源大模型竞赛规则

热推新书《AI提问大师》《DeepSeek应用能手》现已上架!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)