一文读懂AI大模型底层逻辑

一,大模型的本质

传统大语言模型的逻辑是基于海量数据训练的统计预测机制,通过Transformer架构捕捉语言模式,实现对上下文的理解与生成。它并非真正“理解”语言,而是通过学习文本中的复杂规律,预测最可能的下一个词,从而生成连贯的回复。

具体来说,其核心逻辑包含以下几个层面:

1,自回归预测(Autoregressive Prediction)

模型以“填空”方式工作:给定前文,逐个预测下一个词。例如输入“今天心情有点……”,模型会根据训练数据中类似语境的统计规律,计算出“低落”“复杂”“好”等词的概率分布,并选择最高概率的词输出。

2,Transformer架构与自注意力机制

传统大模型普遍采用 Transformer 构造其“大脑”。其中的 自注意力(Self-Attention) 机制让模型能动态判断句子中哪些词更相关。

例如在句子“他去了银行取钱”中,模型会自动加强“银行”与“钱”之间的关联权重,而弱化“他”与“去了”的语法连接,从而更准确把握语义重点。

3,两阶段训练路径

预训练(Pre-training):在万亿级文本(如网页、书籍、代码)上进行无监督学习,掌握语言结构和世界知识。

微调(Fine-tuning):通过人工标注或人类反馈强化学习(RLHF),使模型输出更符合人类偏好,比如有礼貌、有逻辑、不违规。

3,知识压缩与模式泛化

大模型将人类语言知识压缩进数十亿参数中,形成一种“隐式知识库”。当面对新问题时,它不是检索答案,而是基于相似语境的模式进行泛化推理,因此能应对从未见过的任务。

4,局限性:无真正理解,依赖统计规律

尽管表现强大,但传统大模型并不具备人类的认知能力。它的“逻辑”本质上是高维空间中的向量运算和概率推断,容易产生“幻觉”(编造事实)或在复杂推理任务中出错,除非经过专门增强。

这就是大语言模型的本质:文本拼接器。

二,大模型究竟是如何运作的

AI大模型的运作核心是通过Transformer架构对海量文本进行模式学习,以概率预测方式生成语言,实现从输入到输出的智能映射。它并非“思考”,而是基于数据统计和神经网络计算的复杂函数拟合。

具体运作流程可分为以下关键步骤:

1,输入编码:文本转为向量序列

用户输入的自然语言首先被拆解为“token”(如词或字),每个token通过词表映射为数字ID,再经嵌入层(Embedding) 转换为高维向量。同时加入位置编码(Positional Encoding),使模型能识别词序关系。

2,上下文理解:自注意力机制动态加权

在Transformer的每一层中,自注意力机制会计算所有token之间的相关性权重,决定哪些词对当前预测更重要。例如在“猫追老鼠,它跑得很快”中,模型会自动强化“它”与“猫”之间的关联,而非“老鼠”。

3,深层特征提取:多层Transformer堆叠处理

模型通常包含数十层Transformer块,每层进一步提炼语义特征。前几层捕捉语法结构,深层则理解抽象语义和逻辑关系,形成对输入的完整“理解”。

4,输出生成:自回归式逐词预测

模型以自回归方式逐个生成输出token:每一步预测最可能的下一个词,并将其作为下一轮输入的一部分,直到完成整个回复。这个过程基于概率分布采样,可引入温度参数控制创造性。

5,知识来源:预训练+微调的双重塑造

预训练:在万亿级文本上学习通用语言规律,将知识“压缩”进参数中;

微调:通过指令数据或人类反馈(RLHF)调整输出风格,使其更符合人类偏好,如逻辑性、安全性等。

6,工程实现:上下文窗口与推理优化

实际应用中,模型受限于上下文长度(如32k、128k tokens),过长对话会截断旧内容。同时使用KV缓存、量化推理等技术提升响应速度与资源效率。

三,什么是 token?

实际上,大语言模型是个文盲,它完全不懂 look in my eyes 的含义,只会利用一个叫分词器的家伙,把这些文本进行切割,切完的小文本就是一个个 token。

为什么要切?

前面我们提到大语言模型的本质是文本拼接器,那么只有把大文本切成一个一个小文本,才好按照概率排名来选择“下一个词”,近而得到“合理”的回答。

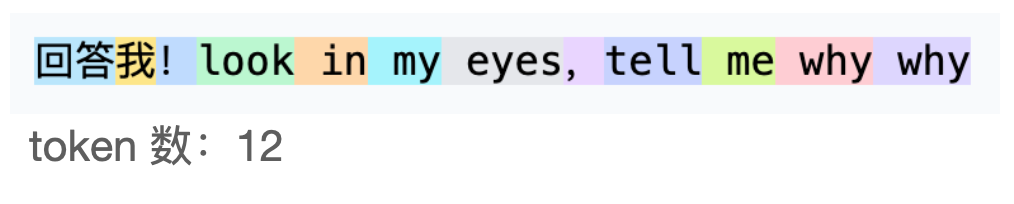

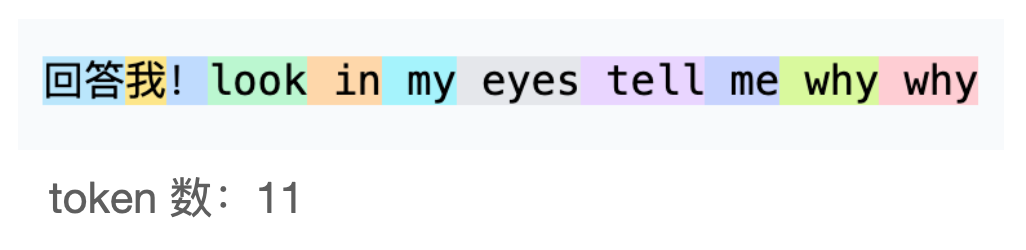

可能这样切。

也可能这样切。

这完全取决于不同大模型的分词方法。比如通过统计学来实现分词,在统计大量文本后发现“回答” 这两个字,经常出现,那么“回答”就可以变成一个 token。发现 “!” 经常出现,那么“!”也是一个 token。发现“ing” 经常出现,那么 “ing” 也是一个 token。所以 token 可以是一个单词、单词组合、标点符号甚至是单词的一部分。如果说我们人类以字为基本语言单位,那么大语言模型就是以 token 为基本语言单位。除此之外,token 还有一个非常现实的作用:计费。

token 数代表了大语言模型在计算和生成内容时所消耗的资源。

这里还有一个概念叫做上下文窗口。

简单理解就是大模型可以处理 token 数量,上下文越大,能处理的 token 数越多。能处理的 token 数量越多,大模型对信息理解就会越充分,最终给出的结果就会更“合理”。

四,模型训练的基本原理

模型训练的基本原理是通过调整模型参数,使其在给定数据上最小化预测误差,从而学习到数据中的潜在模式与规律。这一过程本质上是优化一个损失函数,让模型逐步逼近真实的数据分布。

具体来说,模型训练包含以下几个核心环节:

1,数据驱动学习

模型从大量标注或无标注数据中学习输入与输出之间的映射关系。在监督学习中,模型通过对比预测结果与真实标签(Ground Truth)来计算误差;在无监督或自监督学习中,则通过重构输入、预测缺失部分等方式隐式学习结构。

2,前向传播与损失计算

输入数据经过模型的多层计算得到输出结果,称为前向传播。随后使用损失函数(如均方误差、交叉熵)量化预测值与真实值之间的差异,形成优化目标。

3,反向传播与参数更新

通过反向传播算法,将损失值沿网络反向传递,计算每个参数对损失的梯度。再结合优化器(如SGD、Adam)根据梯度调整权重和偏置,使模型在下一次预测时更准确。

4,迭代优化与泛化能力提升

训练过程是反复迭代的:每轮遍历一批数据(batch),更新参数,直到模型在验证集上的性能趋于稳定。为防止过拟合,常采用正则化、早停、数据增强等策略,提升模型对新数据的泛化能力。

5,预训练与微调的现代范式

当前大模型普遍采用“预训练 + 微调”两阶段模式:

预训练:在海量通用数据上学习语言或视觉的通用表征;

微调:在特定任务的小规模标注数据上进一步调整,实现高效迁移。

6,硬件与分布式支持

大规模模型训练依赖GPU/TPU集群和分布式计算框架(如PyTorch Distributed、Horovod),以并行处理数据和参数更新,缩短训练周期。

五,推理过程的运作机制

大模型推理过程的运作机制是模型在完成训练后,基于输入内容通过自回归方式逐 token 生成输出,实现对新数据的快速理解与响应。这一过程并非“思考”,而是高效调用已学知识的模式匹配与概率预测。

具体机制可分为以下几个关键阶段:

1,输入编码与上下文构建

用户输入(如问题或指令)首先被分词器拆解为 token 序列,每个 token 转换为高维向量,并加入位置编码以保留顺序信息。历史对话也会被拼接进来,形成完整的上下文输入。

2, Transformer 层的前向计算

上下文向量依次通过多层 Transformer 块进行处理。每层中的自注意力机制动态计算 token 间的相关性权重,使模型能聚焦关键信息;前馈网络则进一步提取抽象语义特征。

3,KV 缓存优化推理效率

在生成过程中,模型会将每一层注意力计算得到的 Key 和 Value 向量缓存(KV Cache),避免重复计算。这显著降低延迟,尤其在长文本生成中提升吞吐量。

4,自回归式输出生成

模型以当前上下文为基础,预测下一个最可能的 token。该 token 被添加到输入序列中,作为下一轮推理的新输入,如此循环直至生成结束符或达到长度限制。

5,采样策略控制输出风格

预测时采用概率采样(如 top-k、top-p、temperature 调整),决定是否选择高概率词还是引入随机性。这影响输出的确定性与创造性,例如低温度更严谨,高温度更具发散性。

6,高效推理技术支撑实时响应

实际部署中广泛使用模型量化(如 INT4)、推测解码(Speculative Decoding)和批处理(Batching)等技术,在保证质量的同时大幅压缩计算资源消耗。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)