Kimi K2.6技术解析:MoE架构+MuonClip优化器,开源模型这次真的翻身了

2026年4月20日,月之暗面发布了Kimi K2.6并开源权重。开源代码模型首次在主流基准测试中超越GPT-5.4——这事说起来挺让国内开发者振奋的,但冷静下来想想,我们更想知道的是:这套技术到底是怎么做到的?300个Agent是怎么协同的?本文从技术视角聊聊。

一、技术架构:MoE + MuonClip

1.1 MoE架构参数

K2.6用了MoE(Mixture of Experts)架构,训练策略上有升级。先看参数:

┌─────────────────────────────────────────────┐

│ Kimi K2.6 架构概览 │

├─────────────────────────────────────────────┤

│ 总参数量 │ 1万亿(1T) │

│ 激活参数量 │ 320亿(32B) │

│ 专家数量 │ 384个,每token激活8个 │

│ 上下文长度 │ 256K tokens │

│ 训练数据量 │ 15.5万亿tokens │

└─────────────────────────────────────────────┘

简单说:推理时只激活32B参数,但能用上1T参数的知识储备。稀疏激活机制让性能和成本能兼顾。

1.2 MuonClip优化器

MoE大规模训练有个老大难问题:专家模块负载不均衡,有的被用烂了,有的几乎闲着。

Kimi团队搞了个MuonClip来治这个:

- Clip机制:自适应裁剪梯度,防止个别专家梯度爆炸

- Muon更新:用二阶信息更新参数,收敛更稳

- 负载均衡正则:内置均衡损失,让专家激活分布均匀

说实话,优化器这块以前不太受重视,但到了万亿参数规模,选什么优化器真的能决定训练成败。AdamW在超大规模场景下容易飘,MuonClip是个不错的解法。

二、性能对比:编程与Agent能力

2.1 编程能力基准

| 测试集 | Kimi K2.6 | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|

| Terminal-Bench 2.0 | 66.7 | 65.4 | 65.4 |

| SWE-Bench Pro | 58.6 | 57.7 | 53.4 |

| SWE-Bench Verified | 80.2 | — | — |

| SWE-Bench Multilingual | 76.7 | — | — |

2.2 Agent能力基准

| 测试集 | Kimi K2.6 | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|

| HLE-Full(工具调用) | 54.0 | 52.1 | 53.0 |

| DeepSearchQA | 83.0% | 63.7% | 80.6% |

| BrowseComp Agent Swarm | 86.3 | 78.4 | 56.7 |

DeepSearchQA比GPT-5.4高了将近20个点,Agent Swarm也强了8分。光看单点能力还不够震撼,但多Agent协作这块的提升确实有点东西。

三、实战案例

3.1 Zig语言优化(12小时自主进化)

用Mac(M3 Max)跑Qwen3.5-0.8B,让K2.6用Zig语言优化推理流程。

执行数据:

- 跑了12小时

- 工具调用4000+次

- 迭代了14轮

结果:

吞吐量: 15 tokens/s → 193 tokens/s

对比LM Studio:快20%

有意思的是,K2.6没专门学过Zig,但边学边干把活干完了。少样本场景下的代码生成和跨语言迁移能力,确实可以。

3.2 金融撮合引擎重构(13小时)

exchange-core是个高性能金融撮合引擎,有8年历史了。交给K2.6重构:

- 连续跑了13小时

- 改了4000+行代码

- 上了12套优化策略

结果:

中位吞吐量: 0.43 MT/s → 1.24 MT/s (+185%)

峰值吞吐量: 1.23 MT/s → 2.86 MT/s (+133%)

这种老代码重构+性能优化的活,传统做法需要资深工程师干好几周。不是说AI已经完全替代人了,但至少证明了可行性。

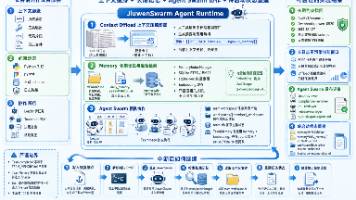

四、Agent集群:从100到300

4.1 规模对比

| 指标 | K2.5 | K2.6 |

|---|---|---|

| 子Agent数量 | 100个 | 300个 |

| 协作步骤 | 1500步 | 4000步 |

规模涨了3倍,复杂任务处理能力确实上了一个台阶。

4.2 协作机制

K2.6的Agent集群用分层调度:

用户请求

↓

K2.6 协调者(Coordinator)

↓

┌─────────────────────────────────────┐

│ 专家Agent池(300个) │

│ ├── 搜索Agent(多源并行) │

│ ├── 代码Agent(生成/审查/优化) │

│ ├── 分析Agent(数据处理/建模) │

│ ├── 文档Agent(报告生成/排版) │

│ └── 运维Agent(监控/告警/自愈) │

└─────────────────────────────────────┘

↓

任务输出

协调者按任务类型动态分配Agent,不用人工干预。

4.3 落地场景

场景1:量化策略分析

- 100个半导体标的 × 5套量化策略

- 自动出分析报告、建模表格、汇报PPT

场景2:科研论文转化

- 产出40页报告、7000字分析、2万+结构化数据、14张图表

场景3:RL基础设施运维

- 跑了5天没出故障

- 自动监控、故障响应、系统运维

五、第三方验证与成本

5.1 第三方测试

| 平台 | 测试场景 | 结果 |

|---|---|---|

| Vercel | Next.js基准性能 | 提升 >50% |

| CodeBuddy | 长上下文稳定性 | 提升 18% |

| CodeBuddy | 工具调用成功率 | 96.60% |

5.2 成本

K2.6 API成本约是Claude Opus 4.6的1/6。这个数字对需要大规模调用AI能力的团队来说,挺诱人的。

5.3 效率

平均步骤数减少约35%。意味着更少的Token消耗、更少的出错机会、更快的响应。

六、开发者指南:怎么接入K2.6

6.1 开源资源

- License: Modified MIT License

- 权重: HuggingFace已上线

- 使用限制: 个人随便用,商用看条款

6.2 接入建议

- 快速集成:直接用官方API,适合原型验证

- 数据隐私:本地部署建议用量化版本(4-bit/8-bit)

- 复杂任务:拆解后用Agent协同,别一股脑全丢给一个Agent

6.3 技术选型

| 场景 | 推荐方案 |

|---|---|

| 代码补全/生成 | K2.6 API |

| 复杂代码重构 | K2.6 + Agent集群 |

| 工具调用密集型 | K2.6(成功率96.6%) |

| 多Agent协作 | K2.6 + Claw群组(内测) |

七、一些思考

7.1 从"单点能力"到"系统智能"

K2.6已经不只是一个对话模型了,更像是Agent的OS。长周期自动coding、Agent Swarm协作、跨技术栈交付——这些以前要一整套工程体系才能做的事,现在一个模型加调度就能跑起来。

7.2 开源vs闭源

Reddit上有句话说得挺到位:“Open-source is no longer catching up, it’s starting to set the pace.”

开源模型在某些领域确实开始定义技术标准了,不只是跟着跑。

7.3 开发者的机会在哪

核心转变是:瓶颈从"怎么写代码"变成了"应该造什么"。

AI Agent接管了执行层,人的价值更多体现在:

- 任务定义和拆解

- 质量把控和验收

- 创新方向的选择

想清楚要什么,比会写代码更重要了。

总结

Kimi K2.6的开源发布,对国产模型是个里程碑事件。从技术角度,有几个值得关注的地方:

- MoE + MuonClip:给大规模模型训练提供了新的优化思路

- 300 Agent集群:多Agent协作的工程实现路径,有参考价值

- 成本:1/6的Claude价格确实诱人

- 实战:Zig优化、代码重构这些案例说明工程可用性已经不差了

感兴趣的话,建议自己上手试试。纸上学来终觉浅,跑个demo比看多少篇文章都有用。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)