想学习人工智能或者大模型技术的看过来!!!非常详细收藏我这一篇就够了

“技术的价值在于应用,理论与实践相结合才能事半功倍”

最近一段时间就发现了一个问题,写的越理论的东西看的人越多,越实际越细节的东西看的人越少,不知道是因为系统推送的原因,还是观看者的原因。

因此,根据这个现象就想提几个学习的建议,让大家少走一点弯路。

01人工智能技术学习建议

这个关于学习人工智能技术的建议,也可以说是一个学习技术的方法论。

首先大家要明白一点——(任何)技术都是一个更偏向于实践的东西,具体来说就是学习技术实践要大于理论,要以实践为主理论为辅,而不是反其道而行之,但是在实际的经历和观察中,我发现很多人却是以理论为主,实践为辅。

知行合一,在知中行,在行中知_

就拿这个公众号来说,越理论的东西看的人越多,真的涉及到实操的部分看的人反而变少了。

比如说,很多人对什么是人工智能,什么是神经网络,什么是大模型,什么是多模态大模型等等很感兴趣;但对大模型实际过程中的训练数据的收集与清洗,损失差和反向传播等核心操作却视若无睹。

但是这些理论的东西,每个理解过人工智能技术的人都能说上几句;但真的让他来实际操作从大模型的选型,模型的训练和部署来打造一个能用的大模型,这时他就开始傻眼了。

理论需不需要懂?

需要,但并不是特别需要;很多理论只是看别人的书和文章你是不会真正明白的,只有实际动手操作时才能真正理解理论。

就类似于java面试八股文,随便一个面试者都可以说上几句;但一旦涉及到具体的业务场景或技术场景,这时很多人就傻眼了,而这也是不同面试者之间的差距。

理论并不等于技术,技术也不等于理论,技术更多时候是理论和实践的结合;在实践中检验理论,在理论中指导实践,最后理论和实践互相验证,互相修正。

所以说,学习大模型技术最重要的是上手实践一下,不一定非要像openAI,谷歌,meta一样搞那么大的模型,哪怕只是设计一个两三层的神经网络模型,然后自己完成模型的设计,训练和部署也比一直看理论更有用。

或者是找一些开源的大模型项目,看看它们解决了哪些问题;是怎么做的,又为什么这么做,是否有其它解决方案;而且一些小模型个人电脑就可以跑的起来,或者找一些免费的GPU资源,比如谷歌的Colab平台。

这样你才能知道不同模型之间的差别是什么,怎么使用模型解决不同领域的问题等。

_学习大模型的三个方向_

很多人学习人工智能技术就一心扑在技术上,认为自己把技术学好了就一定能找到工作,一定能成为公司技术部核心成员;但大家要明白的一个事实是,技术是为业务服务的,技术的作用是解决业务问题,而不是搞学术研究。

学习大模型技术,个人认为有三个方向:

大模型基础技术大牛

说白了就是数学大牛,大模型技术本质就是一个数学模型,因此需要做这个方向的技术人员更多的是数学专业的大牛;比如说微分,概率,线性代数等。

他们的作用是设计更好的机器学习算法和打造更好的技术学习模型,比如怎么设计一个更好的神经网络,怎么设计更好的损失函数,怎么优化反向传播算法等。

这种工作更加偏向于底层技术和学术研究,而且这种人才待遇好,要求高,基本上不是名牌大学毕业的很难参与进来。

大模型“运维”人员

之所以说是“运维”人员,是这个方向需要做的就是根据企业的业务需求,找到合适的商业或开源模型,然后能够收集和处理训练数据,然后完成模型的训练,部署和升级等任务;能够熟练使用不同的模型和工具处理不同领域的问题。因为他们特别像传统的服务器维护人员,因此叫大模型“运维”。

这个技术方向就需要懂得大模型的基础理论,并且有很强的实操能力,然后有充足的业务经验,能够把大模型和业务场景相结合,因此这个更看重的是经验和实操,反而技术要求并不高,重要的是能够熟练使用各种工具。

大模型上层应用构建

再一个方向就是基于大模型构建上层应用,这个方向更像是一个传统的技术开发者,不需要了解大模型的运作原理,只需要能使用大模型的功能文档和接口文档即可,如果能懂一些大模型的理论就更好不过了。

个人建议

对大部分人来说,选择后两种方式比较好,最好是能把后两种方向结合起来。因为研究大模型基础技术的成本太高,绝大部分企业都没有足够的资金和技术来实现,因此其就业的压力和竞争力可想而知。

其次,后两个方向只需要有一定的经验和学习能力就可以做到,甚至很多程序员可以直接转行成为第三种大模型应用开发者。

所以,对大部分人来说,最好的选择就是搞大模型应用,门槛相对较低,前景广阔。

因此,对个人来说一定要弄清楚自己的定位,否则就会导致自己没有努力的方向;然后这个也想学,那个也想学,最后什么都会又什么都不会。

对技术人员来说,写作应该是一项必不可少的技能之一。写作的作用并不是说要你的文笔有多好,而是要把自己学习和思考的过程给记录下来,哪怕是错的。

一是方便后续回顾,二是写作的过程是一个从新思考的过程,有些不明白不清晰的地方在写作的过程中就会重新进行思考,这时就会有一个更加清晰的认识。

有句老话叫:“厉害的不是你学会了什么,而是你能够用简单的语言把你学的东西讲明白”。

学习是一个输入端过程,而写作是一个输出的过程。

最近两年大模型发展很迅速,在理论研究方面得到很大的拓展,基础模型的能力也取得重大突破,大模型现在正在积极探索落地的方向,如果与各行各业结合起来是未来落地的一个重大研究方向

大模型应用工程师年包50w+属于中等水平,如果想要入门大模型,那现在正是最佳时机

2025年Agent的元年,2026年将会百花齐放,相应的应用将覆盖文本,视频,语音,图像等全模态

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

给大家推荐一个大模型应用学习路线

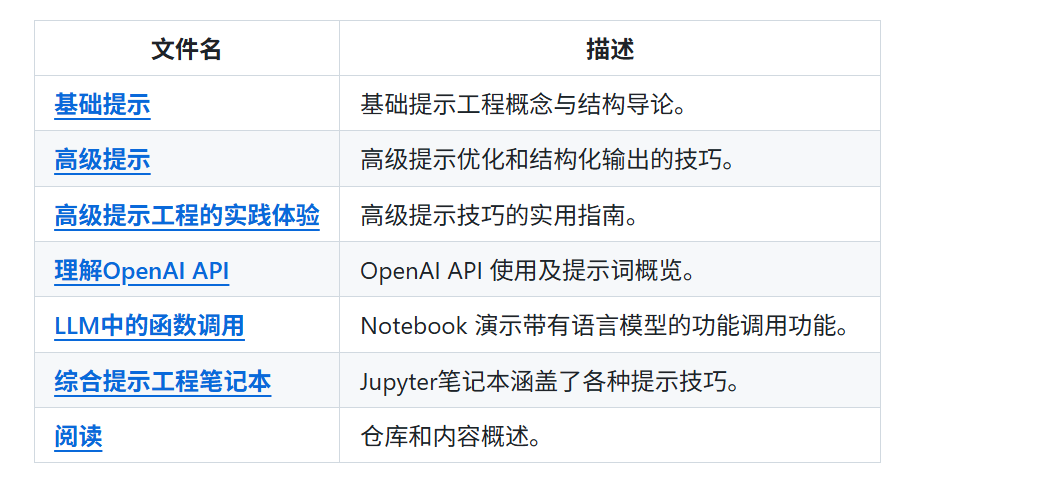

这个学习路线的具体内容如下:

第一节:提示词工程

提示词是用于与AI模型沟通交流的,这一部分主要介绍基本概念和相应的实践,高级的提示词工程来实现模型最佳效果,以现实案例为基础进行案例讲解,在企业中除了微调之外,最喜欢的就是用提示词工程技术来实现模型性能的提升

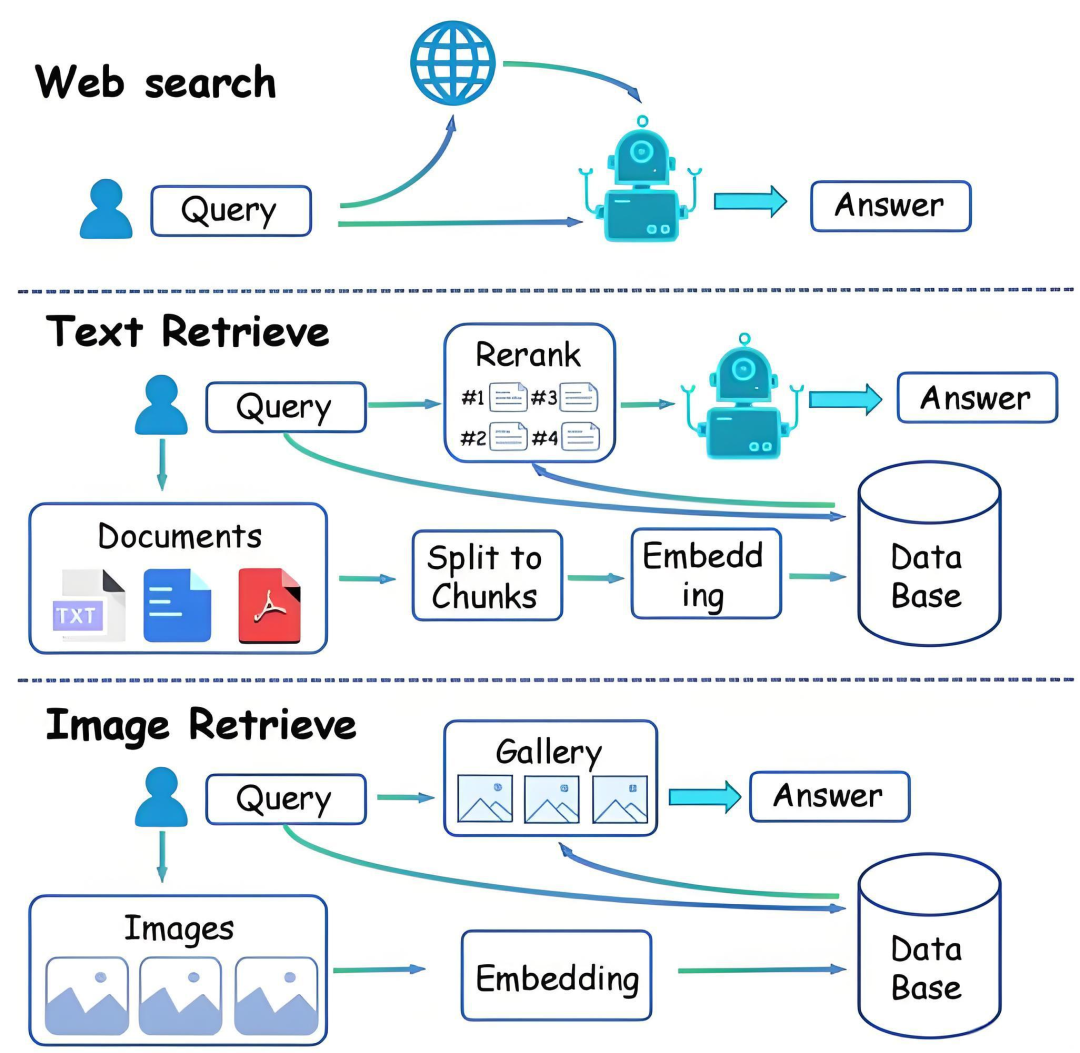

第二节:检索增强生成(RAG)

可能大家经常会看见RAG这个名词,这个就是将向量数据库与大模型结合的技术,通过外部知识来增强改进提升大模型的回答结果,这一部分主要介绍RAG架构与组件,从零开始搭建RAG系统,生成部署RAG,性能优化等

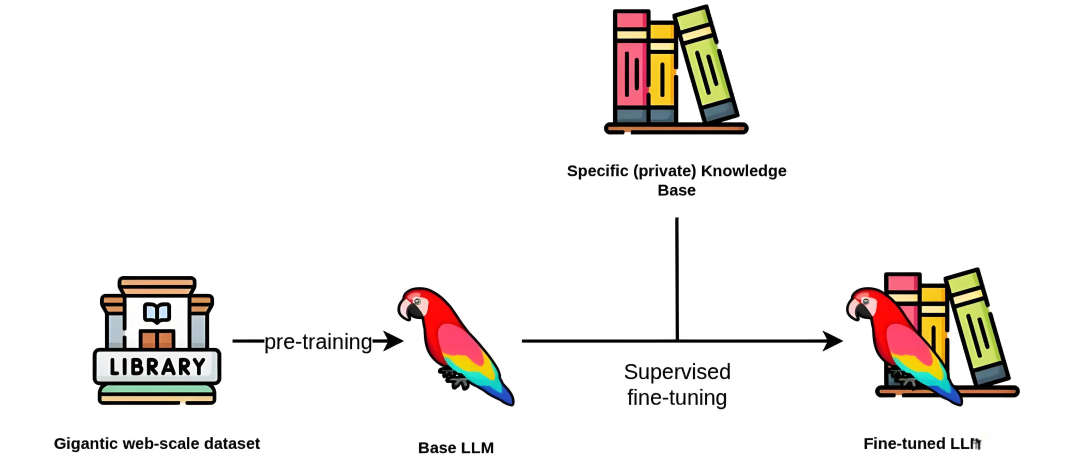

第三节:微调

预训练之后的模型想要在具体任务上进行适配,那就需要通过微调来提升模型的性能,能满足定制化的需求,这一部分主要介绍微调的基础,模型适配技术,最佳实践的案例,以及资源优化等内容

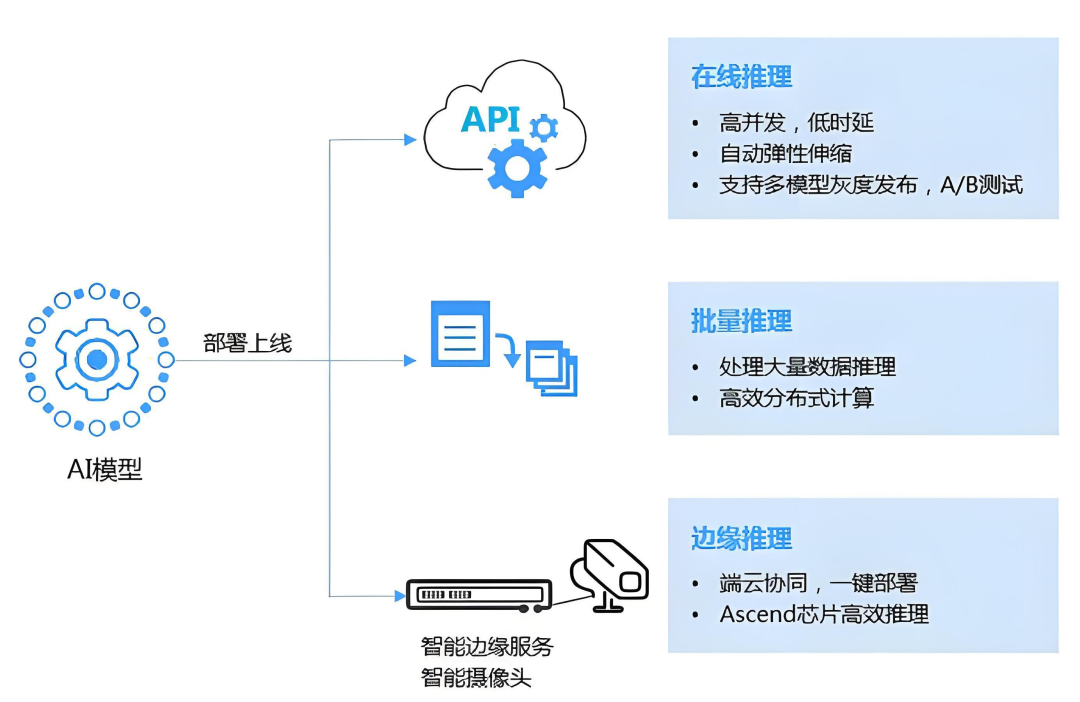

第四节:模型部署

想要把预训练或者微调之后的模型应用于生产实践,那就需要部署,模型部署分为云端部署和本地部署,部署的过程中需要考虑硬件支持,服务器性能,以及对性能进行优化,使用过程中的监控维护等

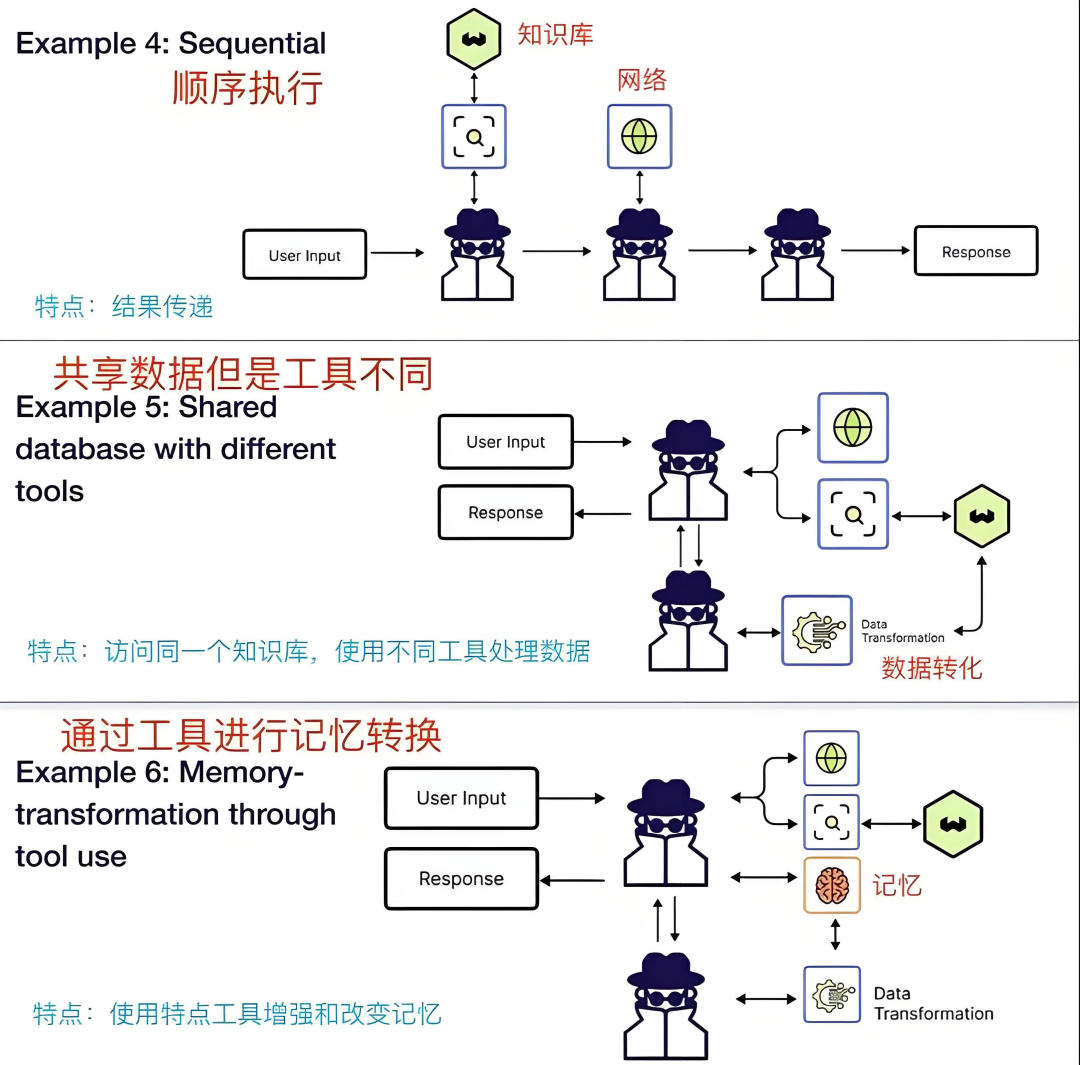

第五节:人工智能系统和项目

这一部分主要介绍自主人工智能系统,包括代理框架,决策框架,多智能体系统,以及实际应用,然后通过实践项目应用前面学习到的知识,包括端到端的实现,行业相关情景等

学完上面的大模型应用技术,就可以去做一些开源的项目,大模型领域现在非常注重项目的落地,后续可以学习一些Agent框架等内容

上面的资料做了一些整理,有需要的同学可以下方添加二维码获取(仅供学习使用)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献60条内容

已为社区贡献60条内容

所有评论(0)