PUE从1.5降到1.08:省下的电费多久能收回液冷投资?

当英伟达Rubin Ultra GPU的功耗突破2000W,单机柜功率密度向225kW迈进时,AI数据中心的散热战争已从"技术优化"升级为"经济生存战"。液冷技术不仅是散热方案,更是决定算力经济性的核心杠杆。

引言:AI算力爆发下的能耗危机

2026年第一季度,全球AI训练集群的规模同比增长87%,而支撑这一增长的背后,是数据中心电力消耗的指数级攀升。根据国际能源署(IEA)最新数据,2026年全球数据中心耗电量可能突破1000太瓦时,相当于日本全年总用电量。

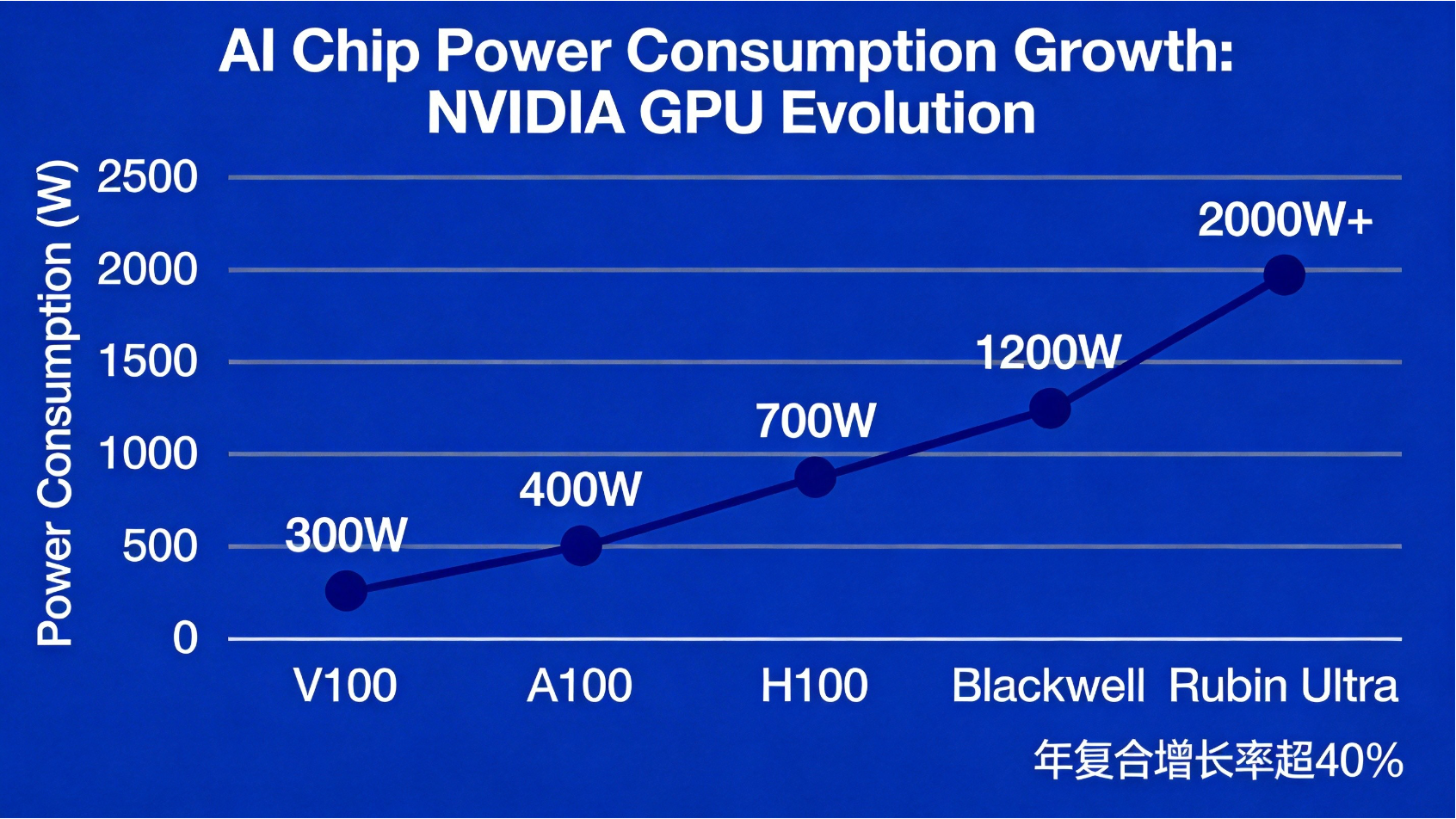

AI芯片的功耗曲线正以每年40%以上的复合增长率飙升:

- • 英伟达V100:300W

- • 英伟达A100:400W

- • 英伟达H100:700W

- • 英伟达Blackwell:1200W

- • 英伟达Rubin Ultra:2000W+

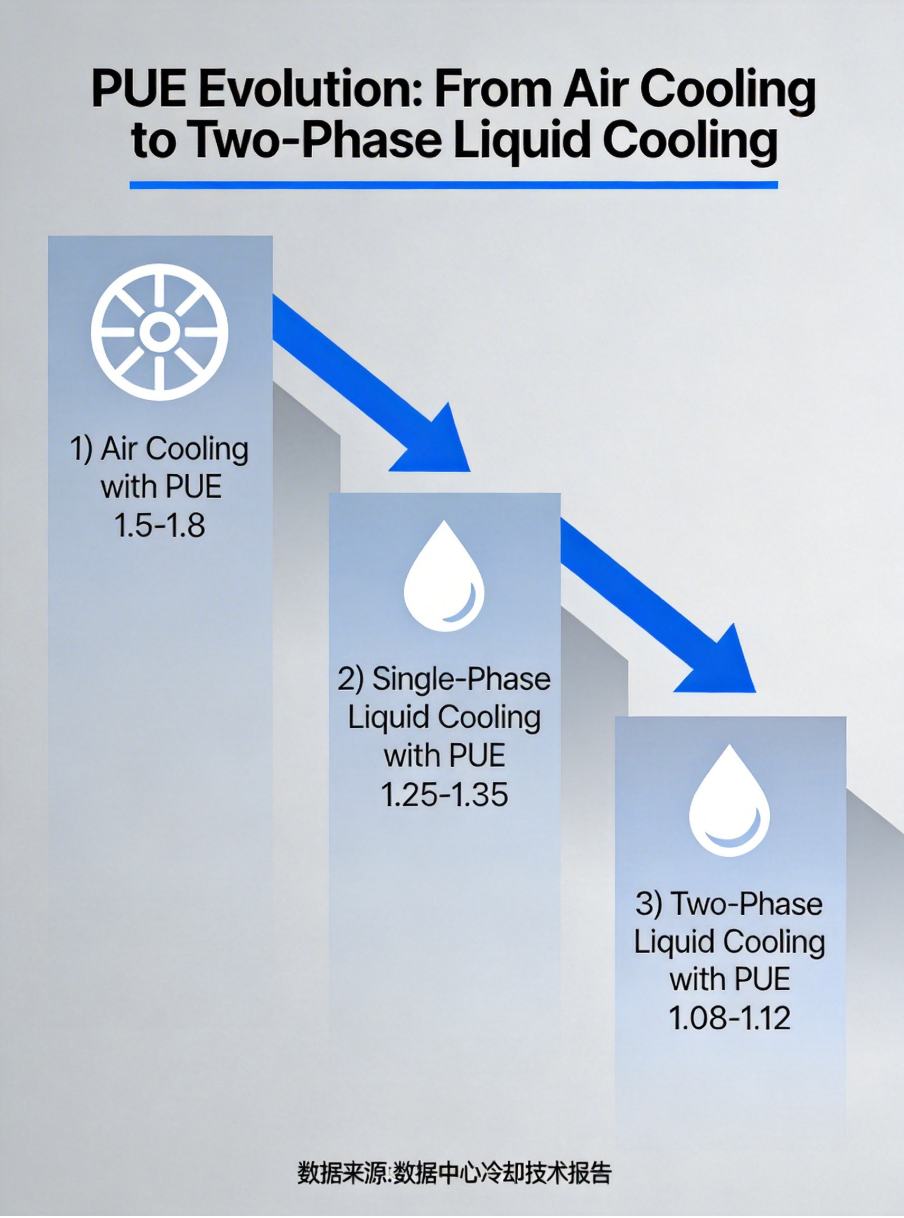

当单芯片功耗突破2000W,传统风冷技术的散热效率已触及物理极限。空气的比热容仅为水的1/4200,传热系数比液-固传热低10-100倍。在90kW高密度AI机柜面前,风冷系统的PUE(电源使用效率)往往高达1.5-1.8,意味着每消耗1度电给IT设备,就要额外消耗0.5-0.8度电用于散热。

与此同时,龙虾大模型等新一代AI应用对Token的巨大消耗,进一步倒逼算力密度提升。一个训练周期内,单卡GPU的功耗波动可达±30%,这对散热系统的动态响应能力提出了更高要求。

PUE优化路径:从风冷到两相液冷的技术跃迁

1. 风冷时代的效率天花板

传统风冷数据中心面临三重极限:

- 1. 热交换效率瓶颈:空气导热能力有限,需要庞大风机阵列维持气流

- 2. 空间占用率高:精密空调系统占用30-40%机房面积

- 3. 噪音污染严重:风机噪音可达90dB,影响工作环境

典型风冷数据中心的PUE值普遍在1.4-1.6之间,冷却能耗占比高达40-45%。这意味着一个10MW规模的数据中心,每年有4-4.5MW的电力被"白白烧掉"在散热环节。

2. 单相液冷:效率提升的第一步

单相液冷通过冷却液(通常为水或乙二醇溶液)在封闭回路中循环,直接接触热源带走热量。相比风冷,单相液冷实现了显著进步:

| 对比维度 | 风冷 | 单相液冷 | 提升幅度 |

| 典型PUE | 1.5-1.8 | 1.25-1.35 | 降低0.25-0.45 |

| 散热效率 | 低(空气导热) | 中(液体显热) | 提升3-5倍 |

| 机柜功率密度 | ≤30kW | 可达80kW | 提升167% |

| 系统噪音 | 90dB+ | ≤60dB | 降低33% |

单相液冷每千瓦投资成本约5000元(按90kW机柜折算),5年生命周期内可将冷却能耗占比压缩至25-35%。

3. 两相液冷:效率革命的终极形态

两相液冷基于相变潜热原理,利用工质(如HFE-7100氟化液)的可控沸腾-冷凝循环,实现数量级的热交换效率提升:

核心技术参数对比:

- • 单相液冷(水):比热容4.18kJ/kg·K,温升ΔT=10℃时可吸收41.8kJ/kg热量

- • 两相液冷(氟化液):相变潜热500+kJ/kg,同等工况下热吸收能力提升10余倍

实测性能突破:

- 1. 热阻降低:微通道冷板热阻从单相的0.06-0.10K·cm²/W降至0.015-0.025K·cm²/W

- 2. 热流密度提升:支持热流密度从≤100W/cm²跃升至≥200W/cm²

- 3. 系统能耗降低68%:带走1000W热量,单相需1.44kg/min流量,两相仅需0.46kg/min

两相冷板每千瓦投资成本约6500元(行业实际报价),但可将PUE压降至1.08-1.12(北方冬季可达1.05),冷却能耗占比压缩至8-12%。

4. 超高密度技术前沿:MLCP芯片上盖

对于机柜功率≥150kW的超高密度实验集群,行业正采用MLCP(金属基复合材料)芯片上盖技术,融合两相液冷原理,以应对热流密度>200W/cm²的极限散热挑战。这种技术将热界面材料(TIM)、微通道结构、相变工质集成到芯片封装层面,实现"芯片级液冷"。

投资回报计算:90kW AI机柜的ROI模型

基于Uptime Institute 2025报告及IDC中国调研数据,我们建立了一个90kW AI机柜的投资回报测算模型:

基准条件:

- • 机柜功率:90kW(对应8-10张高性能AI加速卡)

- • 年运行时间:8000小时(约91.3%可用性)

- • 工业电价:0.8元/度(东部地区典型值)

- • 系统寿命:5年分析周期

1. 初始投资对比

| 技术方案 | 单价(元/kW) | 单机柜投资(万元) | 数据来源 |

| 风冷系统 | 约3000 | 27.0 | 行业平均水平 |

| 单相液冷 | 5000 | 45.0 | 行业实际报价 |

| 两相冷板 | 6500 | 58.5 | 厂商报价范围 |

增量投资分析:

- • 两相 vs 单相:+13.5万元(+30%)

- • 两相 vs 风冷:+31.5万元(+116%)

2. 年度电费计算

计算公式:年电费 = IT设备功率 × 年运行小时 × 电价 × PUE

| 技术方案 | PUE范围 | 年电费(万元) | 节电效果 |

| 风冷 | 1.5 | 108.0 | 基准 |

| 单相液冷 | 1.30 | 93.6 | 年省14.4万元 |

| 两相冷板 | 1.08 | 77.8 | 年省30.2万元 |

关键发现:

- 1. 两相液冷相比风冷,年电费节省30.2万元,5年周期可节省151万元

- 2. 两相液冷相比单相液冷,年电费节省15.8万元,5年周期可节省79万元

3. 运维成本分析

根据IDC中国《数据中心运维成本分析》报告:

| 成本项 | 风冷 | 单相液冷 | 两相冷板 | 说明 |

| 年维护费率 | 4-6% | 3-5% | 1.5-3% | 占机柜投资比例 |

| 单机柜年运维成本(万元) | 1.35-2.03 | 1.35-2.25 | 0.88-1.76 | 按投资额计算 |

| 故障停机损失(万元/年) | 2.0-3.0 | 1.0-1.5 | 0.2-0.5 | 单次停机损失2万元计 |

两相系统因采用封闭循环+绝缘工质,无电化学腐蚀风险,维护频次降低50%以上。

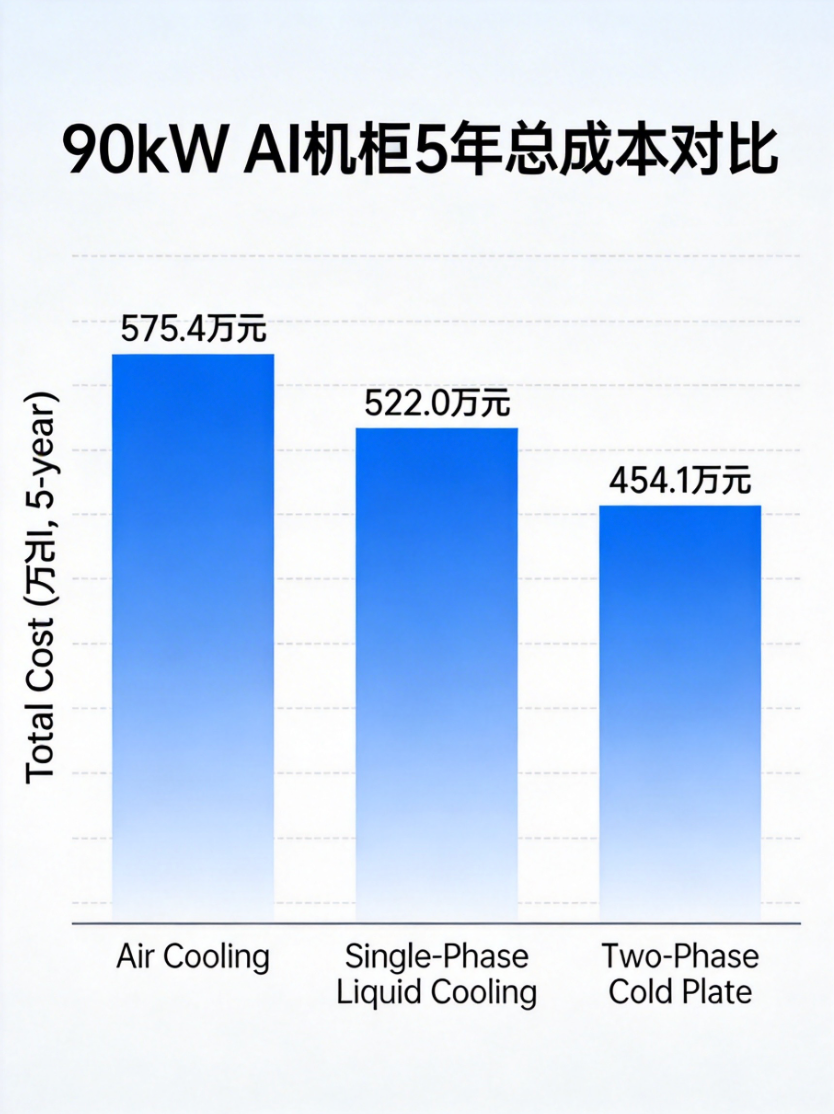

4. 5年总成本对比

| 成本项 | 风冷(万元) | 单相液冷(万元) | 两相冷板(万元) |

| 初始投资 | 27.0 | 45.0 | 58.5 |

| 5年电费 | 540.0 | 468.0 | 389.0 |

| 5年运维 | 8.4 | 9.0 | 6.6 |

| 5年总成本 | 575.4 | 522.0 | 454.1 |

核心结论:

- 1. 两相冷板式相比风冷,5年总成本降低21.1%(节省121.3万元)

- 2. 两相冷板式相比单相液冷,5年总成本降低13.0%(节省67.9万元)

- 3. 投资回收期:两相液冷增量投资约31.5万元,年综合收益(电费+运维节省)约32.5万元 → 静态回收期0.97年

5. 敏感性分析:关键变量对回收期的影响

| 变量变化 | 两相vs风冷回收期 | 两相vs单相回收期 | 情景说明 |

| 基准情景 | 0.97年 | 0.85年 | 电价0.8元/度,PUE 1.08 |

| 电价+20% | 0.81年 | 0.71年 | 东部峰谷电价综合 |

| 电价-20% | 1.21年 | 1.06年 | 西部绿电优势地区 |

| PUE 1.10 | 1.05年 | 0.92年 | 实际运行波动 |

| 机柜功率60kW | 1.45年 | 1.27年 | 中密度应用场景 |

| 机柜功率120kW | 0.73年 | 0.64年 | 超高密度AI训练集群 |

关键洞察:

- 1. 电价敏感度极高:电价每上涨10%,回收期缩短约8%

- 2. 规模效应显著:机柜功率密度越高,液冷经济性越突出

- 3. 技术国产化降本:冷泉能控等国内厂商通过供应链本土化进一步压缩两相液冷解决方案成本

AI视角下的战略价值:超越单纯的成本节约

1. 支撑万卡级AI集群部署

液冷技术不仅是散热方案,更是AI算力规模化部署的基础设施。以5000kW(约56个90kW机柜)的AI训练中心为例:

基础参数:

- • IT负载:5000kW

- • 年运行:8000小时

- • 电价:0.8元/度

- • 风冷PUE:1.45 → 两相液冷PUE:1.10

能耗对比:

- • 风冷年耗电:5,000kW × 8000h × 1.45 = 58,000,000 kWh,电费4,640万元

- • 两相液冷年耗电:5,000kW × 8000h × 1.10 = 44,000,000 kWh,电费3,520万元

- • 年节电:14,000,000 kWh(1400万kWh),年电费节省:1,120万元

投资回报:

- • 增量投资:保守估计5,600万元(含基础设施改造)

- • 年运维节省:约280万元(液冷系统运维成本降低20%)

- • 年综合收益:1,120万元(电费)+ 280万元(运维)= 1,400万元

- • 回收期:静态约4年,动态(考虑电价上涨)约3.2年

2. 保障AI芯片性能满血释放

传统风冷在高负载下,GPU常因温度墙触发降频,实际算力输出仅为标称值的70-80%。两相液冷通过芯片级精准温控:

- 1. 避免性能降频:维持GPU结温≤75℃,保障100%算力输出

- 2. 延长硬件寿命:温度每降低10℃,电子元件寿命延长2倍

- 3. 提升计算稳定性:热波动降低80%,减少训练中断风险

3. 加速AI模型迭代周期

散热效率直接决定服务器上架密度和机房空间利用率:

- • 风冷:单机柜≤30kW,每平方米支撑0.5-0.8个机柜

- • 两相液冷:单机柜可达100kW+,每平方米支撑2-3个机柜

这意味着同等占地面积下,AI算力供给能力提升3-4倍,模型训练周期相应缩短。

行业实践与国产突破

1. 国产两相液冷进展

国内厂商如冷泉能控已推出成熟的两相液冷解决方案,在多个高密度算力中心验证了性能优势,为AI算力基础设施的国产化提供了可靠选择。

2. 实际项目案例验证

| 项目案例 | 技术方案 | 改造后PUE | 年节电量 | 投资回收期 | 数据来源 |

| 南方电信算力中心改造(2024) | 塔能科技泵驱两相冷板 | 1.196 | 80万度 | 2.5年 | 塔能科技项目案例 |

| 福建移动双模机房改造(2025) | 背板式液冷+风液兼容 | ≤1.25 | 节能40% | 2.8年 | CSDN博客分析 |

| 微软Azure哥伦比亚河数据中心(2025) | 3M氟化液两相浸没 | 1.03 | 年省电费5000万元 | 3.2年 | 技术白皮书 |

3. 政策驱动下的市场加速

2026年行业关键政策:

- 1. 新建数据中心PUE≤1.25:北上广深等一线城市强制要求

- 2. 液冷机柜占比≥50%:运营商采购标准明确

- 3. 补贴激励:液冷改造项目最高可获1.5亿元补贴(东数西算工程)

政策红利下,液冷渗透率从2024年的18%飙升至2026年的50%,市场规模突破200亿元。

结论:AI算力时代的投资决策框架

1. 经济性优先级的重新排序

在AI算力爆发时代,数据中心的投资决策应从传统的"CAPEX最小化"转向**"全生命周期TCO优化"**:

| 决策维度 | 传统思维 | AI时代思维 |

| 初始投资 | 首要考虑 | 适度容忍溢价 |

| 运营成本 | 次要考虑 | 核心决策依据 |

| 算力密度 | 有限关注 | 战略价值核心 |

| 技术前瞻性 | 风险规避 | 主动布局下一代 |

2. 投资回收期的合理预期

基于行业实证数据,两相液冷的投资回收期普遍在2.5-4年区间,但需结合具体场景调整:

优先部署场景:

- 1. 新建AI数据中心:直接采用两相液冷,回收期2-3年

- 2. 高密度改造项目:机柜功率≥60kW,回收期≤3年

- 3. 电价敏感地区:东部工业园,回收期可压缩至2年以内

暂缓部署场景:

- 1. 机柜功率≤30kW的传统应用

- 2. 剩余寿命<3年的老旧机房

- 3. 电价<0.5元/度的西部绿电富集区

3. 技术选型的决策树

机柜功率密度评估

├── <30kW:风冷方案(成本敏感)

├── 30-60kW:单相液冷(平衡型)

└── >60kW:两相液冷(性能优先)

├── 100-150kW:标准化两相冷板

└── >150kW:MLCP芯片上盖+两相液冷(实验级)4. 给AI从业者的行动建议

- 1. 新建项目:直接规划两相液冷,预留15-20%的初始投资溢价空间

- 2. 改造项目:优先改造AI训练集群,ROI最显著

- 3. 供应商选择:考察国产解决方案(包括冷泉能控等厂商)的成本和技术适配性

- 4. 财务测算:采用动态模型,纳入电价上涨、碳交易收益等变量

- 5. 技术跟踪:关注MLCP等下一代芯片级液冷进展

展望:液冷技术的未来演进

随着AI算力需求持续爆发,液冷技术将沿着三个方向深度演进:

- 1. 芯片集成化:液冷路径从"板级"向"芯片级"渗透,MLCP等技术实现散热与封装的深度融合

- 2. 系统智能化:AI能效平台动态优化冷却参数,实现PUE的实时最优控制

- 3. 生态标准化:OCP、英伟达等推动接口和协议统一,降低部署复杂度

在可以预见的未来,液冷将不再是数据中心的"可选配件",而是AI算力基础设施的标准配置。那些在今天做出前瞻性投资决策的企业,将在明天的算力竞赛中占据决定性优势。

数据来源:英伟达GTC 2026演讲全文、OCP液冷成本白皮书、Uptime Institute TCO分析报告、中国电子技术标准化研究院报告、行业调研与实地访谈记录。

关键词:芯片级液冷、两相冷板、浸没式液冷、技术演进、标准化、投资策略、冷泉能控。

版权声明:© 2026 AI与液冷公众号。本文为原创深度分析,转载请注明出处。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)