给一张照片,用手比划就能生成抓杯子、开盒子的第一人称视频!Hand2World的破局之路

从 Genie 3 到 LingBot-World,世界模型正成为 AI 领域最热的方向之一。一个自然的问题是:如何让用户用最直觉的方式——手势——来驱动世界模型中的交互?我们提出了 Hand2World:给一张照片,对着空气比划几下,AI 就能生成手伸进场景里抓杯子、翻书、开盒子的逼真第一人称视频,物体也会产生对应的物理响应——还能自回归地一直生成下去,长视频也保持稳定。

- 论文地址:https://arxiv.org/abs/2602.09600

- 项目主页:https://hand2world.github.io

这件事为什么难?

看起来很酷,但要做到这一点并不容易。

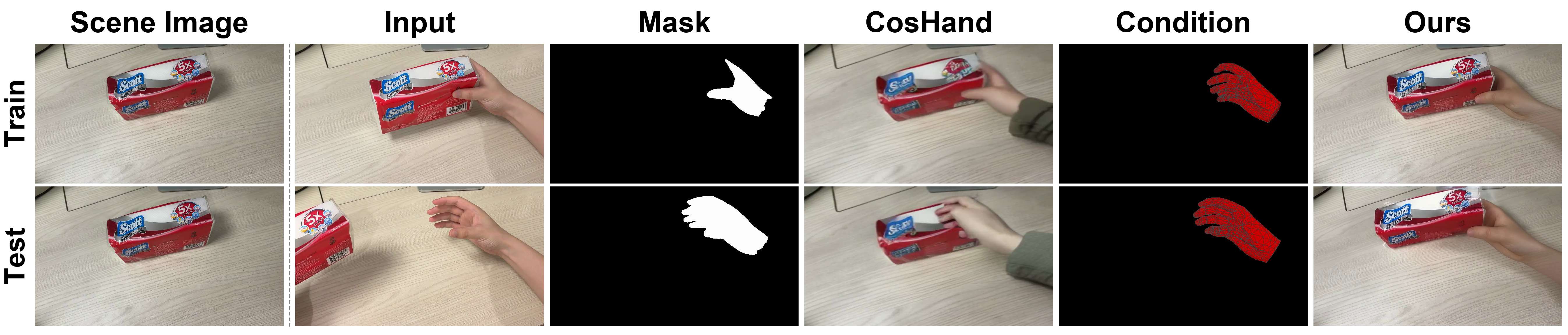

现有方法(CosHand、InterDyn、Mask2IV 等)普遍用 2D 手部 mask 作为控制信号。但这类方法有一个根本性的缺陷——mask 分布偏移。如下图所示:训练时(上排),手在抓握物体,手部被遮挡,提取出的 mask 是残缺的;推理时(下排),用户在空气中凭空比划,手完全可见,mask 也是完整的。这种格式不一致会导致模型在遇到完整 mask 时产生错误的遮挡关系——比如 CosHand 在下排中生成了明显的伪影。

而我们的控制信号(Condition 列)是从 3D 手部 mesh 投影得到的「轮廓 + 线框」,无论手是否被遮挡,格式始终一致。更关键的是,这不仅仅是提供了额外的几何信息——它让模型能够从生成目标本身隐式学会遮挡推理,而不是依赖输入信号中硬编码的可见性。

另一个挑战是手-相机歧义:第一人称视频中,用户一边比划手势一边自由转头,手部运动和相机运动在单目视角下纠缠在一起。如果不显式解耦,模型分不清「是手在动还是头在动」,背景就会漂移。

怎么做的?

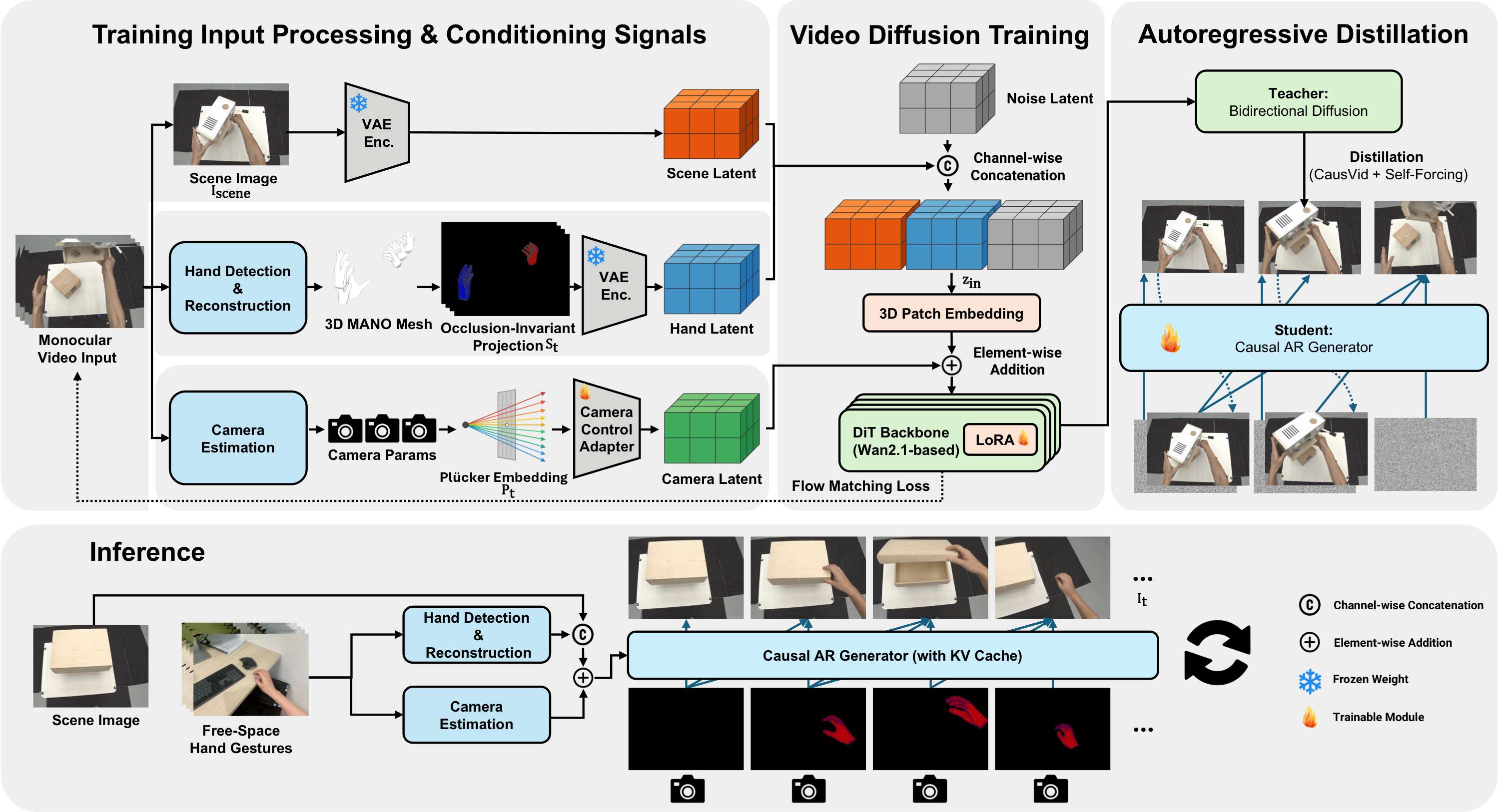

Hand2World 基于视频扩散 Transformer(Wan2.1-1.3B-Control),三个核心设计分别解决上述问题:

(1)遮挡不变的手部条件信号。 我们从单目视频中恢复完整的 3D 手部 mesh(MANO 模型),投影到图像平面,渲染为「轮廓 + 线框」的复合信号。遮挡关系不再硬编码在输入中,而是交给生成模型根据场景上下文推断。线框叠层还能在手掌朝向相机、手指自遮挡时提供额外的关节结构信息。

(2)双通道相机解耦。 我们用逐像素的 Plücker 射线嵌入编码相机运动,通过轻量级 adapter 以加法方式注入扩散模型,将手部关节运动和头部自运动彻底解耦,解决上述手-相机歧义。

(3)闭环交互生成系统。 将双向扩散教师模型蒸馏为因果自回归生成器(基于 CausVid + self-forcing),通过 KV cache 维持时序连贯,支持任意长度的流式生成。结合上述组件,Hand2World 构成了第一个完整的闭环交互系统——用户可以迭代地调整手势并实时观察生成的交互结果。

(4)可扩展的数据收集 Pipeline。 我们还开发了一套全自动的单目标注流水线:YOLO 手部检测 + 时序滤波去噪 → HaMeR 估计 MANO 参数 → Depth Anything V3 恢复深度和相机位姿。不需要人工标注、不需要多目相机,直接从普通第一人称视频中提取训练数据,为具身智能的大规模数据收集提供了可扩展的方案。

效果如何?

我们在 ARCTIC、HOT3D、HOI4D 三个第一人称交互数据集上进行了评估。与最强 baseline InterDyn 相比,Hand2World 将 FVD 从 908 降到 218(降幅 76%),相机轨迹误差从 0.13 降到 0.07(降幅 42%),DINO 语义相似度从 0.80 提升到 0.88。

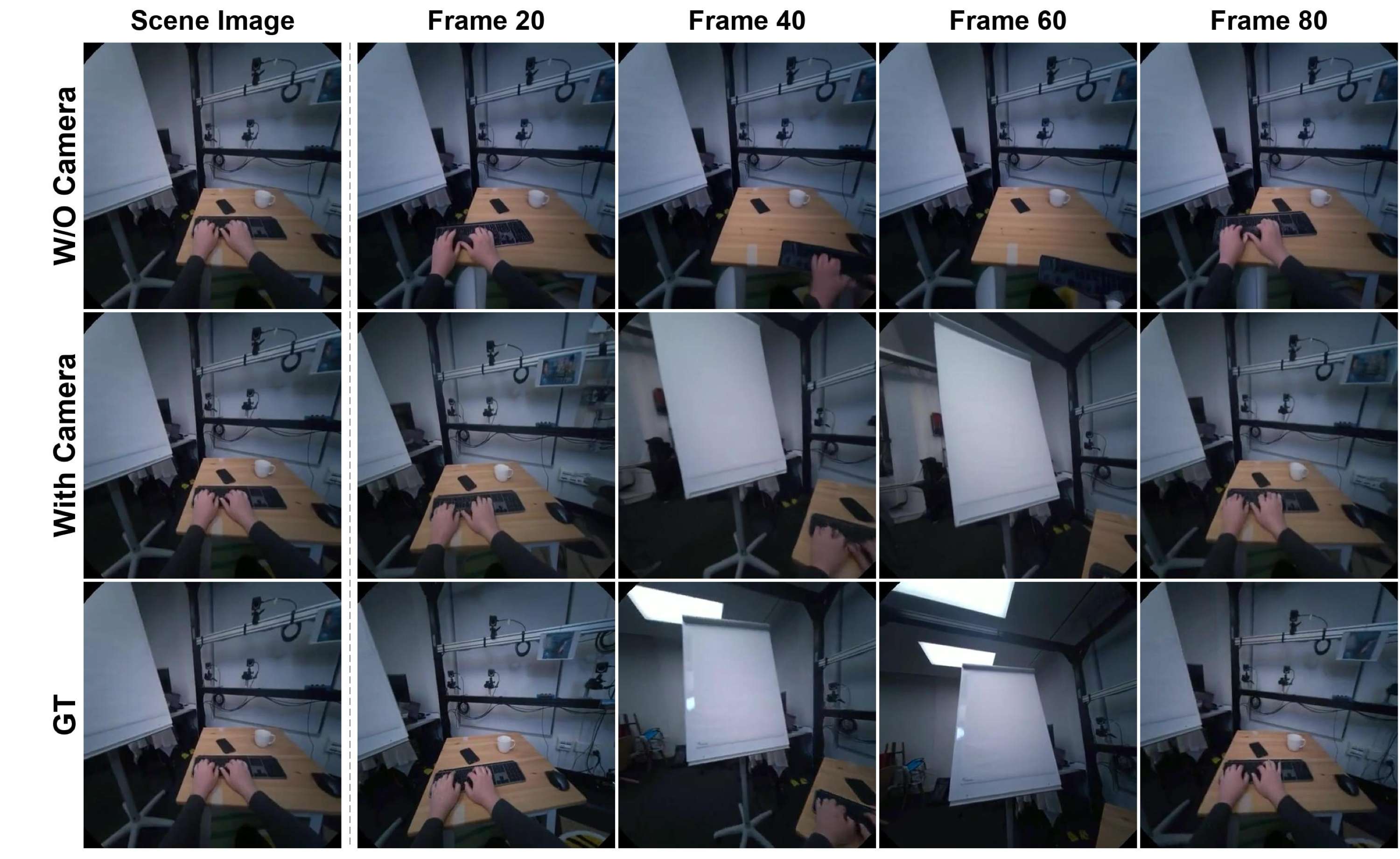

消融实验表明,相机 adapter 是影响最大的单一组件——移除后 FVD 飙升到 815。下图展示了有/无相机控制的对比:没有相机条件(上排)时模型无法跟随头部转动,背景严重漂移;加入 Plücker 射线嵌入后(中排),生成轨迹与真实视频(下排)高度一致。

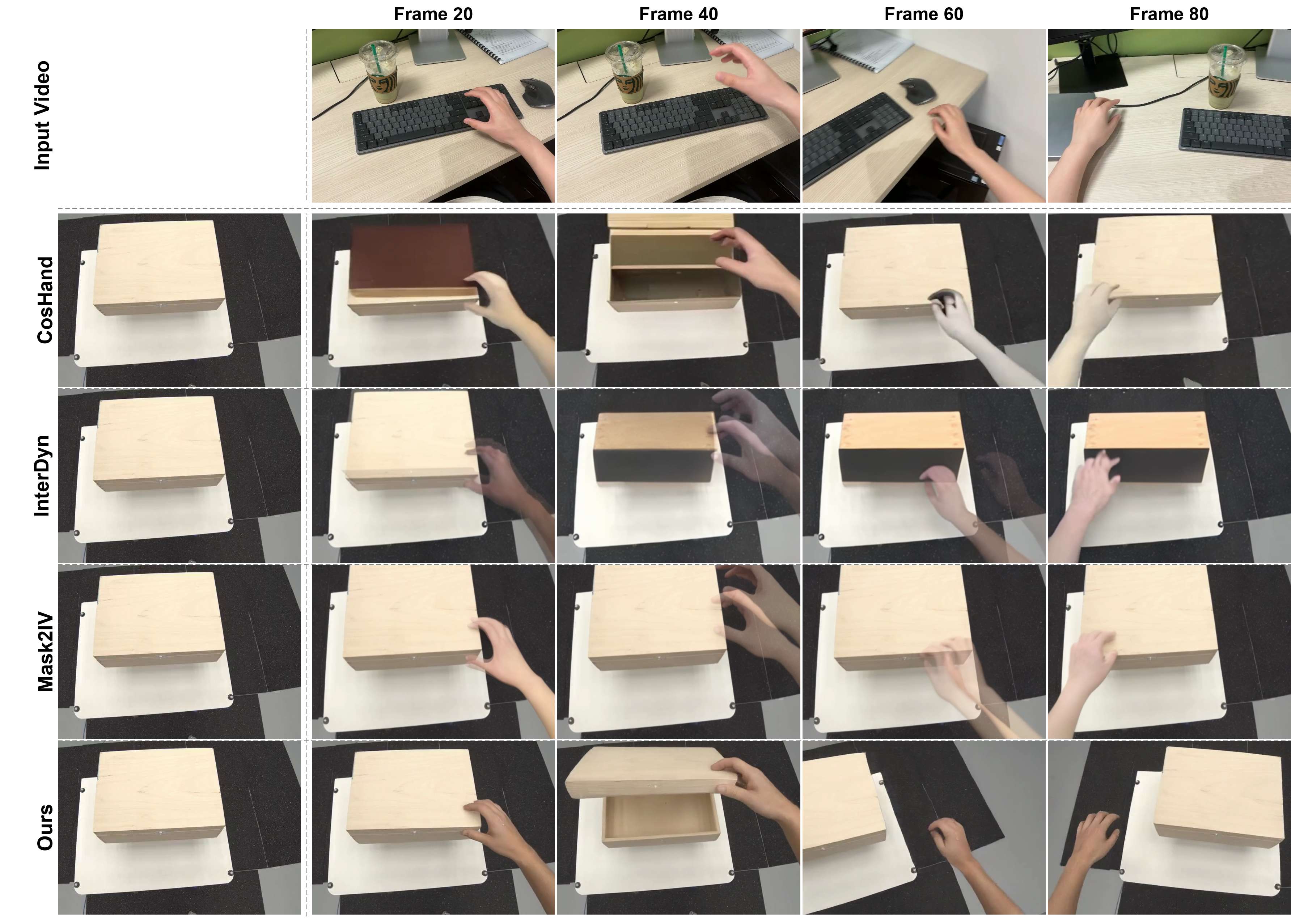

下图展示了凭空手势下各方法的生成效果对比:

蒸馏后的 Hand2World-AR(FVD 232)性能接近教师模型,同时支持因果、流式的任意长度生成。

应用展望

Hand2World 在多个方向展现出应用潜力:AR/MR 眼镜场景下用手势与物体自然交互、为机器人大规模生成手-物交互训练数据、以及从单张照片构建可交互的虚拟环境。

作为这一任务的首个统一框架,Hand2World 在三个不同数据集上建立了基准。我们希望这个系统能成为交互式第一人称世界建模的一个起点,激发更多后续研究。更多可视化结果可访问项目主页。

重磅!

全网首个!具身智能开源知识库来啦(技术/产业/投融资/上下游)

推荐阅读

VLA+RL方向首个系统教程来啦!Online RL/Offline RL/test time RL等~

我们用低成本的机械臂完成pi0/pi0.5/GR00T/世界模型等VLA任务~

VLA/VLA+触觉/VLA+RL/具身世界模型等!具身大脑+小脑算法与实战全栈路线来啦~

1v1 科研论文辅导来啦!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)