2026 年 AI 工程新范式:Harness Engineering 深度解析

2026 年 AI 工程新范式:Harness Engineering 深度解析

受众假设:你已经写过 Prompt,了解 RAG/动态上下文注入,并对 Agent 的“推理-行动-观察”循环不陌生。

本文聚焦:工程机制与可靠性直觉(而不是“某个模型有多强”)。

TL;DR(先看结论)

- Harness Engineering 关注的不是“怎么把模型训练得更强”,而是“怎么设计模型运行系统,让模型在机制里把事稳定做成”。

- 它可理解为 AI 工程的第三阶段:Prompt → Context → Harness,且是包含关系:

Prompt ⊂ Context ⊂ Harness。 - 之所以在 2025 年底到 2026 年初快速升温,核心是 4 件事:模型能力到临界点、长任务暴露系统性失败模式、多步链路的累积误差导致端到端可靠性崩塌、模型商品化后竞争焦点转向系统(Harness)。

- 多步 Agent 的关键问题通常不是“95% 单步成功率不够高”,而是“缺少验证与恢复机制”,因为

0.95^20 ≈ 36%(成功率会指数衰减)。 - 成熟 Harness 常见 6 个模块:上下文/知识、工具/权限、验证/约束、状态/记忆、可观测性/反馈、人类接管/生命周期。

- 它同时带来创新与争议:工程约束对象从“确定性代码”转向“概率推理系统”;风险来自概念膨胀、过度工程化、证据与可复现性不足,以及多 Agent 带来的风险放大。

快速导航(按困惑定位)

| 你可能在困惑什么 | 看哪节 | 一句话解释 |

|---|---|---|

| “Harness Engineering 到底是什么?和 Prompt/Context 有啥不同?” | 1, 2 | Harness 解决的是“让模型在什么机制里干活,并确保干成”。 |

| “为什么 2026 年大家突然开始聊 Harness?” | 3 | 模型变强后,差异点从模型转移到系统设计与可靠性治理。 |

| “Agent 看起来 95% 都正常,为什么一上真实任务就翻车?” | 4 | 多步串联系统里,端到端成功率是指数衰减,需要验证与恢复。 |

| “成熟 Harness 具体长什么样?模块怎么拆?” | 5 | 六大模块覆盖:信息可达性、可执行性、可验证性、可恢复性、可观测性、可控性。 |

| “头部公司怎么做?有哪些可复用的模式?” | 6 | 共同收敛到:外部制品记忆 + 生成/评估分离 + 确定性约束。 |

| “它有什么争议/风险?会不会只是过渡概念?” | 7 | 风险来自边界模糊、过度工程化与证据不足;未来取决于模型是否压缩这些系统复杂度。 |

1. 关键概念:Harness 是什么

这里说的 Harness Engineering(下文简称 Harness),指的是:设计模型运行系统的工程方法论,而不是直接优化模型本身。

一句话定义:Harness = “把模型能力接到真实世界任务上,并且用机制保证可控、可验、可恢复”的系统工程。

可以用一个直观隐喻来理解角色分工:

- 模型是马匹:强大但无方向

- 人类是骑手:提供方向

- Harness 是马具:控制与引导工具

更工程化的定义:Harness 处理模型外部的完整运行系统,包括任务拆解、上下文管理、工具编排、权限设定、状态交接、结果验证、失败恢复,以及人类控制权交接等系统性设计。

2. 三阶段演进:Prompt → Context → Harness

可以把 AI 工程演进粗分为三阶段,并用“关注点”来对比差异:

| 阶段 | 主导时期 | 核心关注点 | 技术本质 | 比喻 |

|---|---|---|---|---|

| Prompt Engineering | 2022-2024 | 如何提问? | 单轮文本优化 | 命令右转 |

| Context Engineering | 2025-至今 | 让模型看到什么? | 动态输入管理 | 提供地图 |

| Harness Engineering | 2026-至今 | 模型如何工作? | 完整系统设计 | 整辆车的工程设计(方向盘、刹车、车道维护等) |

包含关系:Harness 包含 Context,Context 包含 Prompt。换句话说,你可以把前者当作后者的“上层装配”。

Prompt ⊂ Context ⊂ Harness

(从“怎么说”→“给它看什么”→“让它在什么机制里干活并确保干成”)

(一个更贴近工程直觉的对照)

Prompt:写一句话,让模型“想清楚”

Context:把资料塞进去,让模型“看得到”

Harness:把流程/工具/验证/恢复都配齐,让系统“交付得出来”

3. 为什么会爆发:四个驱动因素

2025 年底至 2026 年初 Harness Engineering 升温,常见可以归因到 4 个驱动因素:

- 模型能力已达临界点:基础模型能力显著提升后,系统设计成为性能差异主要来源,需要 Harness 释放模型潜力。

- 长任务暴露系统性缺陷:跨窗口长任务出现典型失败模式(上下文耗尽、提前宣布完成且不验证等),这些无法靠模型升级解决,必须靠 Harness 机制治理。

- 概率系统的累积误差:多步流水线端到端成功率会指数衰减,必须通过系统层面验证解决。

- 模型商品化:模型能力差距缩小,围绕模型的系统设计成为新竞争壁垒(“旧护城河是模型质量,新护城河是 Harness 质量”)。

4. 可靠性直觉:为什么 95% 仍然会在真实任务里失败

这里有一个关键数学直觉:

- 多步 Agent 流水线单步成功率 95%

- 串联 20 步后端到端成功率约 36%

可以用最小模型表达这个现象:

端到端成功率 ≈ p^n

p = 单步成功率(例如 0.95)

n = 步数(例如 20)

0.95^20 ≈ 0.358

结论不是“95% 太差”,而是:当任务必须拆成多步时,系统设计的重心要放在“验证、恢复与状态治理”,否则失败会在长链条里被放大。

给一个更直观的表(p=0.95):

| 步数 n | 端到端成功率 0.95^n(约) |

|---|---|

| 5 | 77% |

| 10 | 60% |

| 20 | 36% |

| 30 | 21% |

(多步 Agent 端到端成功率的直觉图)

Step1 Step2 Step3 Step20

95% × 95% × 95% × ... × 95%

│ │ │ │

└──────┴──────┴────── ... ──┘

端到端 ≈ 36%

因此:需要 Harness 来做

- 结果验证(不是“自我觉得完成了”)

- 失败恢复(重试/回滚/换路)

- 状态交接(跨窗口/跨 session 不丢进度)

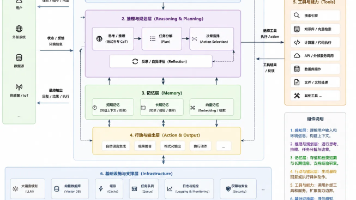

5. Harness 的六大核心模块

成熟 Harness 常见可以拆为 6 个模块。这里的读法建议是:先看“它解决什么失败模式”,再看“它实现成什么模块”。

- 上下文工程与知识管理:项目指令文件(如 agents.md)、动态上下文注入、上下文隔离与压缩。核心原则是“无法访问的信息对 Agent 等同于不存在”。

- 工具编排与权限设计:策划工具集、MCP 与文件系统访问管理、沙箱隔离机制。

- 验证机制与约束:确定性约束(Linter/结构测试/pre-commit)、生成-评估分离、自动审查循环。

- 状态管理与记忆持续性:外部化记忆(进度文件/结构化功能清单)、增量提交与检查点恢复。

- 可观测性与反馈闭环:执行追踪与质量分级、异常检测与反馈归因。

- 人类接管与生命周期管理:关键决策点暂停、生命周期钩子(升级路径/失败恢复)。

用一个“目标导向”的图把它们放在同一个框架里:

┌──────────────────────────────┐

│ Agent Loop │

│ 推理 → 行动 → 观察 │

└──────────────┬───────────────┘

│

▼

┌───────────────────────────────────────────────────────────────┐

│ Harness(把“能做”变成“能稳定做对”) │

│ │

│ 1) 上下文/知识:信息可达性 2) 工具/权限:动作可执行性 │

│ 3) 验证/约束:结果可验证性 4) 状态/记忆:跨步可持续性 │

│ 5) 可观测/反馈:问题可定位性 6) 人类接管:关键决策可控性 │

└───────────────────────────────────────────────────────────────┘

6. 头部实践:共同收敛到哪些模式

把不同公司的实现细节放在一起看,表面上各叫各的名字,但底层收敛点很一致:把“生成”和“验证”分离、把记忆外部化成可审计制品、把关键约束做成确定性门禁(而不是靠模型自觉)。

6.1 Anthropic:从双 Agent 到三 Agent(生成-评估分离)

一种常见的演进路线是从“生成”与“执行”分工,进一步走向“生成-评估分离”:

- 2025 年 11 月:双 Agent(初始化 Agent + 编码 Agent)

- 初始化 Agent:建环境、创建脚本、生成可测试需求清单(JSON)

- 编码 Agent:读取进度文件、审查需求、执行测试

- 关键点:通过外部制品(进度文件、Git 历史、需求清单)实现跨 session 记忆

- 2026 年 3 月:三 Agent(Planner + Generator + Evaluator)

- Planner:扩展需求

- Generator:实现功能

- Evaluator:独立验证(解决自评估缺陷)

(三 Agent 的最小结构)

Planner → Generator → Evaluator

扩展需求 产出实现 独立验证

关键:Evaluator 不是 Generator 的“自我批评”,而是独立角色。

6.2 OpenAI:Codex Agent(高吞吐 + 约束 + 自我改进闭环)

常见做法可以概括为“高吞吐 + 强约束 + 自我改进闭环”:

- 3-7 人团队 5 个月生成约百万行代码,合并 1500 个 PR

- 人均日吞吐量 3.5 个 PR,且随团队扩大而上升

- 约束:零手写代码,逻辑/测试/CI/文档均由 Codex 生成

Harness 三个常见支柱:

- Context Engineering:增强知识库 + 动态访问可观测性数据

- 架构约束:自定义 Linter 与结构测试强制执行

- 垃圾回收:扫描文档不一致与架构违规

核心模式:遇到困难时不“更努力”,而是反问“缺少什么能力?如何让该能力可执行?”,把改进落在系统机制上,形成自我改进闭环。

6.3 Google DeepMind:Alethia(Generator/Verifier/Revisor)

一种经典的三组件结构与效果边界是:

- Generator:提出解法与证明策略

- Verifier:检查逻辑缺陷与幻觉

- Revisor:修正错误

结果:在 IMO Proof Bench Advance 达到 95.1% 准确率,但更广泛问题集错误率 68.5%,体现 Harness 在特定场景的强大与泛化局限。

7. 创新本质、争议与风险

7.1 创新本质

可以从 4 个维度理解它的创新点:

- 约束对象变化:从确定性代码执行转向概率性推理系统

- 反直觉原则:约束解决空间反而提升表现

- 生成-评估分离:Anthropic 与 Google 独立收敛到相同模式

- 代码库优化目标:优先优化 Agent 可读性而非人类阅读偏好

7.2 主要争议与风险

常见的 5 类风险是:

- 概念膨胀:术语边界模糊导致精确性下降

- 过度工程化:模型升级可能让复杂 Harness 成为负担

- 证据基础局限:多数证据来自厂商自身,独立定量验证缺乏

- 可复现性缺口:百万行代码案例特定条件难以复制

- 风险放大:多 Agent 配置可能提高意外污染概率(从 0.24% → 0.87%)

8. 结论与行动路径

核心结论可以用三段式区分来记:

- Prompt Engineering 解决“怎么说”

- Context Engineering 解决“给模型看什么”

- Harness Engineering 解决“让模型在什么机制里干活并确保干成”

务实行动路径(按时间尺度整理):

- 立即:创建 agents.md,记录 Agent 重复性错误及规则

- 中期:构建确定性验证层(Linter、结构测试、可观测性)

- 长期:设计模块化可替换 Harness 架构,支持模型升级平滑迁移

开放性问题:Harness Engineering 会成为 AI 时代的 DevOps,还是会被下一代模型压缩系统复杂度后边缘化?

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)