开发者视角下的AI工具选型指南:从需求拆解到工程化落地的全维度评估

导语:

随着大模型技术的爆发,AI工具市场呈现出“千帆竞发”的局面。从代码生成、文档撰写到数据分析,市面上充斥着数十种号称“提效神器”的AI工具。然而,对于开发者而言,盲目追逐热点工具不仅无法提升效率,反而可能陷入“工具泛滥”的窘境。本文将从工程化思维出发,建立一套科学的AI工具选型框架,帮助您根据实际场景做出最优决策。

一、 工具选型的前提:明确需求分层

在选择任何AI工具之前,首先需要厘清一个问题:我需要AI解决的是“生产力问题”还是“能力边界问题”?

根据开发者的日常工作流,可以将需求分为三个层级:

| 层级 | 场景示例 | 核心诉求 |

|---|---|---|

| L1:代码生成与补全 | 编写函数、自动补全、单元测试生成 | 准确性、上下文理解能力、IDE集成度 |

| L2:架构设计与重构 | 代码审查、技术方案设计、重构建议 | 逻辑推理能力、代码库整体理解能力 |

| L3:知识获取与文档 | 技术调研、API文档解读、技术博客撰写 | 信息时效性、来源可靠性、表达专业性 |

专业建议: 不要试图用单一工具覆盖所有需求。根据“奥卡姆剃刀”原则,每个层级选择1-2个专精工具,形成工具链组合,远比堆砌工具更高效。

二、 主流AI工具分类盘点与技术指标

当前市场上的AI工具可按技术架构和产品形态分为以下几类:

1. 通用大语言模型(LLM)类

这类工具以对话交互为主,适用于L2和L3场景。

| 工具 | 技术底座 | 核心优势 | 适用场景 | 局限性 |

|---|---|---|---|---|

| ChatGPT (GPT-4系列) | OpenAI | 推理能力强、生态成熟、插件丰富 | 复杂问题拆解、技术方案设计、代码审查 | 代码理解深度不及专用工具 |

| Claude (Anthropic) | Claude 3.5 Sonnet | 长上下文(200K tokens)、安全性高 | 大型代码库分析、技术文档撰写 | 国内访问受限 |

| 通义千问 (Qwen) | 阿里 | 中文理解优秀、免费额度充足 | 中文技术文档、本地化需求 | 专业领域深度略逊 |

| DeepSeek | 深度求索 | 代码能力突出、推理效率高 | 算法实现、数学建模 | 生态插件较少 |

技术选型指标:

-

上下文窗口: 处理大型代码库需要≥100K tokens

-

代码理解能力: 可参考HumanEval、MBPP等基准测试得分

-

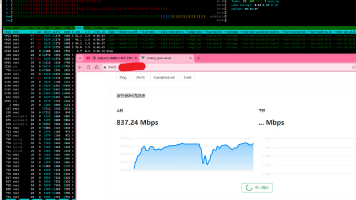

API响应延迟: 实时交互场景需≤3秒

2. 专用代码生成类

这类工具深度集成IDE,专为L1场景设计。

| 工具 | 技术底座 | 核心优势 | 适用场景 |

|---|---|---|---|

| GitHub Copilot | OpenAI Codex | IDE原生集成、多语言支持、企业级安全 | 日常代码补全、单元测试生成 |

| Cursor | 多种模型切换 | AI原生IDE、代码库级理解 | 复杂重构、跨文件编辑 |

| CodeWhisperer | Amazon | AWS生态集成、免费 | AWS开发、云端部署 |

技术选型指标:

-

补全准确率: 建议实测与自己技术栈相关的代码片段

-

隐私安全: 企业开发需关注工具是否使用代码进行训练

-

IDE兼容性: VS Code、JetBrains、VS等主流IDE的支持程度

3. 数据分析与可视化类

适用于科研、数据处理场景。

| 工具 | 核心功能 | 技术优势 |

|---|---|---|

| Julius AI | 数据清洗、统计分析、可视化生成 | 自然语言转Python/R代码 |

| LangChain + 本地模型 | 自定义数据管道 | 数据不出域、隐私可控 |

三、 工程化选型评估矩阵

作为技术人员,选择工具应建立可量化的评估体系。建议从以下五个维度进行打分(1-5分):

维度一:技术性能(权重30%)

-

准确性: 在核心任务上的输出正确率

-

响应速度: API延迟或本地推理速度

-

稳定性: 服务可用性、错误率

维度二:集成能力(权重25%)

-

API丰富度: REST API、SDK支持

-

IDE插件: 是否支持主流开发环境

-

工作流适配: 能否嵌入CI/CD、自动化流程

维度三:成本控制(权重20%)

-

定价模式: 订阅制($20/月)vs 按量付费($0.002/1K tokens)

-

免费额度: 是否满足日常开发需求

-

长期ROI: 提效带来的时间节省能否覆盖成本

维度四:安全合规(权重15%)

-

数据隐私: 是否使用用户数据进行训练

-

企业级认证: SSO、RBAC支持

-

部署模式: 云端vs本地vs混合

维度五:生态与社区(权重10%)

-

文档质量: API文档、示例代码的完善程度

-

社区活跃度: GitHub stars、Stack Overflow讨论量

-

更新频率: 模型迭代周期

四、 场景化选型实战案例

场景1:个人开发者,日常Python开发

需求: 快速编写函数、调试代码、撰写技术笔记

推荐组合:

-

代码补全: GitHub Copilot(IDE集成,低心智负担)

-

复杂问题: DeepSeek(免费、代码能力强)

-

文档撰写: Claude(长上下文,可一次性处理整篇文档)

理由: Copilot解决80%的日常编码;DeepSeek作为备选解决复杂算法;Claude用于技术方案整理和文档输出。

场景2:企业团队,Java后端开发,注重数据安全

需求: 代码规范统一、敏感数据不出域、团队协作

推荐组合:

-

本地化方案: Ollama + CodeLlama-34B(私有化部署)

-

企业级服务: GitHub Copilot Business(数据不用于训练)

-

代码审查: SonarQube + AI插件(质量门禁)

理由: 企业场景优先考虑数据安全,本地模型虽然能力略逊云端,但隐私可控;Copilot Business提供商业隐私保护。

场景3:科研人员,数据分析与论文写作

需求: 数据清洗、统计分析、学术写作润色

推荐组合:

-

数据分析: Julius AI(自然语言转代码)

-

论文润色: ChatGPT Plus(GPT-4)或 Claude

-

文献综述: Elicit或Scite(AI辅助文献检索)

理由: 科研场景需要工具具备“可解释性”和“溯源能力”,上述工具均能提供参考文献链接或代码逻辑说明。

五、 高阶策略:多模型协同与Agent化

对于进阶开发者,可以考虑引入多模型协同架构:

-

模型路由: 根据任务类型自动选择模型

-

简单任务 → 本地小模型(如Phi-3)

-

复杂推理 → 云端大模型(如GPT-4)

-

代码生成 → 专用代码模型(如CodeLlama)

-

-

Agent编排: 使用LangChain或AutoGPT构建工作流

-

输入:需求描述

-

执行:规划Agent拆解任务 → 代码Agent生成代码 → 测试Agent验证 → 审查Agent优化

-

输出:可直接运行的代码仓库

-

六、 避坑指南:常见误区的技术解读

| 误区 | 技术解读 | 正确做法 |

|---|---|---|

| “越大越好” | 模型参数量与效果并非线性关系,大模型延迟高、成本高 | 根据任务复杂度选择合适的蒸馏模型或MoE架构模型 |

| “免费就是好” | 免费工具往往在隐私政策、响应速度上存在隐性成本 | 评估时间成本与隐私风险,必要时为生产力付费 |

| “替代人工” | 当前AI工具仍存在幻觉、上下文丢失等问题 | 将AI定位为“结对编程搭档”而非“替代者”,保持审查意识 |

| “单一工具通吃” | 没有任何工具在所有任务上表现最优 | 构建工具链,各司其职 |

结语:

AI工具选型不是一次性的决策,而是一个持续优化的过程。技术的迭代速度远超我们的预期,今天的“最优解”可能在三个月后就被超越。建议建立“月度复盘”机制,评估当前工具组合的效率,及时调整。

对于开发者而言,真正的核心竞争力不在于使用了多少AI工具,而在于能否将工具的能力转化为自己的工程产出。希望本文提供的评估框架和实战思路,能帮助您在AI工具的海洋中,找到最适合自己的那一套技术栈。

欢迎在评论区留言交流您的工具使用心得,共同构建更高效的开发者工具链。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)