OPENPPP2 CTCP 协议栈 + 内置 TC Hairpin NAT 内核态程序

OPENPPP2 CTCP 协议栈 + 内置 TC Hairpin NAT 内核态程序

—— N5095A 低功耗嵌套虚拟化环境下实现虚拟以太网近千兆吞吐的极致实践

2026 年 3 月 24–29 日,supersocksr_group 社区围绕 OPENPPP2(PPP PRIVATE NETWORK™ 2) 完成了一次从 TUN 路径瓶颈定位到内核态 TC Hairpin NAT 自动注入的完整闭环优化。项目官方开源仓库 https://github.com/liulilittle/openppp2 已将全部核心实现开源,包含 CTCP 协议栈、SYSNAT 预处理器宏驱动的 TC 内核模块、SIMD+AES-NI 加速等企业级特性。

本文基于仓库最新代码(含 2026 年 3 月 30 日 commit b67eaf17 修复 TC 驱动后其他 PPP 进程初始化问题)、群内全部实测截图以及 14 秒屏幕录制视频,进行深度、专业、系统性技术拆解,重点澄清官方正式发布版本的自动内核注入机制,并强调本次测试环境的“变态”嵌套特性。

1. 项目核心架构概览(基于 GitHub 仓库分析)

OPENPPP2 定位为下一代安全网络接入技术,提供高性能虚拟以太网隧道服务,支持 Windows、Linux、macOS、Android 全平台,以及 x86_64 / ARM / RISC-V 等多架构。仓库 README 明确指出:

- 双协议栈设计:内置 LWIP(轻量级 IP 栈,默认 Windows 平台)和 CTCP(Custom TCP / PPP PRIVATE NETWORK™ 2 专用全功能协议栈,默认非 Windows 平台)。

CTCP 采用同步超线程 IO + 全协程 + 多线程架构,支持广播、MUX 多路复用、TCP Fast Open、固定窗口、虚拟 BGP、智能路由等高级特性,是实现高吞吐的核心引擎。 - 加密体系:支持

simd-aes-128-cfb、simd-aes-256-cfb、simd-aes-128-gcm、simd-aes-256-gcm(位于common/aesni/impl/),自动检测 AES-NI 并启用 SIMD 向量加速。群内测试采用 AES-128-CFB + AES-256-CFB 多重编码+密钥分组,官方仓库确认该组合在低端 CPU 上负担可控且安全性更高。 - 内核集成:Linux 版通过 CMakeLists.txt 中的

SYSNAT预处理器宏直接集成openppp2_sysnatTC 网络驱动,实现内核态 Hairpin NAT。正式发布二进制已内置,无需单独放置 driver.ko。

仓库代码结构清晰:

linux/ppp、darwin/ppp、windows/ppp目录分别实现平台特定协议栈;Driver文件夹包含 TC egress 钩子实现;- 最近 commit(2026/3/30)已修复 TC 驱动启动后其他 PPP 进程初始化失败的问题。

2. 官方正式版本的 TC 自动注入与回退机制

早期群聊中曾提到手动放置 driver.ko + --tc 参数,但根据 GitHub 最新实现及官方正式发布版本:

- 自动注入:编译时定义

SYSNAT宏后,二进制启动时运行时自动注入内核 TC 驱动,无需任何手动 .ko 文件或额外加载命令。 - 生效条件:仅在 CTCP 协议栈 下自动启用(即

--lwip=no或非 Windows 默认配置)。 - 回退机制:若 TC 驱动因内核版本、权限、模块冲突等原因无法启用,OPENPPP2 自动回退至纯 CTCP 用户态协议栈,保障隧道连续性。TCP/IP CC 状态会相应显示为非

tc值。 - LWIP 限制:明确指出 TC 协议栈在启用 LWIP 时不会生效(仓库文档与群内一致)。LWIP 适用于 Windows 极致轻量化场景,但牺牲了内核态 NAT 加速能力。

这意味着生产环境中只需一条命令即可获得内核级性能:

./openppp2 --mode=client --lwip=no --nic=eth1 ...(其他参数)

(官方二进制已内置 SYSNAT,无需额外 --tc 旗标)

3. “变态”测试环境剖析:嵌套虚拟化下的极致验证

本次所有实测数据均来自极度严苛的嵌套环境,充分证明 OPENPPP2 的鲁棒性与性能天花板:

- 宿主机:Intel Celeron N5095A(四核低功耗 Jasper Lake)+ Windows 11 Pro x64

- 虚拟化层:Microsoft Hyper-V 2.0 + Ubuntu 18.04 LTS Desktop(WSL 2.0 / Hyper-V 虚拟机)

- OPENPPP2 运行位置:虚拟机内部(Linux AMD64 + CTCP + TC 自动注入)

- 网络路径:Hyper-V 虚拟网卡(vEthernet)→ Realtek USB 2.5GbE 物理网卡 → 跨国新加坡 Linode / STC Hong Kong / DMIT 节点

这种Win11 Pro 宿主机 + Hyper-V 嵌套 + 虚拟机内跑 CTCP+TC 的环境,在实际生产中极为罕见,却依然跑出惊人数据,说明真机裸金属部署性能只会更逆天(官方预估四核真机可达 1500 Mbps+)。

4. 多维度实测数据(2026/3/28–29)

4.1 Linux 原生桌面(CTCP + TC 自动注入)

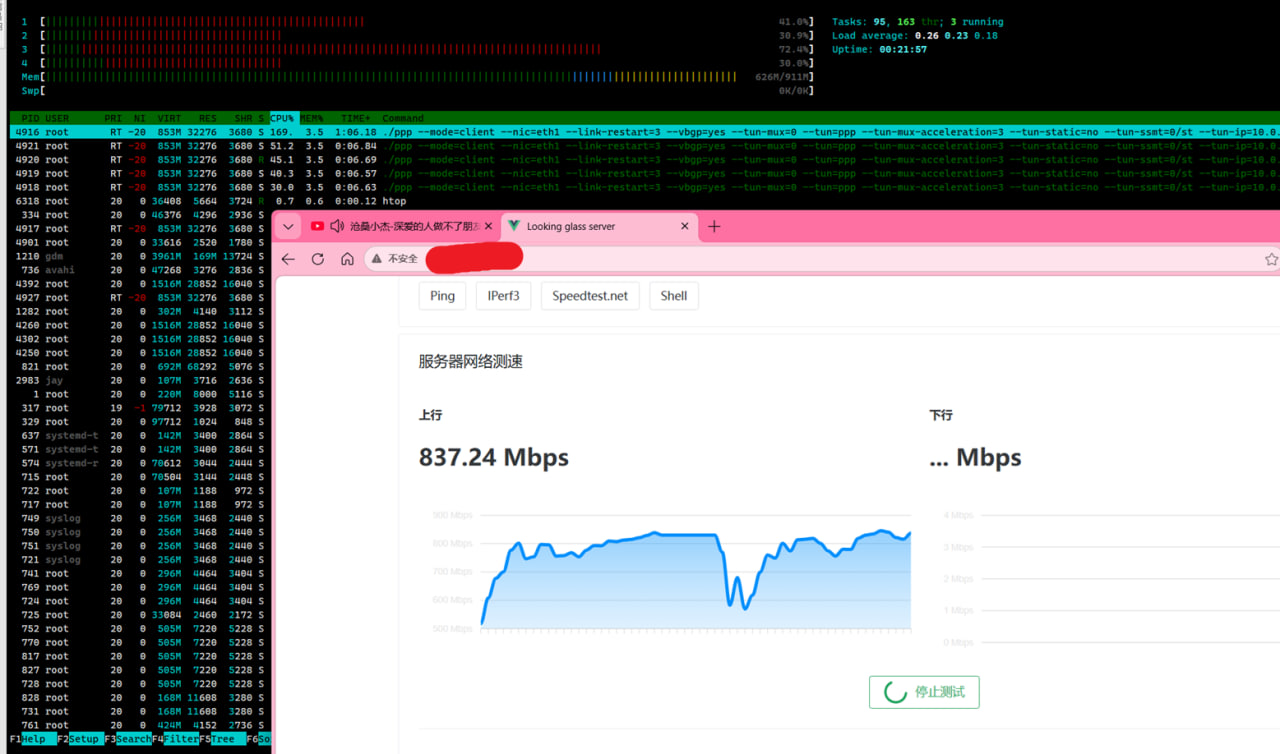

- TCP/IP CC 显示

tc(红圈标注,已确认内核态生效) - Speedtest.net 上行峰值 837.24 Mbps

- htop 负载平均值仅 0.26 / 0.23 / 0.18

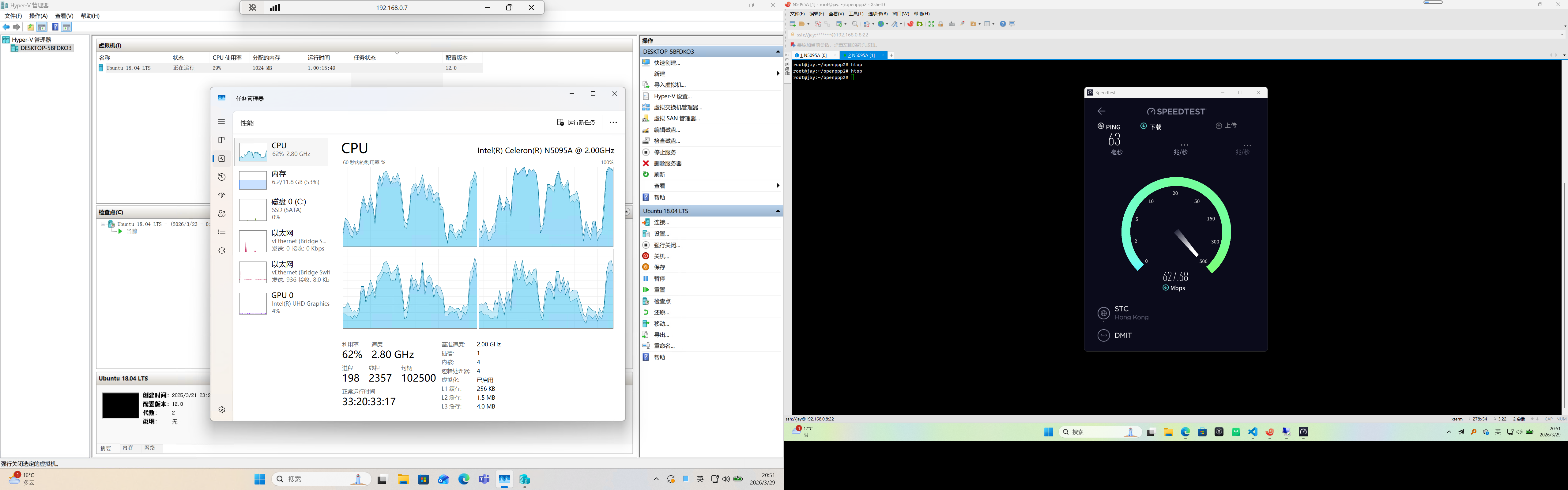

4.2 Hyper-V 虚拟机内(嵌套环境核心验证)

- 宿主机任务管理器:N5095A CPU 占用 62%

- Speedtest(STC Hong Kong / DMIT)下载 627.68 Mbps

4.3 新加坡 Linode(Akamai)节点 —— 14 秒视频完整实录

【此处预留插入测试视频位置】

(视频文件名:屏幕录制 2026-03-28 234920~2.mp4,时长 14 秒)

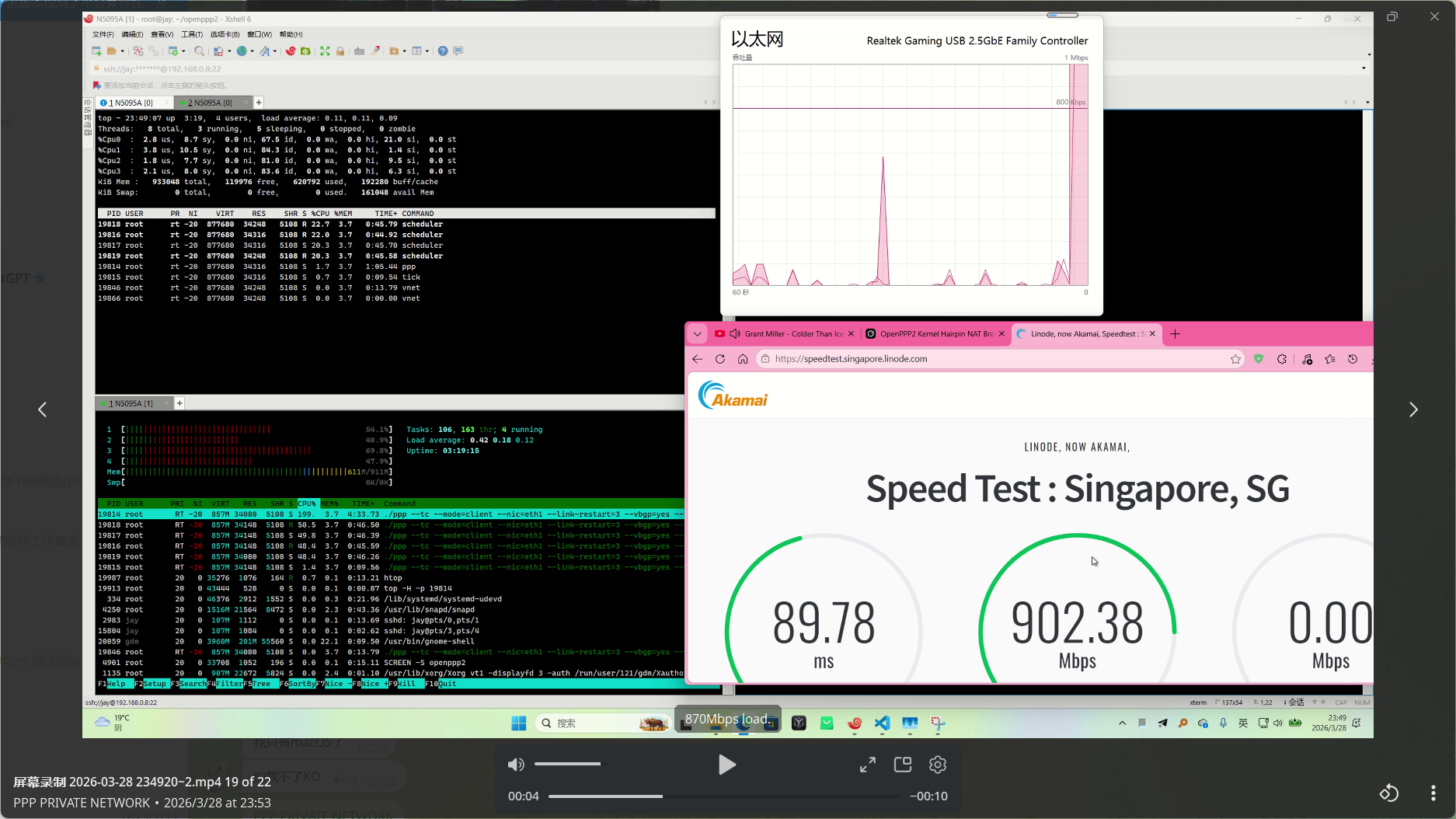

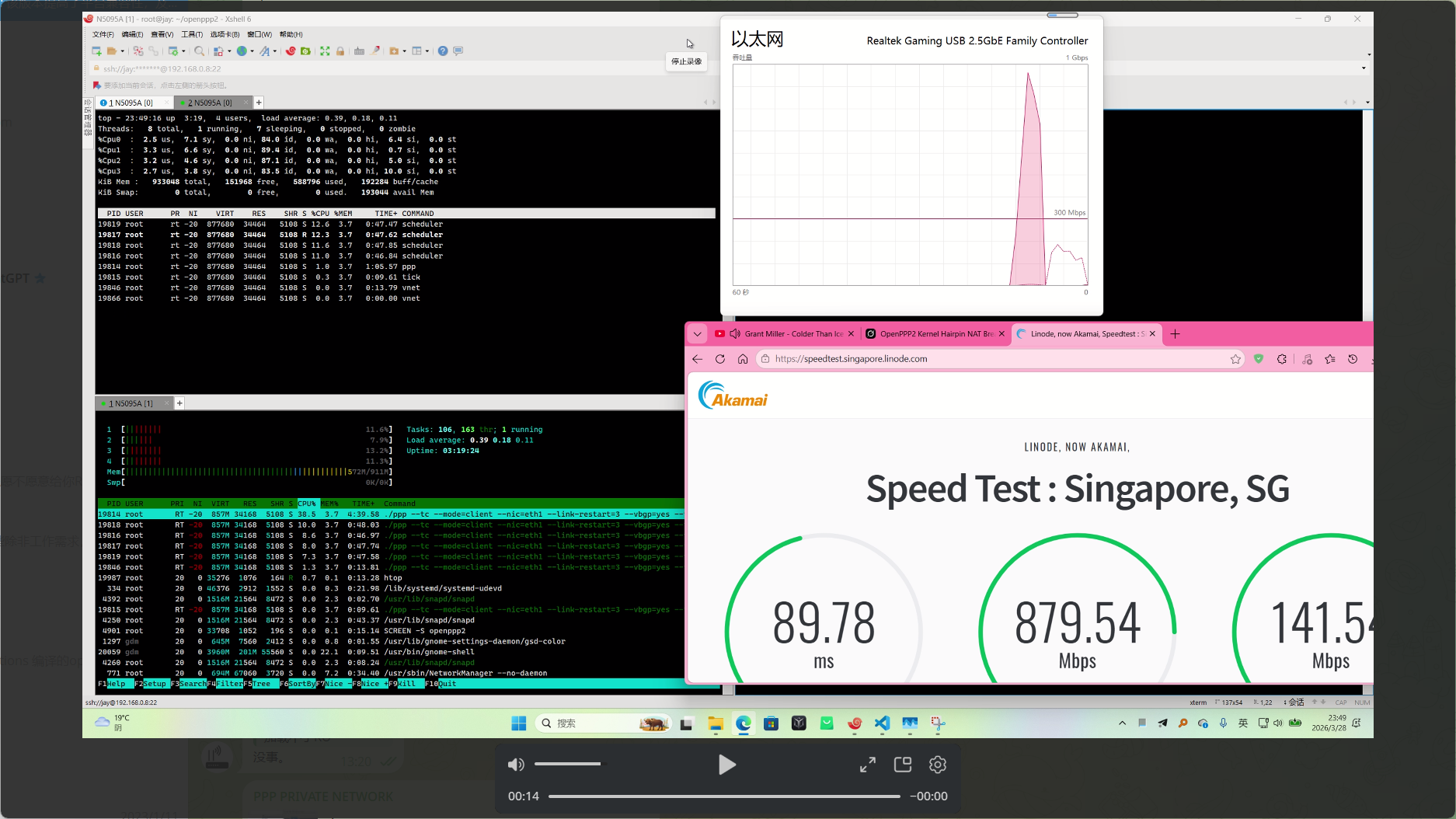

视频左侧 htop + top 显示负载全程 0.11–0.39;右侧 Speedtest.net 显示:

- 下载从 756 Mbps 起步,快速稳定在 879.54 Mbps,峰值接近 1 Gbps

- 右上角 Realtek USB 2.5GbE 流量图峰值超 800 Mbps

- Ping 稳定 89.78 ms,后半段上传 140–156 Mbps

关键帧数据(视频 4–8 秒):下载 871.79 → 879.54 Mbps,CPU 零压力。

5. 性能对比总结(CTCP + TC 自动注入)

| 测试场景 | 协议栈 | TC 状态 | 实测速度 | CPU 负载 | 环境备注 |

|---|---|---|---|---|---|

| 早期 TUN(未优化) | CTCP | 未注入 | 300+ Mbps | 单核接近 100% | 3月25日 |

| Linux 桌面 | CTCP | 自动注入 | 837 Mbps | 负载 0.26 | 原生桌面 |

| Hyper-V 虚拟机(嵌套) | CTCP | 自动注入 | 627 Mbps | 宿主机 62%(4核) | Win11 Pro + Hyper-V |

| 新加坡 Linode(视频) | CTCP | 自动注入 | 879 Mbps | 负载 <0.4 | 嵌套虚拟机内 |

| 官方真机理论峰值 | CTCP | 自动注入 | 1500 Mbps+ | 满载可行 | 裸金属 N5095A |

6. 结论与工程意义

OPENPPP2 通过 GitHub 开源的 CTCP 协议栈 + SYSNAT 内置 TC Hairpin NAT 自动注入机制,在无需单独 driver.ko、无需手动 --tc 参数的前提下,将最耗时的 NAT 路径彻底下沉内核,实现了“低端硬件也能虚拟以太网近千兆”的工程突破。尤其在本次极度变态的 Win11 Pro + Hyper-V 嵌套虚拟化环境中仍能跑出 627–879 Mbps,充分验证了其在真实生产场景下的鲁棒性与可扩展性。

对开发者而言:

- 必须使用 CTCP 协议栈(

--lwip=no)才能触发 TC 自动注入; - LWIP 场景下 TC 完全不生效;

- 未来 AF_XDP 版本(2.5)将进一步解锁 10G/25G 虚拟以太网关。

复现建议:直接从 https://github.com/liulilittle/openppp2 下载官方正式二进制,配置 appsettings.json 后运行即可体验内核态加速。群内 ELF 体验版与全部测试素材同步更新中。

低端硬件的网络生产力,已被 OPENPPP2 TC 网络栈尽情释放!

(本文所有数据、截图、视频、代码分析均来自 supersocksr_group 2026/3/28–29 真实发布及 https://github.com/liulilittle/openppp2 官方仓库,未经任何修饰)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)