重识大模型法则:读懂最火上下文工程

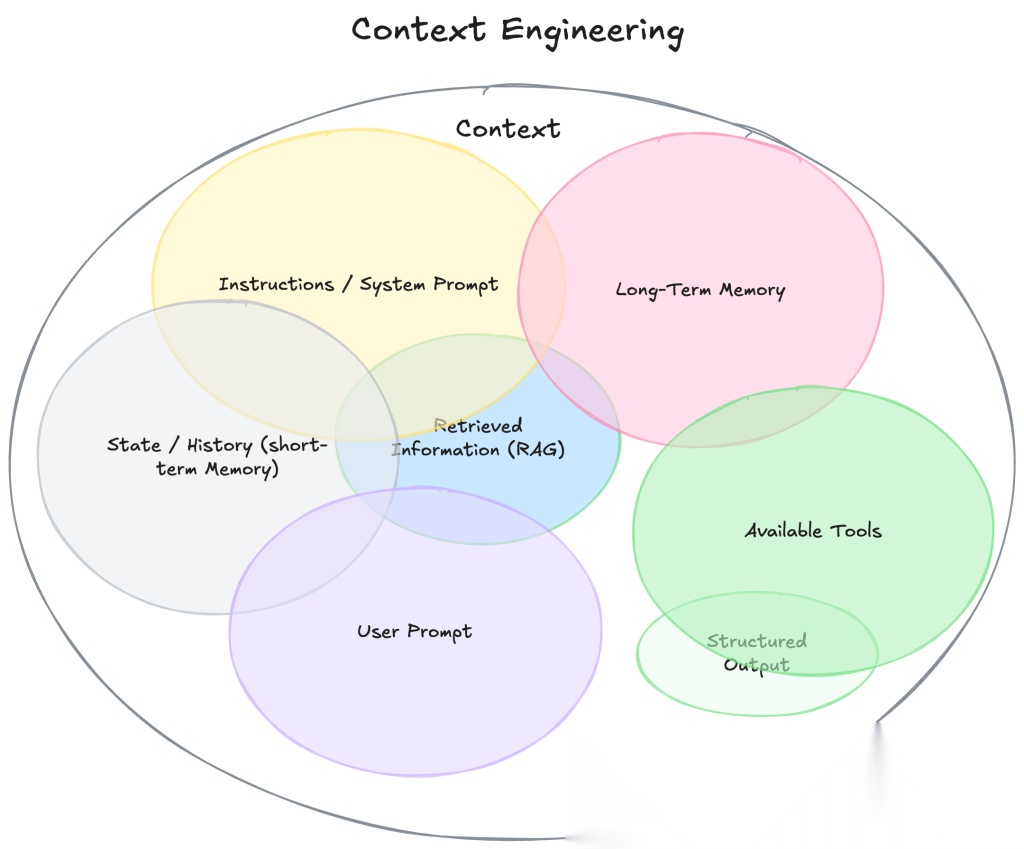

上下文工程

这个词来自《Context Engineering for AI Agents: Lessons from Building Manus[5]》,接下来的一些观点也可能和这篇文章有关。但显然,我们已经重新定义了一下“上下文”。

对LLM算法来说,如果单说RAG、MCP、提示词什么的,可能确实不需要过于关注,但“上下文工程”可能就得稍微关注一下了,因为它直接涉及到能否用好LLM。其实我自己也没太多思考,主要整理下这篇文章的几个观点。

围绕KV Cache设计

显然这是一个推理性能相关问题,KV Cache能够极大地提升推理效率。而且,随着上下文越来越长,输入输出Token比会越来越大,KV Cache的作用会更加明显。所以,尽量保证输入前缀的稳定性,新的信息从后面追加。如果使用vLLM,记得启动时开启prefix-caching[6],这样能够大大缩短预填充时间。这在长上下文任务和多轮对话场景下尤其有用。

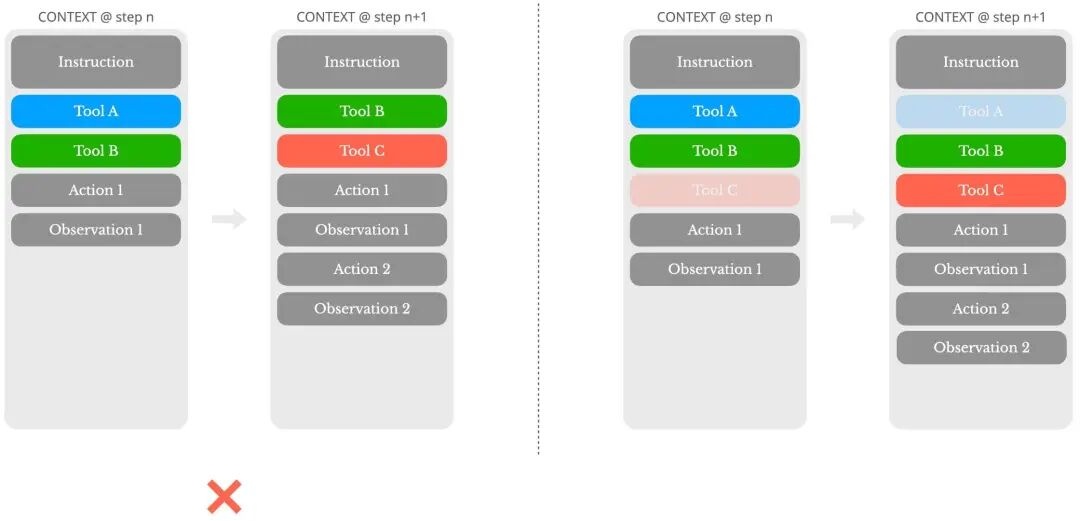

Mask而非按需加载

主要说的就是这些提供上下文的“信息源”,动态增删不仅会导致KV Cache失效,而且当先前的动作和观察仍然涉及当前上下文中不再定义的工具时,模型会感到困惑进而可能导致幻觉。Manus使用一个上下文状态感知状态机管理工具可用性,通过在解码过程中掩蔽token的logits,以基于当前上下文阻止(或强制)选择某些动作。

左图中,Action/Obs1使用的Tool A在下一步中没了,但Action/Obs1还在。

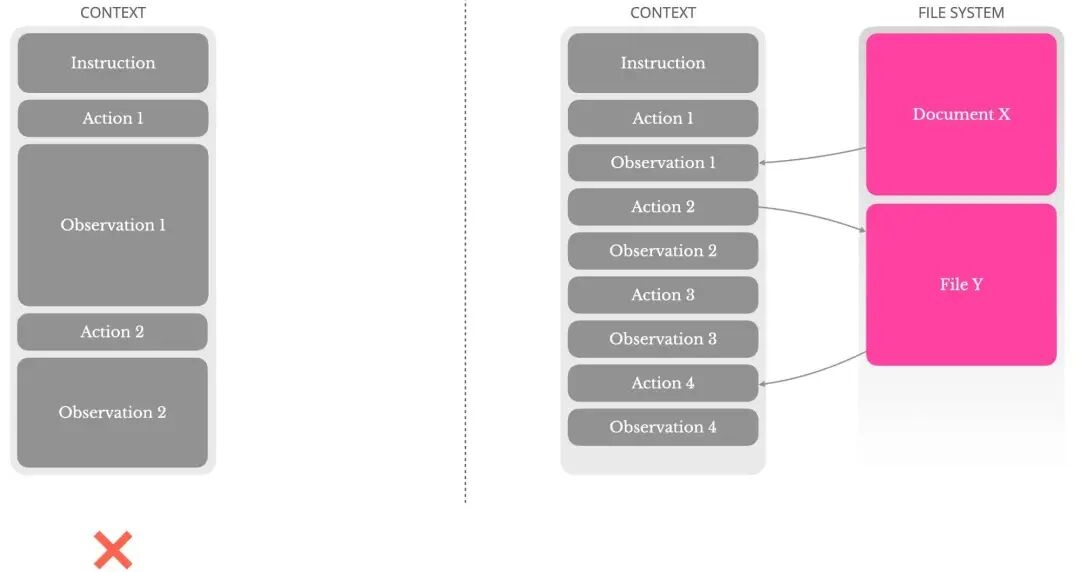

文件系统作为上下文

Agent的上下文信息经常太长,超出模型限制后性能下降,而且长输入成本也高。上下文截断或压缩策略可能导致信息损失,而且更关键的,Agent必须根据所有先前状态预测下个动作,我们没法保证那个信息在未来可能非常有用。所以,Manus将文件系统视为上下文,按需写入和读取。这里的压缩策略始终设计为可恢复的。比如,只要保留URL,网页内容就可以从上下文中移除。

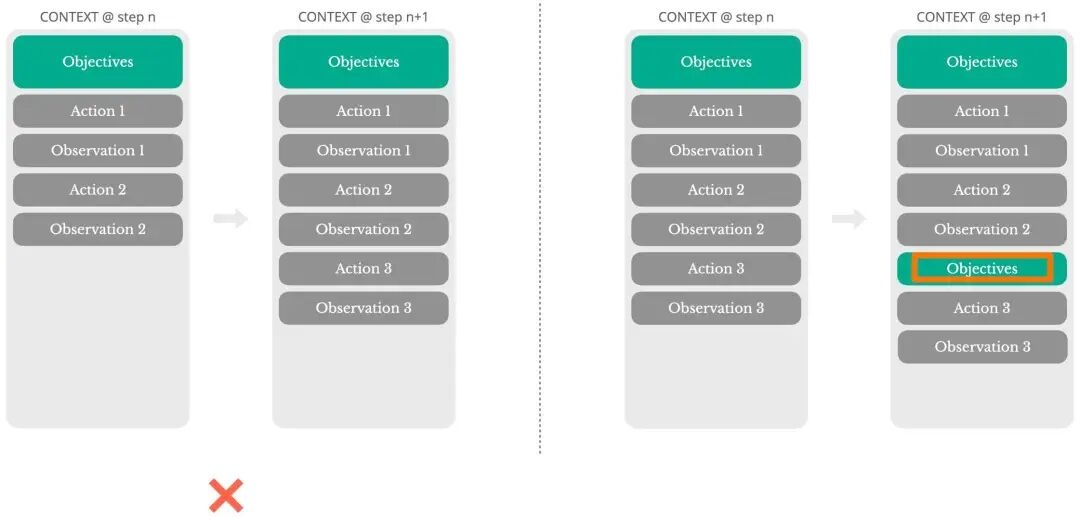

通过复述控制记忆

通过不断重复TODO,将目标复述到上下文末尾,缓解主题偏离和早期目标遗忘问题。

保留错误内容

把错误的尝试保留在上下文中。当模型看到一次失败的动作——以及由此产生的观察结果或错误堆栈信息——它会在内部隐式地更新自己的信念。这会让模型对类似动作的“先验”偏好发生转变,从而降低再次犯同样错误的概率。

增加提示样本结构多样性

LLM模仿上下文中的行为模式。如果上下文充满了类似的过去行动-观察对,模型将倾向于遵循该模式,即使这不再是最优的。Manus在行动和观察中引入少量的结构化变化——不同的序列化模板、替代性措辞、顺序或格式上的微小噪音。这种受控的随机性有助于打破模式并调整模型的注意力。

小结

都是相当实用的设计,而且它是“通用”的,因为它针对的就是“上下文”。最后,引用文章最后的话:

上下文工程仍是一门新兴的科学——但对于智能体系统来说,它已经变得不可或缺。虽然模型正变得更强大、更快速、更低成本,但再强的能力也无法取代记忆、环境和反馈的作用。你如何构建上下文,最终决定了智能体的行为方式:它运行得有多快、恢复得有多好、扩展得有多远。

The agentic future will be built one context at a time. Engineer them well.

虽说LLM is Agent美丽动人,但不得不说,Context Engineering也不乏迷人魅力。大家喜欢哪个?还是说,两手抓,两手都要硬。

再次重新认识数据

为什么说“再次”,因为R1出来后已经让我们重新认识了什么叫“高质量数据”。感兴趣的读者可以阅读《DeepSeek R1后LLM新范式 | Yam[7]》和《DeepSeek R1深度技术解析及其影响 | Yam[8]》。这里的再次,当然是指“LLM即Agent”的数据,具体来说就是K2的数据构造。

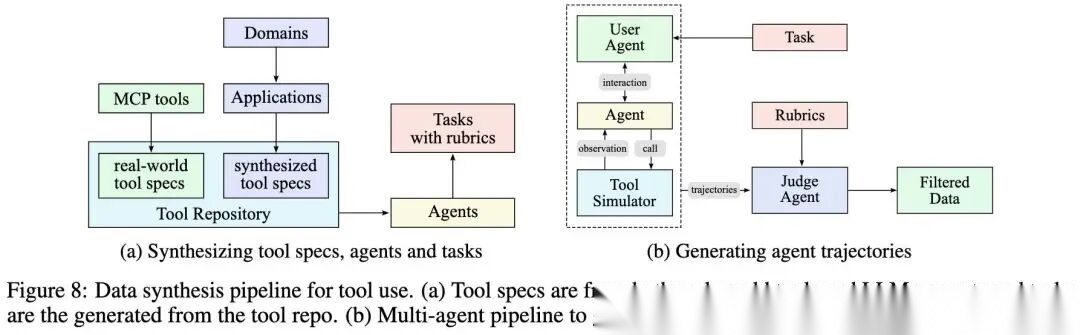

为什么K2能够LLM即Agent?我想高质量的相关数据恐怕是最重要的原因。请打开K2技术报告,我们不谈预训练阶段的Rephrasing,直接把报告翻到第9页,看SFT的《Large-Scale Agentic Data Synthesis for Tool Use Learning》,整整一小节介绍如何搞数据。数据合成pipeline如下图所示。

有真实的3000个和生成的各个领域超过2万个工具;成千上万个风格和能力各异的Agent和针对每个Agent一系列有明确评分标准的从简单到复杂的任务;用户模拟+工具模拟生成高质量多轮对话;质量评估和过滤,以及真实环境数据补充。

不知道大家有没有再次重新认识数据。果然,还是机器学习那句老话——数据决定上限,算法逼近上限。LLM的进化之路也是“数据”的蜕变进化之路啊。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献67条内容

已为社区贡献67条内容

所有评论(0)