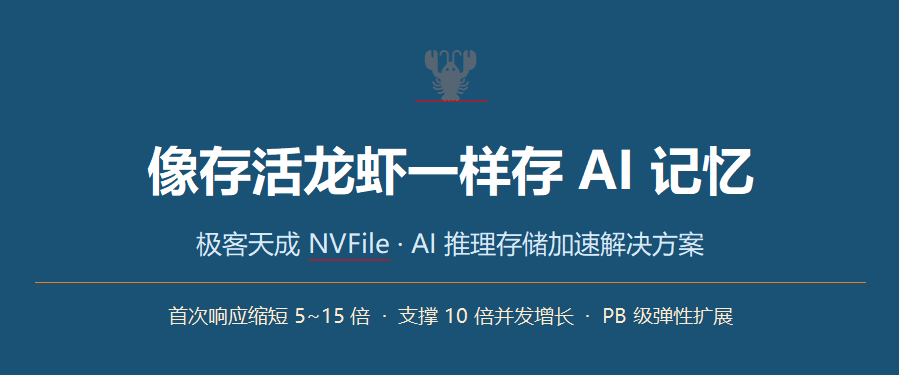

像存活龙虾一样存 AI 记忆-极客天成 NVFile · AI 推理存储加速解决方案

一、龙虾进了普通冷库,就不新鲜了——AI 推理的存储困境

大语言模型(LLM)在回答每一个问题时,都需要反复「回想」之前的对话记录。这份「记忆」,在技术上叫做 KV Cache(键值缓存)。它就像龙虾在运输途中的保活箱——越新鲜、越快速抵达,最终出品的质量越高。

问题在于:AI 模型的「记忆」会随着对话越来越长、用户越来越多,急剧膨胀。就算是最昂贵的 GPU 显存(HBM),也很快装不下了。

于是业界普遍尝试把 KV Cache 搬到外部存储——但结果是:

- 传统存储太慢: 访问延迟动辄毫秒级,AI 每次「回想」一段记忆都要等半天,用户感受到明显卡顿。

- 内存交换治标不治本: 主机内存有限,且拷贝过程拖慢整体速度,在大并发场景下更是捉襟见肘。

- TTFT 居高不下: 首次响应时间(TTFT,即用户发问到 AI 开口回答的时间)是体验核心,传统方案难以压短这一关键指标

|

打个比方:传统存储的延迟,就像把活龙虾装进普通泡沫箱运输——也许能到,但到的时候已经半死不活,上桌之前还得手忙脚乱折腾一番,食客早已不耐烦了。 |

二、NVFile 是什么?——专为 AI 记忆打造的"活水运输仓"

极客天成 NVFile 是一款面向 AI 推理场景深度优化的并行文件存储系统。它不是传统意义上"存放数据"的容器,而是 AI 推理流水线中的一个高速缓存加速层——性能接近内存,容量远超内存,专门解决 KV Cache 的快存快取问题。

类比存储人最熟悉的语言来说:

- 定位: 在 GPU 显存(一级缓存)与传统存储(冷数据仓库)之间,NVFile 扮演的是高速缓存层(热数据快道),是专门为 AI 模型记忆设计的"保鲜通道"。

- 介质: 基于 NVMe SSD 集群构建,通过高速 InfiniBand 网络互联,访问速度介于内存与机械存储之间,但容量可弹性扩展至 PB 级。

- 架构: 无缓存直通设计 + 全栈并行化 + RDMA 零拷贝技术,彻底绕开操作系统内核的传统慢路径,直达 GPU 显存。

三、三个核心技术能力——龙虾保活的三道工序

① 无缓存直通:去掉「中转冷库」,AI 记忆直达目的

传统存储路径像走「多级中转」:数据从 SSD 出来,先进操作系统的 Page Cache 缓冲,再经 CPU 处理,再拷贝进内存,最终才到 GPU 显存——每一步都是延迟。

NVFile 的无缓存直通架构,彻底砍掉这条弯路。数据从 NVMe SSD 出发,通过 RDMA(远程直接内存访问)技术,直接"飞"进 GPU 显存,全程不经 CPU、不过内存缓冲。访问延迟稳定在 5~10 微秒,是传统方案的百倍提速。

|

存储人的类比:这就像取消所有中转仓,让活龙虾从养殖基地直连餐厅水族箱——全程恒温直达,保鲜率直线拉满。 |

② 全栈并行化:一次服务千桌客人,每桌都不等

AI 推理服务的真实场景是高并发——成百上千用户同时在问,每个人都需要独立调取自己的那份「记忆」。这就考验存储系统的并发处理能力。

NVFile 的全栈并行化架构从三个层面解决并发问题:

- 网络层: 基于 InfiniBand Multi-Rail 技术,单节点可建立数百条并发 RDMA 通道,聚合带宽达 TB/s 级,流量不拥堵、不排队。

- 数据层: 三维条带化技术将海量 KV Cache 均匀分散在所有 NVMe SSD 上,IO 压力不集中、不成瓶颈,多少人同时访问都能顺畅应答。

- 元数据层: 高性能元数据服务实测超 200 万 QPS,快速定位每份 KV Cache 数据,不让索引成为响应速度的短板。

|

存储人的类比:就像一家顶级海鲜酒楼,后厨有专门的分池存活系统——每种龙虾独立水槽、独立水泵、独立供氧。无论大堂坐了多少桌客人,每桌龙虾上桌时都是最新鲜状态。 |

③ 以存换算:少点外卖,多吃剩菜——但剩菜还比外卖鲜

AI 推理中有大量「重复运算」——同样的上下文反复被不同用户调用,每次都重新计算,成本极高。NVFile 作为 KV Cache 的持久化高速存储层,让这些算好的结果直接缓存下来,下次调用直接读取,不再重算。

这在存储界叫「以存换算」——用便宜的存储资源,换省下的昂贵算力资源。在长对话、个性化推理等场景,可大幅降低单次推理成本,让 GPU 的钱花在刀刃上

四、实测数据说话——把龙虾送上桌的速度快了多少?

以下为 NVFile 与传统方案的关键指标对比(内部实测数据):

|

对比维度 |

传统存储方案 |

NVFile 极速方案 |

|

访问延迟 |

毫秒级(ms) |

微秒级(5~10μs)✓ |

|

TTFT 改善 |

基准线 |

缩短 5~15 倍 ✓ |

|

并发扩展能力 |

受 GPU 内存限制 |

提升 10 倍并发 ✓ |

|

存储容量扩展 |

受 HBM 容量限制 |

PB 级弹性扩展 ✓ |

|

GPU 算力复用 |

重复计算高 |

KV Cache 复用降本 ✓ |

在严格 TTFT 约束(用户可接受的 2 秒内)下,集成 NVFile 的系统:

- TTFT 压缩: 长上下文场景从数百毫秒压至数十毫秒,提升 5~15 倍,用户感受从【等得想关闭】到【秒级响应】。

- 并发扩展: 同等 GPU 硬件资源下,可支持并发推理请求数提升 10 倍,ROI 显著提升。

- 算力节省: KV Cache 复用减少重复计算,长序列任务综合算力成本可观地下降。

五、谁最需要 NVFile?——哪些【龙虾馆子】最受益

- AI 对话平台(如 OpenClaw 类应用): 面向海量用户的 AI 问答、智能客服、AI 助手产品——用户越多、对话越长,NVFile 节省的 TTFT 和算力越明显,直接决定用户留存与服务成本。

- AI 推理云服务提供商: 需要在有限 GPU 资源下服务最多用户的云平台,NVFile 的 10 倍并发扩展能力即是 10 倍的收入空间。

- 企业私有化 AI 部署: 金融、医疗、法律等高价值行业的私有 AI 推理系统,对响应速度与数据安全双重要求,NVFile 在本地化部署下同样具备完整性能优势。

- 长上下文 / 多轮对话 AI 产品: 法律合同分析、长文本摘要、代码生成等场景,上下文越长受益越大,是 NVFile 加速效果最显著的战场。

|

特别说明:OpenClaw 等面向终端用户的 AI 应用,是 NVFile 最典型的受益场景。随着用户规模增长、对话轮次加深,KV Cache 的体量快速膨胀,NVFile 的介入能让 AI 的"记忆调取"从拖脚步变成健步如飞——用户根本感觉不到等待。 |

六、结语——好存储,是 AI 推理的隐形加速引擎

存储从来不只是「放东西的地方」。在 AI 推理时代,存储的速度、架构和智能化程度,直接决定了模型能不能【想得快】、服务能不能【跟得上】、成本能不能【降得下】。

极客天成 NVFile,以存储人最熟悉的底层逻辑——低延迟、高并发、高性价比——为 AI 推理系统构建了一条专属的高速记忆通道。

就像那只保活运输的龙虾:从养殖池到餐桌,全程活蹦乱跳,一丝鲜味都不打折。这,就是我们对存储性能的承诺。

|

联系极客天成,获取 NVFile 方案评估与 PoC 测试支持 让您的 AI 推理系统,像活龙虾一样鲜活弹跳 |

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)