【论文翻译】Coordinate Attention for Efficient Mobile Network DesignCA注意力机制原文翻译

# 摘要

最近关于移动网络设计的研究表明,通道注意力(例如 Squeeze-and-Excitation 注意力)在提升模型性能方面具有显著效果,但它们通常忽略了位置信息,而位置信息对于生成空间选择性注意力图非常重要。在本文中,我们提出了一种用于移动网络的新型注意力机制,通过将位置信息嵌入通道注意力中,我们称之为“坐标注意力”。与通过二维全局池化将特征张量转换为单一特征向量的通道注意力不同,坐标注意力将通道注意力分解为两个沿两个空间方向分别聚合特征的一维特征编码过程。通过这种方式,可以沿一个空间方向捕捉长程依赖,同时沿另一空间方向保留精确的位置信息。生成的特征图随后被分别编码为一对具有方向感知和位置敏感的注意力图,这些注意力图可以互补地应用于输入特征图,以增强目标对象的表征。我们的坐标注意力设计简单,可灵活地嵌入经典移动网络,如 MobileNetV2、MobileNeXt 和 EfficientNet,且几乎不增加计算开销。大量实验证明,我们的坐标注意力不仅对 ImageNet 分类有益,更有趣的是,在下游任务中表现更佳,例如目标检测和语义分割。

# 1.简介

注意力机制用于告诉模型“关注什么”和“在哪里关注”,已被广泛研究 [47, 29] 并广泛应用于提升现代深度神经网络的性能 [18, 44, 3, 25, 10, 14]。然而,它们在移动网络(模型大小有限)中的应用明显落后于大规模网络。这主要是因为大多数注意力机制带来的计算开销对于移动网络来说是无法承受的。

考虑到移动网络受限的计算能力,到目前为止,对于移动网络最流行的注意力机制仍然是Squeeze-and-Excitation(SE)注意力[18]。它在2D全局池化的帮助下计算通道注意力,并在相当低的计算成本下提供显著的性能提升。然而,SE注意力仅考虑编码通道间信息,而忽略了位置信息的重要性,而位置信息对于捕捉视觉任务中的对象结构至关重要[42]。后续工作,如BAM[30]和CBAM[44],尝试通过降低输入张量的通道维度,然后使用卷积计算空间注意力,如图2(b)所示。然而,卷积只能捕捉局部关系,但在建模对视觉任务至关重要的长程依赖性方面表现不足[48,14]。

在本文中,超越前人的工作,我们提出了一种新颖且高效的注意力机制,通过将位置信息嵌入通道注意力,使移动网络能够关注大范围区域,同时避免产生显著的计算开销。为了缓解2维全局池化造成的位置信息损失问题,我们因式分解通道注意力到两个平行的1维编码过程,将空间坐标信息整合到生成的注意力图中。具体而言,我们的方法利用两个一维全局池化操作,分别沿垂直和水平方向聚合输入特征,形成两个独立的方向感知特征图。这两个嵌入了特定方向信息的特征图随后分别被编码成两个注意力图,每个注意力图捕捉输入特征图沿一个空间方向的长程依赖。因此,位置信息可以在生成的注意力图中得到保留。然后,通过乘法将这两个注意力图应用到输入特征图上,以强调感兴趣的表示。我们将所提出的注意力方法命名为坐标注意力,因为其操作区分空间方向(即坐标)并生成坐标感知的注意力图。

我们的坐标注意力具有以下优势。首先,它不仅捕捉跨通道的信息,还捕捉方向感知和位置敏感的信息,这有助于模型更准确地定位和识别感兴趣的对象。其次,我们的方法灵活且轻量化,可以轻松地插入移动网络的经典构建模块中,例如MobileNetV2 [34] 提出的倒残差块和MobileNeXt [49] 提出的沙漏块,通过强调信息丰富的表示来增强特征。第三,作为一个预训练模型,我们的坐标注意力可以为移动网络的下游任务带来显著的性能提升,特别是对于那些具有密集预测的任务(例如语义分割),这一点将在我们的实验部分展示。

为了展示所提出方法相对于以往移动网络注意力方法的优势,我们在 ImageNet 分类[33] 以及包括目标检测和语义分割的流行下游任务上进行了大量实验。在可比的可学习参数量和计算量下,我们的网络在 ImageNet 的 top-1 分类准确率上实现了 0.8% 的性能提升。在目标检测和语义分割任务中,与采用其他注意力机制的模型相比,我们也观察到了显著的改进,如图 1 所示。我们希望我们简单且高效的设计能够促进未来移动网络注意力机制的发展。

# 2.相关工作

在本节中,我们对本文作一个简要的文献综述,包括关于高效网络架构设计以及注意力或非局部模型的先前工作。

## 2.1 移动网络架构

最近的最先进移动网络大多基于深度可分离卷积 [16] 和倒残差块 [34]。HBONet [20] 在每个倒残差块内部引入下采样操作,以建模具有代表性的空间信息。ShuffleNetV2 [27] 在倒残差块的前后使用通道分割模块和通道洗牌模块。随后,MobileNetV3 [15] 结合神经网络架构搜索算法 [50] 来搜索不同深度倒残差块的最优激活函数和扩展比例。此外,MixNet [39]、EfficientNet [38] 和 ProxylessNAS [2] 也采用不同的搜索策略,搜索深度可分离卷积的最佳卷积核大小,或者控制网络权重的标量,包括扩展比例、输入分辨率、网络深度和宽度。最近,Zhou 等人 [49] 重新思考了深度可分离卷积的利用方式,提出了 MobileNeXt,该方法为移动网络采用了经典的瓶颈结构。

## 2.2 注意力机制

注意力机制 [41, 40] 已被证明在各种计算机视觉任务中非常有用,例如图像分类 [18, 17, 44, 1] 和图像分割 [14, 19, 10]。一个成功的例子是 SENet [18],它通过简单地压缩每个二维特征图来高效建立通道间的依赖关系。CBAM [44] 进一步推进了这一思想,通过使用大尺寸卷积核引入空间信息编码。后续工作,如 GENet [17]、GALA [22]、AA [1] 和 TA [28],通过采用不同的空间注意力机制或设计高级注意力模块来扩展这一思想。非局部/自注意力网络近年来非常流行,因为它们能够建立空间或通道层面的注意力。典型例子包括 NLNet [43]、GC Net [3]、A2Net [7]、SCNet [25]、GSoP-Net [11] 或 CC Net [19],它们都利用非局部机制捕捉不同类型的空间信息。然而,由于自注意力模块内部的计算量很大,它们通常被应用于大型模型 [13, 46],而不适合移动网络。与这些利用昂贵且复杂的非局部或自注意力模块的方法不同,我们的方法考虑了一种更高效的方式来捕捉位置信息和通道间关系,以增强移动网络的特征表示。通过将二维全局池化操作分解为两个一维编码过程,我们的方法在保持轻量化特性的同时(例如 SENet [18]、CBAM [44] 和 TA [28]),表现优于其他注意力方法。

# 3. 坐标注意力

坐标注意力模块可以被视为一个计算单元,旨在增强移动网络所学习特征的表达能力。它可以接受任何中间特征张量作为输入,输出大小和X一样输出具有增强表示的变换张量Y。为了清楚地描述所提出的坐标注意力,我们首先回顾SE注意力,它在移动网络中被广泛使用。

## 3.1 回顾SE注意力

如[18]所示,标准卷积本身很难建模通道之间的关系。显式构建通道间的依赖关系可以提高模型对那些对最终分类决策贡献更大的信息通道的敏感性。此外,使用全局平均池化也可以帮助模型捕捉卷积所缺乏的全局信息。在结构上,SE块可以分解为两个步骤:压缩和激励,它们分别用于全局信息嵌入和通道关系的自适应重新校准。给定输入X,第c个通道的压缩步骤可以公式化如下

(1)

其中,表示输出与第c个通道相关。输入 X 是直接来自具有固定卷积核大小的卷积层,因此可以将其视为一组局部描述符。Squeeze 操作使收集全局信息成为可能。

第二步,激励,旨在充分捕捉通道之间的依赖关系,这可以被表述为

![]() (2)

(2)

其中·指的是通道-wise乘法,σ是 sigmoid 函数,ˆ z 是由变换函数生成的结果,该函数的公式如下:

![]() (3)

(3)

这里,T1 和 T2 是两个可以学习的线性变换,用于捕捉每个通道的重要性。

SE模块已广泛应用于近期的MobileNet工作[18, 4, 38],并被证明是实现最先进性能的关键组件。然而,它仅通过建模通道关系来重新加权每个通道的重要性,却忽略了位置信息,我们将在第4节通过实验证明,位置信息对于生成空间选择性注意力图是重要的。接下来,我们将介绍一个新型注意力模块,它同时考虑通道间关系和位置信息。

## 3.2 坐标注意力块

我们的坐标注意力通过两个步骤编码通道关系和长程依赖的精确位置信息:坐标信息嵌入和坐标注意力生成。所提出的坐标注意力模块的示意图可以在图2的右侧部分找到。接下来,我们将详细描述它。

### 3.2.1 坐标信息嵌入

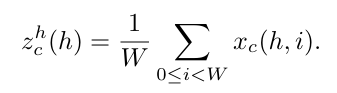

全局池化通常用于通道注意力中以全局编码空间信息,但它将全局空间信息压缩到通道描述符中,因此难以保留位置信息,而位置信息对于捕获视觉任务中的空间结构是必不可少的。为了鼓励注意力块在空间上以精确的位置信息捕获远程交互,我们将公式(1)中的全局池化分解为一对一维特征编码操作。具体来说,给定输入 X,我们使用两种空间范围的池化核 (H,1) 或 (1,W) 分别沿水平坐标和垂直坐标对每个通道进行编码。因此,高度为 h 的第 c 个通道的输出可以表达为

(4)

(4)

同样,第 c 个通道在宽度 w 的输出可以表示为

(5)

(5)

上述两种变换分别沿两个空间方向聚合特征,从而得到一对方向感知的特征图。这与通道注意力方法中的压缩操作(公式(1))不同,后者生成单一的特征向量。这两种变换还使我们的注意力模块能够沿一个空间方向捕获长程依赖,并沿另一个空间方向保留精确的位置信息,这有助于网络更准确地定位感兴趣的目标。

### 3.2.2 坐标注意力生成

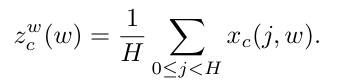

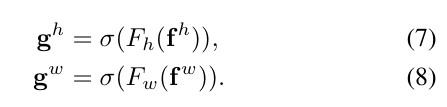

如上所述,方程(4)和方程(5)实现了全局感受野并编码了精确的位置信息。为了利用由此产生的表达性表示,我们提出了第二种变换,称为坐标注意力生成。我们的设计参考以下三个标准。首先,对于移动环境中的应用,新变换应尽可能简单且成本低廉。其次,它可以充分利用捕获到的位置信息,从而准确突出感兴趣的区域。最后但同样重要的是,它还应能够有效捕捉通道间关系,这在现有研究中已被证明是必不可少的 [18, 44]。具体来说,给定由方程(4)和方程(5)生成的聚合特征图,我们首先将它们拼接,然后将其传送到共享的 1 × 1 卷积变换函数 F1,得到![]() (6)

(6)

其中 [·,·] 表示沿空间维度的连接操作,δ 是一个非线性激活函数,f ∈ RC/r×(H W) 是编码了水平和垂直方向空间信息的中间特征图。这里,r 是用于控制块大小的缩减比率,如同 SE 块中的设置。然后把f切割到两个分开的空间维度。另外两个1×1卷积变换Fh和Fw被用于分别将fh和fw转换为与输入X具有相同通道数的张量,从而得到

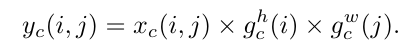

回想一下,σ是Sigmoid函数。为了降低模型的额外复杂度,我们通常会用适当的缩减比r(例如32)来减少f的通道数。我们将在实验部分讨论不同缩减比对性能的影响。然后,输出gh和gw分别被扩展并用作注意力权重。最后,我们的坐标注意力模块的输出Y可以写成 (9)

(9)

讨论。与仅关注重新加权不同通道重要性的通道注意力不同,我们的坐标注意力模块还考虑编码空间信息。如上所述,对输入张量同时沿水平和垂直方向应用注意力。两个注意力图中的每个元素都反映感兴趣的目标是否存在于相应的行和列中。该编码过程使我们的坐标注意力能够更准确地定位感兴趣目标的确切位置,从而帮助整个模型更好地识别。我们将在实验部分对此进行详尽的展示。

## 3.3 实施

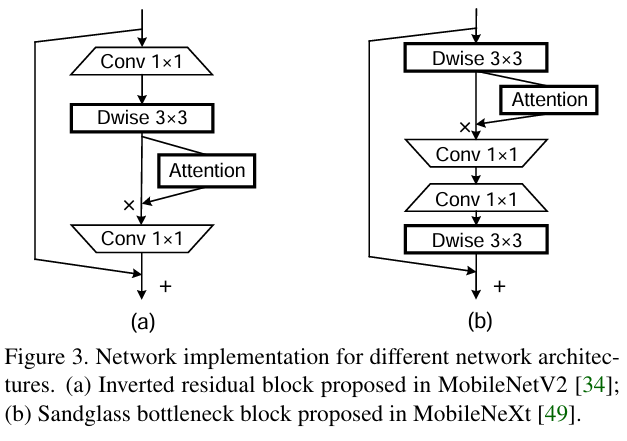

由于本文的目标是研究一种更好的方式来增强移动网络的卷积特征,这里我们以两种经典的轻量级架构为例,它们具有不同类型的残差块(即 MobileNetV2 [34] 和 MobileNeXt [49]),以展示所提出的坐标注意力块相对于其他著名的轻量级注意力模块的优势。图3显示了我们如何将注意力模块插入MobileNetV2中的倒残差块以及MobileNeXt中的沙漏块。

# 4 实验

在本节中,我们首先描述我们的实验设置,然后进行一系列消融实验,以展示每个组件在所提出的坐标注意力性能中的贡献。接下来,我们将我们的方法与一些基于注意力的方法进行比较。最后,我们报告了所提出的方法在目标检测和语义分割上与其他基于注意力的方法的比较结果。

## 4.1 实验设置

我们使用 PyTorch 工具箱[31]来实现我们所有的实验。在训练过程中,我们使用标准的带衰减的 SGD 优化器,动量为 0.9 来训练所有模型。权重衰减始终设为 4×10⁻⁵。采用余弦学习率调度,初始学习率为 0.05。我们使用四块 NVIDIA GPU 进行训练,批量大小设为 256。在没有额外说明的情况下,我们以 MobileNetV2 作为基线,并训练所有模型 200 个 epoch。对于数据增强,我们使用与 MobileNetV2 中相同的方法。我们在 ImageNet 数据集[33]上报告分类结果。

## 4.2 消融试验

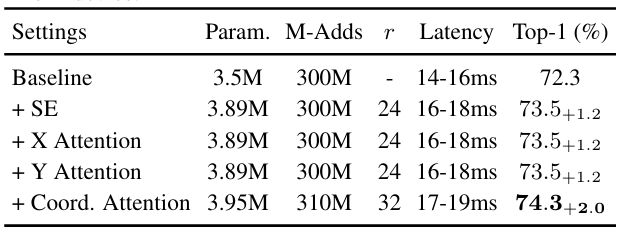

坐标注意力的重要性。为了展示所提出的坐标注意力的性能,我们进行了系列消融实验,其对应结果全部列在表1中。我们从坐标注意力中移除了水平注意力或垂直注意力,以观察编码坐标信息的重要性。如表1所示,沿任一方向有注意力的模型性能相当于添加SE注意力的模型。然而,当同时引入水平注意力和垂直注意力时,我们获得了如表1所示的最佳结果。这些实验表明,在可比较的可学习参数和计算成本下,坐标信息嵌入对于图像分类更有帮助。

表 1 显示了在不同实验设置下所提出的坐标注意力的结果比较。这里,r 是缩减比率,基线结果基于 MobileNetV2 模型。如图所示,无论是添加水平(X)注意力还是垂直(Y)注意力的模型,其性能与添加 SE 注意力的模型相同。然而,当同时考虑水平和垂直注意力(坐标注意力)时,我们的方法取得了最佳结果。延迟在 Google Pixel 4 设备上进行了测试。

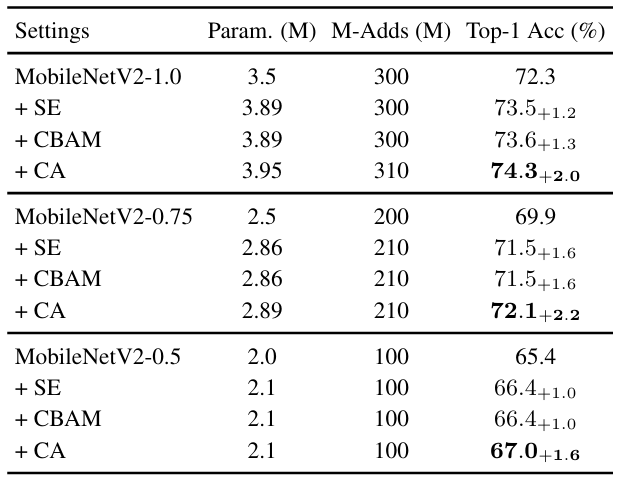

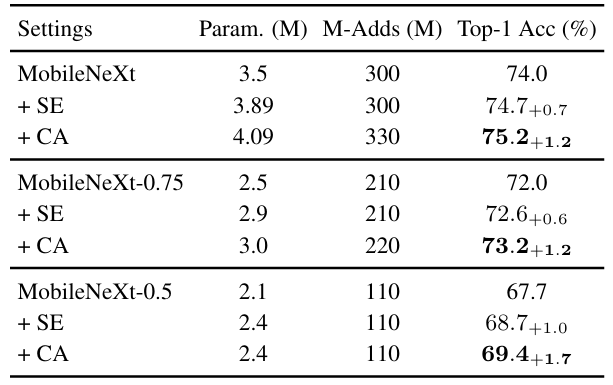

不同权重乘数。在这里,我们以两个经典的移动网络(包括在倒置残差块中的MobileNetV2[34]和带沙漏瓶颈块的MobileNeXt[49])作为基线,来观察所提出的方法在不同权重乘数下与SE注意力[18]和CBAM[44]的性能比较。在本实验中,我们采用三种典型的权重乘数,包括{1.0, 0.75, 0.5}。如表2所示,以MobileNetV2网络为基线时,带CBAM的模型结果与带SE注意力的模型相似。然而,在各个设置下,采用所提出的坐标注意力的模型都获得了最佳结果。当使用MobileNeXt网络时,也可以观察到类似现象,如表3所列。这表明,无论是沙漏瓶颈块还是倒置残差块,无论选择哪种权重乘数,我们的坐标注意力都表现最佳,因为它采用了先进的方法同时编码位置信息和通道间信息。

Table2. 使用 MobileNetV2 作为基线时,不同权重乘数下不同注意力方法的比较。(PS:“权重乘数”是一个超参数,它会在上述相乘操作之前,先对注意力图进行整体缩放(即 最终特征 = 原始特征 × (权重乘数 × 注意力图))。)

Table3. 使用 MobileNeXt作为基线时,不同权重乘数下不同注意力方法的比较。

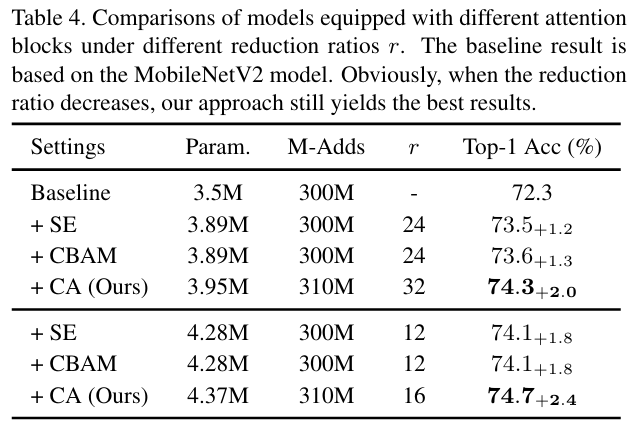

减小比率的影响。为了研究不同注意力块减小比率对模型性能的影响,我们尝试减少减小比率的大小并观察性能变化。如表4所示,当我们将其减小到原始大小的一半时,模型大小增加,但可以获得更好的性能。这表明通过减小减小比率增加更多参数对于提升模型性能很重要。更重要的是,我们提出的坐标注意力在这个实验中表现优于SE注意力和CBAM注意力,反映出所提出的坐标注意力对缩减比的稳健性。

## 4.3 和其他模型的比较

面向移动网络的注意力。我们在表2中将我们的坐标注意力与用于移动网络的其他轻量级注意力方法进行比较,包括广泛采用的SE注意力[18]和CBAM[44]。如图所示,加入SE注意力已经使分类性能提升了超过1%。对于CBAM,其空间注意力模块如图2(b)所示,在移动网络中相比SE注意力并没有显著贡献。然而,当考虑提出的坐标注意力时,我们取得了最佳结果。我们还在图4中可视化了不同注意力方法产生的特征图。显然,我们的坐标注意力在定位感兴趣对象方面比SE注意力和CBAM更为有效。

我们认为,所提议的位置编码方式相对于CBAM的优势有两个方面。首先,CBAM里的孔家按注意力挤压通道到1,造成信息损失,。然而,我们的坐标注意力使用适当的缩减比率来减少瓶颈中的通道维度,避免过多的信息损失。其次,CBAM利用一个卷积层,卷积核大小为7×7,以编码局部空间信息,而我们的坐标注意力通过使用两个互补的1D全局池化操作来编码全局信息。这使得我们的坐标注意力能够捕捉空间位置之间的长程依赖关系,这对于视觉任务至关重要。

为了进一步展示所提出的协调注意力在更强大的移动网络中相比SE注意力的优势,我们以EfficientNet-b0 [38]作为我们的基线。EfficientNet基于架构搜索算法,并包含SE注意力。为了研究所提出的协调注意力在EfficientNet上的性能,我们仅将SE注意力替换为我们提出的协调注意力。对于其他设置,我们遵循原论文。

## 4.4 的应用不写了。。。

# 5 结论

在本文中,我们提出了一种用于移动网络的新型轻量级注意力机制,称为坐标注意力。我们的坐标注意力继承了通道注意力方法(例如,Squeeze-and-Excitation 注意力)建模通道间关系的优势,同时利用精确的位置信息捕捉长程依赖关系。在 ImageNet 分类、目标检测和语义分割的实验中,验证了我们坐标注意力的有效性。致谢:本研究部分得到了 AISG-100E-2019-035、MOE2017-T2-2-151、NUS ECRA FY17 P08 和 CRP20-2017-0006 的支持。

参考文献

QiBin Hou, Daquan Zhou, Jiashi Feng.Coordinate Attention for Efficient Mobile Network Design[EB/OL].(2021-03-04)[2026-03-22].2103.02907![]() https://arxiv.org/pdf/2103.02907

https://arxiv.org/pdf/2103.02907

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)