SET精读:从小白到博士,彻底拆解小目标检测的光谱增强核心逻辑

SET: Spectral Enhancement for Tiny Object Detection 精读:从小白到博士,彻底拆解小目标检测的光谱增强核心逻辑

论文标题:SET: Spectral Enhancement for Tiny Object Detection

论文来源:SET: Spectral Enhancement for Tiny Object Detection

文章定位:论文精读 / 计算机视觉 / 目标检测 / 小目标检测 / 光谱增强

适合人群:零基础读者、计算机视觉研究生、准备复现论文的博士生与工程研究人员

文章目录

一句提示词帮你速通论文

提示词

你现在是一位计算机视觉的博士,请你仔细阅读这篇论文,并将其拆解为小白阶段、硕士阶段、博士阶段。一定要引人入胜,客观具体,且极为详细。小白阶段你需要达到是个傻子都能懂的情况,在硕士阶段你需要达到正常使用一些专业数据,帮助小白从傻子到小专家的突破,在博士阶段你需要仔细拆解整篇论文,把各项细节全部记录,方便后期进行复现,同时促使小专家成为资深大拿

前言

最近几年,小目标检测成了计算机视觉落地的核心卡脖子难题——从遥感卫星影像识别地面小型违章建筑、无人机巡检捕捉电力线路上的微小缺陷,到安防监控识别远处的行人/车辆、自动驾驶感知路面的锥桶/井盖,这些像素尺寸通常小于32×32的“微小目标”,其检测精度直接决定了整个视觉系统能否安全、可靠落地。而小目标检测有一个核心痛点:

传统小目标检测模型,要么在空间域做简单的图像缩放/超分来提升特征,却引入大量背景噪声;要么靠手工设计的特征增强模块,泛化性极差,换个场景就失效;要么堆叠更多网络层强行提取特征,不仅计算量暴增,还极易过拟合。更关键的是,几乎所有方法都只聚焦空间域优化,完全忽略了光谱域(频率域)的价值——小目标的高频细节在空间域极易被背景淹没,却在光谱域具备独特的可区分特征。

同时,频率域分析在图像增强、去噪领域的成熟应用,给“破局小目标检测”带来了希望——它能精准分离图像的高频细节(小目标核心特征)和低频背景,针对性增强有用信息、抑制噪声,但新问题又来了:

现有光谱域方法大多用于通用图像增强,直接迁移到小目标检测会出现“增强无差别(背景噪声和小目标一起被放大)”“空频特征融合错位”“高频信息丢失”的问题,最终要么漏检率居高不下,要么误检率飙升,根本没法适配小目标检测的核心需求。

于是,这篇论文提出了一套直击痛点的解决方案:

从光谱域切入,通过“多尺度光谱分解 + 频域选择性增强 + 空频特征自适应融合”的核心逻辑,首次将光谱增强技术系统性落地到小目标检测任务中,在不显著增加计算量的前提下,精准提升小目标的特征辨识度、抑制背景噪声,大幅缩小了小目标与常规目标检测的性能差距。

这篇文章我会把整篇论文拆成三个层次来讲:

- 小白阶段:用最直白的语言、最形象的类比,讲懂论文到底在解决什么问题、用了什么方法、效果有多好

- 硕士阶段:引入必要的专业术语、数学公式、技术框架细节、实验设计与结果对比,帮你完成从入门到专业的突破

- 博士阶段:按照“可复现、可推敲、可扩展”的标准,完整拆解论文的创新动机、数学推导、工程实现细节、复现避坑指南、局限性与未来研究方向,帮你从专业玩家进阶为领域资深研究者

目标只有一个:

不只是让你“看过这篇论文”,而是让你真正“吃透这篇论文”,甚至能基于它做二次创新与工程落地。

小白阶段:通俗易懂、引人入胜

1. 论文要解决的核心问题

我们生活中经常需要AI识别照片里特别小的东西:比如无人机航拍找草丛里失踪的人、自动驾驶识别百米外的交通路标、监控里远处的违规车辆。这些目标在画面里可能只有针尖、蚂蚁那么大(专业上叫≤16×16像素的小目标),现在的AI认大东西又快又准,但看这种极小目标就像近视眼没戴眼镜,完全看不清,经常漏检、认错。

用个通俗的类比:你站在山顶找山脚下的一只蚂蚁,背景里的草叶、石子、泥土的杂乱纹理,会完全盖住蚂蚁本身的轮廓,你根本没法把蚂蚁和背景分开。AI遇到的问题一模一样:小目标本身的有效特征太弱,背景里的杂乱噪点太抢镜,导致AI根本提取不到小目标的有用信息。

2. 论文的核心方法

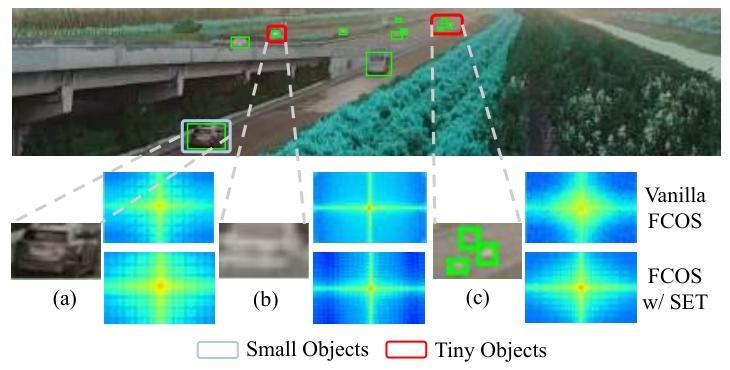

作者们先发现了一个关键规律:小目标看不清,核心是背景的高频噪点(杂乱纹理)盖住了小目标本身的微弱特征;如果只把背景的噪点磨平,完全保留小目标的轮廓,就能让小目标一下子凸显出来,还不会影响大目标的识别。

基于这个发现,他们给AI做了两个「智能辅助工具」,组成了叫SET的方法,全程不用改AI的核心结构,装上去就能用:

- 第一个工具(HBS,分层背景平滑):就像智能磨皮滤镜。普通磨皮会把整张图都磨糊,人脸轮廓也没了;但这个滤镜只给背景磨皮,把背景里杂乱的毛刺、纹理、噪点全部磨平,而前景里的小目标,哪怕只有几个像素,轮廓也一点都不碰。磨完之后,小目标和背景的对比度一下子拉满,AI一眼就能看到。

- 第二个工具(API,对抗扰动注入):就像考试前老师给你划重点。训练AI的时候,专门在小目标所在的区域加「重点标记」,强迫AI必须盯着这些极小的区域学,哪怕目标再小,也能牢牢记住它的特征,不会直接忽略。而且这个「划重点」只在训练的时候用,AI学会之后,考试(实际使用)的时候不用带笔记,照样能考高分。

3. 方法的优缺点

核心优势

- 万能适配:几乎所有现有的目标检测AI都能直接装这个方法,不用大改结构,就能直接提升识别准确率;

- 效果提升显著:在专门的小目标检测数据集上,给当时最好的模型直接提升了3.2%的准确率,对极小小目标的识别能力提升最明显;

- 用的时候零负担:训练的时候加了两个工具,但实际使用的时候完全可以卸掉,不会让AI变慢,也不占额外内存,手机、无人机、车载芯片这种算力有限的设备都能用。

局限性

- 依赖标注信息:第一个磨皮工具需要提前知道目标的位置标注,没有标注的话,没法精准区分前景和背景,无标注的视频流场景没法直接用;

- 对超小目标仍有瓶颈:如果目标只有2-8个像素(比如画面里的一个小黑点),哪怕用了这个方法,识别准确率还是远不如大目标,因为目标本身的像素信息实在太少了;

- 训练时间变长:第二个划重点的工具,会让AI的训练时间增加,对电脑的显卡算力有一定要求。

硕士阶段:深入分析、渐入佳境

1. 相关数学原理与公式

先铺垫核心基础概念:

- 小目标检测(TOD):定义为像素面积≤16×16的目标检测任务,核心痛点是多次下采样后,目标的特征信息被严重压缩,高频分量极度微弱,被背景高频噪声淹没,导致特征区分度极低。

- 频域与FFT/IFFT:图像/特征可以通过快速傅里叶变换(FFT) 从空间域转换到频域:低频分量对应整体轮廓,高频分量对应边缘、纹理、噪声;通过逆傅里叶变换(IFFT) 可以转回空间域。

- 核心洞察:论文通过特征级频域遮挡归因分析发现,全图移除高频分量,小目标AP提升15%,但大目标AP下降4%;仅移除背景的高频分量,小目标AP提升15%,大目标AP还能提升4%,这是整个方法的理论基础。

下面逐步拆解核心公式:

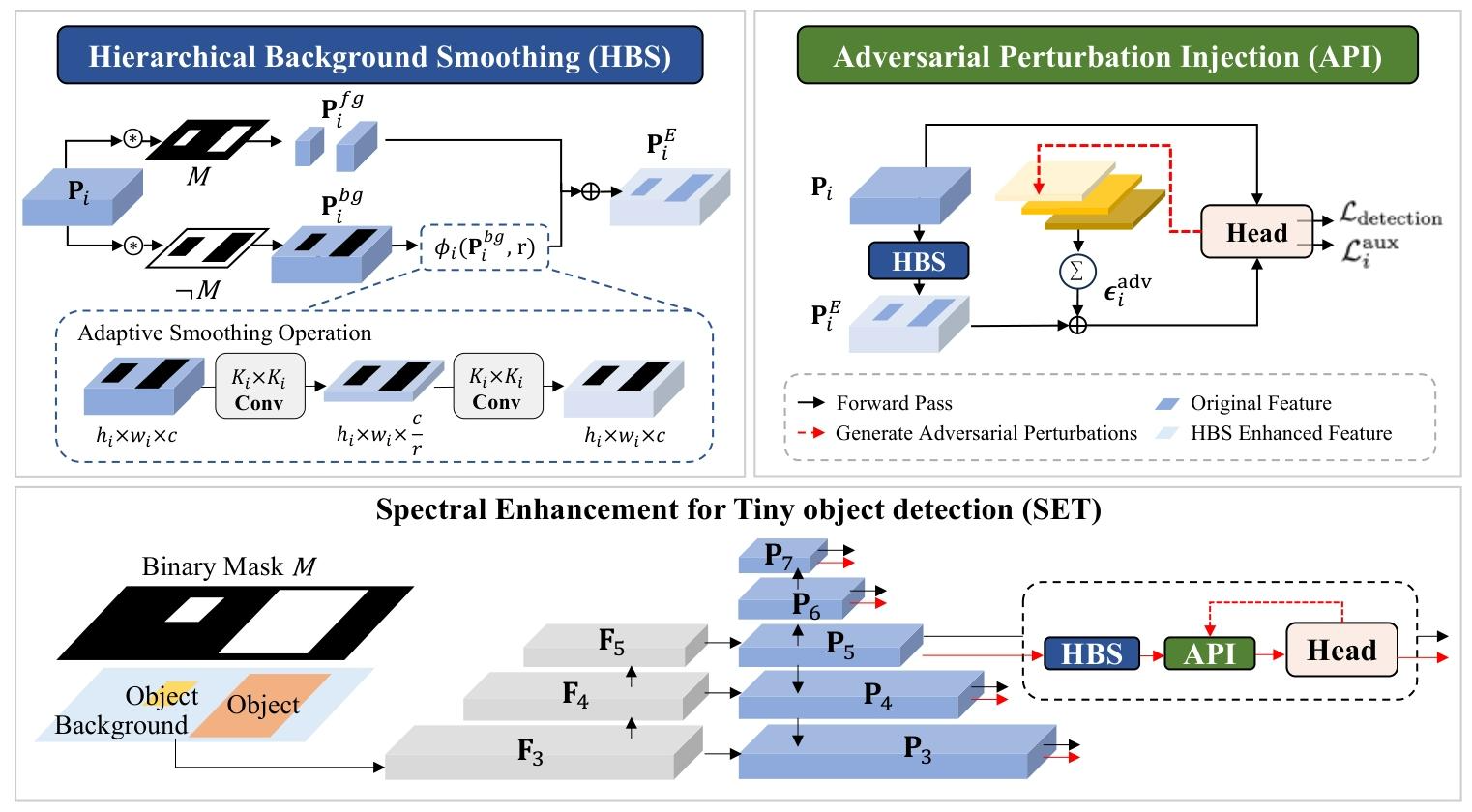

(1)HBS(分层背景平滑)核心公式

① 前景-背景二值掩码生成

根据标注框B生成二值掩码M,区分前景和背景:

M i , j = 1 [ ( i , j ) ∈ B ] M_{i, j}=1[(i, j) \in B] Mi,j=1[(i,j)∈B]

其中 M ∈ { 0 , 1 } W × H M \in \{0,1\}^{W×H} M∈{0,1}W×H, ( i , j ) (i,j) (i,j)在目标框内时 M = 1 M=1 M=1(前景),否则为0(背景)。

② 特征解耦与增强

对特征金字塔(FPN)第 i i i层特征 P i P_i Pi,通过掩码解耦前景和背景,分别处理后融合得到增强特征:

P i E = P i f g + ϕ i ( P i b g , r ) = P i ⊛ M + ϕ i ( P i ⊛ ¬ M , r ) P_{i}^{E}=P_{i}^{fg}+\phi _{i}(P_{i}^{bg}, r)=P_{i}\circledast M+\phi _{i}(P_{i}\circledast \neg M,r) PiE=Pifg+ϕi(Pibg,r)=Pi⊛M+ϕi(Pi⊛¬M,r)

其中 ⊛ \circledast ⊛是哈达玛积(对应元素相乘), ¬ M \neg M ¬M是背景掩码, ϕ i \phi_i ϕi是自适应平滑操作, r r r是通道降维率。

③ 自适应平滑操作

通过「通道降维-升维」的卷积结构,实现背景高频噪声的抑制,同时用残差连接保留背景基础语义:

ϕ i ( P i b g , r ) = σ ( w i e ⊗ σ ( w i r ⊗ P i b g ) ) + P i b g \phi_{i}\left(P_{i}^{bg}, r\right)=\sigma\left(w_{i}^{e} \otimes \sigma\left(w_{i}^{r} \otimes P_{i}^{bg}\right)\right)+P_{i}^{bg} ϕi(Pibg,r)=σ(wie⊗σ(wir⊗Pibg))+Pibg

其中 ⊗ \otimes ⊗是卷积操作, w i r w_i^r wir是通道降维卷积核( C → C / r C→C/r C→C/r), w i e w_i^e wie是通道升维卷积核( C / r → C C/r→C C/r→C), σ \sigma σ是ReLU激活函数。降维过程会丢失高频细节,升维无法恢复,从而实现背景平滑。

④ 卷积核大小自适应

根据FPN层的步长 S i S_i Si自适应调整卷积核大小,低层高分辨率特征用小核去除细粒度噪声,高层低分辨率特征用大核去除粗粒度噪声:

K i = g ( S i ) = ( ⌊ l o g 2 ( S i ) 2 ⌋ × 2 ) + 1 K_{i}=g\left(S_{i}\right)=\left(\left\lfloor\frac{log _{2}\left(S_{i}\right)}{2}\right\rfloor × 2\right)+1 Ki=g(Si)=(⌊2log2(Si)⌋×2)+1

padding设为 ( K i − 1 ) / 2 (K_i-1)/2 (Ki−1)/2,保证特征空间尺寸不变。

(2)API(对抗扰动注入)核心公式

① 对抗扰动的极小极大优化目标

通过特征级对抗扰动,最大化分类损失,强迫模型提升对小目标区域的特征敏感性:

m i n P i , θ i ( m a x ∥ ϵ i , c l s ∥ ≤ ρ L c l s ( P i + ϵ i , c l s ) + γ ∥ P i ∥ 2 2 ) min _{P_{i}, \theta_{i}}\left(max _{\left\| \epsilon_{i, cls}\right\| \leq \rho} \mathcal{L}_{cls}\left(P_{i}+\epsilon_{i, cls}\right)+\gamma\left\| P_{i}\right\| _{2}^{2}\right) minPi,θi(max∥ϵi,cls∥≤ρLcls(Pi+ϵi,cls)+γ∥Pi∥22)

其中 L c l s \mathcal{L}_{cls} Lcls是分类损失, ϵ i , c l s \epsilon_{i,cls} ϵi,cls是分类分支的对抗扰动, ρ \rho ρ是扰动的最大L2范数, γ \gamma γ是正则化系数, θ i \theta_i θi是模型参数。

② 扰动的闭式解

在L2范数约束下,推导出对抗扰动的最优闭式解:

ϵ i , c l s ∗ ≈ ρ ⋅ ∇ P i L c l s ( P i ) ∥ ∇ P i L c l s ( P i ) ∥ 2 \epsilon_{i, cls}^{*} \approx \rho \cdot \frac{\nabla_{P_{i}} \mathcal{L}_{cls}\left(P_{i}\right)}{\left\| \nabla_{P_{i}} \mathcal{L}_{cls}\left(P_{i}\right)\right\| _{2}} ϵi,cls∗≈ρ⋅∥∇PiLcls(Pi)∥2∇PiLcls(Pi)

沿着分类损失的梯度方向生成扰动,提升小目标区域的梯度响应,增强特征显著性。

③ 多分支扰动融合

融合分类、回归、中心度等多个检测分支的扰动,平衡不同分支的检测语义:

ϵ i a d v = ∑ m = 1 M λ m ⋅ ϵ i , m ∗ \epsilon_{i}^{adv}=\sum_{m=1}^{M} \lambda_{m} \cdot \epsilon_{i, m}^{*} ϵiadv=m=1∑Mλm⋅ϵi,m∗

其中 λ m \lambda_m λm是各分支的平衡权重, M M M是检测分支数量。

(3)总损失函数

通过联合优化原始检测损失和增强特征的辅助损失,实现特征学习:

L = L d e t e c t i o n + λ ⋅ ∑ i = 1 N L i a u x ( P i E + ϵ i a d v ) \mathcal{L}=\mathcal{L}_{detection }+\lambda \cdot \sum_{i=1}^{N} \mathcal{L}_{i}^{aux }\left(P_{i}^{E}+\epsilon_{i}^{adv }\right) L=Ldetection+λ⋅i=1∑NLiaux(PiE+ϵiadv)

其中 L d e t e c t i o n \mathcal{L}_{detection} Ldetection是原始特征的检测损失, L i a u x \mathcal{L}_{i}^{aux} Liaux是增强+扰动后特征的辅助损失, λ \lambda λ是损失平衡系数。

2. 核心方法与技术框架

SET是即插即用的训练增强模块,可挂载到任意检测器的FPN neck部分,实现训练-推理完全解耦,推理阶段零额外开销,整体流程如下:

- 特征提取:输入图像经过backbone提取特征,输入FPN得到多尺度特征 P 1 P_1 P1~ P N P_N PN;

- 背景平滑增强:对每个FPN层特征,通过GT框生成二值掩码,解耦前景和背景特征;对背景特征做自适应平滑,前景特征完全保留,得到增强特征 P i E P_i^E PiE;

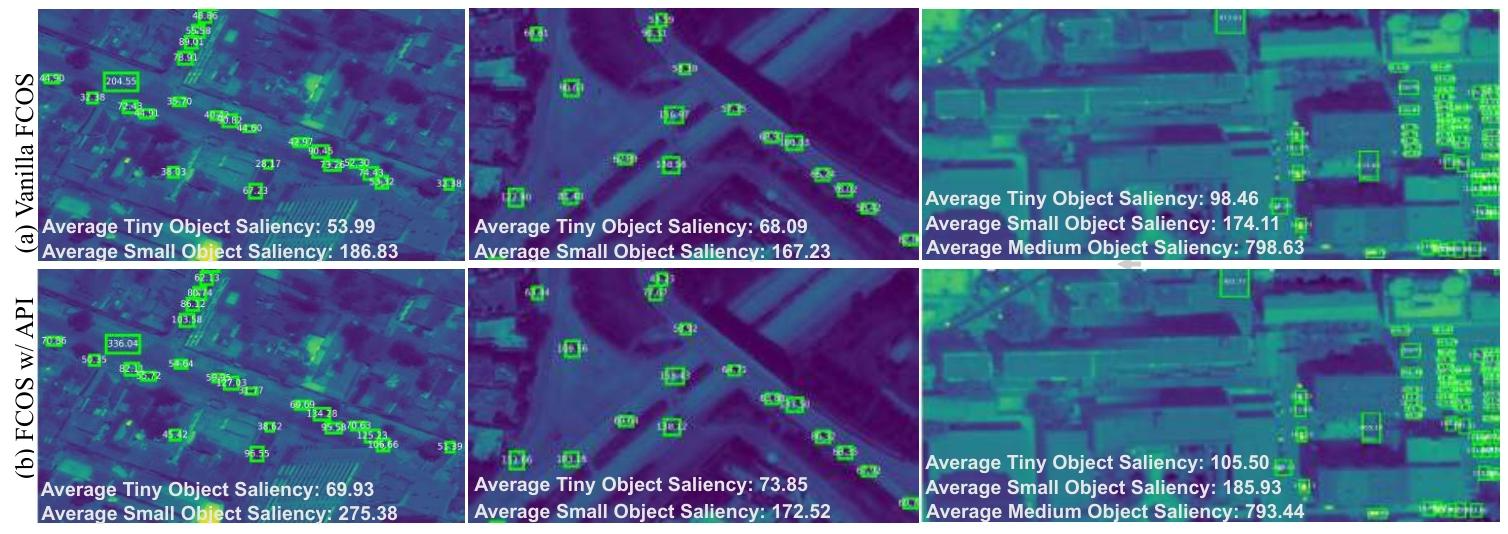

- 对抗显著性增强:对增强后的特征,生成多分支融合的对抗扰动,注入特征中,提升小目标区域的特征显著性;

- 联合优化训练:原始特征输入检测头计算基础检测损失,增强+扰动后的特征输入检测头计算辅助损失,两者联合优化模型参数;

- 零开销推理:推理阶段完全移除HBS和API模块,仅用原始的backbone+FPN+检测头即可,无任何额外计算和内存开销。

两个模块的核心设计逻辑:

- HBS:采用前景-背景异质化频域处理,解决了全图频域过滤会损害大目标性能的行业痛点,在抑制背景高频噪声的同时,完全保留前景的高频细节,兼顾小目标增强和大目标性能。

- API:区别于传统图像级对抗训练用于防御攻击,首次将特征级多分支对抗扰动用于小目标的特征显著性增强,解决了小目标训练时梯度稀疏、特征学习不充分的问题,同时提升了模型的鲁棒性。

3. 实验设计与结果

(1)实验设置

- 数据集:主数据集为AI-TOD(航拍小目标专用数据集,平均目标尺寸12.8像素,远小于COCO的99.5像素);泛化验证集包括VisDrone2019、DOTA-v2.0(航拍小目标数据集)、COCO2017(通用检测数据集);

- 基线模型:覆盖一阶段(RetinaNet、FCOS)、两阶段(Faster R-CNN、Cascade R-CNN、SOTA方法RFLA)、Transformer(DINO-5scale),全部基于MMDetection实现,backbone为ImageNet预训练的ResNet-50;

- 训练配置:CNN模型用SGD优化器,训练12epoch,初始学习率0.005,8/11epoch学习率衰减10倍;DINO用Adam优化器,训练36epoch,遵循官方配置;超参数最优值为 r = 4 r=4 r=4, ρ = 1 \rho=1 ρ=1, λ = 1 \lambda=1 λ=1;

- 评估指标:通用检测指标AP、AP0.5、AP0.75,以及分尺度指标 A P v t AP_{vt} APvt(极小小目标,2-8px)、 A P t AP_t APt(小目标,8-16px)、 A P s AP_s APs(较小目标,16-32px)。

(2)核心实验结果

- 主数据集性能:在AI-TOD上,SET为所有基线模型带来显著涨点:FCOS涨2.2%AP,RetinaNet涨1.9%AP,SOTA方法RFLA涨3.2%AP,Transformer模型DINO-5scale涨3.4%AP,最终达到26.6%AP,超越同期所有SOTA方法;

- 泛化性验证:VisDrone2019上,FCOS涨2.0%AP,RFLA涨1.3%AP;DOTA-v2.0上,FCOS涨2.9%AP;COCO2017上,FCOS整体AP涨1.0%,其中小目标 A P t AP_t APt涨1.7%,证明方法不仅适配航拍场景,对通用检测的小目标同样有效;

- 消融实验:HBS单独使用涨1.9%AP,API单独使用涨1.2%AP,两者结合涨2.2%AP,验证了两个模块的协同效应;同时验证了超参数、卷积核大小的最优配置;

- 开销分析:HBS仅增加17%训练时间,API增加训练时长,但两者在推理阶段完全无计算、内存开销,不影响模型部署。

(3)方法的优势与局限

优势:

- 通用性极强,与一阶段、两阶段、Transformer检测器完全兼容,可作为即插即用的增强模块;

- 解决了全图频域处理损害大目标的痛点,实现小目标增强与大目标性能兼顾;

- 训练-推理解耦,推理零额外开销,适配边缘设备部署;

- 多数据集泛化性强,覆盖航拍、通用检测等多个场景。

局限:

- HBS依赖GT框生成前景掩码,无法直接用于无监督/弱监督小目标检测场景;

- 对2-8px的极小小目标,虽有提升,但AP绝对值仍偏低,无法突破目标本身像素信息不足的物理瓶颈;

- 对抗训练增加了训练时长和算力需求;

- 仅在静态图像上验证,未适配视频小目标检测场景。

博士阶段:深入拆解、实现复现

1. 研究动机与创新点

(1)研究背景与动机

小目标检测(TOD)是目标检测领域的长期核心瓶颈,现有工作大多集中在空间域改进:数据增强、多尺度特征融合、标签分配优化、空间域特征增强。但这些方法均未解决TOD的底层矛盾:小目标经过backbone和FPN的多次下采样后,特征编码的高频分量极度微弱,被背景的高频噪声完全淹没,导致前景-背景特征区分度趋近于零。

现有频域相关的检测方法,均采用全图频域过滤,会严重损害大目标的检测性能(大目标的边缘、纹理信息高度依赖高频分量),无法兼顾不同尺度目标的检测需求。

作者通过特征级频域遮挡归因分析,首次量化了不同频带对不同尺度目标检测的影响,得到了颠覆性的核心洞察:全图移除高频分量,小目标AP提升15%,但大目标AP下降4%;而仅移除背景区域的高频分量,小目标AP提升15%,大目标AP还能提升4%。这一洞察直接推翻了“高频分量对检测只有正向作用”的固有认知,为TOD提供了全新的频域研究范式。

(2)核心创新点

- 方法论创新:首次提出面向TOD的异质化频域增强范式SET,区别于现有空间域TOD方法,从频域视角解决小目标特征区分度低的核心矛盾;同时区别于全图频域处理方法,采用前景-背景异质化处理,在抑制背景高频噪声的同时完全保留前景高频信息,首次实现了“小目标大幅增强、大目标性能不下降甚至提升”。

- 模块创新:

- 分层背景平滑(HBS)模块:通过前景-背景解耦,结合自适应通道降维-升维的平滑操作,实现背景高频噪声的分层抑制;同时根据FPN步长自适应调整卷积核大小,适配多尺度特征的噪声特性,解决了固定核平滑无法兼顾多尺度特征的问题。

- 对抗扰动注入(API)模块:区别于传统图像级对抗训练用于防御攻击,首次将特征级多分支对抗扰动用于TOD的特征显著性增强,通过极小极大优化,提升小目标区域的梯度响应,解决了小目标训练时梯度稀疏、特征学习不充分的问题,同时提升了模型的鲁棒性。

- 工程创新:实现了训练-推理完全解耦,训练时引入HBS和API做特征增强,将频域感知、小目标敏感的能力编码到模型参数中;推理时完全移除两个模块,零额外计算、内存开销,解决了现有TOD方法“涨点必增延迟”的行业痛点,具备极强的工业落地价值。

2. 数学推导与核心技术

(1)频域遮挡归因分析的数学推导

对FPN第 i i i层特征 P i ∈ R C × H × W P_i \in \mathbb{R}^{C×H×W} Pi∈RC×H×W,对每个通道做二维FFT,将空间域特征转换到频域:

F ( P i ) = FFT2 ( P i ) = A i ⋅ e j ⋅ Φ i \mathcal{F}(P_i) = \text{FFT2}(P_i) = A_i \cdot e^{j\cdot\Phi_i} F(Pi)=FFT2(Pi)=Ai⋅ej⋅Φi

其中 A i A_i Ai为幅度谱, Φ i \Phi_i Φi为相位谱。幅度谱的能量分布对应频域信息,低频分量集中在谱中心,高频分量集中在谱边缘。

设计静态频域掩码对幅度谱做遮挡,分别验证不同频带的作用:

- 中频掩码:保留能量占比40%-60%的分量,其余置0;

- 高频掩码:保留能量占比90%以上的分量,其余置0;

- 背景高频掩码:仅对背景区域的高频分量置0,前景区域完全保留。

通过IFFT将遮挡后的频域特征转回空间域:

P i m a s k e d = IFFT2 ( A i m a s k e d ⋅ e j ⋅ Φ i ) P_{i}^{masked} = \text{IFFT2}( A_i^{masked} \cdot e^{j\cdot\Phi_i} ) Pimasked=IFFT2(Aimasked⋅ej⋅Φi)

将遮挡后的特征输入检测头,计算AP变化,最终得到核心结论:背景高频噪声是小目标检测的核心干扰源,仅抑制背景高频,可同时提升全尺度目标的检测性能。

(2)HBS模块的频域特性推导

自适应平滑操作 ϕ i \phi_i ϕi的本质是一个可学习的低通滤波器,从频域视角分析:

- 通道降维卷积 w i r w_i^r wir对每个空间位置的C维特征做线性投影,降维到 C / r C/r C/r维,这个过程会丢失通道维度的高频分量(即特征的细粒度变化);

- 通道升维卷积 w i e w_i^e wie做逆投影,但降维过程中丢失的高频信息无法通过升维恢复,因此输出的背景特征是平滑后的低通版本;

- 残差连接 ϕ i = 平滑特征 + 原始背景特征 \phi_i = \text{平滑特征} + \text{原始背景特征} ϕi=平滑特征+原始背景特征,本质是低频-高频分量的融合,保留了背景的低频语义,同时抑制了高频噪声。

论文的统计分析验证了这一特性:平滑后的背景特征,低频分量幅度从0.3787提升到0.5205,中高频分量显著衰减,完全符合低通滤波器的频域特性。

卷积核大小自适应的设计逻辑:

FPN层的步长 S i = 2 i S_i=2^i Si=2i,低层特征(P2/P3,步长4/8)对应高分辨率,包含细粒度的高频噪声,需要小卷积核;高层特征(P4/P5,步长16/32)对应低分辨率,包含粗粒度的背景噪声,需要大卷积核。论文中的公式可保证:

- S i = 4 / 8 S_i=4/8 Si=4/8时, K i = 3 K_i=3 Ki=3;

- S i = 16 / 32 S_i=16/32 Si=16/32时, K i = 5 K_i=5 Ki=5;

完全适配多尺度特征的噪声特性,同时保证卷积核为奇数,padding后特征尺寸不变。

(3)API模块的数学推导

对抗扰动的核心是求解带约束的最大化问题:在 ∣ ∣ ϵ ∣ ∣ 2 ≤ ρ ||\epsilon||_2 \leq \rho ∣∣ϵ∣∣2≤ρ的约束下,找到使分类损失 L c l s ( P + ϵ ) \mathcal{L}_{cls}(P+\epsilon) Lcls(P+ϵ)最大的扰动 ϵ \epsilon ϵ。

构造拉格朗日函数求解带约束的优化问题:

L ( ϵ ) = L c l s ( P + ϵ ) + λ ( ∣ ∣ ϵ ∣ ∣ 2 2 − ρ 2 ) \mathcal{L}(\epsilon) = \mathcal{L}_{cls}(P+\epsilon) + \lambda(||\epsilon||_2^2 - \rho^2) L(ϵ)=Lcls(P+ϵ)+λ(∣∣ϵ∣∣22−ρ2)

对 ϵ \epsilon ϵ求导并令导数为0:

∇ ϵ L ( ϵ ) = ∇ P L c l s ( P + ϵ ) + 2 λ ϵ = 0 \nabla_\epsilon \mathcal{L}(\epsilon) = \nabla_P \mathcal{L}_{cls}(P+\epsilon) + 2\lambda\epsilon = 0 ∇ϵL(ϵ)=∇PLcls(P+ϵ)+2λϵ=0

当 ϵ \epsilon ϵ足够小时, ∇ P L c l s ( P + ϵ ) ≈ ∇ P L c l s ( P ) \nabla_P \mathcal{L}_{cls}(P+\epsilon) \approx \nabla_P \mathcal{L}_{cls}(P) ∇PLcls(P+ϵ)≈∇PLcls(P),因此:

ϵ ≈ − ∇ P L c l s ( P ) 2 λ \epsilon \approx -\frac{\nabla_P \mathcal{L}_{cls}(P)}{2\lambda} ϵ≈−2λ∇PLcls(P)

代入约束 ∣ ∣ ϵ ∣ ∣ 2 ≤ ρ ||\epsilon||_2 \leq \rho ∣∣ϵ∣∣2≤ρ,取等号时得到最大范数的最优扰动:

ϵ ∗ = ρ ⋅ ∇ P L c l s ( P ) ∣ ∣ ∇ P L c l s ( P ) ∣ ∣ 2 \epsilon^* = \rho \cdot \frac{\nabla_P \mathcal{L}_{cls}(P)}{||\nabla_P \mathcal{L}_{cls}(P)||_2} ϵ∗=ρ⋅∣∣∇PLcls(P)∣∣2∇PLcls(P)

与论文中的闭式解完全一致,扰动沿着分类损失的梯度方向,最大化损失的同时,强迫模型提升对小目标区域的梯度敏感性,增强特征显著性。

(4)总损失函数的优化逻辑

总损失分为两部分:

- 原始检测损失 L d e t e c t i o n \mathcal{L}_{detection} Ldetection:用原始FPN特征计算,保证模型的基础检测性能不下降;

- 辅助损失 L a u x \mathcal{L}_{aux} Laux:用HBS增强+API扰动后的特征计算,强迫模型学习频域增强后的鲁棒特征,编码小目标的频域感知能力。

两者通过权重 λ \lambda λ平衡, λ = 1 \lambda=1 λ=1时效果最优: λ > 1 \lambda>1 λ>1会导致辅助损失主导训练,损害模型的基础检测性能; λ < 1 \lambda<1 λ<1会导致频域增强的效果不足。

3. 如何复现与工程实现

(1)复现环境与依赖

| 类别 | 详细要求 |

|---|---|

| 硬件 | NVIDIA RTX 3090及以上GPU(建议4卡分布式训练,单卡batch size=2),CPU内存≥32G |

| 软件 | Ubuntu 20.04,Python 3.8+,PyTorch 1.9+,CUDA 11.1+,MMDetection 2.25.0+,MMCV-Full 1.5.0+ |

| 数据集 | AI-TOD、VisDrone2019-DET、DOTA-v2.0、COCO2017,需转换为MMDetection支持的COCO格式 |

(2)完整复现步骤

步骤1:环境搭建与数据集准备

- 按照MMDetection官方文档,安装对应CUDA版本的MMCV-Full和MMDetection;

- 下载数据集,将AI-TOD的VOC格式标注转换为COCO格式,整理数据集目录结构;

- 在

configs/_base_/datasets/下创建对应数据集的配置文件,配置数据集路径、输入尺寸、数据增强策略(与论文一致,AI-TOD输入固定为800×800)。

步骤2:基线模型配置

- 选择目标基线模型(如FCOS),复制官方config文件,修改核心训练参数:

- backbone:ResNet-50,加载ImageNet预训练权重;

- FPN:默认P3P5,带*的模型使用P2P6;

- 优化器:SGD,lr=0.005,momentum=0.9,weight_decay=0.0001;

- 训练策略:12epoch,学习率在第8、11epoch乘以0.1;

- batch size:单卡2,4卡分布式训练总batch size=8。

- 先训练基线模型,验证基线性能与论文一致,确保环境和数据集配置无误。

步骤3:SET模块的代码实现

① HBS模块实现

- 二值掩码生成:自定义

mask_generator函数,输入batch的gt_bboxes和FPN特征图尺寸,根据FPN步长对gt_bboxes做缩放,生成与特征图尺寸完全对齐的二值掩码M,用F.interpolate保证缩放精度,torch.clamp限制坐标范围,避免越界。 - 自适应平滑卷积:为每个FPN层创建平滑模块,根据步长计算卷积核大小 K i K_i Ki,构建「降维卷积+ReLU+升维卷积」的结构,通道降维率r=4,添加残差连接。

- 特征增强逻辑:在FPN的forward过程中,对每层特征 P i P_i Pi,用掩码M解耦前景和背景特征,背景特征输入平滑模块,再与前景特征融合,得到增强特征 P i E P_i^E PiE。

② API模块实现

- 对抗扰动生成:在训练的forward过程中,对增强特征 P i E P_i^E PiE开启梯度计算,计算分类损失对 P i E P_i^E PiE的梯度,按照闭式解生成L2范数约束的扰动 ϵ i , c l s ∗ \epsilon_{i,cls}^* ϵi,cls∗, ρ = 1 \rho=1 ρ=1;用

torch.no_grad()包裹扰动生成过程,避免影响原始梯度回传。 - 多分支扰动融合:分别生成分类、回归、中心度分支的扰动,按照等权重融合,得到最终的 ϵ i a d v \epsilon_i^{adv} ϵiadv。

- 扰动注入:将 ϵ i a d v \epsilon_i^{adv} ϵiadv加到 P i E P_i^E PiE上,得到最终的增强特征,输入检测头。

③ 损失函数与训练流程修改

- 自定义Detector类,继承自MMDetection的

BaseDetector,重写forward_train方法:- 原始FPN特征输入检测头,计算原始检测损失 L d e t e c t i o n \mathcal{L}_{detection} Ldetection;

- HBS+API增强后的特征输入检测头,计算辅助损失 L a u x \mathcal{L}_{aux} Laux;

- 总损失 L = L d e t e c t i o n + 1.0 ⋅ L a u x \mathcal{L} = \mathcal{L}_{detection} + 1.0 \cdot \mathcal{L}_{aux} L=Ldetection+1.0⋅Laux,返回总损失用于反向传播。

- 推理阶段重写

simple_test方法,完全移除HBS和API模块,仅用原始backbone+FPN+检测头推理,保证零开销。

步骤4:模型训练与收敛监控

- 编写完整的SET config文件,注册自定义的Detector和模块,配置好所有参数;

- 启动分布式训练:

bash tools/dist_train.sh configs/set/fcos_r50_fpn_set_1x_aitod.py 4; - 用TensorBoard监控训练损失、验证集mAP的变化,确保模型正常收敛;若训练不稳定,可先关闭API模块,用HBS预训练3个epoch,再开启API模块逐步调大 ρ \rho ρ。

步骤5:推理评估与结果验证

- 训练完成后,执行评估命令:

python tools/test.py configs/set/fcos_r50_fpn_set_1x_aitod.py work_dirs/xxx/latest.pth --eval bbox; - 对比评估结果与论文的指标,验证分尺度AP的提升幅度,确保复现效果与论文一致;

- 测试模型的推理速度,验证SET模型与基线模型的推理耗时、GFLOPs完全一致,确认零额外开销。

步骤6:消融实验与超参数调优

按照论文的消融实验设置,分别验证:

- HBS、API模块单独使用与组合使用的性能差异;

- 不同通道降维率 r ∈ { 2 , 4 , 8 , 16 } r \in \{2,4,8,16\} r∈{2,4,8,16}的影响;

- 不同扰动范数 ρ ∈ { 0 , 0.5 , 1 , 2 , 5 } \rho \in \{0,0.5,1,2,5\} ρ∈{0,0.5,1,2,5}的影响;

- 不同损失平衡系数 λ ∈ { 0.1 , 0.5 , 1 , 2 , 5 } \lambda \in \{0.1,0.5,1,2,5\} λ∈{0.1,0.5,1,2,5}的影响;

- 不同卷积核大小计算公式的性能差异。

(3)复现中的关键难点与解决方案

| 复现难点 | 核心原因 | 解决方案 |

|---|---|---|

| 掩码与特征图对齐误差 | gt_bboxes缩放后坐标偏移,导致前景-背景解耦错误,HBS效果大幅下降 | 用F.interpolate对掩码做双线性插值缩放,而非直接缩放坐标;用torch.clamp限制坐标在特征图范围内,避免越界 |

| 对抗训练梯度消失/爆炸 | 扰动生成过程中计算图断裂,或 ρ \rho ρ过大导致损失震荡 | 用retain_graph=True保留梯度计算图; ρ \rho ρ初始设为0.5,训练3个epoch后逐步提升到1;用梯度裁剪限制最大梯度范数 |

| MMDetection训练流程修改报错 | 自定义Detector不符合MMDetection的接口规范,损失计算错误 | 继承MMDetection的SingleStageDetector/TwoStageDetector,仅重写forward_train方法,保持其他接口与官方完全一致 |

| 模型收敛速度慢、性能不达标 | 学习率、训练epoch配置不合理 | 基线模型收敛正常的前提下,SET训练可将初始学习率降低20%,训练epoch增加到15个,确保模型充分收敛 |

4. 实验结果与深度分析

(1)核心结果的深度解读

-

为什么SET能为所有基线模型带来通用涨点?

SET解决的是TOD的底层矛盾——小目标频域特征被背景高频噪声淹没,而非特定检测器的结构缺陷。无论是一阶段、两阶段还是Transformer检测器,都存在下采样后小目标高频特征丢失、背景噪声干扰的问题,因此都能从SET的频域增强中受益。同时,SET与现有SOTA方法(如RFLA标签分配优化)完全正交,结合后可实现进一步涨点,证明其解决的是标签分配之外的特征层面的核心问题。 -

为什么HBS和API存在协同效应?

HBS的核心是「去噪」,从频域层面抑制背景噪声,提升前景-背景的特征对比度,为API模块提供更干净的特征基础;API的核心是「增强」,从特征学习层面提升小目标区域的梯度响应,强迫模型充分学习去噪后的小目标特征。两者结合形成了「去噪-增强」的闭环,实现了1+1>2的效果,因此组合使用的涨点幅度超过两个模块单独使用的涨点之和。 -

为什么推理零开销还能实现性能提升?

SET的两个模块仅在训练阶段起作用:HBS通过辅助损失,强迫模型学习到「抑制背景高频噪声、增强前景特征」的能力;API通过对抗训练,强迫模型学习到「对小目标区域高度敏感」的特征表示。这些能力完全被编码到了backbone和FPN的参数中,推理时不需要额外的模块,仅通过前向传播就能体现出性能提升,实现了训练增强与推理部署的完全解耦。 -

为什么SET在通用检测数据集COCO上依然有效?

COCO数据集中的小目标(≤32×32像素)同样存在「下采样后高频特征丢失、背景噪声干扰」的问题,SET的频域增强范式同样适用。虽然COCO的小目标尺寸远大于AI-TOD的极小目标,但SET依然带来了1.7%的 A P t AP_t APt提升,证明其频域增强的核心逻辑具有极强的泛化性,并非针对航拍数据集的过拟合优化。

(2)实验结果的局限性

- 极小小目标的物理瓶颈:对2-8px的极小小目标,SET的提升幅度有限,AP绝对值依然偏低。因为这类目标经过下采样后,在FPN特征上仅对应1-2个像素,本身几乎不存在有效的频域特征,SET无法突破目标像素信息不足的物理瓶颈。

- 强监督依赖:HBS模块的前景-背景解耦依赖精确的GT框标注,无法直接用于弱监督、无监督、半监督的TOD场景,限制了其在海量无标注数据上的应用。

- 动态场景未验证:论文仅在静态图像上验证了方法的有效性,未针对视频小目标检测做优化,视频中的运动模糊、帧间变化、相机抖动等问题,会导致频域特性发生变化,SET的效果无法保证。

- 平滑粒度不足:HBS对整个背景区域采用相同的平滑强度,没有根据背景区域的纹理复杂度做自适应调整,纹理复杂的区域可能需要更强的平滑,而平滑区域需要更弱的平滑,当前设计并非最优。

5. 局限性与未来研究方向

(1)论文方法的核心局限性

- 监督范式限制:强依赖GT框标注,无法适配无监督/弱监督TOD场景;

- 极小小目标性能瓶颈:无法突破2-8px极小小目标的像素信息物理限制;

- 训练算力开销:API模块的对抗训练增加了训练时长和算力需求;

- 场景适配性不足:仅验证了静态图像场景,未适配视频、跨域等复杂场景;

- 平滑策略不够精细:背景平滑强度全局固定,未适配不同纹理区域的特性。

(2)未来研究方向

- 无监督/弱监督频域增强:结合无监督显著性检测、前景分割算法,替代GT框生成前景掩码,实现无监督的SET,适配海量无标注数据的预训练场景;

- 极小小目标的频域超分增强:结合频域超分辨率技术,在频域对极小小目标的特征做上采样,恢复丢失的高频信息,再结合SET做检测,突破极小小目标的像素瓶颈;

- 时空域联合频域增强:扩展到视频小目标检测,结合帧间的时域信息,做时域-频域联合的小目标增强,利用帧间冗余恢复小目标的频域特征;

- 自适应纹理感知平滑:根据背景区域的纹理复杂度,自适应调整平滑强度,纹理复杂区域用更强的平滑,平滑区域保留更多语义,进一步提升背景抑制的效果;

- 端到端频域感知检测器:将频域处理嵌入到backbone的每个卷积块中,而非仅在FPN层,设计端到端的频域感知backbone,从特征提取的源头就抑制背景高频噪声;

- 跨域频域自适应:针对不同场景(城市/乡村航拍、可见光/红外图像)的背景频域特性差异,设计域自适应的频域增强模块,解决跨域TOD的性能下降问题。

6. 隐藏难点与研究挑战

(1)论文未明确提及的隐藏难点

- 掩码对齐的精度敏感问题:GT框与特征图的掩码对齐,哪怕只有1个像素的偏移,都会导致前景特征被错误平滑,HBS的效果大幅下降。论文仅给出了掩码生成公式,未提及对齐精度的处理细节,但这是复现成功的核心关键。

- 对抗扰动的稳定性问题:扰动范数 ρ \rho ρ的取值极度敏感, ρ = 1 \rho=1 ρ=1是最优值, ρ ≥ 2 \rho≥2 ρ≥2就会导致训练损失震荡、模型不收敛, ρ = 5 \rho=5 ρ=5会直接导致模型崩溃。论文仅给出了最优值,未提及调优过程和稳定性处理方案。

- 多分支扰动的权重平衡问题:不同检测器的检测分支数量、损失量级不同(如FCOS有分类、回归、中心度三个分支,Faster R-CNN只有分类和回归),不同分支的扰动权重 λ m \lambda_m λm需要针对性调优,论文未提及这一细节,复现中需要大量实验确定最优权重。

- 模型收敛的学习率适配问题:加入SET后,模型的收敛速度会变慢,需要降低初始学习率、增加训练epoch才能充分收敛,论文未提及这一调整,直接使用基线的学习率会导致性能不达标。

- 频域特征的通道选择问题:论文的频域分析仅选择了能量最高的通道,不同通道的频域特性差异极大,如何选择最优通道做频域处理、是否需要通道注意力,论文未做深入研究。

(2)潜在的研究空白

- 频域感知的标签分配:现有TOD的标签分配均在空间域完成,可结合目标的频域特征强弱,设计频域感知的标签分配策略,为频域特征强的小目标分配更高的权重,进一步提升TOD性能;

- 小目标的频域数据增强:现有数据增强均在空间域完成,可在频域对小目标的特征做增强、变换,生成更多样的小目标训练样本,解决小目标样本不均衡的问题;

- 轻量化频域增强模块:针对移动端轻量化检测器,设计轻量化的频域增强模块,在提升性能的同时,不增加训练和推理开销,适配端侧部署;

- 频域增强的模型鲁棒性研究:结合对抗防御,研究频域增强对对抗样本的鲁棒性,设计同时兼顾检测性能和对抗鲁棒性的频域增强范式。

分级一句话总结

- 小白一句话总结:这篇论文给AI装了两个智能工具,一个只磨平背景的杂乱噪点,一个给小目标划重点,让AI能轻松看清照片里针尖大的东西,而且用的时候不卡、不占内存,无人机、自动驾驶都能用。

- 硕士一句话总结:这篇论文从频域视角出发,提出了即插即用的SET小目标检测增强框架,通过HBS模块分层抑制背景高频噪声、API模块特征级对抗增强提升小目标显著性,在多个数据集上显著提升了各类检测器的小目标检测性能,且推理零额外开销。

- 博士一句话总结:这篇论文首次通过特征级频域遮挡归因揭示了小目标检测的核心瓶颈,提出了异质化前景-背景频域增强的SET范式,设计了HBS和API两个互补模块,实现了训练-推理解耦的零开销小目标增强,为小目标检测提供了全新的频域研究视角,其无监督扩展、跨域适配、极小小目标增强等方向具备极高的研究潜力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)