机器学习预测模型解释器|R语言实现SHAP分析,评估模型,代码示例完整复现

机器学习预测模型解释器 R语言实现SHAP分析,预测模型评估 SHAP分析包含我们科研私家菜团队优化开发的SHAP包及模型分析示例代码,保证代码和图表均可以复现。 提供全程。

在机器学习领域,模型的可解释性日益受到重视,特别是在医疗、金融等高风险决策领域。SHAP(SHapley Additive exPlanations)作为一种先进的模型解释技术,能够量化每个特征对模型预测结果的贡献度。本文将深入分析一套基于R语言实现的SHAP可视化工具集,展示其核心功能和应用场景。

功能概述

这套代码工具集主要提供了以下核心功能:

- SHAP值计算与排序:对任意XGBoost或LightGBM模型,计算每个特征的SHAP值并按其重要性排序

- 特征重要性可视化:生成特征重要性条形图,直观展示各特征对模型输出的平均影响

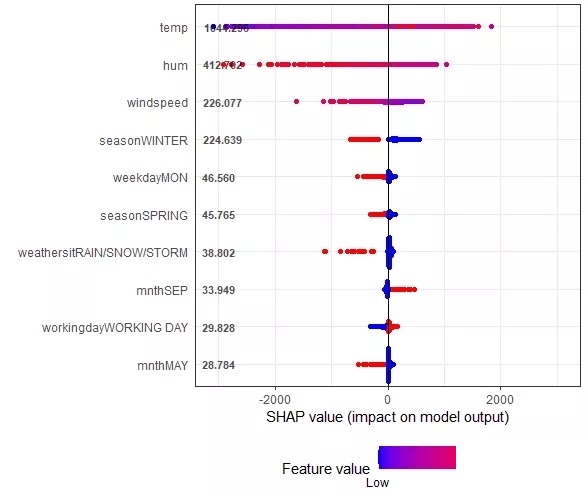

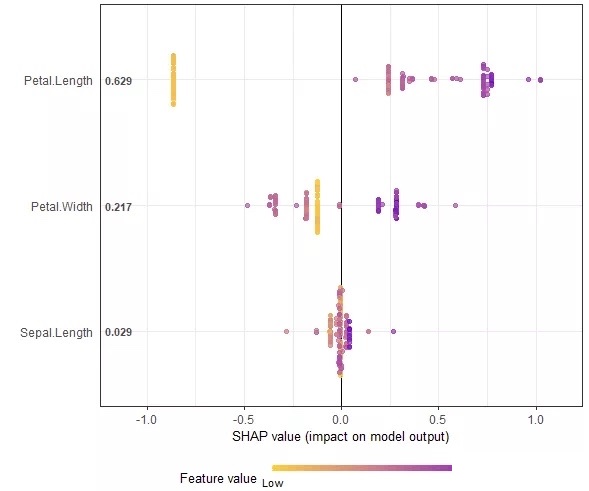

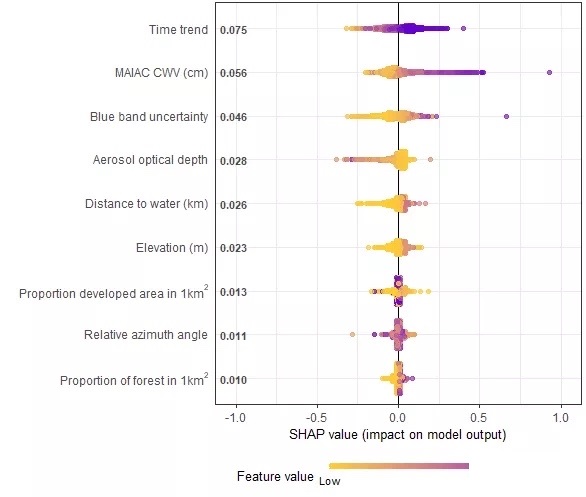

- SHAP摘要图:使用蜂群图展示特征值的分布及其对模型输出的影响方向和大小

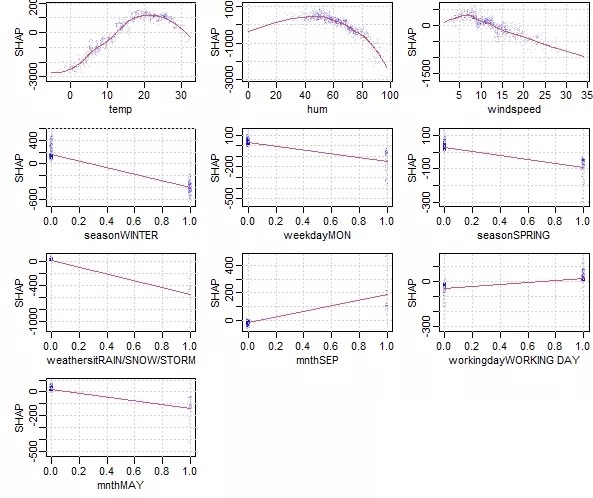

- SHAP依赖图:分析单个特征与SHAP值之间的关系,揭示特征影响的潜在模式

- 交互效应可视化:展示特征间的交互作用对模型预测的影响

核心架构与实现

1. SHAP值计算核心模块

工具集的核心是shap.score.rank函数,它负责计算SHAP值并进行特征排序:

shap.score.rank <- function(xgb_model = xgb_mod, shap_approx = TRUE,

X_train = mydata$train_mm){

shap_contrib <- predict(xgb_model, X_train,

predcontrib = TRUE, approxcontrib = shap_approx)

# ... 数据处理和排序逻辑

return(list(shap_score = shap_contrib,

mean_shap_score = (mean_shap_score)))

}该函数利用XGBoost内置的SHAP值计算功能,生成每个样本每个特征的SHAP贡献值,然后计算特征的平均绝对SHAP值作为重要性指标。

2. 数据预处理模块

shap.prep函数负责将原始SHAP数据转换为适合绘图的長格式:

shap.prep <- function(shap = shap_result, X_train = mydata$train_mm, top_n){

# 选择top_n个重要特征

# 融合SHAP值和原始特征值

# 标准化特征值到[0,1]范围

return(shap_long2)

}这个模块的关键创新在于将SHAP值与对应的原始特征值关联,并为特征值创建标准化版本,便于后续可视化中的颜色编码。

3. 可视化模块

工具集提供了多种可视化方式,其中最核心的是SHAP摘要图:

plot.shap.summary <- function(data_long){

ggplot(data = data_long)+

coord_flip() +

geom_sina(aes(x = variable, y = value, color = stdfvalue)) +

# ... 其他绘图元素

}这种可视化结合了以下信息:

- Y轴:按重要性排序的特征

- X轴:SHAP值(特征对模型输出的影响)

- 颜色:标准化后的特征值(蓝色表示低值,红色表示高值)

- 文本标注:每个特征的平均绝对SHAP值

应用案例展示

1. 自行车租赁预测模型分析

在自行车租赁预测案例中,工具集成功识别出:

- 温度(temp)和感觉温度(atemp)是最重要的预测因子

- 季节和天气情况对租赁需求有显著影响

- 时间相关特征(如月份、小时)呈现明显的周期性模式

2. 鸢尾花分类模型解释

对于经典的鸢尾花分类问题,SHAP分析显示:

- 花瓣长度(Petal.Length)是区分物种的最重要特征

- 花瓣宽度(Petal.Width)在不同物种间也有显著区分能力

- 萼片相关特征的重要性相对较低

3. 心脏病预测模型

在医疗应用场景中,该工具集帮助识别:

- 年龄和最大心率是预测心脏病风险的关键因素

- 运动诱导的心绞痛是重要的临床指标

- ST段压低值对风险评估有显著贡献

技术优势与特色

- 完整的分析流程:从数据预处理、模型训练到SHAP值计算和可视化,提供端到端的解决方案

- 灵活的参数配置:支持近似SHAP计算以提高大数据集的处理效率,平衡精度与性能

- 多模型支持:不仅支持XGBoost,还扩展支持LightGBM模型

- 丰富的可视化类型:包括摘要图、依赖图、交互效应图和力导向图等多种可视化方式

- 临床和业务友好:输出结果易于理解,便于与非技术人员沟通模型决策逻辑

实际应用价值

这套SHAP分析工具在实际项目中具有重要价值:

- 模型调试:识别影响模型预测的关键特征,指导特征工程方向

- 业务洞察:理解特征与预测结果之间的关系,获得领域知识验证

- 模型可信度:增强模型透明度,建立业务方对AI决策的信任

- 偏见检测:识别可能引入歧视的特征,促进公平AI实践

总结

这套基于R的SHAP可视化工具集为机器学习模型的可解释性分析提供了强大而灵活的支持。通过丰富的可视化技术和完整的分析流程,它帮助数据科学家和领域专家深入理解复杂模型的决策机制,在追求模型性能的同时不牺牲可解释性,对于在高风险领域部署可信赖的AI系统具有重要意义。

机器学习预测模型解释器 R语言实现SHAP分析,预测模型评估 SHAP分析包含我们科研私家菜团队优化开发的SHAP包及模型分析示例代码,保证代码和图表均可以复现。 提供全程。

该工具集的模块化设计使其易于扩展和集成到现有的机器学习工作流中,为构建透明、可信的机器学习应用提供了坚实的技术基础。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)