OpenAI 发布 GPT-5.4 mini/nano:全面提升速度、性价比与开发体验

OpenAI 最新推出了两款轻量级模型——GPT-5.4 mini 和 GPT-5.4 nano。本次更新聚焦在「低延迟」「高并发适配」等核心关键词。对于开发者和终端用户而言,最直接的变化就是模型响应更快、并发下推理成本更易控制,相比旗舰模型,适用于更广泛的生产环境。

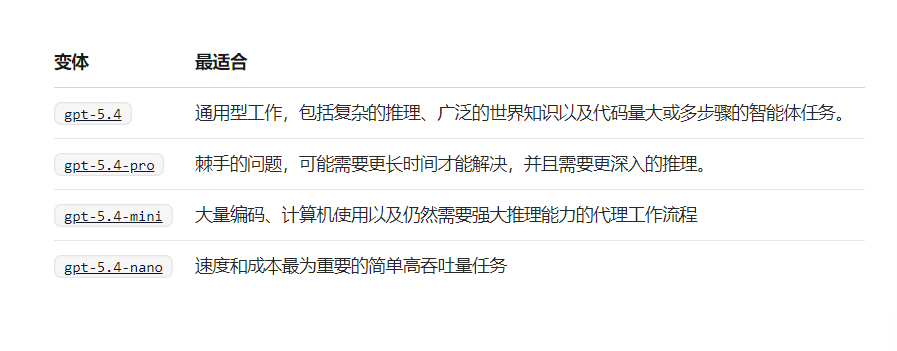

新模型定位与应用场景

mini 和 nano 的定位边界非常明确:

- GPT-5.4 mini:主打高频需求,适用于常规对话、代码生成、多模态理解和工具调用。支持 API / Codex / ChatGPT,同时 GitHub Copilot 也将逐步接入该版本。

- GPT-5.4 nano:聚焦于极致极速和结构化任务,适合分类、信息抽取、数据排序等高频批量任务。目前 仅支持 API 调用。

这两款模型的发布,主要目的是健全 Agent 工作流方案,让开发者在不同场景下有更细粒度的技术选型,而非一味拼高分。

性能表现对比分析

本次升级最值得关注的点在于:速度提升显著,mini 与旗舰的差距持续缩小。

根据 OpenAI 官方数据:

- 运行速度:GPT-5.4 mini 对比同代 GPT-5 mini,速度提升达 2 倍以上。

- 代码任务(SWE‑Bench Pro, Public):mini 53.4%,nano 52.4%,显著高于 GPT‑5 mini 的 45.7%。

- 电脑操控(OSWorld‑Verified):mini 72.1%,非常接近 GPT‑5.4 旗舰版的 75.0%,远高于上一代 mini(42.0%)和 nano(39.0%)。

整体来看,GPT-5.4 mini 已经具备支撑复杂生产任务、代码与工具流转的能力,不再仅限于普通聊天或简单问答。

价格与计费策略

对于高并发和大规模推理场景,控制成本同样关键。mini 和 nano 的定价策略非常实用:

- GPT-5.4 mini:输入 $0.75/百万 tokens,输出 $4.50/百万 tokens。

- GPT-5.4 nano:输入 $0.20/百万 tokens,输出 $1.25/百万 tokens。

- 上下文窗口:mini 和 nano 均支持 400,000 tokens。

如果你在 Codex 内执行子任务,按照 OpenAI 说明,mini 仅消耗 GPT-5.4 配额的 30%,能显著降低成本。GitHub Copilot 则采用 0.33x premium request multiplier,具体以 Copilot 支持文档为准,后续也可能会有策略调整。

可用渠道与入口梳理

- ChatGPT:Free 和 Go 用户可通过对话框 “+” 菜单 → “Thinking” 使用 GPT-5.4 mini。若主模型触达限额,则会回退到 mini。

- GitHub Copilot:已逐步推送至 Copilot Pro / Pro+ / Business / Enterprise 用户,具体依赖你的客户端模型选择和组织策略,有需求记得联系管理员开通。

- API / Codex:开发者可直接调用 mini、nano,并可充分利用 400K 上下文支持,方便大规模上下文应用。

总结观点

旗舰主攻规划决策,mini 负责灵活并行执行,nano 擅长高频批处理。这样分层协作是目前实现 Agent 工作流“降本增效”的推荐架构。此次 OpenAI 的 mini/nano 发布,为开发实践带来了更高可用性和性价比。需要注意所有信息和价格以 OpenAI 官方为准,建议开发者实时关注控制台动态。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)