AI对话系统架构设计:提示工程与知识库管理的协同方案(RAG实战)

AI对话系统架构设计:提示工程与知识库管理的协同方案(RAG实战)

元数据框架

标题:AI对话系统架构设计:提示工程与知识库管理的协同方案(RAG实战)

关键词:检索增强生成(RAG)、提示工程、对话系统架构、知识库管理、向量数据库、自然语言处理、大语言模型应用

摘要:本文深入探讨了现代AI对话系统架构设计的核心挑战与解决方案,重点分析提示工程与知识库管理的协同机制,以及检索增强生成(RAG)技术的实战应用。通过系统性解构RAG系统的理论基础、架构设计、实现机制和实际部署,本文提供了一套全面的技术框架,帮助AI工程师构建高性能、可扩展且知识精确的对话系统。从基础概念到高级实现,从数学原理到代码实践,本文涵盖了RAG技术栈的各个方面,包括数据预处理、检索优化、提示设计、评估方法以及在不同行业的应用案例。无论是学术研究人员还是工业界实践者,都能从本文获得关于构建下一代智能对话系统的深入见解和实用指导。

1. 概念基础:对话系统与知识增强的范式转变

1.1 对话系统的演进历程:从规则到智能

1.1.1 早期对话系统:基于规则的有限交互(1960s-1990s)

对话系统的历史可以追溯到20世纪60年代,当时计算机科学家开始探索让机器理解和生成人类语言的可能性。这一时期的代表性系统包括:

- ELIZA(1966):由Joseph Weizenbaum开发的第一个聊天机器人,使用模式匹配和简单替换技术模拟心理治疗师的对话。ELIZA没有真正的理解能力,而是通过识别关键词(如"我感到")并套用预设的回应模板来工作。其核心代码如下所示:

# ELIZA核心对话逻辑简化版

def eliza_response(user_input):

user_input = user_input.lower()

# 模式匹配规则

if "我感到" in user_input or "我觉得" in user_input:

return user_input.replace("我感到", "你为什么感到").replace("我觉得", "你为什么觉得") + "?"

elif "因为" in user_input:

return "你能详细解释一下这个原因吗?"

elif "你是谁" in user_input:

return "我是一个帮助你谈论感受的助手。你今天感觉怎么样?"

else:

# 通用回应

return "请继续说下去。"

尽管ELIZA在技术上简单,却引发了关于机器智能和人类与机器交互可能性的深刻思考。

-

PARRY(1972):由Kenneth Colby开发,模拟偏执型精神分裂症患者的行为,引入了更复杂的对话状态管理和情感模型。

-

ATIS(Air Travel Information System,1990s):这一时期典型的任务导向对话系统,专注于航班查询等特定领域,使用有限状态机和基于框架的方法处理用户请求。

这一阶段的对话系统主要依赖于预定义的规则和模式匹配,缺乏学习能力和泛化能力,只能在狭窄的领域内工作,无法处理未预料到的用户输入。

1.1.2 统计学习时代:数据驱动的对话模型(2000s-2010s)

随着机器学习技术的发展,对话系统进入了统计学习时代。这一时期的技术特点包括:

- 基于分类的意图识别:使用机器学习算法(如SVM、逻辑回归)对用户输入进行意图分类

- 统计机器翻译(SMT):将对话响应生成视为翻译问题

- 隐马尔可夫模型(HMM):用于对话状态跟踪和序列预测

代表性系统和技术包括:

- IBM Watson(2011):虽然主要以问答系统闻名,但展示了大规模知识整合和自然语言处理的潜力

- Google Now(2012):引入上下文感知和个性化推荐的虚拟助手

- Apple Siri(2011):将语音识别与任务执行相结合的早期主流虚拟助手

这一时期的对话系统开始利用数据驱动方法,但仍然受到特征工程的限制和领域知识获取的瓶颈。

1.1.3 神经对话系统:深度学习革命(2010s中期至今)

2010年代中期,深度学习技术的突破彻底改变了对话系统的发展轨迹。关键进展包括:

- 词嵌入技术:如Word2Vec(2013),使计算机能够将词语表示为连续向量空间中的点,捕捉语义关系

- 序列到序列(Seq2Seq)模型:由Sutskever等人(2014)提出,使用编码器-解码器架构实现端到端的对话生成

- 注意力机制:Bahdanau等人(2014)和Vaswani等人(2017)的Transformer架构,显著提升了长序列处理能力

这一时期的代表性系统包括:

- Google Neural Machine Translation (GNMT,2016):展示了深度学习在语言任务上的卓越性能

- OpenAI GPT系列:从GPT-1(2018)到GPT-4(2023),规模和能力不断提升,实现了前所未有的语言理解和生成能力

- Google BERT(2018):引入双向预训练,极大提升了上下文理解能力

神经对话系统的兴起带来了对话质量的飞跃,但也带来了新的挑战,特别是在知识准确性和事实一致性方面。

1.2 RAG技术的崛起:弥合参数知识与外部知识的鸿沟

1.2.1 大语言模型的固有局限

尽管大型语言模型(LLMs)取得了巨大成功,但它们存在几个关键局限性:

-

知识截止日期:模型训练数据有时间限制,无法获取最新信息。例如,GPT-4的初始版本知识截止到2023年4月,无法回答之后发生的事件。

-

事实准确性与幻觉:LLMs倾向于生成看似合理但不正确的信息(“幻觉”)。研究表明,即使是最先进的模型在知识密集型任务中的幻觉率也高达15-30%。

-

领域知识局限性:通用模型在特定专业领域(如医疗、法律)的表现不如专业模型,且难以获取和应用组织内部的私有知识。

-

上下文窗口限制:即使是最新的模型也有上下文长度限制(如GPT-4 Turbo为128k tokens),无法处理超长文档或大量背景信息。

-

更新成本高昂:更新模型知识需要重新训练或大规模微调,消耗大量计算资源。

-

缺乏可解释性:模型决策过程不透明,难以追溯答案来源,在需要问责的场景中存在风险。

这些局限性使得纯LLM对话系统在许多关键应用场景中无法满足要求,特别是对知识准确性和可靠性有高要求的领域。

1.2.2 RAG技术的定义与核心思想

检索增强生成(Retrieval-Augmented Generation,RAG)是一种将信息检索与生成式AI相结合的技术框架,最早由Lewis等人在2020年提出。RAG的核心思想是:

在生成回答之前,先检索与当前问题相关的外部知识,然后基于检索到的知识生成回答。

这种方法有效解决了纯LLM的知识局限性,其工作流程可以概括为:

- 检索阶段:根据用户查询从外部知识库中检索相关文档片段

- 增强阶段:将检索到的文档片段与原始查询一起作为输入提供给LLM

- 生成阶段:LLM基于提供的上下文信息生成回答

RAG的创新之处在于它不依赖于模型参数中存储的知识,而是动态引入外部知识源,从而实现:

- 知识的实时更新,无需重新训练模型

- 减少幻觉,提高回答准确性

- 支持专业领域知识的集成

- 提供可追溯的信息来源

- 降低知识存储的参数效率问题

1.2.3 RAG技术的发展历程与关键突破

RAG技术自2020年提出以来经历了快速发展,关键里程碑包括:

- 2020年:Lewis等人提出原始RAG模型,将检索机制与生成模型结合,在知识密集型任务上取得突破

- 2021年:REALM(Retrieval-Augmented Language Model Pre-training)将检索增强融入预训练过程

- 2022年:FLARE(Forward-Looking Active Retrieval augmented generation)引入生成过程中的动态检索机制

- 2023年:RAG技术与向量数据库结合,实现产业化应用;多模态RAG、增量RAG等变体出现

- 2023-2024年:混合检索(稀疏+密集)、分层检索、结构化知识RAG等高级技术成为研究热点

RAG技术的发展可以分为四个代际:

| 代际 | 时间 | 关键技术 | 特点 | 代表系统 |

|---|---|---|---|---|

| 第一代 | 2020-2021 | 基础检索+生成架构 | 静态检索,单步流程 | Lewis et al. (2020)原始RAG |

| 第二代 | 2021-2022 | 增强检索策略,多轮检索 | 动态检索,上下文感知 | REALM, ORQA, FLARE |

| 第三代 | 2022-2023 | 向量数据库集成,优化流程 | 工程化成熟,性能提升 | LangChain RAG, LlamaIndex |

| 第四代 | 2023-至今 | 混合检索,知识图谱增强,多模态 | 智能化检索,深度知识整合 | GraphRAG, MultiModal RAG |

这种演进反映了RAG从学术研究到工业应用的快速转化,以及从简单检索到复杂知识整合的技术深化。

1.3 提示工程:引导语言模型的艺术与科学

1.3.1 提示工程的定义与重要性

提示工程(Prompt Engineering)是设计和优化输入提示以有效引导大语言模型产生期望输出的过程。它是人与LLM之间的"编程语言",通过精心设计的指令、上下文和示例来控制模型行为。

在RAG系统中,提示工程尤为关键,因为它需要完成双重任务:

- 构建有效的查询以检索相关知识

- 将检索到的知识与原始查询结合,引导模型生成高质量回答

随着模型能力的增强,提示工程已从简单的指令设计发展为一门复杂的学科,涵盖心理学、语言学、逻辑学和领域专业知识。

1.3.2 提示工程的核心原则

有效的提示工程基于以下核心原则:

- 清晰性(Clarity):指令必须明确、具体,避免模糊或歧义的表述

- 相关性(Relevance):只包含与当前任务相关的信息,避免噪声

- 充分性(Sufficiency):提供足够的上下文和背景信息

- 结构性(Structure):使用适当的格式、分隔符和组织方式增强可读性

- 引导性(Guidance):通过示例、思维链和约束条件引导推理过程

- 迭代性(Iteration):通过多轮测试和调整优化提示效果

这些原则构成了提示设计的基础框架,在RAG系统中需要特别注意如何有效地将检索到的知识整合到提示中,避免信息过载和知识冲突。

1.3.3 提示工程的演进与技术发展

提示工程技术随着LLM能力的提升而不断演进:

基础阶段(2018-2020):主要关注简单指令和关键词优化,如:

"总结以下文本:[文本内容]"

中级阶段(2020-2022):引入结构化提示和少样本学习,如:

"请将以下文本分类为积极、消极或中性。

示例:

文本:这个产品非常好用!

分类:积极

文本:我对这个服务感到失望。

分类:消极

现在请分类:

文本:[待分类文本]

分类:"

高级阶段(2022-至今):发展出复杂的提示策略,如:

- 思维链(Chain-of-Thought, CoT):引导模型逐步推理

- 少样本/零样本提示:通过少量示例或无示例引导新任务

- 角色提示:为模型分配特定角色以影响输出风格和内容

- 自一致性(Self-Consistency):通过多路径推理提高可靠性

- 提示链(Prompt Chaining):将复杂任务分解为多个提示步骤

在RAG系统中,这些高级提示技术与检索过程紧密结合,形成了"检索-提示-生成"的闭环优化。

1.3.4 RAG中的提示工程特殊性

RAG系统中的提示工程面临独特挑战:

- 知识整合:需要有效整合多个检索到的文档片段,可能存在冲突或冗余

- 上下文管理:在有限的上下文窗口中平衡查询、检索到的知识和生成指令

- 来源引用:引导模型准确引用检索到的知识来源

- 不确定性处理:处理检索结果质量参差不齐的情况

这些挑战使RAG提示工程比纯LLM提示工程更加复杂,需要专门的技术和策略。

1.4 知识库管理:组织与检索知识的科学

1.4.1 知识库的类型与特征

在RAG系统中,知识库是存储可供检索的信息的基础架构。知识库可以分为多种类型:

-

非结构化知识库:包含文本、图像、音频等自由格式数据

- 文档(PDF、Word、TXT)

- 网页内容

- 电子邮件、聊天记录

- 音视频转录文本

-

半结构化知识库:包含一定结构但不严格遵循模式的数据

- JSON/XML文件

- 电子表格

- 标记文本(Markdown、HTML)

- 数据库转储文件

-

结构化知识库:高度组织化、遵循严格模式的数据

- 关系型数据库(MySQL、PostgreSQL)

- 图数据库(Neo4j、OrientDB)

- 知识图谱(如DBpedia、Wikidata)

- 表格数据

-

混合知识库:结合多种结构的综合知识存储

- 企业知识门户

- 研究文献库

- 智能文档管理系统

不同类型的知识库需要不同的处理和检索策略,现代RAG系统越来越倾向于支持多种知识类型的混合检索。

1.4.2 知识库构建的关键步骤

构建有效的RAG知识库涉及以下关键步骤:

-

知识获取:收集相关文档和数据,可能来源包括:

- 内部文档和报告

- 外部公开数据

- API接口获取的数据

- 网络爬虫收集的信息

-

数据清洗:去除噪声、重复内容和无关信息,包括:

- 格式标准化

- 去除冗余内容

- 纠正错误和不一致

- 统一术语和命名

-

文档分块:将长文档分割为适合检索的小块,需要考虑:

- 语义完整性(确保块包含完整概念)

- 块大小(平衡上下文丰富度和检索精度)

- 重叠策略(避免概念割裂)

- 分块方法(基于规则、语义或混合)

-

元数据提取:从文档中提取辅助检索的元数据,如:

- 作者、日期、来源

- 文档类型、主题分类

- 关键词、摘要

- 访问权限、更新频率

-

向量化/索引构建:将文本转换为向量表示或创建搜索索引

- 嵌入模型选择

- 索引结构设计

- 相似度度量选择

- 索引优化

-

知识组织:建立知识之间的关联和层次结构

- 分类体系构建

- 主题映射

- 关联关系提取

- 层次结构设计

-

更新与维护:保持知识库的时效性和相关性

- 更新策略设计

- 版本控制

- 过期知识处理

- 性能监控

这些步骤构成了知识库生命周期管理的核心,直接影响RAG系统的性能和可靠性。

1.5 RAG系统中的协同机制:提示工程与知识库管理的融合

1.5.1 协同框架概述

在现代RAG系统中,提示工程与知识库管理不再是独立的组件,而是深度融合的协同系统。这种协同体现在:

- 双向反馈:提示工程指导知识检索,检索结果质量反馈提示优化

- 动态适应:系统根据知识库特性调整提示策略,根据提示需求优化知识组织

- 联合优化:同时优化提示设计和知识结构以提升整体性能

- 用户中心:以用户需求为导向协调知识检索和提示生成

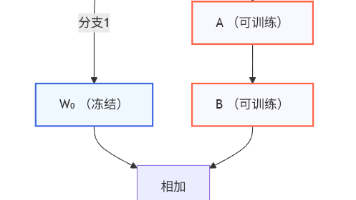

这种协同关系可以用以下概念模型表示:

这个模型展示了提示工程作为连接用户查询、知识库和语言模型的核心枢纽作用,以及系统各组件间的动态交互。

1.5.2 协同优化的关键维度

提示工程与知识库管理的协同优化涉及多个关键维度:

- 语义对齐:确保提示生成的查询与知识库的语义表示一致

- 结构匹配:根据知识结构优化提示格式,根据提示需求调整知识组织

- 上下文平衡:在有限的上下文窗口中优化知识选择和提示设计

- 反馈循环:利用用户反馈同时改进提示策略和知识质量

- 领域适配:针对特定领域调整提示模板和知识组织结构

这些维度的协同优化是构建高性能RAG系统的关键,也是当前研究和实践的热点领域。

1.5.3 协同带来的价值

提示工程与知识库管理的有效协同为RAG系统带来多方面价值:

- 知识精准性:通过优化提示提高检索相关性,通过结构化知识增强提示效果

- 推理可靠性:结合外部知识和引导推理减少幻觉,提高回答可信度

- 系统效率:减少不必要的检索和生成步骤,提高响应速度

- 用户满意度:提供更相关、准确和有用的回答

- 可维护性:使系统更易于更新和扩展,适应不断变化的知识需求

这种协同效应使整体系统性能远超各组件单独优化的效果,代表了RAG技术的未来发展方向。

1.6 关键术语与概念界定

为确保后续讨论的精确性,我们界定以下关键术语:

- 检索增强生成(RAG):一种结合信息检索和生成模型的AI框架,通过检索外部知识来增强生成式回答

- 提示(Prompt):提供给语言模型的输入文本,包含指令、上下文和/或示例

- 提示工程(Prompt Engineering):设计和优化提示以引导模型产生期望输出的过程

- 知识库(Knowledge Base):RAG系统中存储可供检索的信息的结构化或非结构化集合

- 嵌入(Embedding):将文本或其他数据转换为高维向量的过程,用于语义相似性计算

- 向量数据库(Vector Database):专门设计用于存储和检索向量嵌入的数据库系统

- 分块(Chunking):将长文档分割为较小文本片段的过程,便于有效检索和处理

- 上下文窗口(Context Window):语言模型能够同时处理的最大文本长度

- 思维链(Chain-of-Thought):一种提示技术,引导模型通过逐步推理得出结论

- 幻觉(Hallucination):语言模型生成看似合理但不正确或不存在的信息

- 知识图谱(Knowledge Graph):以图形结构表示实体和关系的知识表示方法

- 混合检索(Hybrid Retrieval):结合多种检索方法(如稀疏检索和密集检索)的检索策略

- 多轮检索(Multi-turn Retrieval):根据中间结果迭代优化检索的过程

- 提示模板(Prompt Template):预定义的提示结构,可动态填充内容以适应不同场景

这些术语将贯穿本文的后续章节,精确理解它们对于掌握RAG系统设计和实现至关重要。

2. 理论框架:RAG系统的数学与逻辑基础

2.1 信息检索基础理论

2.1.1 信息检索模型概述

信息检索(Information Retrieval, IR)是RAG系统的基础技术,其目标是从文档集合中找出与用户查询相关的信息。现代RAG系统集成了多种检索模型,主要分为三大类:

-

基于词汇的检索模型(Lexical Retrieval Models)

- 基于关键词匹配和词频统计

- 代表算法:布尔模型、向量空间模型、TF-IDF、BM25

-

基于语义的检索模型(Semantic Retrieval Models)

- 基于深度学习的语义理解

- 代表算法:DPR、Sentence-BERT、ColBERT、ANCE

-

混合检索模型(Hybrid Retrieval Models)

- 结合词汇和语义检索的优势

- 代表算法:SPLADE、DeepCT、Hybrid Fusion

每种模型基于不同的理论基础和数学假设,适用于不同的应用场景。

2.1.2 向量空间模型与余弦相似度

向量空间模型(Vector Space Model, VSM)是信息检索的基础数学框架,将文档和查询表示为向量空间中的点。其核心思想是:语义相似的文本在向量空间中距离相近。

在VSM中,文档和查询被表示为n维向量,其中n是词汇表大小,每个维度对应一个词项的权重:

文档向量:$ D = (w_{1}, w_{2}, …, w_{n}) $

查询向量:$ Q = (q_{1}, q_{2}, …, q_{n}) $

词项权重通常使用TF-IDF(Term Frequency-Inverse Document Frequency)计算:

词频(TF):衡量词项在文档中的重要性

$ tf_{t,d} = \text{词项} t \text{在文档} d \text{中出现的次数} $

逆文档频率(IDF):衡量词项在整个文档集合中的区分度

$ idf_{t} = \log\left(\frac{N}{df_{t}}\right) $

其中$ N 是文档总数,是文档总数,是文档总数, df_{t} 是包含词项是包含词项是包含词项 t $的文档数

TF-IDF权重:$ w_{t,d} = tf_{t,d} \times idf_{t} $

文档与查询的相似度通过余弦相似度计算:

sim(D,Q)=cos(θ)=D⋅Q∥D∥∥Q∥=∑t=1nwt,d×wt,q∑t=1nwt,d2×∑t=1nwt,q2 \text{sim}(D, Q) = \cos(\theta) = \frac{D \cdot Q}{\|D\| \|Q\|} = \frac{\sum_{t=1}^{n} w_{t,d} \times w_{t,q}}{\sqrt{\sum_{t=1}^{n} w_{t,d}^2} \times \sqrt{\sum_{t=1}^{n} w_{t,q}^2}} sim(D,Q)=cos(θ)=∥D∥∥Q∥D⋅Q=∑t=1nwt,d2×∑t=1nwt,q2∑t=1nwt,d×wt,q

余弦相似度取值范围为[0,1],值越大表示相似度越高。

尽管VSM在捕捉语义关系方面有局限,但它计算效率高,可解释性强,仍是现代混合检索系统的重要组成部分。

2.1.3 BM25算法:概率检索的巅峰之作

BM25(Best Matching 25)是一种基于概率的检索算法,由Stephen Robertson和Karen Sparck Jones于1970年代提出,并在1990年代得到改进。它是最广泛使用的检索函数之一,其基本形式为:

score(D,Q)=∑t∈Qlog((r+0.5)/(R−r+0.5)(n−r+0.5)/(N−n−R+r+0.5))×(k1+1)tfK+tf×(k3+1)qfk3+qf \text{score}(D, Q) = \sum_{t \in Q} \log\left(\frac{(r + 0.5)/(R - r + 0.5)}{(n - r + 0.5)/(N - n - R + r + 0.5)}\right) \times \frac{(k_1 + 1)tf}{K + tf} \times \frac{(k_3 + 1)qf}{k_3 + qf} score(D,Q)=t∈Q∑log((n−r+0.5)/(N−n−R+r+0.5)(r+0.5)/(R−r+0.5))×K+tf(k1+1)tf×k3+qf(k3+1)qf

其中:

- $ N $:文档总数

- $ n :包含词项:包含词项:包含词项 t $的文档数

- $ R $:与查询相关的文档总数(通常设为0)

- $ r :包含词项:包含词项:包含词项 t $的相关文档数(通常设为0)

- $ tf :词项:词项:词项 t 在文档在文档在文档 D $中的词频

- $ qf :词项:词项:词项 t 在查询在查询在查询 Q $中的词频

- $ k_1, k_3 :调节词频和查询词频影响的参数(通常:调节词频和查询词频影响的参数(通常:调节词频和查询词频影响的参数(通常 k_1=1.2, k_3=8 $)

- $ K ::: K = k_1 \times ((1 - b) + b \times \frac{|D|}{\text{avgdl}}) ,其中,其中,其中 b 是调节文档长度影响的参数(通常是调节文档长度影响的参数(通常是调节文档长度影响的参数(通常 b=0.75 ),),), |D| 是文档长度,是文档长度,是文档长度, \text{avgdl} $是平均文档长度

当忽略相关性信息($ R = r = 0 $)时,BM25简化为:

score(D,Q)=∑t∈Qlog(N−n+0.5n+0.5)×(k1+1)tfK+tf×(k3+1)qfk3+qf \text{score}(D, Q) = \sum_{t \in Q} \log\left(\frac{N - n + 0.5}{n + 0.5}\right) \times \frac{(k_1 + 1)tf}{K + tf} \times \frac{(k_3 + 1)qf}{k_3 + qf} score(D,Q)=t∈Q∑log(n+0.5N−n+0.5)×K+tf(k1+1)tf×k3+qf(k3+1)qf

BM25的优势在于:

- 考虑了文档长度对相关性的影响

- 对高频词的权重增长进行了饱和处理

- 参数可调节,适应不同数据集和场景

- 计算效率高,适合大规模部署

BM25是许多搜索引擎和RAG系统的基础检索算法,也是混合检索架构中的关键组件。

2.1.4 语义嵌入与向量检索:从字面匹配到语义理解

随着深度学习的发展,基于语义嵌入的检索方法逐渐成为主流。这种方法通过预训练语言模型将文本转换为低维向量表示(嵌入),捕捉深层语义关系,而不仅仅是表面词汇匹配。

嵌入模型学习将文本映射到高维向量空间,使得语义相似的文本在空间中距离相近。典型的嵌入模型包括:

- Sentence-BERT及其变体(如all-MiniLM-L6-v2)

- BERT用于句子嵌入(BERT-base, BERT-large)

- 专门优化的检索模型(如DPR, ColBERT, ANCE)

- 多语言嵌入模型(如LaBSE, XLM-RoBERTa)

嵌入模型的数学表示为函数$ E: T \rightarrow \mathbb{R}^d ,将文本,将文本,将文本 T 映射到映射到映射到 d $维向量空间。

向量检索的核心是近似最近邻(ANN)搜索,因为精确K近邻在高维空间和大规模数据集上计算成本过高。常见的ANN算法包括:

- 局部敏感哈希(LSH):通过哈希函数将相似向量映射到相同桶中

- 分层可导航小世界图(HNSW):构建多层图结构加速检索

- 乘积量化(PQ):将向量分割为子向量并量化,减少存储和计算成本

- IVF(Inverted File with Product Quantization):结合倒排索引和乘积量化

向量检索的相似度通常使用余弦相似度或欧氏距离计算:

余弦相似度:$ \cos(E(D), E(Q)) = \frac{E(D) \cdot E(Q)}{|E(D)| |E(Q)|} $

欧氏距离:$ |E(D) - E(Q)|2 = \sqrt{\sum{i=1}^{d} (E(D)_i - E(Q)_i)^2} $

语义嵌入检索相比传统方法的优势:

- 捕捉同义词和语义相关词(如"汽车"和"车辆")

- 理解上下文含义(如"苹果"指水果还是公司)

- 处理词汇表外(OOV)词

- 支持跨语言检索

然而,向量检索也存在挑战:

- 计算成本高,需要专门的向量数据库支持

- 可解释性差,难以理解检索结果的匹配原因

- 对嵌入模型质量高度依赖

- 对领域适配敏感

现代RAG系统通常结合传统检索(如BM25)和语义嵌入检索的优势,形成混合检索架构,以平衡性能、效率和可解释性。

2.2 提示工程的理论基础

2.2.1 语言模型的条件概率框架

大语言模型(LLMs)的核心是基于条件概率生成文本。给定前文$ x_1, x_2, …, x_{n-1} ,模型预测下一个词,模型预测下一个词,模型预测下一个词 x_n $的概率:

P(xn∣x1,x2,...,xn−1;θ) P(x_n | x_1, x_2, ..., x_{n-1}; \theta) P(xn∣x1,x2,...,xn−1;θ)

其中$ \theta $是模型参数。对于完整序列,生成概率是每个步骤条件概率的乘积:

P(x1,x2,...,xn;θ)=∏k=1nP(xk∣x1,...,xk−1;θ) P(x_1, x_2, ..., x_n; \theta) = \prod_{k=1}^{n} P(x_k | x_1, ..., x_{k-1}; \theta) P(x1,x2,...,xn;θ)=k=1∏nP(xk∣x1,...,xk−1;θ)

提示工程的本质是通过设置初始序列$ x_1, …, x_m (提示)来引导模型生成特定类型的后续序列(提示)来引导模型生成特定类型的后续序列(提示)来引导模型生成特定类型的后续序列 x_{m+1}, …, x_n $,即使得:

argmaxxm+1,...,xnP(xm+1,...,xn∣x1,...,xm;θ) \arg\max_{x_{m+1}, ..., x_n} P(x_{m+1}, ..., x_n | x_1, ..., x_m; \theta) argxm+1,...,xnmaxP(xm+1,...,xn∣x1,...,xm;θ)

对应于期望的输出。

2.2.2 上下文学习(In-Context Learning)理论

上下文学习(ICL)是LLMs的关键能力,指模型仅通过提示中的示例而非参数更新来学习新任务的能力。ICL的理论基础仍在研究中,但主要假设有:

- 隐含贝叶斯推理:模型通过示例推断任务分布,并基于此生成新样本

- 元学习视角:预训练使模型获得元学习能力,能够快速适应新任务

- 注意力机制作用:注意力权重在示例和测试输入之间建立关联

ICL的性能取决于多个因素,包括:

- 示例数量和质量

- 示例与测试输入的相似度

- 示例的顺序和排列方式

- 任务的复杂性

在RAG系统中,ICL表现为模型能够基于检索到的知识片段和提示中的指令生成回答,而无需对模型参数进行任何更新。

2.2.3 思维链(Chain-of-Thought)推理的理论模型

思维链(CoT)提示是一种引导模型进行逐步推理的技术,特别适用于复杂问题解决。其理论基础是将复杂推理分解为一系列中间步骤,使模型能够:

- 逐步构建解决方案

- 避免跳跃性推理导致的错误

- 展示推理过程,提高可解释性

CoT的数学模型可以表示为将问题$ Q 分解为中间推理步骤分解为中间推理步骤分解为中间推理步骤 S_1, S_2, …, S_k 和最终答案和最终答案和最终答案 A $:

P(A∣Q)=∑S1,...,SkP(S1,...,Sk,A∣Q) P(A | Q) = \sum_{S_1,...,S_k} P(S_1,...,S_k, A | Q) P(A∣Q)=S1,...,Sk∑P(S1,...,Sk,A∣Q)

通过最大化联合概率$ P(S_1,…,S_k, A | Q) $,模型能够找到合理的推理路径和正确答案。

研究表明,CoT在以下情况下特别有效:

- 数学推理问题

- 逻辑推理任务

- 需要多步骤分析的复杂问题

- 知识密集型任务

在RAG系统中,CoT与检索结合形成"检索增强思维链"(RAG-CoT),模型首先检索相关知识,然后基于这些知识进行逐步推理,显著提高复杂问题解决能力。

2.2.4 提示工程的信息论视角

从信息论角度看,提示工程是通过优化输入信息来减少模型输出的不确定性。根据香农信息论:

互信息:衡量提示$ P 与模型输出与模型输出与模型输出 O $之间的相关性

$ I(P; O) = H(O) - H(O|P) $

其中$ H(O) 是输出的熵(不确定性),是输出的熵(不确定性),是输出的熵(不确定性), H(O|P) 是给定提示后输出的条件熵。优质提示应最大化互信息是给定提示后输出的条件熵。优质提示应最大化互信息是给定提示后输出的条件熵。优质提示应最大化互信息 I(P; O) $,即提供足够信息减少输出不确定性,同时不引入噪声。

信息瓶颈理论表明,最优提示应包含任务必要的最小信息量,过滤掉无关信息。这指导我们在设计提示时遵循"最小充分性"原则:提供足够信息完成任务,不多也不少。

率失真理论为提示压缩提供了框架,即在保持信息传递效率的前提下,优化提示长度以适应模型的上下文限制。这对于RAG系统尤为重要,因为需要在有限上下文窗口中平衡查询、检索知识和提示指令。

这些理论视角为提示工程提供了量化分析框架,超越了经验性的"试错"方法,迈向更系统化的提示优化。

2.3 RAG系统的理论模型

2.3.1 RAG的整体概率模型

RAG系统的核心是结合检索和生成的概率模型。给定查询$ Q ,RAG系统的目标是生成回答,RAG系统的目标是生成回答,RAG系统的目标是生成回答 A $,其整体概率可以表示为:

P(A∣Q)=∑KP(A∣Q,K)P(K∣Q) P(A | Q) = \sum_{K} P(A | Q, K) P(K | Q) P(A∣Q)=K∑P(A∣Q,K)P(K∣Q)

其中$ K = {k_1, k_2, …, k_m} 是从知识库中检索到的知识片段集合,是从知识库中检索到的知识片段集合,是从知识库中检索到的知识片段集合, P(K | Q) 是检索概率分布,是检索概率分布,是检索概率分布, P(A | Q, K) $是生成概率分布。

RAG系统通过最大化$ P(A | Q) $来生成最优回答,这涉及两个关键步骤:

- 检索相关知识:最大化$ P(K | Q) $,找到与查询最相关的知识

- 基于知识生成:最大化$ P(A | Q, K) $,基于查询和知识生成回答

这个概率模型为RAG系统提供了理论基础,也指出了优化方向:同时优化检索分布和生成分布,以及它们之间的协作。

2.3.2 检索增强生成的理论优势

从理论角度看,RAG相比纯生成模型有以下优势:

-

知识不确定性降低:通过引入外部知识$ K ,条件生成概率,条件生成概率,条件生成概率 P(A | Q, K) 的熵通常低于的熵通常低于的熵通常低于 P(A | Q) $,减少了模型编造信息的可能性:

H(A∣Q,K)≤H(A∣Q) H(A | Q, K) \leq H(A | Q) H(A∣Q,K)≤H(A∣Q) -

知识时效性增强:RAG可以整合最新知识,而无需重新训练模型,解决了纯LLM的知识滞后问题:

PRAG(A∣Q,Knew)≈Pupdated LLM(A∣Q) P_{\text{RAG}}(A | Q, K_{\text{new}}) \approx P_{\text{updated LLM}}(A | Q) PRAG(A∣Q,Knew)≈Pupdated LLM(A∣Q)

其中$ K_{\text{new}} $是新获取的知识。 -

领域适应性提升:通过更换或扩展知识库,RAG系统可以快速适应新领域,而无需大规模领域微调:

P(A∣Q,Kdomain)≈Pdomain LLM(A∣Q) P(A | Q, K_{\text{domain}}) \approx P_{\text{domain LLM}}(A | Q) P(A∣Q,Kdomain)≈Pdomain LLM(A∣Q)

其中$ K_{\text{domain}} $是领域特定知识。 -

计算效率优化:更新知识库的成本远低于更新模型参数:

C(Kupdate)≪C(θupdate) C(K_{\text{update}}) \ll C(\theta_{\text{update}}) C(Kupdate)≪C(θupdate)

其中$ C $表示更新成本。

这些理论优势解释了为什么RAG在知识密集型任务中表现优于纯LLM方法,以及为什么它成为工业界部署LLM应用的首选架构。

2.3.3 RAG系统的优化目标

RAG系统的优化目标是最大化条件概率$ P(A | Q) $,这可以分解为多个子目标:

-

检索质量优化:最大化检索到的知识与查询的相关性

maxKP(K∣Q) \max_{K} P(K | Q) KmaxP(K∣Q) -

知识选择优化:在上下文窗口限制下选择最有用的知识片段

maxK′⊆K,∣K′∣≤LP(A∣Q,K′) \max_{K' \subseteq K, |K'| \leq L} P(A | Q, K') K′⊆K,∣K′∣≤LmaxP(A∣Q,K′)

其中$ L $是上下文长度限制。 -

提示优化:设计最优提示格式和内容以引导生成

maxPP(A∣Q,K,P) \max_{P} P(A | Q, K, P) PmaxP(A∣Q,K,P)

其中$ P $是提示模板。 -

生成优化:最大化生成回答的质量、相关性和准确性

maxAP(A∣Q,K,P) \max_{A} P(A | Q, K, P) AmaxP(A∣Q,K,P)

这些子目标相互关联,需要联合优化而非独立处理。例如,检索策略的优化应考虑后续生成步骤的需求,提示设计应适应检索到的知识类型。

2.3.4 RAG中的知识融合与推理

RAG系统不仅需要检索知识,还需要有效地融合和推理这些知识以生成回答。知识融合的理论模型可以分为:

-

串联融合:将检索到的知识片段简单拼接后输入模型

Kconcat=[k1;k2;...;km] K_{\text{concat}} = [k_1; k_2; ...; k_m] Kconcat=[k1;k2;...;km]

这种方法简单但可能导致信息过载和注意力分散。 -

选择性融合:基于相关性和重要性选择知识片段

Kselective=argmaxK′⊆KP(A∣Q,K′) K_{\text{selective}} = \arg\max_{K' \subseteq K} P(A | Q, K') Kselective=argK′⊆KmaxP(A∣Q,K′)

这种方法需要预测知识片段的有用性,计算成本较高。 -

整合融合:将多个知识片段整合成连贯的知识表示

Kintegrated=fmodel(k1,k2,...,km) K_{\text{integrated}} = f_{\text{model}}(k_1, k_2, ..., k_m) Kintegrated=fmodel(k1,k2,...,km)

其中$ f_{\text{model}} $是专门的整合模型。 -

辩证融合:处理知识片段之间的冲突和不一致

Kdialectic=resolve(k1,k2,...,km) K_{\text{dialectic}} = \text{resolve}(k_1, k_2, ..., k_m) Kdialectic=resolve(k1,k2,...,km)

这种方法最为复杂,但对处理多源异构知识至关重要。

推理过程则可以建模为:

A=infer(Q,K)=argmaxAP(A∣Q,K) A = \text{infer}(Q, K) = \arg\max_{A} P(A | Q, K) A=infer(Q,K)=argAmaxP(A∣Q,K)

其中推理函数$ \text{infer} $可以是:

- 直接生成(适用于简单问题)

- 多步推理(适用于复杂问题)

- 符号推理(适用于逻辑和数学问题)

- 迭代推理(适用于需要多轮检索和生成的问题)

知识融合和推理的质量直接决定了RAG系统的性能上限,是当前研究的重点领域。

2.4 知识库管理的理论模型

2.4.1 知识表示的理论框架

知识库管理的基础是知识表示,即如何结构化地组织信息以支持高效检索和推理。主要的知识表示模型包括:

-

逻辑表示:基于一阶谓词逻辑、描述逻辑等形式化语言

- 谓词:$ P(x_1, x_2, …, x_n) $表示对象间关系

- 规则:$ P(x) \rightarrow Q(x) $表示推理规则

- 优势:精确、可推理;劣势:表达能力有限、处理复杂知识困难

-

语义网络:以图结构表示概念和关系

- 节点表示实体或概念

- 边表示关系

- 优势:直观、适合表示关联知识;劣势:缺乏形式化语义、推理能力有限

-

框架/脚本:基于结构化模板表示知识

- 框架:包含槽位和默认值的结构化表示

- 脚本:表示事件序列和典型场景

- 优势:适合表示定型知识;劣势:灵活性差、难以处理非典型情况

-

本体论:形式化定义概念及其关系的共享词汇表

- 包含类、属性、关系、实例等元素

- 支持逻辑推理和一致性检查

- 优势:高度结构化、支持复杂推理;劣势:构建成本高、维护困难

-

向量表示:将知识编码为高维向量

- 实体嵌入:$ E(e) \in \mathbb{R}^d $

- 关系嵌入:$ E® \in \mathbb{R}^d $

- 优势:适合计算相似度、易于集成到机器学习模型;劣势:可解释性差、难以表示复杂逻辑关系

现代RAG系统越来越倾向于混合知识表示,结合结构化和向量表示的优势,如知识图谱与嵌入结合的GraphRAG架构。

2.4.2 文档分块的理论基础

文档分块是知识库构建的关键步骤,其理论基础涉及信息论和认知科学。最优分块策略应最大化:

- 信息完整性:每个块包含完整的语义单元

- 检索相关性:块大小适合捕获查询相关信息

- 计算效率:块大小平衡存储和检索成本

从理论角度,分块问题可以建模为:

给定文档$ D = [s_1, s_2, …, s_N] (其中(其中(其中s_i是句子或段落),找到分块边界是句子或段落),找到分块边界是句子或段落),找到分块边界 B = [b_1, b_2, …, b_k] ,使得分块,使得分块,使得分块 C = [D[b_1:b_2], D[b_2:b_3], …, D[b_k:N]] $最大化目标函数:

J(C)=α⋅coherence(C)+β⋅retrievability(C)−γ⋅cost(C) J(C) = \alpha \cdot \text{coherence}(C) + \beta \cdot \text{retrievability}(C) - \gamma \cdot \text{cost}(C) J(C)=α⋅coherence(C)+β⋅retrievability(C)−γ⋅cost(C)

其中:

- $ \text{coherence}© $:块内语义连贯性

- $ \text{retrievability}© $:块被相关查询检索到的概率

- $ \text{cost}© $:存储和处理分块的成本

- $ \alpha, \beta, \gamma $:权衡参数

分块方法可以分为:

-

固定大小分块:基于字符或token数的简单分块

- 优势:实现简单、计算成本低

- 劣势:可能割裂语义单元

-

语义分块:基于语义边界的分块

- 基于段落、章节等自然边界

- 基于句子相似度的分块(如使用余弦相似度)

- 基于主题建模的分块(如使用LDA识别主题变化)

- 优势:保持语义完整性;劣势:计算复杂、依赖模型质量

-

层次化分块:构建多级分块结构

- 大块包含多个相关小块

- 支持不同粒度的检索

- 优势:灵活适应不同查询类型;劣势:存储开销大、管理复杂

研究表明,最优分块大小通常在200-500token范围内,但具体取决于文档类型、领域和检索模型。动态分块策略(根据内容调整块大小)通常优于固定大小分块。

2.4.3 知识更新与演化的理论模型

知识库不是静态的,而是需要不断更新以反映新信息。知识更新的理论模型包括:

-

增量更新模型:只添加新信息而不删除旧信息

- $ K_{t+1} = K_t \cup K_{\text{new}} $

- 优势:简单、保留历史信息;劣势:存储成本增加、可能包含过时或冲突信息

-

替换更新模型:用新信息替换旧信息

- $ K_{t+1} = (K_t \setminus K_{\text{old}}) \cup K_{\text{new}} $

- 优势:保持知识库精简;劣势:需要识别过时信息、可能丢失历史上下文

-

版本化更新模型:维护知识的多个版本

- $ K_{t+1} = K_t + (t+1, K_{\text{new}}) $

- 优势:支持时间旅行查询、可恢复旧版本;劣势:存储成本高、版本管理复杂

-

衰减更新模型:随时间降低旧知识的权重

- $ w_{t+1}(k) = \alpha \cdot w_t(k) + (1-\alpha) \cdot w_{\text{new}}(k) $

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)