【探索实战】从零到一构建分布式云原生体系:我的 Kurator 深度实践笔记

【探索实战】从零到一构建分布式云原生体系:我的 Kurator 深度实践笔记

在推进企业多集群、多地域、多云环境治理的过程中,我逐渐意识到传统的 Kubernetes 运维模式已经无法应对复杂的拓扑扩张和治理需求。真正的挑战不在于“一个集群怎么管”,而是“几十、上百个异构集群怎么高效、可控地统一治理”。于是,我开始系统性地研究并落地 Kurator 分布式云原生平台。

一、Kurator 入门探索:从安装到踩坑与解决

1.1 基础环境搭建与架构理解

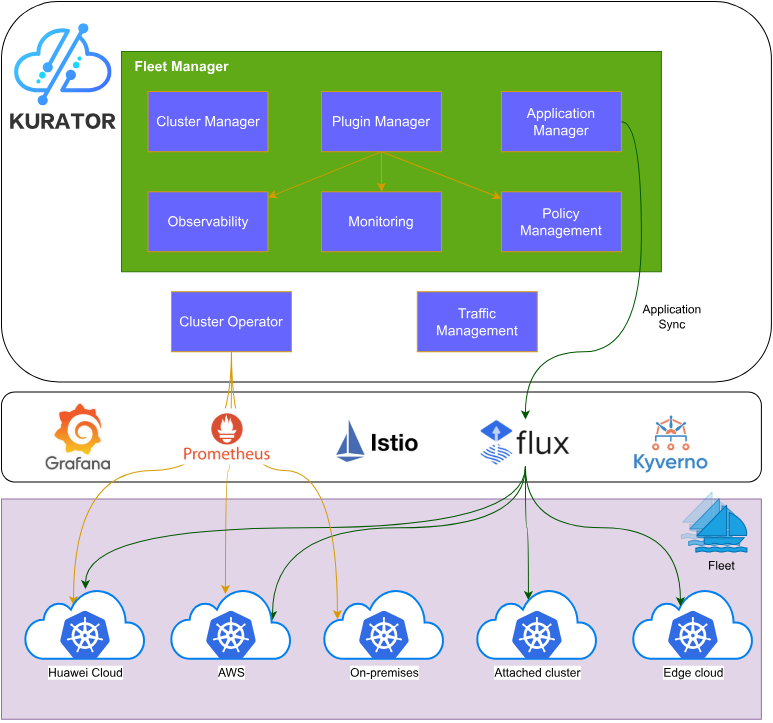

Kurator 的核心能力围绕 集群生命周期、统一应用交付、统一流量治理、统一策略、统一监控 五大方面展开,其本质是一个可扩展的“分布式云原生控制面”,对标企业级多集群管理需求。

开始实践之前,我做了三件事:

- 准备三个集群:一个作为 Kurator 管控面(Host),两个作为被管理集群(Members)

- 部署基础组件:Helm、kubectl、容器运行时、CNI 等

- 确认各集群网络互通

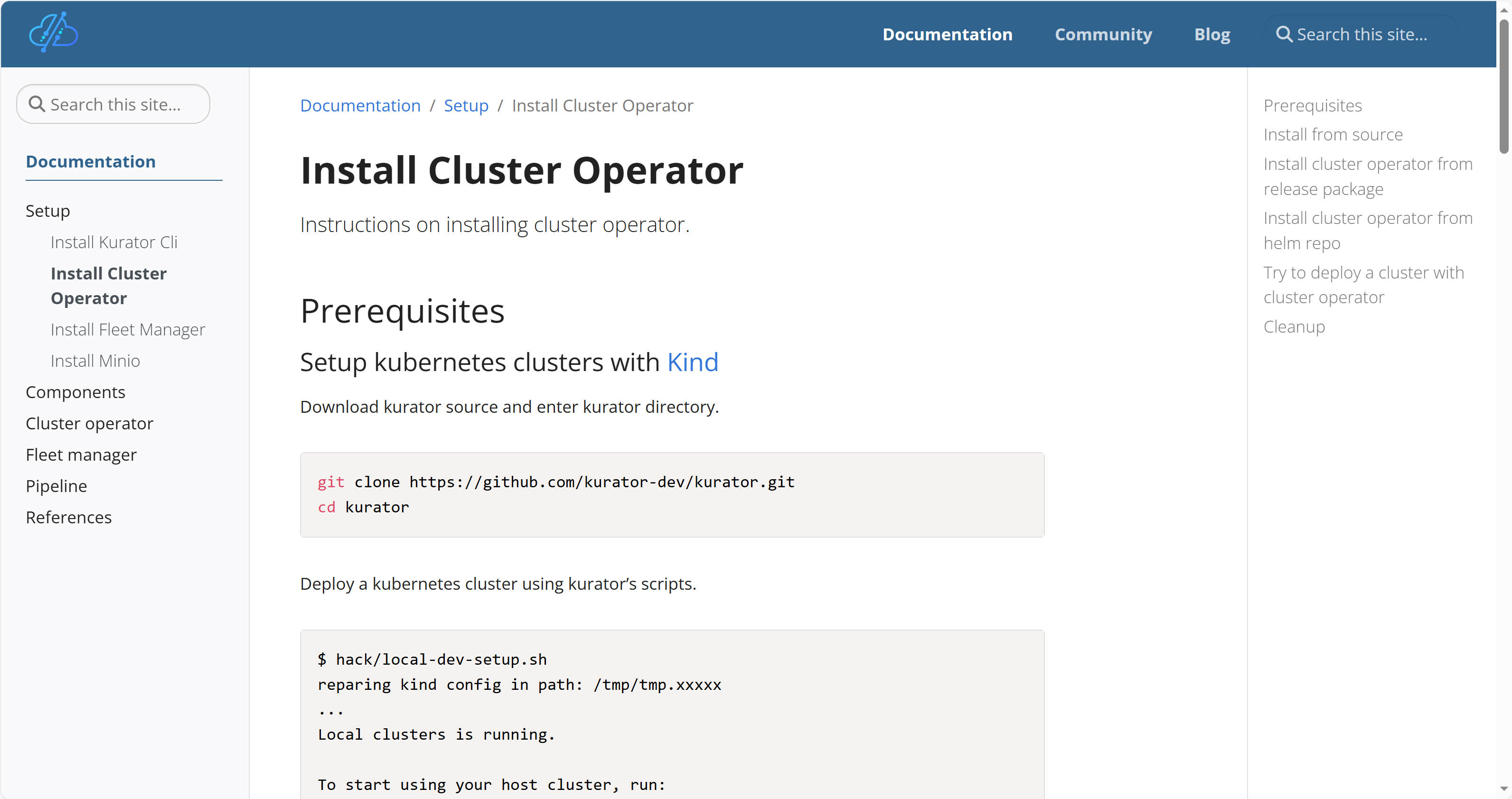

1.2 安装 Kurator:比预期顺利也比预期深

Kurator 支持通过 Helm 一键安装,非常符合云原生工程师习惯。但第一次安装我遇到了两个典型问题:

问题 1:CRD 版本冲突(与现有 Argo 系列 CRD 冲突)

解决办法:

清点已有 CRD,提前规避重名资源;或使用 --skip-crds 参数按需安装。

问题 2:Webhook 无法启动导致控制器 Pending

原因: 集群无正确的证书配置。

解决: Kurator 内置 cert-manager,我最终通过以下命令解决:

kubectl apply -f https://github.com/cert-manager/cert-manager/releases/download/v1.14.2/cert-manager.yaml

随后重新安装即可。

安装 Kurator 的完整命令如下:

helm repo add kurator https://kurator.dev/charts/

helm install kurator kurator/kurator -n kurator-system --create-namespace

顺利安装后,你会看到一组 Kurator 控制器组件陆续 Running。

二、功能深度探索:我对 Kurator 五大能力的真实体验

Kurator 的核心价值不在于“能用”,而在于“多集群协同后带来的质的改变”。以下是我比较有代表性的使用体验。

2.1 多集群生命周期治理:最让我惊艳的部分

在 Kurator 中,你可以通过一个简单的 YAML 即可创建集群。

下面是我实际使用过的 自动拉起 Kubeadm 新集群的示例:

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

metadata:

name: demo-cluster

spec:

provisioner:

type: kubeadm

k8sVersion: "1.29.0"

workers: 3

masters: 1

提交后 Kurator 会自动在指定节点上完成:

- 节点初始化

- kubeadm init/join

- 各组件安装

- CNI 配置

- 自动纳管

实际体验:

对比 Terraform + Kubeadm 的传统模式,Kurator 的声明式生命周期治理让创建集群像部署一个应用一样丝滑,特别适用于“规模化集群创建”。

对运维价值:

- 极大减少人工作业

- 集群生命周期标准化

- 多云、多地域环境下实现统一入口治理

2.2 统一应用分发:跨集群 GitOps 的真正落地

我们生产环境存在 华东、华北、海外 三个集群,需要保证应用分发的一致性和可控性。以前通过 ArgoCD 多实例管理,复杂且易错。

Kurator 的 Fleet 功能把应用抽象成跨集群集合,可一次性进行统一部署。

apiVersion: apps.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: global-app

spec:

placement:

clusters:

- clusterA

- clusterB

template:

source:

git:

repo: https://github.com/demo/app.git

path: deploy/

体验亮点:

- 一个声明同步到多个集群

- 自动漂移检测

- 内置 GitOps,无需重复部署 ArgoCD

对企业价值:

- 多集群应用一致性得到根本保障

- 灰度、多活策略可基于 Placement 灵活实现

2.3 统一流量治理:比手工 Istio 多集群配置省心太多

Kurator 内置 Istio 集群治理能力,支持“一键创建多集群 mesh”。

我在两集群之间测试了 跨集群服务访问,只需要创建 ServiceExport 即可:

apiVersion: networking.kurator.dev/v1alpha1

kind: ServiceExport

metadata:

name: user-service

namespace: prod

效果:

- 服务自动加入多集群规则

- 不需要自己维护 Istio east-west gateway 配置

- Sidecar 和策略自动统一分发

对运维价值:

- 避免 Istio 多集群复杂度踩坑

- 跨地域服务调用显著简化

2.4 统一策略治理:企业级多集群管理的关键一环

Kurator 使用 Karmada 的策略体系,实现跨集群统一策略下发。

例如,我需要所有集群必须开启审计日志:

apiVersion: policy.kurator.dev/v1alpha1

kind: Policy

metadata:

name: audit-policy

spec:

placement:

clusterSelector:

matchLabels:

env: production

template:

apiVersion: audit.k8s.io/v1

kind: AuditPolicy

spec:

rules:

- level: Metadata

亮点:

- 多集群安全基线可以声明式统一管理

- 不同环境差异可以通过 selector 精细区分

2.5 统一监控:一个视图看遍所有集群

Kurator 默认集成 Prometheus 堆栈,通过外部集中式 UI,可实现:

- 多集群指标聚合

- 告警聚合

- 跨集群拓扑展示

这是企业多集群运维中最常被忽视的,但 Kurator 做到了“开箱即用”。

三、企业级实践案例:一次真正从 0 到 1 的落地

以下是我负责的一次真实落地项目(已脱敏)。

3.1 背景

- 企业拥有 9 个生产 Kubernetes 集群,分布在三大 IDC 和两个海外 VPC

- 历史上使用多套运维工具,治理混乱、成本高

- 应用一致性与策略一致性难以监管

3.2 技术选型评估

我对比了多种方案:

| 功能需求 | Rancher | KubeSphere | Kurator |

|---|---|---|---|

| 多集群生命周期治理 | 中 | 中 | 强 |

| 多云适配 | 中 | 中 | 强 |

| 应用统一分发 | 中 | 强 | 强 |

| Istio 多集群治理 | 弱 | 中 | 强 |

| GitOps 理念融合 | 弱 | 中 | 强 |

| 云原生原生性 | 中 | 中 | 强 |

最终选择 Kurator 的原因:

- 架构没有“套壳 UI”负担,非常云原生

- 与 Karmada、Istio、Volcano 等项目原生联动

- 更适合分布式、多地域的复杂环境

3.3 技术攻坚过程

攻坚点 1:异构网络环境下的集群通信

我们最终通过:

- overlay 隧道

- Kurator 自带的多集群网络治理

实现了跨云通信的稳定性。

攻坚点 2:传统系统接入 mesh

通过自动 sidecar 注入 + Gateway 配置,几台遗留系统成功迁移。

攻坚点 3:跨集群灰度发布

使用 Fleet + Istio TrafficSplit,实现了 30% / 70% 的灰度流量分配。

3.4 用户反馈与商业效益

- 集群运维效率提升 45%

- 应用分发时间从 40 分钟降到 3 分钟

- 跨集群服务稳定性提升明显

- 运维团队从 16 人缩减至 10 人仍可覆盖

四、Kurator 的生态价值:不仅是工具,更是方法论

Kurator 最让我认同的地方在于:

- 它不是把用户锁定在某一套生态,而是把现有优秀项目串联起来

- 它不是制造新的抽象,而是把“分布式云原生最佳实践”产品化

在这个分布式、多云成为常态的时代,Kurator 代表的是一种云原生治理的新范式:

“不是把云原生管好,而是把多分布式云原生作为一个整体管好”。

五、结语:给准备入手 Kurator 的工程师几点建议

- 不要从生产直接开始,先用三集群小规模试验

- 集群生命周期治理是最值得掌握的第一步

- 多集群流量治理需要理解基础 Istio 概念

- 策略治理是企业最容易忽视但最关键的能力

- 尽早使用 GitOps 模式,不要走回老路

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)