国产化AI落地的“深水区”:基于鲲鹏+苏安OS的RAG与Agent全栈安全架构实战

引言:从“玩具”到“生产级”:企业AI的合规与安全挑战

在2026年的今天,大模型技术已经跨越了单纯的“对话玩具”阶段,正在向企业核心业务系统渗透。然而,作为技术架构师,我们在落地过程中面临的核心矛盾已经发生了转移:从“模型好不好用”变成了“系统安不安全、合不合规”。

结合近期在某大型技术峰会中的实战复盘,本文将带你构建一套基于华为鲲鹏生态与苏安智能体操作系统的企业级AI架构。这套架构已在C919运维、电网调度等高敏场景验证,核心解决“数据不出域”与“业务流程黑盒”难题。

一、 架构真经:软硬协同的国产化AI底座

企业级AI应用不能只靠软件“裸奔”,必须依托硬件级的信任。我们构建的底座架构如下:

1. 核心痛点与解决方案

- 痛点:企业(尤其是国央企)面临“百虾大战”后的碎片化Agent管理难题,且对Intel/AMD芯片存在供应链安全顾虑。

- 方案:采用鲲鹏920芯片 + OpenEuler操作系统作为算力底座。鲲鹏920作为全球首个基于ARM的创生型CPU,配合华为自研的CCA(Confidential Computing Architecture)架构,为上层AI提供了硬件级的“安全围栏”。

2. 源码级解读:基于OVIP的上下文缓存优化

在生产环境中,大模型推理的高延迟是性能瓶颈。华为方案通过原生框架对OVIP(Open Vision Inference Protocol)进行特定优化,引入了上下文缓存机制。

# 伪代码示意:基于KV Cache的上下文快照

class ContextSnapshot:

def __init__(self):

self.kv_cache = {} # 存储中间推理数据

def save_snapshot(self, task_id, intermediate_data):

"""

在Agent执行长流程任务时,将中间状态(如规划步骤)存入快照

避免重复推理,实测可降低50%的Token消耗

"""

self.kv_cache[task_id] = compress(intermediate_data)

def recall_from_cache(self, task_id):

# 在任务恢复时快速召回上下文

return decompress(self.kv_cache.get(task_id))

避坑实录1:硬件与软件的“最后一公里”适配

- 误区:直接将x86环境的Docker镜像迁移到鲲鹏。

- 正解:必须进行指令集层面的编译优化。利用鲲鹏DevKit工具包进行扫描,针对ARMv8.2指令集进行特定编译,否则性能可能下降30%以上。

二、 AI安全:苏安操作系统的“安全三态”管控

安全三态(确定性安全、可预测安全、安全量子态)。这是解决AI“幻觉”与“越狱”攻击的关键。

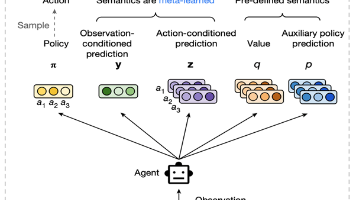

1. 实战场景:无限任务生成的双流进化

在某互联网平台的运维场景中,我们需要让Agent处理“无限任务”(连续变化的业务环境)。

- 双流模式:

- 在线流:执行既定的、经过人工审计的固定工作流(保障确定性)。

- 离线流:在沙箱中自由探索新策略,通过安全哨兵进行动态监测,验证无误后才合并入在线流。

2. 源码级解读:意图检测与本体论防护

为了防止Prompt注入攻击,苏安系统在内核层引入了意图检测:

# 模拟意图检测中间件

def intent_guard(prompt, user_profile):

# 1. 提取本体论特征(基于用户画像的基线行为)

baseline_intent = get_user_baseline_intent(user_profile)

current_intent = extract_intent(prompt)

# 2. 计算偏离度(安全量子态量化)

deviation = calculate_cosine_similarity(baseline_intent, current_intent)

if deviation > THRESHOLD:

# 触发“安全哨兵”,阻断或降级执行

raise SecurityQuantumAlert("行为偏离基线,需人工审计")

else:

return execute_agent(prompt)

避坑实录2:权限的“最小化”陷阱

- 现象:Agent在调用第三方工具时因权限不足而失败。

- 对策:实施动态权限管理。Agent在未获得明确授权前,只能访问脱敏视图,且无法导出原始数据。

三、 数据引擎:TODB时序大模型的工业落地

在大数据开发场景中,传统的RAG往往只关注文本,却忽略了工业与金融领域最核心的时序数据。

1. 技术架构:让大模型训推更靠近数据

浪潮TODB提出了AI IDP(In-Database Processing)思路。

- 痛点:将海量时序数据(如传感器数据、股价)导出到外部模型训练,不仅慢,而且有泄露风险。

- 方案:在数据库内部集成轻量化时序基础模型。

2. 源码级解读:基于TODB的虚拟电厂预测

-- 在TODB中直接调用AI能力进行功率预测

SELECT

device_id,

-- 内置的时序模型函数,无需数据迁移

TO_MODEL_PREDICT(

'timeseries_forecast_v2',

history_data,

'lookahead=96' -- 预测未来96个时间点(24小时)

) AS predicted_power

FROM

power_plant_sensors

WHERE

date = '2026-04-25';

3. 模型优势

- 轻量化:参数量少,推理速度快。

- 高精度:针对周期性、协变量进行统一建模,解决了传统模型在长期预测中误差积累的问题(实测误差 < 10%)。

四、 业务实战:基于Airflow的RAG知识库工程化

最后,我们将视角拉回到具体的业务场景(如某广告科技公司的运维工单处理)。

1. 痛点:非结构化数据的治理

企业文档(PDF、飞书文档、Excel表格)往往包含复杂的表格和格式,直接切片会导致“幻觉”。

2. 实战方案:Airflow + 多模态切片

- 切片策略:

- 文本:按段落切分,保留元数据(如年份、版本号)。

- 表格:针对大表格,采用“保留表头+语义完整性”策略,避免表头与数据分离。

3. 避坑实录3:大表格的“幻觉”根源

- 现象:用户问“2025年的差旅报销标准”,AI回答了一个错误的数字。

- 根因:向量化切片时,表格被切到了两段,模型只看到了数字没看到表头,或者看到了错误的表头。

- 对策:在切片逻辑中增加表格预处理模块,强制将表头信息注入到每一行数据的向量描述中。

五、 总结与展望

在2026年的AI+业务实战中,我们已经不能仅停留在“调参”层面。

- 底座国产化:鲲鹏920 + OpenEuler 是解决供应链安全的基石。

- 系统安全化:苏安OS的“安全三态”与沙箱机制,是让AI进入核心业务的前提。

- 数据实时化:TODB等时序数据库的AI化,打通了物理世界与数字世界的壁垒。

作为架构师,我们的使命是构建“可解释、可审计、可治理”的AI系统,让技术真正服务于业务的确定性增长。

结尾互动

各位技术同仁,面对国央企日益严格的“信创合规”要求,你们在落地AI项目时遇到的最大阻碍是硬件适配、数据安全,还是业务流程的改造?

欢迎在评论区留言,分享你的实战踩坑经验,我们一起探讨国产化AI落地的最佳路径。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)