DeepSeek V4 vs Claude Opus 4.7 实测

1|先把结论摆出来

我用同一套 HTML 编码题,让 DeepSeek V4-Pro(思考全开)和 Claude Opus 4.7(思考全开)各跑一遍。两边都用 opencode CLI 驱动,prompt 完全一致。

6 道精选题逐一打开看动效之后,几个直观印象:

✅ DeepSeek V4 颜值常常更高:黑洞、樱花、火锅几道题,DeepSeek 出图比 Claude 更耐看。

➡ 但 DeepSeek 经常「漏要素」:地球用了夜景贴图导致全球都点了灯(明显违反「夜晚一侧」的要求);火锅没画火焰、透视错;鱼群偷工。

✅ Claude 更老实地按要求做:地球大陆是程序化绘制、夜灯只在背日侧;火锅有火焰、气泡、蒸汽;但偶尔有自己的瑕疵(樱花抖动、鱼群初始堆叠)。

➡ 价格上,DeepSeek 是「白菜价」,Claude 是「贵族价」——具体差距下一节用图说话。

一句话:DeepSeek V4 是「快糙猛但漂亮」,Claude Opus 4.7 是「慢工细活面面俱到」。日常视觉原型 DeepSeek 完全够用;要严格按需求清单交付的活儿,Opus 还是稳。

2|两位选手的硬实力

DeepSeek V4(2026 年 4 月发布)

-

V4-Pro:1.6T 总参数 / 49B 激活,1M 上下文

-

V4-Flash:284B 总参数 / 13B 激活,1M 上下文

-

双模式:Thinking / Non-Thinking,思考强度通过 reasoning_effort=high|max 调节

编码 benchmark:Vals AI Vibe Code 开源权重模型第一,CodeForces Rating 3206(人类排名 #23)

Claude Opus 4.7

-

Anthropic 当前旗舰,最强代码 + 推理表现

-

200K 上下文,Thinking 模式默认开启

-

2026 年 4 月发布,价格沿用 Opus 4.6 一致档位

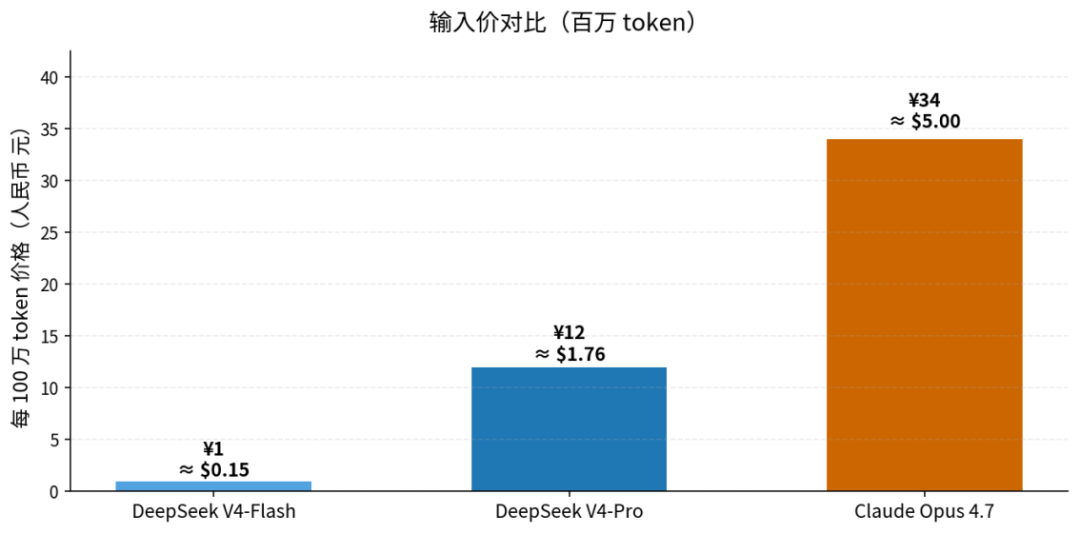

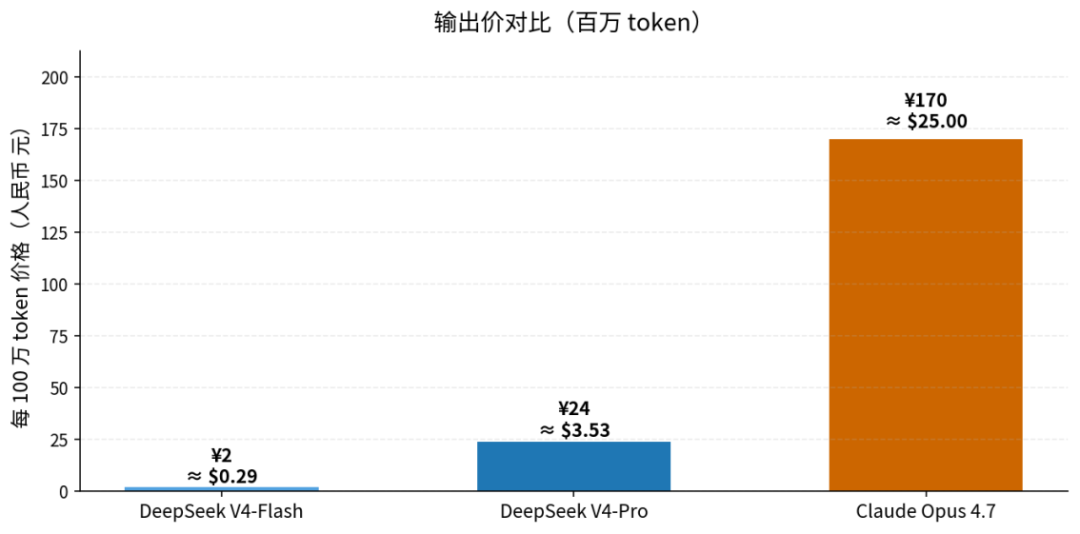

3|价格对比(敲黑板)

官方 API 公开价(每百万 token,2026 年 5 月,汇率取 1 美元 ≈ 6.80 元):

-

DeepSeek V4-Pro:输入 12 元(约 $1.76)/输出 24 元(约 $3.53)

-

DeepSeek V4-Flash:输入 1 元(约 $0.15)/输出 2 元(约 $0.29)

-

Claude Opus 4.7:输入 $5(约 34 元)/输出 $25(约 170 元)

画成柱状图直观一点:

注:DeepSeek 还有「缓存命中」减价(V4-Pro 输入降到 1 元、V4-Flash 降到 0.2 元),跑 Agent 类高频复用 prompt 时实际花费会比上图更低。Claude 也有 Prompt Caching,最大可省 90%,但起步价仍然高一档。

4|测试方法

6 道精选题分两类:

-

4 道视觉效果题:3D 地球、黑洞、樱花、沸腾火锅

-

1 道物理感题:鱼群(Boids 群聚)

-

1 道完整小游戏:Flappy Bird

每题在干净独立目录跑,全开思考、统一要求 Write 工具落盘 output.html,禁止启动 dev server / 安装包。两个模型用完全相同的 prompt。

5|逐题对比(看动图)

下面每一对动图都是直接录的:左 DeepSeek V4,右 Claude Opus 4.7。每题先简单说一下题目要求,再放观感。

题 01 | 3D 地球

题目简介:题目要求:全屏黑色宇宙 + 至少 200 颗闪烁星点 + 中央一颗自动旋转的 3D 地球(24 秒一周),大陆轮廓真实可辨认,云层独立旋转,大气层光晕(边缘蓝、太阳侧更亮),夜晚一侧有城市灯光;鼠标拖动可手动旋转、滚轮 0.5–3 倍缩放。

DeepSeek V4

Claude Opus 4.7

图:DeepSeek 用了夜景贴图(看上去更精致),Claude 在 canvas 上自己画大陆。

DeepSeek 的地球第一眼很惊艳——直接拉了张地球贴图上去,海洋陆地的色彩饱满。但仔细看,整颗地球都点亮了城市灯光:日间侧也有大片暖黄色光点。题目要求是「夜晚一侧有城市灯光」——DeepSeek 偷懒直接拿了张「夜景版」贴图当 albedo,整颗星球都成了「夜面」,反而违反了原题。

Claude 这边没用贴图——它在 canvas 里程序化绘制大陆轮廓(亚洲、非洲、美洲都看得出),云层独立旋转、大气层光晕、夜灯只在背日侧亮,要求清单上的每一条都打钩。代价就是「不那么像 NASA 真实照片」,更像一颗「示意版地球」。

总体:DeepSeek 更美观,但没完全满足需求;Claude 不漂亮但要求都做到位。

题 02 | 黑洞漩涡

题目简介:题目要求:黑色宇宙 + 800+ 闪烁星 + 中央黑洞,事件视界为黑圆,外面一圈带辉光的吸积盘(橙红→黄→紫渐变),盘面快速旋转;1500+ 粒子被吸入,鼠标移动可改变黑洞位置、滚轮调整黑洞质量、点击释放粒子。

DeepSeek V4

Claude Opus 4.7

图:吸积盘风格不同,DeepSeek 偏旋转色带,Claude 偏多层光晕 + 螺旋臂。

黑洞这题两边都基本满足要求:黑色事件视界 + 周围环状吸积盘 + 粒子被吸入 + 鼠标交互调整黑洞质量。视觉风格不同但都说得过去——DeepSeek 的吸积盘有清晰旋转色带,更有「转动感」;Claude 是同心圆光晕配螺旋臂粒子分布,更接近真实星系照片。

这题见仁见智,两边都能用。

题 03 | 樱花飘落

题目简介:题目要求:樱花飘落动画,背景渐变天空 + 远景树枝。500+ 花瓣从树枝飘落,沿正弦摆动并自旋;地面会堆积花瓣;鼠标移动产生风扰动;点击触发一阵花瓣爆发。

DeepSeek V4

Claude Opus 4.7

图:Claude 樱花更接近真实形态但画面有抖;DeepSeek 美观差点意思但运动稳。

Claude 这一版的樱花颜色和形态更接近实物——粉白渐变、花瓣轮廓有锯齿感,更有「樱花的样子」。但播放时整个画面会有轻微的随机抖动,疑似时间步长或视图矩阵的小 bug。

DeepSeek 的樱花没那么美——花瓣造型偏简单,颜色也单调一点。但它的运动更稳:飘落轨迹平滑,没有抖动。

想截图发朋友圈,挑 Claude;想做循环播放的背景动效,DeepSeek 反而稳。

题 04 | 沸腾火锅

题目简介:题目要求:中央一口红色铜锅,锅里翻滚气泡(5–40px、上升膨胀、破裂"啵"扩散),锅口飘半透明米白蒸汽,锅内漂 3–5 个食材轻微震动,锅下面 4–6 道红黄渐变摇摆火焰;点击锅多冒一波气泡。

DeepSeek V4

Claude Opus 4.7

图:Claude 火焰、气泡、蒸汽都有;DeepSeek 漏火焰,气泡和透视都不对。

题目要求里写得很明白:「锅下面 4-6 道火焰」「锅里冒气泡」「锅口飘蒸汽」。Claude 三样都做了,但有个小毛病——气泡有时会「漂出」锅边、跑到画面外的位置,明显是没做边界裁剪。

DeepSeek 这题翻车明显:火焰没画,锅与汤面的透视关系也错了(俯视的锅却画了从侧面看的汤面),气泡虽然在水面但渲染效果非常糙。视觉给人一种「半成品」的感觉。

功能完整度看 Claude,DeepSeek 这题可以打个不及格。

题 05 | 鱼群(Boids)

题目简介:题目要求:海蓝渐变背景 + 80+ 条鱼用 Boids 群聚算法(分离/对齐/凝聚)游动,至少 3 种鱼形态/尺寸;鼠标移动鱼群跟随,点击释放饵料让鱼群聚集;少量气泡 + 海草。

DeepSeek V4

Claude Opus 4.7

图:Claude 鱼造型精致但初始挤成一坨;DeepSeek 鱼简化但分布舒展。

Claude 的鱼造型很精致——身段、鱼鳍都画了,颜色多样。但初始位置算法有问题:80 多条鱼一开始几乎全堆在屏幕中央,重叠严重,要等几秒群聚算法才把它们散开。

DeepSeek 的鱼造型简单(基本就是一个椭圆 + 三角尾巴),但功能上 Boids 群聚算法跑得正常,初始分布也舒展,从开始播放就好看。

美观看 Claude(再耐心看几秒),观感舒服看 DeepSeek。

题 06 | Flappy Bird

题目简介:题目要求:复刻 Flappy Bird——空格/点击让小鸟跳跃,穿过随机管道间隙得分,撞管道或落地游戏结束;卷轴背景 + 计分 + 历史最高分。

DeepSeek

Claude Opus 4.7

图:两边游戏都能玩,Claude 美术更精致。

Flappy Bird 这种小游戏两边都能完整实现:小鸟、管道、跳跃、得分、碰撞结束都齐活。差距在美术——Claude 的小鸟造型、管道材质、背景渐变都更用心;DeepSeek 是「能玩但糙」。

能跑就行选 DeepSeek,要交付选 Claude。

6|实战中的 DeepSeek V4 怎么用

看完上面 6 道题,我的判断:

✅ DeepSeek V4 适合的场景

-

视觉效果原型:粒子、3D 渲染、动画——颜值在线,价格 1/85 起,做 demo 最佳。

-

中等代码量任务(< 500 行):日常工具脚本、组件、API 接入。

-

大上下文检索 + 重写:1M context 是真的有用,能塞下整个中型仓库。

-

高频调用 / Agent 跑批:单次成本几乎可以忽略,思考又能开。

⚠️ 还是要 Opus 4.7 的场景

-

严格按需求清单交付:每条 bullet 都要打钩的产品级任务(题目 01 地球、04 火锅那种)。

-

工具链整合(多文件 / 多步 tool call):Opus 的指令遵循 + 工具调用更稳。

-

复杂业务推理(金融 / 法律 / 多约束求解):Opus 仍有边际优势。

7|测试只是参考

在你把这篇文章的结论搬去做选型决策之前,先看一下这次测试覆盖的边界:

-

这 6 道题集中在「Canvas / Three.js 视觉效果 + 小游戏」这一类——属于单文件、自包含、写完就能看到结果的任务。

-

它们考的是「美术 + 简单交互 + 一些物理 / 算法 + 跟着 spec 打钩」。

-

它们没考察的东西远比考察了的多:长链路代码重构、复杂业务建模、SQL / 数据分析、多文件协同改动、Agent 工作流(多轮 tool call)、长会话上下文管理、文档生成、API 设计与文档化、Code Review、安全审计、生产代码可维护性……

换句话说,这套测试只能告诉你「在写漂亮的 HTML 动画这件事上,谁更行」,告诉不了你「在你公司那个 50 万行的代码库里,谁更行」。

所以请把这篇文章的所有结论当作「能力切片」来看,而不是「整体排名」。一个模型在视觉题表现好,不代表它在你正在做的具体任务上一定好;反过来也一样。

我自己的建议:与其相信任何外部 benchmark(包括这一篇),不如花一个下午,从你自己实际工作里挑 5-10 个真实任务,做一份「私人 benchmark」。两个候选模型都跑一遍,结果会比看任何评测都更靠谱。

8|尾声

DeepSeek V4 不是「开源平替」,它就是当前价位最猛的代码模型——颜值在线、思考能开、上下文又长。如果你的工作流原来用 Opus 4.7,先把 V4-Pro 接进去跑一周——很可能 80% 的任务你会舍不得切回去。剩下 20% 较真的活儿,再请 Opus 出场也不迟。

后台回复关键词「DeepSeekv4横评」,可领取这次评测全部 14 道题的 prompt + 两个模型的 baseline HTML 文件

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)