AI推理模型工程2026:从o3到DeepSeek-R1的工程化落地实践

推理模型(Reasoning Model)正在重新定义AI应用的边界。当OpenAI o3在ARC-AGI测试上突破人类基准,当DeepSeek-R1以极低成本实现顶级推理能力,工程师们面临的问题已经不是"推理模型能做什么",而是"怎么把推理模型用好、用对、用便宜"。

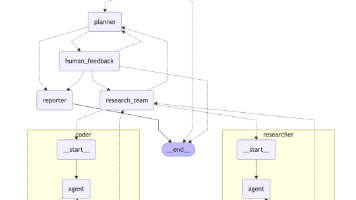

本文从工程实践角度,深入剖析推理模型的核心机制、应用场景选择、成本控制策略与生产部署最佳实践。## 什么是推理模型?与普通LLM的本质区别推理模型不是更大的LLM,而是引入了思维链强化学习(Chain-of-Thought RL)的新型训练范式。### 核心差异对比| 维度 | 普通LLM | 推理模型 ||------|---------|---------|| 输出方式 | 直接生成答案 | 先思考再回答(内部CoT) || 训练目标 | 语言建模 / SFT | 过程奖励 + 结果奖励 RL || 延迟特征 | 低延迟(秒级) | 高延迟(思考时间10s-数分钟) || 擅长任务 | 知识问答、文本生成 | 数学、代码、逻辑推理、规划 || Token消耗 | 标准 | 显著更高(思考Token) |### 代表性推理模型OpenAI系列:- o1:首代推理模型,引入"thinking tokens"概念- o3:重大升级,ARC-AGI得分超87%(人类均值85%)- o4-mini:轻量高效版,适合高频推理场景DeepSeek系列:- DeepSeek-R1:开源推理模型,AIME 2024满分,成本仅o1的1/20- DeepSeek-R1-Distill:蒸馏版本,7B/14B/32B可本地部署其他:- Claude 3.7 Sonnet(extended thinking模式)- Gemini 2.5 Pro(带thinking的版本)- Qwen QwQ-32B:阿里开源推理模型## 推理模型的技术原理### 强化学习驱动的思维链推理模型通过GRPO(Group Relative Policy Optimization)或PPO训练,核心思路:1. 生成多个思考路径(思维链)2. 对最终答案进行奖励评估(正确+1,错误-1)3. 用过程奖励模型(PRM)评估中间步骤质量4. 强化正确推理路径,惩罚错误路径训练流程:问题 → 生成N条思维链 → PRM打分 + 结果验证 → 策略梯度更新 → 模型学会"深度思考"### “顿悟时刻”(Aha Moment)DeepSeek团队在R1训练中观察到一个有趣现象:模型在RL训练中自发学会了回溯与自我修正:[模型内部思维]"让我先尝试方法A...""等等,这里有个问题..." ← 自发回溯"重新考虑,用方法B...""验证:B确实正确,最终答案是X"这种行为不是人工设计的,而是RL过程中自然涌现的。### 思考Token与预算控制推理模型引入了思考预算(Thinking Budget)概念:python# OpenAI o1/o3 APIresponse = client.chat.completions.create( model="o3", messages=[{"role": "user", "content": problem}], reasoning_effort="high" # low / medium / high)# Anthropic Claude 3.7(extended thinking)response = client.messages.create( model="claude-3-7-sonnet-20250219", max_tokens=16000, thinking={ "type": "enabled", "budget_tokens": 10000 # 思考Token预算 }, messages=[{"role": "user", "content": problem}])## 应用场景选择:什么时候用推理模型### 适合使用推理模型的场景1. 复杂数学与科学计算python# 竞赛数学、物理推导、统计分析problem = """证明:对于任意正整数n,n^2 + n + 41是素数当n<40成立,但n=40时该公式失效。请给出完整的证明与反例验证。"""# → 使用推理模型,普通LLM容易在证明步骤中出错2. 复杂代码调试与架构设计python# 多层嵌套bug、并发问题、性能优化prompt = """以下Python代码在高并发下会产生竞态条件,请找出所有潜在的线程安全问题并给出修复方案:[复杂并发代码]"""# → 推理模型能系统性枚举所有并发场景3. 多步骤规划与决策python# Agent任务规划、项目方案设计task = """设计一个支持10万并发用户的实时聊天系统,需要考虑:消息持久化、离线推送、消息顺序、群组功能。请给出完整的技术架构方案。"""4. 逻辑推理与法律/合规分析合同条款分析、风险评估、多条件判断→ 推理模型能系统性考虑所有条件分支### 不适合使用推理模型的场景- 简单问答:天气、常识问题,用普通LLM更快更便宜- 实时对话:推理延迟10s+,用户体验差- 大批量文本处理:摘要、翻译、格式转换,成本过高- 创意写作:推理模型在创意任务上并不比普通LLM强决策规则(简版):任务需要多步骤推导 AND (有明确正确答案 OR 需要系统性分析)→ 用推理模型否则 → 用普通LLM## 成本控制:推理模型的Token账单优化### 理解推理模型的Token消耗总Token = 思考Token(内部) + 输入Token + 输出Token示例:- 一个数学竞赛题:思考 ~5000 Token + 输入 200 + 输出 500- o3定价(假设):$15/M input, $60/M output- 单题成本:5000*0.06 + 200*0.015 + 500*0.06 ≈ $0.36### 成本优化策略策略1:推理努力级别(Reasoning Effort)分级pythondef choose_reasoning_effort(task_complexity: str) -> str: """根据任务复杂度选择推理努力级别""" if task_complexity == "simple": return "low" # 减少思考Token,节省60%以上成本 elif task_complexity == "medium": return "medium" else: return "high" # 复杂推理才用高级别# 实践中90%任务用low/medium即可满足需求策略2:混合模型路由(推理模型 + 普通LLM)pythonclass ModelRouter: def __init__(self): self.reasoning_model = "o3-mini" self.standard_model = "gpt-4o-mini" def route(self, query: str) -> str: """智能路由:只有复杂推理任务才用推理模型""" complexity = self.estimate_complexity(query) if complexity > 0.7: # 高复杂度阈值 return self.reasoning_model return self.standard_model def estimate_complexity(self, query: str) -> float: """简单规则判断复杂度""" keywords = ['证明', '推导', '分析', '优化', '设计架构', 'prove', 'derive', 'optimize', 'debug'] score = sum(1 for kw in keywords if kw in query.lower()) return min(score / 3, 1.0)策略3:缓存推理结果pythonimport hashlibimport jsonfrom functools import lru_cacheclass ReasoningCache: def __init__(self, redis_client): self.redis = redis_client self.ttl = 3600 * 24 # 24小时缓存 def get_or_compute(self, problem: str, model: str) -> str: cache_key = f"reasoning:{hashlib.md5(problem.encode()).hexdigest()}" cached = self.redis.get(cache_key) if cached: return json.loads(cached)['answer'] # 调用推理模型(昂贵) result = call_reasoning_model(problem, model) self.redis.setex(cache_key, self.ttl, json.dumps({'answer': result})) return result策略4:分解任务,只对核心子任务用推理pythondef solve_complex_problem(problem: str) -> str: # Step 1: 普通LLM分解问题(便宜) sub_problems = gpt4o_mini.decompose(problem) results = [] for sub in sub_problems: if sub['requires_reasoning']: # Step 2: 只对需要推理的子问题用推理模型 answer = o3_mini.solve(sub['content'], effort="medium") else: # 普通子任务用便宜模型 answer = gpt4o_mini.solve(sub['content']) results.append(answer) # Step 3: 普通LLM汇总结果(便宜) return gpt4o_mini.synthesize(results)## DeepSeek-R1本地部署实践### 环境要求| 模型 | 显存需求 | 推荐硬件 ||------|---------|---------|| DeepSeek-R1-7B-Distill | 16GB | RTX 4080 / A4000 || DeepSeek-R1-14B-Distill | 32GB | RTX 4090 / A6000 || DeepSeek-R1-32B-Distill | 80GB | A100 80G || DeepSeek-R1-671B(全量) | 1.3TB | H100 x8+ |### 使用vLLM部署R1蒸馏版bash# 安装vLLMpip install vllm# 启动推理服务(14B版本)python -m vllm.entrypoints.openai.api_server \ --model deepseek-ai/DeepSeek-R1-Distill-Qwen-14B \ --tensor-parallel-size 2 \ # 双卡 --max-model-len 32768 \ --reasoning-parser deepseek_r1 \ # 解析思维链 --served-model-name deepseek-r1-14b### Ollama本地部署(适合开发测试)bash# 拉取模型ollama pull deepseek-r1:14b# 运行(自动管理显存)ollama run deepseek-r1:14b# 通过API调用curl http://localhost:11434/api/generate \ -d '{ "model": "deepseek-r1:14b", "prompt": "证明√2是无理数", "stream": false }'### 处理思维链输出DeepSeek-R1的思维链用<think>标签包裹:pythonimport redef parse_r1_output(raw_output: str) -> dict: """解析DeepSeek-R1的输出,分离思维链和答案""" think_pattern = re.compile(r'<think>(.*?)</think>', re.DOTALL) think_match = think_pattern.search(raw_output) thinking = think_match.group(1).strip() if think_match else "" answer = think_pattern.sub('', raw_output).strip() return { 'thinking': thinking, 'answer': answer, 'thinking_length': len(thinking.split()) }# 使用示例result = call_model("DeepSeek-R1-14B", "解释量子纠缠的物理机制")parsed = parse_r1_output(result)print(f"思考过程({parsed['thinking_length']}词):{parsed['thinking'][:200]}...")print(f"最终答案:{parsed['answer']}")## 生产环境最佳实践### 1. 推理模型的超时处理pythonimport asynciofrom typing import Optionalasync def reasoning_with_timeout( problem: str, timeout_seconds: int = 120, fallback_model: str = "gpt-4o") -> str: """推理模型加超时回退""" try: result = await asyncio.wait_for( call_reasoning_model_async(problem), timeout=timeout_seconds ) return result except asyncio.TimeoutError: # 超时时回退到普通LLM,保证响应 print(f"推理超时(>{timeout_seconds}s),回退到{fallback_model}") return await call_standard_model_async( problem + "\n请给出最佳答案(无需详细推导)", model=fallback_model )### 2. 推理质量评估pythonclass ReasoningQualityEvaluator: """评估推理模型输出质量""" def evaluate(self, problem: str, solution: str, thinking: str) -> dict: # 检查思维链完整性 has_steps = any(kw in thinking for kw in ['首先', '然后', '因此', '综上', 'first', 'therefore']) # 检查自我修正 has_revision = any(kw in thinking for kw in ['等等', '重新', '修正', 'wait', 'actually', 'let me reconsider']) # 检查答案与推理一致性(调用验证LLM) consistency = self.check_consistency(problem, solution, thinking) return { 'has_coherent_steps': has_steps, 'shows_self_correction': has_revision, 'answer_consistency': consistency, 'thinking_depth': len(thinking) / 1000 # 粗略指标 }### 3. 监控推理成本pythonfrom dataclasses import dataclassfrom datetime import datetime@dataclassclass ReasoningCall: timestamp: datetime model: str input_tokens: int thinking_tokens: int output_tokens: int @property def total_cost_usd(self) -> float: """估算成本(以o3-mini定价为例)""" prices = { 'o3-mini': {'input': 1.1/1e6, 'output': 4.4/1e6}, 'o3': {'input': 10/1e6, 'output': 40/1e6}, } p = prices.get(self.model, prices['o3-mini']) return (self.input_tokens * p['input'] + (self.thinking_tokens + self.output_tokens) * p['output'])# 实时成本监控class ReasoningCostTracker: def __init__(self, daily_budget_usd: float = 10.0): self.budget = daily_budget_usd self.calls: list[ReasoningCall] = [] def add_call(self, call: ReasoningCall): self.calls.append(call) today_cost = sum(c.total_cost_usd for c in self.calls if c.timestamp.date() == datetime.now().date()) if today_cost > self.budget * 0.8: # 预算警告:切换到更便宜的推理模型 self.emit_budget_warning(today_cost)## 2026年推理模型应用展望1. 更廉价的推理:模型蒸馏+量化技术持续进步,7B推理模型将达到2024年o1水平2. 实时推理:思考速度优化,从"慢思考"走向"快慢结合"3. 多模态推理:图像+数学推理能力融合(o3已支持视觉推理)4. Agent原生推理:推理模型作为Agent的规划核心,取代传统ReAct循环5. 边缘推理:轻量推理模型在手机/嵌入式设备端运行## 总结推理模型不是万能药,工程师需要掌握:1. 识别适用场景:复杂推理 > 普通问答,不要为了用推理模型而用2. 控制成本:合理设置reasoning_effort,80%任务用low/medium足够3. 本地部署:DeepSeek-R1蒸馏版是成本敏感场景的最佳选择4. 生产保障:超时处理、回退策略、成本监控缺一不可5. 评估质量:推理链质量 > 最终答案正确性,过程才是价值所在推理模型代表的不仅是技术进步,更是AI应用从"快速响应"向"深度思考"转变的范式迁移。善用推理模型,才能构建真正能解决复杂问题的AI系统。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献79条内容

已为社区贡献79条内容

所有评论(0)