GitHub 狂揽 1.1 万 Star!22 岁开发者逆向 【Claude Mythos】,撕开闭源 AI 的黑箱

本文将完整拆解这场 AI 圈的现象级事件:从 Anthropic 雪藏的「最强黑箱模型」Claude Mythos,到 22 岁开发者用 600 行代码开源复现核心架构,再到这场开源狂欢背后,AI 行业正在发生的底层逻辑颠覆。

📖 文章目录

二、背景前置:Claude Mythos 到底是什么?AI 圈最神秘的「禁忌模型」

三、主角登场:22 岁的 Kye Gomez,用第一性原理拼出黑箱蓝图

四、核心拆解:OpenMythos 到底逆向出了什么?600 行代码重构 AI 思考逻辑

4.1 核心架构:循环深度 Transformer(RDT)—— 不盖高楼,原地跑圈

4.2 能力放大:MoE 动态路由 + 循环思考,770M 参数追平 1.3B 模型

4.3 核心代码:600 行 PyTorch 实现,人人可复现的架构创新

五、为什么它能爆火?1.1 万 Star 背后,戳中了行业的三大痛点

一、事件开篇:被雪藏的黑箱,被开源击穿的神话

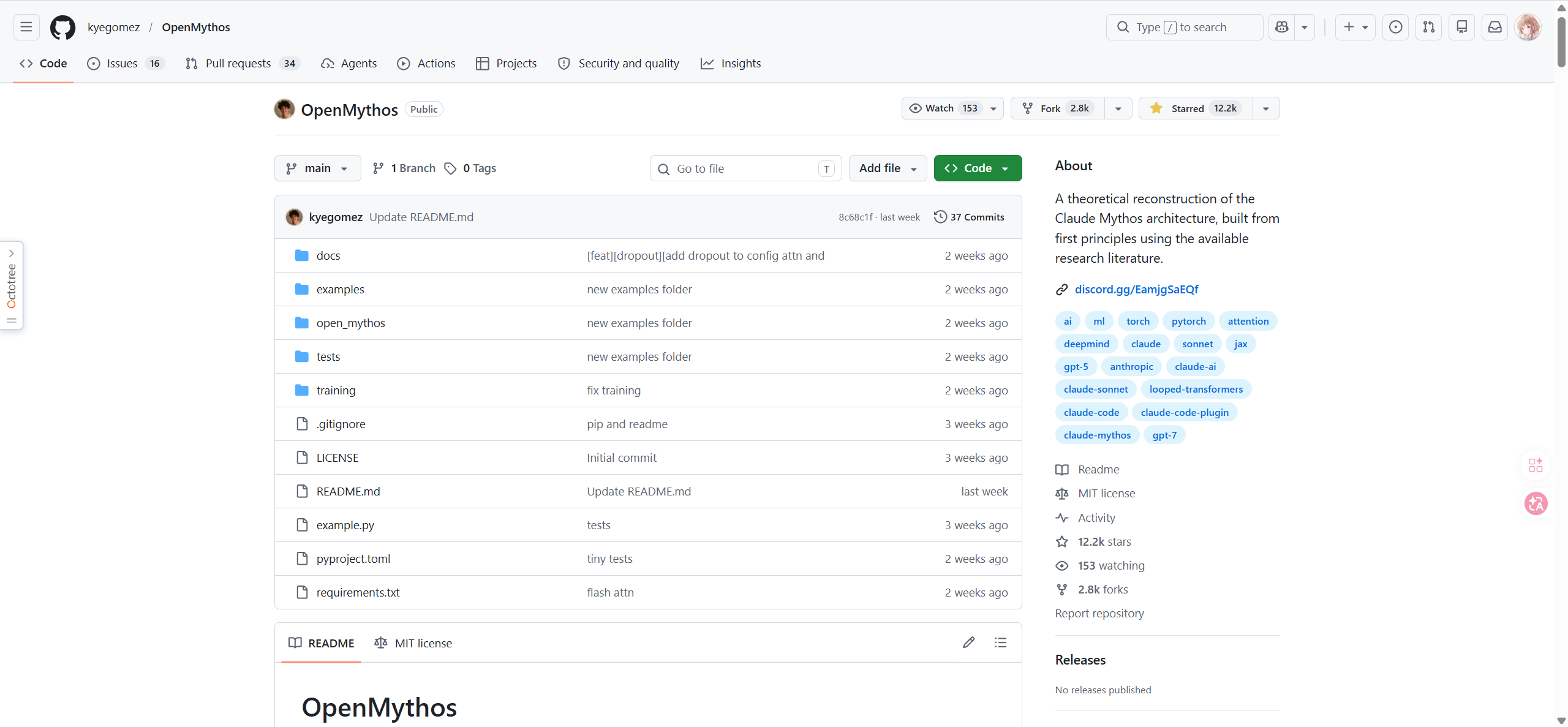

2026 年 4 月,AI 圈被一个开源项目彻底点燃:OpenMythos。

它的缔造者,是一位 22 岁的年轻开发者 Kye Gomez。他没有拿到 Anthropic 的内部泄密数据,没有破解 Claude Mythos 的权重文件,仅靠公开的学术论文、模型性能数据和行业技术线索,用第一性原理完成了对 Anthropic「雪藏神级模型」Claude Mythos 的理论重建与代码复现,并将全部代码开源到 GitHub。

项目上线 48 小时,狂揽 7300+ Star;上线两周,Star 数突破 1.1 万,Fork 数超 1500,相关讨论帖在 X、HackerNews、Reddit 等平台获得超百万次浏览,整个 AI 圈陷入了一场关于「闭源与开源」「Scaling 与架构创新」的集体狂欢。

而这场狂欢的起点,是 Anthropic 捂得像保险柜一样的 Claude Mythos—— 一个被官方称为「迄今为止构建的最强大模型」,却因能力过于危险被彻底雪藏,不对外发布、不公开技术细节、不开放任何测试权限,只留下零星的性能数据和行业猜测。

所有人都以为,这会是一个永远无法窥探的 AI 黑箱。直到这位 22 岁的开发者,用 600 行 PyTorch 代码,把巨头锁在保险柜里的核心架构,变成了人人可研究、可复现、可修改的开源项目。

二、背景前置:Claude Mythos 到底是什么?AI 圈最神秘的「禁忌模型」

在讲 OpenMythos 之前,我们必须先搞清楚:被逆向的 Claude Mythos,到底是个怎样的存在?

Claude Mythos 是 Anthropic 在 2026 年 3 月 RSAC 安全大会上曝光的内部代号为「Capybara」的模型,也是 Anthropic 迄今为止最神秘、最具争议的模型。它的核心标签只有两个:强到颠覆认知,危险到不敢发布。

| 核心能力维度 | Mythos 的恐怖表现 | 行业对比 |

|---|---|---|

| 网络安全漏洞挖掘 | 自主发现 OpenBSD 内核中隐藏 27 年的零日漏洞,FFmpeg 中 16 年未被发现的安全缺陷,单次运行成本不足 50 美元 | 顶尖白帽黑客需要数月完成的工作,它几分钟就能完成 |

| 超长程图推理 | GraphWalks BFS 超长上下文测试(256K-1M Token)准确率达到 80% | Claude Opus 4.6 仅 38.7%,GPT-5.4 仅 21.4%,差距达到跨代级 |

| 代码工程能力 | SWE-bench Pro 工业级代码修复任务准确率从 53.4% 跃升至 77.8% | 超越当前所有闭源模型,Token 消耗量仅为 Claude Opus 4.6 的五分之一 |

更让行业震惊的是,Anthropic 在曝光这个模型后,直接宣布将其「雪藏」—— 不对外发布、不开放 API、不公开任何技术文档,仅对外回应了一句「研究敏感信息」。架构、参数、训练方式、核心创新,全部被锁进了黑箱。

对于 AI 行业来说,这就像有人造出了一辆能突破音速的汽车,却只告诉所有人「它很快」,不展示发动机、不公布技术原理,甚至不让任何人坐上去体验。

而 Kye Gomez 做的事,就是通过这辆车的极速表现、风噪、油耗这些公开线索,硬生生推导出了发动机的核心设计,还把图纸开源给了所有人。

三、主角登场:22 岁的 Kye Gomez,用第一性原理拼出黑箱蓝图

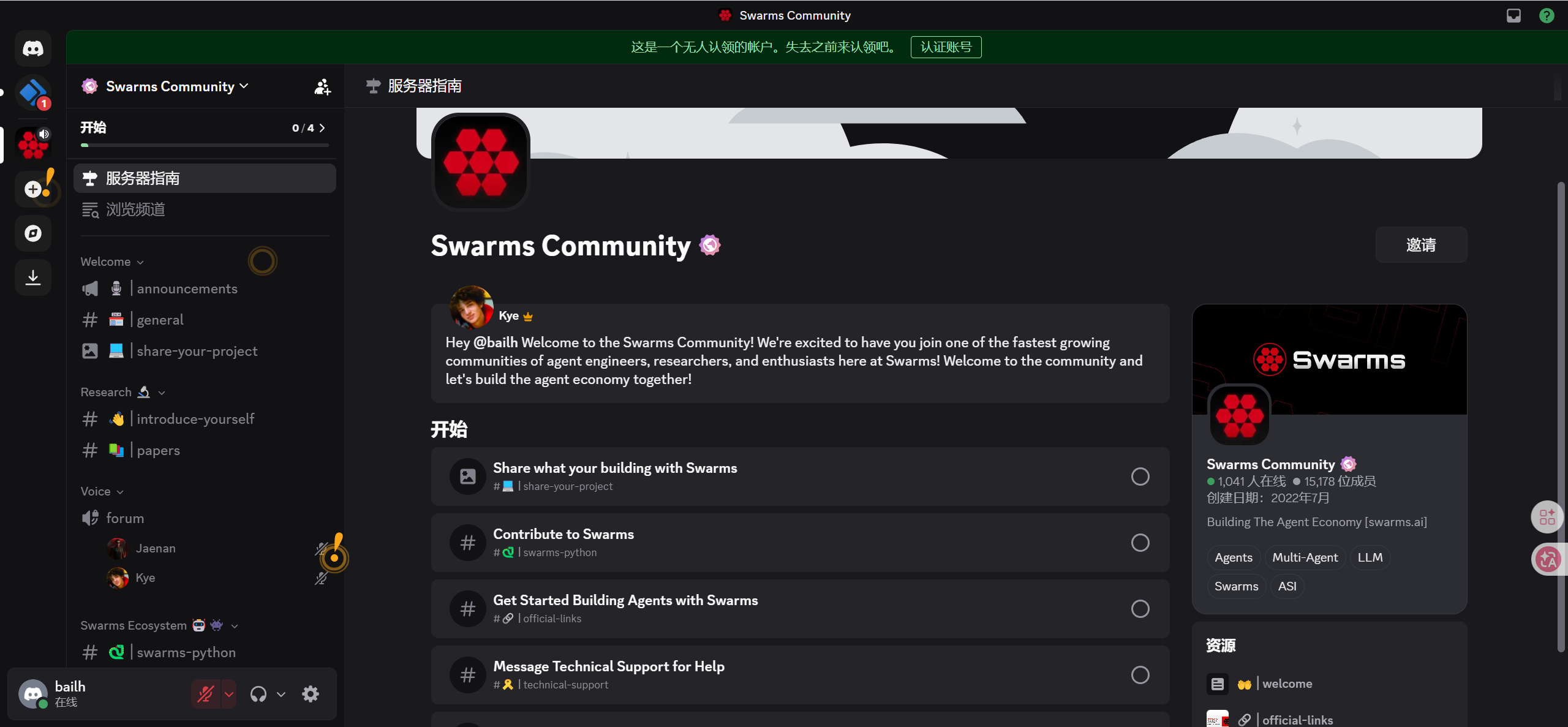

能完成这件看似不可能的事,Kye Gomez 从来不是什么突然冒出来的「民间黑客」,而是一位在 AI 领域深耕多年的连续创业者。

公开资料显示,这位 22 岁的开发者,10 岁开始写代码,13 岁就完成了自己的第一个 AI 模型,18 岁就登上媒体分享 AI 助手创业经验,如今是 AI 多智能体框架 Swarms 的创始人,GitHub 上拥有超过 400 个开源仓库,专注于 AI 模型实现、工程化框架与架构创新。

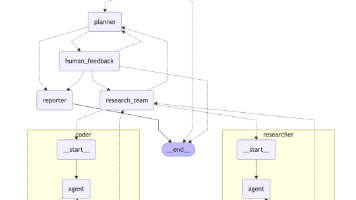

他的复现思路,从来不是「破解」「泄密」,而是第一性原理 + 公开信息拼图:

- 核心假设推导:通过 Mythos 的性能数据,他发现了一个关键矛盾 —— 模型能力实现了跨代级提升,但 Token 消耗量仅为前代 Opus 的五分之一。这意味着,Mythos 的强大绝对不是靠堆参数、堆层数实现的,而是采用了一种全新的、更高效的架构范式;

- 学术碎片整合:他整合了过去两年学术界关于循环 Transformer、混合专家(MoE)架构的所有公开研究,包括 UCSD 的 Parcae 循环训练论文、DeepSeek 的 MoE 路由优化成果,找到了能实现「低 Token 消耗、高推理能力」的唯一解;

- 理论重建与代码实现:基于推导的核心假设,他用两天时间完成了架构的理论重建,并用 PyTorch 实现了完整的代码,最终形成了 OpenMythos 项目。

在 GitHub 的 README 中,他直白地写下了项目的本质:这是一个基于第一性原理,对 Claude Mythos 架构的理论重建,不是泄露的模型,不是权重蒸馏,而是一个可证伪的、用代码实现的学术假设。

而正是这份「不靠泄密,纯靠推导」的硬核创新,让整个 AI 圈为之疯狂。

四、核心拆解:OpenMythos 到底逆向出了什么?600 行代码重构 AI 思考逻辑

OpenMythos 最炸裂的地方,不是它「复刻了 Mythos」,而是它推导出了 Mythos 能实现「低消耗、高能力」的核心密码 ——循环深度 Transformer(Recurrent-Depth Transformer, RDT),彻底推翻了过去 6 年 AI 行业「堆层数、堆参数」的 Scaling Law 铁律。

4.1 核心架构:循环深度 Transformer(RDT)—— 不盖高楼,原地跑圈

过去 6 年,所有主流大模型都遵循着同一个架构逻辑:标准 Transformer 的堆叠。想要模型能力更强,就堆更多的 Transformer 层,100 层不够就 200 层,200 层不够就 500 层。

这就像盖高楼,想要视野更好,就只能一层一层往上盖。带来的代价就是:参数爆炸、显存占用飙升、训练和推理成本指数级上涨。

而 RDT 架构,彻底换了一个思路:不盖高楼,原地跑圈。

它的核心逻辑一句话就能说清:模型不再堆叠数百层独立权重的 Transformer 层,而是只用一个核心计算块,在一次前向传播中,让数据在这个块里循环跑最多 16 次。每循环一次,就更新一次隐藏状态,相当于模型「多想了一步」。

表格

| 维度 | 标准 Transformer | 循环深度 Transformer(RDT) |

|---|---|---|

| 核心逻辑 | 多层堆叠,每层独立权重,依次执行 | 单层循环,同一套权重,多次迭代执行 |

| 表达能力 | k 层权重,仅能实现 k 层的表达能力 | k 层权重循环 L 次,等效 kL 层的表达能力,参数量仅为前者的 1/L |

| 显存占用 | 随层数线性增长,大模型需要顶级显卡 | 固定层数,循环次数不增加参数量,小显卡也能跑 |

| 推理成本 | 参数量越大,成本越高,指数级上涨 | 参数量固定,仅需调整循环次数,成本可控 |

最关键的是,所有的思考过程都在连续的潜空间里默默完成,不需要像思维链(CoT)那样把思考过程说出来,既保证了推理深度,又不会额外增加 Token 消耗 —— 这也完美解释了 Mythos 为什么能做到「能力翻倍,Token 消耗反而降到五分之一」。

4.2 能力放大:MoE 动态路由 + 循环思考,770M 参数追平 1.3B 模型

除了核心的 RDT 架构,OpenMythos 还复现了 Mythos 的第二个核心创新:与循环深度绑定的混合专家(MoE)路由机制。

简单来说,模型在每一次循环迭代中,会根据当前的任务难度,动态激活对应的专家模块:简单任务只激活少量轻量专家,复杂任务则激活更多专业专家,实现「简单题少转几圈,难题多转几圈」的动态适配。

这套组合拳带来的效果是颠覆性的:

- OpenMythos 的 770M 参数版本,就能实现 1.3B 参数标准 Transformer 的等效表达能力;

- 在多步数学推理、代码生成任务上,同参数量级下,碾压所有传统 Transformer 竞品;

- 支持最高 16 次循环迭代,可根据任务难度自由调整推理深度,兼顾速度与精度。

4.3 核心代码:600 行 PyTorch 实现,人人可复现的架构创新

最让行业震惊的是,这套颠覆了 Scaling Law 的架构,Kye Gomez 只用了600 行左右的 PyTorch 代码就完整实现了,没有复杂的工程依赖,没有苛刻的环境要求,任何开发者都能拉取代码、复现、修改和二次开发。

核心代码的极简骨架如下(可直接运行):

import torch

import torch.nn as nn

from torch.nn import functional as F

# 循环Transformer核心块

class RecurrentTransformerBlock(nn.Module):

def __init__(self, dim, num_heads, num_experts, expert_dim):

super().__init__()

self.attention = nn.MultiheadAttention(dim, num_heads, batch_first=True)

self.norm1 = nn.LayerNorm(dim)

# MoE混合专家层

self.experts = nn.ModuleList([nn.Linear(dim, expert_dim) for _ in range(num_experts)])

self.gate = nn.Linear(dim, num_experts)

self.norm2 = nn.LayerNorm(dim)

self.feed_forward = nn.Sequential(

nn.Linear(dim, dim * 4),

nn.GELU(),

nn.Linear(dim * 4, dim)

)

def forward(self, x, hidden_state=None):

# 注意力层 + 残差连接

attn_out, _ = self.attention(x, x, x)

x = self.norm1(x + attn_out)

# MoE动态专家路由

gate_scores = F.softmax(self.gate(x), dim=-1)

expert_outputs = torch.stack([expert(x) for expert in self.experts], dim=-1)

moe_out = torch.sum(expert_outputs * gate_scores.unsqueeze(-2), dim=-1)

moe_out = self.feed_forward(moe_out)

# 更新隐藏状态,用于下一次循环

x = self.norm2(x + moe_out)

new_hidden = hidden_state + x if hidden_state is not None else x

return x, new_hidden

# OpenMythos主模型

class OpenMythos(nn.Module):

def __init__(self, vocab_size, dim=512, num_heads=8, num_experts=4, expert_dim=2048, max_loop=16):

super().__init__()

self.token_embedding = nn.Embedding(vocab_size, dim)

self.pos_embedding = nn.Embedding(1024, dim)

self.core_block = RecurrentTransformerBlock(dim, num_heads, num_experts, expert_dim)

self.max_loop = max_loop

self.head = nn.Linear(dim, vocab_size)

def forward(self, x, loop_steps=None):

# 词嵌入与位置编码

batch_size, seq_len = x.shape

x = self.token_embedding(x)

x = x + self.pos_embedding(torch.arange(seq_len, device=x.device))

# 循环迭代思考,默认使用max_loop,可自定义循环次数

loop_steps = loop_steps or self.max_loop

hidden_state = None

for _ in range(loop_steps):

x, hidden_state = self.core_block(x, hidden_state)

# 输出预测

return self.head(x)

正是这份极简、硬核、可复现的代码,让 OpenMythos 从一个学术假设,变成了所有开发者都能上手的工具,也让整个行业看到了 AI 架构创新的全新可能。

五、为什么它能爆火?1.1 万 Star 背后,戳中了行业的三大痛点

一个理论重建的开源项目,能在短短两周内拿下 1.1 万 Star,绝不仅仅是因为「逆向了 Claude Mythos」这个噱头。它的爆火,本质上是因为它精准戳中了当前 AI 行业最痛的三个痛点。

1. Scaling Law 走到尽头,行业陷入了增长焦虑

过去 6 年,AI 行业的发展完全被 Scaling Law 绑架:想要模型更强,就只能堆更多的参数、更多的算力、更多的数据。但到了 2026 年,这条路已经走到了尽头:

- 高质量训练数据即将耗尽,GPT-5 已经爬遍了全网的高质量文本,甚至付费买断了全球几十家头部媒体的内容库;

- 训练成本已经触达经济极限,GPT-5 训练花了 30 亿美元,下一代模型按规模推算需要 100-150 亿美元,超过了 OpenAI 一年的总营收;

- 能力提升的边际效益断崖式下跌,GPT-4 到 GPT-5 的能力跃迁,已经远小于 GPT-3 到 GPT-4,花 100 亿做出一个领先 5% 的模型,已经成了一笔算不过来的账。

而 OpenMythos 的出现,给行业指了一条全新的路:不用堆参数、堆算力,靠架构创新,就能实现能力和效率的双重提升。这对于陷入增长焦虑的整个 AI 行业来说,无异于一剂强心针。

2. 闭源巨头的黑箱垄断,让行业创新陷入停滞

从 GPT-4 到 Claude Mythos,头部闭源厂商的模型越来越像一个黑箱:只告诉你它能做什么,不告诉你它是怎么做的;只给你开放 API 调用,不开放任何技术细节、架构设计、训练方法。

整个 AI 行业的创新,正在陷入「巨头发布新模型,全行业跟着做微调」的怪圈,底层架构创新几乎停滞。所有人都在巨头划定的 Scaling Law 框架里内卷,却没人能看到黑箱里的真正创新。

而 OpenMythos 的出现,打破了这种黑箱垄断:它用公开的学术研究,推导出了巨头藏起来的架构创新,还把它开源给了所有人,让中小团队、个人开发者,也能接触到最前沿的模型架构创新,而不是只能做巨头生态里的「微调玩家」。

3. 开源社区需要真正的创新,而不是大厂的「开源施舍」

过去两年,开源大模型的发展,始终在「追赶闭源模型」的路上:大厂发布闭源模型,开源社区跟着做蒸馏、做复刻,始终在闭源厂商的身后追赶,几乎没有真正的底层架构创新。

而 OpenMythos 是一次完全不同的开源创新:它不是对闭源模型的蒸馏、微调、复刻,而是从第一性原理出发,完成了对前沿架构的理论重建和代码实现,甚至走在了闭源厂商的技术公开之前。

它向整个行业证明了:开源社区不只能做闭源模型的「追随者」,也能做前沿架构的「探索者」和「创新者」。这也是为什么全球无数开发者为这个项目 Star、Fork、贡献代码的核心原因 —— 它代表了开源 AI 的真正精神。

六、行业震荡:闭源巨头的护城河,正在被架构创新瓦解

OpenMythos 的爆火,绝不仅仅是一个开源项目的成功,它正在动摇整个 AI 行业的底层游戏规则。

过去,闭源 AI 巨头的核心护城河,无非三个:海量的资金、顶级的算力、垄断的高质量数据。它们靠着这三大优势,堆出了更大的模型、更强的能力,形成了对开源社区的碾压级优势。

但 OpenMythos 的出现,证明了一件事:当架构创新能让 770M 参数的模型,追平 1.3B 参数模型的能力时,堆参数、堆算力的护城河,就已经开始瓦解了。

未来的 AI 竞争,不再是「谁能花更多的钱,训练更大的模型」,而是「谁能做出更高效、更创新的架构,用更低的成本实现更强的能力」。闭源巨头靠资金和算力堆起来的壁垒,正在被架构创新一点点击穿。

Anthropic 对这个项目的反应,也印证了这一点。面对社区的疯狂追问,Anthropic 始终没有正面回应 OpenMythos 的架构是否与 Claude Mythos 一致,仅用「研究敏感信息」一笔带过。而业内人士普遍认为,OpenMythos 的核心假设,已经无限接近 Mythos 的真实架构。

更重要的是,这个项目正在掀起一场 AI 架构创新的开源狂欢。项目开源后,短短两周内,社区已经基于它衍生出了数十个优化版本,有人把它适配到了消费级显卡,有人优化了循环训练的稳定性,有人把它和多模态能力结合,形成了一场全民参与的架构创新运动。

七、写在最后:开源的本质,是对 AI 创新的回归

OpenMythos 的 1.1 万 Star,从来不是给「破解神话」的奖励,而是给「开源创新」的致敬。

这个项目最珍贵的地方,从来不是它「逆向了 Claude Mythos」,而是它向整个行业证明了:AI 创新的核心,从来不是堆钱、堆算力、堆参数,而是对 AI「思考本质」的探索。

从 Transformer 诞生的那天起,AI 行业就走上了 Scaling Law 的快车道,所有人都在疯狂堆规模,却很少有人停下来思考:AI 的推理能力,真的只能靠堆叠层数来实现吗?

而 OpenMythos 给出了一个否定的答案。它用 600 行代码告诉我们:AI 的思考,和人类的思考一样,不是靠大脑变得越来越大,而是靠对同一个问题,进行更深层次的循环思考、反复迭代。

对于整个 AI 行业来说,这或许才是真正的未来。当 Scaling Law 走到尽头,当闭源巨头的黑箱垄断被打破,AI 创新的下一个时代,一定属于那些敢于突破框架、探索本质的架构创新,属于开源社区里,每一个用代码改变世界的开发者。

毕竟,AI 最珍贵的,从来不是越来越大的参数规模,而是人类对智能本质永不停歇的探索。

参考链接:

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献157条内容

已为社区贡献157条内容

所有评论(0)