从Ollama到MLX到端侧Agent:本地AI生态成熟度分析

2026年,本地AI已经不是极客的玩具。M4系列芯片的统一内存架构让消费级硬件流畅运行7B甚至14B模型,推理框架的易用性也在过去两年有了质的提升。但"模型能跑"和"能解决问题"之间,仍然隔着一整条技术栈。

本文系统梳理本地AI生态的三层结构——推理框架层、模型生态层、应用层——并对每层的成熟度做一次诚实的评估。

一、推理框架层:三足鼎立

本地推理框架经过两年演化,形成了llama.cpp、Ollama和MLX为核心的三足格局。

llama.cpp:跨平台基石

llama.cpp是整个本地AI生态的底座。从2023年初Georgi Gerganov的纯CPU推理代码,到今天支持CUDA、Metal、Vulkan多后端的完整引擎,它的核心价值是跨平台覆盖和极致量化支持。

./llama-server -m models/qwen2.5-7b-q4_k_m.gguf \

--host 0.0.0.0 --port 8080 -ngl 99 -c 8192

GGUF格式已是事实标准。从Q2_K到Q8_0的各种量化方案,开发者可以在精度和内存之间精细权衡。HuggingFace上几乎所有主流开源模型都有社区维护的GGUF版本。

成熟度:Production-ready。API兼容OpenAI格式,生态完善,性能稳定。缺点是编译配置有门槛。

Ollama:体验标杆

Ollama本质上是llama.cpp的封装,但它把"下载→配置→启动"压缩到一条命令:

ollama run qwen2.5:7b

不挑平台,不挑硬件,上手门槛极低,OpenAI兼容API让现有应用零修改切换到本地推理。过去一年它已经成为开发者本地跑模型的首选入口。

成熟度:Production-ready。局限在于通用方案无法针对特定硬件极致优化,Apple Silicon上性能不如MLX。

MLX:Apple Silicon原生

MLX是Apple机器学习研究团队2023年底推出的框架,原生为Apple Silicon设计,直接利用统一内存和Metal GPU加速。

from mlx_lm import load, generate

model, tokenizer = load("mlx-community/Qwen2.5-7B-Instruct-4bit")

response = generate(model, tokenizer, prompt="解释量化推理的原理", max_tokens=512)

统一内存的优势:CPU和GPU共享物理内存,模型加载后无需跨设备拷贝。M4 Pro的36GB统一内存可流畅运行14B Q4模型,M4 Max的128GB甚至可以跑70B。MLX的lazy evaluation机制为批处理和流式生成提供了额外优化空间。

成熟度:Production-ready(Apple Silicon限定)。macOS生态内推理性能显著优于通过Metal后端的llama.cpp。局限是仅支持Apple硬件。

三者定位对比

| 维度 | llama.cpp | Ollama | MLX |

|---|---|---|---|

| 平台 | 全平台 | 全平台 | macOS/iOS |

| 硬件优化 | 多后端适配 | 依赖llama.cpp | Apple Silicon原生 |

| 上手门槛 | 中(需编译) | 极低 | 低(pip install) |

| 量化格式 | GGUF | GGUF | MLX safetensors |

| Apple Silicon性能 | 良好 | 良好 | 最优 |

二、模型生态层:丰富但碎片化

GGUF格式是跨平台量化的标准。HuggingFace上几乎每个热门模型都有Q4_K_M到Q8_0的全系列量化版本,新模型发布后通常几小时内就能找到可用的GGUF。

MLX格式在Apple生态内快速增长。mlx-community在HuggingFace上维护了数百个预转换模型,覆盖Qwen、Llama、Mistral、Gemma等主流系列。

能力方面,7B Q4量化模型在代码生成、文本摘要、对话等任务上已达实用水平。以Qwen2.5-7B-Instruct为例,Q4_K_M量化后模型体积约4.5GB,在M4 Pro上decode速度稳定在60-80 tokens/s,日常编码辅助和文档处理完全够用。14B级别在推理和复杂指令跟随上更进一步,代价是内存占用翻倍、推理速度减半。

但本地模型在长链条推理、多模态理解等维度,距离云端大模型仍有明显差距。这不只是参数量的问题,还涉及训练数据规模、RLHF调优深度等因素。

成熟度:Production-ready(特定任务)。代码补全、文本生成、简单问答可用;复杂推理仍依赖云端。

三、应用层:从推理到Agent

前两层成熟后,更大的问题浮出水面:模型能跑了,然后呢?

答案是Agent——让模型主动感知环境、规划步骤、调用工具、完成任务。这是本地AI生态中成熟度最低但想象力最大的一层。

为什么Agent适合本地

Agent需要访问用户的本地环境:读文件、操作应用、调用系统API、控制浏览器。这些动作天然在本地执行,发到云端反而多一层远程控制的复杂度。隐私也是关键因素——Agent执行任务时接触大量个人数据(邮件、文件、浏览记录),全部上传到云端处理意味着数量级的隐私风险放大。本地Agent让数据始终在设备上闭环。

核心技术挑战

- 环境感知:Agent如何"看到"屏幕内容?OCR准确率、UI元素识别、布局理解是视觉感知的基础。

- 动作执行:点击、输入、滚动——操作系统的无障碍API提供了部分能力,但覆盖度因应用而异。

- 规划与纠错:多步任务中的路径规划、失败检测和回退策略,对模型推理能力要求很高。

- 延迟:本地推理速度直接影响交互体验。等3秒还是0.3秒,决定了产品能不能用。

成熟度:Early Production。简单任务(打开应用、填表单、固定流程)可靠完成;复杂任务(跨应用工作流、需要判断的流程)成功率还在爬升。

四、Apple Silicon的结构性优势

统一内存:模型权重加载一次即可被CPU/GPU/Neural Engine共同访问,省去传统架构的数据拷贝。M4 Pro 24GB可完整加载7B Q4模型并保留充足KV Cache空间。

Metal Compute:为矩阵运算提供GPU级并行计算,MLX的矩阵乘法和注意力计算全部跑在GPU上。

能效比:M4系列在推理场景的每瓦性能远超同价位x86+独显。Mac mini跑7B模型一整天功耗不到30W,"Always-on本地AI"由此成为现实。

Neural Engine:16核ANE提供38 TOPS算力,目前在LLM推理中利用率不高,未来可能扮演更重要角色。

五、2026本地AI真实成熟度

已成熟,可日常依赖:

- 本地7B-14B模型做对话、代码补全、文本处理

- API集成到开发工作流(IDE插件、命令行工具)

- 简单自动化任务(文件整理、信息提取)

- 离线可用,数据不出设备

可用但有局限:

- 端侧Agent的GUI操作(简单流程可靠,复杂流程待提升)

- 多模态本地理解(能力快速提升中,精度不及云端)

还不成熟:

- 复杂多步推理的本地完成

- 跨应用通用Agent协调

- 模型本地微调(受内存和训练框架限制)

本地AI不是云端的替代品,而是互补关系。实际工程中合理的架构是混合式:隐私敏感、延迟敏感、高频调用的任务跑本地(如代码补全、文件处理、GUI操作),需要深度推理和大规模知识检索的任务走云端,两者通过统一的API接口无缝切换。开发者不必二选一,关键是为每类任务选择合适的执行位置。

实践参考:Mano-P

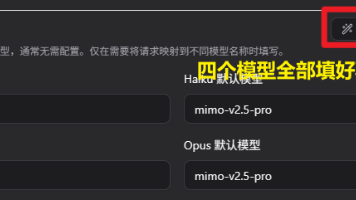

我们开源了端侧GUI Agent项目Mano-P,在上述生态上构建完整的应用层实现。Mano-P基于MLX框架运行在Apple Silicon上,采用纯视觉驱动方式操作macOS——截屏理解界面,规划步骤,调用系统API执行操作。所有推理在本地完成,不向外部发送用户数据。

4B量化版本在M4 Pro上:prefill 476 tokens/s,decode 76 tokens/s,峰值内存4.3GB。OSWorld基准测试准确率58.2%(排名第一)。Apache 2.0开源。

brew tap HanningWang/tap && brew install mano-cua

GitHub:https://github.com/Mininglamp-AI/Mano-P

推理加速组件Cider同样基于MLX构建,为端侧多模态模型提供优化推理管线。欢迎⭐

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)