深度拆解:AniShort如何用“节点式工作流“重构AI短剧工业化生产

一、一个被忽视的产业拐点

2024年被称为"AI视频元年"。Sora、Runway、Pika轮番轰炸,但一个诡异的现象出现了:

技术越进步,创作者越焦虑。

为什么?因为工具链的碎片化达到了荒诞的程度。一位从业者向我描述他的日常:

"早上用Claude写剧本,中午在Midjourney跑角色图,下午去Runway生成视频片段,晚上在剪映里手动对齐口型,凌晨用微信把成片发给甲方,第二天收到60秒语音反馈:'感觉不对,重来。'"

这不是创作,这是数字时代的体力劳动。

直到我在南通AI短剧产业大会上看到AniShort的演示,意识到行业可能找到了从"单兵作战"到"工业化流水线"的跃迁路径。

二、核心命题:AI短剧为什么必须"工业化"?

要理解AniShort的价值,先要理解AI短剧产业的三重矛盾:

矛盾一:爆发的内容需求 vs 低下的生产效率

据AniShort平台数据,当前短剧市场总规模已超168亿,年上线剧集6万+部。但AI短剧的产能远未释放——单条视频平均制作周期仍长达3-7天。

矛盾二:极致的个性化需求 vs 不可控的AI随机性

观众对角色"脸盲"零容忍。第4集男主换张脸?弹幕立刻刷屏"这谁?"。传统AI视频工具的最大痛点正是角色一致性。

矛盾三:高昂的试错成本 vs 微薄的变现回报

大多数AI短剧创作者处于"为爱发电"状态。没有工业化成本控制能力,单分钟成本压不下来,就永远无法跑通商业模型。

AniShort的解法很直接:用"节点驱动生产"实现短剧的高效规模化量产。

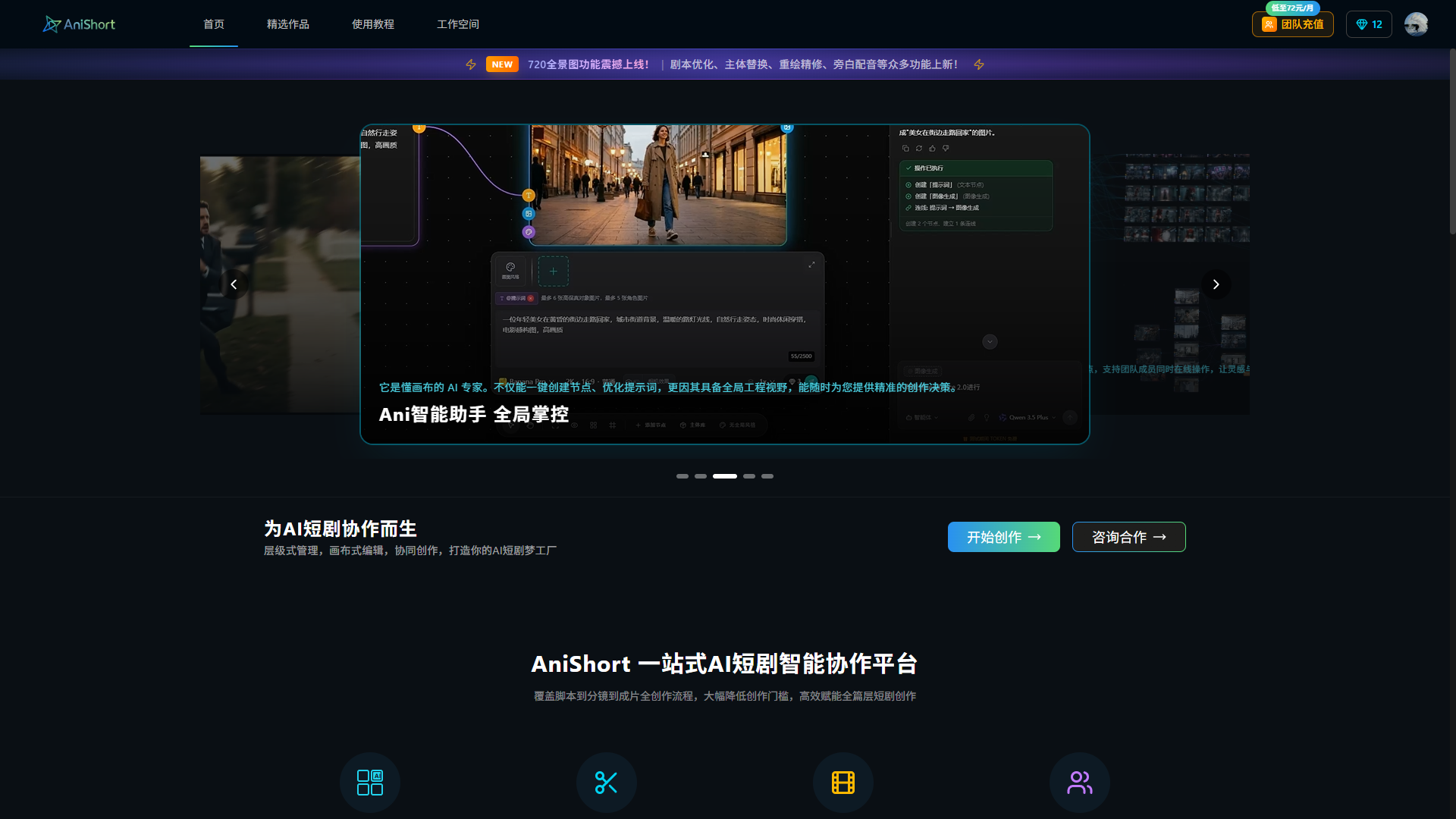

三、解剖AniShort:不是工具集,而是"操作系统"

很多人把AniShort理解为"AI工具大全",这是严重的低估。

它的本质是一个面向AI视频生产的操作系统,核心架构是"节点式工作流"。

3.1 什么是节点式工作流?

传统视频制作是线性流程:剧本→分镜→拍摄→剪辑→成片,一步错步步错。

AniShort将其重构为网状节点结构:

[剧本节点] ←→ [角色设定节点] ←→ [场景节点]

↓ ↓ ↓

[分镜节点] ←→ [宫格图节点] ←→ [视频生成节点]

↓ ↓ ↓

[剪辑节点] ←→ [审片节点] ←→ [导出节点]

每个节点既是独立模块(可单独编辑、复用),又是关联组件(修改上游节点,下游自动同步)。

3.2 工作流的全景结构

一个完整的短剧项目包含六大节点群:

|

节点群 |

功能 |

可复用性 |

|

剧本/分镜脚本 |

AI辅助剧本拆分、格式化 |

跨项目复用叙事模板 |

|

角色场景道具设定图 |

标准化视觉资产库 |

跨剧集复用角色形象 |

|

九宫格分镜图 |

可视化叙事预览 |

单集内调整镜头顺序 |

|

分镜图提取 |

从宫格中拆分独立镜头 |

挑选最优画面 |

|

分镜图重新拼接 |

按叙事逻辑重组 |

灵活调整节奏 |

|

视频生成 |

Seedance2.0/真人API输出 |

批量生成多版本 |

关键洞察:节点之间的连线不是简单的数据传递,而是拓扑逻辑关系。比如修改角色设定图的"服装版本",所有引用该角色的分镜图、视频节点会自动标记"待更新",实现全局一致性管理。

四、八大实操步骤中的技术逻辑

AniShort将复杂工作流封装为8个用户动作,但底层技术逻辑非常精密:

步骤一:剧本处理(NLP结构化)

输入自然语言剧本,AI执行:

- 实体识别:提取角色名、场景名、道具名

- 场景拆分:按叙事单元切分场次

- 情感标注:识别对话情绪、动作意图

输出的是结构化剧本数据,而非简单文本。

步骤二:主体信息提取(知识图谱构建)

这是AniShort的"秘密武器"。系统基于剧本构建视觉主体知识图谱:

角色实体 → 属性集(性别/年龄/服装/视觉记忆点)

→ 关系集(与其他角色的互动模式)

→ 时序集(出场顺序、造型变化)

展示的"角色主体索引表",本质上是机器可理解的数字演员档案。

步骤三:设定图生成(条件控制生成)

利用ControlNet+IP-Adapter等技术,基于标准化提示词生成三视图一致性角色。关键约束:

- 正面/侧面/背面角度固定

- 人种特征、年代背景、文化语境锁定

- 视觉记忆点(如"疲惫但锋利的侧脸线条")强化

步骤四:分镜脚本生成(跨模态对齐)

将文本剧本转化为视觉语言:

- 景别语法(大远景→建立空间,特写→强化情绪)

- 运镜逻辑(推轨=揭示,跟随=紧迫)

- 时间标注(精确到秒的镜头时长)

步骤五:宫格分镜图(批量受控生成)

3×3宫格不是简单的图片拼接,而是叙事矩阵。每个格子对应:

- 空间位置(九宫格=场景空间分区)

- 时间顺序(从左到右、从上到下=叙事流)

- 情绪曲线(构图张力变化)

步骤六:拆分挑选重组(人机协同优化)

AI生成10个版本,人类导演做审美决策。系统提供:

- 智能评分(构图、光影、角色一致性)

- 相似度去重

- 叙事连贯性检测

步骤七:视频生成(时序一致性控制)

接入Seedance 2.0的核心优势:

- 角色锚定:注入步骤三的设定图作为视觉参考

- 运动连贯性:基于分镜时序预测动作衔接

- 音画同步:原生支持口型驱动、表情同步

步骤八:剪辑审阅(非破坏性编辑)

所有操作基于节点引用而非文件拷贝,支持:

- 版本分支管理

- 逐帧批注(精确到时间码)

- 源文件不落地(零损耗协作)

五、成本结构分析:为什么能做到119元/分钟?

成本拆解值得逐行解读:

|

成本项 |

金额 |

产业意义 |

|

Banner图(19张) |

5.7元 |

视觉素材边际成本趋近于零 |

|

Seedance 2.0视频(285秒) |

171元 |

SOTA模型API化,按需付费 |

|

1080P超分 |

28.5元 |

分辨率升级作为后处理,而非重生成 |

|

算力合计 |

205.2元 |

技术民主化的直接体现 |

|

人力(1.5小时) |

93.75元 |

创作者从执行者变为决策者 |

|

总成本/2.5分钟 |

119.58元/分钟 |

传统成本的1/50-1/100 |

关键突破:成本结构从"人力密集型"转向"算力密集型",而算力成本正遵循摩尔定律下降。

六、十大核心功能的战略卡位

技术层:

- 满血版Seedance 2.0:独占API通道,构建技术壁垒

- 年框API开放真人视频:合规解决真人形象授权难题

- 图片视频批量生成:从"单条制作"到"工业化批次"

协作层:

- 多画布节点化创作:可视化降低协作门槛

- 双轨并行工业化量产:资产复用实现规模效应

- 多人实时高效协同:帧级精度,操作可溯

- 专业在线审片交付:消灭微信传视频的原始协作

管理层:

- 团队资源精细化管控:算力积分=数字时代的"制片预算"

- 创作资产复利沉淀:角色/场景/模板成为可增值IP

- 智能体全流程提效:AI Agent自动排查待办、引导操作

七、数据驱动的创作决策

不只是生产工具,更是决策大脑。

数据维度覆盖:

- 市场规模与增长趋势

- 题材热度排行(什么类型在赚钱)

- 用户画像分析(谁在付费)

- 平台政策解读(哪里流量多)

- 竞品动态监控(别人在做什么)

这意味着:AniShort正在从"工具提供商"向"产业基础设施"进化。

八、产业启示:AI视频的竞争终局是什么?

AniShort的模式揭示了AI视频产业的三个演进方向:

方向一:从"模型竞争"到"工作流竞争"

未来胜负手不是谁的模型更强,而是谁能把模型封装成最顺畅的生产流程。用户不为技术参数付费,为产出效率付费。

方向二:从"创作者经济"到"制片厂经济"

当单分钟成本降到百元级别,AI短剧将从个人创作转向小型制片厂模式。3-5人团队+AniShort平台=月产10部短剧的产能。

方向三:从"内容变现"到"资产变现"

角色、场景、模板等创作资产的复利沉淀,意味着未来的竞争是IP库的竞争。谁先建立标准化数字资产库,谁就掌握规模化的钥匙。

九、结语:工具革命背后的生产力解放

AniShort的slogan是"为AI短剧协作而生"。

但更深层的意义在于:它把创作者从"技术操作员"还原为"故事讲述者"。

当节点式工作流接管了重复劳动,当Seedance 2.0接管了画面生成,当智能体接管了流程管理——人类终于可以做人类最擅长的事:创意、审美、情感共鸣。

这或许才是AIGC时代的真正生产力革命。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)