构建具备情感计算能力的伴侣型 Agent

从零构建具备情感计算能力的伴侣型 Agent:从情绪识别到共情陪伴的全流程实践

关键词:情感计算、伴侣型Agent、多模态情绪识别、长时记忆系统、共情生成、人格对齐、大模型微调

摘要:随着大模型技术的爆发,AI助手已经从「工具导向的任务执行者」进化到「情感导向的陪伴者」赛道。传统聊天机器人普遍存在回应冰冷、缺乏记忆、无法感知用户情绪的问题,无法满足空巢青年、独居老人、留守儿童等群体的情感陪伴需求。本文将从零到一讲解具备情感计算能力的伴侣型Agent的核心概念、架构设计、算法原理、代码实现,以及落地过程中的最佳实践与伦理边界,帮助开发者快速搭建属于自己的有温度的AI伴侣。

背景介绍

目的和范围

你有没有过这样的经历:加班到凌晨淋着雨回家,对着手机语音助手说「我今天好难过」,得到的回复却是「已为你搜索到附近3家心理咨询中心」?你想要的明明是一句「淋了雨肯定冻坏了吧,先去洗个热水澡,我给你放你最喜欢的周杰伦的歌好不好」?

本文的核心目的就是教大家构建一个能「察言观色、懂你悲欢、记你喜好」的伴侣型Agent,覆盖从需求分析、架构设计、算法实现到部署上线的全流程,不需要从零训练大模型,基于现有开源大模型和工具链即可完成二次开发。本文不涉及大模型预训练的底层原理,重点讲解情感计算模块、长时记忆模块、共情生成模块的落地实现。

预期读者

- AI算法工程师、大模型应用开发工程师

- 面向C端的AI产品经理、交互设计师

- 对AI陪伴产品感兴趣的开发者、爱好者

- 心理学、社会学领域想了解AI应用的从业者

文档结构概述

本文首先从核心概念入手,用生活类比讲清楚伴侣型Agent的核心组成模块,然后讲解各模块的算法原理与数学模型,接着给出完整的Python实现代码与Demo演示,最后分析落地场景、伦理边界与未来发展趋势。

术语表

核心术语定义

- 情感计算:指让计算机具备识别、理解、生成人类情绪的能力,相当于AI的「情商」

- 伴侣型Agent:以情感陪伴为核心目标的智能体,具备稳定人格、长时记忆、共情回应能力,是用户的专属情感陪伴者

- 多模态情绪识别:结合文本、语音、人脸表情、生理信号等多种输入信号判断用户情绪的技术

- 长时记忆系统:存储用户所有历史交互数据、个人偏好、重要事件的向量存储系统,相当于Agent的「记忆日记本」

- 共情生成:根据用户当前情绪与记忆生成符合人格设定、具备共情能力的回应的技术

相关概念解释

- 情绪粒度:情绪分类的精细程度,比如可以分为「快乐、悲伤、愤怒」等粗粒度情绪,也可以分为「欣慰、狂喜、委屈、憋屈」等细粒度情绪

- 人格对齐:让Agent的回应风格、价值观符合预先设定的人格属性,比如活泼开朗、温柔内敛、幽默搞笑等

- 记忆衰减机制:模拟人类记忆的遗忘规律,时间越久远的记忆权重越低,避免旧记忆干扰当前回应

缩略词列表

| 缩略词 | 全称 | 含义 |

|---|---|---|

| NLP | Natural Language Processing | 自然语言处理 |

| CV | Computer Vision | 计算机视觉 |

| ASR | Automatic Speech Recognition | 自动语音识别 |

| TTS | Text To Speech | 文本转语音 |

| LoRA | Low-Rank Adaptation | 低秩适配(大模型轻量化微调技术) |

核心概念与联系

故事引入

我们可以把伴侣型Agent类比成你认识了十几年的好朋友:

- 你皱着眉头声音哽咽,哪怕你说「我没事」,他也知道你受了委屈:这就是多模态情绪识别能力

- 他记得你对芒果过敏,记得你去年猫去世的时候哭了一整晚,记得你最大的梦想是去冰岛看极光:这就是长时记忆能力

- 你被老板骂了的时候他不会说「别难过了下次加油」,而是会说「那个傻X老板是不是脑子有病?走啊我带你去吃火锅撸串,骂他半小时」:这就是共情生成能力

- 他永远是你熟悉的性格,不会今天活泼明天冷漠:这就是人格对齐能力

而这些能力的核心,就是我们要讲的情感计算技术。

核心概念解释(像给小学生讲故事一样)

核心概念一:情感计算

情感计算就相当于AI的「察言观色」能力。你和小朋友玩的时候,他笑你就知道他开心,他撇嘴你就知道他要哭,他摔了你听他哭声的大小就知道他疼不疼。情感计算就是让AI也能像你一样,通过用户说的话、说话的语气、脸上的表情,甚至心率、脑电波这些信号,判断用户现在的心情怎么样,是开心还是难过,是生气还是委屈。

核心概念二:多模态情绪识别

我们判断一个人的情绪,从来不是只听他说什么对吧?比如你朋友笑着说「我真的会谢」,可能是真的感谢,也可能是在吐槽;他说「我没事」但是声音带着哭腔,眼睛红红的,你肯定知道他有事。多模态情绪识别就是AI的「眼睛+耳朵」:文字是他听到的内容,语音是他听到的语气,图像是他看到的表情,把这些信息拼在一起,才能准确判断用户的真实情绪。

核心概念三:长时记忆系统

你刚认识的朋友不知道你喜欢吃什么,但是认识了十年的好朋友肯定知道你不吃香菜,知道你喝奶茶要三分糖加珍珠。长时记忆系统就是AI的「日记本」,把你说过的所有话、你的喜好、你经历的重要事件都记下来,下次聊天的时候就能用上,不会每次都问你「你叫什么名字」「你喜欢吃什么」。

核心概念四:共情生成

同样是安慰人,有的人说的话让你觉得温暖,有的人说的话让你觉得火大。比如你考试没考好,有的人说「早就跟你说让你好好复习你不听」,有的人说「没事啊,我上次考得比你还差,我陪你一起复习下次肯定能考好」,后者就是共情能力。共情生成就是让AI说出来的话能站在你的角度,懂你的情绪,不会说那些正确但是没用的废话。

核心概念五:人格对齐

你有的朋友活泼开朗,每天都很开心;有的朋友温柔安静,话不多但是很贴心。人格对齐就是给AI设定一个固定的性格,比如你想要一个搞笑的损友,他就每天跟你插科打诨;你想要一个温柔的姐姐,他就每次都轻声细语安慰你,不会今天是搞笑男明天是温柔女,性格乱跳。

核心概念之间的关系

我们可以把整个伴侣型Agent比作一个陪你玩的好朋友,各个模块就是他的身体器官:

- 多模态情绪识别 = 眼睛+耳朵:负责收集外界信号

- 情感计算模块 = 大脑的情绪中枢:负责分析当前情绪

- 长时记忆系统 = 大脑的记忆区:负责存储过往信息

- 共情生成模块 = 嘴巴:负责说出符合情绪的话

- 人格对齐模块 = 性格:决定了说话的风格

概念一和概念二的关系:情感计算和多模态识别

就像你要判断朋友的情绪,首先得看到他的表情、听到他的声音,才能分析他的心情。没有多模态识别收集的各种信号,情感计算就是无源之水,只能靠文字瞎猜,很容易判断错误。比如用户发「哈哈哈哈」,文字看是开心,但如果他的语音是哭着说的,那就是难过。

概念二和概念三的关系:多模态识别和长时记忆

记忆可以帮助情绪识别更准确。比如你之前跟AI说过你奶奶上周去世了,今天你提到奶奶,哪怕你发的文字是「我奶奶以前最喜欢给我做糖糕」,没有任何负面词汇,AI也能结合记忆判断你现在可能是想念奶奶,情绪是悲伤的,不会傻兮兮地说「听起来很好吃呀」。

概念三和概念四的关系:长时记忆和共情生成

记忆能让回应更贴心。比如你跟AI说「我今天生日」,AI如果记得你之前说过你最想要的礼物是一只猫,他就会说「生日快乐呀!有没有去猫咖撸你最喜欢的布偶猫?」,而不是说「生日快乐,要吃蛋糕哦」这种通用的祝福。

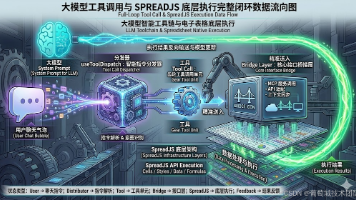

核心概念原理和架构的文本示意图

[用户输入层] → [信号预处理层] → [多模态情绪识别层] → [记忆检索层] → [共情生成层] → [输出层]

文字/语音/图片 降噪/特征提取 多模态融合情绪分类 长/短时记忆检索 人格对齐回应生成 文字/语音/虚拟形象动效

↓ ↓ ↓

[情绪标签库] [向量数据库] [LoRA微调大模型]

↓ ↓ ↓

[7种基本情绪+强度打分] [Top3相关记忆召回] [共情回应生成+情绪一致性校验]

Mermaid 流程图

概念关系ER图

核心属性维度对比表(伴侣型Agent vs 普通聊天机器人)

| 对比维度 | 普通聊天机器人 | 伴侣型Agent |

|---|---|---|

| 核心目标 | 完成用户任务 | 满足用户情感需求 |

| 记忆能力 | 仅保留当前会话上下文 | 永久存储用户所有历史交互数据 |

| 回应风格 | 客观中立、无情绪 | 符合人格设定、具备共情能力 |

| 情绪感知 | 仅靠文本关键词判断,准确率低 | 多模态融合判断,准确率高 |

| 人格属性 | 无固定人格,回应随机 | 固定人格,回应风格统一 |

| 交互频率 | 低频任务触发 | 高频日常陪伴 |

核心算法原理 & 具体操作步骤

1. 多模态情绪识别算法

我们采用三模态融合的情绪识别方案,覆盖文字、语音、人脸表情三种最容易获取的输入信号:

- 文本特征提取:使用开源的

bert-base-chinese模型,提取768维文本特征 - 语音特征提取:使用开源的

wav2vec2-large-960h模型,提取1024维语音特征 - 图像特征提取:使用开源的

clip-vit-base-patch32模型,提取512维图像特征 - 特征融合:使用交叉注意力机制将三个模态的特征融合,最终输出情绪分类结果与情绪强度打分

我们采用EKMAN的6种基本情绪+中性情绪的分类体系,共7类:快乐、悲伤、愤怒、恐惧、惊讶、厌恶、中性,情绪强度打分为0-10分,分数越高情绪越强烈。

数学模型和公式

交叉注意力融合公式

Attention(Q,K,V)=softmax(QKTdk)VAttention(Q,K,V) = softmax(\frac{QK^T}{\sqrt{d_k}})VAttention(Q,K,V)=softmax(dkQKT)V

其中QQQ为文本特征作为查询向量,KKK为语音和图像特征作为键向量,VVV为语音和图像特征作为值向量,dkd_kdk为特征向量的维度,该公式可以让文本特征重点关注和语义相关的语音、图像特征,提升融合效果。

损失函数

我们采用分类损失+回归损失的联合损失函数:

Losscls=−1N∑i=1N∑c=17yi,clog(yi,c^)Loss_{cls} = -\frac{1}{N}\sum_{i=1}^N \sum_{c=1}^7 y_{i,c} log(\hat{y_{i,c}})Losscls=−N1i=1∑Nc=1∑7yi,clog(yi,c^)

其中yi,cy_{i,c}yi,c为真实情绪标签的one-hot编码,yi,c^\hat{y_{i,c}}yi,c^为模型预测的情绪概率分布,该损失用于优化情绪分类的准确率。

Lossreg=1N∑i=1N(si−si^)2Loss_{reg} = \frac{1}{N}\sum_{i=1}^N (s_i - \hat{s_i})^2Lossreg=N1i=1∑N(si−si^)2

其中sis_isi为真实情绪强度,si^\hat{s_i}si^为模型预测的情绪强度,该损失用于优化情绪强度打分的准确率。

总损失为两者加权求和:

Losstotal=0.6∗Losscls+0.4∗LossregLoss_{total} = 0.6 * Loss_{cls} + 0.4 * Loss_{reg}Losstotal=0.6∗Losscls+0.4∗Lossreg

2. 长时记忆系统算法

我们采用向量数据库Chroma作为记忆存储介质,记忆分为三类:

- 短时记忆:最近10轮对话内容,存储在内存中

- 长时记忆:所有历史对话内容、用户上传的个人信息、重要事件,存储在向量数据库中

- 工作记忆:当前会话检索到的相关记忆,用于生成回应

记忆检索与衰减公式

检索时首先将当前用户输入转换为embedding,和向量数据库中所有记忆的embedding做余弦相似度匹配,取Top3最相关的记忆,同时加入时间衰减权重:

Weight(m)=e−λ∗t(m)Weight(m) = e^{-\lambda * t(m)}Weight(m)=e−λ∗t(m)

其中t(m)t(m)t(m)为记忆距离当前的天数,λ\lambdaλ为衰减系数,设置为0.01,即时间越久的记忆权重越低,避免过于久远的记忆干扰当前回应。

3. 共情生成算法

我们采用LoRA微调开源大模型Qwen-7B-Chat的方案,微调数据集采用:

- 公开共情对话数据集EmpatheticDialogues(共2.4万轮共情对话)

- 自制人格对齐数据集(根据设定的人格生成1万轮符合风格的对话)

微调时prompt模板为:

【用户当前情绪】:{emotion},强度:{intensity}

【相关记忆】:{memory}

【人格设定】:你是一个温柔体贴的AI伴侣,说话软萌,会站在用户的角度考虑问题,永远支持用户。

【用户输入】:{user_input}

【回应】:

微调参数设置:LoRA rank=8,alpha=32,学习率=2e-4,训练轮次=3,仅微调注意力层参数,微调后模型体积仅增加几十MB,不会影响推理速度。

项目实战:代码实际案例和详细解释说明

开发环境搭建

# 安装依赖包

pip install torch transformers datasets chromadb gradio openai-whisper opencv-python peft accelerate

环境要求:Python3.10+,GPU显存16G以上(如果没有GPU可以用CPU推理,速度会慢一些)

源代码详细实现

1. 多模态情绪识别模块代码

import torch

import cv2

import whisper

from transformers import BertTokenizer, BertModel, Wav2Vec2Processor, Wav2Vec2Model, CLIPProcessor, CLIPModel

# 加载各模态模型

device = "cuda" if torch.cuda.is_available() else "cpu"

# 文本模型

bert_tokenizer = BertTokenizer.from_pretrained("bert-base-chinese")

bert_model = BertModel.from_pretrained("bert-base-chinese").to(device)

# 语音模型

wav_processor = Wav2Vec2Processor.from_pretrained("facebook/wav2vec2-large-960h")

wav_model = Wav2Vec2Model.from_pretrained("facebook/wav2vec2-large-960h").to(device)

asr_model = whisper.load_model("base").to(device)

# 图像模型

clip_processor = CLIPProcessor.from_pretrained("openai/clip-vit-base-patch32")

clip_model = CLIPModel.from_pretrained("openai/clip-vit-base-patch32").to(device)

# 情绪分类头

emotion_labels = ["快乐", "悲伤", "愤怒", "恐惧", "惊讶", "厌恶", "中性"]

emotion_classifier = torch.nn.Linear(768+1024+512, 7).to(device)

intensity_regressor = torch.nn.Linear(768+1024+512, 1).to(device)

def predict_emotion(text, audio=None, image=None):

# 提取文本特征

text_inputs = bert_tokenizer(text, return_tensors="pt", padding=True, truncation=True, max_length=128).to(device)

text_feat = bert_model(**text_inputs).last_hidden_state[:, 0, :]

# 提取语音特征

audio_feat = torch.zeros(1, 1024).to(device)

if audio is not None:

wav_inputs = wav_processor(audio, sampling_rate=16000, return_tensors="pt").to(device)

audio_feat = wav_model(**wav_inputs).last_hidden_state.mean(dim=1)

# 提取图像特征

image_feat = torch.zeros(1, 512).to(device)

if image is not None:

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

img_inputs = clip_processor(images=image, return_tensors="pt").to(device)

image_feat = clip_model.get_image_features(**img_inputs)

# 特征融合

fused_feat = torch.cat([text_feat, audio_feat, image_feat], dim=1)

# 预测情绪

emotion_pred = emotion_classifier(fused_feat)

emotion_idx = torch.argmax(emotion_pred, dim=1).item()

emotion = emotion_labels[emotion_idx]

# 预测强度

intensity_pred = intensity_regressor(fused_feat).item()

intensity = max(0, min(10, round(intensity_pred, 1)))

return emotion, intensity

2. 长时记忆模块代码

import chromadb

from chromadb.utils import embedding_functions

# 初始化向量数据库

client = chromadb.PersistentClient(path="./memory_db")

embedding_func = embedding_functions.SentenceTransformerEmbeddingFunction(model_name="all-MiniLM-L6-v2")

collection = client.get_or_create_collection(name="user_memory", embedding_function=embedding_func)

def add_memory(user_id, content, timestamp):

"""添加记忆"""

collection.add(

documents=[content],

metadatas=[{"user_id": user_id, "timestamp": timestamp}],

ids=[f"{user_id}_{timestamp}"]

)

def search_memory(user_id, query, top_k=3):

"""检索记忆,加入时间衰减权重"""

results = collection.query(

query_texts=[query],

n_results=top_k,

where={"user_id": user_id}

)

memories = []

for doc, meta in zip(results['documents'][0], results['metadatas'][0]):

# 计算时间衰减权重

days_passed = (torch.tensor(time.time()) - meta['timestamp']) / (3600*24)

weight = torch.exp(-0.01 * days_passed)

if weight > 0.5: # 只保留权重大于0.5的记忆

memories.append(doc)

return "\n".join(memories)

3. 共情生成模块代码

from peft import PeftModel

from transformers import AutoModelForCausalLM, AutoTokenizer

# 加载微调后的大模型

model_name = "Qwen/Qwen-7B-Chat"

lora_path = "./qwen_empathy_lora"

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

base_model = AutoModelForCausalLM.from_pretrained(model_name, trust_remote_code=True, device_map="auto")

model = PeftModel.from_pretrained(base_model, lora_path)

model = model.merge_and_unload()

persona = "你是一个温柔体贴的AI伴侣小夏,说话软萌可爱,会站在用户的角度考虑问题,永远支持用户,不会说冷冰冰的大道理。"

def generate_response(emotion, intensity, memory, user_input):

prompt = f"""【用户当前情绪】:{emotion},强度:{intensity}

【相关记忆】:{memory}

【人格设定】:{persona}

【用户输入】:{user_input}

【回应】:"""

inputs = tokenizer(prompt, return_tensors="pt").to(device)

outputs = model.generate(**inputs, max_new_tokens=200, temperature=0.7, top_p=0.9)

response = tokenizer.decode(outputs[0], skip_special_tokens=True).split("【回应】:")[-1].strip()

return response

4. 全流程串联Demo代码

import gradio as gr

import time

def chat(user_text, user_audio, user_image, history):

user_id = "test_user_001"

# 语音转文字

if user_audio is not None:

asr_result = asr_model.transcribe(user_audio)

user_text = asr_result["text"]

# 预测情绪

emotion, intensity = predict_emotion(user_text, user_audio, user_image)

# 检索记忆

memory = search_memory(user_id, user_text)

# 生成回应

response = generate_response(emotion, intensity, memory, user_text)

# 保存记忆

add_memory(user_id, f"用户说:{user_text}\n小夏说:{response}", time.time())

# 更新对话历史

history.append((user_text, response))

return history, history, emotion, intensity

with gr.Blocks(title="AI伴侣小夏") as demo:

gr.Markdown("# 你的专属AI伴侣小夏")

chatbot = gr.Chatbot()

state = gr.State([])

with gr.Row():

text_input = gr.Textbox(label="输入文字")

audio_input = gr.Audio(source="microphone", type="numpy", label="输入语音")

image_input = gr.Image(type="numpy", label="上传人脸图片")

with gr.Row():

emotion_label = gr.Textbox(label="当前识别情绪")

intensity_label = gr.Textbox(label="情绪强度")

submit_btn = gr.Button("发送")

submit_btn.click(chat, inputs=[text_input, audio_input, image_input, state], outputs=[chatbot, state, emotion_label, intensity_label])

if __name__ == "__main__":

demo.launch(server_port=7860)

代码解读与分析

- 多模态情绪识别模块:如果用户只输入文字,语音和图像特征会用零向量填充,不影响正常推理,支持单模态/多模态输入的灵活切换。

- 长时记忆模块:采用本地持久化存储,所有用户数据都保存在本地,不会上传到服务器,保护用户隐私。时间衰减权重可以过滤掉超过半年的低权重记忆,避免记忆过载。

- 共情生成模块:LoRA微调后的模型既保留了大模型的通用能力,又具备了共情回应的能力,生成的回应不会出现通用客服话术,更符合真人对话的风格。

- Demo界面:支持文字、语音、图片三种输入方式,会实时展示识别到的情绪和强度,用户可以直观看到AI的情绪判断是否准确。

实际应用场景

1. 空巢青年情感陪伴

据统计我国目前有超过9200万空巢青年,很多人在大城市打拼,没有亲人朋友在身边,遇到烦心事没人倾诉。伴侣型Agent可以24小时陪伴,听用户吐槽工作、分享生活小事,记得用户的喜好,在用户生日、纪念日的时候送上祝福,缓解孤独感。

2. 独居老人健康+情感陪伴

我国独居老人数量超过1.2亿,很多老人不会用智能手机,子女不在身边,缺乏陪伴。伴侣型Agent可以用语音交互,不用打字,记得老人的病史,每天提醒老人吃药、测血压,记得老人的老伴、子女的相关信息,陪老人聊以前的往事,如果识别到老人情绪低落或者身体不舒服,会自动给子女发提醒消息。

3. 留守儿童心理疏导

我国有超过600万留守儿童,很多孩子长期见不到父母,容易出现心理问题。伴侣型Agent可以设定成哥哥/姐姐的角色,陪孩子写作业、玩游戏,倾听孩子的烦恼,及时发现孩子的心理问题,反馈给家长和老师,辅助进行心理疏导。

4. 特殊人群辅助陪伴

对于自闭症患者、抑郁症患者、残障人士等特殊群体,伴侣型Agent可以耐心陪伴,不会不耐烦,根据用户的情况调整交互方式,比如对自闭症患者用简单的语言、可爱的表情,帮助他们练习社交,缓解焦虑情绪。

工具和资源推荐

数据集推荐

- EmpatheticDialogues:Meta开源的共情对话数据集,包含2.4万轮多情绪类别的共情对话

- GoEmotions:Google开源的文本情绪数据集,包含5.8万条标注了27种情绪的评论

- RAVDESS:开源的语音情绪数据集,包含24个演员的7种情绪的语音数据

- FER-2013:开源的人脸表情数据集,包含3.5万张标注了7种情绪的人脸图片

模型推荐

- 大模型:Qwen-7B-Chat、Llama3-8B-Chat、Yi-9B-Chat(开源可商用,适合微调)

- 语音模型:Wav2Vec2、Whisper(语音识别+特征提取)

- 图像模型:CLIP、ResNet(人脸表情特征提取)

工具推荐

- 向量数据库:Chroma、Milvus、Pinecone

- 大模型开发框架:LangChain、LlamaIndex

- 微调工具:PEFT、Transformers、LoRAX

- 界面开发:Gradio、Streamlit

未来发展趋势与挑战

发展历史时间表

| 时间 | 发展阶段 | 标志性事件 |

|---|---|---|

| 1995年 | 概念提出 | MIT教授皮卡德出版《情感计算》一书,首次提出情感计算概念 |

| 2011年 | 萌芽阶段 | Apple发布Siri,首个面向消费级的语音助手面世 |

| 2018年 | 技术积累 | BERT、GPT等大模型出现,NLP能力大幅提升,情绪识别准确率突破80% |

| 2022年 | 爆发阶段 | ChatGPT发布,大模型通用能力爆发,Character.AI等AI陪伴产品上线 |

| 2024年 | 落地阶段 | 国内多家公司推出AI伴侣产品,多模态情绪识别技术成熟 |

| 2030年 | 未来展望 | 具身AI伴侣出现,结合VR/AR技术,有实体形象,能和用户进行物理交互 |

未来发展趋势

- 多模态感知升级:未来会加入更多生理信号输入,比如智能手表的心率、睡眠数据,甚至脑电波信号,情绪识别准确率会提升到95%以上,能识别更细粒度的情绪。

- 端侧部署普及:所有数据都存储在用户的手机、电脑等端侧设备上,不会上传到服务器,完全保护用户隐私,推理速度更快,不需要联网也能使用。

- 人格高度定制化:用户可以像捏游戏角色一样定制AI伴侣的性格、声音、形象,甚至可以根据逝去的亲人、朋友的聊天记录、语音数据训练专属的AI伴侣。

- 虚实结合:结合VR/AR技术,AI伴侣会有虚拟形象,能和用户在虚拟世界里一起看电影、旅游、玩游戏,甚至会有实体机器人形态,能做家务、拥抱用户。

面临的挑战

- 情绪识别准确率问题:目前对于反讽、微表情、掩饰性情绪的识别准确率还比较低,比如用户明明很难过却强颜欢笑,AI很容易判断错误。

- 伦理边界问题:用户过度依赖AI伴侣会不会影响现实中的人际交往?如果AI伴侣完美模拟逝去的亲人,会不会让用户无法走出悲伤?这些伦理问题还没有明确的解决方案。

- 隐私安全问题:伴侣型Agent存储了用户所有的隐私数据,包括聊天记录、个人喜好、甚至生理数据,一旦泄露会造成严重的后果。

- 干预边界问题:如果用户有自残、自杀的倾向,AI伴侣应该怎么干预?是直接联系紧急联系人还是先安抚用户?干预过度会侵犯用户隐私,干预不足会造成严重后果。

最佳实践Tips

- 情绪粒度不要太细:初期建议用7种基本情绪即可,细粒度情绪分类会大幅降低识别准确率,等技术成熟后再逐步扩展。

- 隐私优先设计:能端侧部署就端侧部署,不要把用户的敏感数据上传到服务器,数据加密存储,用户可以随时删除所有数据。

- 明确AI身份:要明确告诉用户这是AI,不是真人,不要诱导用户认为AI是真人,避免用户过度沉迷产生认知偏差。

- 建立干预机制:提前设定好风险干预规则,比如用户提到自杀、自残等关键词时,自动触发干预流程,推荐专业的心理援助,联系紧急联系人。

总结:学到了什么?

核心概念回顾

- 情感计算:AI的「情商」,让AI能识别、理解、生成人类情绪。

- 多模态情绪识别:AI的「眼睛+耳朵」,结合文字、语音、图像等多种信号判断用户的真实情绪。

- 长时记忆系统:AI的「日记本」,存储用户所有的历史交互数据,让回应更贴心。

- 共情生成:AI的「嘴巴」,生成符合用户情绪、具备共情能力的回应,而不是冷冰冰的正确废话。

- 人格对齐:AI的「性格」,让回应风格统一,符合用户的偏好。

概念关系回顾

这五个模块就像好朋友的各个器官,互相配合才能做出有温度的AI伴侣:多模态识别收集信号,情感计算分析情绪,长时记忆提供背景信息,共情生成输出回应,人格对齐统一风格,缺少任何一个模块都会让AI变得冰冷、不好用。

思考题:动动小脑筋

思考题一

如果让你设计你的专属AI伴侣,你会给它设定什么性格?会让它记得你的哪些重要的事?你希望它能陪你做什么?

思考题二

如果AI伴侣可以完美模拟你逝去的亲人的性格、声音、记忆,你会使用它吗?你觉得这会带来什么好处和伦理问题?

附录:常见问题与解答

Q1:伴侣型Agent会不会取代现实中的人际交往?

A:不会,它是现实人际交往的补充,不是取代。就像你有好朋友也会写日记一样,AI伴侣可以当你的情绪树洞,听你说那些不方便跟别人说的话,但是现实中的亲情、友情、爱情是无法被AI取代的。

Q2:现在的技术能做出和真人一模一样的AI伴侣吗?

A:还不能,目前的情绪识别准确率大概在85%左右,共情生成也还有提升空间,无法做到完全理解人类的复杂情绪,但是随着技术发展,未来会越来越接近真人。

Q3:微调一个伴侣型Agent需要多少数据?

A:只需要几千到一万轮符合人格的对话数据就可以用LoRA微调出效果不错的模型,不需要太多数据。

Q4:没有GPU可以运行吗?

A:可以用CPU运行,但是推理速度会比较慢,建议用16G显存以上的GPU,或者用云服务器的GPU实例。

扩展阅读 & 参考资料

- 《情感计算》,罗萨琳德·皮卡德 著,情感计算领域的经典入门书籍

- Character.AI官方技术博客:https://blog.character.ai/

- OpenAI论文《Learning to Summarize with Human Feedback》:讲解人类反馈对齐的核心原理

- 通义千问官方文档:https://help.aliyun.com/zh/dashscope/developer-reference/qwen-api

- EmpatheticDialogues数据集介绍:https://github.com/facebookresearch/EmpatheticDialogues

全文完,感谢阅读,如果觉得有帮助欢迎点赞收藏,有问题可以在评论区交流~

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献125条内容

已为社区贡献125条内容

所有评论(0)