SplatFlow: Multi-View Rectified Flow Model for 3D Gaussian Splatting Synthesis

一、论文基本信息

论文题目:SplatFlow: Multi-View Rectified Flow Model for 3D Gaussian Splatting Synthesis

作者:Hyojun Go*、Byeongjun Park*、Jiho Jang、Jin-Young Kim、Soonwoo Kwon、Changick Kim(* 共同一作)

单位:EverEx、韩国科学技术院(KAIST)

会议:CVPR 2025

项目主页:https://gohyojun15.github.io/SplatFlow/

二、论文摘要

基于文本的 3D 场景生成与编辑,在 VR/AR、游戏、数字内容创作中价值巨大。

尽管 3D 高斯溅射(3DGS)已实现高保真 + 实时渲染,但现有方法普遍任务专一、框架割裂:生成要逐场景优化、编辑要复杂后处理,缺少一套同时支持生成与编辑的统一方案。为此,本文提出SplatFlow框架:用多视图校正流(RF)模型在潜在空间联合生成多视图图像、深度、相机姿态;用高斯溅射解码器(GSDecoder) 前馈输出像素对齐 3DGS;结合免训练反转 + 修复,一键实现 3D 对象编辑、新视角合成、姿态估计等任务。在 MVImgNet、DL3DV-7K 真实场景数据集上,SplatFlow 在生成质量、文本对齐、编辑效果上均超越现有方法。

三、论文动机(为什么要做)

3DGS 好用,但流程太碎3D 高斯溅射渲染快、效果好,但现有工作生成归生成、编辑归编辑,没有一体化框架。

真实场景太难搞

物体级数据集简单,真实世界尺度不一、相机轨迹复杂,传统方法难以泛化。

编辑成本太高现有 3DGS 编辑依赖 SDS 优化、视图注意力、自回归循环,步骤多、速度慢、门槛高。

→ 目标:一套模型、一次训练、同时搞定生成 + 编辑 + 多类 3D 任务。

四、核心创新点

4.1 首次实现 3DGS 生成与编辑的一体化统一框架

SplatFlow 在领域内首次真正打通 3D 高斯溅射的生成与编辑闭环,打破以往 “生成模型专司生成、编辑模型另起炉灶” 的割裂现状,构建出单一模型兼顾高质量生成与灵活编辑的全新范式。

它摒弃了传统 3D 编辑必须设计专用编辑模块、额外优化流程、视图一致性补偿组件的复杂思路,全程只训练一个生成模型,不新增任何编辑专用网络。编辑能力完全依托免训练的扩散反转技术(SDEdit) 与潜在空间修复技术(RePaint) 实现,仅通过修改多视图潜在特征即可完成编辑,流程极简、无额外开销、落地更高效。

4.2 多视图图像 + 深度图 + 相机姿态联合潜在建模

针对真实世界场景尺度差异大、相机轨迹复杂、多视图易不一致的痛点,SplatFlow 在潜在空间内对图像、深度、相机姿态三者进行端到端联合建模,而非分开训练、单独预测。

模型以文本为条件,一次性输出对齐的多视图图像特征、深度潜在特征、普吕克射线坐标,从根源上保证多视图几何一致性与空间结构合理性,无需后处理校准。这种联合分布学习让模型能自适应不同场景尺度与任意相机轨迹,完美适配无约束的真实 3D 场景生成。

4.3 前馈式高斯解码,彻底告别逐场景优化

依托高效前馈 3DGS 重建技术,SplatFlow 设计专用高斯溅射解码器(GSDecoder),实现一步式从多视图潜在表示直接解码为像素对齐 3DGS。

对比传统基于 SDS 的文本到 3D 方法必须逐场景迭代优化、耗时极长的缺陷,该解码器以固定网络前馈推理,速度大幅提升,可支撑大规模数据集训练与快速部署。同时通过深度潜在注入、对抗损失与视觉辅助损失,在保持速度的同时精准还原几何结构与表面细节,兼顾效率与保真度。

4.4 原生兼容 Stable Diffusion 3,复用 2D 大模型强先验

SplatFlow冻结并共享 Stable Diffusion 3 的预训练编码器,让多视图校正流模型与 SD3 共用同一潜在空间,实现 2D 与 3D 生成模型的深度兼容。

这一设计直接继承 SD3 的文本对齐、语义理解、细节生成能力,无需从零学习文本 - 视觉对齐,显著提升 3D 生成质量与泛化性;同时保持与主流 2D 扩散生态的互通性,支持灵活接入各类提示引导、编辑策略,让 3D 生成能够站在 2D 大模型的成熟能力之上快速迭代。

五、方法框架

SplatFlow 只有两大核心组件,结构非常清爽:

4.1 SplatFlow 整体架构

SplatFlow 是一个仅训练生成模型、即可统一支持 3DGS 生成与免训练编辑的端到端框架,由多视图校正流(RF)模型和高斯溅射解码器(GSDecoder) 两大核心组件构成。

以文本为条件,模型先在潜在空间生成多视图一致的图像、深度与相机姿态,再通过前馈解码直接输出像素对齐的 3DGS;全程不设计专用编辑模块,仅依靠免训练反转 + 潜在空间修复完成编辑与各类 3D 任务,实现生成与编辑一体化。

4.2 高斯溅射解码器(GSDecoder)

GSDecoder 以多视图潜在特征 + 相机姿态为输入,采用纯前馈方式输出 3DGS,彻底告别逐场景优化。

输入:K 个视图的图像潜在、深度潜在(DepthAnything V2 提取)、对应相机姿态。

深度潜在整合:将深度潜在作为额外输入注入,强化 3D 几何结构,提升收敛速度与重建精度。

网络设计:基于 Stable Diffusion 3 解码器初始化,增加通道维度并引入跨视图注意力,保证多视图信息互通与结构一致。

训练损失:组合使用 LPIPS、MSE 与视觉辅助损失,后期加入对抗损失提升细节与真实感,同时保证训练稳定。

输出:逐像素对齐的 3DGS 完整参数(位置、不透明度、协方差、颜色),可直接用于实时渲染。

4.3 多视图校正流(RF)模型

多视图 RF 模型在潜在空间联合建模多视图图像、深度、相机姿态,从文本提示直接生成三者对齐的潜在表示。

输入构造:将多视图图像潜在、深度潜在与普吕克射线坐标沿通道维度拼接,形成统一输入特征。

模型结构:基于 Stable Diffusion 3 微调,修改输入输出通道,加入跨视图注意力,使用条件流匹配损失训练,采样更快、误差更低。

采样与姿态优化:从普吕克坐标解算相机姿态,并通过流形约束精修姿态参数,确保多视图共享内参、轨迹合理;同时融入 SD3 向量场引导,提升多视图图像质量。

核心输出:对齐的多视图图像潜在、深度潜在与优化后的相机姿态,从根源保证 3D 一致性,适配真实场景的多变尺度与复杂轨迹。

4.4 免训练推理:生成、编辑与修复应用

SplatFlow 仅训练生成能力,编辑、相机姿态估计、新视角合成均通过免训练方式实现。

3DGS 编辑:对原始多视图潜在执行SDEdit 免训练反转,以目标文本为条件重采样,直接得到编辑后潜在,再解码为 3DGS,无需额外编辑模块与精细优化。

修复类任务:利用模型对图像、深度、姿态的联合建模,将已知部分作为约束,通过 RePaint 修复完成:

相机姿态估计:从部分视图图像与深度推断完整相机姿态。

新视角合成:用部分视图生成其余新视角,支持插值与外推。

六、实验分析

6.1 文本→3DGS 生成

数据集:MVImgNet、DL3DV-7K

指标:FID(越低越好)、CLIPScore(越高越好)

结果:全面超越 Director3D,更小训练集跑出更好效果,细节更清晰、纹理更自然。

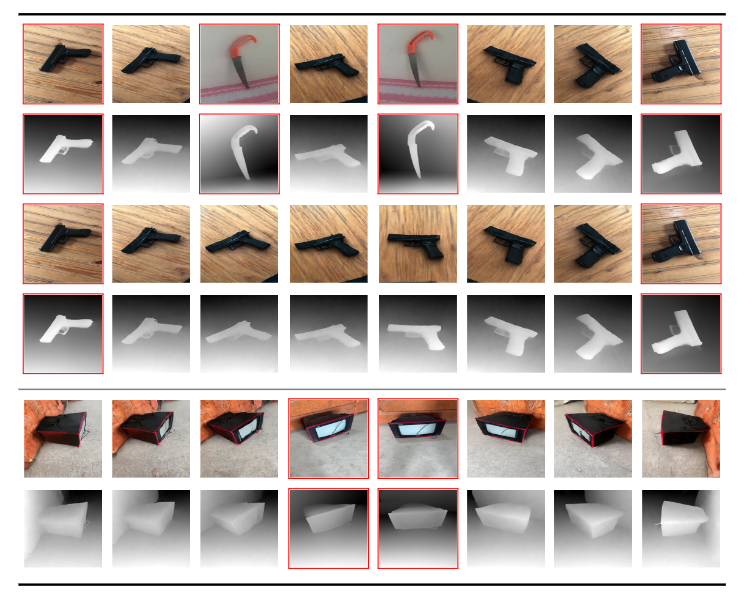

6.2 3D 对象编辑(物体替换)

对比:DGE、MVInpainter

结论:SplatFlow 可彻底替换对象,不是简单改风格,CLIP 分数与方向相似度更高。

6.3 相机姿态估计

对比:RelPose++、RayDiffusion

结果:旋转与相机中心精度大幅领先,深度联合建模带来强鲁棒性。

6.4 新视角合成

支持插值(均匀视角)与外推(中心视角);

输入视图越多,PSNR/SSIM 越高,深度估计越准。

七、结论与展望

7.1结论

SplatFlow 构建了首个统一 3DGS 生成 + 编辑的高效框架;

多视图 RF+GSDecoder 设计,适配真实复杂场景;

免训练编辑 + 修复,一键支持对象编辑、姿态估计、新视角合成;

在多项任务上SOTA,简单、强大、好用。

7.2展望

向动态 4D 场景扩展;

提升超大场景、室内外混合的生成能力;

进一步轻量化,落地移动端实时 3D 内容创作。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)