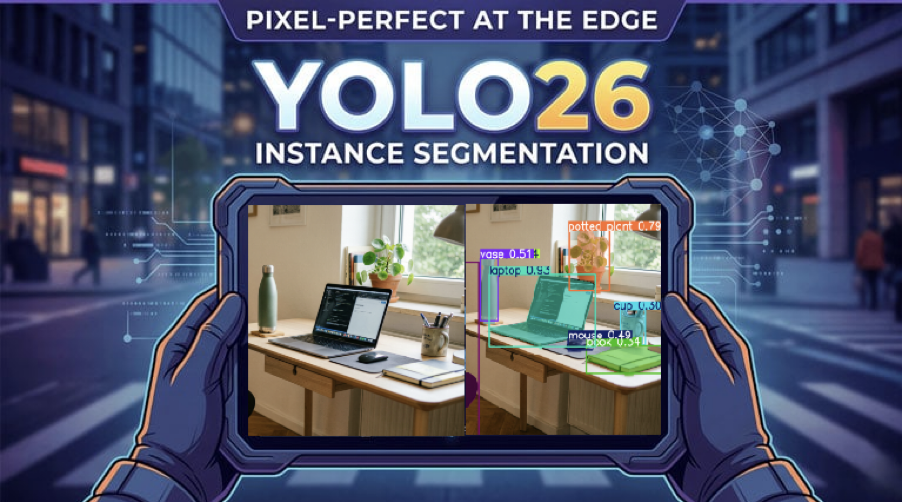

告别画框,YOLO26实例分割:像素级实时抠图,边缘端也能丝滑跑!

做过计算机视觉的朋友都知道,目标检测给你画个矩形框,顶多算“知道这儿有个东西”;但实例分割能精准抠出轮廓,这才是真正的“看懂形状”。

比如自动驾驶里,你要的不只是“前方有行人”,而是他精确的轮廓边界;医疗影像里,你要的也不只是“这儿有异物”,而是它到底长什么样、边界在哪。

以前,想要实时跑实例分割,要么速度跟不上,要么边缘设备直接卡死。但现在,YOLO26的实例分割版本(YOLO26-Seg)彻底把局势扭转了——不仅速度拉满,抠图精度更是逼近离线模型,而且对边缘部署极度友好。

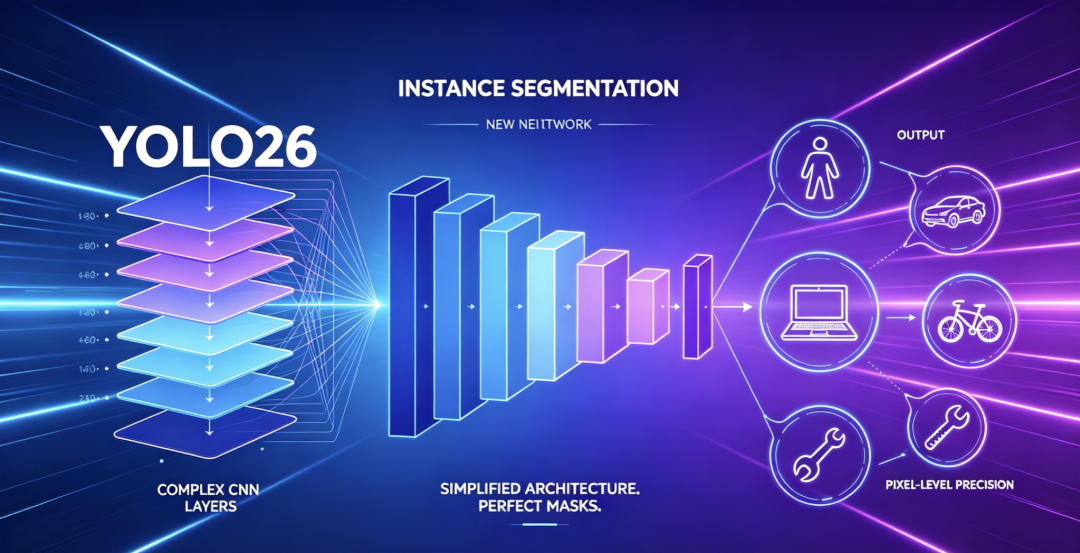

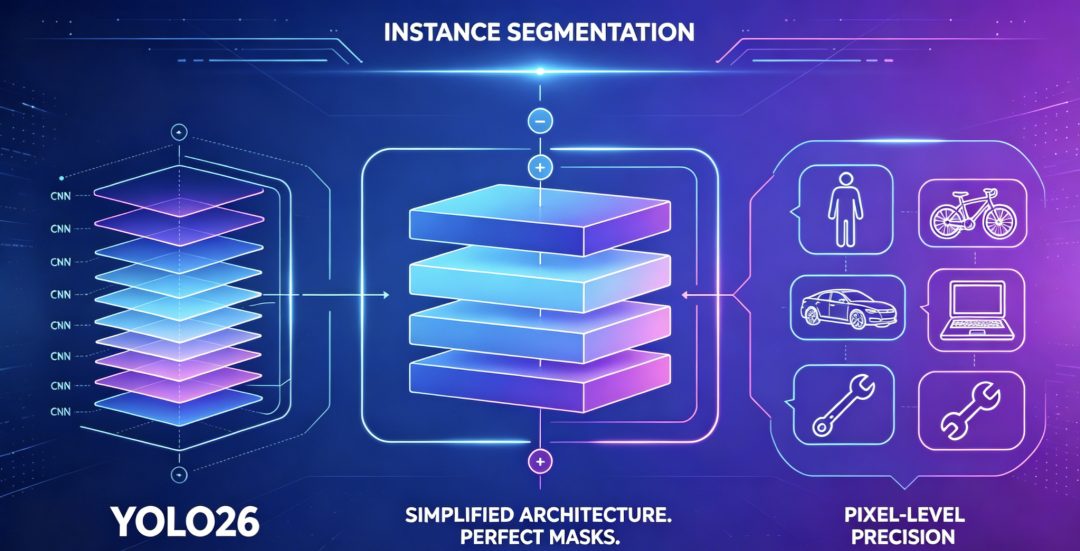

三大杀手锏:为什么YOLO26-Seg能这么猛?

相比于前代,YOLO26在实例分割上的提升不是简单的“修修补补”,而是从架构到训练的全面进化:

1. 彻底告别NMS后处理(NMS-free)

以前跑YOLO,推理完还得加一步NMS(非极大值抑制)去重,这玩意儿不仅吃算力,延迟还不可控,在边缘设备上特别让人头疼。YOLO26直接采用了One-to-One预测头,一对一预测,从根本上干掉了NMS。推理延迟更稳、更丝滑,部署到Jetson或者树莓派上再也不用担心后处理卡脖子。

2. MuSGD优化器:小模型也能喂得饱

训练过分割模型的都知道,小模型容易训崩,边界极其难收敛。YOLO26引入了MuSGD优化器(SGD和Muon的混合),这灵感可是来自大模型训练。简单来说,它让训练过程更稳定、收敛更平滑,对边界极其敏感的实例分割来说,这意味着更靠谱的轮廓和更少的“锯齿”。

3. 升级版多尺度Proto模块:细节抠到极致

实例分割的灵魂就在于“边界准不准”。遇到细长结构(比如椅子腿)、遮挡边缘、小目标,以前很容易糊成一团。YOLO26升级了多尺度Proto模块,把多尺度特征利用到了极致,轮廓贴合度直线拉升,遮挡处也不容易断裂。

数据说话:速度与精度的极致平衡

在COCO-Seg(80类)标准测试集上,YOLO26-Seg家族的表现堪称惊艳(输入640×640):

模型 参数量 T4 TensorRT耗时 Mask mAP50-95 适用场景

yolo26n-seg 2.7M 2.1ms 33.9 极致轻量,移动端/边缘设备首选

yolo26s-seg 10.4M 3.3ms 40.0 算力有限的工业相机、无人机

yolo26m-seg 23.6M 6.7ms 44.1 平衡之选,服务器端高并发

yolo26l-seg 28.0M 8.0ms 45.5 追求高精度的复杂场景

yolo26x-seg 62.8M 16.4ms 47.0 离线处理、对精度要求极高

划重点:yolo26n-seg只有2.7M参数,T4上推理只要2.1ms! 即便是在CPU上,ONNX推理也就50ms左右。这意味着,以前只能在服务器上跑的像素级分割,现在下放到边缘端也能实时跑了。

极简实战:从推理到训练的保姆级教程

Ultralytics的生态依然是那么好用,几行代码就能跑通全流程。

1. 图片推理:三行代码搞定抠图

from ultralytics import YOLO

# 加载模型,首次运行会自动下载权重

model = YOLO("yolo26n-seg.pt")

results = model("your_image.jpg", conf=0.25)

# 可视化结果

annotated_img = results[0].plot()

推理后,

results[0].masks.xy 可以直接拿到多边形轮廓坐标,

results[0].masks.data 拿到0/1二值化掩码,对接下游业务非常方便。

2. 视频推理:逐帧分割与重编码

视频推理同理,用OpenCV逐帧读取,送入模型,再把画好轮廓的帧写回视频即可。在实际测试中,即便是高速行驶的车辆画面,YOLO26-Seg的掩码贴合度依然非常稳,不会出现大幅度抖动。

3. 自定义数据集训练

标注格式依然是经典的YOLO格式(class_id x1 y1 x2 y2 ...多边形坐标),准备好YAML配置文件即可开训:

model = YOLO("yolo26n-seg.pt") # 加载预训练权重

model.train(data="your_data.yaml", epochs=100, imgsz=640, batch=16)

小建议:先用nano模型快速跑通流程、调通数据,再换大模型冲精度。

4. 别光看图,看指标!

训练完一定要跑验证,肉眼看容易“自嗨”:

metrics = model.val()

print(f"Mask mAP50-95: {metrics.seg.map:.4f}")

如果Box mAP很高但Mask mAP很低,

说明模型框找得准,但轮廓很拉胯,

需要从数据质量或模型尺度上找原因。

边缘部署:ONNX + TensorRT 一键丝滑导出

模型练得好,部署跑不了也是白搭。YOLO26最大的护城河就在于一键导出各种硬件格式,而且导出后的推理接口和PyTorch几乎零差异!

导出ONNX(通用CPU/端侧):

yolo export model=best.pt format=onnx simplify=True

导出TensorRT(NVIDIA GPU/Jetson):

yolo export model=best.pt format=engine half=True # 开启FP16,速度翻倍

导出后直接当模型加载:

model = YOLO("best.engine") # 或者 best.onnx

results = model("test.jpg")

完全不需要你手写繁琐的预处理和后解析脚本,这点对落地工程师来说简直是福音。

避坑指南:实战中你必须知道的3个局限

虽然YOLO26-Seg很强,但千万别把它当万能药,实战中有几个坑必须注意:

COCO类别的偏差:预训练模型只认识COCO的80类。实测中你会发现,它容易把鹿认成羊,把水瓶认成花瓶——因为训练集里根本没这些细分。垂直场景必须微调,千万别直接裸跑。

重度遮挡容易“糊”:当目标重叠非常严重时(比如密密麻麻的牛群),单阶段模型很容易把两个实例的掩码连在一起。这时候需要适当降低置信度阈值召回更多目标,或者结合追踪算法(如BoT-SORT)时序修正。

高速运动模糊会漏检:画面出现严重运动模糊时,目标置信度会断崖式下降。对速度要求极高的场景,可以尝试把conf调低至0.1左右,再用业务逻辑做二次过滤。

选型建议:到底该用哪个版本?

有GPU服务器,死磕精度:直接上yolo26x-seg或yolo26l-seg,配合TensorRT,依然能打实时。

Jetson / 边缘计算盒:yolo26n-seg + TensorRT FP16,速度与精度的黄金组合。

纯CPU / 移动端:yolo26n-seg + ONNX / OpenVINO,牺牲一点帧率换可跑性。

医疗/工业质检等抠细节场景:选中等以上模型,并在自己数据上精调,务必开启多尺度评估。

写在最后

YOLO26-Seg的横空出世,本质上把“像素级实时理解”的门槛又打下来了一截。NMS-free架构解决了部署痛点,MuSGD和Proto升级拉高了精度上限,再加上Ultralytics全家桶的易用性,从算法验证到落地部署,真正做到了一条龙。

完整项目代码:

#实现示例分割

,并备注 box 框,分割 mask 采用不同颜色展示

from ultralytics import YOLO

import cv2

import matplotlib.pyplot as plt

import numpy as np

# 加载模型

model = YOLO("yolo26n-seg.pt")

# 推理

results = model("11.png", conf=0.25, iou=0.45)

result = results[0]

original = cv2.cvtColor(result.orig_img, cv2.COLOR_BGR2RGB)

h, w = original.shape[:2]

print(f"检测到物体数量: {len(result.boxes)}")

if result.masks is not None:

masks = result.masks.data.cpu().numpy() # (N, H, W)

boxes = result.boxes

# 创建一个3通道的黑色背景图 (H, W, 3)

combined_color = np.zeros((h, w, 3), dtype=np.uint8)

for i, (mask, box) in enumerate(zip(masks, boxes)):

# 1. 处理 Mask

mask_resized = cv2.resize(mask, (w, h))

mask_bool = mask_resized > 0.5

# 为当前物体生成随机颜色 (RGB格式,范围50~255)

color_rgb = np.random.randint(50, 256, 3).tolist()

# 在 mask 对应位置填色

combined_color[mask_bool] = color_rgb

# 2. 处理 Box 检测框

# 提取边界框坐标 (x1, y1, x2, y2)

x1, y1, x2, y2 = map(int, box.xyxy[0].tolist())

# 提取类别和置信度

cls_id = int(box.cls[0])

cls_name = result.names[cls_id]

conf = float(box.conf[0])

# 注意:cv2.rectangle 和 cv2.putText 使用的是 BGR 颜色格式,所以需要反转

color_bgr = color_rgb[::-1]

# 画矩形框 (线宽设为3)

cv2.rectangle(combined_color, (x1, y1), (x2, y2), color_bgr, thickness=3)

# 并排展示:原图 vs 带Box的彩色mask

fig, axes = plt.subplots(1, 2, figsize=(16, 7))

axes[0].imshow(original)

axes[0].set_title("Original", fontsize=14)

axes[0].axis("off")

axes[1].imshow(combined_color)

axes[1].set_title("Colored Masks with Bounding Boxes", fontsize=14)

axes[1].axis("off")

plt.tight_layout()

plt.show()

else:

print("未检测到任何 mask")更多transformer,VIT,swin tranformer

参考头条号:人工智能研究所

v号:人工智能研究Suo, 启示AI科技动画详解transformer 在线视频教程

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)