AI Coding Agent:OMO、Goose、Ralph Wiggum、x-cmd、HolyClaude、Halo

AI辅助编码系列包括:

- Vibe Coding、AI IDE/插件

- Claude Code实战

- AI IDE/插件(二):Zed、SpecKit、OpenCode、Roo Code、Plandex、Flyde、iFlow CLI

- AI IDE/插件(三):OpenHands、TaskMaster、DeepCode、cc-switch、ZCF、KimiCLI、CodeBuff、Neovate、CatPaw、CodeFlicker

- Claude Code生态:CCR、SuperClaude、opcode、CCUsage

- Claude Code生态(二):Everything CC、Claude-Mem、Ruflo、Auto-Claude、CC StatusLine、CodePilot

- AI Coding Agent:Aider、vibe-kanban、Trellis、MonkeyCode、Synkra AIOS、Letta Code、Mux、OpenDevTeam

- 蚂蚁百灵研发助手CodeFuse介绍

OMO

官网,开源(GitHub,56.3K Star,4.6K Fork)辅助工具,oh-my-opencode简称,OpenCode的Orchestration Layer(代理编排层)。

OpenCode Serve、OpenCode Web

| 维度 | Claude Code | OpenCode原生 | Open Code+oh-my-opencode |

|---|---|---|---|

| 开源程度 | 闭源 | 开源 | 开源(基于开源OpenCode) |

| 多代理并行 | 不支持(单会话单代理) | 基础支持 | 原生支持后台多代理+专业角色分工 |

| 模型自由度 | 只Claude | 75+Provider | 继承+更好token管理 |

| 终端体验 | Web为主 | 极致TUI | 极致TUI+tmux实时监控多代理 |

| SKILLS.md/Hooks | 原生支持 | 近期补齐 | 完整支持+更多预置hooks |

| 每月成本 | 几百块 | 0元起(自带免费模型) | 0元起(可接自己订阅) |

| 社区热度(2026.2) | 高 | 很高(95k+star) | 爆发式增长(Reddit/HN刷屏) |

内置功能

内置3大skills

- playwright:浏览器自动化

- frontend-ui-ux:有UI设计任务时候触发

- git-master:commit, rebase, squash, blame时触发

内置MCP

- websearch

- context7 库稳定搜索

- grep_app

内置7大编程Agent

- Sisyphus 使用 claude opus 4.5,通过专业子代理进行规划、委托和执行复杂任务,并进行激进的并行执行

- Oracle:设计、调试 (GPT 5.2 Medium)

- Libraian:官方文档、开源实现、代码库探索 (Claude Sonnet 4.5)

- Explore:极速代码库探索(上下文感知 Grep)(Claude Haiku 4.5)

- Hephaestus:探索代码库模式,完成任务从头到尾,不提前中断,入研究。(gpt-5.3-codex)

- Multimodal Looker:多模态专家,分析 PDF、图片、图表以提取信息 (google/gemini-3-flash)

- Prometheus:

Hephaestus 和 Sisyphus + ulw 的区别就是,大多数任务 :输入 Sisyphus 的 ulw,Hephaestus 更需要 GPT-5.2 Codex 的推理风格来进行深入的架构工作或复杂调试,适合需要“彻底自主、不打扰用户”的深度编码任务。

配置文件oh-my-opencode.json

- 项目级:

.opencode/oh-my-opencode.json - 用户级:

~/.config/opencode/oh-my-opencode.json

{

"$schema": "https://raw.githubusercontent.com/code-yeongyu/oh-my-opencode/master/assets/oh-my-opencode.schema.json",

"agents": {

// Override specific agents only - rest use fallback chain

"atlas": { "model": "anthropic/claude-sonnet-4-5", "variant": "max" },

"librarian": { "model": "zai-coding-plan/glm-4.7" },

"explore": { "model": "opencode/gpt-5-nano" },

"multimodal-looker": { "model": "zai-coding-plan/glm-4.6v" }

},

"categories": {

// Override categories for cost optimization

"quick": { "model": "opencode/gpt-5-nano" },

"unspecified-low": { "model": "zai-coding-plan/glm-4.7" }

},

"experimental": {

"aggressive_truncation": true

}

}

斜杠命令

/init-deep:初始化AGENTS.md知识库/ralph-loop:开始开发循环直到完成/ulw-loop和ralph-loop:更激进,更高强度/cancel-ralph:取消活跃的拉尔夫环/start-work:从普罗米修斯生成的计划开始执行

推荐按需使用场景:

- 简单任务:直接输入提示词,通常是单文件修改

- 复杂任务:只要输入 ulw,解释上下文很麻烦

- 复杂精确任务:

@plan→/start-work,普罗米修斯Plan,阿特莱斯执行Executor

Goose

官网,Block(Square和Cash App的母公司)开源(GitHub,44.3K Star,4.5K Fork)基于Rust的终端本地优先智能体、可扩展的工程/企业向AI Agent平台,内置JS引擎Boa(Rust写的),安全代码执行沙箱。

侧重把企业既有工具(通过MCP扩展)与本地执行能力结合,解决工具碎片化、隐私合规、多 agent 编排与工程效率提升等问题。官方文档。

解决痛点:

- 工程/研发效率低:减少在大型代码库与工具链间的上下文切换。

- 工具碎片化:以 MCP 标准把各种内部系统变成统一的“可调用工具”。

- 隐私/合规:本地执行、自托管,便于审计与合规控制。

- 复杂任务编排:支持 subagents/orchestrator + shared memory 来拆分并行复杂任务。

- 治理与审计缺失:central agent 层可插入审计、人工审批与验证环节,降低 hallucination 风险。

功能:

-

MCP协议支持

-

.gooseignore:敏感文件配置 -

yaml文件Recipes

-

定位:面向工程/企业的可扩展、本地优先的 AI agent 平台(open-source + enterprise-features)。

-

目标客户:Platform engineering、SRE、内部 Developer Platform 团队、有数据主权/合规需求的企业。

-

价值主张:把内部工具快速标准化为 LLM 可调用的工具集,提供审计/记忆/编排能力以实现可治理的Agent化生产力提升。

对比

| 产品 | 定位 | 强项 | 短板 |

|---|---|---|---|

| Goose | 企业向开源agent平台 | MCP扩展、桌面/CLI本地运行、技能池 | 社区与文档仍在增长,企业化套件需补强 |

| LangChain | 开发框架/SDK | 丰富插件、广泛生态 | 需要工程化投入以生产化 |

| Auto/GPT之类 | 开源自动agent demo | 快速试验与玩法示范 | 生产化治理能力弱 |

| 商业托管产品(Copilot/Anthropic等) | 托管/服务 | UX、SLA、企业支持 | 不开源、定制受限、成本高 |

架构

- Interface(CLI / Desktop):用户输入与结果展示层

- Agent运行时:负责

run-loop、提示词构造、工具调用和会话管理 - Extensions / MCP服务器:以MCP暴露Tools(工具/能力),Agent作为客户端发现并调用

crate

- •

crates/goose:Agent 主体与 CLI / session 管理实现。 - •

crates/goose-mcp:MCP 客户端/工具发现与调用实现(工具 schema 的发现与 RPC)。 - • 依赖线索:

tokio-cron-scheduler(定时/心跳)、sqlx(持久化)、各种扩展/extension crate。

关键模块

- Agent run-loop

- 流程:Human request → 构造 prompt(包含 available_tools)→ LLM 生成 response / tool call → Agent 调用工具(MCP 或本地 provider)→ 将结果返回模型并继续 loop

- 错误处理:将 tool 错误当作 tool-response 反馈给 LLM 以促成模型纠正或重试。

- Tools 注册与工具集(含 CLI)

- 通过 MCP discovery(如 tools/list)把扩展工具 schema 拉取并纳入可用工具清单,清单随提示词一并发送给模型

- CLI 类型 provider 可被包装为 MCP extension,或由 Agent 本地在启动时发现并注册。

- Skills,技能池,可复用的一组指令与 supporting files(SKILL.md 等),Agent 在会话或触发时发现并加载,用于标准化常见工作流(部署检查表、代码审查流程等)。

- 上下文管理(Context Management)

- 当会话历史超阈值时,Agent 会触发 context compaction / summary,将早期对话摘要替换以节约 token

- 支持静态注入文件(如 .goosehints)和按需加载的 supporting files。

- 记忆管理(Memory)与多智能体协作

- Memory MCP 是内置扩展,可做持久化记忆的读写;Knowledge Graph Memory 支持关系化记忆与复杂关联检索

- 多 agent 协作场景下,记忆层应作为共享持久层,子 agent 通过 MCP tool 读写 memory 来同步状态与产物。

- 心跳 / 定时调度(Heartbeat):基于

tokio-cron-scheduler调度器来实现周期性任务(定期compaction、flush或监控检查)以及主动触发逻辑(基于监控或记忆决策触发新的任务)。

差异化路线图建议(优先级)

- 企业治理套件(审计/审批/白名单):高优先级

- 记忆层强化(命名空间、权限、KG支持):高优先级

- 安全沙箱与结果验证(自动测试/静态分析):中优先级

- 企业连接器与SSO集成:中优先级

- 运营面板(监控、成本、错误率):中低优先级

GTM与商业模式建议

- 双轨模式:免费开源社区版 + 收费企业版(支持、SLA、企业 connectors)。

- 早期落地目标:Platform engineering / DevTools 团队的技术试点项目(展示时间/效率节省)。

- 渠道:开源社区、SRE/DevRel合作、案例研究展示ROI。

风险

- 幻觉/不可靠执行:通过Agent层强制“工具实测→返回→人工确认”的工作流

- 生态成熟度不足:提供付费支持并培养认证扩展生态

- 合规审计难度:提供详细审计日志、可回溯的

tool call traces与memory change logs

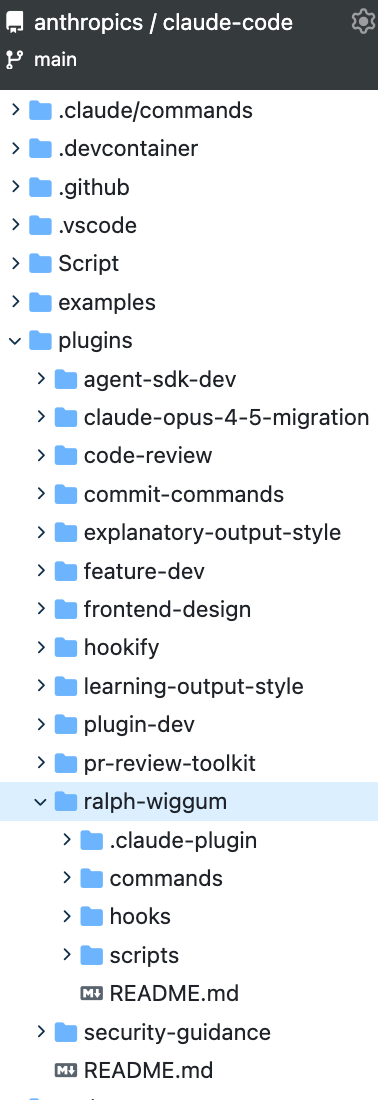

Ralph Wiggum

CC官方自带插件。

单独使用BMAD或Ralph都有局限:

| 框架 | 优势 | 短板 |

|---|---|---|

| BMAD | 结构化流程、角色分工、可追溯工件 | 执行阶段需要人工监督 |

| Ralph Wiggum | 自主执行、迭代优化、无需干预 | 缺乏结构、容易偏离目标 |

两者结合,BMAD提供"做什么"和"为什么",Ralph提供"怎么做"的自主执行。

| 框架 | 结构化程度 | 自主执行 | 学习曲线 |

|---|---|---|---|

| BMAD+Ralph | 高 | 高 | 中 |

| 纯BMAD | 高 | 低 | 中 |

| 纯Ralph | 低 | 高 | 低 |

| GSD | 中 | 中 | 低 |

| Spec Kit | 高 | 低 | 高 |

统一框架的四个阶段

阶段一:发现(Discovery)

目标:理解问题空间,收集上下文

BMAD 的 Analyst 代理负责这个阶段:

- 梳理业务需求和技术约束

- 识别利益相关者和成功标准

- 产出:Brief 文档

Ralph 模式:这个阶段不用 Ralph。发现需要人的参与和判断。

阶段二:规划(Planning)

目标:制定实现方案,拆分任务

BMAD 的 PM 和 Architect 代理介入:

- PM:产出 PRD(产品需求文档)

- Architect:产出技术架构设计

- 产出:PRD + Architecture Doc + Story List

Ralph 模式:仍然不用。规划需要架构决策,风险太高。

阶段三:执行(Execution)

目标:按 Story 实现代码

这是 Ralph Wiggum 大显身手的地方。

配置 Ralph 执行循环:

执行模式:

- Ralph 读取 Story 和验收标准

- 生成代码实现

- 运行测试验证

- 如果失败,自动调整并重试

- 循环直到所有验收标准通过

阶段四:验证(Verification)

目标:端到端质量检查

BMAD 的 QA 代理 + Ralph 协同:

- QA:定义验证场景和边界用例

- Ralph:自动执行验证流程

安装

npx bmad-method@alpha install

/plugin install ralph-wiggum@claude-plugins-official

/bmad:bmm:workflows:quick-dev

/ralph-loop start --story=Story-001

.bmad/ralph-config.yaml配置文件:

# Ralph 执行配置

max_iterations: 20

exit_conditions:

- all_tests_pass

- no_type_errors

- build_success

- coverage_above_80

notification:

on_complete: true

on_iteration: false

# 成本限制

cost_limit:

max_usd_per_task: 5.00

alert_at: 3.00

注意事项,不是所有任务都适合自动循环:

- 架构决策:需要人的判断

- 安全相关代码:需要人工审核

- 用户体验改动:需要人工验证

- 外部API集成:可能产生真实费用

长循环会导致上下文膨胀。解决方法:

- 每个Story完成后重启Ralph

- 使用

git作为记忆层 - 定期执行

/compact压缩上下文

x-cmd

英文官网,中文官网,开源(GitHub,4.4K Star,142 Fork)。

提供export与import子命令,用于会话数据的导出与恢复;适用于在不同设备、不同环境之间同步Claude会话,或在重装、清理环境后进行会话恢复。

x openclaw --install

# 导出当前项目的会话数据

x claude sess export

# 导入会话数据到当前项目

x claude sess import backup.tar.gz

x upgrade beta

HolyClaude

官网,开源(GitHub,2.2K Star,231 Fork)。

旨在解决问题:

- Docker默认64MB共享内存死锁会导致Chromium标签页无限崩溃;

- 容器内外UID与GID的不匹配将引发灾难级的Permission Denied权限拒绝;

- 缺失

Xvfb虚拟显示器会使得无头浏览器的前端测试直接瘫痪; - 官方安装器也会在root权限的WORKDIR挂载目录下彻底卡死。

预装Claude Code CLI、可通过浏览器访问的终端UI、原生无头浏览器、7款AI命令行工具以及50多款开发工具;包揽从代码生成到视觉审计的数字沙盒。。智能体(Agent)可以快速拉起Web应用、导航访问、截取屏幕并运行视觉测试,而容器绝不会因此崩溃。

架构体系

- 顶层(交互层):CloudCLl(端口3001)浏览器级的多会话终端

- 核心层(执行引擎):官方ClaudeCode CLI+另外6款顶尖AI代理

- 生态层(环境支持):Xvfb虚拟显示器 (:99) + Headless Chromium +全栈开发工具链

- 底座(工业级守护):

s6-overlay(PID1)–负责进程监控、僵尸进程回收与优雅停机(而非不可靠的Docker原生重启)

亮点

- AI代理的视觉盲区被原生无头浏览器技术彻底照亮。系统在底层强行粉碎Docker残缺的64MB共享内存锁死限制,直接硬核划拨2GB的

shm_size庞大内存池。配合预置的1920x1080虚拟桌面与Playwright自动化框架,这套硬核配置直接赋予智能体自动化网页截图、UI测试审查以及Lighthouse性能审计的完整三维视觉感知能力 - 在默认的

allowEdits防御模式下,系统允许全速的自动化文件读写,但对Shell危险命令与底层包安装死守最后的人类授权底线。对于追求极致并发的硬核极客,只需开启Bypass Mode超频模式,即可彻底拆除所有交互提示弹窗,将最高信任权移交智能体,进入真正无人值守的全自动工程构建深水区 - 默认防线(allowEdits):自动读写文件。但在执行Shell命令和安装系统包时,必须请求人类授权

- 极客超频(Bypass Mode):信任你的Al。开启完全无提示执行模式,真正实现无人值守的全自动工程构建

技术栈:

Halo

官网,开源(GitHub,1.4K Star,123 Fork)GUI工具,

功能:

- 多供应商支持:

- 远程访问:从手机、平板或任何浏览器控制

- 文件预览与管理

- 内置AI浏览器

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

所有评论(0)