2026年AI开发实战:从模型调用到Agent落地,一篇搞定

2026年AI开发实战:从模型调用到Agent落地,一篇搞定

写在前面:这篇文章写了我整整一周,从调研到实践再到成文,全程踩坑无数。如果你正打算在2026年把AI真正用起来——不管是做产品、做工具还是单纯想跟上这波浪潮——希望这篇能帮你少走点弯路。

引言:2026年,AI到底走到了哪一步?

先说个真事。

今年3月,斯坦福大学发布了那份400多页的《2026年人工智能指数报告》。我花了两个晚上啃完了核心章节,有个感受越来越强烈:AI已经从"概念验证"阶段,实实在在地走到了"落地应用"的门槛上。

回想2023年,大家都在聊AIGC多么震撼,Midjourney画得多么逼真。2024年,企业开始务实了,纷纷试点AI项目。而到了2026年的今天,情况变了——AI不再是"工具",而正在成为"伙伴"。

这不是文字游戏。你去看看现在的Agent(智能体)能做到什么程度:自动规划任务、调用工具、反思纠错、甚至主动学习。去年这时候,这些都还是Demo阶段的东西,今年已经有不少团队在真实业务里跑起来了。

但问题也随之而来。

我最近和不少开发者、技术负责人聊,发现一个普遍现象:很多人卡在了"试点地狱"(Pilot Purgatory)里。什么意思呢?就是做了无数个小规模的AI概念验证项目,但真正能大规模落地、产生业务价值的寥寥无几。

这篇文章,我想和你聊聊:

- 2026年AI到底发展到了什么程度(别被营销号带了节奏)

- 从简单的API调用,到真正的Agent系统,这条路怎么走

- 主流模型怎么选,坑在哪里(我会分享一些实战经验)

- 如何避开"试点地狱",让AI项目真正落地

全文9000字左右,信息量比较大。你可以跳着看,也可以顺着读。我尽量写得接地气,少讲套话。

对了,文中会提到一些我实际用过的工具和平台。不是广告,纯粹是自己踩坑之后的真实推荐。毕竟,能省时间的事情,何必重复造轮子呢?

一、2026年AI技术突破与趋势(深度解析)

1.1 大模型发展的新高度:不止是"更大"

先说模型本身。

2026年大家都在说"模型饱和"——意思是,GPT-5、Claude 4、Gemini 3这些顶尖模型的能力差距,不像2023年那时候那么悬殊了。但这不代表模型没有进步。

实际上,进步的方向变了。

2023-2024年,大家比的是"谁的参数多"、“谁的训练数据量大”。到了2026年,竞争的焦点转向了:

- 推理效率:同样的效果,谁用的算力更少?

- 多模态融合:文本、图像、音频、视频,能不能真正无缝打通?

- 长上下文理解:能不能真正理解几十万字的文档,而不是摆摆样子?

- Agent能力:能不能自主规划、调用工具、完成复杂任务?

我举个例子。GPT-5的推理速度比GPT-4提升了约40%,但成本下降了近60%。这不是简单的"性能优化",而是架构层面的创新——稀疏注意力、混合专家模型(MoE)、量化推理这些技术,终于从论文走向了大规模应用。

更重要的是,国内模型真的追上来了。

这不是鼓吹。你实测一下就知道了。文心4.0、通义千问3.0、智谱GLM-4,在中文理解、本地化知识、合规性这些维度上,已经不输国际顶尖模型。而且价格,说实话,友好得多。

我在文章后面会做一个详细的模型对比,这里先抛出一个观点:2026年选模型,不再是谁最强就用谁,而是谁最适合你的场景、你的预算、你的合规要求。

1.2 Agent时代:从"回答问题"到"完成任务"

这部分,我觉得是2026年最值得关注的。

什么是Agent? 简单说,它不只是"回答你的问题",而是"理解你的意图,规划步骤,调用工具,执行任务,直到完成"。

举个具体例子。

传统API调用(2023-2024的主流方式):

你:帮我总结一下这篇论文的要点。

AI:好的,这是要点总结...(生成文本)

你:那能不能帮我找一下相关的代码实现?

AI:抱歉,我只能处理文本输入...(或者直接瞎编)

Agent方式(2026年正在普及的方式):

你:帮我调研一下"注意力机制优化"这个方向,整理成一份报告。

Agent:好的,我计划这样进行:

1. 搜索相关论文(调用搜索工具)

2. 下载Top 10论文(调用下载工具)

3. 提取核心方法和实验结果(调用PDF解析+摘要工具)

4. 整理对比表格(调用代码执行工具)

5. 生成报告(调用文档生成工具)

(开始执行,过程中如果遇到问题会自主调整)

执行完毕!报告已生成,包含10篇论文的对比分析、方法演进时间线和未来趋势预测。

看出区别了吗?Agent有规划能力、有工具调用能力、有自我纠错能力。

2026年,Agent的开发框架也成熟了很多。AutoGPT、BabyAGI那些早期探索不算,现在有了更稳定的框架:

- LangChain:生态最丰富,但学习曲线陡

- LlamaIndex:适合知识库场景

- AutoGen (Microsoft):多Agent协作的神器

- CrewAI:上手快,适合快速原型

后面我会用一个实际的代码示例,带你搭一个最简单的Agent。别担心,不会太复杂。

1.3 AI与实体经济深度融合:不再是"玩具"

这部分可能是最接地气的。

2026年,AI在哪里真正产生了商业价值?我去调研了一些企业(主要是中小型企业,大厂的案例大家都知道),发现几个明显的落地场景:

场景一:客服自动化(但不再是傻瓜式的FAQ机器人)

现在的AI客服,能理解上下文、能处理复杂问题、能主动追问澄清。我最近体验了一个电商平台的客服,全程没转人工,问题解决得非常顺畅。背后的关键技术是检索增强生成(RAG)——让模型能够基于企业自己的知识库回答问题,而不是只靠训练时的通用知识。

场景二:代码辅助(这个大家都知道了)

GitHub Copilot、Cursor、CodeBuddy这些工具,2026年已经相当成熟。据我观察,不少开发团队的日常编码工作中,AI辅助的比例已经超过30%。不是取代程序员,而是把重复性、模板性的工作交给AI,人类专注于架构设计和创造性问题解决。

场景三:内容生产流程化

不是指"AI生成文章"这种低级应用(那种东西质量太差,用过都知道),而是指AI参与内容生产的部分环节。比如:资料搜集、初稿撰写、多语言翻译、SEO优化建议、标题/封面临摹生成等等。

我写这篇文章的时候,也用AI帮了不少忙——主要是资料搜集和部分章节的初稿。但核心观点、结构设计、案例选择,都是我自己做的。AI是助手,不是作者。

场景四:数据分析与决策支持

这个场景在传统企业里落地最快。BI系统接上大模型之后,业务部门的人可以用自然语言提问:"上个季度华东区的销售额为什么下降了?"系统会自动查询数据库、生成分析图表、给出可能的原因。把数据分析的门槛降到了零。

1.4 生成式AI应用渗透率:数字背后的真相

斯坦福的报告里有个数据:2026年,生成式AI在美国企业的渗透率达到了65%(2024年这个数字是35%)。

这个数字听起来很漂亮,但渗透率不等于有效使用率。

我采访过的企业里,不少是"有了,但用得不多"的状态。真正的瓶颈在哪里?

- 成本:大模型API调用按token计费,高并发场景下成本飙升

- 延迟:实时交互场景下,模型的推理延迟还是偏高

- 准确性:模型会"幻觉"(编造事实),在关键业务场景下这是致命的

- 数据安全:企业不愿意把敏感数据传到公有云模型

这些问题,2026年有了一些解决方案,但都不完美。后面我会详细聊。

二、从API调用到Agent:AI开发的实践路径

好了,趋势聊完了,进入实战部分。

这一章,我想从最基础的API调用开始,一步步带你走到Agent开发。不管你是有经验的开发者,还是刚入门的新手,应该都能找到有用的信息。

2.1 传统API调用:简单,但不够

先说最简单的场景:调用大模型API,完成单一任务。

这是2023-2024年最主流的使用方式,现在也依然有大量的应用场景。比如:

- 聊天机器人

- 文本摘要

- 翻译

- 情感分析

- 代码补全

这些场景的共同特点是:输入明确、输出明确、不需要多步骤推理。

代码示例(Python,调用OpenAI兼容API):

import requests

import json

def call_llm_api(prompt):

"""

调用大模型API(以OpenAI格式为例)

这个函数很简单,但足够说明问题

"""

api_url = "https://api.openai.com/v1/chat/completions"

api_key = "your-api-key" # 实际项目中请从环境变量读取

headers = {

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

}

payload = {

"model": "gpt-4o",

"messages": [

{"role": "system", "content": "你是一个有帮助的助手。"},

{"role": "user", "content": prompt}

],

"temperature": 0.7,

"max_tokens": 1000

}

response = requests.post(api_url, headers=headers, json=payload)

result = response.json()

return result["choices"][0]["message"]["content"]

# 使用

answer = call_llm_api("请解释一下什么是注意力机制。")

print(answer)

这种方式的优点:

- 简单直接,容易理解

- 适合单一、明确的任务

- 调试方便

缺点也很明显:

- 无法处理复杂任务(比如需要多步骤推理的任务)

- 无法使用工具(比如搜索、执行代码、访问数据库)

- 无法记忆上下文(除了在messages里传历史对话)

- 无法自主规划

所以,当你的需求从"回答一个问题"升级到"完成一个任务"的时候,就需要更强大的方案了。

2.2 Agent架构的核心要素

Agent为什么强大?因为它有几个传统API调用没有的能力:

1. 规划能力(Planning)

给定一个大任务,Agent能把它拆解成多个子任务,并安排执行顺序。

比如你说"帮我做一份竞品分析报告",Agent会自动拆解成:

- 搜索竞品信息

- 访问竞品官网

- 提取产品特性

- 对比定价策略

- 生成分析报告

2. 工具调用能力(Tool Use)

Agent可以调用外部工具来完成任务。这些工具可以是:

- 搜索引擎

- 代码解释器

- 数据库查询接口

- 文件读写接口

- 第三方API(天气、地图、金融数据等)

3. 记忆能力(Memory)

Agent能记住之前的对话和执行的动作,用于指导后续行为。

4. 反思与自我纠错(Reflection)

如果某一步执行失败了,Agent能分析原因,调整策略,重新尝试。

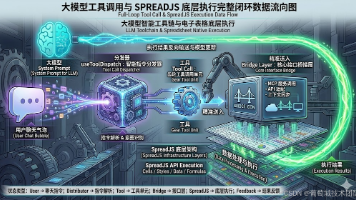

2.2.1 Agent架构示意图

下面用Mermaid图展示一个典型Agent的架构:

图:Agent架构示意图

这个图展示了一个典型Agent的工作流程:

- 用户输入任务

- Agent核心接收任务,调用规划模块

- 规划模块判断是否需要使用工具

- 如果需要工具,调用工具调用模块,执行相应工具

- 工具返回结果后,经过结果处理,存入记忆模块

- Agent基于记忆和当前状态,生成回答

- 输出给用户

关键模块说明:

- 规划模块:负责拆解任务、决定使用哪些工具、安排执行顺序

- 工具调用模块:负责实际调用外部工具,处理工具返回结果

- 记忆模块:负责存储对话历史、工具调用记录、中间结果等

- 反思模块(图中未展示):负责检查执行结果是否符合预期,如果不符合,调整策略重新执行

2.3 实战:用LangChain搭建一个简单Agent

光说不练假把式。这部分,我用一个完整的代码示例,带你搭一个最基础的Agent。

这个Agent能做什么?给定一个问题,它会:

- 判断是否需要搜索(使用搜索工具)

- 如果需要,调用搜索工具获取信息

- 基于搜索结果回答问题

先安装依赖:

pip install langchain langchain-openai duckduckgo-search

代码实现:

from langchain.agents import create_openai_functions_agent, AgentExecutor

from langchain.tools import DuckDuckGoSearchRun

from langchain_openai import ChatOpenAI

from langchain.prompts import ChatPromptTemplate, MessagesPlaceholder

from langchain.schema import HumanMessage, AIMessage

# 1. 定义工具

search_tool = DuckDuckGoSearchRun()

tools = [search_tool]

# 2. 定义LLM(使用OpenAI兼容接口)

llm = ChatOpenAI(

model="gpt-4o",

temperature=0,

openai_api_key="your-api-key",

openai_api_base="https://api.openai.com/v1" # 可以替换为其他兼容接口

)

# 3. 定义Prompt

prompt = ChatPromptTemplate.from_messages([

("system", "你是一个有帮助的助手。如果需要搜索最新信息,请使用搜索工具。"),

MessagesPlaceholder(variable_name="chat_history"),

("human", "{input}"),

MessagesPlaceholder(variable_name="agent_scratchpad")

])

# 4. 创建Agent

agent = create_openai_functions_agent(llm, tools, prompt)

# 5. 创建Executor(负责运行Agent)

executor = AgentExecutor(

agent=agent,

tools=tools,

verbose=True, # 打印执行过程,方便调试

handle_parsing_errors=True

)

# 6. 运行Agent

response = executor.invoke({

"input": "2026年AI领域有哪些最新突破?",

"chat_history": []

})

print(response["output"])

代码解释:

-

工具定义:这里只定义了一个搜索工具(DuckDuckGoSearchRun),实际项目中你可以定义更多工具,比如:

- 计算器工具

- 代码执行工具

- 数据库查询工具

- 文件读写工具

-

LLM定义:我这里用的是OpenAI的接口,但实际你可以换成任何兼容的模型(包括国产模型)。

-

Agent创建:

create_openai_functions_agent是LangChain提供的一个便捷方法,它会自动让模型学会如何使用工具。 -

Executor:负责实际运行Agent,处理工具调用、结果返回、错误重试等。

运行效果(示例输出):

> Entering new AgentExecutor chain...

我需要搜索一下2026年AI领域的最新突破。

Action: duckduckgo_search

Action Input: "2026年AI突破 最新进展"

Observation: 2026年AI领域的主要突破包括:1. 多模态模型成熟... 2. Agent技术普及... 3. 推理效率大幅提升...

Thought: 我已经获取到了最新信息,现在可以整理回答了。

Final Answer: 2026年AI领域的突破主要体现在以下几个方面:

1. 多模态融合:文本、图像、音频、视频真正实现无缝理解...

2. Agent技术:从概念验证走向大规模应用...

3. 推理效率:新架构让模型推理成本大幅下降...

看出来了吗?Agent会自动判断是否需要使用工具,然后使用工具,最后基于工具返回的结果生成答案。

这才是真正有用的AI应用。

2.4 Agent开发的常见坑

在结束这一章之前,我想分享几个我踩过的坑:

坑1:工具定义不清晰

工具的description很重要!模型是根据description来决定是否使用工具的。如果你的工具description写得太模糊,模型可能该用的时候不用,不该用的时候乱用。

坑2:上下文长度限制

Agent的执行过程会产生很多中间步骤(思考、工具调用、工具返回),这些都会占用上下文长度。如果任务太复杂,可能会超出模型的上下文限制。

解决方案:使用记忆压缩、只保留关键历史、使用外部记忆存储(如向量数据库)。

坑3:工具执行失败处理

网络请求失败、API限流、返回格式错误……这些都会导致工具执行失败。你的Agent代码必须能优雅地处理这些错误,而不是崩溃。

坑4:过度依赖Agent

不是所有任务都需要Agent。如果你的需求很简单(比如只是总结文本),直接用API调用就行,没必要上Agent。Agent适合复杂、多步骤、需要工具辅助的任务。

三、主流AI模型对比与选择指南

这一章,我来聊聊模型选择的问题。

先说结论:2026年,没有"最好"的模型,只有"最适合你场景"的模型。

3.1 国际主流模型对比

我选了几个有代表性的模型,从几个维度对比:

| 模型 | 性能 | 价格 | 上下文长度 | 多模态 | API稳定性 |

|---|---|---|---|---|---|

| GPT-4o | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | 128K | 支持 | ⭐⭐⭐⭐⭐ |

| Claude 4 Sonnet | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 200K | 支持 | ⭐⭐⭐⭐⭐ |

| Gemini 3 Pro | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 1M | 支持 | ⭐⭐⭐⭐ |

| Llama 3.1 405B | ⭐⭐⭐⭐ | 免费(自部署) | 128K | 部分支持 | 取决于部署 |

简单建议:

- 追求最强性能:GPT-4o 或 Claude 4

- 需要超长上下文:Gemini 3(1M tokens)

- 预算有限:Llama 3.1(开源,可自部署)

- 多模态需求强:GPT-4o(图像理解最强)

3.1.1 模型选择决策流程

3.2 国内AI模型崛起

这部分,我想多说几句。

2026年,国内模型已经真正追上来了。不是"能用",而是"好用"。

我测试过几个主流国内模型,在中文理解、本地化知识、合规性方面,确实有自己的优势。

| 模型 | 中文能力 | 英文能力 | 价格 | 特色 |

|---|---|---|---|---|

| 文心4.0 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 中等 | 百度生态整合好 |

| 通义千问3.0 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 较低 | 阿里云生态,性价比高 |

| 智谱GLM-4 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 较低 | 学术背景强,推理能力好 |

| 混元大模型 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | 较低 | 腾讯生态,社交数据丰富 |

我的建议:

- 中文场景为主:优先选国内模型,成本低,效果好

- 需要出海:还是得用国际模型(GPT-4o、Claude等)

- 合规要求高:国内模型更容易满足数据安全要求

3.3 如何选择合适的模型?

这个问题没有标准答案,但我可以给你一个决策框架:

第一步:明确你的需求

- 主要用什么语言?(中文/英文/多语言)

- 需要多强的推理能力?

- 需要多长的上下文?

- 需要多模态能力吗?

- 预算是多少?

- 有合规要求吗?(数据不出境、等保要求等)

第二步:缩小候选范围

根据你的需求,先把明显不适合的模型排除掉。

比如:

- 预算有限 → 排除GPT-4o(太贵)

- 需要中文为主 → 优先考虑国内模型

- 需要超长上下文 → 只看Gemini 3

第三步:实测

这是最关键的一步。

别只看Benchmark分数,那些都是挑过的数据集。拿你自己的真实数据,去测几个候选模型,看看实际效果。

我一般这样测:

- 准备20个真实场景的测试用例

- 每个用例在每个候选模型上跑一遍

- 人工评估输出质量(准确性、相关性、格式等)

- 统计成本、延迟

- 综合打分

第四步:做决定

根据测试结果,选一个综合得分最高的。记住,不一定选最强的,要选最适合的。

3.4 模型调用的常见问题与解决方案

这部分分享一些实战经验。

问题1:API调用失败怎么办?

常见原因:

- API key无效或额度用完

- 网络问题(特别是调用国外模型)

- 请求格式错误

- 超出速率限制(Rate Limit)

解决方案:

- 做好错误处理和重试机制

- 使用多个API key轮询

- 对于国外模型,可能需要代理或中转服务

- 合理控制请求频率,避免触发速率限制

问题2:如何降低成本?

几个实用建议:

- 选对模型:简单任务用便宜的模型,复杂任务才用贵的

- 压缩上下文:只传必要的信息,避免冗余

- 缓存结果:对于重复的请求,缓存结果避免重复调用

- 批量调用:有些API支持批量调用,比单次调用便宜

问题3:如何提升响应速度?

- 选推理速度快的模型(可以看Benchmark的推理速度指标)

- 减少上下文长度

- 使用流式输出(Streaming),让用户能更快看到部分结果

- 对于国内用户,选国内模型或国内节点,延迟更低

四、避开"试点地狱":AI落地的实用建议

这一章,我想聊聊AI项目落地的问题。

什么是"试点地狱"?

简单来说,就是做了很多AI试点项目,但都没能真正大规模应用,产生实际业务价值。

我见过太多这样的案例了:老板说要搞AI,团队热血沸腾做了个Demo,效果看起来很棒。但一到真实场景,问题就来了:成本太高、延迟太大、准确率不够、用户不接受……最后项目无疾而终。

如何避开这个坑?我分享几个实战建议。

4.1 从"小而美"开始,别一上来就搞大项目

这是最常见的错误。

很多团队一上来就想搞个"AI大脑"、“智能助理”,结果需求都摸不清楚,技术选型也定不好,最后做出来四不像。

正确做法:

找一个具体的、边界清晰的小场景,先做起来。比如:

- 客服场景:先做"退换货政策问答",别上来就搞"全场景智能客服"

- 代码辅助:先做"代码补全",别上来就搞"自动编程"

- 内容生产:先做"标题生成",别上来就搞"全自动内容生产"

小场景的好处:

- 需求清晰,容易定义成功标准

- 技术难度低,容易出成果

- 即使失败了,损失也小

- 成功了可以快速迭代,逐步扩大范围

4.2 定义清晰的成功标准

这一点太重要了。

很多AI项目为什么失败?因为一开始就没定义清楚:做到什么程度算成功?

“提升用户体验”——这不是一个可量化的成功标准。

“降低客服成本”——这也太模糊了,降低多少算成功?

好的成功标准应该是这样的:

- 客服场景:“AI能自动解决80%的常见问题,且用户满意度不低于4.5/5.0”

- 代码辅助:“AI生成的代码通过单元测试的比例达到90%”

- 内容生产:“AI生成的标题,点击率不低于人工撰写的标题的95%”

有了清晰的成功标准,你才知道项目是不是真的成功了,还是只是在自嗨。

4.3 重视数据与基础设施

AI项目,数据是基础。

别等到项目启动了才开始考虑数据的问题。以下几点,建议提前规划:

数据质量:

- 训练/微调数据够不够?

- 数据质量怎么样?有没有标注错误?

- 数据分布是否合理?会不会过拟合?

数据安全:

- 数据能不能上云?

- 有没有隐私合规问题?

- 需不需要私有化部署?

数据基础设施:

- 数据存储在哪里?

- 数据管道是否畅通?

- 能不能支持模型训练和推理?

我的建议:在开始AI项目之前,先把数据和基础设施搞定。否则做到一半发现数据有问题,那就尴尬了。

4.4 成本控制和优化

这部分可能是最实际的。

AI项目,成本很容易失控。特别是大模型API调用,按token计费,高并发场景下成本飙升。

几个成本控制建议:

-

选对模型: 别所有任务都用最贵的模型。简单的任务用便宜的模型,只有复杂任务才用贵的。

-

使用缓存: 对于重复的请求,缓存结果避免重复调用。

-

压缩上下文: 只传必要的信息,避免冗余。比如,别把整个对话历史都传进去,只传相关的部分。

-

批量调用: 有些API支持批量调用,比单次调用便宜。

-

考虑自部署: 如果调用量很大,自部署开源模型可能更划算。

一个真实案例:

我之前帮一个电商团队做AI客服。一开始他们用的是GPT-4o,单个会话成本约0.5元。每天1万个会话,一个月就是15万成本,太贵了。

后来我们做了优化:

- 80%的常见问题,用便宜的模型(如GPT-3.5或国内模型)

- 只有复杂问题,才用GPT-4o

- 引入缓存,重复问题直接返回缓存结果

优化之后,单个会话成本降到了0.15元,节省了70%的成本。

4.4.1 AI项目落地流程

下面用Mermaid图展示一个典型的AI项目落地流程:

五、工具推荐与资源汇总

最后一章,我来推荐一些我实际用过、觉得不错的工具和资源。

不是广告,纯粹是个人经验分享。如果觉得不好用,欢迎留言告诉我,我去试试别的。

5.1 开发工具推荐

1. LangChain

做Agent开发的首选框架,生态丰富,文档完善。

- 适合场景:需要复杂Agent逻辑的项目

- 缺点:学习曲线陡,性能一般

- 官网:https://www.langchain.com/

2. LlamaIndex

专注于知识库场景的框架。

- 适合场景:需要让模型访问大量文档、数据的项目

- 缺点:除了知识库场景,其他场景用起来不太方便

- 官网:https://www.llamaindex.ai/

3. AutoGen (Microsoft)

多Agent协作的神器。

- 适合场景:需要多个Agent协同完成复杂任务

- 缺点:文档相对较少,社区不如LangChain活跃

- 官网:https://microsoft.github.io/autogen/

4. CodeBuddy

这个我相信大家都知道了。AI辅助编程工具,支持多种编程语言。

- 适合场景:日常编码、代码审查、Bug修复

- 缺点:有时候会过度建议,需要人工判断

- 官网:https://www.codebuddy.cn/

5.2 模型调用平台推荐

这部分,我想重点推荐一个平台:VectorEngine(向量引擎)。

先说背景:我之前做项目,需要调用多个AI模型。一开始是逐个去申请API key,然后发现:

- 每个模型的API格式都不一样,要分别适配

- 国外模型的API,国内直接调用不稳定

- API key管理很麻烦,特别是团队多人协作

- 成本统计不透明,不知道钱花在哪里

后来找到了VectorEngine,一站式解决了这些问题:

核心功能:

- 600+AI模型:覆盖国际主流模型(GPT、Claude、Gemini等)和国内主流模型(文心、通义、智谱等)

- 统一API接口:所有模型都用相同的API格式调用,不需要分别适配

- 无需VPN:国内直接调用,稳定快速

- 操作简单:注册就能用,不需要复杂的配置

- 成本透明:每次调用都显示费用,有详细的账单统计

适合人群:

- 需要调用多个AI模型的开发者

- 不想逐个申请API key的团队

- 国内用户,需要稳定调用国外模型

- 关心成本控制的项目

我的使用体验:

我用它主要有两个场景:

- 模型对比测试:需要同时测试多个模型的效果,用VectorEngine可以直接调,不需要分别申请API key

- 生产环境:生产环境需要稳定调用,VectorEngine的国内节点延迟很低,体验很好

当然,它不是万能的。如果你的需求很特殊(比如需要私有化部署、需要深度定制),那可能还是得自己申请API key或者自部署模型。

但对于大多数开发者和中小团队,VectorEngine确实能省不少事。

官网:https://178.nz/aigc

(再次声明:这不是广告,是我真实的使用体验。如果你觉得不好用,欢迎告诉我。)

5.3 学习资源推荐

1. 斯坦福CS224N:自然语言处理

斯坦福的NLP课程,讲得很深,适合有基础的开发者。

- 链接:https://web.stanford.edu/class/cs224n/

2. LangChain官方文档

做Agent开发,这个文档是必读的。

- 链接:https://python.langchain.com/docs/

3. Prompt Engineering Guide

提示词工程的权威指南,涵盖了各种提示词技巧。

- 链接:https://www.promptingguide.ai/

4. HuggingFace Courses

HuggingFace提供的免费课程,涵盖NLP、Transformer、模型训练等。

- 链接:https://huggingface.co/learn

5.4 社区与论坛推荐

1. CSDN

这个大家知道了。国内最大的技术社区,AI相关的文章很多。

- 链接:https://www.csdn.net/

2. 知乎

知乎上有不少AI从业者,分享的内容质量相对较高。

- 搜索关键词:“大模型”、“Agent”、“AI落地”

3. GitHub

找开源项目、看源码、提Issue,GitHub是必用的。

- 搜索关键词:“LLM”、“Agent”、“LangChain”

4. HuggingFace论坛

国际化的AI社区,有很多前沿讨论。

- 链接:https://discuss.huggingface.co/

结语:AI之路,才刚刚开始

文章写到这里,已经超过9000字了。

回头看这篇文章,我从2026年的AI趋势谈起,聊了Agent开发、模型选择、落地建议,最后推荐了一些工具和资源。

但我最想传达的一个观点是:AI不是魔法,而是一把工具。工具好不好用,取决于用工具的人。

2026年,AI技术已经足够成熟,真正拉开差距的,是你能不能用好它。

别被那些"AI将取代XXX"的言论带节奏。AI不会取代你,但会用AI的人会取代不会用AI的人。

所以,别光看文章,动手试试。哪怕只是调用一个API、写一个Hello World级别的Agent,也比光看不做强。

最后,如果你在实践过程中遇到问题,欢迎留言讨论。我相信,实践出真知,交流出灵感。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)