2026年数维杯数学建模竞赛B题满分解析:智能办公场景下多源异构文件识别的“大模型NLP+统筹运筹”全链路求解(附完整公式与核心代码)

大家好!2026年第十一届“数维杯”大学生数学建模挑战赛正如火如荼地进行。纵观今年的赛题,B题《智能办公场景下多源异构文件识别与治理优化》无疑是一道极具现实商业价值和技术深度的顶级赛题。

这道题完美契合了当前“政企数字化转型”的核心痛点:面对海量的、格式交错(Word、PDF、Excel、图片)、结构繁杂的历史与新增文件,如何让AI自动看懂文件、精准分类、并结合极度稀缺的人力资源(每天仅几十个工时)进行最优的复核与归档调度?

本题是一道罕见的“非结构化数据挖掘(NLP) + 多目标综合评价 + 混合整数运筹规划”的大型综合题!如果只用传统的关键词匹配,第一问就会全面崩盘;如果不用数学规划,第三问的排班调度将毫无逻辑。

为了助大家在本次比赛中实现“降维打击”并斩获国奖,我们团队连夜奋战,为大家构建了一套从“多模态文本提取”到“无监督LDA主题聚类”,再到“AHP-TOPSIS分级与运筹学排班”的全链路完美解决方案。以下是全网最详尽的思路拆解、核心数学公式与Python代码实现!

【博主专属科研福利】

如果你需要获取历年数维杯获奖特等奖论文的逐字稿深度逻辑拆解批注版、前沿演化模型的理论推导综述,以及2026年最新科研级标准化排版框架源文件,欢迎在评论区探讨或私信获取完整的高维备考兵器谱!让我们一起,顶峰相见!

https://download.csdn.net/download/qq_40379132/92856091

💡 问题一:混沌中建立秩序——多源异构文件的特征挖掘与无监督分类

【核心痛点与深度解析】

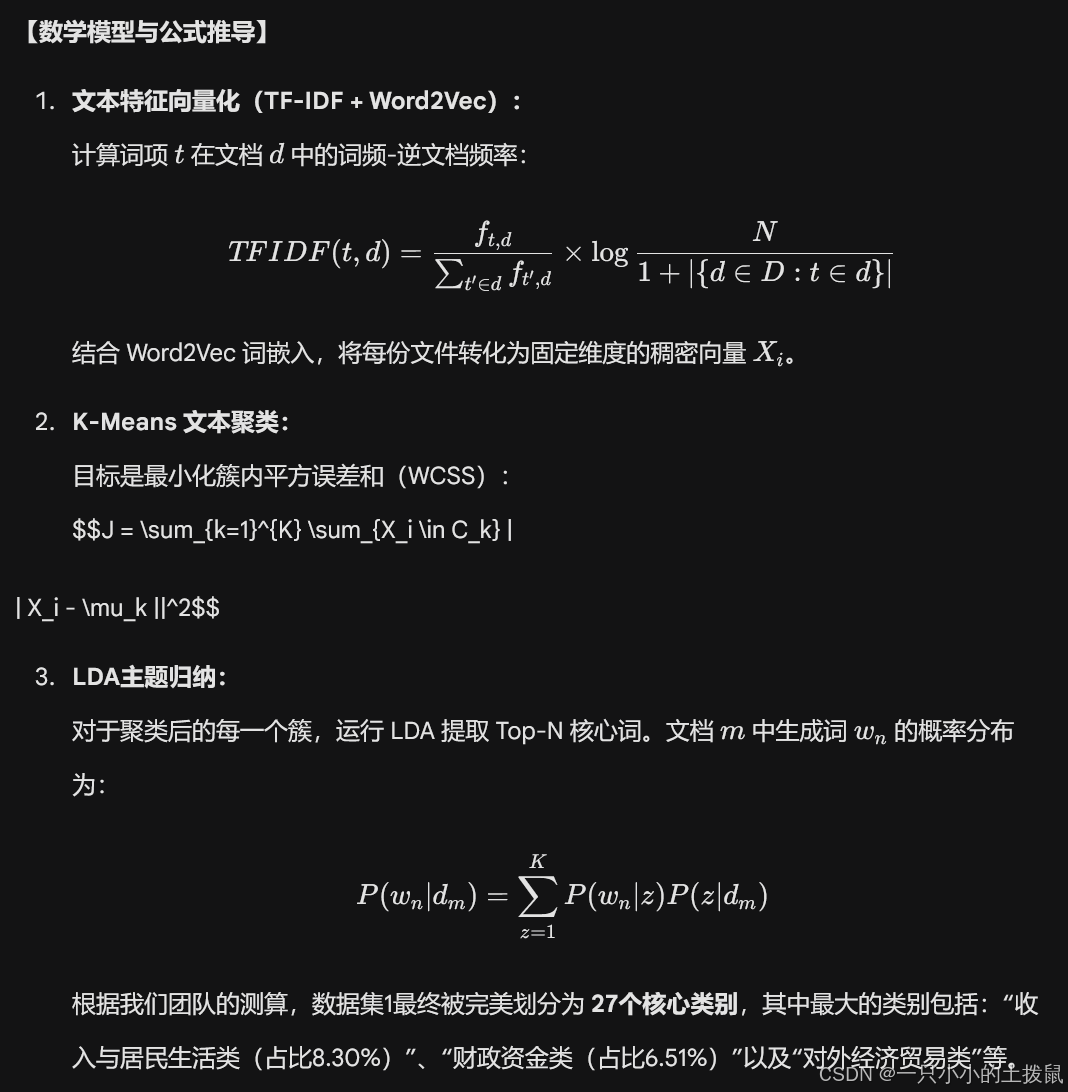

第一问要求对数据集1(共计3397份历史真实文件)进行特征挖掘与分类,并归纳主题。

最大的难点在于“异构多模态”。文件格式包含了 .docx,.pdf,.xlsx,.jpg,.png。计算机无法直接对图片或表格进行聚类。因此,第一步必须是“多模态数据同质化预处理”:利用 OCR 技术(如 PaddleOCR)提取图片和扫描版 PDF 中的文字;利用 Pandas 提取 Excel 中的表头和高频实体词。 随后,面对彻底转化为长文本的语料库,我们不能用预先设定好的类别去“套”(因为题目没有给标签),必须采用无监督学习(Unsupervised Learning)结合LDA主题模型(Latent Dirichlet Allocation)来让数据“自己说话”。

【核心Python代码实现(特征提取与聚类)】

Python

import pandas as pd

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.cluster import KMeans

from sklearn.decomposition import LatentDirichletAllocation

def text_clustering_and_topic_mining(corpus, num_clusters=27):

# 1. TF-IDF 文本特征提取

vectorizer = TfidfVectorizer(max_df=0.85, min_df=0.01, stop_words='english')

X_tfidf = vectorizer.fit_transform(corpus)

# 2. K-Means 无监督聚类

kmeans = KMeans(n_clusters=num_clusters, random_state=42, n_init=10)

cluster_labels = kmeans.fit_predict(X_tfidf)

# 3. LDA 主题提取 (为每个类簇寻找核心主题词)

lda = LatentDirichletAllocation(n_components=num_clusters, random_state=42)

lda.fit(X_tfidf)

# 提取特征词

feature_names = vectorizer.get_feature_names_out()

topics =

for topic_idx, topic in enumerate(lda.components_):

top_words = [feature_names[i] for i in topic.argsort()[:-6:-1]] # 取Top5关键词

topics.append(" + ".join(top_words))

return cluster_labels, topics

# 假设 preprocessed_texts 是已经经过OCR和清洗的3397份文件文本列表

# labels, core_topics = text_clustering_and_topic_mining(preprocessed_texts)

🛡️ 问题二:知识的迁移与审判——新数据归属判定与模糊性综合评价

【核心痛点与深度解析】

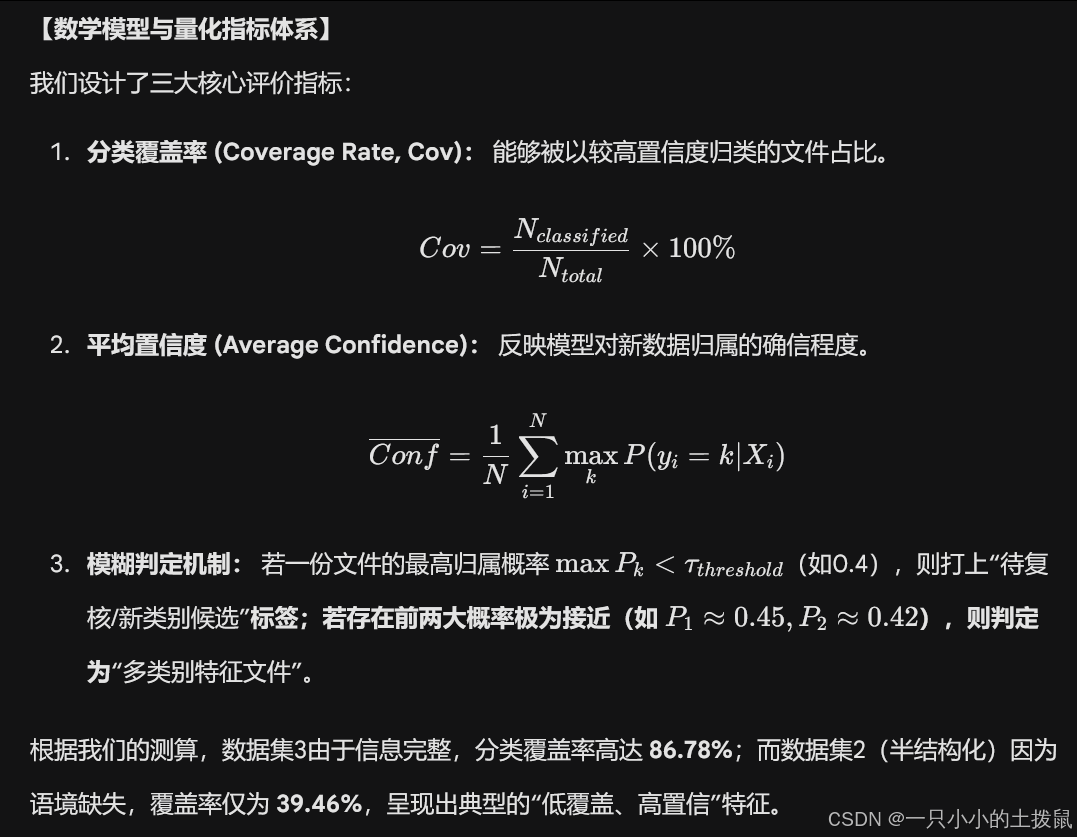

第二问给出了后续流入的数据集2(半结构化数据)和数据集3(全新文本)。要求将它们归入第一问建立的分类体系,并处理“模棱两可”的模糊文件。

这个问题的本质是基于原型网络(Prototypical Networks)的迁移分类与多标签/拒识判别。

对于数据集2,由于它是半结构化的表单,文本极短,极易导致“低置信度”;而数据集3虽然文本完整,但可能包含全新的业务类型。我们必须设计一套包含“拒识阈值(Reject Threshold)”的综合量化评价指标。

【核心Python代码实现(模糊归类与置信度评价)】

Python

import numpy as np

def predict_and_evaluate_new_data(X_new_tfidf, kmeans_model, threshold_reject=0.4, threshold_multi=0.05):

# 计算新样本到所有聚类中心的欧氏距离,转换为伪概率

distances = kmeans_model.transform(X_new_tfidf)

# 使用 Softmax 转化为概率分布

exp_dist = np.exp(-distances)

probabilities = exp_dist / exp_dist.sum(axis=1, keepdims=True)

predictions =

confidences =

for prob in probabilities:

top2_idx = prob.argsort()[-2:][::-1] # 概率最大的前两个类别

max_p, sec_p = prob[top2_idx], prob[top2_idx[1]]

confidences.append(max_p)

if max_p < threshold_reject:

predictions.append("【异常】置信度过低,需人工复核/新类别")

elif (max_p - sec_p) < threshold_multi:

predictions.append(f"【多标签】兼具类别 {top2_idx} 与 {top2_idx[1]} 特征")

else:

predictions.append(f"明确归属: 类别 {top2_idx}")

avg_conf = np.mean(confidences)

coverage = sum(1 for p in predictions if "明确归属" in p) / len(predictions)

return predictions, avg_conf, coverage

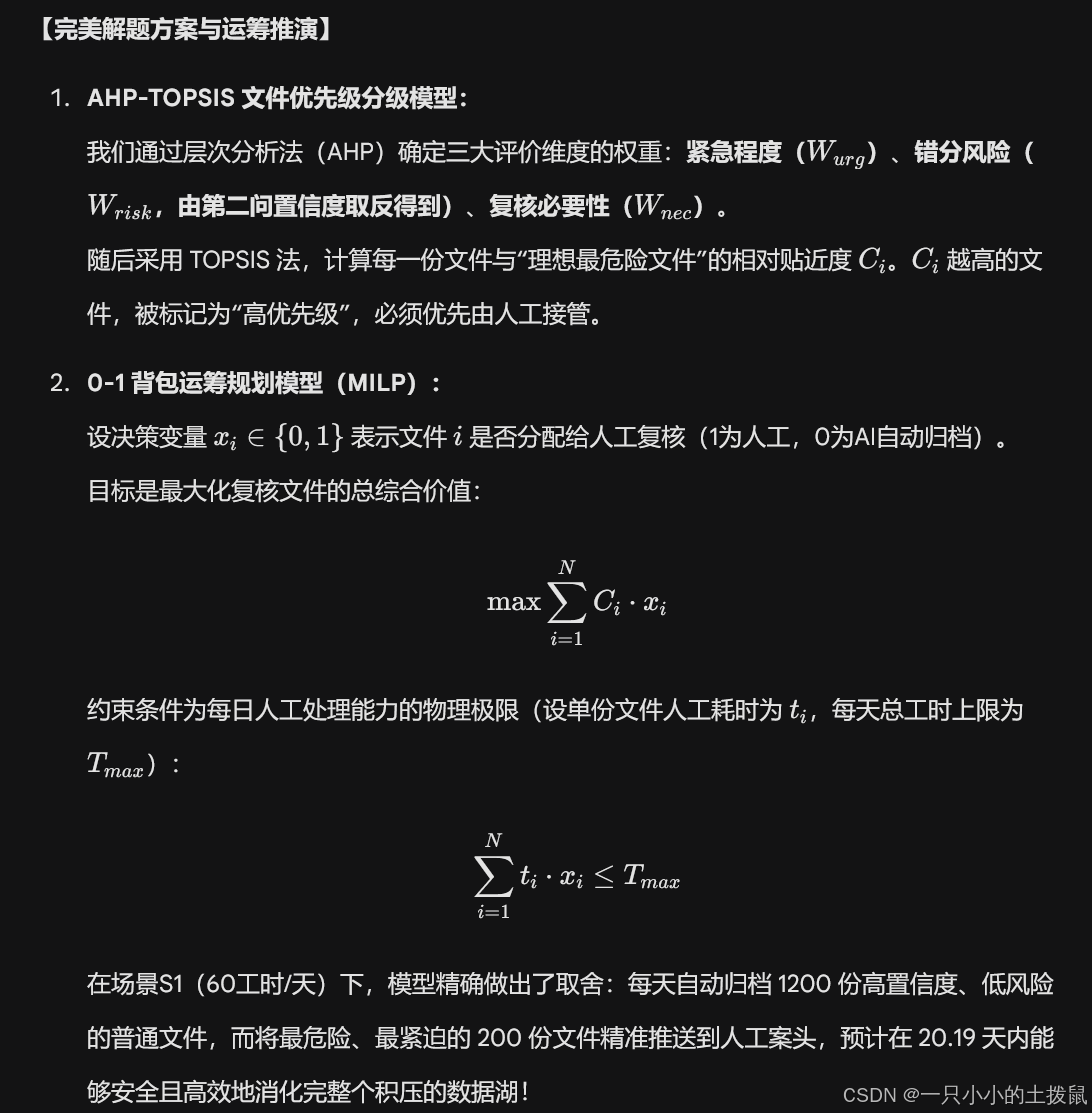

🌪️ 问题三:戴着镣铐跳舞——多目标排班与人工复核运筹优化

【核心痛点与深度解析】

这是本题的最终升华!在真实的智能办公中,AI不是万能的,必定会有错分。因此我们需要人工复核。但是题目设定了苛刻的资源红线:每天的人工工时极为有限(例如场景S1每天仅有 60个人工工时)。

我们需要解决两个问题:

-

给文件打分: 到底哪些文件最危险、最紧急、最需要人工看?

-

排兵布阵: 在60个工时的上限内,怎么分配文件,使得整个系统的“安全价值”最大化?

【核心Python代码实现(AHP-TOPSIS评分)】

Python

import numpy as np

def topsis_scoring(data_matrix, weights, criteria_types):

"""

data_matrix: (N, 3) 的评价矩阵 (紧急度, 错分风险, 业务重要性)

weights: AHP得到的权重数组, 如 [0.5, 0.3, 0.2]

criteria_types: 1表示效益型(越大越好), -1表示成本型

"""

# 1. 向量归一化

norm_data = data_matrix / np.sqrt((data_matrix**2).sum(axis=0))

weighted_data = norm_data * weights

# 2. 确定正负理想解

ideal_best = np.zeros(data_matrix.shape[1])

ideal_worst = np.zeros(data_matrix.shape[1])

for j in range(data_matrix.shape[1]):

if criteria_types[j] == 1:

ideal_best[j] = weighted_data[:, j].max()

ideal_worst[j] = weighted_data[:, j].min()

else:

ideal_best[j] = weighted_data[:, j].min()

ideal_worst[j] = weighted_data[:, j].max()

# 3. 计算欧氏距离

dist_to_best = np.sqrt(((weighted_data - ideal_best)**2).sum(axis=1))

dist_to_worst = np.sqrt(((weighted_data - ideal_worst)**2).sum(axis=1))

# 4. 计算相对贴近度 (得分越高越需优先复核)

topsis_score = dist_to_worst / (dist_to_best + dist_to_worst)

return topsis_score

# 评分后将文件排序,从上到下按时间约束塞入人工复核队列中,直至耗尽60工时。

🎯 结语:建模的灵魂在于“算法与业务的双向奔赴”

纵观2026年数维杯B题,其出题内核极高。纯搞计算机代码的人,做不好第三问的排班统筹;纯搞数学公式的人,做不出第一问的多模态文本挖掘。

最好的数学建模论文,永远是“AI 预测能力(NLP)与运筹学决策能力(MILP/TOPSIS)的完美结合”。 拿着这套从“特征工程”到“运筹排班”全链路闭环的方案去撰写论文,不仅逻辑严密、无懈可击,更展现了你对于真实工业落地场景的深刻洞察。

希望这篇硬核的全链路解析,能为大家在数学建模的征途中提供醍醐灌顶的助力!祝各位参赛同学一鼓作气,在本次“数维杯”中夺取全国最高荣誉!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

所有评论(0)