AI面试避坑:50个真实问题远比MTEB榜单更能证明你的RAG实力!

本文深入探讨了在AI面试中如何评估RAG系统的embedding效果。作者强调,不应仅依赖MTEB榜单,而应使用50个真实用户问题及对应的“标准答案资料”来评估系统的hit@10、recall@10和MRR等指标。文章指出,评估的关键在于使用真实业务问题,关注系统是否找得到正确资料,以及如何处理内部缩写、代码、订单号等复杂问题。作者建议先通过公开榜单进行粗筛,再使用业务测试集进行最终评估,并提供了一套详细的评估checklist以供参考。

AI 落地面试深水区 · 第 02 课 · RAG 深挖篇 2/14

RAG 高频判断题

Embedding 怎么评估,光看 MTEB 榜单行不行?别被榜单骗了:50 个真实问题,往往比一个公开排名更能说明企业 RAG 到底靠不靠谱。

先把术语翻成人话

RAG:先找资料再回答

embedding:文字变数字,看像不像

query:用户真实问题

gold doc:标准答案资料

hit@10 / recall@10:找没找到

MRR:排第几

一、面试现场

面试官提问

“你们 RAG 用的什么 embedding?怎么评估它好不好?”

阿里巴巴 AI 平台一面。简历上写了"基于内部知识库做了一套问答 Copilot",面试官没绕弯子,直接抛过来。这一题表面问的是模型选型,实际考的是你能不能把"把问题和文档变成向量"这一步,放回真实业务里判断。

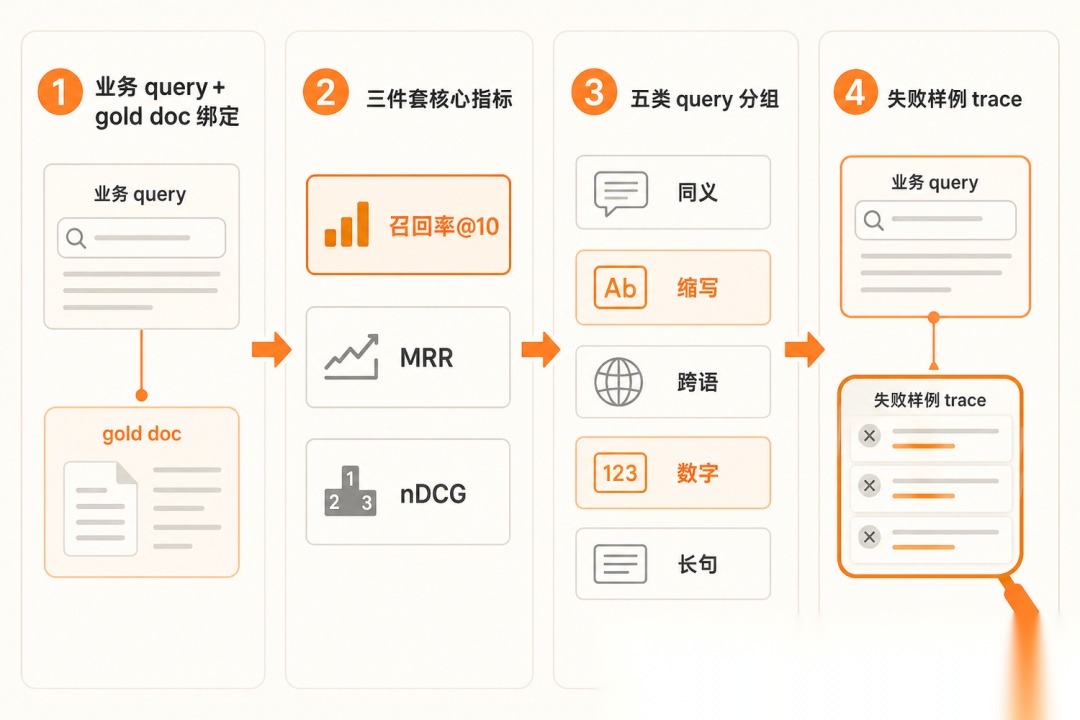

**直接回答:先拿 50 个真实用户问题,再为每个问题标出"标准应该找到哪份资料"。然后看系统前 10 个候选里有没有这份资料,以及它排在第几位。**专业一点说,这就是用业务 query + gold doc 跑 hit@k / recall@k 和 MRR。我的判断是:没有自家测试集的 embedding 选型,本质上只是换模型抽盲盒。

二、大多数人怎么答的

典型翻车回答

“看 MTEB 榜单选 top-3,再换个更大的模型,检索效果就上去了。”

这个回答有一点对:MTEB 能做第一轮粗筛,把候选模型从几十个砍到 3-5 个。但榜单测的是"通用考试题",你的系统面对的是"公司自己的题":内部工单、合同、代码库、客服记录。我见过公开榜单靠前的模型换到法务 PDF 上,前 10 个候选里的命中率反而低 12 个点。

"换更大的模型"也一样。截至 2026-05-02,OpenAI text-embedding-3-large、Voyage-4-large、BAAI/bge-m3 在不同领域上的胜负关系是交叉的。把"大 = 准"当标准,等于跳过了最关键的一步:它在你的资料库里,到底找不找得到正确资料。

三、深度解析

把这题翻成人话:用户用自己的话提问时,系统能不能把正确资料找出来?****我认为真正的分水岭不是你报出哪个模型名,而是你能不能拿出一张"哪些问题找得到、哪些问题找不到"的失败样例表。我会先看找不找得到,再看排得靠不靠前,最后看失败集中在哪类问题上。

判断一:用真实问题,不用考试题

MTEB / C-MTEB 是公开考试题;你的业务问题更像"报销限额是多少",标准答案在《差旅报销管理办法》第三条。关键在于:评估对象必须是"真实用户问题 + 你库里的正确资料"这对数据。50 条高频问题加专家标注就够起步,不要一上来追求 5000 条。

判断二:先看找不找得到,再看排第几

单个标准答案的场景,先看 hit@k:前 k 个候选里有没有命中那条正确资料;多个标准答案的场景,再看 recall@k:正确资料被找回了多少比例。我认为先用 hit@10 / recall@10 判断"找不找得到",再用 MRR 判断"排得靠不靠前"。不要只看 cosine 均值,它更像平均相似度,不能直接说明用户能不能拿到正确资料。

判断三:要覆盖真实麻烦问题

企业 RAG 最容易翻车的,不是标准问法,而是五类麻烦问题:同一句话的不同说法、公司内部缩写、中英混着问、订单号/错误码这类精确字符、以及很长很口语的问题。这些东西在公开榜单里不一定多,但在你的知识库里可能天天出现。

判断四:失败样例的 trace 比平均分更重要

平均分会把问题盖住。工程动作:给每条问题打一个类型标签,跑完后按标签分组看 recall@10;再把失败问题单独拿出来,看是资料切得不对、模型不认识内部词,还是标准答案本身标错了。这套数据沉淀下来就是回归集,每次换模型、换切分策略都重跑。

四、面试官追问链

追问 1

“如果 recall@10 高但答案仍然差,是 embedding 的问题吗?”

大概率不是。前 10 个候选里已有正确资料,说明"找资料"不算坏;问题多半在后面:重排没把它推到前 3,提示词没要求优先看高排名片段,或引用被裁断。处理顺序是:先看重排,再调提示词,最后才动 embedding。

追问 2

“怎么用 50 条 query 做一个最小 embedding eval?”

五步就够:抽 50 条真实问题;标出每题应该找到的 1-3 篇资料;跑两个候选模型;看前 5 / 前 10 是否命中、排第几;再按问题类型分组。50 条不是上限,是起跑线,跑通后再扩到 200。

追问 3

“为什么领域术语多的系统可能需要 hybrid search 而不是只换 embedding?”

因为内部缩写、产品型号、订单号不像自然语言,更像精确字符。比如 SKU-X1932、ORD20260418,关键词检索反而更可靠。更值得做的是:语义搜索找一批,关键词搜索找一批,合并后再重排。

五、最小 eval 长什么样

把方法落到表上,就是每个问题都有"问题类型"和"标准资料":前者用于分组诊断,后者用于判断系统到底找没找到。

| 业务 query | 类型 | gold doc |

|---|---|---|

| 差旅报销限额是多少 | 同义 | EXP-03 |

| SKU-X1932 下架了吗 | 术语 | TKT-1102 |

| LOGISTICS_TIMEOUT 怎么处理 | 代码 | LOG-07 |

| 上周工单怎么还没回 | 长问法 | FAQ-11 |

跑完后不要只看平均分,按类型聚合,弱在哪一眼就能看出来:

| Query 类型 | Recall | MRR | 诊断 |

|---|---|---|---|

| 同义改写 | 0.92 | 0.71 | 先不动 |

| 缩写术语 | 0.34 | 0.18 | 加 BM25 |

| 跨语言 | 0.61 | 0.42 | 看样例 |

| 数字代码 | 0.28 | 0.14 | 关键词兜底 |

| 长 query | 0.78 | 0.55 | 加 rerank |

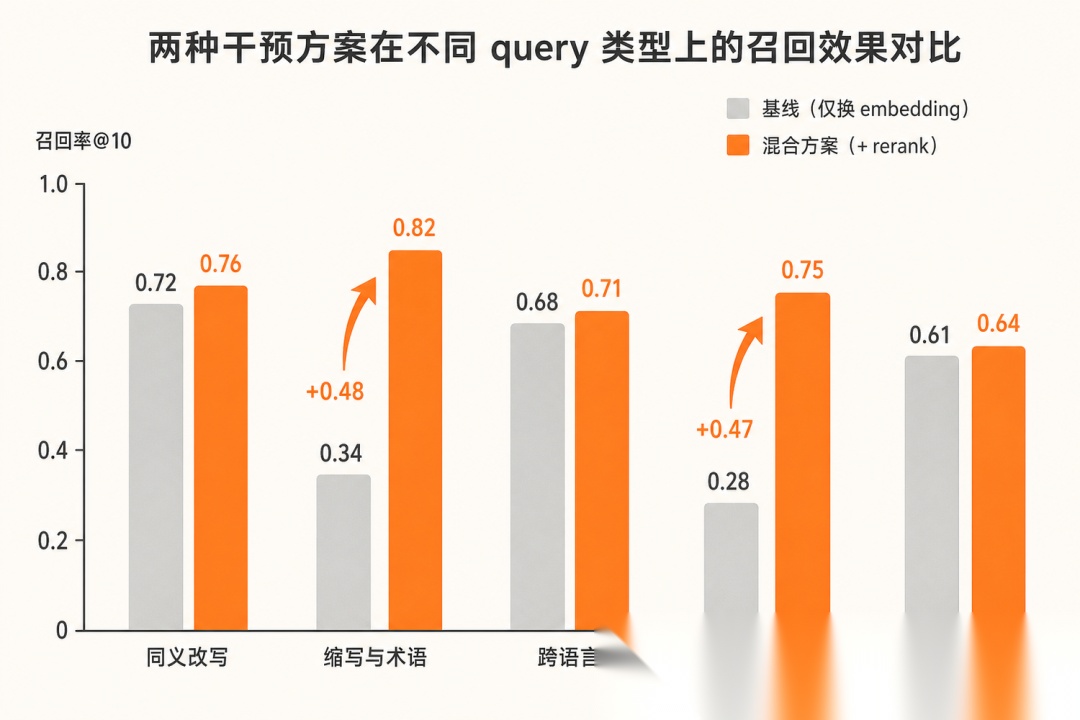

这张表读完,结论不是"换更大的 embedding",而是:缩写与数字代码加关键词兜底,长问题加重排,同义改写先不动。

↳ 复盘数字

匿名项目复盘:仅换 embedding,整体 recall@10 从 0.74 → 0.78;加关键词兜底 + 重排后,整体 0.74 → 0.91,缩写类 0.34 → 0.82。这不是公开基准,只说明诊断方向。

我的判断

关键在于先把评估闭环跑通——同一份 200 条样本上跑过 3 个 embedding,比只看 MTEB 排行榜有用得多。我的优先顺序是:公开榜单粗筛,业务测试集定最终选择。

结语:抓住大模型时代的职业机遇

AI大模型的发展不是“替代人类”,而是“重塑职业价值”——它淘汰的是重复性、低附加值的工作,却催生了更多需要“技术+业务”交叉能力的高端岗位。对于求职者而言,想要在这波浪潮中立足,不仅需要掌握Python、TensorFlow/PyTorch等技术工具,更要深入理解目标行业的业务逻辑(如金融的风险控制、医疗的临床需求),成为“懂技术、懂业务”的复合型人才。

无论是技术研发岗(如算法工程师、研究员),还是业务落地岗(如产品经理、应用工程师),大模型都为不同背景的职场人提供了广阔的发展空间。只要保持学习热情,紧跟技术趋势,就能在AI大模型时代找到属于自己的职业新蓝海。

最近两年大模型发展很迅速,在理论研究方面得到很大的拓展,基础模型的能力也取得重大突破,大模型现在正在积极探索落地的方向,如果与各行各业结合起来是未来落地的一个重大研究方向

大模型应用工程师年包50w+属于中等水平,如果想要入门大模型,那现在正是最佳时机

2025年Agent的元年,2026年将会百花齐放,相应的应用将覆盖文本,视频,语音,图像等全模态

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

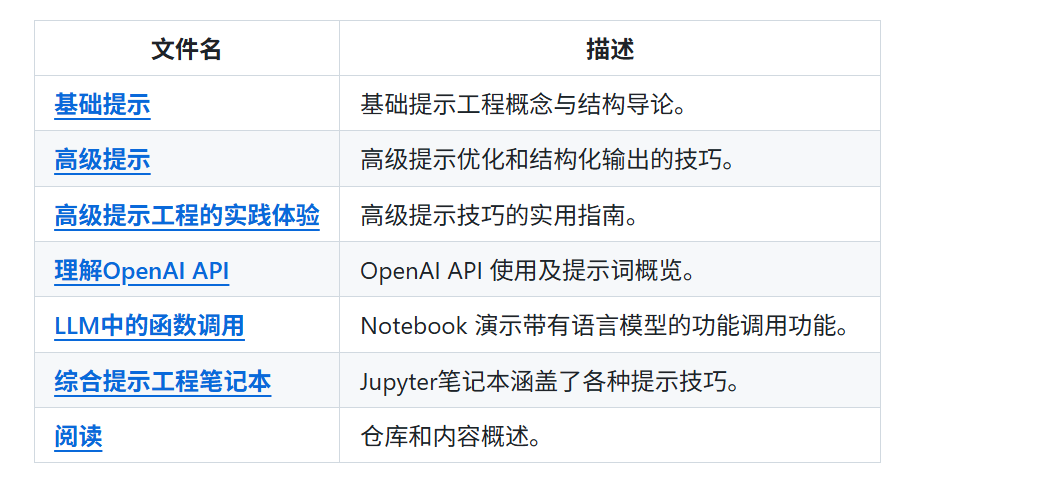

给大家推荐一个大模型应用学习路线

这个学习路线的具体内容如下:

第一节:提示词工程

提示词是用于与AI模型沟通交流的,这一部分主要介绍基本概念和相应的实践,高级的提示词工程来实现模型最佳效果,以现实案例为基础进行案例讲解,在企业中除了微调之外,最喜欢的就是用提示词工程技术来实现模型性能的提升

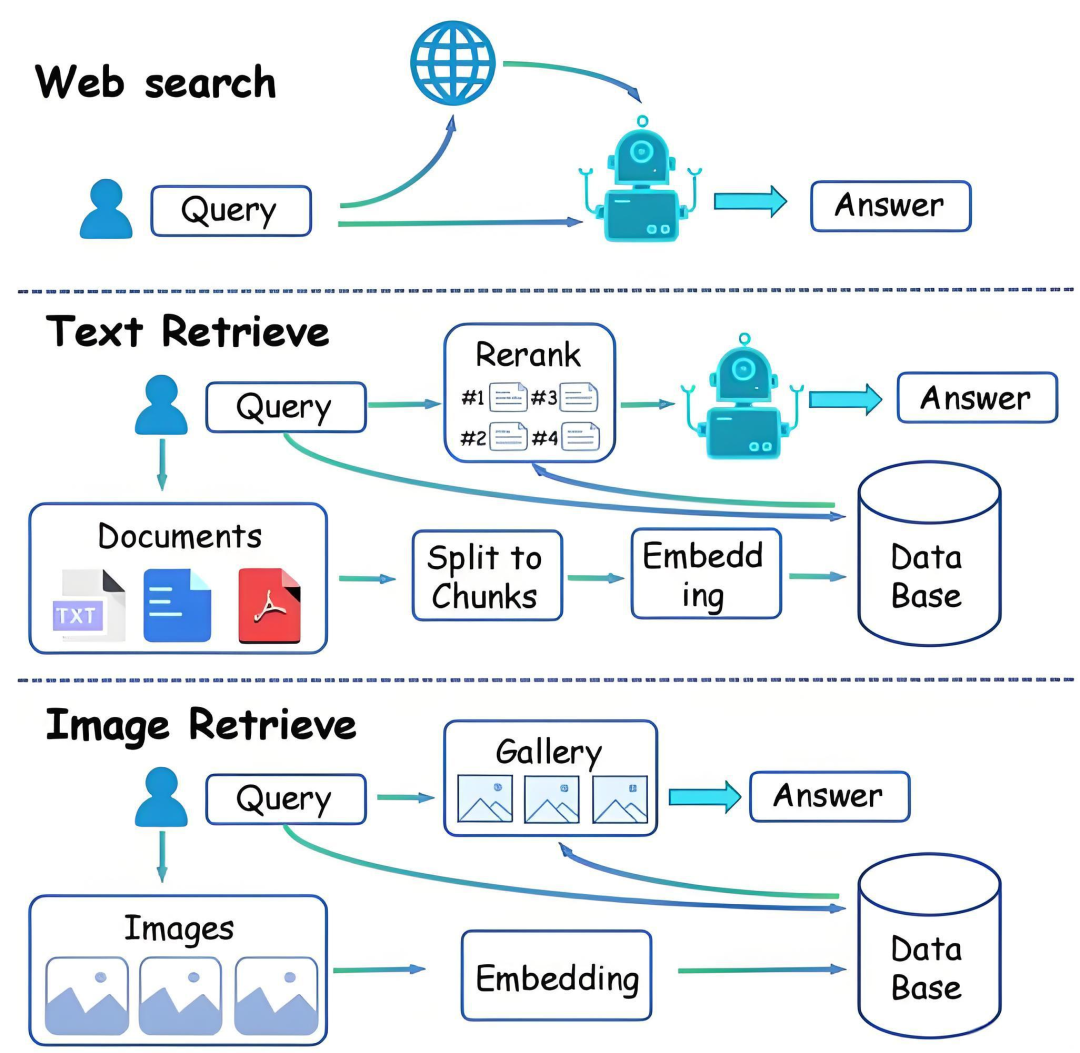

第二节:检索增强生成(RAG)

可能大家经常会看见RAG这个名词,这个就是将向量数据库与大模型结合的技术,通过外部知识来增强改进提升大模型的回答结果,这一部分主要介绍RAG架构与组件,从零开始搭建RAG系统,生成部署RAG,性能优化等

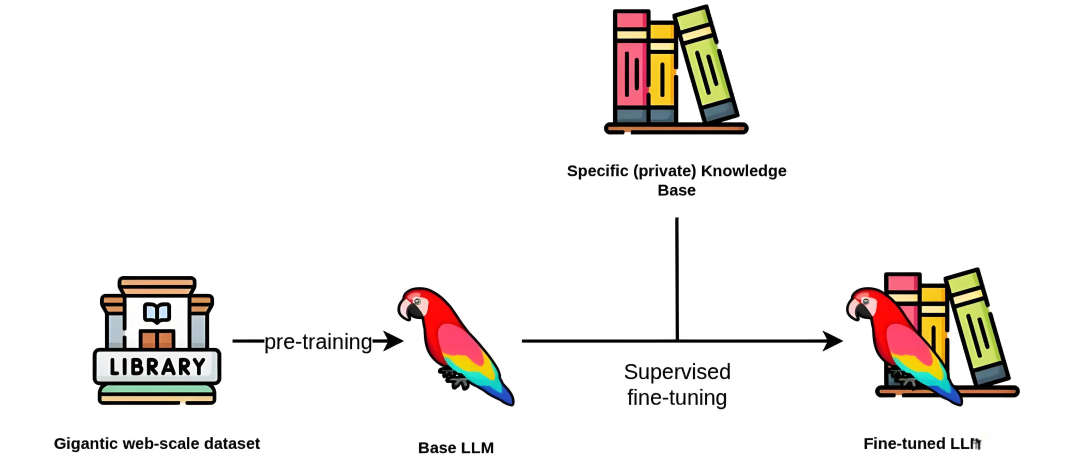

第三节:微调

预训练之后的模型想要在具体任务上进行适配,那就需要通过微调来提升模型的性能,能满足定制化的需求,这一部分主要介绍微调的基础,模型适配技术,最佳实践的案例,以及资源优化等内容

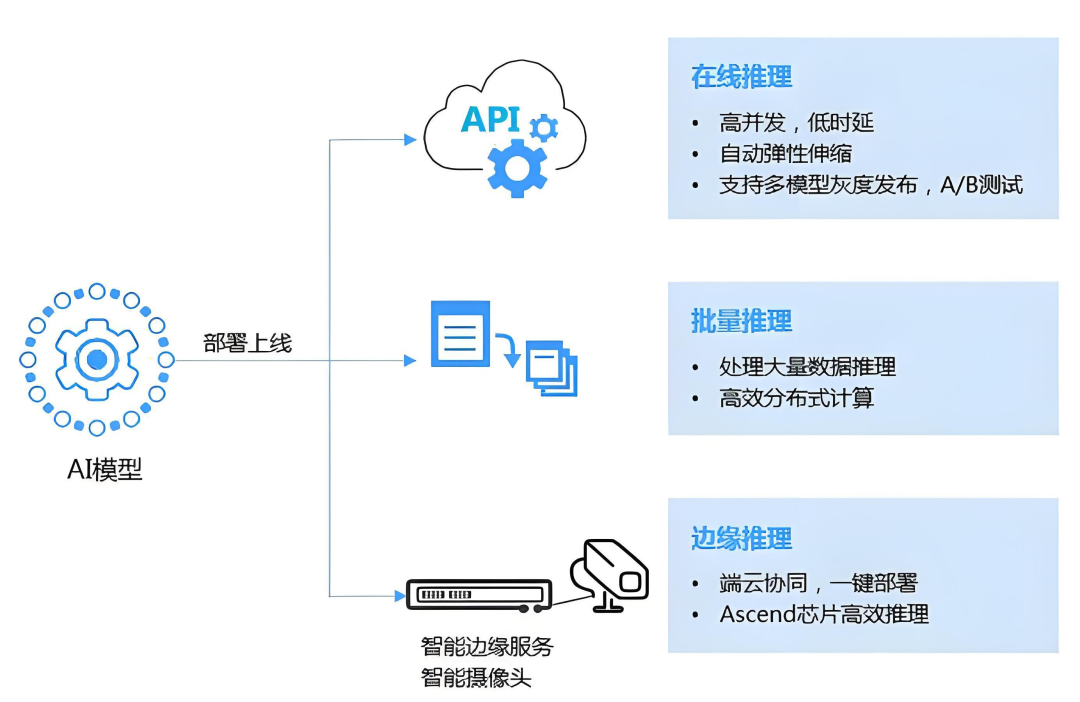

第四节:模型部署

想要把预训练或者微调之后的模型应用于生产实践,那就需要部署,模型部署分为云端部署和本地部署,部署的过程中需要考虑硬件支持,服务器性能,以及对性能进行优化,使用过程中的监控维护等

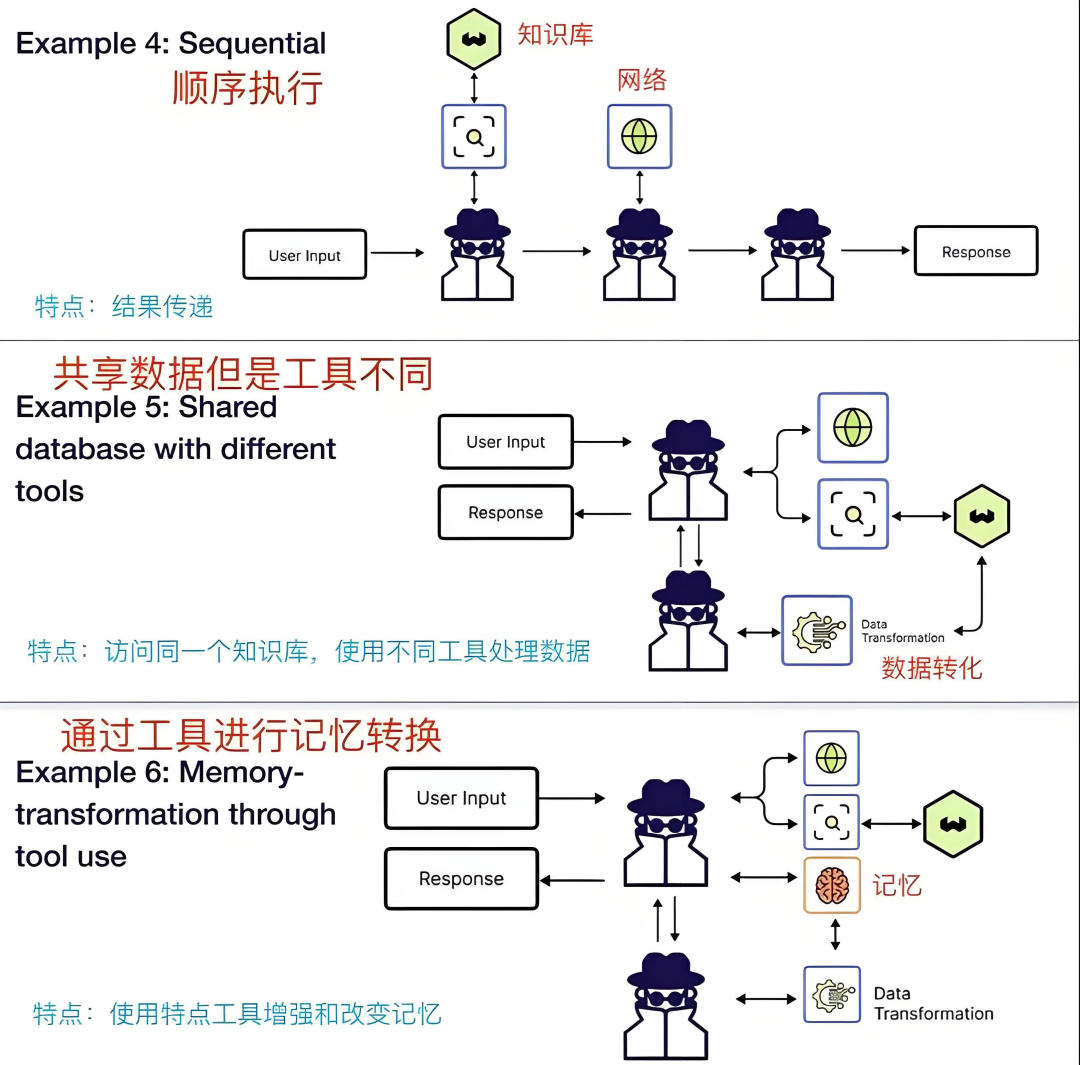

第五节:人工智能系统和项目

这一部分主要介绍自主人工智能系统,包括代理框架,决策框架,多智能体系统,以及实际应用,然后通过实践项目应用前面学习到的知识,包括端到端的实现,行业相关情景等

学完上面的大模型应用技术,就可以去做一些开源的项目,大模型领域现在非常注重项目的落地,后续可以学习一些Agent框架等内容

上面的资料做了一些整理,有需要的同学可以下方添加二维码获取(仅供学习使用)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献118条内容

已为社区贡献118条内容

所有评论(0)