能让你的 AI 编程 Token 降低 60% 以上的开源神器:目前 GitHub 狂揽约 4.2 万星标

大家好,我是Java1234_小锋老师。

如果你经常用 Claude Code、Cursor、Gemini CLI、Codex 之类的工具写代码,你一定遇到过这种尴尬:模型明明只是想看一眼 git status、cargo test 或一大段 grep 结果,结果却要把 整段终端输出 搬进上下文里。输出越长,账单越疼,上下文也越容易被“噪声”占满。

今天要聊的 rtk-ai/rtk,就是一个定位非常“朴素却致命”的开源项目:在命令输出进入大模型之前,先做过滤、聚合、截断与去重,把常见开发命令的返回内容压缩到模型真正需要的那部分。项目在 GitHub 上已经积累了 约 4.2 万个 Star(热度仍在快速上升),自称在常见工作流里可以把 LLM 相关的 token 消耗降下来 大约 60%~90%——具体幅度当然取决于你的仓库规模、命令频率和输出形态,但思路本身非常清晰:别喂模型“整包饲料”,先压缩成“高密度信息”。

先说结论:它到底解决什么问题

在日常 AI 编程里,“模型执行命令”的成本常常不是 命令本身,而是 命令输出。尤其当你反复跑测试、lint、构建日志、目录树、git diff 时,输出里大量重复行、无关 banner、以及过长路径,会迅速挤占上下文窗口,并且按 token 计费的产品还会直接反映到费用上。

RTK 要做的,就是把这类输出在进入模型前做一次 针对性瘦身。它不是替代你的 shell,也不是替代模型;它更像一个站在中间的 CLI 代理,把“终端返回给 AI 的内容”变得短、准、可追踪。

RTK 是什么

RTK(仓库里也常被称作 Rust Token Killer)是一个用 Rust 实现的高性能命令行工具:单个二进制、对外宣称零额外依赖(针对工具分发形态而言),并且内置对 100+ 常见开发命令的过滤与压缩策略。项目主页见:https://github.com/rtk-ai/rtk,官方文档站点见:https://www.rtk-ai.app。

你也可以把它理解成:当你让 AI 执行 bash 命令时,终端仍跑真正的 git / cargo / pytest,但 返回给模型的文本 会先经过 RTK 的规则处理。

它如何工作:中间层代理 + 命令级优化策略

官方 README 里把它概括成四条主要手段(对不同命令类型的组合程度不同):

- 智能过滤:去掉噪声,例如冗余注释样式信息、无关紧要的空行、bootstrap 话术等。

- 分组聚合:把同质信息合并,例如同类错误归类、同类文件归类展示。

- 截断保留:宁可少而精,也把“最关键的上下文骨架”留下来。

- 去重重叠:对重复刷屏的日志进行折叠,并附带计数摘要。

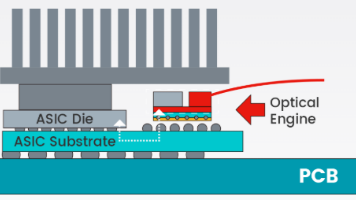

从整体链路看,可以理解为模型仍然发出 git status 之类指令,但经过 hook 重写后执行的是 rtk 包装版本,从而让模型拿到的返回更短:

这里有一个非常关键、也非常“现实”的细节:hook 通常只作用于 Bash 工具调用。如果某些 AI 产品内置了 Read、Grep、Glob 这类不走 bash 的路径,它们可能 不会自动被 RTK 重写。官方也建议:在这些场景下改用 shell 的 cat/head/tail、rg/grep、find,或者显式调用 rtk read、rtk grep、rtk find。

一张表看懂:官方给出的“示例会话”节省幅度

下面这张表来自项目 README,用于展示“30 分钟 Claude Code 会话”量级下的估算对比(项目中说明:基于中等规模的 TypeScript / Rust 项目,实际会因项目差异而波动):

| 操作 | 频次 | 标准输出(token 估算) | 经 RTK(token 估算) | 节省 |

|---|---|---|---|---|

ls / tree |

10x | 2,000 | 400 | ~80% |

cat / read |

20x | 40,000 | 12,000 | ~70% |

grep / rg |

8x | 16,000 | 3,200 | ~80% |

git status |

10x | 3,000 | 600 | ~80% |

git diff |

5x | 10,000 | 2,500 | ~75% |

cargo test / npm test |

5x | 25,000 | 2,500 | ~90% |

| 合计(示例) | ~118,000 | ~23,900 | ~80% |

我会建议你把这张表当作“方向性参考”,而不是对你团队账单的承诺:一旦你的输出里包含大段结构化数据、异常长的堆栈、或你刻意需要完整日志,压缩率就会变化——这也是工具提供 tee 等机制的原因:失败时仍可落盘保存 未过滤 的全量输出,方便模型随后单独读取。

怎么上手:安装与对各家的集成

安装方式在项目里写得很完整,常见的有:

- Homebrew:

brew install rtk - 一键脚本(Linux/macOS):README 提供的

install.sh - Cargo 从源码安装:

cargo install --git https://github.com/rtk-ai/rtk - Release 预编译包:Windows / Linux / macOS 都有对应归档

初始化到具体 AI 工具的命令也很直接,例如 README 展示的:

rtk init -g # Claude Code / Copilot(默认)

rtk init -g --gemini # Gemini CLI

rtk init -g --codex # Codex(OpenAI)

rtk init -g --agent cursor # Cursor

rtk init --agent windsurf # Windsurf

# ……以及 Cline / Kilo Code / Antigravity 等路径

装完一般需要 重启你的 AI 编程工具。此外它还有 rtk gain 这类命令,用于查看节省统计(也支持 --graph、--history 等)。

Windows 用户要注意什么

如果你在原生 Windows(cmd/PowerShell)使用,官方描述是:过滤能力仍可用,但自动重写 hook 依赖 Unix shell,所以在原生 Windows 上可能回落到 向 CLAUDE.md 注入使用说明 的模式,命令不一定会被自动改写。更“完整体验”的路线通常是 WSL:在 Linux 子系统里安装与初始化,就与 Linux 一致。

Windows 使用者还需要注意一个很实在的小坑:README 特别提醒不要 双击运行 rtk.exe(会一闪而过),应从终端启动;另外 crates.io 上存在同名项目的风险,若 rtk gain 行为异常,可能装错包——官方建议优先用文档里的安装方式核验。

隐私与遥测:默认为关,需明确同意

对团队落地来说,“工具是否上报数据”往往比 Star 数更敏感。RTK 在文档里写明:可能存在 匿名聚合 的使用统计,但 默认关闭,需要用户在 rtk init 或 rtk telemetry enable 时 明确同意 才会开启;也可用环境变量强制关闭采集。你若要在公司环境推广,建议直接阅读仓库中的 docs/TELEMETRY.md 并与安全规范对齐。

结语:值得试,但要有合理预期

RTK 的热度不是偶然:它切中的是 AI 编程里一个长期被忽视的成本中心——命令行输出。它的工程表达也很“工程师友好”:单二进制、覆盖面广、与多家工具集成、还能用 rtk gain 把效果量化。

但也要诚实地讲:它不是魔法。对不走 bash hook 的工具链路径、以及你确实需要完整输出的场景,它不会替你做“无损压缩”。它最适合作为你工作流里的默认基础设施:让模型更少被噪声拖累,让你的 token 更像在买“信息密度”而不是买“横幅广告”。

如果你准备尝试,建议从官方 README 的快速开始走一遍,再用 rtk gain 观察你真实项目里的收益曲线;最后是否在团队里推广,交给数据与合规流程决定,会比只看星标数更稳妥。

参考链接

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)