什么是共封装光学(CPO)?关于CPO的架构、优势、挑战与性能

共封装光学将光子引擎直接与交换机ASIC及AI加速器集成,从而在板级降低功耗与延迟。本文阐释CPO的工作原理、其与可插拔及近封装光学的对比,以及其优势与挑战。

核心要点

共封装光学(CPO)将光引擎直接集成在交换芯片或加速器旁,缩短了电气走线距离,并省去了数字信号处理器(DSP)重定时器。这种近距离布局显著减少了功耗。实验表明,一个30瓦的可插拔光模块可被9瓦的CPO链路替代,功耗降低70%。

将电气距离缩短至毫米级,能效可向每比特亚皮焦耳的目标推进。采用三维封装的硅光芯片可实现每片6.4 Tb/s的传输速率,并构建出51.2 Tb/s至102.4 Tb/s的交换机,其带宽密度是可插拔模块无法比拟的。

消除长距离铜线路径可提升信号完整性,并减少均衡和重定时的开销,从而降低延迟。这缩小了链路预算,使200 Gbit/s的SerDes通道能直接驱动光引擎。

CPO引入了实际的工程权衡:光子器件紧贴发热逻辑单元时散热管理更为困难,规模化光纤连接复杂,且光器件与专用集成电路共置会影响良率、测试和现场维护的便利性。高密度光纤线束进一步增加了集成难度。

博通的Tomahawk 6及相关下一代CPO交换芯片预计在2025-2026年窗口期实现商用。随着供应链和标准的成熟,CPO在功耗与密度优势最为关键的大规模GPU互连中广泛应用预计在2028至2030年间实现。

业界正朝着模块化光引擎(1.6T–6.4T)、外部激光源和标准化光纤连接器的方向趋同。博通、Marvell、Ayar Labs和Ciena正采取不同的架构路径,为工程师在带宽密度、能效、可维护性和成本之间提供了多样化选择。

引言

人工智能模型和高性能计算的快速增长,对数据中心互连接口提出了前所未有的要求。传统的铜质背板和可插拔光模块已在功耗与带宽方面遭遇瓶颈。现代交换机已支持51.2 Tb/s的传输速率,而技术路线图更是朝着100 Tb/s及更高目标迈进。每块GPU通常需要多个功耗达30瓦的可插拔光模块。若规模扩展至数以万计的GPU,其总功耗就会达到数百兆瓦。与此同时,随着端口数量与数据速率的不断提升,铜质走线越来越难以在板级距离上保持信号完整性,导致插入损耗加剧,进而需要昂贵的均衡与重定时器来补偿。工程师们迫切需求能够在单位功耗下提供更高带宽、更低延迟和更优扩展性的互连解决方案。

共封装光学通过将光引擎集成在交换芯片或加速器相邻的同一封装内,以应对这一瓶颈。通过在距离硅芯片仅数毫米的范围内将电信号转换为光信号,CPO缩短了铜线路程,省去了高功耗数字信号处理器,并使得光子引擎能够直接驱动光纤。早期部署案例如博通的Bailly CPO交换芯片与英伟达面向扩展型InfiniBand互连的Quantum-X光子平台,均已展现出显著的节能效果与带宽密度优势。

本文阐释共封装光学背后的原理,检视其实际实施方案,并将其与可插拔光学及新兴的近封装光学(NPO)模式进行对比。同时,文章还将剖析设计CPO系统时工程师需权衡的挑战与取舍,并梳理适用于人工智能数据中心的供应商布局与技术发展路线。

何为共封装光学?

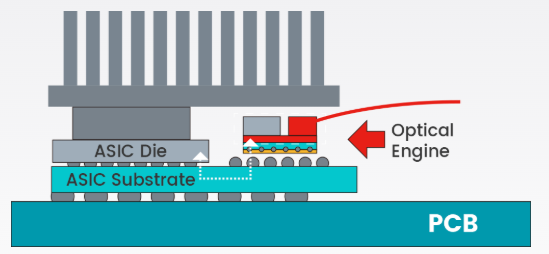

共封装光学指将光学收发器及光子元件直接集成在电子集成电路(交换芯片或AI加速器)的同一基底或同一封装内。与可插拔光学模块置于前面板、通过较长PCB走线及笼子连接至交换机的方式不同,CPO将光子引擎置于距离ASIC仅数毫米的位置。更短的电气路径意味着更低的信号损耗、更少的功耗以及更高的数据速率。其集成方式可采用2.5D(基于硅中介层)或3D(使用晶圆上芯片或芯片间堆叠等封装技术),互连方法因具体实现而异,包括硅通孔、混合键合或二者结合等方式。

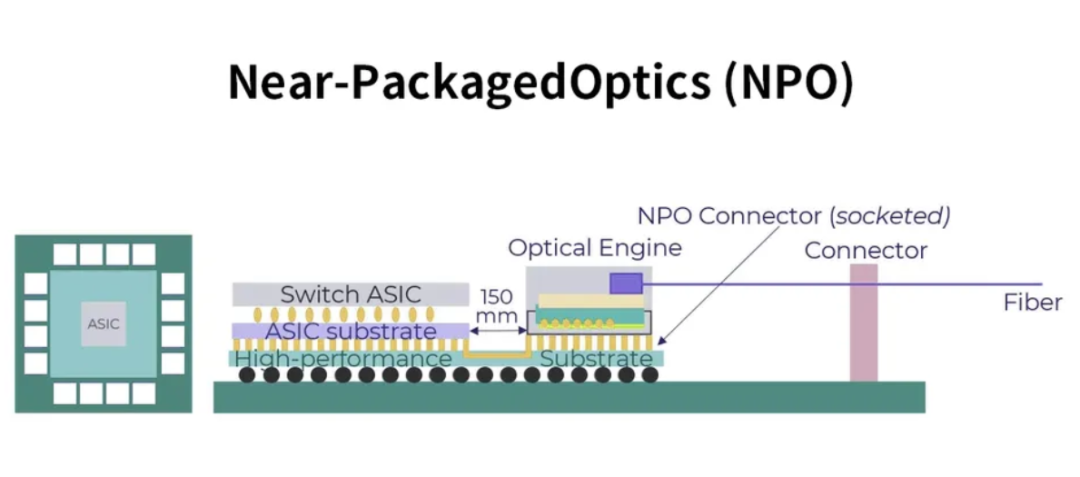

通过将光引擎紧邻电信号源放置,CPO极大缩短了电气路径长度,从而提升信号完整性并降低功耗。该架构还允许在无需DSP重定时器的条件下实现更高的SerDes速率(200 Gbit/s或更高),达到可插拔前端模块无法企及的带宽密度。CPO与近封装光学(NPO)有显著区别:NPO将光子引擎置于PCB边缘靠近ASIC的位置,但仍处于封装外部。相比可插拔方案,NPO虽然缩短了路径长度,但并未实现光学的完全集成。

阅读推荐:什么是ASIC芯片:全面了解专用集成电路

CPO封装的组成部件

共封装解决方案融合了多个基础模块:

-

交换芯片或加速器:高基数、高带宽的硅基器件,负责数据路由或处理。博通的Tomahawk 6目标是通过CPO集成实现102.4 Tb/s带宽;英伟达的Quantum-X则面向InfiniBand扩展型网络,目标为51.2 Tb/s。它们服务于不同的网络领域,但均代表了ASIC带宽的技术前沿。

-

光子集成电路:包含波导、调制器、驱动器和光电探测器的硅光子芯片。调制技术多样:早期CPO采用马赫-曾德尔调制器,英伟达第二代方案采用微环调制器(显著降低了系统级功耗),而面向未来400G通道的电吸收调制器正在评估中。

-

电子集成电路:集成SerDes、驱动器、控制逻辑和电源管理的CMOS芯片。它通过高速电气通道与ASIC对接,并控制PIC。

-

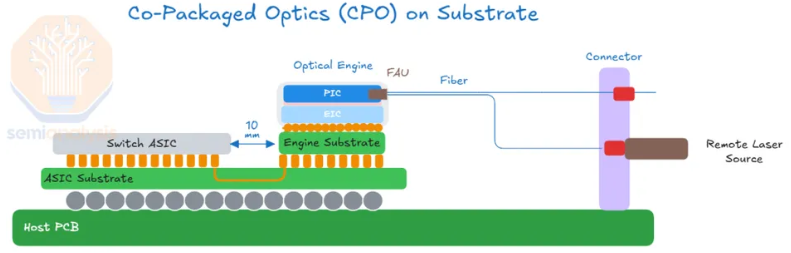

光引擎:将PIC、EIC与光纤阵列单元集成的模块。每个光引擎模块可提供1.6T至6.4T的聚合带宽。博通Bailly CPO采用八个6.4 Tb/s硅光引擎环绕ASIC布局。英伟达的量子架构采用基于台积电COUPE工艺的1.6 Tb/s引擎,并将三个引擎组合成4.8 Tb/s光学子组件,支持拆卸以方便维护。

-

外部光源:为提高可靠性和散热管理,激光器常被移出ASIC封装。激光模块通过波导将光馈入PIC。Ayar Labs等供应商使用SuperNova 16波长激光器为其TeraPHY芯粒供电。外部激光器简化了冷却设计并支持冗余配置。

-

光纤连接与接口:密集光纤阵列将光信号从引擎传输至机架。CPO采用边缘耦合(如博通的环氧树脂粘接光纤)或表面耦合(如英伟达的微透镜方案)。康宁的GlassBridge和CPO FlexConnect等先进连接器提供可拆卸光纤线束,支持数千根光纤连接。据报道,Marvell的参考设计在每个计算托盘上使用32个金属PIC耦合器,光纤总数达数万根。

共封装光学的工作原理

数据在CPO系统中按四个快速连续的阶段传输。首先,交换芯片或加速器通过封装内互连将高速电信号发送至电子集成电路。由于这些铜走线仅数毫米长,SerDes通道在当前实现中每通道速率可达100 Gb/s(下一代设计目标为200 Gb/s),无需长距离PCB走线所需的重度均衡处理。

接着,EIC驱动光子集成电路上的调制器,将电数据编码到光载波上以实现高速传输。根据设计不同,可采用马赫-曾德尔调制器、微环调制器或电吸收调制器。微环调制器因体积更小、驱动电压更低而备受青睐,这直接降低了每比特能耗。在接收端,同一PIC上的光电探测器将输入光信号转换回电信号。

编码后的光通过片上波导传输至封装边缘的光纤阵列单元。光栅耦合器或扩束耦合器连接波导与光纤之间的间隙,光栅耦合器通常可容忍约±20 µm的对准偏差。康宁GlassBridge和Marvell金属PIC耦合器等可拆卸连接器允许在不干扰ASIC的情况下断开光纤线束,这对现场维护至关重要。

光本身来自ASIC封装外部的激光源——通常安装在交换机机箱或前面板。外部激光源产生单波长或多波长的连续光,并通过光分路器或波分复用器分配至多个光引擎。将激光器外置降低了ASIC封装的热负荷,提升了系统整体可靠性。

与可插拔及近封装光学的比较

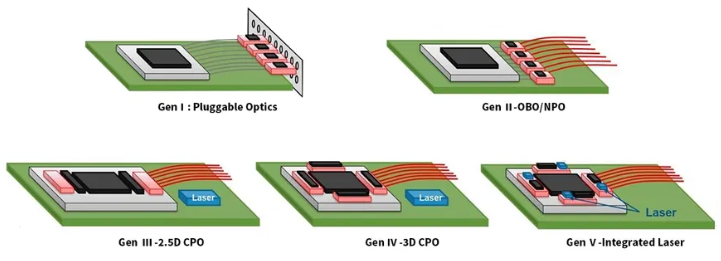

光互连封装技术代际演进:从可插拔光学模块,到具备片载激光源的完全集成式共封装光学。

可插拔光学模块因其标准化和易于维护的特性,目前仍是网络交换机的主流形态。然而,它们依赖于长距离PCB走线和高功耗DSP重定时器。一个1.6 Tb/s的可插拔模块通常功耗约为25瓦。

近封装光学与线性可插拔光学相关但有区别,后者从模块本身移除了DSP,但不一定改变光学器件的位置。下表对比了这些方案。

|

指标/特性 |

可插拔光学 |

近封装光学 |

共封装光学 |

|---|---|---|---|

|

电气路径长度 |

从ASIC到模块约15-30厘米;需要高损耗LR SerDes和DSP重定时器 |

约2-5厘米;损耗降低但仍需一些均衡 |

毫米级;消除了DSP和重定时器 |

|

每比特功耗 |

15–20 pJ/比特;完全重定时的1.6T模块,通常20–22瓦 |

8-15 pJ/比特;通过缩短走线改善 |

已演示5–10 pJ/比特;早期实现中低于5 pJ/比特;例如1.6 T CPO链路≈5瓦 |

|

带宽密度 |

受前面板笼位面积和光纤数量限制 |

中等;仍受板级布线限制 |

最高;6.4 T引擎允许多个引擎实现每交换机>51 Tb/s |

|

可维护性 |

优秀;模块支持热插拔 |

中等;模块靠近ASIC但可访问 |

因设计而异;部分平台使用可拆卸OSA(NVIDIA),而其他则永久粘合引擎(博通)。需要精密的封装 |

|

热管理 |

模块功耗在前面板附近耗散;冷却更容易 |

更靠近ASIC;共享散热方案 |

光子器件紧邻ASIC,需要先进的冷却;通常采用液冷 |

|

部署时间线 |

成熟;在以太网各代中广泛部署 |

新兴;用于线性可插拔光学 |

早期部署(2025-26年)用于横向扩展;纵向扩展采用预计在2028-30年 |

架构与实现

CPO并非单一架构,而是一系列设计方法,不同实现之间的差异反映了真实的工程权衡,而非任意的供应商选择。理解这些在集成拓扑、激光器放置和光纤连接方面的权衡,就能解释为何没有两个CPO交换机看起来完全相同。

集成拓扑:2.5D 与 3D

CPO中的核心封装问题是如何紧密耦合电子IC和光子IC。在2.5D集成中,两个裸片并排放置在通过微凸块或铜柱连接的无源硅中介层上。这相比传统的PCB布线减少了寄生电感,并支持高I/O密度,但信号在ASIC和光学引擎之间仍要跨越两个凸块接口,这会增加寄生参数并限制电气路径可以缩短的程度。

3D混合集成更进一步,将EIC直接堆叠在PIC之上,通过最小化封装寄生参数实现更高性能,尽管热管理和制造复杂性更高。NVIDIA光学引擎中使用的TSMC COUPE工艺就是3D堆叠的一个例子。

2.5D提供高密度互连和相对简单性,但面临可扩展性和热挑战;3D减少了占用面积和功耗,但增加了工艺复杂性。Santec的第一代CPO交换机在系统级封装中使用2.5D集成——将光学引擎围绕ASIC放置在有机基板上——而在光学引擎内部则使用3D堆叠。

激光器架构:外部与片上

早期的CPO设计将激光器放在PIC上,这简化了光路但带来了两个问题:激光器是组件中最不可靠的部分,并且它们在紧邻温度敏感的调制器和ASIC的位置产生热量。业界已趋向于将外部激光源作为首选解决方案。

通过将安装在交换机机箱或前面板上的激光器模块产生的连续波光通过光纤路由到光学引擎,设计者使激光器热量远离ASIC封装,并允许激光器独立更换而无需触碰交换机。例如,Ayar Labs的SuperNova从一个独立的、可现场更换的模块为其TeraPHY小芯片提供16个波长。其权衡在于从激光器到引擎的光纤路径中的插入损耗,必须保持在PIC调制器的光功率预算范围内。

光纤连接:固定式与可拆卸式

光纤如何连接到封装是CPO设计中最具影响的机械决策之一,它直接影响可维护性。边缘耦合——光纤在芯片边缘与波导端面对准并用环氧树脂粘合——是最成熟的方法,提供低插入损耗,但粘合是永久性的。表面耦合使用PIC顶面的光栅耦合器或微透镜将光垂直重定向到光纤阵列中,这允许更宽松的对准公差,并支持可拆卸连接器。

康宁的GlassBridge使用玻璃波导连接器进行高密度、可拆卸的光纤连接,而Marvell的金属PIC耦合器提供了另一种可拆卸选项。核心的权衡是插入损耗与可维护性:边缘耦合的固定式线束光学性能更好,但使得现场更换光纤线路变得困难;可拆卸的表面耦合连接器增加了损耗,但允许在不干扰ASIC封装的情况下断开光纤线束。

横向扩展与纵向扩展实现

这些架构选择根据CPO系统是面向横向扩展网络还是纵向扩展网络而有所不同。在横向扩展中——连接以太网结构中的数千台交换机——优先考虑的是端口密度和每比特成本。这里的光学引擎通常基于硅光子学,以每通道200 Gb/s运行PAM4,并且交换机ASIC主导了封装设计,多个引擎排列在其周边。在纵向扩展中——连接计算节点或机架内的GPU——需求转向更低的延迟、更高的每加速器带宽密度和更长的传输距离。这就是基于小芯片的光学I/O(如Ayar Labs的TeraPHY)变得相关的地方:不是用光学引擎围绕交换机ASIC,而是通过UCIe等标准将光学接口直接集成到加速器封装中,实现完全绕过交换机的芯片到芯片光链路。这些在架构上不同于交换机级的CPO,服务于网络层次结构中的不同点,尽管两者都属于CPO的范畴。

关键技术优势

带宽密度与可扩展性

可插拔光学在物理上受前面板限制——前面板上只能安装有限数量的笼位,每个笼位都会消耗功率并产生热量。CPO消除了这个天花板。通过将光学引擎直接围绕在交换机ASIC周围,设计者可以在相同的占用面积内封装更多的带宽,并通过增加引擎来扩展带宽,而无需重新设计电路板。

这使得CPO对于构成AI训练集群骨干的超大规模交换机特别有吸引力,在这些场景中,带宽需求每几年翻一番,物理密度与原始吞吐量同等重要。

能效

功耗是现代数据中心的关键限制因素,而光互连是整体功耗预算的重要贡献者。可插拔架构中的低效率是结构性的——信号必须被驱动穿过数厘米的有损PCB走线,由DSP恢复,并在到达光学引擎之前进行重定时。这些步骤中的每一步都会消耗功率。CPO通过将电气路径缩短到毫米级并完全移除DSP,消除了大部分开销。结果是每比特能量的大幅降低,在数万个GPU的规模上,这直接转化为节省的兆瓦级容量和更低的冷却基础设施成本。

延迟与信号完整性

铜走线会劣化信号。走线越长,需要的均衡就越多,而均衡会增加延迟。DSP重定时器加剧了这一点——它们恢复信号但引入了额外的处理延迟。在同步AI工作负载中,数千个GPU必须协调梯度更新,延迟确定性(latency determinism)与原始速度同样重要。CPO通过保持电气路径足够短,使信号无需重定时就能干净地到达调制器,从源头上解决了这个问题。结果是更低且更可预测的延迟,这提高了大规模分布式训练的效率。

传输距离与拓扑灵活性

一旦数据进入光纤,距离就变得廉价。机架内的铜互连在高通道速率下,在信号完整性出现问题之前,被限制在一两米内。来自CPO交换机的光链路可以跨越一排、一个房间或建筑物之间,无需中继器。这为网络架构师在如何布局计算集群方面提供了更多自由——GPU节点不再需要物理上紧邻为其服务的交换机,并且像胖树和蜻蜓网络这样的拓扑结构更容易用更少的交换级数构建。随着AI集群向百万GPU规模发展,这种物理布局的灵活性成为一个有意义的运营优势。

挑战与权衡

热管理与冷却

硅光子学组件对温度敏感,这是纯电子系统所没有的。调制器和激光器中的波长漂移即使在轻微的温度波动下也会降低光学性能,而将光子引擎直接放置在高功率交换机ASIC旁边,恰恰产生了难以管理的集中热量。传统的风冷在CPO交换机运行的高功率密度下越来越不足,推动设计者转向冷板等液冷解决方案。这增加了系统级复杂性和成本,并且需要仔细的热建模,以确保瞬态热点——例如在流量突发期间——不会将组件推至其工作范围之外。

光纤管理与可维护性

CPO交换机中的每个光学引擎都需要光纤连接,一个完全配置的交换机可能涉及数百到数千条独立的光纤路径。在机箱级别管理这种密度——布线、弯曲半径、连接器访问——是一个不小的机械工程问题。共封装设计的可维护性限制使其变得更加困难。可插拔模块可以在几秒钟内更换,而具有永久粘合光纤连接的CPO光学引擎则需要更复杂的干预才能更换。

一些供应商通过可拆卸光纤连接器或模块化光学子组件来解决这个问题,这些组件可以在不干扰ASIC的情况下移除,但这些方法会带来自身的插入损耗代价。可维护性仍然是运营商坚持使用可插拔模块的最有力论据之一。

制造与良率

CPO需要将本不属于一起的半导体材料和工艺进行异质集成——CMOS电子器件、硅光子学,以及在某些设计中,III-V族激光器材料。每个集成步骤都是一个潜在的良率损失点,并且由于组件一旦粘合,返工就受到限制,任何阶段的缺陷都可能导致整个组件报废。光纤到波导接口处的微米级对准公差进一步增加了工艺复杂性。

硅光子学供应链也比传统CMOS更不成熟,提供经过验证的大批量工艺的晶圆厂更少。在最终组装前建立已知合格裸片测试协议至关重要,但在技术上要求很高,因为测试光学组件需要与电气晶圆探针不同的基础设施。

标准与生态系统成熟度

可插拔光学的成功部分归功于强大的标准化——任何供应商的QSFP模块都可以在任何供应商的交换机中工作。CPO目前还没有等效的标准。机械接口、光纤连接方法、热规格和电气连接器标准仍在由光互联网论坛和共封装光学协作组织等机构定义。

这对工程师的实际影响是供应商锁定的风险:早期的CPO部署可能使运营商同时承诺使用特定的ASIC供应商、光学引擎供应商和光纤基础设施。在标准固化之前,转换成本很高,多供应商互操作性有限。

经济性

在每端口基础上,CPO目前比可插拔光学更昂贵。集成复杂性、较低的良率和不太成熟的供应链都导致了更高的前期成本。CPO的经济性论证基于系统生命周期内的总拥有成本——更低的功耗减少了电力和冷却成本,更高的带宽密度减少了构建特定网络所需的交换机和机架数量。

在超大规模场景下,大型GPU集群的光互连可能消耗大量电力,这些运营节省会迅速累积。随着制造量的增加和供应链的成熟,预计每端口成本差距将缩小,分析师的预测也反映了CPO将在本十年内变得具有成本竞争力的预期。

行业格局

华为

华为通过其海思半导体部门在CPO领域进行了全链条布局,涵盖自研芯片、硅光引擎、系统方案及生态合作。海思已发布业界首款56G SerDes CPO芯片,并推出7.2T高密度Hi‑ONE硅光引擎技术平台,支持224G NPO方案;其硅基光子芯片采用微环调制器和锗硅探测器,单芯片带宽达448Gbps。在产品层面,华为推出超节点全光互联方案,将CPO光引擎与昇腾AI芯片协同,用于降低AI集群的PUE;同时自研800G/1.6T光模块并支持CPO技术。产业链上,华为与华工科技联合研发CPO板级方案,并通过参股公司ficonTEC布局高精度CPO封测设备,与光库科技、腾景科技等构建完整生态。华为在行业评选中位列中国CPO领域前茅,但其专家指出CPO仍面临生态与工程挑战,认为NPO是重要的过渡方案。海思规划到2027年实现光互连芯粒在3D堆叠芯片中的量产,带宽突破5Tbps。

NVIDIA

NVIDIA通过其Quantum-X Photonics InfiniBand交换机和Spectrum-X Photonics以太网交换机进入CPO领域,两者均在GTC 2025上宣布。Quantum-X于2026年初实现商用;Spectrum-X预计在2026年下半年推出。NVIDIA的光学引擎使用TSMC的COUPE工艺,采用3D堆叠的EIC和PIC,以及微环调制器——与基于MZM的方案相比,这种设计选择降低了驱动电压和每比特能耗。外部激光器由Lumentum和Coherent等合作伙伴提供,将高热组件保持在ASIC封装之外。NVIDIA声称相比可插拔光模块,网络能效提高了3.5倍。一个值得注意的架构特点是可拆卸光学子组件,它允许在不干扰交换机ASIC的情况下现场更换光学引擎——这是对运营商对CPO采用持谨慎态度的可维护性担忧的直接回应。

博通

博通在所有交换机ASIC供应商中拥有最长的商业CPO记录,在2025年底宣布其第三代CPO交换机TH6-Davisson之前,已经出货了Tomahawk 4和Tomahawk 5的CPO版本。TH6-Davisson使用基于TSMC COUPE的光学引擎提供102.4 Tb/s的带宽,目前正在向早期访问客户提供样品。博通报告称,相对于传统的可插拔解决方案,光互连功耗降低了70%。在标准方面,博通与其他行业参与者共同创立了光计算互连多源协议,旨在为多供应商光计算互连创建即插即用规范——解决阻碍CPO采用的供应商锁定问题。博通还提供传统可插拔配置的Tomahawk 6,这表明它认为CPO和可插拔模块将在短期内共存,而不是CPO立即取代一切。

Marvell

Marvell从交换机ASIC和定制加速器两个角度切入CPO。其参考CPO交换机设计使用围绕ASIC排列的模块化6.4T光引擎瓦片,并采用可拆卸的金属PIC耦合器以实现现场可维护性。除了交换机,Marvell还将3D硅光子学引擎集成到定制XPU平台中,消除了计算小芯片之间的铜走线,并实现了跨机架的光连接。这使Marvell处于横向扩展交换和纵向扩展加速器互连的交汇点——比纯交换机供应商拥有更广泛的CPO布局。

Ayar Labs

Ayar Labs采用根本不同的架构方法,目标是纵向扩展计算结构,而非交换机ASIC。其TeraPHY小芯片通过UCIe标准将基于微环的光学I/O直接集成到加速器封装中,外部SuperNova激光器提供16个波长。其结果是实现了铜基NVLink式互连在规模上无法比拟的带宽和延迟下的芯片到芯片光连接。Ayar Labs本质上是在构建未来GPU和AI加速器封装内部的光学结构层,而不是交换机之间的连接。

生态系统推动者

CPO依赖于一个远超ASIC和光学引擎供应商的供应链。TSMC的COUPE工艺是NVIDIA和博通光学引擎的基础。康宁提供光纤线束、GlassBridge可拆卸连接器和多芯光纤产品,以解决机箱级别的光纤密度挑战。Lumentum和Coherent提供两大CPO交换机供应商都依赖的外部激光源。OIF继续推动电气和光学接口的互操作性标准,而OCI MSA则专门针对纵向扩展光计算互连层。

结论

共封装光学标志着数据中心互连设计的一个真正拐点,而不仅仅是渐进式改进。通过将光学引擎直接与交换机ASIC和加速器集成,CPO同时解决了可插拔光学在AI规模下无法解决的三个限制:功耗、带宽密度和板级距离上的信号完整性。商业部署已经在进行中,表明CPO不再是路线图上的项目,而是数据中心架构师必须规划的工程现实。

挑战是真实存在的,不应被低估。热管理、光纤密度、制造良率以及缺乏通用标准仍然是活跃的工程问题,而非已解决的问题。这种转变在网络层次结构中将是不均衡的。横向扩展CPO已经进入生产阶段;纵向扩展光结构——连接机架内和跨机架的加速器——预计将从2027年开始有意义的部署,随着供应链和标准的成熟,到2028年达到高产量。即便如此,采用也将是渐进的:纵向扩展市场目前仍由铜互连主导,领先的供应商正在将铜基解决方案至少扩展到2027年。

CPO不会统一或快速地取代可插拔光学。这两种形态服务于成本-复杂性曲线上的不同点,并将在本十年的大部分时间里在同一数据中心内共存。展望更远的未来,CPO的架构逻辑超越了交换机。直接集成到AI加速器封装中的光学小芯片——提供任何电气互连都无法比拟的带宽和延迟——代表了下一个前沿。随着光子和电子协同设计的成熟,计算和互连之间的界限将继续模糊,而今天正在建设的数据中心将看起来像是最后一代由铜主导的基础设施。

推荐阅读:NPU VS 谷歌TPU:深入理解AI芯片的关键差异

常见问题解答

共封装光学与可插拔光学有何区别?

共封装光学将光学引擎集成在与交换机ASIC或加速器相同的封装内。从硅芯片到调制器的电气路径只有几毫米长,因此CPO消除了DSP重定时器,并提供更高的带宽密度和更低的每比特功耗。可插拔光学位于前面板上,通过15-30厘米的铜走线连接。它们需要高功耗DSP,并且延迟更高。CPO在已演示的实现中将每比特能量从约15–20 pJ/比特降低到5–10 pJ/比特,并提高了端口密度。

光子集成电路如何实现CPO?

PIC是包含波导、调制器、光电探测器和其他光学组件的硅光子芯片。在CPO封装中,PIC通过混合键合与电子IC接口,并通过耦合器连接到光纤。硅光子学允许使用CMOS兼容工艺在晶圆上集成数千个光学功能,从而实现紧凑、低功耗的光学引擎。采用微环调制器的PIC实现了高带宽密度和更低的驱动电压,从而降低了每比特能耗。

为什么许多CPO设计使用外部激光源?

激光器会产生热量并且需要严格的可靠性,因此将其直接集成在CPO封装上是不切实际的。外部激光源通过波导向多个光学引擎提供连续波光。这种方法改善了热管理,允许使用更高功率的激光器,并提供冗余。例如,Ayar Labs的SuperNova向其TeraPHY小芯片提供16个波长。外部激光器还使得光学引擎在不同封装之间的可维护性和扩展性更容易。

采用共封装光学的主要挑战是什么?

主要挑战包括热管理、光纤处理、制造良率和生态系统标准化。光子器件对温度敏感。将它们集成在高温ASIC旁边需要先进的冷却和仔细的热建模。高密度CPO系统可能涉及数千根光纤,使布线和可维护性复杂化。PIC、EIC和混合键合中的错位或缺陷可能会影响制造良率。最后,机械接口、调制格式和测试的行业标准仍在发展中,因此早期采用者必须应对专有解决方案。

近封装光学与CPO有何不同?

NPO将光学引擎放置在PCB边缘,靠近ASIC但在封装之外。与可插拔模块相比,这缩短了电气路径长度,但仍保留了一些铜走线,并且通常需要重定时器。NPO与线性可插拔光学相关但有区别,后者从可插拔模块中移除了DSP,但没有将光学器件更靠近ASIC。相比之下,CPO将光学引擎移动到与ASIC相同的封装中,消除了对DSP的需求,并实现了最高的带宽密度。

CPO何时将在AI数据中心成为主流?

CPO部署已经分阶段进行。博通在2025年期间出货了数万台Tomahawk 5-Bailly CPO交换机,NVIDIA的Quantum-X Photonics InfiniBand交换机于2026年上市,以太网CPO紧随其后于2026年下半年推出。分析师预计,在纵向扩展GPU结构中的大规模采用将从2027年开始,一旦供应链成熟、标准固化且成本结构改善,到2028年左右将达到高产量。在此过渡期间,可插拔光学将保持普遍存在,特别是对于低速链路。

不同供应商如何实现共封装光学?

博通使用环氧树脂粘合光纤连接到围绕Tomahawk交换机ASIC排列的6.4T引擎,在Tomahawk-6代中提供51.2 Tb/s并可扩展至102.4 Tb/s。NVIDIA的CPO设计使用1.6 T基于微环的引擎,分组为可拆卸的4.8 T OSA,并利用COUPE 3D堆叠。Marvell的参考设计用16个光引擎瓦片围绕ASIC,并使用带有数千根光纤的可拆卸金属PIC耦合器。Ayar Labs专注于通过UCIe标准提供8 Tb/s的纵向扩展光学小芯片。Ciena提供一种无重定时器的CPO模块,桥接了可插拔和CPO领域。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)