大模型备案新规将至:企业部署私有AI模型,数据安全合规到底要过几道关?

2026年被业界称为"AI监管大年"——新版《网络安全法》将AI纳入法治框架、处罚上限提至1000万,GB/T 45654国家标准正式实施,《人工智能拟人化互动服务管理暂行办法》即将落地……企业私有化部署大模型,数据安全合规到底要过几道关?

前言

过去两年,"私有化部署大模型"几乎是每家有一定规模企业的IT规划必选项。理由很直接:数据不出域、模型自主可控、避免公有云数据泄露风险。

但一个容易被忽视的事实是:私有化部署不等于合规通行证。

2026年2月,国家网信办、工信部、国家数据局等部门密集出台新规,多项重磅征求意见稿已在Q2-Q3排期落地。与此同时,从CSDN等技术社区的讨论来看,大量企业对"私有模型到底受不受监管""合规要做什么"仍存在模糊认知。

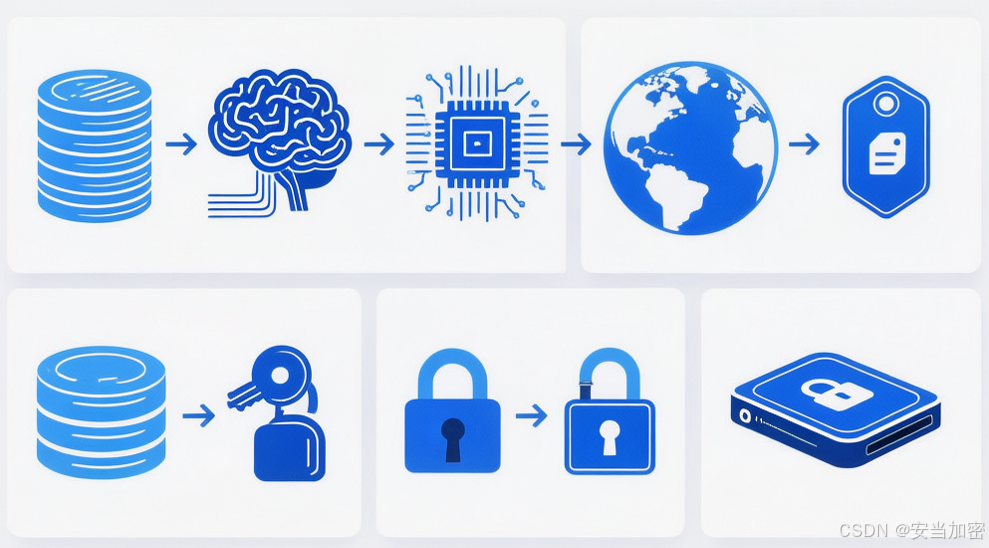

本文试图帮你梳理清楚:部署私有大模型,数据安全合规到底有几道关要过,每道关的核心要求是什么。

第一关:训练数据来源合规——"5%红线"你过了吗?

这是很多企业最容易忽略,也是最容易被"秋后算账"的一关。

GB/T 45654-2025 怎么说?

2025年11月1日正式实施的GB/T 45654-2025《网络安全技术 生成式人工智能服务安全基本要求》,是我国首个专门针对生成式AI服务的国标。其中对训练数据提出了量化红线:

| 环节 | 核心要求 |

|---|---|

| 数据采集前评估 | 对数据来源随机抽样,违法不良信息超过5%的不应采集 |

| 数据采集后核验 | 对已采集数据随机抽样,违法不良信息超过5%的不可用作训练 |

| 全量过滤 | 对全部训练数据进行过滤,去除违法不良信息 |

| 人工抽检 | 不少于4000条,训练数据合格率不低于96% |

| 知识产权 | 不侵害他人知识产权,需具备知识产权管理策略 |

| 个人信息 | 使用前需取得个人同意,敏感个人信息需单独同意 |

关键词是"可追溯":标准要求企业对训练数据来源进行随机抽样安全评估,这意味着你不能只说"数据来自公开渠道",而是要拿出抽样报告和核验记录。

企业常见踩坑

- 坑1:用爬虫从互联网采集行业数据进行微调,未做合规审查。如果这些数据中包含个人信息或商业秘密,即使模型是私有部署,训练数据来源本身就不合规。

- 坑2:采购第三方数据集直接用于训练,但未要求供应商提供数据合规证明。

- 坑3:用企业内部历史业务数据训练,但未对其中涉及的客户隐私数据进行脱敏处理。

建议:建立训练数据台账制度,每一批数据都要记录来源、抽样结果、过滤措施、合规审批人。

第二关:模型安全可控——输出合格率达标了吗?

训练数据合规只是起点,模型本身的"安全性"同样有量化指标。

核心量化指标

GB/T 45654-2025 对模型生成内容提出了明确的合格标准:

| 指标 | 要求 |

|---|---|

| 内容安全合格率 | 不低于90% |

| 偏激问题拒答率 | 不低于95% |

| 正常问题误拒率 | 不高于5% |

| 后门检测 | 定期进行后门存在性检测,发现后门及时处置 |

| 训练/推理环境 | 需隔离(物理隔离或逻辑隔离) |

这些指标意味着企业需要:

- 建设安全风险测试题库,并持续更新

- 建立模型上线前安全测评机制,覆盖伦理道德、模型幻觉、隐私泄露、指令攻击、对抗攻击等

- 将模型生成内容安全性作为训练评价指标之一

私有部署的特殊风险

很多人以为模型放在本地就安全了,但现实打脸来得很快:

- 2025年8月,NVIDIA Triton推理服务器被曝高危漏洞(CVE-2025-23319),攻击者无需凭证即可远程执行代码、窃取AI模型。

- 某AI公司因Linux内核提权漏洞(CVE-2024-1086)突破容器隔离,导致千亿参数模型及128块H100显卡被窃取,直接损失数亿元。

- 监测数据显示,32%的Ollama私有部署实例存在API无认证问题,攻击者可直连默认端口删除模型文件。

私有化部署将安全责任完全交给了企业自己——没有云厂商的安全团队帮你兜底。

第三关:数据出境合规——你的模型数据出境了吗?

如果你的企业有跨境业务,这一关至关重要。

2026年新动态

2026年2月,八部门联合发布《汽车数据出境安全指引(2026版)》,将自动驾驶AI决策数据、车辆运行状态数据纳入重要数据清单。AI处理的重要数据出境必须通过安全评估。

国家数据局也拟制定《人工智能数据出境安全管理细则》,预计Q3落地,核心方向:

- 区分训练数据与推理数据出境规则,训练数据出境限制更严格

- 建立AI模型数据出境评估机制

- 明确标准合同与认证路径

私有部署也要关注?

是的。即使模型部署在本地,以下场景仍涉及数据出境:

- 模型训练使用了海外采集的数据

- 企业员工在海外通过VPN访问内部AI服务

- 模型输出的结果需要同步给海外分支机构

建议:对AI系统的数据流转路径进行全面梳理,标注出每一个可能涉及跨境的数据节点。

第四关:内容标识与透明度——AI生成的内容标注了吗?

这是2026年执法最严的一环。

已落地政策

2026年2月17日,《人工智能生成内容安全管理办法(升级版)》正式落地,核心要求:

| 内容类型 | 标识方式 |

|---|---|

| 文本 | 首尾或中间添加文字/符号提示 |

| 音频 | 语音提示或节奏标识 |

| 图片 | 显著水印/标识 |

| 视频 | 嵌入式标识或片头片尾标注 |

网信办已开展专项整治,半月清理违规信息54万条。

企业影响

即使你的模型是内部使用,如果AI生成的内容对外发布(营销文案、客服回复、报告生成等),也需要符合标识要求。此外,标准还要求:

- 在显著位置公开服务的适用人群、场合、用途

- 在服务协议中公开服务局限性、模型/算法概要信息

- 提供关闭收集输入信息用于训练的选项,关闭方式不超过4次点击

第五关:访问控制与权限管理——谁能访问你的模型?

这一关往往是技术团队最熟悉的,但也最容易"做着做着就松了"。

私有模型的典型权限风险

| 风险场景 | 具体表现 |

|---|---|

| API暴露 | 推理服务端口(如Ollama默认的11434)未启用认证,内网任何人可直连 |

| 账号共享 | 多人共用一个管理员账号,无法追溯操作 |

| 权限过大 | 开发人员拥有生产模型文件的操作权限 |

| 终端访问 | 运维人员可通过SSH直接登录推理服务器,拷贝模型文件 |

| 日志缺失 | 模型访问日志未记录或留存时间不足 |

合规要求

新版《网络安全法》要求关键信息基础设施运营者建立AI应用风险监测与应急响应机制。GB/T 45654也要求设置与服务规模匹配的监看人员,建立投诉举报途径。

从技术角度,一个基本的权限管控框架应该包括:

访问控制层次模型:

- 第一层:网络层 → IP白名单 / 网络隔离

- 第二层:认证层 → 双因素认证 / 零信任

- 第三层:应用层 → API Token / RBAC

- 第四层:数据层 → 加密存储 / 脱敏访问

- 第五层:审计层 → 全链路日志 / 实时告警

第六关:数据加密与存储安全——模型文件"裸奔"了吗?

这是最后一道关,也是很多企业做得最薄弱的一环。

核心问题:模型文件安全吗?

大模型文件的体积通常在数十GB到数百GB之间(一个7B参数的模型约14GB,70B约140GB),如此高价值的数字资产,很多企业的保护方式竟然是——直接放在服务器磁盘上。

这意味着:

- 服务器管理员(root账号)可以直接拷贝模型文件

- 如果服务器被入侵,攻击者可以整盘拖走

- 勒索病毒可以对模型文件进行"二次加密"

- 离职员工如果之前有备份权限,模型就直接带走了

应对思路

从技术架构上,模型文件保护需要解决两个核心问题:

问题一:如何让数据"落盘即密文"?

透明加密(TDE,Transparent Data Encryption)是目前主流的解决方案。其核心思路是在操作系统驱动层拦截文件读写操作,实现:

- 应用程序(如推理引擎)读取模型文件时自动解密,对应用完全透明

- 未经授权的进程(如cp、scp、rsync)读取时只能拿到密文

- 即使磁盘被物理盗取,数据也无法还原

这种方案的差异化优势在于应用免改造——不需要修改推理引擎的任何代码。

问题二:谁有权解密?

这就需要结合密钥管理体系和进程级访问控制:

- 通过进程白名单,只允许指定的推理进程(如ollama、vllm)访问模型文件的明文

- 通过用户权限控制,限定只有特定账号可以启动推理服务

- 根密钥由硬件加密机(HSM)保护,即使服务器被完全攻陷,没有HSM也无法解密

密钥保护架构:

硬件加密机(HSM) → 密钥管理平台 → TDE透明加密 → 模型文件落盘即密文

- HSM保护根密钥

- 密钥管理平台管理密钥生命周期

- TDE提供进程管控

合规自检清单:你的企业过了几道关?

| 关卡 | 检查项 | 你的状态 |

|---|---|---|

| 第一关 | 训练数据来源是否有抽样评估报告? | [ ] |

| 第一关 | 个人信息使用是否取得同意? | [ ] |

| 第二关 | 模型输出安全合格率是否≥90%? | [ ] |

| 第二关 | 推理API是否启用认证? | [ ] |

| 第三关 | AI系统的数据流转是否标注了跨境节点? | [ ] |

| 第四关 | AI生成内容对外发布时是否添加标识? | [ ] |

| 第五关 | 模型访问是否有双因素认证? | [ ] |

| 第五关 | 模型访问日志是否留存≥6个月? | [ ] |

| 第六关 | 模型文件是否加密存储? | [ ] |

| 第六关 | 非授权进程能否拷贝模型文件? | [ ] |

如果以上10项有超过3项打了"×",建议尽快启动合规整改。

关键时间节点提醒

| 时间 | 重要事项 |

|---|---|

| 2026年Q2 | 《人工智能拟人化互动服务管理暂行办法》预计发布正式版 |

| 2026年Q2 | 《AI训练数据安全指南》预计落地 |

| 2026年Q3 | 《AI应用安全通用指引》预计发布 |

| 2026年Q3 | 《AI数据出境安全管理细则》预计落地 |

写在最后

2026年的AI监管趋势很明确:从"要不要管"到"怎么管",从"原则要求"到"量化指标"。

对于已经或计划私有化部署大模型的企业来说,合规不是一道选择题,而是一道必答题。关键是:不要等到监管上门才开始准备,合规工作应该和模型部署同步规划、同步实施。

六道关,每一道都有明确的技术方案可以应对。难点不在于"能不能做",而在于"知不知道要做"。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)