【专家观点】秦凤伟:AIGC时代智算中心网络协议演进与思考

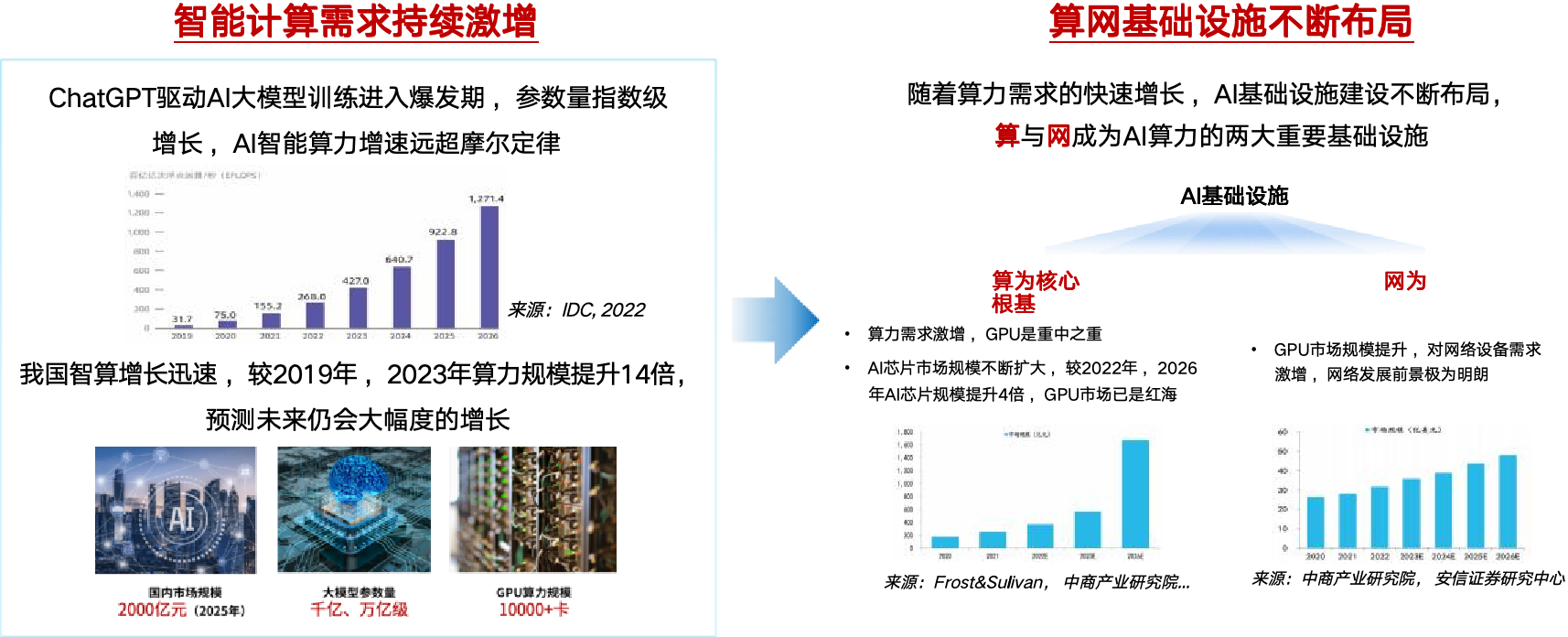

一、AI需求激增推动建设计算和网络基础设施****~篇幅有限,仅展示了部分

ChatGPT引爆AI ,智算算力需求激增 ,参数量呈指数级迭代增长推动计算与网络基础设施建设不断布局

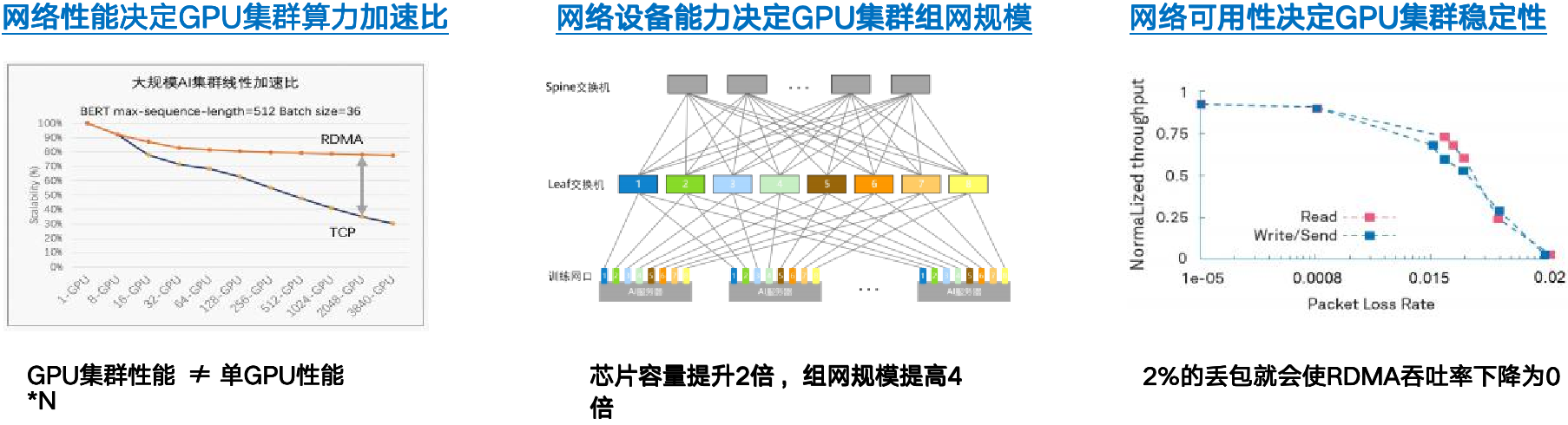

二、面向大模型训练 , 网络成为AI算力瓶颈

- AI大模型以GPU集群分布式训练为基础 , 带来大量节点间通信消耗 , 网络成为AI算力“瓶颈”

- 当前业界主流智算中心网络技术被国外厂商垄断 , 网络芯片存在代际差距 , 网络可能成为我国AI发展的“新卡点”

集群有效算力∝{GPU单卡算力总卡数线性加速比*有效运行时},随着GPU单卡算力进一步受限 ,获得同等算力的难度持续增加 , 以网强算是支撑为未来大模型训练的关键

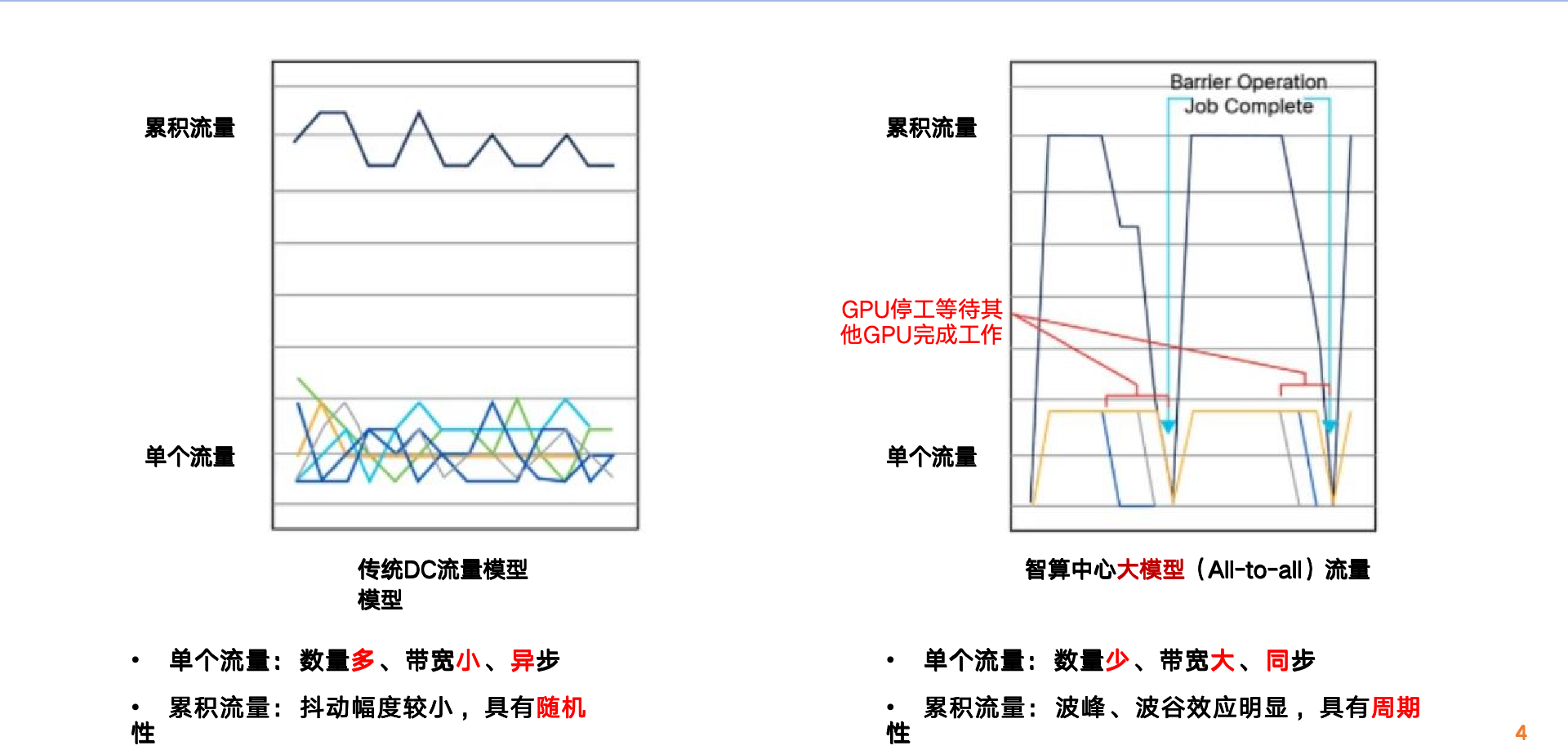

三、传统DC与智算中心流量模型区别

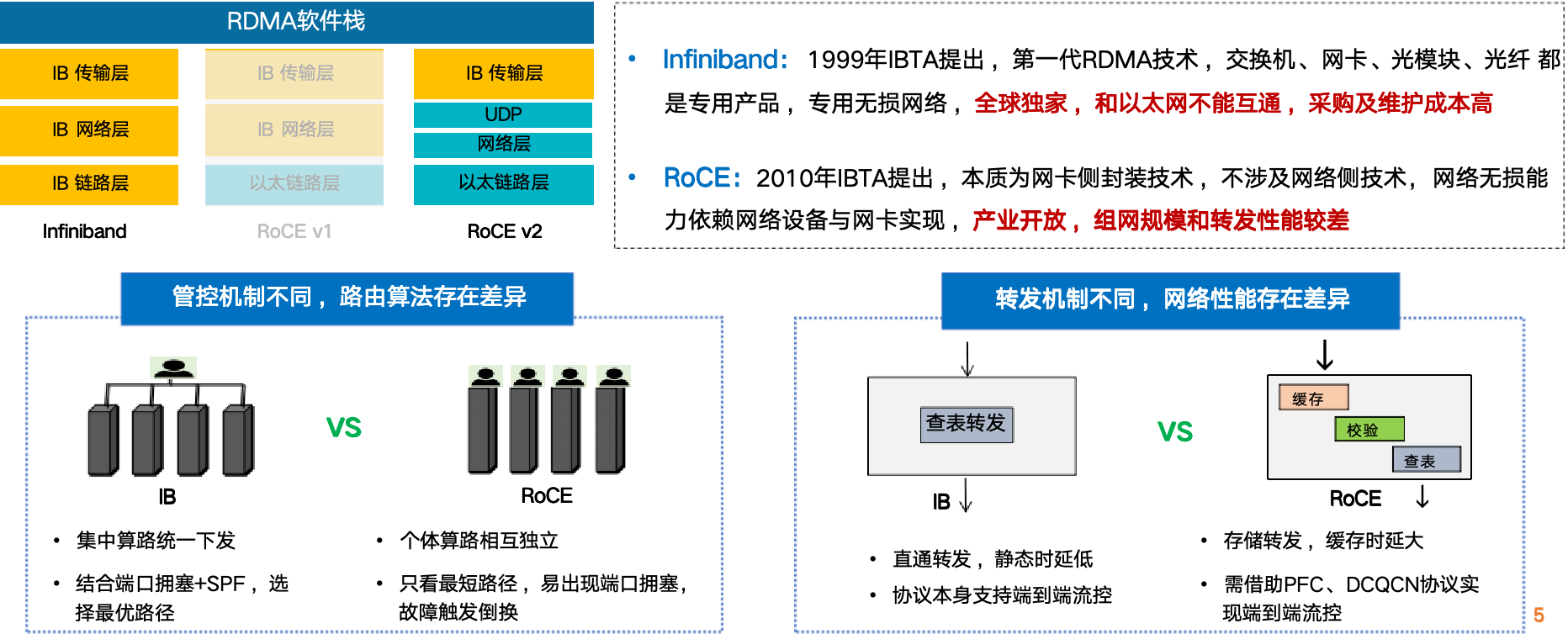

五、IB与RoCE是目前业界主流高性能网络协议

Infini Band与RoCE是由IBTA提出的两种主流面向RDMA提供高性能交换能力的传输协议 , 前者从硬件级别保证网络低时延、 高吞吐,后者是将RDMA应用到以太网 ,依赖PFC等协议实现无损 , 两者在路由机制、 转发机制、 算网能力等方面存在差异

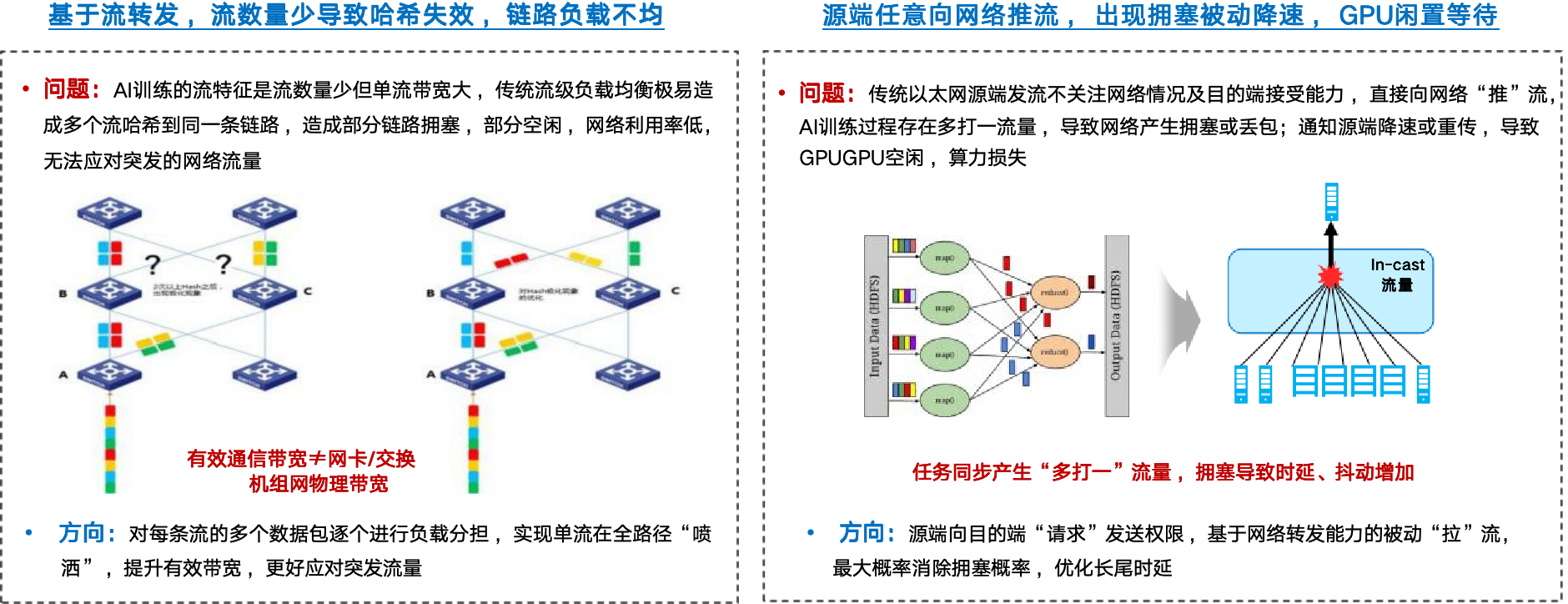

六、当前RoCE网络存在诸多问题 , 不适应大AI模型部署

现有以太网协议基础转发和调度机制 ,在AI模型训练场景存在天然缺陷 , 单纯优化上层网络协议无法解决,需对底层转发和调度机制进行革新 , 并推动网络芯片底层逻辑架构支持 ,突破无损以太性能瓶颈

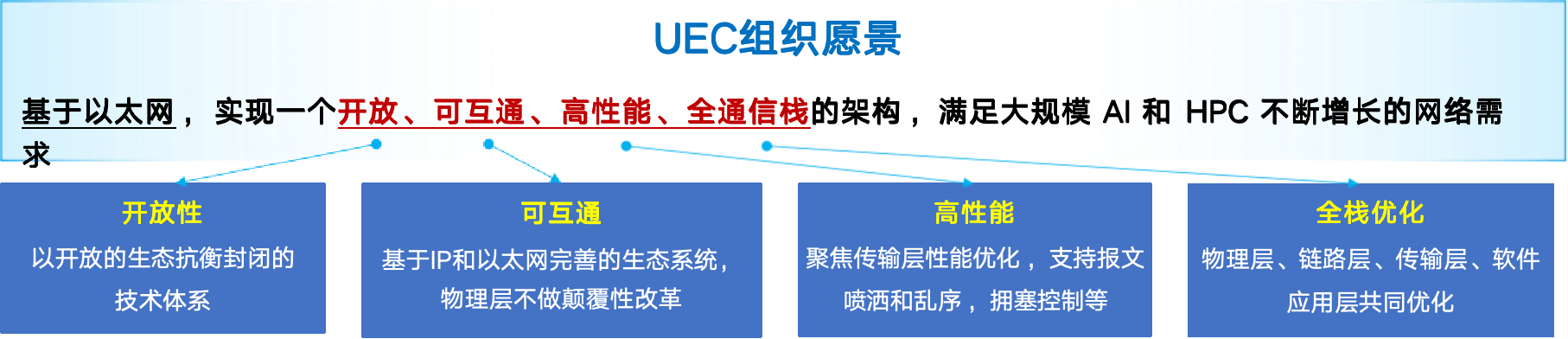

七、业界智算中心高性能网络标准组织介绍—UEC

2023年7月19日 , Linux基金会成立超以太网联盟 (UEC) ,发布UE技术愿景白皮书 , 当前已成立四个工作组并与OCP开展合作

• 面向大模型和高性能计算场景 ,从物理层到软件层对以太协议栈和配套芯片产业进行革新

• 创始成员: AMD、Arista、博通、思科、 Eviden 、 HPE、 Intel、 Meta和微软 ,强强联合 ,覆盖全产业生态 ,核心是将“产品”标准化

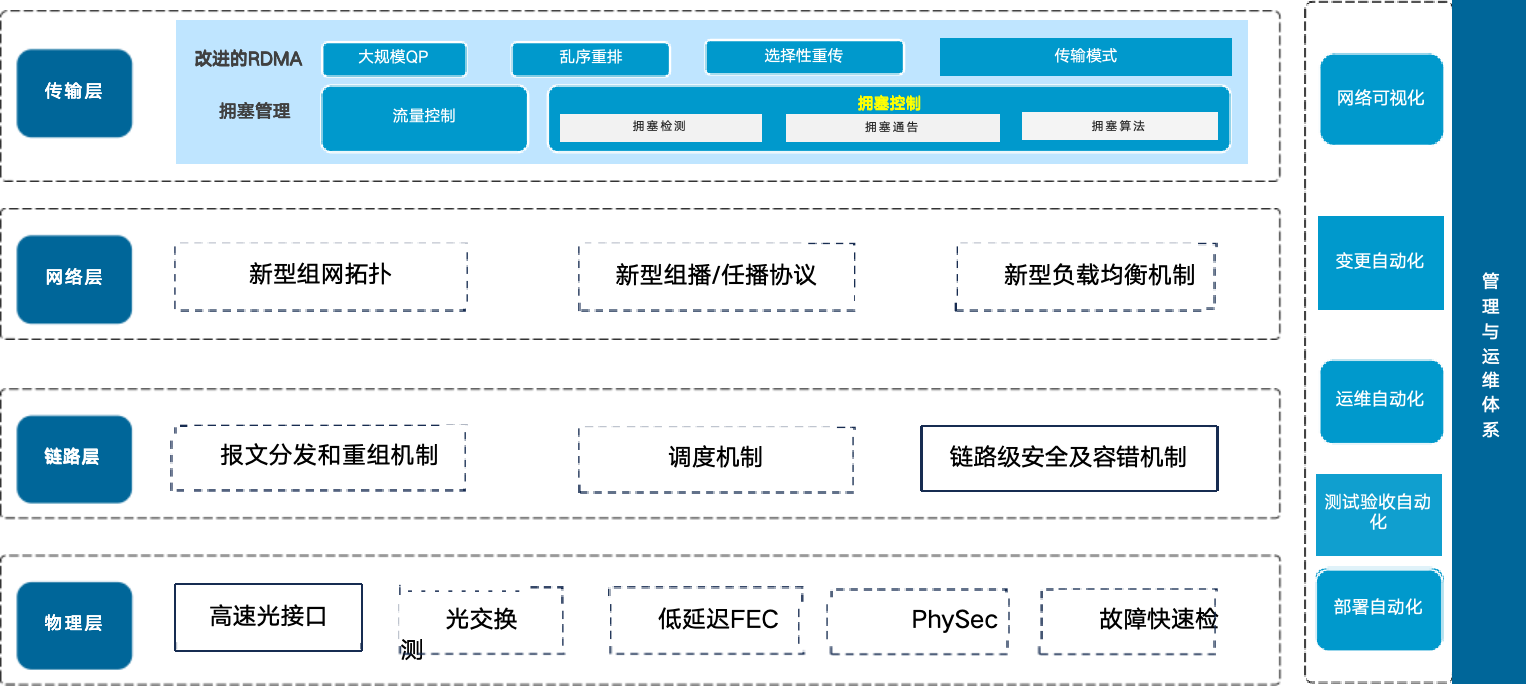

八、GSE技术体系框架

GSE技术体系最大限度兼容以太网生态 ,从四层(物理层、链路层、网络层、传输层) +一体(管理和运维体系)等几个层级进行优化和增强 ,构建无阻塞、高带宽、低时延的新型智算中心网络 ,形成标准开放的技术体系 ,助力AI产业发展

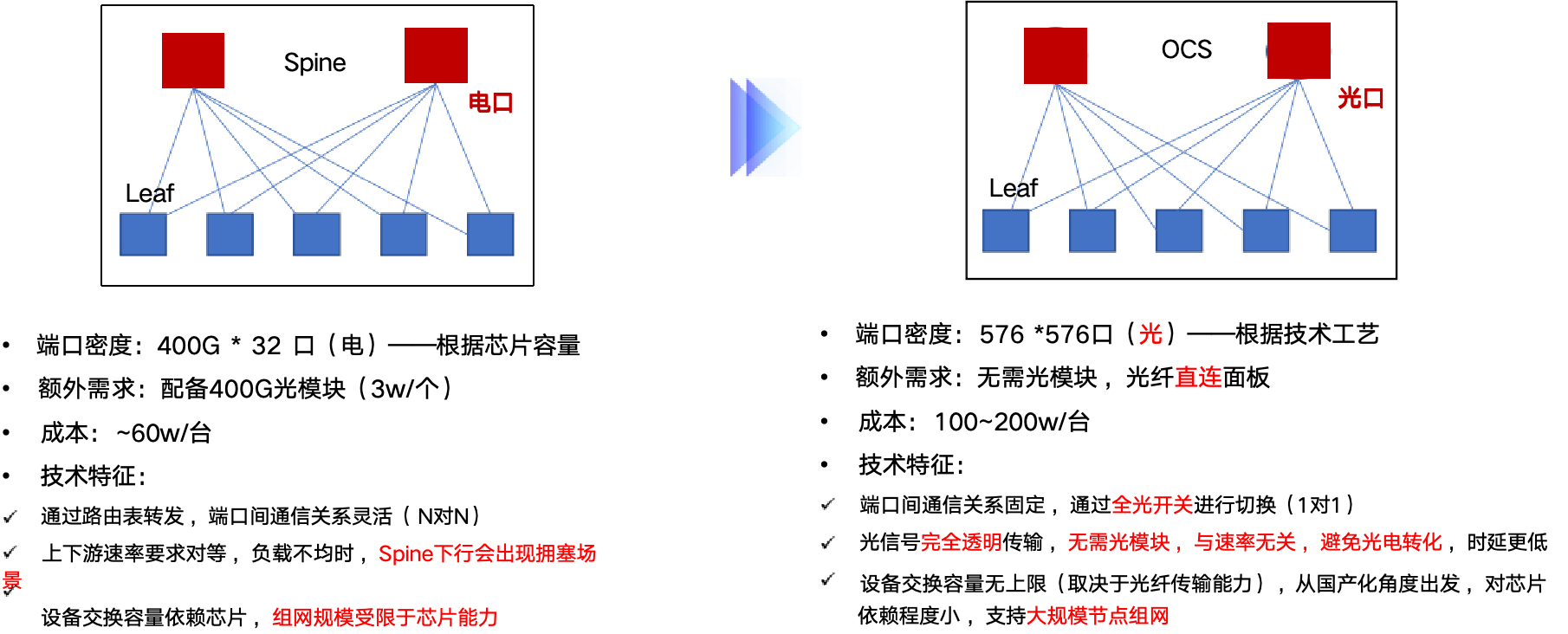

九、GSE技术体系—光交换

新型光交换机与传统交换机的核心区别在于用光口代替电口 ,无需插光模块 , 可实现端口与速率无关; 内部无交换芯片 ,点到点通信关系一定时间内固定 ,设备容量及端口密度与芯片无关 , 可用在网络中替代Spine设备 ,提升网络性能及建设扩容灵活性

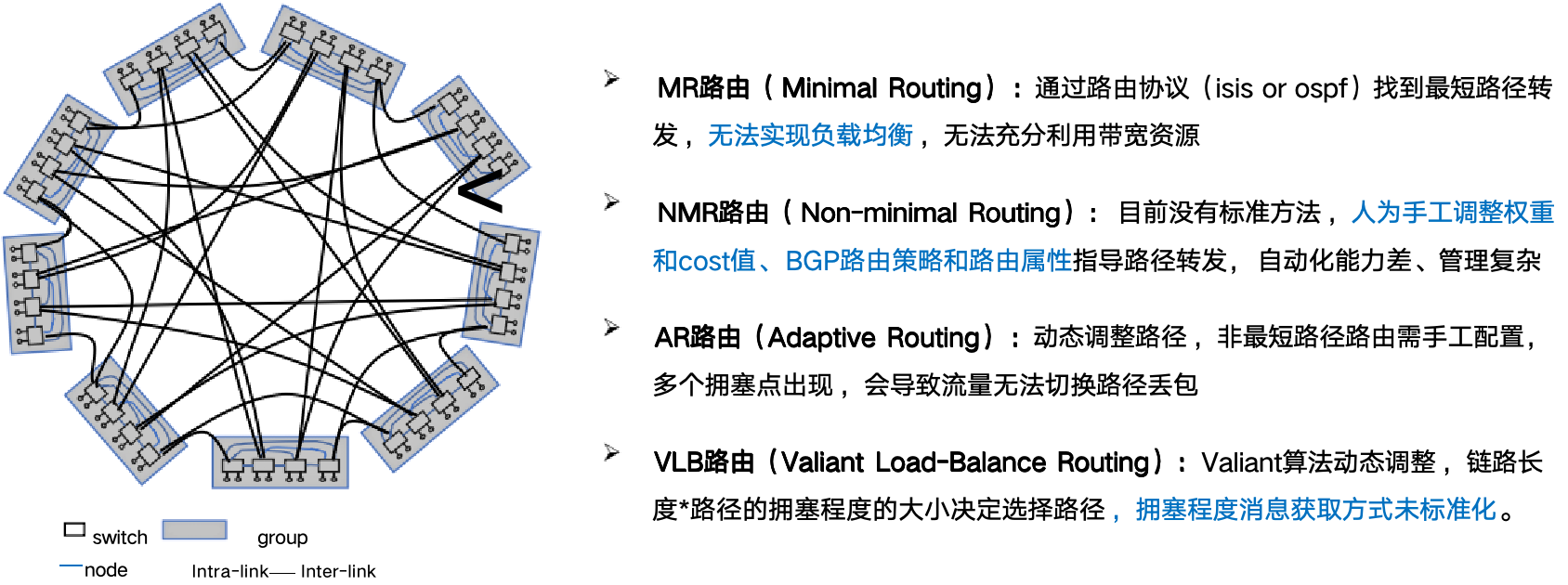

十、GSE技术体系—新型拓扑

• Group与Group之间full-mash, 每个group内部可以是任意拓扑结构 ,如Fat-tree( Dragonfly+)

• 人为干预控制流量转发 ,缺乏动态负载分担机制

• 现有网络架构缺乏网络拥塞的标准定义和远程拥塞的通知机制 ,难以及时获取拥塞信息。

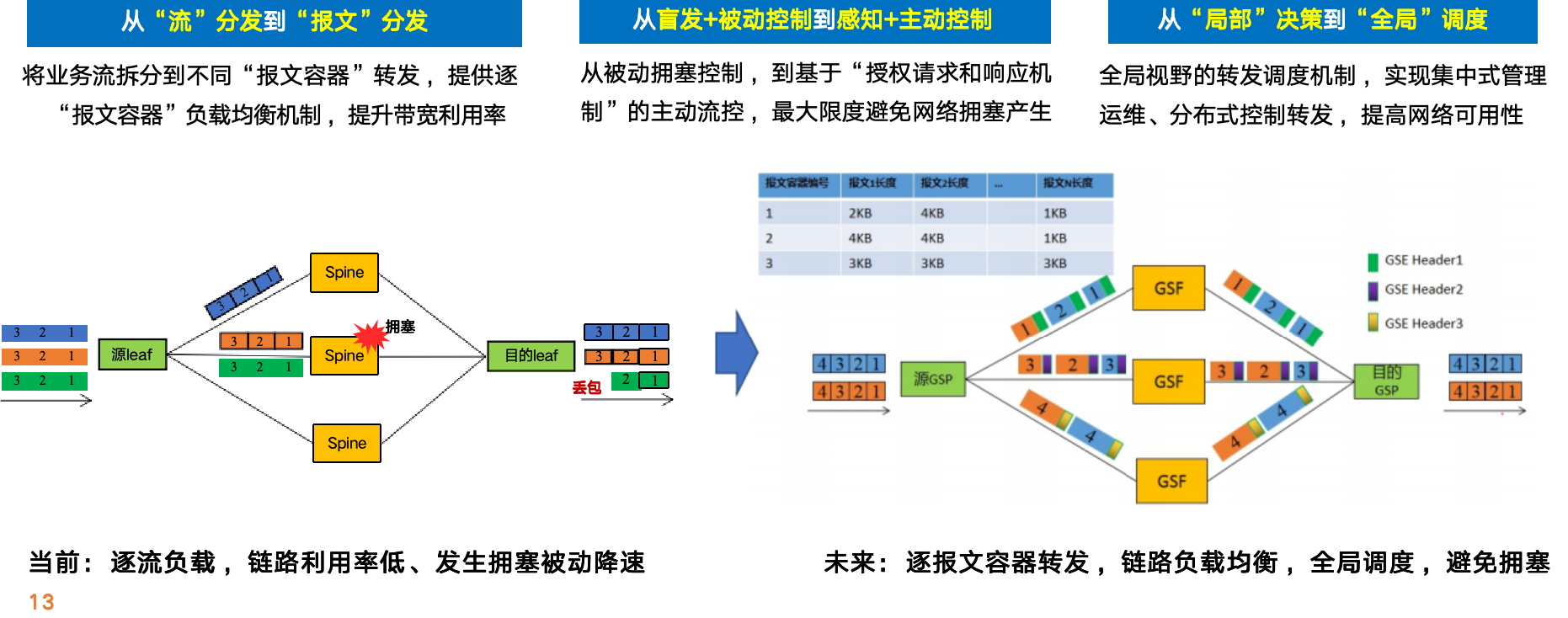

十一、GSE技术体系—全调度以太网三大核心机制

中国移动提出全调度以太网(GSE) 技术架构 ,最大限度兼容以太网生态 ,创新基于报文容器( PKTC) 的转发及调度机制,构建无阻塞、 高带宽、 低时延的新型智算中心网络 ,形成标准开放的技术体系 ,助力AI产业发展

创新以太网转发机制 , 实现三大核心机制转变

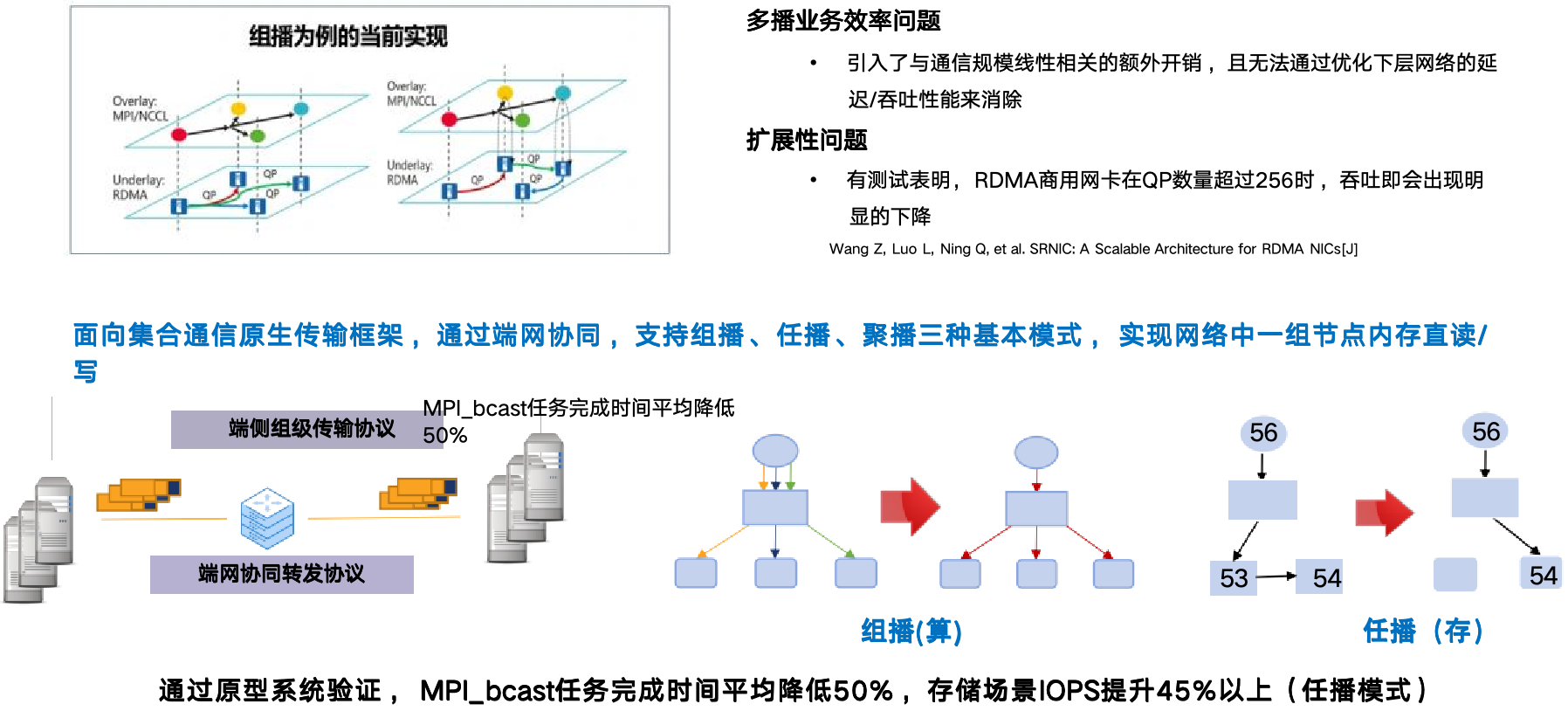

十二、GSE技术体系—NDMA

分布式系统节点间以多对多的集合通信为主 , 业界主流方案基于RDMA点到点高效传输 , 实现多对多集合通信 ,存在性能瓶颈

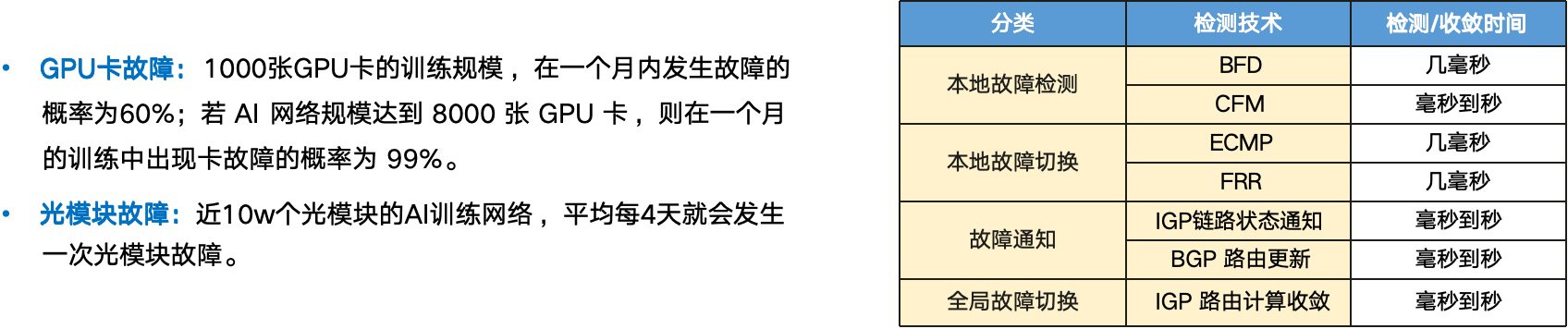

十三、GSE技术体系—网络可靠性

AI大模型训练中所需GPU卡数量达到千卡、万卡级别 ,增加了网络故障概率 ,如何提高网络可靠性是重中之重

• 本地故障检测:本地检测时间大约为几毫秒 ,故障检测时间太长 ,无法满足模型训练需求

• 本地故障切换:在发生链路故障时 ,通过ECMP、 FRR等技术进行快速切换 ,将链路切换为备份链路。链路故障切换时间可在毫秒内实现

• 故障通知: IGP链路状态泛洪和BGP路由更新太慢 ,远端发生故障缺乏统一的故障通知机制

• 全局故障切换:当前只有本地故障的快速切换机制 ,但在响应远程故障时 ,仍缺乏快速切换机制

当前 ,AI大模型训练网络故障后 ,本地故障处理时间为几毫秒 ,远端故障处理时间为几秒 ,故障处理时间过长

十四、总结与展望

• 智算中心网络的有效带宽、 时延抖动、 可靠性成为提升训练效率的关键因素

• 以全调度以太网为核心 , 开展四层(物理层、 链路层、 网络层、 传输层) +一体(管理和运维体系) 攻关,构建标准开放技术生态和评测体系 ,推动新型智算中心网络技术体系成熟

• 欢迎更多上下游产业伙伴加入GSE推进计划 ,推动GSE技术标准和生态成熟 ,助力AI技术发展

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)