Roboflow100-VL: A Multi-Domain Object Detection Benchmark for Vision-Language Models论文精读

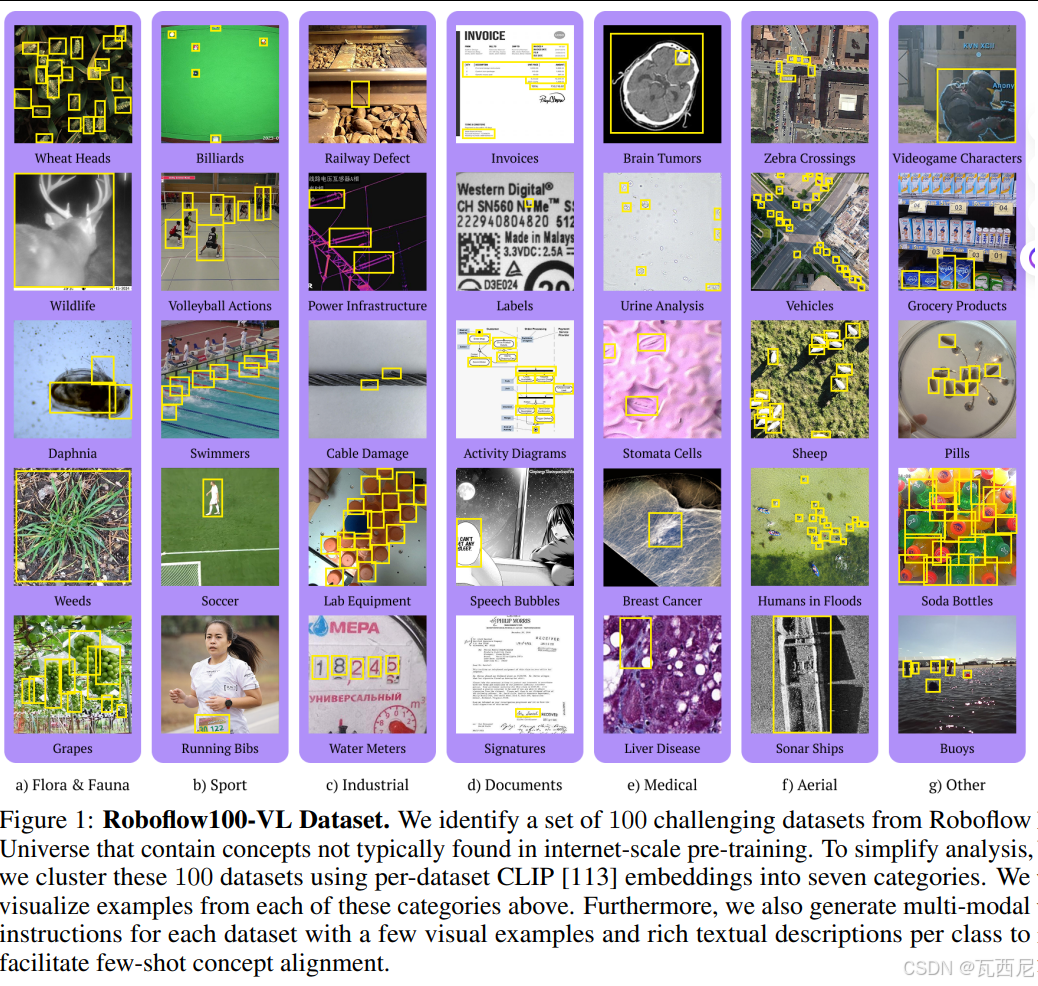

这篇论文《Roboflow100-VL: A Multi-Domain Object Detection Benchmark for Vision-Language Models》提出了一个专门用于评估视觉语言模型(VLMs)在分布外目标检测任务上表现的基准数据集,并系统性地探索了多种微调策略。

以下是基于论文内容的详细解析,重点会放在微调策略及其效果上。

1. 核心动机:为什么需要针对目标检测任务微调VLM?

论文认为,当前顶级的VLMs(如GroundingDINO、Qwen2.5-VL)虽然在常见物体(如COCO数据集中的类别)上零样本性能惊人,但在面对分布外的、真实世界应用场景时表现极差。

- 问题的根源:

- 罕见/专有概念:类别标签是科学术语(如“肝纤维化”)、缩写(如DIP, MCP)、材料属性(如“软塑料”)。

- 上下文依赖:同样的词在不同上下文中含义完全不同(如排球中的“拦网” vs. 建筑上的“砖块”)。

- 非主流成像模态:X光、热成像、航拍图、电路图等,这些数据很少出现在互联网规模的图文预训练数据中。

- 论文的核心论点:要解决这些问题,不能仅仅依靠零样本提示,而应该模拟人类标注员的学习过程——通过少量带有多模态标注说明的多模态例子来让模型与新概念进行对齐。

2. 微调策略分类与核心发现

论文在Roboflow100-VL基准上,系统性地评估了零样本、少样本、半监督和全监督设置下的模型表现。其少样本微调实验是这篇论文对您问题最直接的回应。它将现有方法分为三大类:

策略一:上下文提示(In-Context Prompting)—— 无需梯度的“微调”

这是最轻量级的方法,模型参数完全冻结,通过输入更丰富的上下文信息来提升检测效果。论文测试了三种方式:

-

视觉提示:

- 方法:仅提供少量示例图像作为提示,不提供文本类别名。这适用于类别特征难以用文字描述的场景。

- 代表模型:

MQ-GLIP-Image。 - 效果与分析:论文Table 2显示,这种方法效果很差,

MQ-GLIP-Image的10样本总mAP仅为6.4%,远低于其零样本文本提示的12.2%。这说明仅靠图像提示,模型很难精准理解需要检测的目标究竟是图像中的哪个特定实体,特别是当图像包含多个物体时。

-

多模态提示:

- 方法:同时使用“类别名”、“少量示例图像”和“标注说明”进行提示。

- 代表模型:

Qwen 2.5-VL和Gemini 2.5 Pro。 - 效果与分析:这是论文的一个重要发现——该策略效果不一致且整体有限。如Table 2所示,

Qwen 2.5-VL在使用“指令+图像”后,mAP从5.6%(仅类别名)提升至7.6%,提升微弱;而Gemini 2.5 Pro则从11.6%(仅类别名)大幅下降至8.8%。 - 失败原因分析:论文推测,这些通用多模态大模型在指令微调阶段被训练成遵循严格的提示结构,对于如何有效利用这种冗长的、非结构化的上下文信息没有很好的泛化能力。提示长度与性能甚至没有正相关性(见Table 11)。

小结:对于“分布外”的罕见概念,上下文提示这种无梯度方法目前作用非常有限,远不能替代基于梯度的微调。

策略二:联邦微调—— 针对不完备标注的SOTA方法

这是论文重点讨论和基准测试的一种微调范式,由Madan et. al.提出,专门解决少量标注样本中标注不完备的问题。

- 核心问题:在标准的交叉熵损失函数中,所有未被标注为阳性的区域都被视为“背景/负样本”。但在少样本场景下,一张图中可能只标注了少数几个类别的物体,其他未标注的物体(未知类别或同类别但漏标)会被错误地当作负样本,产生“假阴性”噪声,极大损害训练。

- 联邦损失的核心思想:

- 修改损失函数:它只将在当前图片中已被详尽标注的类别的预测框视为真正的“负样本”。对于图片中未被标注的类别,其预测框的损失会被忽略或特殊处理。

- 确定难负样本的策略:论文对原方法做了一个小改动:对于YOLO模型,不再是使用一个基于频率的先验来判断哪些是“难负样本”,而是直接根据每张图片已有的标注来确定。如果一个类别在该图中没有标注,那么它产生的任何预测都不会在负样本计算中被惩罚。

- 代表模型与效果:

Detic w/ Federated Loss:在10样本设置下总mAP达到22.8%,远超其零样本的9.5%和所有上下文提示方法。YOLOv8 w/ Federated Loss:在各个大小(n/s/m)上,都系统性地优于标准的YOLOv8微调。例如small版本从20.7%提升至23.6%(见Table 2)。

- 核心价值:这种方法非常实用,因为它真实模拟了实际应用中难以获取每个像素都完美标注的数据集的窘境,是处理不完备标注数据的强大工具。

策略三:基于梯度的全参数微调—— 仍有最强上限

这是最传统但效果最强劲的方法。

- 方法:直接在少样本数据集上对预训练模型进行全参数微调。对于VLM检测器(如GroundingDINO),就是输入“类别名”文本提示和图像,端到端地更新所有参数。

- 代表模型与效果:

GroundingDINO(SOTA方法):在10样本设置下总mAP达到惊人的33.6%,一骑绝尘。比最强的联邦微调方法(Detic的22.8%)高出超过10个百分点,比最强的通用MLLM(Gemini 2.5 Pro的9.8%)高出数倍。YOLOv8/v11系列:性能稳定在20%-23%左右。

- 核心发现与分析:

- 大规模任务特定预训练至关重要:论文明确推断,

GroundingDINO之所以微调性能远超YOLO系列,是因为它已经在“开放词汇目标检测”这一特定任务上进行了大规模预训练。这使得它的特征空间对于“定位和根据文本区分物体”这一任务来说,是一个极好的起点,学习新概念只需在此特征空间上进行微调即可。 - 对COCO的过拟合问题:一个非常反直觉的发现是,在标准数据集COCO上表现更好的

YOLOv11,在RF100-VL上与YOLOv8表现并无差异。这暗示了YOLOv11的一些架构改进可能对COCO数据分布存在过拟合,影响了其在真实、多样数据上的泛化能力。

- 大规模任务特定预训练至关重要:论文明确推断,

3. 关键结论与实际应用建议

对于你“如何在视觉语言大模型上针对目标检测任务进行微调”的关注,从这项研究中可以提炼出以下明确的路标:

-

首选方法:选择正确的基座模型进行全参数微调。

- 不要直接用通用MLLM(如Qwen、Gemini)去做检测微调。它们在检测任务上的架构(无NMS、无置信度)和预训练目标限制了其上限。

- 首选像

GroundingDINO这样的任务专用型VLM。它拥有强大的视觉-语言对齐骨干,专门为开放词汇检测设计,是当前微调的最佳起点。

-

必选技巧:数据增强和联邦损失是无价的。

- 当你只有少量(如10个样本/类)且标注不完备的数据时,必须采用联邦损失。标准损失函数在这种噪声下会严重退化。

- 这已经成为了一种标准范式,论文中CVPR 2025挑战赛的获胜团队(如FDURDILab)也大量使用了如

CachedMosaic、MixUp等强力数据增强策略,极大地提升了模型的鲁棒性。

-

拒绝玄学:多模态上下文提示目前作用有限。

- 不要指望仅仅通过写一段更详细的“标注说明”或者贴几张示例图给通用MLLM,就能让它学会检测罕见物体。实验证明,这种方式的性能不稳定、增益小甚至会退化。

- 通用的VQA推理能力不等于精确的目标定位能力。

-

高级技巧:善用伪标签和后处理。

- 伪标签:可以用微调后的模型对未标注数据进行预测,将高置信度的预测作为伪标签加入训练,扩展数据集(半监督学习STAC方法)。

- 后处理:由于通用MLLM的输出无置信度,可以为其预测的框二次计算置信度(如用SigLIP计算裁剪区域与类别文本的相似度),可以显著提升其性能(Table 12)。

- 测试时增强(TTA)和加权框融合(WBF):这些是挑战赛获胜团队的方法,能榨取最后一点性能。

总的来说,这篇论文明确指出,在视觉语言大模型上进行少量样本的目标检测微调,最有效的道路是使用一个强大的、任务专用的基座模型(如GroundingDINO),并用“联邦损失”和强力数据增强在全参数上进行微调。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)