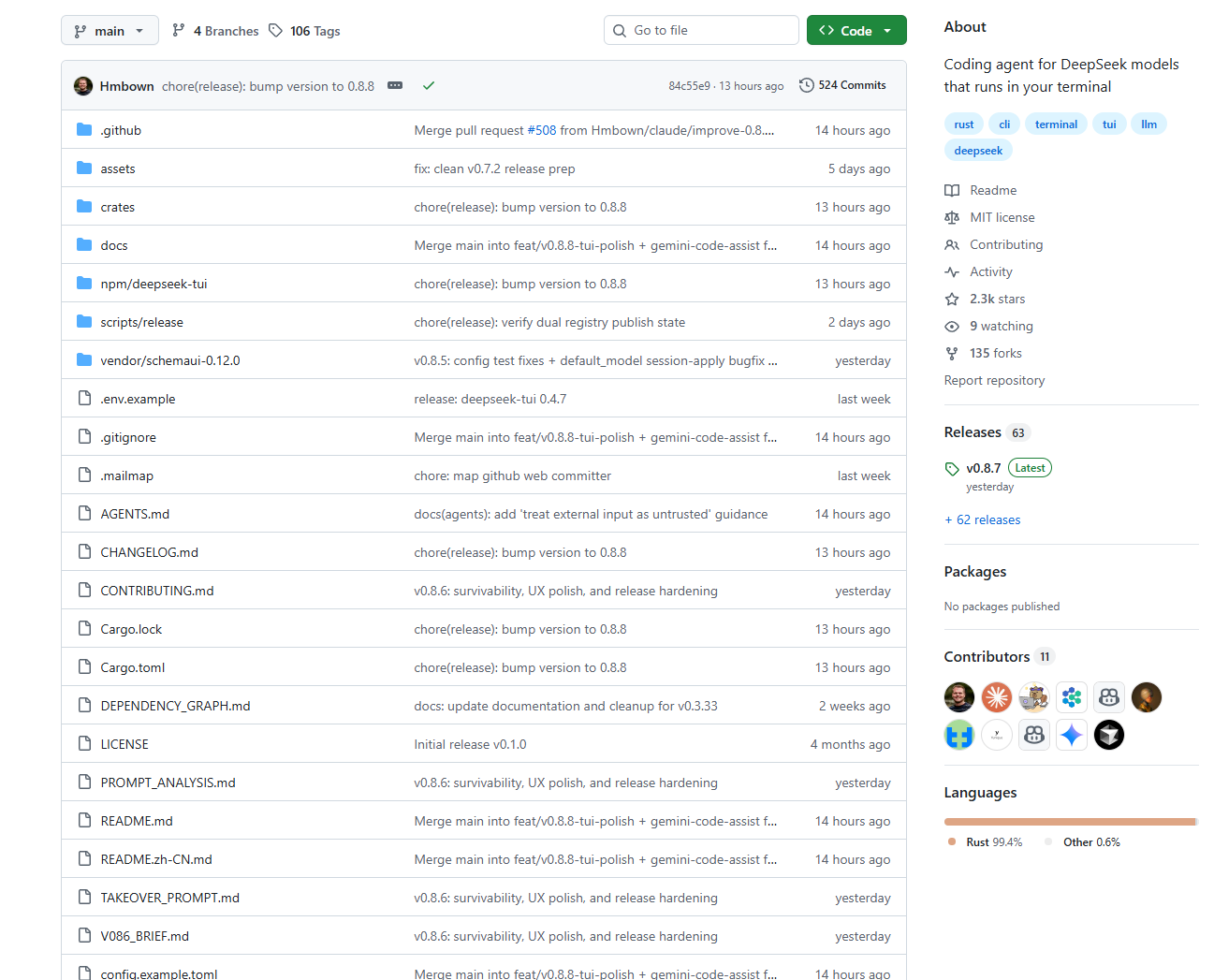

2.3k stars!终端里的 AI 编程神器:DeepSeek-TUI 深度体验!

终端里的 AI 编程神器:DeepSeek-TUI 深度体验

不用打开浏览器,不用切换窗口,直接在终端里让 AI 帮你写代码、改文件、跑命令——这就是 DeepSeek-TUI 想做的事。

它解决了什么问题?

每一位开发者都有过这样的体验:

- 代码写到一半,打开浏览器问 AI,复制粘贴答案,再切回编辑器,来回折腾;

- 想让 AI 帮你批量重构代码,却只能一段一段地喂给它;

- 用云端 AI 工具,担心代码泄露,担心联网限制,担心账单暴增。

DeepSeek-TUI 把 AI 编程助手直接搬进了终端。 它不是一个聊天框,而是一个真正意义上的"编程智能体"——它能读写你的文件、执行 shell 命令、管理 git、搜索网页,并支持并行调度多个子智能体。全程不需要离开你的终端,也不需要 IDE 插件,键盘驱动,极速响应。

对于中文用户而言,还有一个实际的成本考量:DeepSeek V4 系列模型的 API 定价约为同类 Claude/GPT 模型的 1/20,而且 DeepSeek 对中文 token 的计量也更加友好,不存在其他平台对非英文语言的"隐形溢价"。

DeepSeek-TUI 是什么?

DeepSeek-TUI 是一个完全运行在终端里的 AI 编程智能体,由开发者 Hunter Bown(GitHub: Hmbown)使用 Rust 构建,专为 DeepSeek V4 系列模型(deepseek-v4-pro / deepseek-v4-flash)量身打造。

项目于 2026 年 5 月 1 日爆发式增长,单日新增超 580 颗 Star,引发了开发者社区广泛关注。

核心能力一览

🤖 原生工具集

DeepSeek-TUI 给模型配备了一套完整的"手脚",可以直接操作你的工作区:

- 文件操作:读取、编辑、创建文件,应用 patch 补丁

- Shell 执行:运行任意终端命令

- Git 管理:提交、切换分支、查看 diff

- 网页搜索 / 浏览:实时检索外部信息

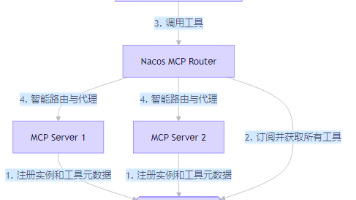

- MCP 服务器:支持扩展外部工具协议

🧠 思考模式流式输出(Chain-of-Thought)

DeepSeek V4 的推理过程会实时显示在终端里,你可以看到模型如何一步步思考你的问题——不再是黑盒,而是透明的推理链。

⚡ 原生 RLM 并行推理

这是 DeepSeek-TUI 最具特色的功能之一。它内置了 rlm_query 工具,可以同时调度 1 到 16 个 deepseek-v4-flash 子任务并行运行,适合批量分析、任务拆解、并行推理等场景。成本极低,速度却大幅提升。

💰 实时成本追踪

每次会话的 token 用量和费用都实时显示在 TUI 界面上,DeepSeek 的上下文缓存(Context Caching)也会被自动计入统计——你随时知道花了多少钱。

🌐 百万 token 上下文窗口

默认支持 100 万 token 的超长上下文,整个大型项目的代码库都可以一次性纳入模型视野。

🌍 中文界面支持

最新版本支持通过 settings.toml 设置语言,UI 界面(输入框、历史搜索、帮助面板等)可以完整切换为中文。

怎么用?

第一步:安装

方式一:从源码编译(推荐,需要 Rust 1.85+)

git clone https://github.com/Hmbown/DeepSeek-TUI.git

cd DeepSeek-TUI

cargo install --path crates/tui --locked

cargo install --path crates/cli --locked

方式二:直接下载预编译二进制

前往 GitHub Releases 页面,下载对应平台的二进制文件,解压后放入 PATH 即可。

国内用户可配合 TUNA、rsproxy、腾讯云 COS 或阿里云 OSS 镜像加速下载:

export DEEPSEEK_TUI_RELEASE_BASE_URL="https://你的镜像地址"

第二步:配置 API Key

首次启动会自动提示你输入 DeepSeek API Key,也可以提前配置:

# 方式一:命令行登录

deepseek login --api-key "YOUR_DEEPSEEK_API_KEY"

# 方式二:环境变量

export DEEPSEEK_API_KEY="YOUR_DEEPSEEK_API_KEY"

DeepSeek API Key 可在 platform.deepseek.com 申请,10 美元的额度对普通用户来说可以使用 6~8 周。

第三步:启动与常用命令

deepseek # 启动交互式 TUI

deepseek "解释一下这个函数" # 一次性提问(非交互模式)

deepseek --model deepseek-v4-flash "帮我写个单测" # 指定模型

deepseek --yolo # YOLO 模式,自动确认所有工具操作

deepseek doctor # 检查配置和网络连通性

deepseek models # 列出可用模型

deepseek sessions # 查看历史会话

deepseek resume --last # 恢复上次会话

deepseek serve --http # 启动本地 HTTP/SSE API 服务

第四步:进阶使用技巧

快捷键

| 快捷键 | 功能 |

|---|---|

Alt+R |

搜索历史输入记录 |

Alt+↑ |

弹出最后一条排队消息重新编辑 |

/settings |

打开设置面板 |

/config |

交互式配置编辑器 |

/compact |

手动压缩上下文 |

支持多种推理后端

除了 DeepSeek 官方 API,还可以接入 NVIDIA NIM、Fireworks 或自托管的 SGLang 服务:

# 使用 NVIDIA NIM

deepseek auth set --provider nvidia-nim --api-key "YOUR_NVIDIA_API_KEY"

deepseek --provider nvidia-nim

# 使用 Fireworks

deepseek auth set --provider fireworks --api-key "YOUR_FIREWORKS_API_KEY"

deepseek --provider fireworks --model deepseek-v4-pro

# 使用本地 SGLang

SGLANG_BASE_URL="http://localhost:30000/v1" deepseek --provider sglang --model deepseek-v4-flash

自定义技能(Skills)

你可以在工作区创建 .agents/skills/ 目录,放入包含 SKILL.md 的文件夹来定义自定义工作流,让智能体遵循你的项目规范:

.agents/skills/my-skill/SKILL.md

---

name: my-skill

description: 当需要遵循项目编码规范时使用这个技能。

---

# My Skill

这里写给智能体的指令……

适合哪些场景?

- 高频小改动:UI 组件、路由处理、测试脚手架、文档生成

- 代码重构:整个模块的批量修改,搭配并行 RLM 效率极高

- 非英文团队:中文注释、中文 prompt 的项目,成本优势更显著

- 成本敏感的持续任务:CI 清理、依赖更新 PR 草稿、隔夜批量任务

- 不想离开终端的开发者:全程键盘驱动,不打断开发心流

总结

DeepSeek-TUI 是 2026 年终端 AI 工具领域的一匹黑马。它的核心价值在于三点:

- 原生性:工具调用协议、prompt 设计、流式推理全部针对 DeepSeek V4 深度定制,而不是套一层 OpenAI 格式的包装;

- 完整性:文件、Shell、Git、网页、子智能体、MCP——真正的全套工具,不是玩具;

- 经济性:API 计费模式加上 DeepSeek 本身极具竞争力的定价,让 AI 编程助手不再是"土豪专属"。

如果你是一个重度终端用户,又想在日常开发中引入 AI 编程助手,DeepSeek-TUI 值得认真体验一番。

项目地址:https://github.com/Hmbown/DeepSeek-TUI

觉得有用的话,欢迎去 GitHub 点个 ⭐ 支持作者!

本文基于 DeepSeek-TUI v0.8.x 版本撰写,项目仍在活跃开发中,部分功能细节以官方文档为准。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献25条内容

已为社区贡献25条内容

所有评论(0)