2026年全球人工智能接口架构演进与 EAIInterfaceType 选型深度研究报告

2026年全球人工智能接口架构演进与 EAIInterfaceType 选型深度研究报告

在人工智能技术迈向 2026 年的关键阶段,大语言模型(LLM)的集成已从早期的实验性探索转变为企业级应用的核心底座。随着推理成本的下降与模型能力的指数级增长,开发者面临的挑战已不再仅仅是“调用哪一个模型”,而是“如何构建一个具有高度扩展性、稳定性且能适配全球多元生态的接口抽象层”。在这一背景下,EAIInterfaceType 枚举的设计不仅是对当前主流 AI 协议的分类,更是对未来“AI 原生应用”软件架构深度思考的产物。

本报告将基于 2026 年的最新技术现状,深入探讨以 OpenAI 为事实标准的兼容生态、以 Anthropic 和 Google 为代表的差异化原生协议、以 Ollama 为核心的本地化推理趋势,以及涵盖云厂商聚合与国产大模型在内的复杂边缘生态。通过对协议底层逻辑、认证机制、流式传输(SSE)及 Model Context Protocol (MCP) 的全方位分析,本研究旨在为基于 C++ 和 Qt 框架构建高性能 AI 系统的工程师提供决策支持与实现指南。

第一章 OpenAI 阵营:事实标准的确立与 Agent 导向的范式转移

在 2026 年的 AI 圈,OpenAI 的接口规范不仅是其自身产品的访问协议,更已成为全行业的通用语言。这种“事实标准”(De facto standard)的地位,源于其早期对 Chat Completions API 的定义,这一定义将复杂的神经网络推理简化为易于理解的消息列表(Messages List)和角色定义(System, User, Assistant)。

1.1 从 Chat Completions 到 Responses API 的进化

随着 AI 应用从简单的聊天机器人转向能够自主执行任务的智能体(Agents),传统的 Chat Completions API (/v1/chat/completions) 在状态管理和工具调用上的局限性日益凸显。2025 年 3 月,OpenAI 正式推出了 Responses API (/v1/responses),标志着其 API 设计理念从“无状态文本生成”转向了“有状态智能系统接口”。

这种范式转移对架构设计产生了深远影响。传统的 Chat Completions 要求开发者手动管理对话历史,每次请求都必须发送完整的历史消息数组以维持上下文,这在长对话场景下导致了极高的 Token 消耗和客户端逻辑复杂度。而 Responses API 引入了 previous_response_id 和服务器端状态管理(通过 store: true 参数),使得模型能够直接引用历史响应,减少了 40% 至 80% 的缓存冗余,并显著提升了推理性能。

| 维度 | Chat Completions (传统) | Responses API (现代/Agent 导向) |

|---|---|---|

| 主要目标 | 无状态文本生成与简单对话 | 复杂的 Agent 工作流与多步推理 |

| 状态管理 | 客户端完全手动管理消息数组 | 选配服务器端状态(store/previous_id) |

| 工具调用逻辑 | 外部编排,需多次往返 | 内建工具集成(搜索、代码解释、MCP) |

| 性能表现 | GPT-5 下性能中规中矩 | 推理模型性能提升约 3%,缓存利用率大幅提高 |

| 输出结构 | 嵌套在 choices 数组中 | 直接通过 output 类型项返回 |

1.2 兼容生态的扩张:DeepSeek, Groq 与 vLLM

OpenAI 接口的强大之处在于其衍生的兼容性生态。目前市场上绝大多数的新兴推理服务商,如 DeepSeek、智谱 AI、零一万物,以及高性能硬件加速平台 Groq 和 Together AI,均原生支持 OpenAI 的 API 格式。对于 C++ 开发者而言,这意味着通过支持 EAIInterfaceTypeOpenAI,只需更改 base_url 和 api_key,即可无缝切换数十个全球顶尖的模型后端,极大地降低了供应商锁定的风险。

这种兼容性不仅限于云端。在企业私有化部署场景中,使用 vLLM 或 llama.cpp 等开源后端部署的模型,通常也会暴露一个 OpenAI 兼容的 REST 端点。这种协议的一致性使得在 Qt 框架下编写的 QNetworkAccessManager 逻辑可以在本地开发环境与生产云端环境之间“零成本”迁移。

第二章 Claude 与 Anthropic:独立演进的推理高地

尽管 OpenAI 统治了市场份额,但 Anthropic 的 Claude 模型系列在 2026 年凭借其在代码编写(Claude Code)、长文本处理(1M+ 上下文)及逻辑缜密性上的卓越表现,成为了唯一能与之抗衡的云端模型阵营。与 OpenAI 不同,Anthropic 坚持使用其原生的 Messages API,并在协议设计上展现了独特的哲学。

2.1 Messages API 的设计哲学:XML 标签与受限解码

Claude 的接口在处理结构化输入输出时更倾向于使用 XML 标签而非纯 JSON 提示。研究表明,Claude 模型对 XML 的解析能力极强,能够精准区分指令、上下文和数据段落。在 Messages API 中,Anthropic 引入了“受限解码”(Constrained Decoding)技术,通过在推理过程中动态限制 Token 生成概率,确保输出严格符合预定义的 JSON Schema,从而实现了“数学意义上的输出确定性”。

2.2 核心竞争力:扩展思考与长上下文管理

Claude 3.7 及 4.x 版本引入了“扩展思考”(Extended Thinking)模式。在 Messages API 的响应中,模型会返回一个专门的 thinking 块,展示其内部推理过程,这对于调试复杂任务和增强用户信任至关重要。此外,Anthropic 的价格策略在 2026 年极具竞争力,特别是在 Claude 3.5/4.5 Sonnet 等层级,其输入成本通常比 GPT-5 同级模型低 40%-60%。

| 模型特性 | OpenAI GPT-5 系列 | Anthropic Claude 4 系列 |

|---|---|---|

| API 格式 | Responses / Chat Completions | Messages API (Stateless) |

| 上下文窗口 | 标准 128K/400K,最高支持 1M | 标准 200K,最高支持 1M+ |

| 特色功能 | 强大的多模态原生集成、DALL-E | 扩展思考块、内建提示词缓存、Claude Code |

| 代码能力 | 自动化云端沙箱 (Codex) | 本地化 Agent (Claude Code) |

| 主要优势 | 生态成熟、多模态丰富 | 逻辑严密、成本效率高、长文本一致性 |

第三章 Google Gemini:多模态原生架构与企业级安全

Google 的 Gemini 代表了多模态能力的最高峰。作为唯一能提供从音频、视频到文本全链路原生处理的模型,Gemini 的 API 架构(基于 Google Cloud / Vertex AI)与 OpenAI 和 Anthropic 均不兼容,必须独立封装在 EAIInterfaceTypeGoogle 之中。

3.1 独具特色的安全与内容过滤机制

Gemini API 提供了一套极其精细的安全设置,允许开发者针对四个维度(骚扰、仇恨言论、性显露、危险内容)调整过滤阈值。这与 OpenAI 较为黑盒的 Moderation API 形成鲜明对比。

| 安全过滤层级 (Threshold) | 过滤效果说明 | 典型应用场景 |

|---|---|---|

| OFF | 彻底关闭过滤器 | 纯创意写作、无限制测试 |

| BLOCK_NONE | 无论概率高低均显示内容 | 对模型控制力要求极高的场景 |

| BLOCK_ONLY_HIGH | 仅阻断极高概率的违规内容 | 大多数通用应用 |

| BLOCK_MEDIUM_AND_ABOVE | 阻断中高概率违规 | 面向未成年的教育类应用 |

| BLOCK_LOW_AND_ABOVE | 最严格过滤,阻断所有疑似违规 | 极其严肃的企业合规环境 |

3.2 Vertex AI 体系下的多模态集成

在技术实现上,Gemini 能够直接在单次请求中处理长达数小时的视频数据或数千行的源代码,其“思考图像”(Thinking with Images)功能允许模型动态缩放并观察图像中的微小细节。这种能力在 C++ 客户端中需要特殊的流式处理支持,因为多模态响应往往包含大量的多媒体元数据。

第四章 Ollama:本地化、开源与隐私的避风港

将 EAIInterfaceTypeOllama 独立列出是 2026 年 AI 软件架构设计中最具前瞻性的决定之一。随着隐私保护意识的增强和边缘计算硬件(如 Apple Silicon M4, NVIDIA RTX 50 系列)的普及,本地运行 LLM 已成为开发者的刚需。

4.1 本地部署的技术优势:隐私、成本与确定性

Ollama 作为本地运行 Llama 3、Qwen、Mistral 等开源模型的最流行工具,其 API 虽然部分兼容 OpenAI,但其核心优势在于管理本地模型生命周期的专用端点。

- 数据主权:所有 Prompt 和模型权重均在本地处理,数据永不出网,这对于医疗(HIPAA)和金融(GDPR)等严监管行业具有不可替代的价值。

- 成本预测性:一旦硬件采购完成,推理成本仅限于电力消耗。在持续重负载(如自动化测试、批量文档索引)场景下,Ollama 的成本效率比云端高出 2-15 倍。

- 低延迟交互:消除网络延迟后,Time to First Token (TTFT) 可降至毫秒级,为实现实时的 UI 反馈(如输入自动补全)提供了基础。

4.2 Ollama 独有的管理能力

在 C++ 实现中,调用 EAIInterfaceTypeOllama 通常涉及对本地服务的动态控制。例如,通过 POST /api/pull 触发模型下载,或通过 POST /api/create 使用自定义 Modelfile 构建特定领域的模型实例。这种对模型运行时的细粒度控制是云端 API 无法提供的。

第五章 Others 阵营:云厂商聚合与国产接口适配

EAIInterfaceTypeOthers 并非简单的“备用”,而是涵盖了复杂的云端分发渠道和特定区域的特殊协议。这包括了 AWS Bedrock、Azure OpenAI 以及以百度文心一言为代表的国产模型生态。

5.1 云厂商聚合器:AWS Bedrock 与 Azure

对于大型企业而言,直接调用 OpenAI 或 Anthropic 的 API 可能会面临合规和账单管理的难题。AWS Bedrock 提供了一个统一的网关,允许开发者通过单一的 AWS 认证机制访问 Claude、Llama、Titan 等多种模型。

- Azure OpenAI:虽然其模型内核与 OpenAI 相同,但认证方式采用 API Key 或 Microsoft Entra ID(Bearer Token),且 Endpoint URL 的构造方式完全不同(涉及 Resource Name 和 Deployment Name)。

- AWS Bedrock:其最大的特色在于集成了“Bedrock Agents”和“Knowledge Bases”(RAG),允许模型直接调用 S3 存储桶中的企业私有数据,并利用 Lambda 函数执行业务逻辑。

5.2 国产模型生态:百度文心一言(Qianfan)

在 2026 年的中国市场,百度千帆(Qianfan)平台已成为企业首选。其 Ernie 4.5 系列模型在中文语境下的理解深度和 STEM 问题的解决能力上具有本土化优势。尽管百度的 API 正向 OpenAI 兼容性靠拢,但其早期的 Access Key / Secret Key 交换 Token 机制、独特的 MoE 架构路由参数以及特定的安全过滤头(X-DashScope-*)依然需要独立的封装逻辑。

第六章 Model Context Protocol (MCP):通往统一接口的终极桥梁

在讨论 EAIInterfaceType 的未来演进时,不得不提及 2024 年底由 Anthropic 提出并迅速被 OpenAI 和 Google 采纳的 Model Context Protocol (MCP)。

6.1 MCP 的核心理念:AI 的“USB-C”接口

MCP 旨在解决“N×M”的集成难题——即 N 个 AI 模型需要连接到 M 个数据源。在 MCP 框架下,模型不再需要为每一个数据库或 SaaS 平台编写特定的 API 调用代码。开发者只需构建一个标准的 MCP Server,任何支持 MCP 的 Host(如 Claude Desktop, ChatGPT, 甚至我们的 C++/Qt 客户端)都能立即获取这些工具和数据。

6.2 架构组成与消息流

| 组件 | 角色定位 | 2026 年的技术演进 |

|---|---|---|

| Host (宿主) | 运行 AI 交互的主程序 | 已集成在主流 IDE (Cursor, VS Code) 和企业机器人中 |

| MCP Client | 负责与 Server 通信的库 | 提供 C++20/Qt 6 原生实现 (如 Llmqore 库) |

| MCP Server | 暴露工具 (Tools) 和资源 (Resources) | 支持 stdio 本地进程通信或 HTTP/SSE 远程通信 |

在 C++ 实现中,MCP 利用 JSON-RPC 2.0 进行消息传递。对于开发者而言,这意味着 EAIInterfaceType 的未来扩展可能不再是增加更多的厂商类型,而是增加对“远程 MCP 节点”的支持,实现工具的即插即用。

第七章 C++/Qt 下的 AI 接口开发实务

将上述多元接口集成到一个基于 Qt 的桌面或嵌入式应用中,需要严谨的软件设计模式。

7.1 工厂模式 (Factory Pattern) 的应用

为了解耦 UI 逻辑与底层的 API 细节,推荐使用静态工厂方法创建 AI 客户端实例。通过 EAIInterfaceType 这一枚举,工厂可以根据配置动态注入不同的网络处理策略。

// 典型的 AI 客户端抽象层结构

class BaseAIClient : public QObject {

Q_OBJECT

public:

virtual void sendPrompt(const QString &prompt) = 0;

signals:

void tokenReceived(const QString &token);

void finished(const QString &fullText);

void errorOccurred(int errorCode, const QString &errorMsg);

};

7.2 流式解析 (SSE) 的技术难点

流式传输是 AI 交互的核心体验。Server-Sent Events (SSE) 协议虽然简单,但在 Qt 的 QNetworkAccessManager 环境下有几个关键坑点:

- 分块读取:必须连接 readyRead() 信号,通过 readAll() 读取部分缓冲区,而不是等待 finished()。

- SSE 格式化:AI 厂商返回的通常是 data: {“delta”: {“content”: “…”}} 这种格式,需要正则或 JSON 解析器提取有效 Token,并处理 `` 结束标志。

- 心跳与重连:AI 推理有时会长时间停顿。客户端需检测 TCP 连接的“半开”状态,利用 Last-Event-ID 进行断线重连。

7.3 Token 计数与性能监控

在 C++ 中,为了精确估算成本和管理上下文窗口,必须集成 Tiktoken 或类似的 BPE 分词器。

然而,在处理中文或代码时,这一比例会发生剧烈波动。使用高效的 C++ Header-only 库(如 tiktoken.cpp)可以在不引入重型依赖的情况下实现微秒级的 Token 计数,这对于实施客户端频率限制(Rate Limiting)至关重要。

第八章 性能、安全与成本:2026 年的运维准则

在 AI 应用步入大规模生产环境后,运维(AIOps)的重要性超过了模型选择本身。

8.1 频率限制 (Rate Limiting) 与重试策略

主流 API 厂商在 2026 年均实施了严厉的 RPM(每分钟请求数)和 TPM(每分钟 Token 数)限制。

| 限制类型 | 监控指标 | 处理策略 |

|---|---|---|

| RPM 限制 | API 调用频次 | 客户端队列缓冲、令牌桶算法 (Token Bucket) |

| TPM 限制 | 累计 Token 消耗量 | 优先级调度、高成本任务异步化 |

| 429 错误 | 服务器拒绝响应 | 指数退避 (Exponential Backoff) + 抖动 (Jitter) |

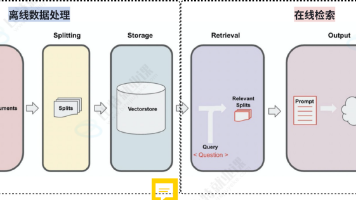

8.2 语义缓存 (Semantic Caching) 的应用

为了降低成本并提升 TTFT(首个 Token 延迟),成熟的 C++ AI 框架通常会集成 Redis 或本地 SQLite 向量数据库,对用户的问题进行语义相似度检测。如果新问题与缓存中的问题高度吻合,则直接返回缓存结果,跳过昂贵的 API 调用。

第九章 结论:构建具备“未来兼容性”的 AI 架构

EAIInterfaceType 枚举的设计不仅是对现有技术的总结,更是对未来趋势的押注。在 2026 年,一个卓越的 AI 系统架构应该具备以下特质:

- 协议中立性:通过封装 OpenAI、Claude、Gemini 的差异,让业务逻辑专注于 Prompt Engineering 而非 API 细节。

- 本地-云端协同:利用 Ollama 处理敏感或简单的任务,利用 Frontier Models 处理复杂的推理,实现成本与能力的动态平衡。

- Agent 化支持:从 Chat Completions 转向支持状态管理的 Responses API,并为未来的 MCP 协议留出扩展接口。

- 极度稳健性:面对 429 错误和网络抖动,具备完善的重试、降级和自动 fallback 机制。

在这个 AI 技术日新月异的时代,接口的统一与抽象将成为软件资产中最具价值的部分。通过深入理解每一类 EAIInterfaceType 背后的技术生态与商业逻辑,开发者将能够构建出真正跨越时代、引领未来的智能应用。

引用的著作

- OpenAI API vs Anthropic API: Developer and Cost Comparison | SFAI Labs, 访问时间为 五月 2, 2026, https://sfailabs.com/guides/openai-api-vs-anthropic-api

- OpenAI Responses API vs. Chat Completions vs. Anthropic Messages API - Portkey, 访问时间为 五月 2, 2026, https://portkey.ai/blog/open-ai-responses-api-vs-chat-completions-vs-anthropic-anthropic-messages-api/

- Llmqore: Qt/C++ LLM Library for AI Integration & MCP, 访问时间为 五月 2, 2026, https://mcpmarket.com/server/llmqore

- LLMCore 0.1.0 — A Qt/C++ library for integrating LLM into desktop applications - Reddit, 访问时间为 五月 2, 2026, https://www.reddit.com/r/QtFramework/comments/1ruvyxz/llmcore_010_a_qtc_library_for_integrating_llm/

- Model Context Protocol - Wikipedia, 访问时间为 五月 2, 2026, https://en.wikipedia.org/wiki/Model_Context_Protocol

- Sneak Peek: Exploring the Qt AI Inference API (Proof-of-Concept), 访问时间为 五月 2, 2026, https://www.qt.io/software-insights/sneak-peek-exploring-the-qt-ai-inference-api-proof-of-concept

- Chat Completions vs OpenAI Responses API: What Actually Changed - DEV Community, 访问时间为 五月 2, 2026, https://dev.to/dev-in-progress/chat-completions-vs-openai-responses-api-what-actually-changed-4bco

- Migrate to the Responses API - OpenAI Developers, 访问时间为 五月 2, 2026, https://developers.openai.com/api/docs/guides/migrate-to-responses

- OpenAI Chat Completions API vs Responses API: What Developers Need to Know - Medium, 访问时间为 五月 2, 2026, https://medium.com/@JoeSanPietro/openai-chat-completions-api-vs-responses-api-what-developers-need-to-know-be3e203b1906

- openai-responses-vs-chat-completions - HackMD, 访问时间为 五月 2, 2026, https://hackmd.io/@ll-24-25/r1L5KzNyxx

- Ultimate Guide – The Best API Providers of Open Source LLM of 2026 - SiliconFlow, 访问时间为 五月 2, 2026, https://www.siliconflow.com/articles/en/The-best-API-providers-of-Open-Source-LLM

- docs/testing: add a third-party provider capability validation guide, with Qianfan as an initial example #2926 - GitHub, 访问时间为 五月 2, 2026, https://github.com/openai/openai-agents-python/issues/2926

- OpenAI Compatibility for Ollama - KodeKloud, 访问时间为 五月 2, 2026, https://notes.kodekloud.com/docs/Running-Local-LLMs-With-Ollama/Building-AI-Applications/OpenAI-Compatibility-for-Ollama/page

- Qianfan - OpenClaw Docs, 访问时间为 五月 2, 2026, https://docs.openclaw.ai/providers/qianfan

- OpenAI ApI standards & onprem model options - Beginners - Hugging Face Forums, 访问时间为 五月 2, 2026, https://discuss.huggingface.co/t/openai-api-standards-onprem-model-options/146593

- Anthropic vs OpenAI: Developer Experience Compared, 访问时间为 五月 2, 2026, https://www.developersdigest.tech/blog/anthropic-vs-openai-developer-experience

- Anthropic vs. OpenAI: The Two AI Giants Compared - DataCamp, 访问时间为 五月 2, 2026, https://www.datacamp.com/blog/anthropic-vs-openai

- OpenAI API vs Anthropic API (2026): GPT or Claude for Your App? - MG Software, 访问时间为 五月 2, 2026, https://www.mgsoftware.nl/en/vergelijking/openai-api-vs-anthropic-api

- Using the Messages API - Claude Console, 访问时间为 五月 2, 2026, https://platform.claude.com/docs/en/build-with-claude/working-with-messages

- Structured outputs - Claude API Docs, 访问时间为 五月 2, 2026, https://platform.claude.com/docs/en/build-with-claude/structured-outputs

- Claude API Structured Output: Complete Guide to Schema-Guaranteed Responses, 访问时间为 五月 2, 2026, https://thomas-wiegold.com/blog/claude-api-structured-output/

- Anthropic Claude Messages API - Amazon Bedrock - AWS Documentation, 访问时间为 五月 2, 2026, https://docs.aws.amazon.com/bedrock/latest/userguide/model-parameters-anthropic-claude-messages.html

- The Ultimate Guide to LLM Token Counters: Your Key to Unlocking AI Efficiency and Cost Control - Skywork, 访问时间为 五月 2, 2026, https://skywork.ai/skypage/en/The-Ultimate-Guide-to-LLM-Token-Counters:-Your-Key-to-Unlocking-AI-Efficiency-and-Cost-Control/1975590557433524224

- Detailed Guide to Gemini API Safety Settings: Correct Understanding and Usage of the BLOCK_NONE Parameter - Apiyi.com Blog, 访问时间为 五月 2, 2026, https://help.apiyi.com/en/gemini-api-safety-settings-block-none-guide-en.html

- Safety and content filters | Generative AI on Vertex AI - Google Cloud Documentation, 访问时间为 五月 2, 2026, https://docs.cloud.google.com/vertex-ai/generative-ai/docs/multimodal/configure-safety-filters

- Safety settings | Gemini API | Google AI for Developers, 访问时间为 五月 2, 2026, https://ai.google.dev/gemini-api/docs/safety-settings

- Baidu just dropped an open-source multimodal AI that it claims beats GPT-5 and Gemini, 访问时间为 五月 2, 2026, https://venturebeat.com/ai/baidu-just-dropped-an-open-source-multimodal-ai-that-it-claims-beats-gpt-5

- Qianfan-OCR-Fast (free) - API Pricing & Providers - OpenRouter, 访问时间为 五月 2, 2026, https://openrouter.ai/baidu/qianfan-ocr-fast:free

- Ollama vs OpenAI | Local AI Software & Expert Consulting - Moltech Solution, 访问时间为 五月 2, 2026, https://www.mol-tech.us/blog/ollama-vs-openai-local-ai-solutions

- OpenAI compatibility - Ollama’s documentation, 访问时间为 五月 2, 2026, https://docs.ollama.com/api/openai-compatibility

- Streaming LLM Responses: Make Your AI App Feel Fast - Redis, 访问时间为 五月 2, 2026, https://redis.io/blog/streaming-llm-responses/

- Azure OpenAI frequently asked questions | Microsoft Learn, 访问时间为 五月 2, 2026, https://learn.microsoft.com/en-us/azure/foundry-classic/openai/faq

- How Does AWS Bedrock Differ From Other Generative AI in 2026 - Qualix Solutions, 访问时间为 五月 2, 2026, https://qualixsolutions.com/blog/how-does-aws-bedrock-differ-from-other-generative-ai/

- Ernie Bot AI: (What It Is, Features, Usecases, Price, Alternatives, How To Access) - AI Mode, 访问时间为 五月 2, 2026, https://aimode.co/app/ernie-bot/

- Diving Deep into AWS Bedrock: A Developer’s Honest Take on the Future of LLMs, 访问时间为 五月 2, 2026, https://aws.plainenglish.io/diving-deep-into-aws-bedrock-a-developers-honest-take-on-the-future-of-llms-e9fb70dfd852

- Azure OpenAI in Microsoft Foundry Models REST API reference, 访问时间为 五月 2, 2026, https://learn.microsoft.com/en-us/azure/foundry/openai/reference

- How to switch between OpenAI and Azure OpenAI endpoints with Python - Microsoft Learn, 访问时间为 五月 2, 2026, https://learn.microsoft.com/en-us/azure/foundry-classic/openai/how-to/switching-endpoints

- The State of AI Agent Frameworks: Comparing LangGraph, OpenAI Agent SDK, Google ADK, and AWS Bedrock Agents | by Roberto Infante | Medium, 访问时间为 五月 2, 2026, https://medium.com/@roberto.g.infante/the-state-of-ai-agent-frameworks-comparing-langgraph-openai-agent-sdk-google-adk-and-aws-d3e52a497720

- Feature Request: Integration of Alibaba Cloud Model Studio for running the AI models · Issue #265 · sipeed/picoclaw - GitHub, 访问时间为 五月 2, 2026, https://github.com/sipeed/picoclaw/issues/265

- Qianfan - LlamaIndex, 访问时间为 五月 2, 2026, https://developers.llamaindex.ai/python/framework-api-reference/llms/qianfan/

- What is the Model Context Protocol (MCP)?, 访问时间为 五月 2, 2026, https://modelcontextprotocol.io/docs/getting-started/intro

- What is MCP? The AI Protocol Changing Everything (2026), 访问时间为 五月 2, 2026, https://www.youtube.com/watch?v=wZn9XvXBnU4

- I Tried 20+ MCP (Model Context Protocol) Courses on Udemy: Here are My Top 5 Recommendations for…, 访问时间为 五月 2, 2026, https://medium.com/javarevisited/i-tried-20-mcp-model-context-protocol-courses-on-udemy-here-are-my-top-5-recommendations-for-921440120326

- Gopher MCP: Running High-Performance AI Tooling in C++ Without the Usual Trade-offs, 访问时间为 五月 2, 2026, https://medium.com/towardsdev/gopher-mcp-running-high-performance-ai-tooling-in-c-without-the-usual-trade-offs-52974bb406dc

- Client Best Practices - Model Context Protocol, 访问时间为 五月 2, 2026, https://modelcontextprotocol.io/docs/develop/clients/client-best-practices

- Stop Writing `if-elif` Hell: Use a Factory Pattern for Your LLM Clients | by Ajeet Verma, 访问时间为 五月 2, 2026, https://ai.plainenglish.io/stop-writing-if-elif-hell-use-a-factory-pattern-for-your-llm-clients-9a4d17118fb1

- Design Patterns in C++/Qt – Factory Method Pattern (Structure 1) with Real Qt Example, 访问时间为 五月 2, 2026, https://www.youtube.com/watch?v=S9NHmkZE4q8

- Server Sent Events (SSE) with Qt - Stack Overflow, 访问时间为 五月 2, 2026, https://stackoverflow.com/questions/54170742/server-sent-events-sse-with-qt

- Server-Sent Events: A Comprehensive Guide | by Mohamed-Ali | Medium, 访问时间为 五月 2, 2026, https://medium.com/@moali314/server-sent-events-a-comprehensive-guide-e4b15d147576

- Streaming AI Responses in Real-Time | by Thinking Loop - Medium, 访问时间为 五月 2, 2026, https://medium.com/@ThinkingLoop/streaming-ai-responses-in-real-time-bcebf0d9f026

- Tiktoken 3.1.4 - NuGet, 访问时间为 五月 2, 2026, https://www.nuget.org/packages/Tiktoken

- KolosalAI/tiktoken.cpp: Simple tiktoken implementation in C++ - GitHub, 访问时间为 五月 2, 2026, https://github.com/KolosalAI/tiktoken.cpp

- kactlabs/toksum: One Stop Token Counter for All Models - GitHub, 访问时间为 五月 2, 2026, https://github.com/kactlabs/toksum

- Implementing Rate Limiting for AI APIs | by Jane Frances | Apr, 2026 | MasteringBackend, 访问时间为 五月 2, 2026, https://publication.masteringbackend.com/implementing-rate-limiting-for-ai-apis-887e9e287e84

- API Rate Limiting Best Practices (2026): Implementation Guide for Developers, 访问时间为 五月 2, 2026, https://www.getknit.dev/blog/10-best-practices-for-api-rate-limiting-and-throttling

- OpenAI rate limits in 2026: A practical handling guide - eesel AI, 访问时间为 五月 2, 2026, https://www.eesel.ai/blog/openai-rate-limits

- API Rate Limits Explained: Best Practices for 2026 - Orq.ai, 访问时间为 五月 2, 2026, https://orq.ai/blog/api-rate-limit

- Best Practices for API Error Handling: A Comprehensive Guide - Microsoft Community Hub, 访问时间为 五月 2, 2026, https://techcommunity.microsoft.com/discussions/appsonazure/best-practices-for-api-error-handling-a-comprehensive-guide/4088121

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)