SAM3遇上四农普:遥感AI分割的实战全解析

2026年,第四次全国农业普查正式启动。

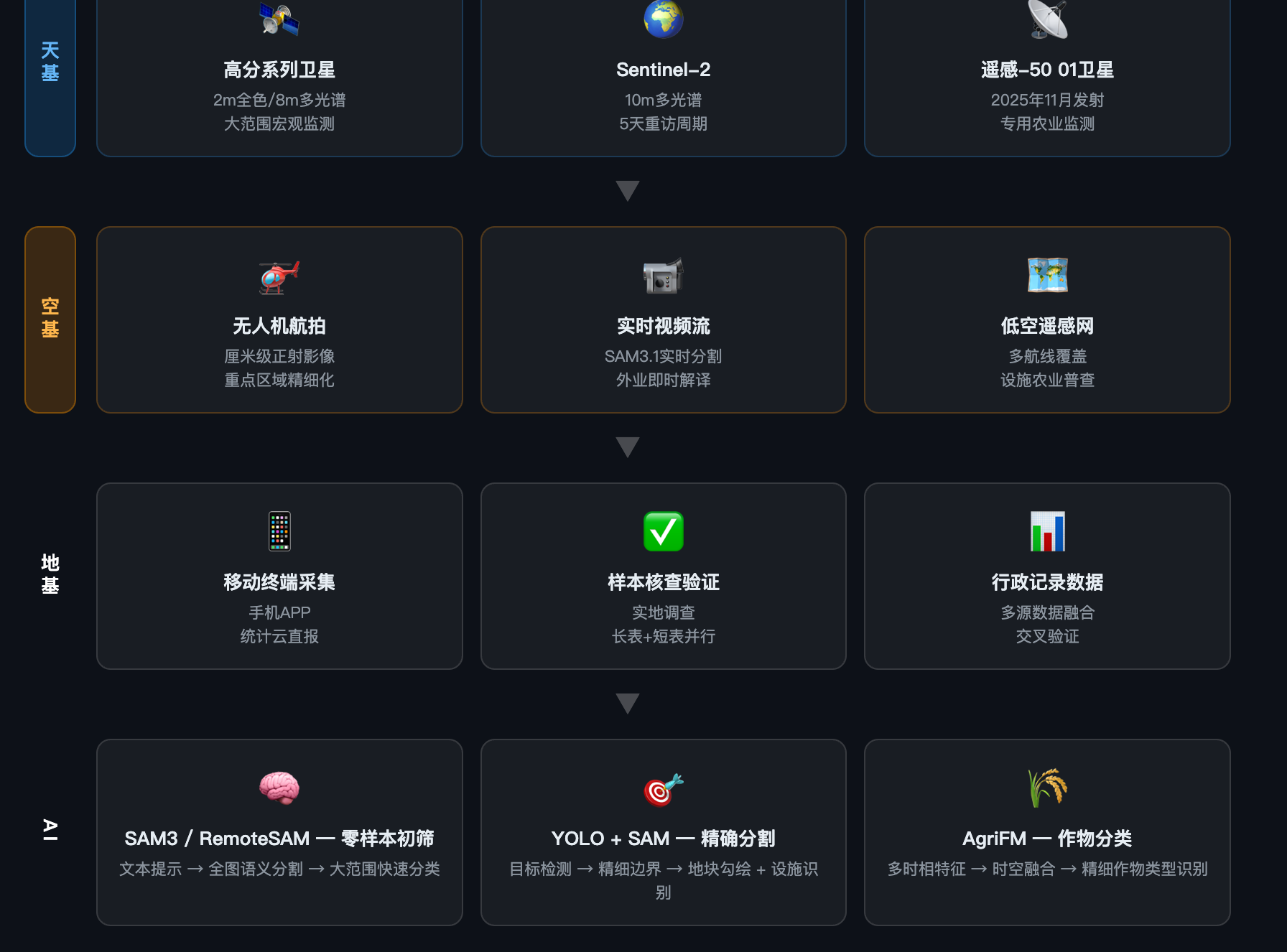

与十年前的第三次农普相比,这次普查有一个根本性的技术跃迁——遥感+AI从"试点探索"变成了"核心手段"。国务院明确要求构建"天空地"一体化智能观测体系,卫星遥感负责大范围宏观监测,无人机负责重点区域精细化测量,地面移动终端负责样本核查验证,而AI解译中枢负责将海量影像自动转化为可用的普查数据。

问题来了:用什么AI模型来做遥感解译?

传统的做法是针对每个任务(作物分类、地块提取、变化检测)分别标注数据、训练专用模型。这套方法成熟,但代价也很明显——标注成本高、周期长、换个区域就得重新来过。

2025年11月,Meta发布了SAM3(Segment Anything Model 3)。这个模型带来了一项关键能力:你只需要输入一段文字描述,它就能自动识别并分割图像中所有符合描述的对象。输入"farmland",它给你圈出所有农田;输入"greenhouse",它给你标出所有温室大棚。零样本,无需训练。

这个能力,恰好踩中了第四次农普遥感解译的核心痛点。

今天这篇文章,我们就来拆解SAM3在农业普查中的六大应用场景,看看它到底能做到什么程度,以及与其他AI方法相比,它适合做什么、不适合做什么。

一、SAM3核心突破:从"被动辅助"到"主动理解"

先快速过一下SAM三代模型的演进,理解SAM3到底新在哪。

| 维度 | SAM (2023.4) | SAM 2 (2024.8) | SAM 3 (2025.11) |

|---|---|---|---|

| 核心任务 | 可提示图像分割 | 可提示视频分割 | 可提示概念分割 |

| 输入方式 | 点、框 | 点、框、视频帧 | 文本+视觉示例+点/框 |

| 输出能力 | 单个mask | 单个mask+时序追踪 | 全图所有匹配实例同时分割 |

| 文本支持 | 无 | 无 | 原生支持自然语言 |

SAM3最大的突破是PCS(Promptable Concept Segmentation,可提示概念分割)。简单说,以前你用SAM,得在图上点一下或画个框,它才帮你分割那个区域。SAM3不需要了,你直接告诉它"我要找什么",它就给你全部找出来。

2026年3月发布的SAM3.1更进一步,引入Object Multiplexing架构,追踪128个对象时推理速度提升7倍,且无精度损失。

这意味着什么?SAM3从"你指我割"的被动工具,变成了"你说我找"的主动语义理解系统。

对遥感场景来说,这个变化意义巨大。遥感影像动辄几百MB,目标地物成千上万,如果还需要人工逐个标注提示,效率优势就不存在了。文本提示让SAM3真正具备了"批处理"遥感影像的能力。

二、农普六大遥感解译场景 × SAM3能力分析

第四次农普的遥感解译需求主要集中在六个场景。我们逐个来看SAM3的表现。

场景一:农作物播种面积测量

需求:准确提取各类农作物的种植面积,这是农普最核心的数据。

SAM3能做什么:输入文本提示如"cropland"或"rice paddy",SAM3可以零样本分割出农田区域。对于大面积、边界清晰的农田,效果已经相当不错。

研究支撑:2025年发表在MDPI Agronomy上的论文提出了一种多源遥感+改进SAM的农田提取方法,融合GF-2高分辨率影像和Sentinel-2多光谱数据,显著提升了SAM在农田提取上的精度。

短板:零样本精度不足以满足普查的严格要求。大面积农田OK,但零散地块、混合种植区域容易漏检或错分。实际应用中需要结合多时相数据和少量标注样本微调。

场景二:农田地块边界提取

需求:精确勾绘每个地块的边界,这是面积计算的基础。

SAM3能做什么:这是SAM系列的传统强项——边界分割精度高。已有多个专门针对农田边界的改进方案:

- fabSAM(arXiv:2501.12487,2025.01):专门针对农田边界勾绘设计的SAM框架

- Boundary SAM(IEEE GRSL,2025):加入细节增强滤波器,支持文本提示,提升了细碎地块边界的提取精度

- YOLOSc-SAM(Smart Agricultural Engineering,2026):先用YOLO检测农田区域,再用SAM精细分割边界,在1m无人机影像和2m卫星影像上都验证了效果

关键洞察:SAM3的边界稳定性比YOLO高出12倍——这是2025年12月arXiv上一篇对比论文的实证结论。当IoU阈值变化时,SAM3的性能波动仅4个百分点,而YOLO波动达48-50个百分点。这个特性使SAM3特别适合需要精确面积计算的农普场景。

场景三:作物类型分类

需求:区分水稻、小麦、玉米、大豆等不同作物类型。

SAM3能做什么:SAM3的文本提示理论上可以输入"rice"、"wheat"等作物名称来分类,但实际上作物类型的光谱特征差异远比人眼看到的复杂。不同作物在特定生育期可能光谱特征极其相似。

现状:2023年NeurIPS AI4Ag Workshop上的一篇评估论文指出,SAM零样本可以识别作物但精度有限,需要领域微调才能达到实用水平。2025年ISPRS Annals上有研究用SAM做水稻秧苗检测,配合多时相数据取得了不错的效果。

实用建议:纯靠SAM3做作物分类不够,但SAM3可以作为一个高效的"初筛"工具——先快速把农田区域和非农田区域分开,再用专业时序模型(如AgriFM)做精细分类。

场景四:设施农业识别

需求:识别温室大棚、畜禽养殖场等设施农业目标。

SAM3能做什么:温室大棚在遥感影像上特征明显(规则的矩形、高反射率),SAM3的文本提示"greenhouse"或"building"可以零样本检出大部分目标。畜禽养殖场相对复杂,但配合无人机低空影像,SAM3也能有效识别。

优势:设施农业目标相对标准化、特征稳定,是SAM3零样本能力最能发挥的场景之一。

场景五:耕地变化检测

需求:对比不同时期的影像,发现新增或减少的耕地。

SAM3能做什么:SAM3的边界稳定性在这里成为杀手锏。变化检测的核心难题不是"发现了变化",而是"区分真实变化和分割误差"。YOLO在IoU阈值选择不同时,性能波动高达30%,这意味着很多"检测到的变化"其实是分割不稳定造成的假阳性。

SAM3仅4个百分点的IoU波动,意味着它产生的边界变化更加可靠,可以大幅减少变化检测中的假阳性。两期影像分别用SAM3分割后做差值对比,结果的可信度远高于YOLO方案。

场景六:数据质量自动检查

需求:对调查员采集的数据进行空间合理性检查。

SAM3能做什么:用SAM3重新分割影像,与人工标注结果对比,自动发现逻辑不一致的区域——比如标注为"耕地"的区域SAM3判定为"建设用地",或者地块边界偏差过大。这种"AI质检"模式可以大幅减少人工复核的工作量。

三、技术横评:SAM3不是万能的

看完六个场景,你可能会觉得SAM3无所不能。但事实并非如此。我们来看几组关键对比数据。

SAM3 vs YOLO:各有所长

根据arXiv:2512.11884的实证研究:

| 指标 | SAM3(零样本) | YOLO11(微调) |

|---|---|---|

| F1分数 | 59.8% | 68.9%-72.2% |

| 边界稳定性 | IoU波动仅4个百分点 | IoU波动48-50个百分点 |

| 部署门槛 | 无需标注数据 | 需大量标注+微调 |

| 适应性 | 通用,可切换任务 | 专用,换任务需重训 |

结论:YOLO检测更全,SAM3分割更准。在普查场景中,最实用的方案不是二选一,而是两者配合——YOLO负责定位检测,SAM3负责精细分割。

SAM3 vs RemoteSAM:遥感专用基础模型

RemoteSAM(ACM Multimedia 2025)是专门为遥感场景设计的基础模型,用27万图像-文本-掩膜三元组训练,覆盖了多样化的遥感语义类别。在遥感专用基准上,RemoteSAM超越了Falcon、GeoChat等模型。

关键差异:SAM3在自然图像上训练,面对俯视视角、多光谱、高分辨率的遥感影像存在域偏移(domain gap)。RemoteSAM直接解决了这个问题,但通用性不如SAM3。

SAM3 vs AgriFM:农业专用基础模型

AgriFM(Remote Sensing of Environment,2025)是专为农业制图设计的时空基础模型,核心是层次化时空特征提取和多源遥感数据动态融合。它特别擅长利用多时相数据识别作物类型。

关键差异:AgriFM是"农业专家",SAM3是"通用选手"。作物分类这类需要时序特征的任务,AgriFM有天然优势;但地块边界提取、变化检测等对边界精度要求高的任务,SAM3更有优势。

四、实战架构:混合方案怎么做

综合以上分析,第四次农普遥感解译的最佳实践是**"基础模型+专业模型"混合架构**:

第一步:大范围初筛

用SAM3或RemoteSAM的零样本能力,对卫星影像进行快速初筛。输入文本提示如"cropland"、"greenhouse"、"water body",自动生成初步分类结果。这一步不需要任何训练数据,一天就能跑完全省影像。

第二步:精确分割与检测

对初筛结果中重点关注区域(如耕地边界模糊区、设施农业集中区),用YOLO+SAM融合框架进行精确分割。YOLO负责目标检测定位,SAM负责生成精确边界。fabSAM、YOLOSc-SAM等已有成熟方案。

第三步:作物精细分类

对需要区分作物类型的区域,用AgriFM等专业时序模型,结合多时相卫星数据(Sentinel-2、高分系列等)进行精细分类。

第四步:质量自动检查

用SAM3的高稳定性分割结果作为参考基准,与人工标注数据自动比对,标记偏差较大的区域供人工复核。

工具链建议:

- SAM3开源代码:github.com/facebookresearch/sam3

- RemoteSAM:github.com/1e12leon/RemoteSAM

- AgriFM:github.com/flyakon/AgriFM

- 遥感数据处理:GDAL + Rasterio + PyTorch

给遥感从业者的三条建议

第一,不要只盯着SAM3。SAM3代表了基础模型的方向——零样本、文本提示、通用分割——但在遥感场景下,RemoteSAM这类遥感专用基础模型可能更实用。关注两者的结合。

第二,混合架构是当前最优解。不要试图用一个模型解决所有问题。SAM3初筛+YOLO精检+专业模型分类,这套组合拳在精度、效率、成本之间取得了最好的平衡。

第三,关注SAM3.1的实时能力。7倍推理加速意味着SAM3可以处理无人机实时视频流。第四次农普大量使用无人机,如果能在飞行过程中实时完成地块分割和作物识别,将彻底改变外业调查的工作模式。

第四次农业普查是AI遥感技术的大考。SAM3不是唯一的答案,但它代表了一个重要的技术方向——从"需要大量标注数据才能工作"到"告诉AI你要什么,它就能找到"。这个方向,值得每一个遥感从业者认真关注。

参考论文:

- SAM 3: Segment Anything with Concepts. arXiv:2511.16719, 2025.11

- SAM 3.1: Meta AI Blog, 2026.03

- Generalization vs Specialization: SAM3 vs YOLO. arXiv:2512.11884, 2025.12

- RemoteSAM: Segment Anything for Earth Observation. ACM MM 2025

- AgriFM: Agricultural Foundation Model. Remote Sensing of Environment, 2025

- fabSAM: Farmland Boundary Delineation. arXiv:2501.12487, 2025.01

- YOLOSc-SAM: Farmland Extraction. Smart Agricultural Engineering, 2026

- SAM for Remote Sensing: From Zero to One Shot. Int. J. Applied Earth Observation, 2024

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)