大模型上云,小模型上端?从 DeepSeek V4 发布看 AI 的场景分化

大模型上云,小模型上端?从 DeepSeek V4 发布看 AI 的场景分化

4 月 27 日,DeepSeek 正式发布 V4 系列模型并开源权重。其中 V4-Pro Base 版参数量达到 1.6 万亿(激活参数 862B),V4-Flash 为 158B(Base 292B),均采用 MoE 架构。上线 HuggingFace 不到两天,V4-Pro 就获得了超过 3000 次点赞和 17 万次下载。

这是开源社区迄今为止最大规模的模型发布之一,也让一个趋势变得更加清晰:AI 模型正在走向两极——云端越来越大,端侧越来越近。

"越来越大"这件事,正在发生什么?

先梳理一下 Scaling Up 方向的最新进展。

大模型之所以越做越大,底层逻辑是 2020 年 OpenAI 提出的 Scaling Laws:模型参数量、数据量和计算量的增加,能带来可预测的性能提升。从 GPT-3 的 175B 到 DeepSeek V4 的 1.6T,参数量增长了近 10 倍,而模型在通用推理、代码生成、数学证明等任务上的能力也确实在持续进步。

工程上,MoE(Mixture of Experts)架构是支撑万亿参数的关键。V4-Pro 的 1.6T 参数中,推理时只激活一部分专家网络(862B),既保留了大参数量的知识容量,又控制了单次推理的计算成本。配合分布式推理和量化优化,V4-Pro 已经可以通过 Together、Novita、Fireworks 等推理服务商在线调用。

从技术层面看,Scaling Up 的逻辑依然成立,而且大模型在通用任务上的表现仍然难以被小模型替代。

"越来越近"又是怎么回事?

但 AI 的部署方式并不是只有"大模型+云端推理"这一种。

另一个方向可以用 Scaling Out 来概括——不是把一个模型做得越来越大运行在远端,而是让更多专精的小模型分布在离用户更近的设备上,各自处理自己擅长的任务,必要时通过网络协作。

这不是一个纯概念的方向,几个关键技术已经成熟到可以支撑实际应用:

模型压缩:大模型的能力可以装进小设备

混合精度量化(如 w4a16)、知识蒸馏、视觉 token 剪枝等技术,能把数十亿参数的模型压缩到消费级硬件可运行的规模。

以 Apple M4 芯片为例,它的 GPU 和 Neural Engine 提供了不错的本地推理算力。一个经过量化的 4B 参数模型,在 M4 芯片上可以实现 476 tokens/s 的 prefill 速度和 76 tokens/s 的 decode 速度,峰值内存只需 4.3GB。

垂直专精:不是所有任务都需要通用模型

通用大模型用一套参数覆盖所有场景,这在很多任务上是高效的。但在一些垂直领域——比如 GUI 自动化、医学影像、工业检测——专门训练的小模型可以用更少的参数达到更高的精度。

数据可以说明这一点:在 GUI 自动化领域,一个 4B 参数的专精模型在特定 benchmark 上的表现已经超过了参数量是它数百倍的通用模型。

数据主权:在本地处理比传到云端安全

大模型运行在云端,用户输入的数据需要离开本地设备。在 AI Agent 场景下这个问题尤其突出——Agent 需要截取用户屏幕、读取本地文件、执行操作指令。这些数据一旦上传到云端,就涉及到隐私合规的问题。

Scaling Out 方案下,模型运行在用户自己的设备上,所有数据在本地完成处理,不需要经过网络传输。

两条路线适合什么场景?

两条路线各有各的适用范围:

Scaling Up(大模型上云)更适合:

- 通用语言理解和生成(对话、摘要、翻译)

- 复杂逻辑推理和代码生成

- 需要大规模知识储备的任务

- 对延迟不敏感的批量处理场景

Scaling Out(小模型上端)更适合:

- 隐私敏感场景(屏幕数据、企业内部数据)

- 实时交互场景(每一步都需要快速响应)

- 离线环境(无网络或网络不稳定)

- 垂直领域的专精任务(GUI 操作、特定领域检测)

- 成本敏感场景(高频调用下 API 成本累积)

两条路线不是替代关系,而是解决不同层级的问题。云端大模型提供通用智能底座,端侧专精模型提供落地执行能力。

具体案例:GUI Agent 的端侧实践

以一个具体场景来说明。

GUI 自动化——让 AI 像人一样看屏幕、理解界面内容、自主执行操作——是一个典型的 Scaling Out 方向。理由很直接:

- 屏幕截图包含用户隐私数据,适合在本地处理

- 一个 GUI 任务可能涉及数十步连续操作,每步需要快速响应

- GUI 操作不需要万亿参数的通用推理能力,而是需要精准的视觉定位和动作规划

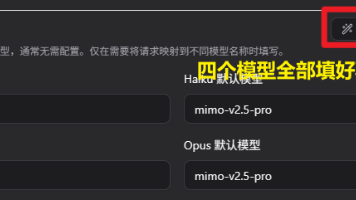

在这个方向上,Mano-P 是明略科技开源的一个端侧 GUI Agent 项目(Apache 2.0 协议)。它采用 GUI-VLA(Vision-Language-Action)架构,将视觉理解、语言推理和动作生成整合在一个端到端模型中,运行在用户的 Mac 上,数据不出设备。

公开评测成绩(标注了评测基准和模型规格):

- OSWorld 基准测试(72B 模型):58.2% 准确率,排名第一(第二名 45.0%,高出 13.2 个百分点)

- WebRetriever Protocol I(72B 模型):41.7 NavEval 分,排名第一(Gemini 2.5 Pro 40.9,Claude 4.5 31.3)

- 端侧部署(4B 量化模型,w4a16):Apple M4 芯片上 prefill 476 tokens/s,decode 76 tokens/s,峰值内存 4.3GB

硬件要求:Apple M4 芯片 + 32GB RAM 的 Mac。

这个案例的意义在于:它用实际数据验证了 Scaling Out 在垂直场景的可行性——4B 参数的端侧模型在 GUI 自动化领域做到了和云端大模型同级甚至更优的效果。

总结

DeepSeek V4 的发布是 Scaling Up 方向的又一个重要节点。万亿参数的开源模型推动了 AI 通用能力的天花板继续上移。

但开源 AI 的发展不只是参数竞赛。Scaling Out 方向也在快速成熟——模型压缩、端侧推理、专精训练、多 Agent 协作,这些技术正在让 AI 能力从云端延伸到每个人的设备上。

两条路线的关系不是对立,而是分层互补。大模型上云,解决通用智能的问题;小模型上端,解决场景落地的问题。 对于开发者和技术选型者来说,理解这两条路线各自的适用范围,可能比单纯追求参数量更有价值。

资源链接:

Mano-P 开源仓库(Apache 2.0):github.com/Mininglamp-AI/Mano-P

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)