企业落地AI,如何跨越从试点到生产的鸿沟?

“这个 AI 应用的演示效果挺惊人的,但真的能在生产环境中稳定运行吗?”

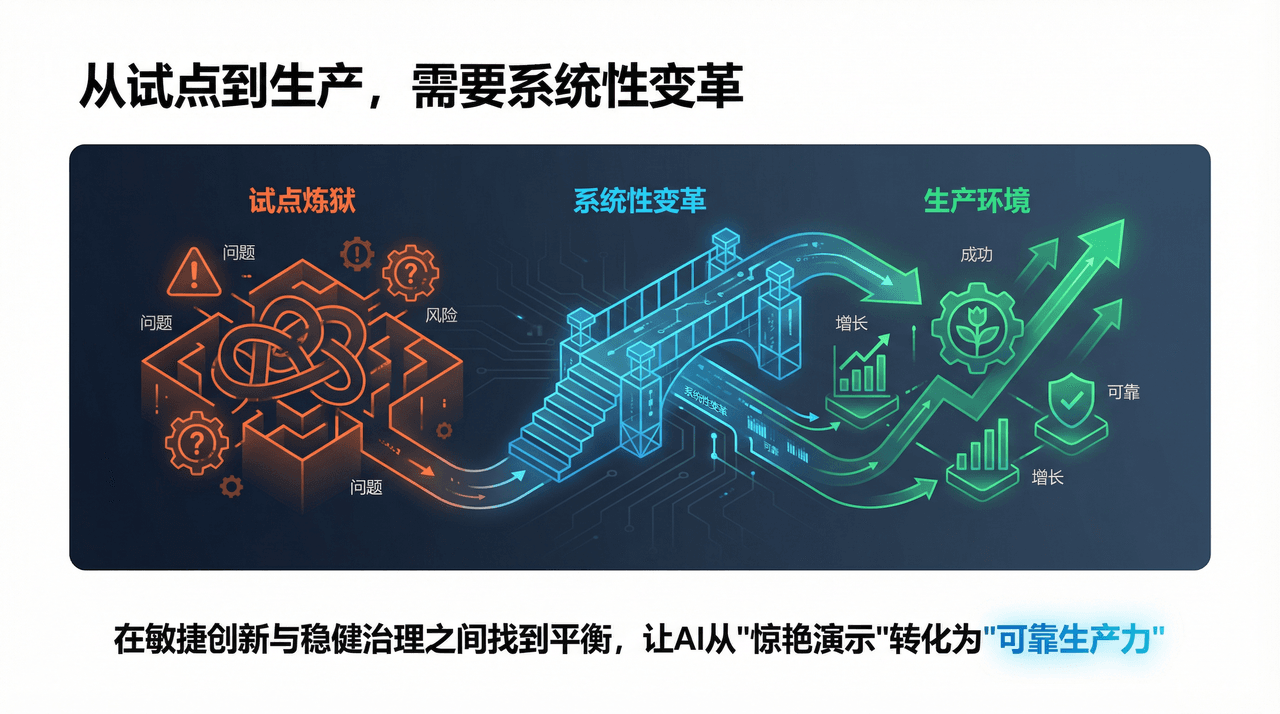

这可能是近两年来每一位 AI 项目负责人都会反复自问的一句话。我们正处在一个充满矛盾的 AI 时代:一方面,AI 的潜力令人振奋;另一方面,大部分的 AI 试点项目最终都未能成功部署到生产环境。麦肯锡的一份调研(The state of AI in 2025: Agents, innovation, and transformation)指出,他们采访的三分之二企业尚未在全公司范围内规模化应用人工智能,仍处于试验或试点阶段。有一个词恰如其分地总结了这种现象,即“试点炼狱”(Pilot Purgatory)。

为什么那些看起来前途无量的 AI 项目,最终会止步于生产环境的大门之外?企业应如何跨越从“惊艳的演示”到“可靠的生产力”之间这道巨大的鸿沟?

本文将以问答(Q&A)的形式,为你剖析企业 AI 落地的核心痛点,并分析探讨可行的破局之道。

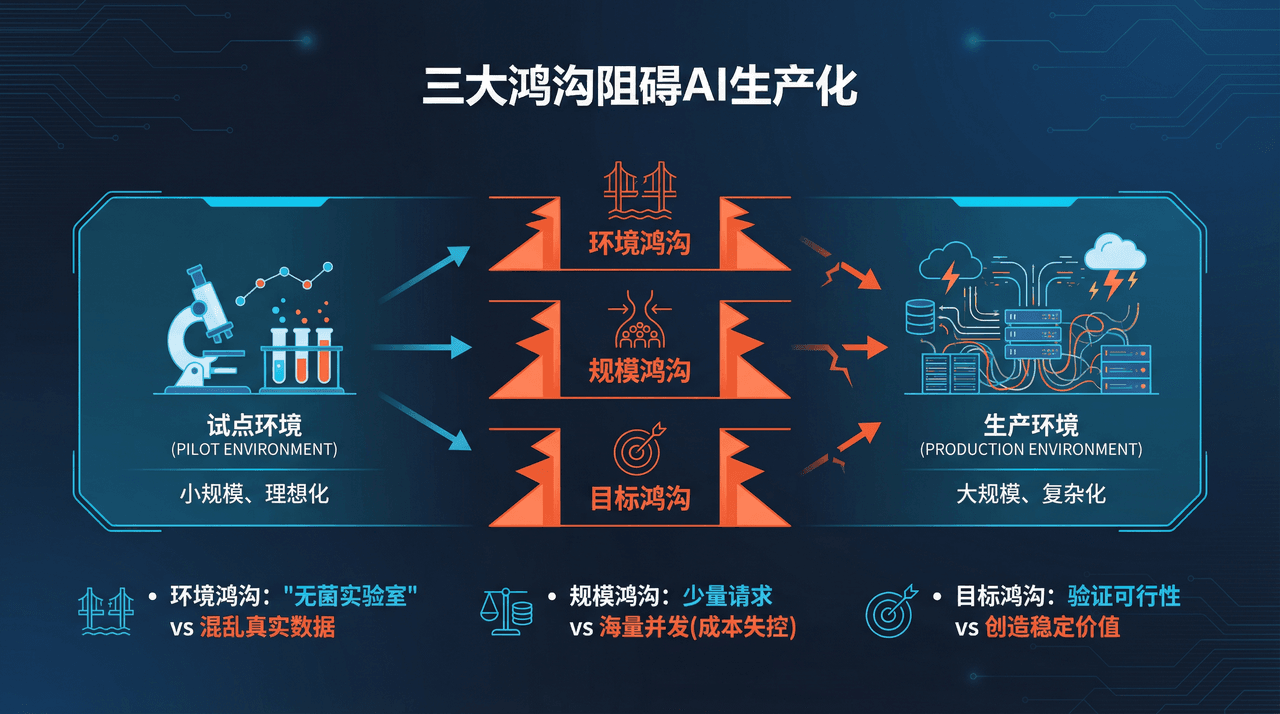

Q1:为什么我的 AI 试点项目看起来很棒,却总在生产环境前止步?

答:这是最典型的“试点炼狱”症状。核心原因在于,试点成功与生产成功是两个完全不同的概念。

- 环境差异:试点项目通常在“无菌”环境中运行,使用经过精心清洗和标注的“完美”数据集。而生产环境则要复杂很多,充满了混乱、实时、非结构化的真实数据,还有复杂的系统集成需求。

- 规模差异:试点可能只处理少量请求,成本可控。一旦进入生产环境,面对海量并发请求,模型的推理成本、延迟和稳定性问题会立刻暴露出来,甚至可能因成本失控而被迫下线。

- 目标差异:试点的目标是“验证可行性”(Proof of Concept),而生产的目标是“创造稳定价值”(Reliable Value Creation)。后者要求系统具备高可用性、可监控性、安全性和可维护性,这些在试点阶段往往被忽略。

简单来说,一个成功的试点证明了 AI“能做什么”,而一个成功的生产部署则要求 AI 能“稳定、可靠、经济地持续做”。

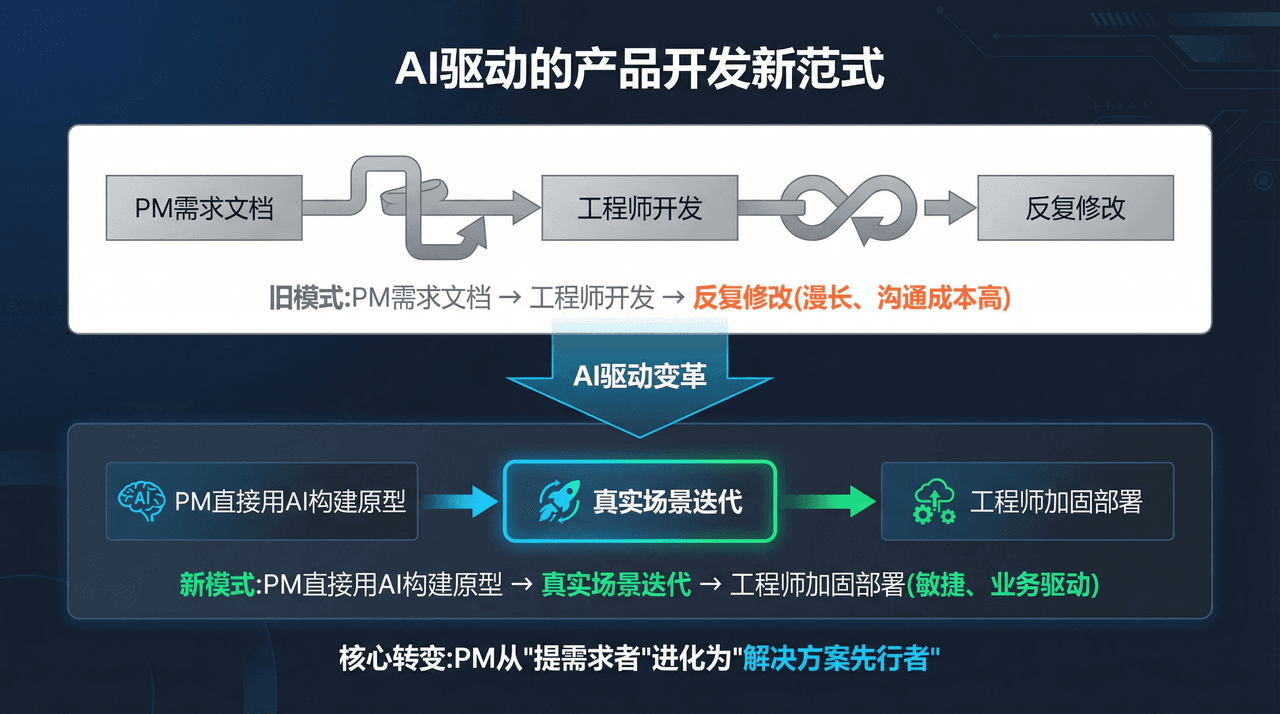

Q2:AI 时代,产品开发流程有什么根本变化?产品经理(PM)该如何适应?

答:AI 正在颠覆传统的开发流程,催生出一种更敏捷、更由业务驱动的新模式。

- 旧模式:PM 调研需求并构思 → 撰写厚重的需求文档(Spec)→ 工程师开发 → 评审 → 反复修改。这个流程漫长、沟通成本高,且工程师可能无法完全理解 PM 的业务意图。

- 新模式:PM 调研需求并构思 → PM 直接使用 AI 构建应用原型 → PM 在真实场景中快速评估和迭代 → 当效果满意后,交给工程师进行生产级加固和部署。

在这种新模式下,PM 不再仅仅是“提需求的人”,而是“创造解决方案的先行者”。他们可以利用 AI 工具快速将业务想法转化为可交互的原型,在投入大量工程资源之前,验证创意的真正价值,从而大大降低创新风险,确保最终产品更贴近业务需求。

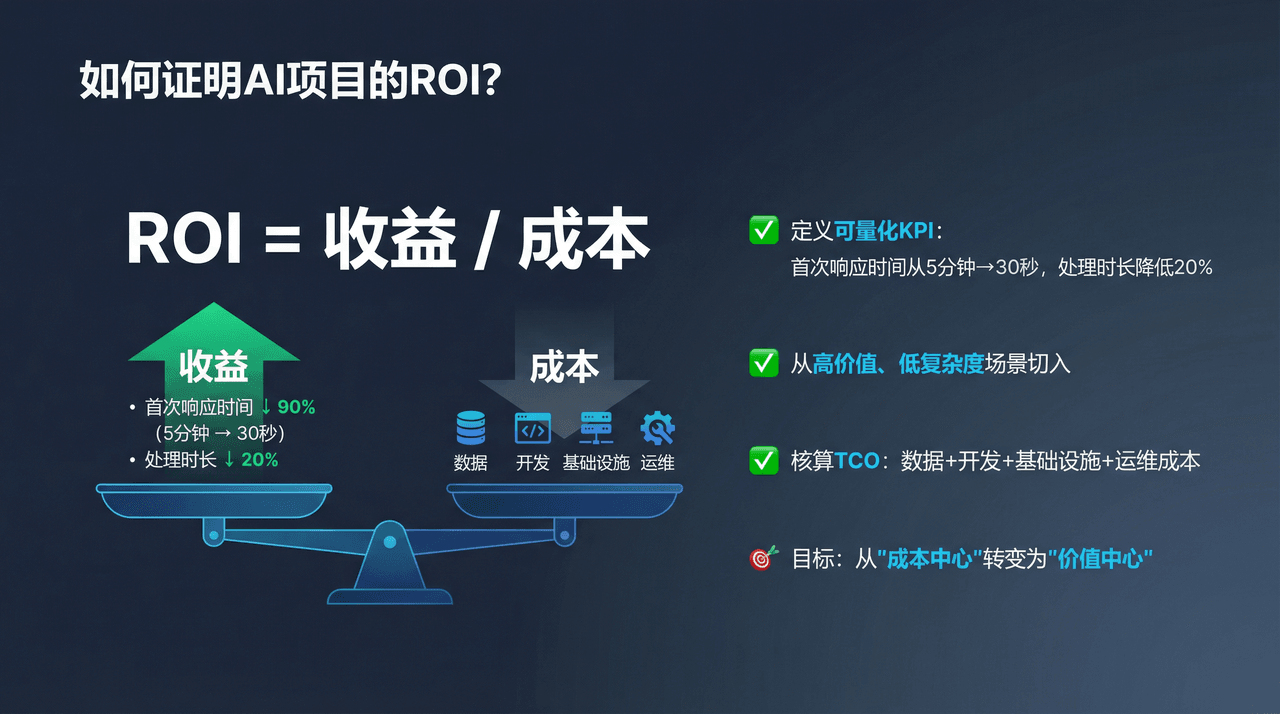

Q3:预算怎么算?如何向管理层证明一个看不见摸不着的 AI 项目能赚钱(ROI)?

答:ROI 模糊是导致 AI 项目被砍掉的首要原因之一。要解决这个问题,必须从“技术思维”转向“商业思维”。

-

定义可量化的业务指标(KPI):在项目启动前,就必须明确 AI 要解决的业务问题,并将其转化为可量化的指标。

- 错误示范:“我们要做一个智能客服。”

- 正确示范:“我们要通过 AI 客服,将客户首次响应时间从 5 分钟缩短到 30 秒,并将人工客服的平均处理时长降低 20%。”

-

从高价值、低复杂度的场景切入:不要一开始就挑战最复杂的任务。选择一个能够快速产生明显业务收益的场景作为突破口,建立管理层的信心。

-

核算总拥有成本(TCO):ROI = 收益 / 成本。成本绝不仅仅是 API 调用费用,还应包括:

- 数据成本:数据采集、清洗、标注的费用。

- 开发成本:模型微调、应用开发的人力。

- 基础设施成本:算力资源、存储和网络费用。

- 运维成本:持续监控、迭代优化和人工干预的成本。

只有清晰地展示出投入与产出的明确关系,AI 项目才能从“成本中心”转变为“价值中心”。

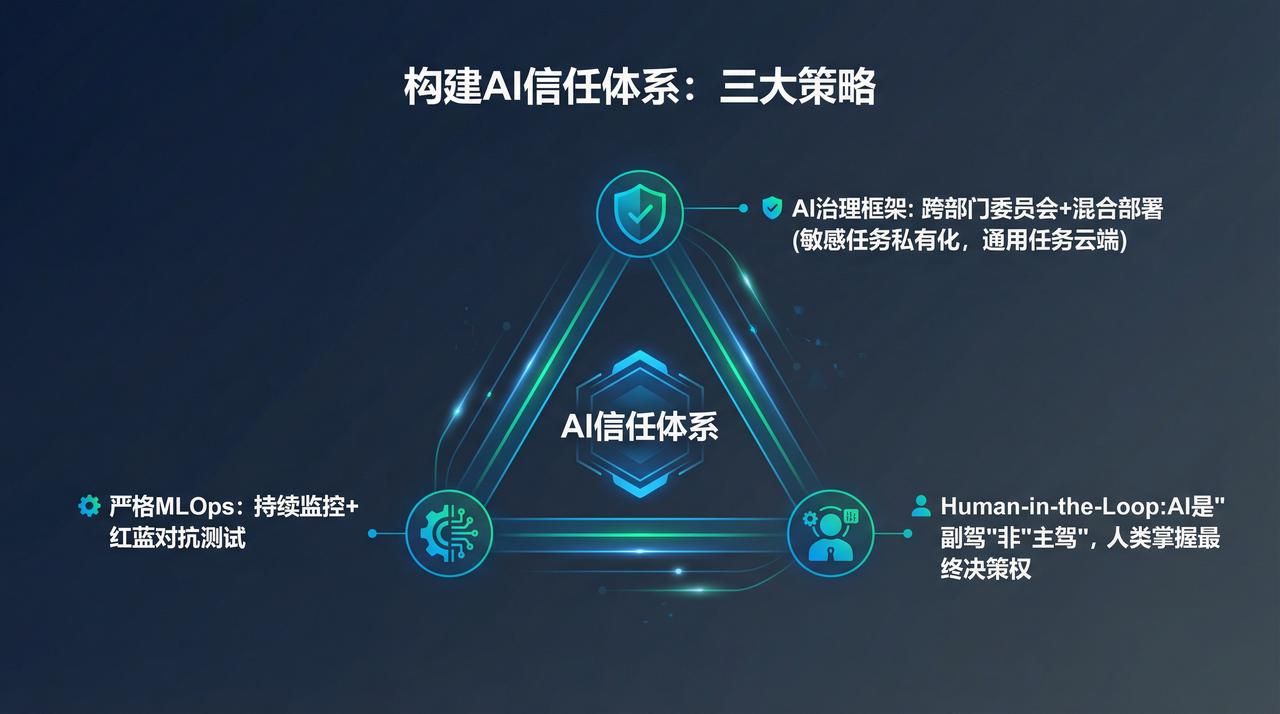

Q4:如何解决数据隐私、模型“幻觉”和安全合规这些棘手问题?

答:信任是 AI 在企业中规模化应用的前提。这些问题无法回避,必须建立一个立体的防御体系。

-

策略一:建立 AI 治理框架

- 成立跨部门的 AI 治理委员会,制定明确的数据使用规范和模型行为准则。

- 采用混合部署模式:对于涉及核心机密或敏感数据的任务(如财务分析、HR 评估),在私有化环境中部署开源模型;对于通用、非敏感任务(如内容生成、公开信息摘要),则可以调用公有云 API,以平衡安全与成本。

-

策略二:实施严格的 MLOps

- 持续评估与监控:建立自动化流水线,持续监控模型的准确性、偏见和“幻觉”发生率。一旦发现性能衰退或数据漂移,立即触发报警和再训练。

- “红蓝对抗”测试:在模型上线前,组织专门的“攻击队”(红队)来寻找模型的漏洞和缺陷,模拟各种极端输入,以测试其鲁棒性。

-

策略三:设计“Human-in-the-Loop”机制

- 在所有高风险决策环节中,AI 的角色应该是“副驾”而非“主驾”。AI 可以提供建议、分析和草案,但最终的决策权必须掌握在人类专家手中。在当下,“Human-in-the-Loop”机制,不仅是安全网,也是持续收集高质量反馈数据的最佳途径。

Q5:公司内部各部门应该“各自为战”,还是建立统一的 AI 平台?

答:“各自为战”是 AI 落地初期常见的现象,但这会迅速导致“AI 孤岛”——技术栈混乱、重复投资、数据不通、安全策略不一。这或许是一个必经阶段,但从长期来看,建立统一的 AI 中台是创造更大价值的一种选择。

- 成本效益:集中采购和管理算力资源,统一调度模型服务,避免各部门重复造轮子,大幅提升算力利用率。

- 效率提升:提供标准化的开发工具、数据连接器和预置模型,让新 AI 应用的开发速度提升数倍。

- 知识沉淀:将成功的 Prompt 工程经验、行业数据和优化后的模型作为可复用的“智能资产”沉淀下来,赋能整个企业。

- 风险管控:实施统一的安全标准、权限管理和合规审计,从根本上杜绝“影子 AI”带来的风险。

结语:从“技术实验”到“业务引擎”

跨越从试点到生产的鸿沟,本质上是一次深刻的组织变革。麦肯锡的报告也清晰表达了一个洞察:人工智能的价值源于对企业运行模式的重塑,它要求企业不再将 AI 视为一个孤立的技术工具,而是将其视为一个驱动业务增长的核心引擎。

成功应用 AI 创造价值的关键,不在于你测试了多少个前沿模型,而在于你是否建立了一套能够将 AI 能力稳定、可靠、经济地融入业务流程的运营体系。停止构建昙花一现的演示,开始着手打造一个能够自我进化、持续创造价值的 AI 原生系统。这,才是 AI 应用的真正开局。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)