DeepSeek-V4 正式发布1M 上下文、Agent 能力与企业落地

一、DeepSeek-V4 到底发布了什么

如果只用一句话来总结 DeepSeek-V4,我会说:

它不是单纯“更大的模型”,而是更接近企业可落地的统一 AI 能力底座。

DeepSeek-V4 最值得关注的几个点:

- 支持 1M 超长上下文:可以处理超长文档、代码仓库、知识库材料和复杂多轮对话。

- Agent 能力增强:更擅长工具调用、任务规划和自动化执行。

- 双版本设计:既有高性能的

DeepSeek-V4-Pro,也有高性价比的DeepSeek-V4-Flash。 - API 兼容性好:能够以较低成本接入现有 OpenAI / Anthropic 风格生态。

- 更适合企业系统集成:不仅能聊天,还能接知识库、文档库、代码仓库和业务系统。

从产品思路上看,DeepSeek-V4 并不只是为了刷榜,而是更强调“好接入、能落地、能跑业务”。

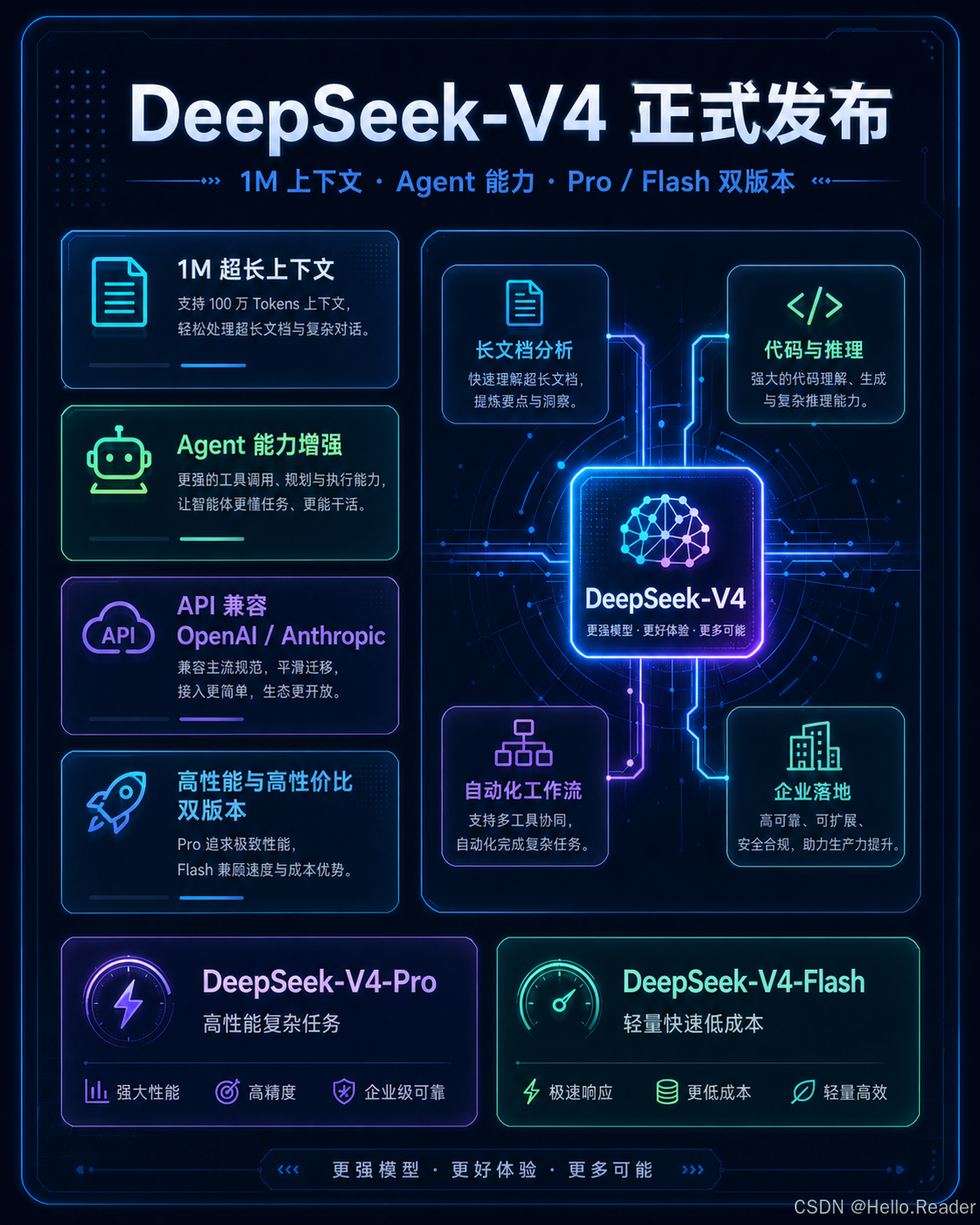

二、DeepSeek-V4 的整体亮点,一图看懂

从这张图你可以快速抓住几个关键词:

- 1M 超长上下文:解决长文档、复杂任务输入问题

- Agent 能力增强:解决多步骤任务执行问题

- API 兼容:解决接入成本问题

- 双版本设计:解决性能与成本平衡问题

- 企业落地能力:解决“能不能真正上线”问题

三、Pro 与 Flash 怎么选

很多人最关心的不是“它强不强”,而是:

我实际做项目,到底应该选 Pro 还是 Flash?

先看图。

1. 两个版本的核心差异

| 维度 | DeepSeek-V4-Pro | DeepSeek-V4-Flash |

|---|---|---|

| 定位 | 高性能版本 | 高性价比版本 |

| 总参数 | 1.6T | 284B |

| 激活参数 | 49B | 13B |

| 上下文长度 | 1M | 1M |

| 适合任务 | 复杂推理 / Agent / 代码 / 长文档 | 问答 / 摘要 / 分类 / 轻量 Agent |

| 核心优势 | 综合能力更强 | 更快、更省成本 |

2. 直接给结论

如果你懒得看太细,直接记住下面这条就够了:

- 重推理、长文档、复杂自动化任务:选 Pro

- 高并发、低成本、批量轻任务:选 Flash

- 企业项目:建议 混合使用

3. 为什么企业项目更适合混用

因为企业真实业务不是单一场景。

比如:

- 合同审查、知识库深度问答、代码分析 → 用 Pro

- 摘要提取、客服分流、内容分类、批量轻问答 → 用 Flash

这样既保住质量,也能控制总体成本。

四、1M 上下文,到底值在哪

“1M 上下文”这个词,看起来很唬人,但真正的价值不在数字本身,而在业务意义。

1. 它最适合什么场景

这类场景最能体现长上下文价值:

- 合同审查:主合同 + 附件 + 补充协议一起分析

- 论文解读:全文阅读 + 结构梳理 + 关键观点总结

- 代码仓库分析:跨文件、跨模块理解逻辑

- 会议记录总结:长会议纪要、行动项提取

- 企业知识库问答:一次性装入更多背景材料

2. 它到底解决了什么问题

长上下文主要解决三件事:

(1)减少信息割裂

材料不用被切得太碎,模型看到的信息更完整,更容易形成全局理解。

(2)减少人工切分成本

过去很多系统为了塞进模型,不得不把内容疯狂拆块。现在这件事可以没那么“极端”。

(3)提升复杂任务表现

尤其在“需要参考很多上下文”的任务里,模型表现会更自然。

3. 但要注意:长上下文 ≠ 无脑堆料

真正靠谱的做法应该是:

- 先做 RAG 检索

- 再做 上下文压缩与重排

- 最后再交给 DeepSeek-V4

所以,1M 上下文最好的打开方式不是“全塞进去”,而是“更聪明地装进去”。

五、API 价格与迁移建议

再强的模型,如果价格不合适、迁移太麻烦,落地价值也会打折。

1. 价格对比

| 项目 | deepseek-v4-flash | deepseek-v4-pro |

|---|---|---|

| 缓存命中输入 | $0.0028 / 1M Tokens | $0.003625 / 1M Tokens(限时 75% off) |

| 缓存未命中输入 | $0.14 / 1M Tokens | $0.435 / 1M Tokens(限时 75% off) |

| 输出 | $0.28 / 1M Tokens | $0.87 / 1M Tokens(限时 75% off) |

2. 老项目怎么迁移

可以按下面的思路理解:

deepseek-chat→ 迁移到deepseek-v4-flashdeepseek-reasoner→ 使用deepseek-v4-flash的思考模式,或者进一步升级到deepseek-v4-pro

3. 实战建议

- 新项目:直接使用 V4 系列

- 复杂任务:优先 Pro

- 批量轻量任务:优先 Flash

六、DeepSeek-V4 企业落地架构

真正让我觉得 DeepSeek-V4 有意思的,不是某个单点指标,而是它已经能自然放进一套企业 AI 架构里。

1. 整体可以分成四层

第一层:用户层

可能来自:

- Web

- App

- 内部系统

第二层:接入层

这里负责生产级治理能力:

- API 网关

- 鉴权

- 限流

- 日志

第三层:智能层

这里是系统“大脑”:

- RAG 检索

- 知识库

- 上下文重排

- DeepSeek-V4-Pro / Flash

- 工具调用

第四层:数据与系统层

这里连接企业真实资产:

- 文档库

- 数据库

- 代码仓库

- 业务系统

2. 它适合哪些应用场景

从图中可以看到,很典型的应用包括:

- 企业知识库问答

- 客服辅助

- 智能写作

- 代码助手

- 合同审查

- 自动化办公

3. 最终收益是什么

一旦做好,收益通常集中在三件事:

- 提升问答质量

- 降低人工成本

- 支持更复杂的自动化流程

七、统一工作流:从用户问题到最终回答

真正的智能问答系统,一般不会是“用户一句话,模型直接吐答案”这么简单。

它背后通常是一整条工作流。

1. 典型流程

从图里可以看到,完整流程通常是:

- 用户问题

- 权限校验

- 文档解析 / 代码索引 / 数据库查询

- RAG 检索

- 上下文压缩与重排

- DeepSeek-V4-Pro / Flash

- 工具调用 / 结果校验

- 最终回答

- 日志、审计、成本统计

2. 为什么要这么复杂

因为企业系统要同时解决三个问题:

- 回答准不准:靠检索、重排、工具调用、结果校验

- 系统安不安全:靠权限控制、日志审计

- 成本可不可控:靠模型选型、缓存、成本统计

所以,今天一个成熟的智能问答系统,本质上是:

模型 + RAG + 工具 + 治理 + 成本控制

八、接入代码示例

1. curl 方式调用

export DEEPSEEK_API_KEY="你的 API Key"

curl https://api.deepseek.com/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer ${DEEPSEEK_API_KEY}" \

-d '{

"model": "deepseek-v4-pro",

"messages": [

{

"role": "system",

"content": "你是一个严谨的技术助手。"

},

{

"role": "user",

"content": "请简要分析 DeepSeek-V4 的企业落地价值。"

}

],

"stream": false

}'

2. Python 方式调用

import os

from openai import OpenAI

client = OpenAI(

api_key=os.environ.get("DEEPSEEK_API_KEY"),

base_url="https://api.deepseek.com",

)

resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "你是一个专业的技术顾问。"},

{"role": "user", "content": "请为我设计一个基于 DeepSeek-V4 的企业知识库问答系统。"}

],

stream=False,

)

print(resp.choices[0].message.content)

九、总结

DeepSeek-V4 最值得肯定的地方,不是单独某一项能力,而是它把多个关键能力做成了一个更完整的组合:

- 1M 上下文:让长文档和复杂材料处理更自然

- Agent 能力:让模型从“会回答”走向“会执行”

- Pro / Flash 双版本:让企业可以在性能与成本之间做更灵活的权衡

- API 兼容与迁移友好:让接入门槛变低

- 企业落地架构清晰:更适合真正做业务系统集成

如果你只是把它当成聊天模型,那你只能用到它的一小部分价值;但如果你把它放进 RAG、Agent、业务系统集成、工具调用 的完整链路里,它才能真正发挥出“生产力工具”的意义。

最后给一句很接地气的建议:

想做质量,优先 Pro;想控成本,优先 Flash;想做企业项目,最好两者配合。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献34条内容

已为社区贡献34条内容

所有评论(0)