辅助驾驶 | 端到端、VLA与世界模型

云端训练–>车端部署

一、规则驱动(早期)

原理

完全依靠人类工程师手写规则实现辅助驾驶。典型算法架构如下:

输入:位置 + 速度 + 障碍物距离 + 导航目的地

↓

人工规则引擎(if-else 逻辑)

↓

输出:变道决策、避障动作

特征

| 特征 | 说明 |

|---|---|

| 高精地图 | 必须依赖,用于定位和路径规划 |

| 使用场景 | 高速公路等结构化道路 |

| 云端训练 | 无,车上运行的是规则代码而非模型 |

分析

优点:

- 决策**

可溯源**,每个动作都能找到对应的规则代码 - 结果**

可解释**,逻辑清晰 - 安全性可控

缺点:

- 规则

无法覆盖所有复杂场景(长尾问题) - 规则之间可能产生**

矛盾** - 开车风格明显不像人类

- 难以应对:恶劣天气、施工路段、多车交互等场景

本质问题:手写规则本质上是**

死板**的,加一个规则应对情况A,可能破坏情况B的表现。

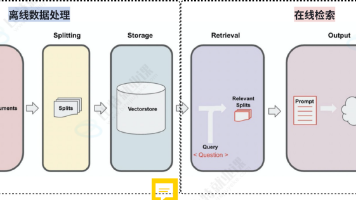

二、端到端模仿学习阶段

核心

发现人类驾驶数据足够多后,模型可以**自己拟合**出各种场景应该怎么做。

技术

云端训练阶段:

┌─────────────────────────────────────┐

│ 输入数据: │

│ ├── 摄像头图像 │

│ ├── 导航信息 │

│ └── 人类驾驶行为(Clips) │

│ ↓ │

│ 深度学习框架 │

│ ↓ │

│ 输出:训练好的模型权重 │

└─────────────────────────────────────┘

车端部署阶段:

┌─────────────────────────────────────┐

│ 输入:摄像头实时画面 │

│ ↓ │

│ 狭义端到端模型(模仿学习) │

│ ↓ │

│ 输出:动作轨迹(方向盘角度、加减速) │

└─────────────────────────────────────┘

概念

Clips:实际驾驶片段的数量单位

例如:

- 小米 HAD 端到端 1000万 Clips 版本

- 华为 ADS 3.0

- 小鹏 XNGP 5.0

- 理想 NOA 7.0

这些都处于同一阶段——模仿学习驱动的端到端。

广义端到端 vs 狭义端到端

- 广义端到端:减少人为设计导致的信息损失,中间不经过人类定义的转换

- 狭义端到端:特指这种模仿学习的端到端——输入图像,输出驾驶动作

分析

优点:

- 开车操作更像人类

- 能处理更多复杂场景

- 无需手工设计中间规则

问题

-

依赖人类数据分布

- 模型学到的是"看到什么就做什么"的应对方式

- 这些应对方式存在于高维度参数空间,无法被人理解(黑盒)

- 遇到训练数据之外的场景,没有明确机制判断如何反应

-

边际效益递减

- 当模型能处理99%场景后,剩下1%的长尾场景

- 可能需要开十几亿甚至几十亿公里才能收集到足够数据

-

OOD问题(Out-of-Distribution)

- 训练分布之外的场景,模型行为不可预测

- 缺乏危险预测能力和防御性驾驶意识

本质问题:模仿学习是"巧妇难为无米之炊"——

没有数据就解决不了问题。

三、世界模型 + RL阶段

解决思路

针对模仿学习的两个核心问题:

- 长尾数据难以收集

- 模型行为难以分析和控制

世界模型(World Model)

定义:利用之前收集的数据,建立一个可以**模仿真实物理世界**、能随意控制场景及其他交通参与者行为的巨大模型。

核心特征 vs 普通视频生成模型:

| 特性 | 普通视频模型(Sora等) | 世界模型 |

|---|---|---|

| 碰撞反馈 | 可能穿模、无反弹 | 符合真实物理规律 |

| 多摄像头一致性 | 逐渐不同步 | 状态统一 |

| 物理规律 | 可能违反 | 严格遵守 |

理解:

- 不是简单的3D游戏场景生成

- 生成的是能直接用于训练的图像/激光雷达

点云+对应驾驶动作 - 可以

生成各种刁钻的罕见场景

Reinforcement Learning

核心机制:用人工定义的奖励/惩罚函数定向限制模型行为。

示例:

# 伪代码示例

def reward_function(model_action, env_state):

score = 0

# 场景:路口绕行

if model_action.is_routing and not can_proceed(env_state):

score -= 10 # 扣分:不合理绕行

# 场景:加加速度过大

if model_action.jerk > threshold:

score -= 5 # 扣分:乘坐不舒适

# 场景:正常行驶

if model_action.is_safe:

score += 1 # 奖励:安全驾驶

return score

通过大量"奖励/惩罚"循环,模型学会:

- 路口等红灯时不绕行

- 加减速控制平顺

- 防御性驾驶意识

成果

这个阶段的模型:

- 依然是一个黑盒

- 但可以在云端世界模型中学到大量真实世界难以收集的罕见场景

- 行为偏好可以被强化学习控制

厂商:

- 华为 WEWA

- 小米最新的 HAD 增强版

- 地平线 HAD

四、VLA 与车端世界模型阶段

为什么还需要进一步发展?

前面阶段的问题:

- 模型仍是

黑盒 - 出问题时难以定位原因

VLA(Vision-Language-Action Model)

核心思想:让模型不仅输出动作,还能**说话解释**

架构:

传统端到端 VA:

摄像头视频 → [黑盒模型] → 驾驶动作

VLA:

摄像头视频 + 文字解释数据 → [多模态模型] → 驾驶动作 + 思维链

训练方式:在训练时,不仅给模型摄像头的信号和开车动作,还要加上对应的文字解释和表述。数据量足够后,模型就能解释"遇到这个场景,为什么要这么做"。

优势:

- 撞车后可以用文字分析原因

- 模型决策过程可解释

- 可以进行人机交互和调试

车端世界模型

核心能力:给定之前的视频 + 当前状态 → 预测未来

如果发生事故,回溯模型预测了什么,就能发现问题的原因。

当前限制:算力瓶颈

| 平台 | 算力 | 功耗 | 用途 |

|---|---|---|---|

| 英伟达论文中的 VLA | 4000+ TOPS | 600W | 服务器训练/推理 |

| 今年上车的最新 SOC | 700+ TOPS | ~数十瓦 | 车端部署 |

算力差距:约6倍

这意味着在车端跑 VLA 或世界模型,必须:

- 模型蒸馏(Distillation)

- 降低输入分辨率

- 降低推理帧率

这些优化会影响实际效果。

部署

- VLA 确实能输出思维链

- 但不是一直思考输出

- 紧急情况下,本质上还是在用 VA 端到端开车

考验:如何在有限算力下部署 VLA 而不影响性能。

VLA 与世界模型的关系

两者不冲突,完全可以相互融合,但需要更多算力支持。

对比

| 阶段 | 云端 | 车端 | 代表厂商/产品 |

|---|---|---|---|

| 1. 规则驱动 | 无 | 规则代码 |

早期高速辅助驾驶 |

| 2. 模仿学习 | 大量 Clips 训练 | VA 端到端 |

华为 ADS3.0、小鹏 XNGP 5.0、理想 NOA 7.0、小米 HAD |

| 3. 世界模型 + 强化学习 | 世界模型生成 + RL |

VA 端到端 + 行为控制 | 华为 WEWA、小米 HAD 增强版、地平线 HAD |

| 4. VLA / 车端世界模型 | 继续增强 | VLA 或世界模型部署 | 仍在发展中,面临算力挑战 |

q&a

端到端有幻觉问题,但并不是不能处理没训练过的场景

- 大模型的泛化能力并非完全失效

端到端最大的问题是没有危险预测能力,即防御性驾驶

- 这是模仿学习架构的根本局限

有了世界模型,大家的差距只会越来越小

- 技术路线收敛后,差异化减小

VLA 比 VA 要先进吗?

- VLA 是在 VA 基础上

增加语言能力,不是替代关系

华为 ADS 是世界模型

- 华为 WEWA 属于第三阶段方案

总结

- 规则驱动 → 完全手写规则,死板不可扩展

- 模仿学习 →

数据驱动,但依赖数据分布,是黑盒 - 世界模型 + 强化学习 → 解决长尾数据问题 + 行为可控制

- VLA / 车端世界模型 → 可解释 + 预测能力,但受限于车端

算力

各厂商的技术差异:各自处于哪个阶段,以及在各自阶段内的工程实现能力

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)