小白程序员轻松掌握大模型核心技术,速收藏!

"分而治之"是工程学中的经典思想——将复杂问题拆解为相对独立的子问题,分别解决后再统一整合。这一思想在RAG(检索增强生成)技术的设计中得到了完美体现,从知识与能力的分离,到检索与生成的协作,RAG技术的每一次技术迭代都蕴含着分而治之的工程智慧。

一、知识与能力的分离

大语言模型LLM会存在什么问题?

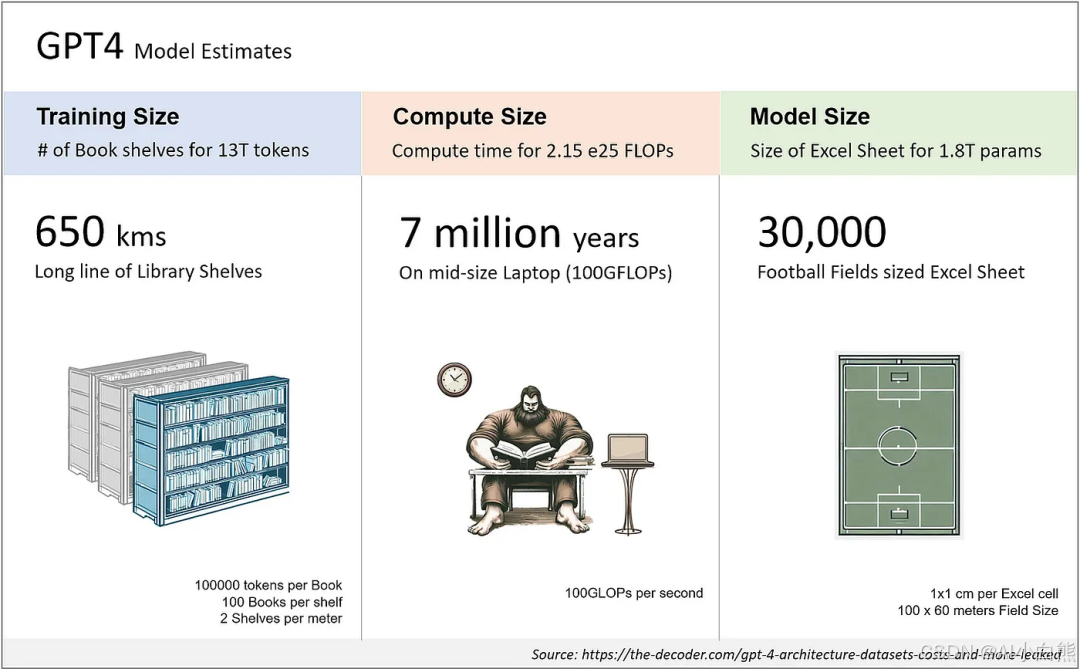

大语言模型将知识编码在数千亿级别的参数中。以GPT-3为例,其1750亿个参数通过分布式存储方式保存语言知识和世界知识。这种参数化存储虽然实现了强大的语言理解能力,但在知识更新方面存在技术挑战。

传统的知识更新需要重新训练模型,这涉及较高的计算成本。同时,增量学习过程中可能出现"灾难性遗忘"现象,即新知识的引入会影响已有知识的表示,导致模型在原有任务上的性能波动。

RAG如何解决LLM知识更新难问题?

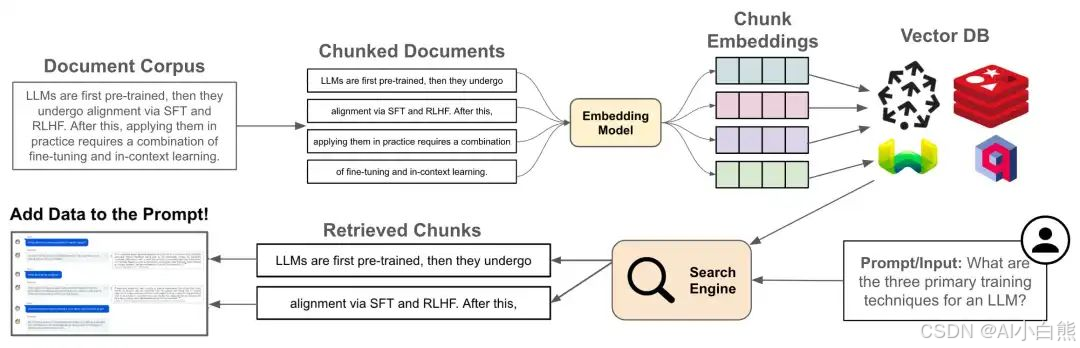

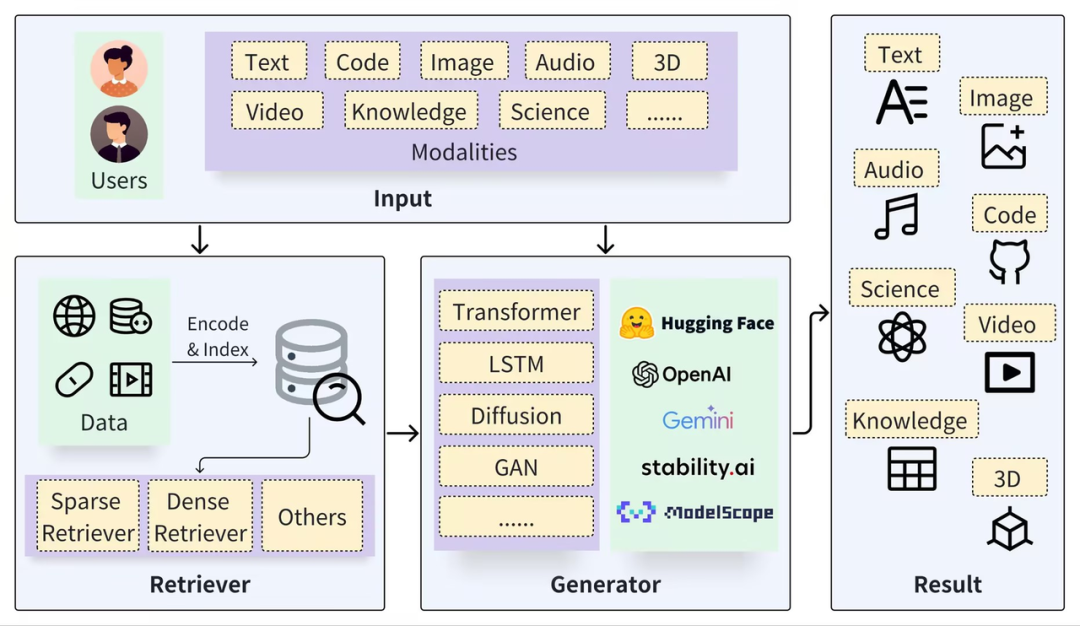

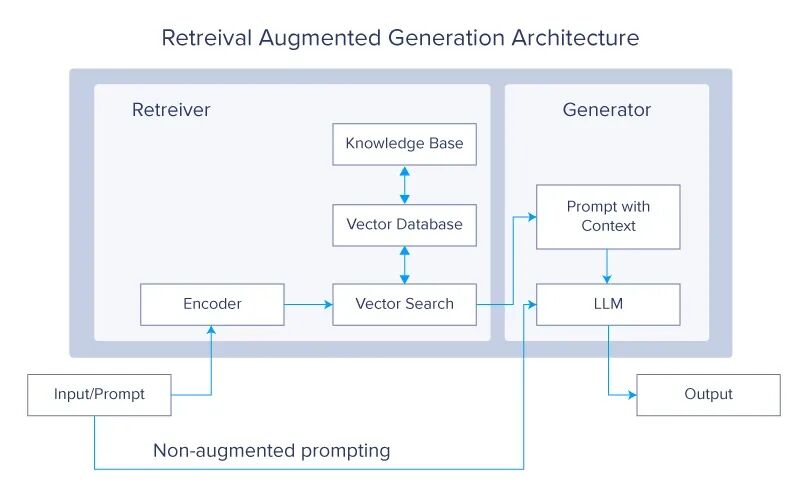

RAG采用了知识与能力分离的设计理念,将语言理解能力和事实知识分离。语言理解和生成能力保留在模型中,而事实知识则存储在可以独立更新的外部知识库中。

- 检索器(Retriever):负责从外部知识库中找到与查询相关的文档

- 知识库(Knowledge Base):存储可随时更新的结构化或非结构化文档

- 生成器(Generator):基于检索到的相关文档生成回答

class RAGSystem:

def __init__(self, knowledge_base, retriever_model, generator_model):

self.knowledge_base = knowledge_base

self.retriever = retriever_model

self.generator = generator_model

def answer_query(self, query):

# 步骤1:从知识库检索相关文档

relevant_docs = self.retriever.retrieve(

query=query,

knowledge_base=self.knowledge_base,

top_k=5

)

# 步骤2:将查询和文档输入生成器

context = self.format_context(query, relevant_docs)

response = self.generator.generate(context)

return response, relevant_docs

def update_knowledge(self, new_documents):

# 知识更新只需添加新文档,无需重训练

self.knowledge_base.add_documents(new_documents)

self.knowledge_base.rebuild_index()

RAG将知识更新变成了向量数据库操作,而不再需要模型重训练。新知识可以立即生效,且不会影响模型的语言理解能力。

二、检索与生成的协作

RAG如何实现检索与生成的协作?

在实现了知识与能力的基本分离后,RAG系统面临一个新的工程挑战:检索和生成两个模块应该如何协作。

在RAG系统中,检索模块和生成模块的协作本质上是一个时机选择问题:什么时候检索知识?检索多少次?

这个选择直接影响系统的效率和效果。检索太少,可能错过关键信息;检索太多,则会增加计算开销和复杂性。

这个问题看似简单,实则涉及系统设计的核心权衡。就像在团队协作中,我们面临一个根本性选择:是在项目开始时一次性分配所有资源,还是在执行过程中根据进展动态调配?每种选择都有其适用场景和代价。

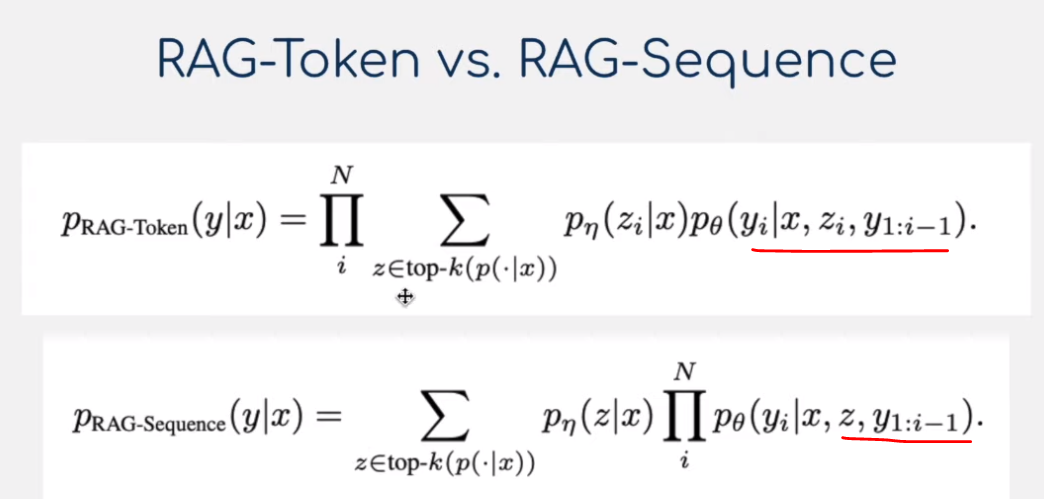

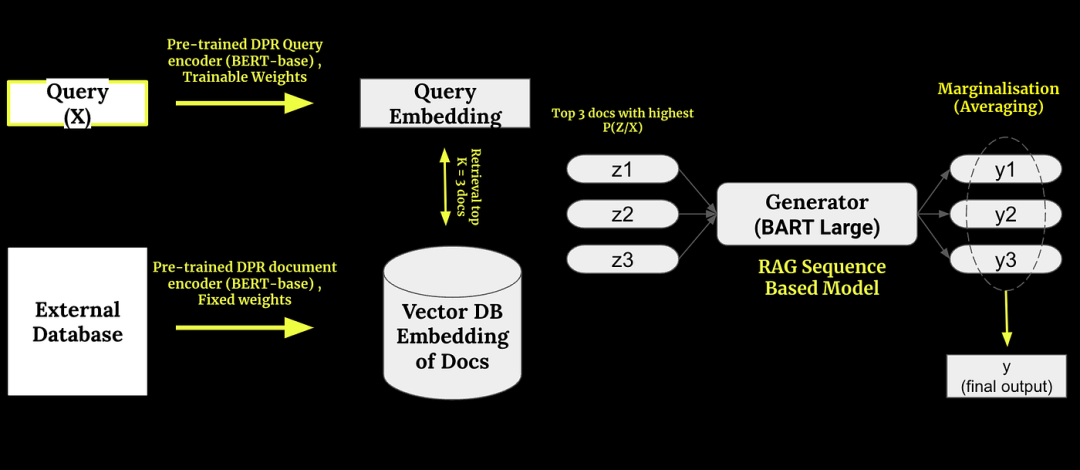

批量协作:RAG-Sequence的设计哲学

RAG-Sequence采用了"批量协作"的设计思路。它的核心理念是:在开始生成之前,一次性获取所有需要的知识,然后专注于生成过程。

这种方法类似于传统的学术写作模式:研究者在开始写作前会系统地收集和整理相关文献,然后基于这些资料完成整篇论文。整个写作过程中,参考资料保持稳定,确保论证的一致性。

具体来说,当用户提出一个查询时,系统首先分析查询内容,从知识库中检索出最相关的文档集合,然后将这些文档与原始查询一起提供给生成模块。生成模块基于这个固定的知识背景,完成整个回答的生成过程。

- 一次性检索:在开始时执行一次检索

操作 - 固定上下文:一次检索后构建的上下文不再变化

- 完整生成:调用大模型

一次性生成整个回答

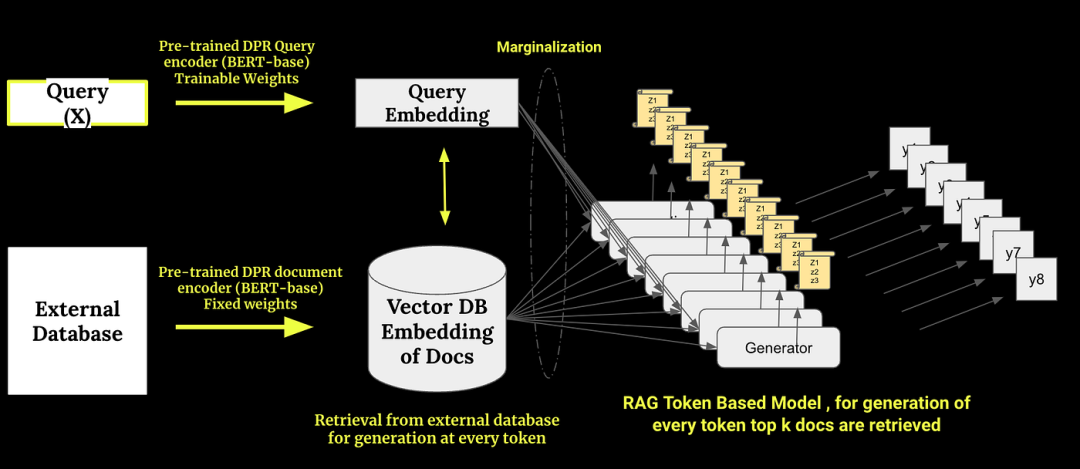

实时协作:RAG-Token的动态适应

与批量协作截然不同,RAG-Token选择了"实时协作"的路径。它的设计哲学是:在生成的每一步都评估知识需求,动态获取最相关的信息。

这种方法更像是即兴演讲或探索性研究:演讲者根据听众的反应和思路的发展,随时调整论点和引用的资料;研究者在研究过程中,根据发现的问题不断查阅新的文献,让研究方向更加精准。

在RAG-Token系统中,生成过程被细分为一个个词语的生成步骤。在每一步,系统都会评估:基于当前的上下文,是否需要检索新的知识?如果需要,系统会根据当前的生成进度重新构建查询,获取最相关的文档,然后继续生成。

- 循环检索:在循环中可能多次检索

- 动态判断:通过一个函数来判断是否需要新知识

- 逐词生成:基于当前上下文使用

大模型来逐个生成词语 - 上下文更新:大模型每次生成后更新当前上下文

RAG技术的成功不仅在于解决了LLM的知识更新问题,更重要的是展示了分而治之这一经典工程思想在AI时代的强大生命力。

RAG技术的演进告诉我们,即使在AI这样快速发展的领域,经典的工程智慧依然是指导技术创新的明灯。当我们面临新的技术挑战时,不妨问自己:这个问题可以如何分解?哪些关注点可以分离?什么样的分治粒度最合适?

或许答案就在分而治之的智慧之中。

日拱一卒,让大脑不断构建深度学习和大模型的神经网络连接。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献63条内容

已为社区贡献63条内容

所有评论(0)