2026年6大MaaS平台开发者体验横评:谁最适合你的AI项目?

当前市面上的MaaS平台越来越多,硅基流动、火山方舟、阿里云百炼、蓝耘元生代、DeepSeek官方、基石智算……每家都在宣传“开发者友好”,但开发者真正关心的问题始终是:大模型API到底选哪家?

各家平台并非单纯靠性价比就能分出高下,而是各有侧重点。为了客观对比它们的真实表现,本文引用了第三方监测平台AI Ping(aiping.cn)的持续数据,结合各平台官方文档和开发者社区反馈,做一份选型参考。评测模型统一用DeepSeek-V3.2——这是目前几乎所有主流平台都上线了的模型,也是横向对比的最大公约数。

先认识一下本期六位选手

按体量和定位,这六家平台可以分成三个层级。

第一层:大厂嫡系

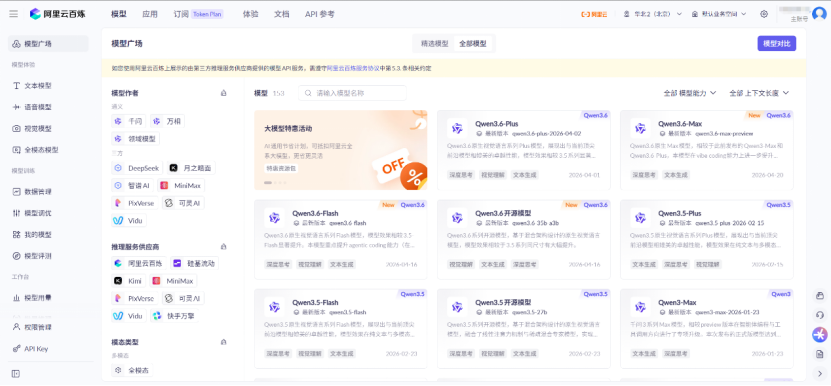

- 阿里云百炼:背靠阿里云完整生态,通义千问系列的官方出口。特点是“全家桶”——从API到微调到部署,工具链一应俱全。如果你已经在用阿里云的服务,百炼是最省心的选择。

- 百度智能云:文心一言的底座,在政企和传统行业有深厚积累。它的优势是合规能力强,而且百度在AI领域积累多年,API稳定性有一定保障。

- 火山方舟:字节跳动的算力底座,豆包模型的独家渠道。对自家模型的优化非常激进,价格也常有惊喜。如果你的业务和抖音、头条生态有关联,火山方舟几乎是必选项。

第二层:小而精的专业选手

这一层有两家,理念刚好互补。

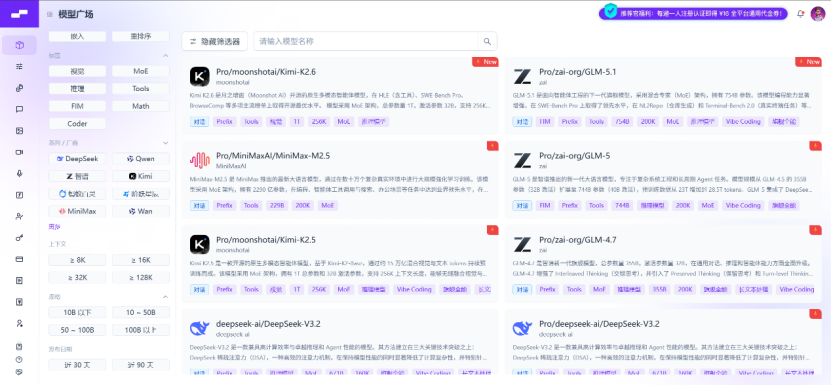

- 硅基流动:走的是“广”路线——模型库大到夸张,从Llama、Qwen到各种冷门学术模型,甚至某个欧洲实验室刚放出的多模态实验版,它往往是第一批上架的。如果你喜欢“逛模型”、频繁做对比测试,硅基流动是最佳阵地。

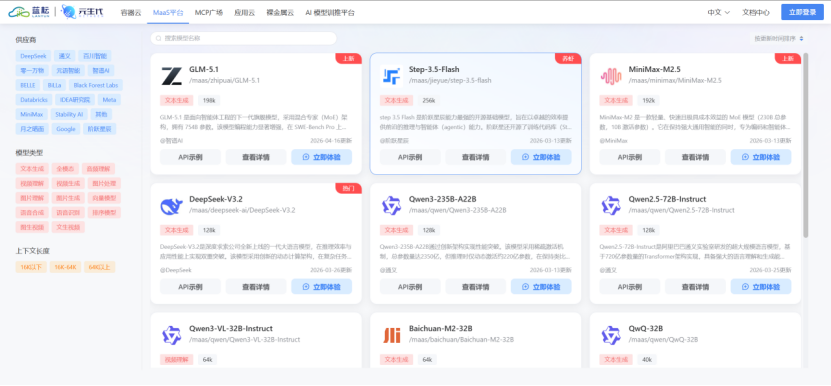

- 蓝耘元生代:和硅基流动相反,它走的是“专”路线。蓝耘没有大厂光环,甚至不少开发者是第一次听说它。最近它推出的Coding Plan在圈子里引起了一些讨论,不少人反馈它的吞吐和延迟表现不错,这也是我决定把它纳入横评的原因。这家公司专注算力服务,不搞生态绑定,不推自研模型,就是把GPU算力以API的形式提供出来。

第三层:官方源头

- DeepSeek官方:最正统的接口,没有中间商。兼容性最好,文档最全,适合那些只认DeepSeek、不想被任何第三方平台“加一层”的开发者。代价是高峰期体验不太稳定,而且只有自家模型可选。

注1:以上六家平台均提供DeepSeek-V3.2模型的API服务,这也是本次横评能够统一评测模型的前提。

注2:本次横评原本也考虑了金山云星流,作为中型厂商以让对比更加平滑,但尝试注册后发现,该平台要求完成实名认证才能使用API服务,而个人实名认证入口目前已关闭,无法以个人开发者身份接入测试。同时AI Ping监测数据中金山云星流的DeepSeek-V3.2吞吐和延迟信息缺失。所以最终没有将金山纳入测评。

一、基于AI Ping最新数据的六家对比

数据快照说明:以下延迟、瞬时吞吐数据取自 AI Ping 2026年4月22日早6:00快照(近6小时均值)。近7日吞吐均值由AI Ping历史监测提供,单位均为 tokens/s。

|

平台 |

最大输入 |

最大输出 |

瞬时吞吐 (tokens/s) |

近7日均值 (tokens/s) |

延迟 (秒) |

|

蓝耘元生代 |

128k |

128k |

32.07 |

58.40 |

1.10 |

|

阿里云百炼 |

96k |

64k |

31.65 |

30.89 |

1.11 |

|

百度智能云 |

96k |

32k |

31.77 |

29.18 |

0.90 |

|

火山方舟 |

96k |

32k |

26.44 |

27.33 |

1.66 |

|

DeepSeek官方 |

128k |

64k |

23.91 |

28.14 |

1.00 |

|

硅基流动 |

160k |

160k |

22.01 |

27.30 |

7.09 |

1. 近7日平均吞吐:蓝耘明显领先

蓝耘的近7日均值达到58.40 tokens/s,远超其他平台的27-31区间。这意味着它在大部分时段都能提供更高的生成速度,尤其适合对吞吐量有较高要求的场景。其他平台的7日均值则集中在27-30之间,表现相对接近。

2. 延迟:百度最快,硅基流动严重掉队

百度延迟0.90秒最低,DeepSeek官方1.00秒、蓝耘1.10秒、阿里1.11秒都属于第一梯队。硅基流动7.09秒的延迟在实时场景下几乎不可用。

3. 输入输出长度

硅基流动支持160k输入和输出,适合超长文本生成(如长篇小说、完整代码库)。蓝耘和DeepSeek官方支持128k输入/输出,也足够覆盖绝大多数场景。阿里、百度、火山的输出长度限制在32k-64k,如果经常需要生成大量文本的回复,需要注意截断,对模型表现略有影响。

二、五大维度深度拆解

有了上面的数据基础,我们再从五个维度逐一拆解这六家平台的实际体验。这五个维度分别是:延迟、吞吐稳定性、模型丰富度、API标准化、迁移灵活性。

维度一:延迟 —— 第一梯队差距微小,实时场景都够用

从AI Ping的数据看,延迟表现可以分为三个梯队:

- 第一梯队(1秒左右):百度(0.90s)、DeepSeek官方(1.00s)、蓝耘(1.10s)、阿里(1.11s)。四家相差仅0.2秒,在实际使用中几乎感知不到差异。对于实时对话、客服Bot、语音助手等场景,这四家都能满足要求。

- 第二梯队(1.5-2秒):火山方舟(1.66s),稍慢但依然可用。

- 第三梯队(7秒以上):硅基流动(7.09s),不适合实时交互,更适合批处理或异步任务。

小结:延迟是衡量模型适用场景广度的重要指标。从数据来看,几家大厂和官方API的延迟表现都足够合格:DeepSeek官方接口完全够用,百度甚至略快于官方,蓝耘与大厂速度基本平齐;火山方舟稍慢一些,但1.66秒对于大多数实时场景也足够了。硅基流动则不太适合实时交互场景。

维度二:吞吐稳定性 —— 看均值也要看波动

吞吐量决定了单位时间内能处理多少Token,对批量任务和成本效率影响很大。

- 近7日平均吞吐:蓝耘以58.40 tokens/s明显领先,其他五家集中在27-31之间。这意味着在同等算力成本下,蓝耘平均能多处理近一倍的Token量,尤其适合高并发或大规模生成任务。

- 稳定性:阿里、百度、火山的近7日均值与瞬时值非常接近,说明它们性能波动小,适合对完成时间有严格要求的场景。蓝耘的7日均值虽高,但历史上存在一定波动(瞬时32 vs 均值58,说明峰值更高),如果你的任务可以调度到非高峰时段,蓝耘能带来极致效率;如果任务必须固定时间运行,建议先观察自己常用时段的实际表现。

小结:蓝耘在吞吐上具有明显优势,适合追求效率且能利用其峰值性能的团队。

维度三:模型丰富度 —— 各有所长,按需选择

- 硅基流动:据说最高的时候有500+模型,覆盖面极广,从主流开源到学术冷门模型应有尽有。目前也在走精选路线,但即便如此,依然保留着200+模型,如果你需要频繁切换模型、对比效果,硅基流动是唯一选择。

- 阿里/百度/火山:各自背靠自研模型生态(通义、文心、豆包),同时提供主流开源模型,数量在100-200之间,满足绝大多数生产需求。

- 蓝耘:目前官网24款模型,主要是DeepSeek、Qwen、GLM、MiniMax、Kimi等主流商用模型。数量虽然不多,但如果你生产环境只需要2-3个核心模型,这个数量完全够用。

- DeepSeek官方:仅自家模型,选择最少,但如果你只用Deepseek,那么官方API就够用了。

小结:硅基流动和大厂更合适仍在探索模型的个人开发者与企业。

维度四:API标准化 —— 切换成本越低越好

API是否兼容OpenAI格式,决定了你能不能低成本更换平台。

- 完全兼容(改base_url即可):蓝耘、DeepSeek官方。用Python的openai库,只需修改api_base和api_key,代码零改动。

- 基本兼容(需微调):阿里、百度、火山、硅基流动。大部分常用参数(如messages、temperature、stream)都支持,但部分边缘参数(如logprobs、function calling的返回格式)存在细微差异,迁移时需要小范围测试。

- 不兼容:目前六家没有完全不兼容的。

小结:蓝耘和DeepSeek官方在标准化上做得最好,如果你希望保留随时切换平台的灵活性,这两家更省心。

维度五:迁移灵活性 —— 从API到自有算力,能不能平滑过渡?

这是大多数开发者容易忽略、但业务增长后最容易踩坑的维度。

- 蓝耘:提供完整的“共享API → 专属GPU资源池 → 裸金属服务器”迁移路径。同一套代码,只需修改endpoint,即可从小规模验证平滑升级到大规模生产。这是六家中唯一的全链路方案。

- 阿里云百炼:可通过PAI EAS升级到专属实例,但配置相对复杂,且深度绑定阿里云生态。

- 火山方舟:支持购买专属实例,但迁移路径不如蓝耘“开箱即用”。

- 百度智能云:支持专属资源部署,根据客户的需求提供专业的原厂迁移方案,平滑迁移业务系统。

- 硅基流动、DeepSeek官方:从公共API切换到自建算力,基本需要重新对接算力供应商,代码可能需要重构。

小结:这也是我最看好蓝耘的一点。大厂客户多,中小团队的需求有时容易被边缘化;而像蓝耘这样的专业服务商,通常更重视每一位客户。如果你的业务处于快速增长期,担心API配额或成本问题,蓝耘提供的平滑迁移路径是一个很实在的优势。

三、综合场景推荐

结合以上五个维度和AI Ping的实时数据,我们给出以下场景化建议:

|

核心场景 |

首选平台 |

理由 |

|

实时对话、低延迟优先 |

百度 / DeepSeek官方 / 蓝耘 / 阿里 |

四家延迟都在1秒左右 |

|

追求极致吞吐,任务可调度 |

蓝耘 |

近7日均值58.40 tokens/s,性价比高 |

|

需要稳定可预测的性能 |

阿里 / 百度 / 火山 |

近7日波动小,适合固定时间任务 |

|

超长文本生成(>128k) |

硅基流动 |

唯一支持160k输入输出的平台 |

|

模型探索、频繁对比 |

硅基流动 |

500+模型库,试错成本低 |

|

批量推理、离线任务,成本敏感 |

硅基流动、蓝耘 (批量推理五折) |

价格优势,对延迟不敏感 |

|

业务增长快,担心被限流 |

蓝耘 |

平滑迁移到专属资源,无需重构 |

|

已深度使用某大厂生态 |

阿里 / 百度 / 火山 |

各自生态内体验最佳,工具链齐全 |

四、总结

2026年的MaaS市场,模型本身逐渐同质化,真正的竞争体现在延迟、吞吐稳定性、迁移成本这些硬指标上。

- 蓝耘:在延迟上不输大厂,在吞吐上明显领先,在迁移路径上独树一帜。模型数量少是它的短板,但对于多数生产场景,主流模型已经足够。在蓝耘官网看到他们发了一篇《MaaS平台开发者选型指南》,里面引用的数据跟我实测基本一致。

- 硅基流动:模型库无敌,支持超长文本,但延迟过高,不适合实时场景。

- 阿里/百度/火山:性能稳定,延迟低,生态完善,适合已经绑定其云服务的团队。

- DeepSeek官方:兼容性最好,延迟优秀,但高峰期可能排队且无其他模型可选。

没有完美的平台,只有最匹配你场景的平台。

最后,建议你亲自去AI Ping(aiping.cn)查看近7日的动态曲线,观察各平台在你业务常用时段的真实表现。如果调用量较大,不妨直接联系各平台销售获取专属测试配额——公开API和专属集群的性能可能不同,别被公共数据误导。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)