RAG架构雪崩:大模型落地深水区的五大暗礁与进化之路

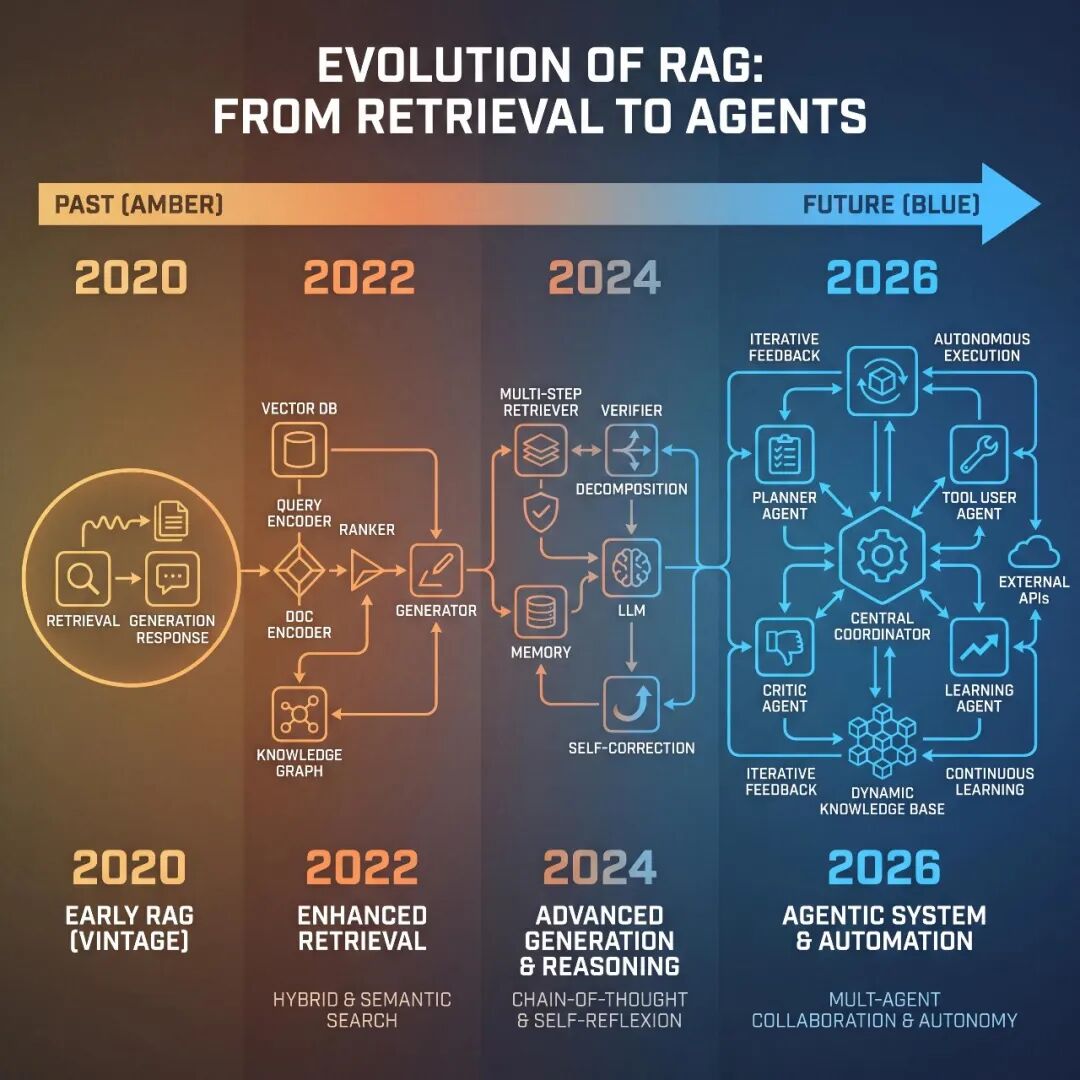

本文回顾了RAG架构从2020年论文提出到成为大模型落地主流范式的发展历程,剖析了其在企业级应用中面临的五大深水区问题:向量化的信息坍缩、Embedding选择的“不可能三角”、检索与生成的对齐鸿沟、多模态信息的降维诅咒以及知识冲突的信任危机。文章进一步探讨了RAG的进化方向,包括Agent化、Contextual Retrieval与Late Chunking等策略,并指出RAG正演变为更宏大的Context Engineering框架的一部分。最后,文章展望了RAG的未来可能性和其对整个AI行业理解信息方式的启示。

一个「简单」问题引发的架构雪崩

2024年年初,某头部券商的AI团队接了一个看起来不算复杂的需求:让大模型能读懂招股书里的股权结构图,回答「创始人通过几层持股控制了海外子公司」这类问题。

技术负责人拍了拍胸脯——不就是RAG嘛,PDF解析、向量入库、检索生成,三板斧下去搞定。

两周后,Demo翻车了。

模型信誓旦旦地回答「创始人直接持有子公司60%股权」,实际上中间隔了三层壳公司。问题出在哪?图片被Vision LLM生成了一段粗糙的文本摘要,存进了向量库。等用户问出那个精确到穿透路径的问题时,那段摘要里压根就没有这个信息——它在入库阶段就已经被「压缩」丢了。

这不是个案。2026年的今天,RAG——这个被无数技术博客封为「大模型落地第一范式」的架构,正在经历它的深水区时刻。水面上看着平静,水面下暗流汹涌。

检索找不准、生成有幻觉、多模态信息丢失、评估没标准。 每一个问题拆开看都不新鲜,但它们组合在一起,构成了2026年企业级AI落地的最大堵点。

这篇文章试图做一件事:把RAG架构这六年的来路捋清楚,把它今天面对的深水区问题摊开来讲,然后看看——它的下一步,到底往哪走。

溯源:一篇论文如何催生一个范式

2020年的那个夏天

故事要从2020年讲起。

那年5月,Facebook AI Research(后来改名Meta AI)的Patrick Lewis和他的团队,在arXiv上挂出了一篇论文:Retrieval-Augmented Generationfor Knowledge-IntensiveNLP**Tasks。

这篇论文的核心想法,用一句话说就是:让语言模型在回答问题之前,先去「查资料」。

听起来朴素得不像话。但在2020年的语境下,这是一个相当激进的提案。彼时的主流思路是把所有知识都「塞进」模型参数里——GPT-3刚刚发布,1750亿参数的暴力美学正当其时。Lewis他们反其道而行之,说:与其让模型死记硬背,不如给它一个「外挂大脑」,需要什么查什么。

具体来说,RAG把两个东西拼在了一起:一个DPR检索器(Dense Passage Retriever),负责从外部知识库里找到相关段落;一个BART生成器,负责基于检索到的内容生成答案。整个系统端到端可微分——检索器和生成器联合训练,检索器学会「找什么对生成器有用」,生成器学会「怎么用检索到的东西」。

更巧妙的是,他们提出了两种变体:RAG-Sequence让整个生成序列共享同一组检索文档;RAG-Token则允许每一个token都参考不同的检索结果。后者的灵活性更高,但计算开销也更大。

论文发出来之后,学术圈的反应是:「哦,这个思路不错。」然后就……没有然后了。至少在2020年,RAG还只是一个学术概念,距离成为工程范式还差一个关键催化剂。

催化剂:ChatGPT和它的「知识截止日期」

2022年11月30日,ChatGPT上线。两个月,一亿用户。

但用户很快发现了一个令人恼火的问题:这个无所不知的AI,居然不知道昨天发生了什么。「我的训练数据截止到2021年9月」——这句话被ChatGPT重复了无数次,也让无数想把大模型塞进业务系统的工程师挠头。

企业的数据是活的。财报每季度更新,政策法规随时变动,内部知识库每天都有新增。如果大模型只能靠参数里的「旧知识」回答问题,那它在企业场景里就是个摆设。

Fine-tuning?太贵了,而且每次知识更新都得重新训练。

RAG在这个时刻被重新发现了。它的核心承诺完美契合了企业需求:不改模型参数,只换检索的知识库,就能让模型「知道」最新的信息。 成本低、灵活性高、可审计——你能看到模型引用了哪些文档,知道答案从哪来的。

2023年,RAG从学术概念变成了工程标配。LangChain、LlamaIndex等框架把RAG的搭建门槛降到了「会写Python就能搞」的程度。一时间,似乎每个做大模型应用的团队都在做RAG。

但问题也随之而来。

从Naive到Advanced:第一批坑的浮现

最早期的RAG实现——后来被称为Naive RAG——简单到近乎粗暴:把文档按固定长度切块,用Embedding模型转成向量,存进向量数据库,用户提问时检索最相似的几块,拼进Prompt里让LLM生成答案。

这套流程在Demo阶段表现惊艳。但一旦进入生产环境,问题就像春笋一样冒出来:

切块(Chunking)是第一个大坑。 你把一份合同按512个token切成块,恰好切到第三条和第四条之间——一个完整的免责条款被劈成两半,上下文断裂,语义残缺。用户问「甲方的免责条件是什么」,检索到了上半截,模型根据半截信息一本正经地胡说八道。

检索精度是第二个坑。 用户问「苹果的最新财报」,向量检索把「苹果园的种植技巧」排在了前面——因为在向量空间里,两个「苹果」的距离并不远。BM25这种传统的关键词匹配反而能搞定这种场景,但纯向量检索搞不定。

幻觉是第三个坑,也是最致命的。 即使检索到了正确的文档,模型在生成时依然可能「添油加醋」,把检索内容和自己的参数知识混在一起,输出一个看起来合理但实际上错误的答案。

2023年到2024年,行业的主要精力都花在了填这些坑上。这个阶段被称为Advanced****RAG,核心思路是在检索的前、中、后三个环节都加入优化策略:

- 检索前(Pre-Retrieval):Query改写——用户的原始问题往往不适合直接检索,先让LLM把问题reformulate一下。HyDE(Hypothetical Document Embeddings)是个典型方案:先让模型生成一个「假设的理想答案」,用这个假设答案的向量去检索,效果往往比用原始问题好得多。

- 检索中(Retrieval):混合检索——BM25和向量检索并行,用RRF(Reciprocal Rank Fusion)融合排序结果。实测下来,混合检索通常比纯向量检索提升10%-30%的MRR。

- 检索后(Post-Retrieval):Reranking——用Cross-Encoder对检索结果重排序,把真正相关的段落推到前面。Cohere和Jina的商业Reranker在这个阶段获得了大量用户。

这些优化确实管用。但它们都是在Naive RAG的基本框架内打补丁。框架本身的局限性,还没有被真正触碰到。

深水区的五道暗礁

如果把RAG的演进比作一次远洋航行,那么Naive RAG是刚出港口的平静水域,Advanced RAG是近海的风浪。而现在,2026年,航船驶入了真正的深水区。

水面下的暗礁,每一道都足以让一个企业级项目触礁沉没。

第一道暗礁:向量化的「信息坍缩」

所有基于Embedding的RAG系统都面临一个根本性问题:把一段文本压缩成一个固定维度的向量,必然伴随信息损失。

这不是优化能解决的问题。这是信息论层面的硬约束。

一段512 token的文本,包含的语义信息是多维度、多层次的。你把它压成一个768维或1536维的向量,就像把一本书的内容压缩成一段100字的摘要——必然有东西被丢掉了。问题在于,你不知道丢掉的是什么,也不知道用户的问题恰好需要的是不是被丢掉的那部分。

这就是所谓的语义坍缩。

举个直观的例子:「特斯拉2024年Q3的毛利率」和「特斯拉的自动驾驶技术路线」,在向量空间中的距离可能很近(都跟特斯拉有关),但它们的语义是完全不同的维度。当用户问的是毛利率,检索系统可能同时召回了自动驾驶的内容——因为在向量空间里它们是「邻居」。

解法正在演进,但还没有银弹。

ColBERT开创了多向量表示的思路:不再把一段文本压成一个向量,而是为每个token都保留一个向量,检索时做token级别的细粒度匹配(Late Interaction)。精度大幅提升,但存储和计算开销也成倍增长。

BGE-M3走了三向混合的路线:Dense + Sparse + Multi-Vector三种表示并行,各取所长。Dense捕捉语义,Sparse保留精确匹配能力,Multi-Vector提供细粒度匹配。

但这些方案的工程复杂度和成本,对于大多数企业来说仍然是个挑战。

第二道暗礁:Embedding选择的「不可能三角」

即使接受了向量化的信息损失,你还得面对另一个头疼的问题:用什么Embedding模型?

这个选择比大多数人想象的要困难得多。

通用模型vs领域模型:OpenAI的text-embedding-3-large在通用场景下表现不错,但在医疗、法律、金融等专业领域,经常被领域微调过的小模型吊打。原因很简单——通用模型没见过足够多的领域术语,在这些术语的向量空间分布上没有足够的区分度。

模型更新的「全量重索引」问题:一旦你选定了一个Embedding模型并且入库了百万级的文档,换模型就意味着全量重新编码和重新索引。这个成本在百万文档级别已经相当可观,在亿级文档的场景下几乎不可承受。

多语言的额外困境:中文场景尤其痛苦。中文的分词歧义、成语隐喻、古文引用,对Embedding模型的要求比英文高出一个量级。而且中英混合文档在企业场景中非常常见——一份技术规范里夹杂着英文术语、代码片段和中文说明,单一语言的Embedding模型很难同时搞好两头。

我的判断是:2026年,Embedding选择仍然更像一门「手艺」而非「工程」。 它依赖经验、依赖反复实验、依赖对业务场景的深度理解。那些声称「一个API搞定一切」的方案,在真正的企业深水区里往往最先翻船。

第三道暗礁:检索与生成的「对齐鸿沟」

这个问题比前两个更隐蔽,但可能更致命。

检索器认为「相关」的东西,和生成器真正「需要」的东西,经常不是一回事。

检索器是按照语义相似度排序的——它找的是「和问题最像的文档」。但生成器需要的是「能帮我推导出答案的文档」。这两者之间存在一个微妙但关键的gap。

2025年NeurIPS上有一篇重要的论文,把RAG重新定义为RAR(Retrieval-Augmented Reasoning),核心论点就是:传统RAG过于关注「检索相关性」,而忽视了「推理有用性」。一个文档可能跟问题高度相关,但它提供的信息对于推导出最终答案毫无帮助——它只是在重复问题本身的语境,而没有提供新的推理线索。

反过来,一个看起来跟问题关系不大的文档,可能恰恰包含了推理链上的关键一环。

Skill-RAG的研究进一步发现:大多数RAG检索失败,不是因为「没有正确的文档」,而是因为「查询和证据之间的对齐出了问题」。 他们把检索失败分为四种类型,分别需要不同的诊断和修复策略。

这个对齐问题在多跳推理(Multi-hop Reasoning)场景下尤为严重。用户问「A公司的CEO去年在哪个大学演讲时提到了B技术的未来方向」——回答这个问题需要先找到CEO是谁,再找到演讲记录,再从演讲内容中提取关于B技术的论述。每一跳检索的query都不同,但传统RAG只做了一次检索。

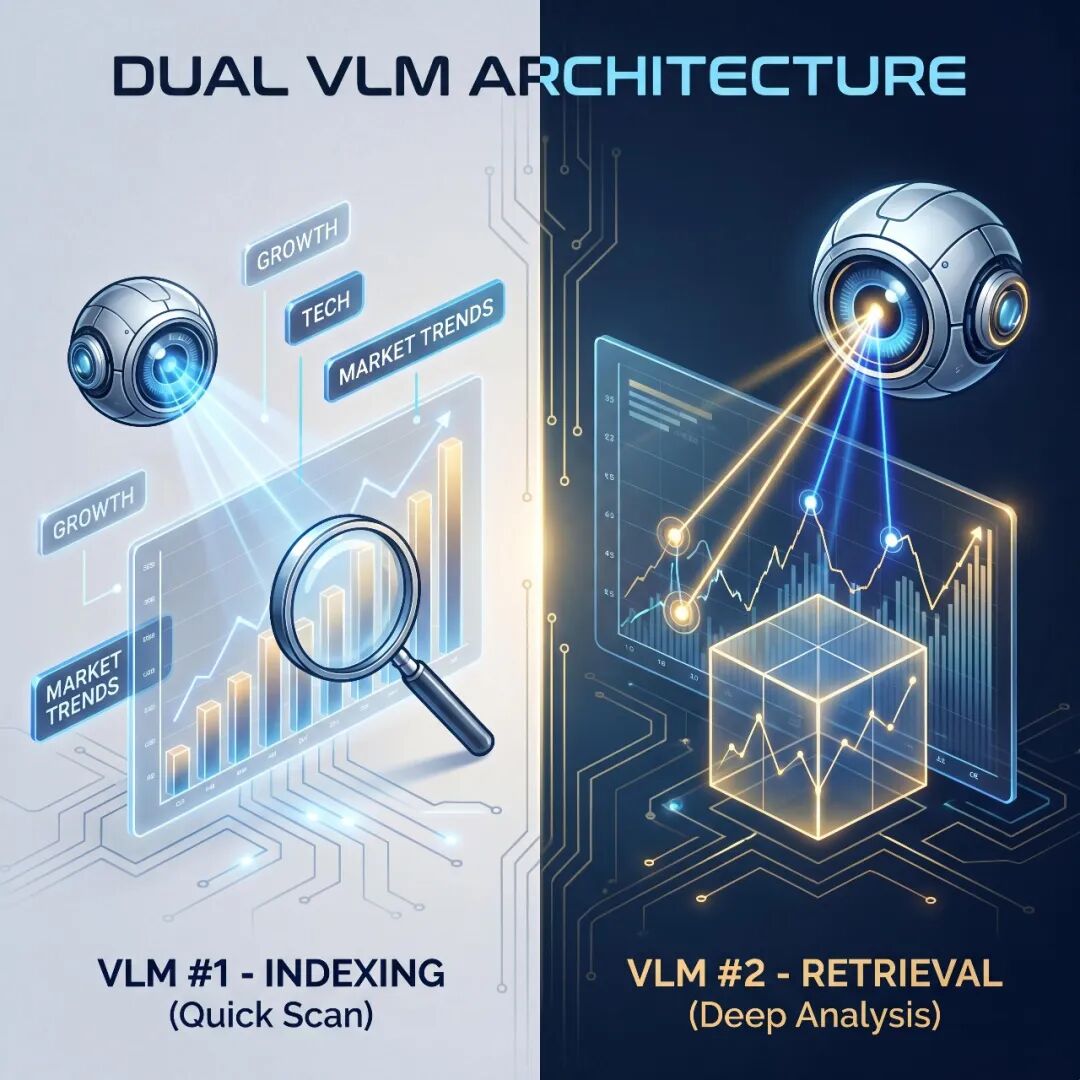

第四道暗礁:多模态的「降维诅咒」

这就是文章开头那个券商团队踩的坑,也是多模态RAG中最核心的痛点。

在大模型落地实践中,企业文档远不只是纯文本。PDF里有图表、有流程图、有截屏、有手写标注。一份200页的招股书里,可能有30%的关键信息藏在图片中。

当前主流方案的处理方式令人沮丧地粗暴:把图片丢给Vision LLM,生成一段文字摘要,然后就当它是「文本」来处理了。

这种做法的问题在于:图片是一种高密度的信息压缩格式。 同一张组织架构图,用户问「CEO是谁」和「CTO下属有哪几个部门」,需要提取的信息完全不同。但入库时的摘要只能是一个——它必须做出选择,记录「什么信息」,必然遗漏其他信息。

这就是所谓的Question-Agnostic预处理vs Question-Specific查询的根本矛盾。

双VLM(Dual-VLM)架构是目前最有工程价值的过渡方案:

- 入库****阶段用一个轻量级VLM(7B-10B),生成包含关键词、实体和全局描述的结构化摘要,目标是最大化检索****召回率——让图片「能被找到」。

- 检索阶段用一个重量级VLM(17B+),带着用户的原始问题重新「阅读」被召回的原始高清图片,目标是最大化答案精度——让图片「被看懂」。

看两次。第一次为了「找得到」,第二次为了「答得准」。

这个方案的精妙之处在于,它把「理解」的成本延迟到了检索时。入库阶段只做轻量级索引,真正的深度理解只在用户提问时才发生——而且是带着问题去理解,目标明确,不浪费算力。

但它也有代价:检索时增加了VLM二次推理的延迟。实测中,如果召回3张图,串行调用VLM会多等15秒。工程上的对策是Python线程池并行化,但这又带来了GPU资源的调度压力。

此外还有三个生产环境的「暗桩」:

- Token爆炸:VLM二次解析后的文本可能非常长。5张图各返回1000字描述,加上原始文本上下文,轻松撑爆LLM的Context Window。必须设置Image_Cap,限制每次处理的图片数量。

- 路径一致性:入库在离线,检索在在线。图片的存储路径、OSS权限、Base64编码的完整性,任何一个环节没对齐都会导致VLM读不到图。

- VLM****幻觉穿透:VLM在解析图片时也会产生幻觉。应对策略是永远不让VLM直接回复用户,必须把VLM的输出送回给LLM做交叉验证。

第五道暗礁:知识冲突的「信任危机」

当检索到的外部知识和模型参数里的内在知识产生冲突时,模型该信谁?

这不是一个工程问题,几乎是一个哲学问题。

2025年NeurIPS的一项研究揭示了一个有趣的发现:LLM****内部处理上下文知识和参数知识时,用的是不同的注意力头(Attention Head)。 也就是说,模型在「决定相信谁」这件事上,有自己的内部机制——但这个机制不完全可控,也不完全可预测。

在实际场景中,知识冲突的表现往往是「悄无声息」的。模型不会告诉你「我检索到的信息和我记忆里的不一样,所以我选了XX」。它只是默默地输出一个答案——你不知道这个答案是基于检索结果还是参数记忆,或者是两者的某种混合。

这对于金融、法律、医疗等对准确性要求极高的领域来说,是不可接受的。

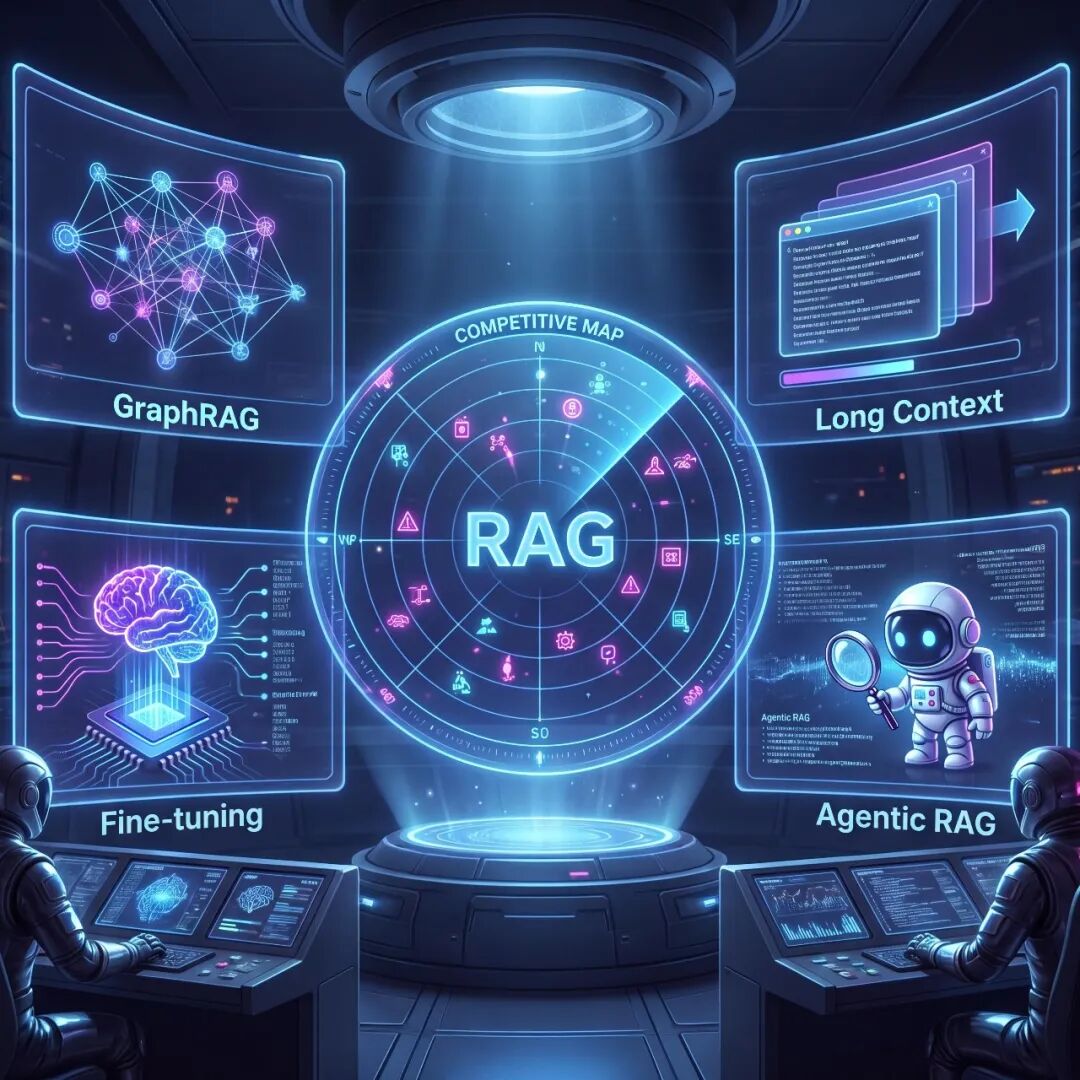

竞争图谱:RAG的「朋友」和「敌人」

RAG不是孤立存在的。在2026年的技术版图上,它同时面对着来自「替代方案」的竞争和来自「互补方案」的协作。

长上下文窗口:RAG的「杀手」还是「搭档」?

2025年到2026年,大模型的上下文窗口经历了爆发式增长:Gemini 2.5支持100万token,Claude 3.5支持20万token,GPT-4.1也在持续扩大窗口。

一种流行的论调出现了:「把所有文档直接塞进Context Window不就行了,还要RAG干嘛?」

这个观点在技术博客和社交媒体上引发了激烈的「RAG is Dead」辩论。

但实际数据给出了不同的答案。

成本差距是最直观的:RAGFlow团队指出,对于同样规模的知识库,直接使用长上下文窗口的API调用成本比RAG方案高出两个数量级。当你有10万份文档、每份几千字时,每次查询都把全量文档塞进上下文是经济上不可行的。

「Lost in the Middle」效应依然存在:即使上下文窗口足够大,模型对中间位置信息的注意力仍然显著低于首尾——这是2023年就被发现的问题,到2026年并没有被彻底解决。把100份文档塞进上下文,模型很可能「忘掉」排在中间的关键段落。

可审计性和可追溯性:RAG天然具备的「引用来源」能力,在长上下文方案中很难实现。你知道答案来自哪份文档的哪个段落——这对企业合规至关重要。

2026年的行业共识逐渐清晰:长上下文和RAG不是替代关系,而是协同关系。 一种新兴的Long Context RAG Pattern正在被验证:用RAG做广泛检索,召回Top-20相关文档块,然后利用长上下文窗口让LLM对这些文档块进行深度推理。RAG负责「缩小搜索范围」,长上下文负责「深度理解」。

Fine-tuning vs GraphRAG vs 框架之战

Fine-tuning和RAG的边界到2026年已经比较清晰了:知识更新频繁的场景用RAG;行为模式调整的场景用Fine-tuning;复杂场景两者叠加。

GraphRAG是2024年7月微软开源后的一匹黑马。它的核心思路是:先用LLM从文档中提取实体和关系,构建知识图谱,然后在图谱上做检索和推理。GraphRAG在「全局性」问题上的表现远超传统RAG——比如「这个行业的主要趋势是什么」。但代价也很明显:索引成本极高,构建知识图谱需要让LLM读遍所有文档做NER和关系提取,费用可能是传统向量索引的10倍以上。

2026年的RAG框架格局可以用「两超多强」来概括:

| 框架 | 定位 | 核心优势 | 核心短板 |

|---|---|---|---|

| LangChain | 全栈生态 | 连接器最丰富,社区最大 | 抽象层数多,调试复杂 |

| LlamaIndex | 数据层深耕 | 复杂文档处理能力强 | 上手门槛相对较高 |

| Dify | 低代码平台 | 拖拽搭建,门槛最低 | 深度定制灵活性不足 |

| RAGFlow | 深度文档理解 | 内置强大PDF解析和多模态处理 | 生态相对较小 |

| Haystack | 企业级合规 | 数据隐私和审计能力强 | 中国市场存在感较弱 |

我的观察是:框架的选择越来越不重要了。 真正的深水区问题不是换个框架就能解决的——它们是RAG范式本身的结构性挑战。

前沿进化:RAG正在变成什么?

Agentic RAG:从「管道」到「智能体」

2024年到2025年,RAG最重要的演进方向是Agent化。

传统RAG是一条固定的管道:检索 → 生成。管道是死的——不管问题简单还是复杂,都走同一条路。

Agentic RAG引入了一个「大脑」:一个Agent来决定什么时候检索、检索什么、检索结果够不够好、要不要再检索一次、要不要换一种方式检索。

Self-RAG(ICLR 2024)是这条路线的里程碑之作。它让模型在生成过程中自主决定「我现在需要查资料吗」,并在检索后生成反思token来评估检索结果的质量。如果质量不行,模型会自主决定重新检索或者跳过检索直接用参数知识回答。

CRAG(Corrective RAG) 更进一步,引入了三级评估机制:CORRECT(检索结果可靠,直接使用)、INCORRECT(不可靠,触发网络搜索补充)、AMBIGUOUS(不确定,融合多来源信息)。

到2026年,Agentic RAG已经发展出多种工作流模式:Prompt Chaining(链式推理)、Routing(路由分发)、Parallelization(并行检索)、Evaluator-Optimizer(评估-优化循环)。

但Agent化也带来了新的问题:延迟和成本的增加。 一个简单的问题可能要跑3-5个步骤——判断、检索、评估、再检索、最终生成。对于实时交互的场景,这个额外的延迟可能不被接受。

Contextual Retrieval与Late Chunking:两条精巧的路

2024年9月,两个方案几乎同时出现,解决的是同一个问题——切块后的上下文丢失——但技术路径完全不同。

Contextual Retrieval(Anthropic提出):在切块之后、入库之前,用LLM为每个文档块添加一段上下文前缀——把这个块在原文中的位置和语境信息编码进去。比如添加「以下段落来自XX公司2024年Q3财报的营收分析章节」。检索失败率降低了67%。

Late Chunking(Jina AI提出):思路与传统切块完全相反——先对整篇文档做token级别的Embedding,再在token embedding层面按块边界切分,然后对每个块内的token embedding做平均池化。这样每个块的Embedding已经包含了全文上下文的信息,因为token级别的Embedding是在看完全文之后生成的。

一个用LLM加前缀,一个用Embedding做延迟切分。两种方案成本不同、效果各有优劣,但都指向同一个洞察:切块不能无脑切,上下文不能随便丢。

从RAG到Context Engineering

2025年末到2026年,一个更大的范式转移正在发生:RAG正在从一个独立的架构范式,演变为更宏大的Context Engineering的一个子模块。

Context Engineering的核心观点是:LLM的性能极度依赖于你给它的上下文质量。而「上下文」不只是检索来的文档——它还包括对话历史和长期记忆、API调用和工具输出、系统Prompt和任务指令。

RAG只负责了「文档检索」这一类上下文的构建。Context Engineering把视野拉大了:怎么为LLM构建最优的上下文——综合所有类型的信息源,在有限的上下文窗口内,给模型最有用的信息。

这也解释了为什么Claude Code可以不用向量数据库也能做出不错的代码检索——它用的是文件系统结构、代码索引、符号表等结构化信息,这些在代码场景下比向量检索更有效。但这个发现只适用于代码等高度结构化的场景,在非结构化文档场景下,向量检索仍然是不可替代的。

RAG的「中年危机」与「第二曲线」

站在2026年4月这个时间点,回头看RAG六年的发展,再横向看它面对的竞争格局,几个判断逐渐浮出水面。

RAG的「成功诅咒」

RAG最大的优势——简单易用、快速见效——正在成为它最大的诅咒。

因为门槛太低,太多团队在没有真正理解深水区问题的情况下就上了RAG。切块、向量化、检索、生成——四步搞定,Demo一跑,效果看起来不错,上线。然后在生产环境里遭遇一连串的边缘案例崩溃,开始怀疑RAG本身不行。

实际上不是RAG不行,是Naive RAG不行。但修好它需要的工程投入,远超大多数团队的预期。

这跟2015年前后的微服务很像。微服务的概念简单得人人都能理解,但真正做好微服务需要的基础设施(服务发现、熔断限流、链路追踪、灰度发布)却是冰山下的巨兽。RAG也是一样:概念简单,做好很难。

深水区的本质

把五道暗礁放在一起看,它们指向的其实是同一个根本问题:

RAG试图用「检索+拼接」的方式,解决「知识理解和推理」的问题。

检索只能找到「看起来相关」的信息,但不能保证这些信息对推理有用(对齐鸿沟)。向量化只能保留「统计层面」的语义特征,但不能保留完整的信息(信息坍缩)。预处理只能基于有限的预设进行摘要,但不能预知所有可能的问题(多模态降维)。

RAG的范式假设是:先检索,再生成。 但深水区的问题在暗示:也许检索和生成不应该是串行的两步,而应该是交织在一起的、迭代的、自适应的过程。

三个剧本

最可能的剧本:RAG成为Context Engine的核心子模块。 RAG不再作为一个独立的架构范式存在,而是被整合进更大的Context Engineering框架中。它负责「文档检索」这一类上下文的构建,和记忆管理、工具调用、指令优化等模块并列。企业的AI基础设施不再是「一个RAG系统」,而是「一个Context Engine,其中包含RAG能力」。

最危险的剧本:Long Context + Agentic能力让RAG边缘化。 如果上下文窗口继续以每年翻倍的速度增长(从100万到1000万token),同时Agent的自主检索能力足够成熟,那么预先切块、预先向量化、预先索引的整个RAG流程可能变得没有必要。模型直接「读」原始文档,读不完的让Agent自主决定先读哪些。这个剧本在技术上有可能性,但成本和延迟问题在2026年还看不到彻底解决的迹象。

最乐观的剧本:原生多模态RAG成为现实。 不再需要把图片转成文字、把表格转成Markdown——多模态Embedding模型直接对原始视觉内容做索引和检索,生成模型也直接「看图说话」。ColPali等早期方案已经展示了这个方向的可行性。如果多模态Embedding和多模态生成的性能持续提升、成本持续下降,那么文章开头那个券商团队的痛苦就不复存在了——模型不再需要「看两次」,一次就能看懂。

一个更大的画面

RAG的深水区问题,折射的其实是整个AI行业在2026年面对的核心挑战:如何让大模型真正「理解」信息,而不只是「匹配」信息。

向量检索本质上是一种高级匹配——在高维空间里找最近的邻居。但人类理解信息的方式不是匹配,而是构建心智模型、进行因果推理、在不完整信息中做出判断。

RAG正在从「暴力匹配」走向「智能理解」。这条路还很长。

但至少,方向已经清晰了。

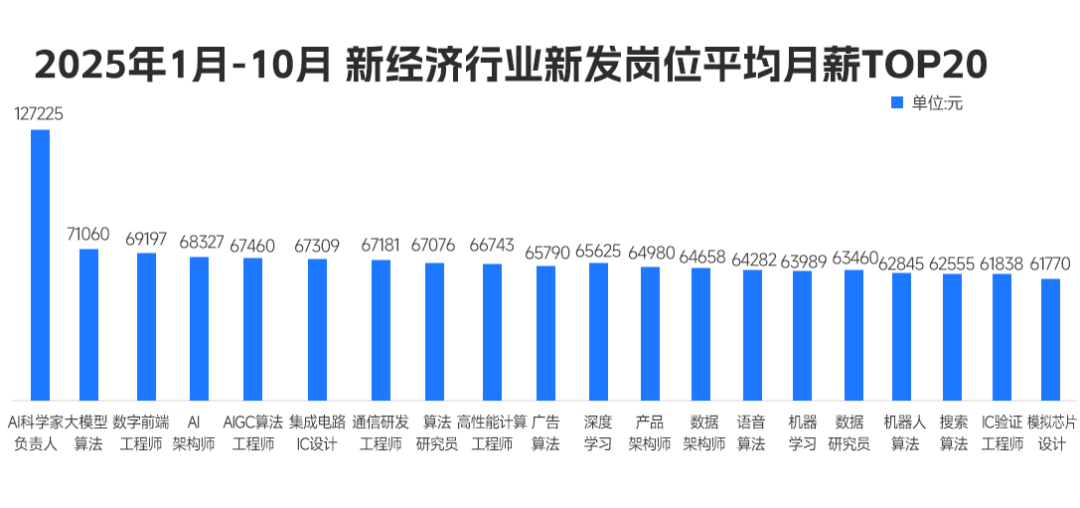

AI行业迎来前所未有的爆发式增长:从DeepSeek百万年薪招聘AI研究员,到百度、阿里、腾讯等大厂疯狂布局AI Agent,再到国家政策大力扶持数字经济和AI人才培养,所有信号都在告诉我们:AI的黄金十年,真的来了!

在行业火爆之下,AI人才争夺战也日趋白热化,其就业前景一片蓝海!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

人才缺口巨大

人力资源社会保障部有关报告显示,据测算,当前,****我国人工智能人才缺口超过500万,****供求比例达1∶10。脉脉最新数据也显示:AI新发岗位量较去年初暴增29倍,超1000家AI企业释放7.2万+岗位……

单拿今年的秋招来说,各互联网大厂释放出来的招聘信息中,我们就能感受到AI浪潮,比如百度90%的技术岗都与AI相关!

就业薪资超高

在旺盛的市场需求下,AI岗位不仅招聘量大,薪资待遇更是“一骑绝尘”。企业为抢AI核心人才,薪资给的非常慷慨,过去一年,懂AI的人才普遍涨薪40%+!

脉脉高聘发布的《2025年度人才迁徙报告》显示,在2025年1月-10月的高薪岗位Top20排行中,AI相关岗位占了绝大多数,并且平均薪资月薪都超过6w!

在去年的秋招中,小红书给算法相关岗位的薪资为50k起,字节开出228万元的超高年薪,据《2025年秋季校园招聘白皮书》,AI算法类平均年薪达36.9万,遥遥领先其他行业!

总结来说,当前人工智能岗位需求多,薪资高,前景好。在职场里,选对赛道就能赢在起跑线。抓住AI风口,轻松实现高薪就业!

但现实却是,仍有很多同学不知道如何抓住AI机遇,会遇到很多就业难题,比如:

❌ 技术过时:只会CRUD的开发者,在AI浪潮中沦为“职场裸奔者”;

❌ 薪资停滞:初级岗位内卷到白菜价,传统开发3年经验薪资涨幅不足15%;

❌ 转型无门:想学AI却找不到系统路径,83%自学党中途放弃。

他们的就业难题解决问题的关键在于:不仅要选对赛道,更要跟对老师!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献119条内容

已为社区贡献119条内容

所有评论(0)