多LLM无缝切换实战:GeoAI平台动态配置设计与开箱落地

在开发LLM+GIS类应用时,几乎所有开发者都会撞上同一个瓶颈:模型适配成本太高。想接入国产大模型支持政务场景,就要重写适配器;想切换本地Ollama做隐私数据推理,又要改动核心代码;不同模型的配置散落在代码、环境变量里,密钥暴露风险高,多模型共存更是无从谈起。

为了彻底解决这一问题,我们在开发GeoAI Universal Platform时,通过文档驱动设计的方式,落地了一套标准化的多LLM动态配置方案,所有设计思路与实现规范均沉淀在项目文档docs/design/17-multi-llm-config-design.md中。

本文将基于这份真实设计文档,拆解多LLM无缝切换的核心技术实现,同时提供开箱即用的实操步骤,让你10分钟内完成验证,快速判断这套方案是否适配你的业务场景。

一、设计背景:为什么要做标准化多LLM配置?

GeoAI通用平台的定位是服务政企国产化、科研隐私计算、中小团队快速开发等多元场景,不同场景对大模型的需求天差地别:

- 政务场景优先选用通义千问等国产模型,满足自主可控要求;

- 涉密地理数据必须使用Ollama本地推理,杜绝数据外发;

- 通用演示与测试场景可使用OpenAI、Claude等海外模型提升效果。

早期原型阶段我们采用硬编码适配模型,结果暴露了大量问题:新增一个LLM提供商要修改多处核心逻辑,配置无法持久化,运行时切换模型必须重启服务,密钥管理混乱且存在安全隐患。

基于这些真实痛点,我们专门制定了多LLM配置设计规范,核心目标就是实现模型无关、动态切换、安全可控、易于扩展,所有设计细节均可查阅官方设计文档:

多LLM配置设计文档

二、核心设计解读:基于官方文档的标准规范

严格遵循17-multi-llm-config-design.md的设计思路,平台的多LLM配置体系围绕四大核心规则构建,没有任何炫技设计,全部为落地服务:

1. 核心设计目标

- 支持多LLM配置共存,可同时管理通义、Ollama、OpenAI等多个模型账号;

- 运行时动态切换激活模型,无需重启服务、不修改代码;

- 服务端安全存储密钥,前端仅做配置展示与操作,杜绝凭证泄露;

- 支持配置迁移,兼容旧版配置格式,降低升级成本。

2. 配置存储与结构规范

所有LLM配置统一存储在项目data/llm-configs/目录下,以独立文件形式持久化,每个配置拥有唯一ID标识,包含提供商类型、模型名称、API地址、密钥等核心字段,结构统一且易于维护。

3. 标准执行流程

整套体系的运行逻辑清晰可追溯:

创建LLM配置 → 校验配置合法性 → 激活指定配置 → 运行时切换模型 → 旧配置平滑迁移

任何环节均有校验机制,避免无效配置导致服务异常。

4. 安全设计底线

- API密钥仅存储在服务端,前端不传输、不展示完整密钥;

- 配置写入严格校验参数,防止非法注入;

- 支持只读模式与权限约束,适配政企生产环境要求。

三、技术实现:从设计到代码的真实落地

设计方案最终要靠代码承接,GeoAI通用平台的多LLM能力,核心依靠接口抽象+工厂模式+管理器缓存实现,所有代码均开源可查:

LLM模块源码目录

1. 统一接口抽象:ILlmProvider

我们定义了标准的LLM服务接口,约定生成响应、配置校验等核心方法,无论接入哪种大模型,都必须遵循这套契约。这是实现“不改代码切模型”的基础,也是平台模块化的核心保障。

2. 工厂模式动态实例化

通过LlmProviderFactory工厂类,根据配置中的提供商类型,自动创建对应的模型实例,上层业务无需关心底层实现,只需传入配置ID即可完成切换。

3. 配置管理器生命周期管控

LlmProviderManager负责配置的加载、激活、缓存与切换,支持运行时热更新,修改配置后立即生效,同时减少重复实例化带来的性能损耗,让多模型切换更流畅。

这套技术架构完全贴合地理空间AI的使用场景,既保证了灵活性,又兼顾了GIS数据处理的稳定性要求。

四、开箱实操:10分钟验证多LLM切换能力

无需复杂环境配置,按照以下步骤即可快速体验,全程复制命令即可执行:

1. 环境准备

确保本地安装Node.js 24.0及以上版本,即可开始部署。

2. 项目拉取与启动

# 克隆项目

git clone https://gitee.com/rzcgis/geo-ai-universal-platform.git

cd geo-ai-universal-platform

# 安装依赖

npm install

# 构建项目

npm run build

# 启动开发版服务

npm run server:dev

3. 通过API配置并激活LLM

服务启动后,可通过接口直接创建通义千问、Ollama等模型配置,并设置为激活状态,无需改动任何源码。

4. Web端可视化配置

进入项目自带的Web演示端:

cd examples/web-demo

npm install

npm run dev

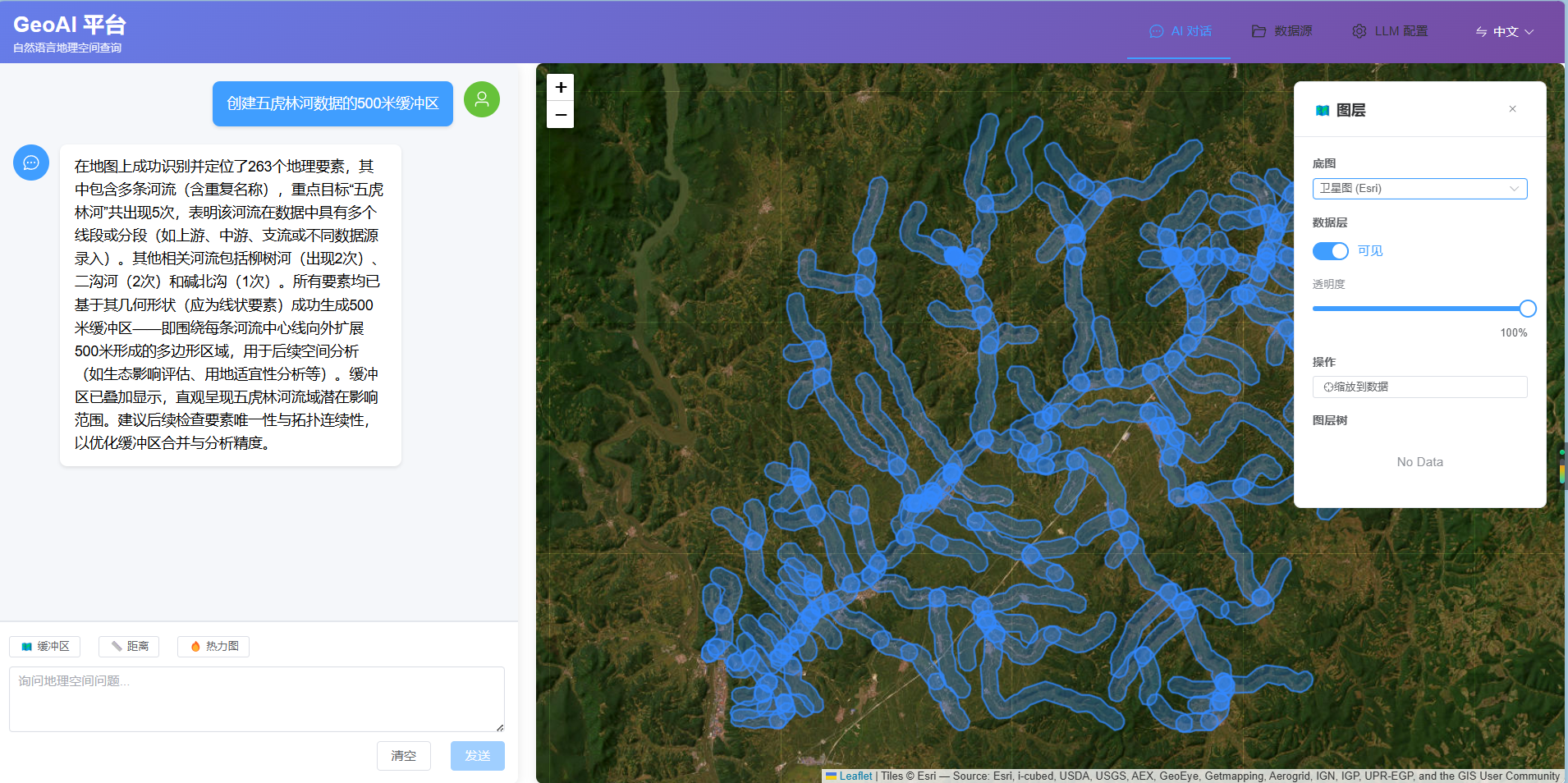

打开http://localhost:5173,在LLM配置面板中可直观添加、切换模型,操作完成后立即生效。

5. 验证效果

在对话窗口输入地理查询语句,如“显示区域内的POI数据”,切换不同LLM提供商,可快速看到不同模型的解析效果,全程无重启、无代码修改。

五、场景价值:这套方案真正解决了什么问题?

对于GeoAI相关开发与落地而言,多LLM动态配置的价值远超技术本身:

- 政企国产化快速适配:一键切换国产大模型,满足政务、自然资源等领域合规要求;

- 隐私数据安全推理:无缝切到Ollama本地模型,涉密地理数据不出内网;

- 开发与测试降本增效:不同环境使用不同模型,无需重复开发适配逻辑;

- 开源项目扩展性更强:第三方开发者可自行接入新模型,不侵入核心代码。

相比于市面上多数GeoAI项目仅绑定单一模型,GeoAI Universal Platform从设计阶段就立足真实落地场景,这也是它能快速适配各类业务的核心原因。

六、写在最后:欢迎试用验证,共同迭代

GeoAI Universal Platform的所有设计与代码均面向真实场景开放,多LLM配置作为平台核心能力之一,从文档到代码完全透明,目的就是让开发者低成本试错、快速验证价值。

如果你正在做LLM+GIS相关开发,被模型适配、配置管理、安全合规等问题困扰,不妨直接访问项目仓库,部署体验完整能力:

GeoAI Universal Platform 项目主页

我们也欢迎大家提交使用反馈、功能建议,平台会根据真实市场需求持续迭代,让地理空间AI的落地更简单、更灵活。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)