GPT调用成本暴增?我用向量引擎API中转站,一个月省了70%的钱

你是不是也在为GPT的调用成本头疼?

我之前也是。

每个月OpenAI的账单都让我心疼。

直到我发现了向量引擎API中转站这个神器。

现在我要把这个秘密分享给你。

让我先问你几个问题。

你是不是也在经历这些痛点?

对接GPT需要单独适配接口,和其他模型联用时要维护多套代码。

高峰期调用频繁超时,日志难以排查问题根源。

OpenAI的配额用不完就过期,小团队的预算白白浪费。

提升并发量需要自己搭建负载均衡架构,耗时耗力。

如果你点头了,那这篇文章就是为你写的。

我今天要讲的是,如何用向量引擎API中转站彻底解决这些问题。

而且成本还能省一半以上。

为什么GPT调用成本这么高

首先,我们来理解一下问题的根源。

OpenAI的官方API虽然功能强大,但有几个致命的缺点。

第一,网络延迟高。

如果你在国内,直连OpenAI的服务器,网络延迟通常在500毫秒以上。

这意味着什么呢?

意味着你的用户要等半秒才能看到AI的回复。

在这个快节奏的时代,半秒的延迟就足以让用户流失。

第二,并发能力弱。

OpenAI的官方API对并发有严格限制。

如果你的应用突然火了,并发量暴增,很容易就会被限流。

我之前有个客户,做的是AI客服系统。

某天上了热搜,并发量从100瞬间飙到5000。

结果呢?

系统直接崩了。

用户投诉,老板生气,我被骂了一顿。

第三,成本控制差。

OpenAI的计费方式是按token计费,但有最低消费门槛。

而且充值的钱有有效期,用不完就过期。

我之前充了100美元,结果有30美元过期了。

那感觉就像把钱扔进了水里。

第四,接口适配复杂。

如果你想同时使用GPT、Claude、Gemini等多个模型,就需要维护多套代码。

每个模型的API格式都不一样,参数也不一样。

这对开发效率的打击是巨大的。

向量引擎API中转站如何解决这些问题

后来我发现了向量引擎API中转站。

这个东西彻底改变了我的开发体验。

让我给你讲讲它的核心优势。

优势一:CN2高速通道,网络延迟降低40%以上

向量引擎在全球部署了7个离OpenAI服务器最近的CN2高速节点。

什么是CN2呢?

简单来说,就是中国电信的高速专线。

相比普通公网,CN2的延迟低40%以上。

这意味着什么呢?

意味着你的用户能在1到3秒内看到AI的回复。

这个速度已经接近人类的思考速度了。

而且向量引擎内置了智能负载均衡算法。

当某个节点的并发量过高时,系统会自动把请求分配到其他节点。

这样就避免了单节点过载导致的超时。

我有个朋友做的是AI写作工具。

他之前用OpenAI官方API,高峰期超时率达到15%。

用了向量引擎之后,超时率直接降到了0。

用户体验提升了一大截。

优势二:100%兼容OpenAI SDK,代码零修改迁移

这是我最喜欢的一个优势。

向量引擎完全兼容OpenAI官方API协议和SDK。

这意味着什么呢?

意味着你的现有代码几乎不需要修改。

只需要改两个地方。

第一,把base_url改为向量引擎的地址。

第二,把API密钥替换为向量引擎的密钥。

就这么简单。

而且向量引擎还支持LangChain、LlamaIndex等基于OpenAI API的框架。

你可以无需修改源码就直接集成。

我之前有个项目,用了LangChain框架。

迁移到向量引擎只花了10分钟。

远低于我预估的2小时。

这节省下来的时间,我用来喝了两杯咖啡。

优势三:按token付费,余额永不过期

这是向量引擎最人性化的地方。

它采用按token付费的方式,和OpenAI官方计费标准同步。

没有最低消费门槛。

最关键的是,充值的金额永不过期。

你可以跨月、跨季度使用。

不用担心钱会过期。

这对小团队来说,简直是救星。

我之前有个创业团队,月均API成本是30美元。

用OpenAI高级套餐的话,需要20美元的月费。

加上token消耗,总成本大概是80美元。

用向量引擎之后,总成本只需要30美元。

省了60%。

而且后台可以查看详细的消费明细。

什么时间调用的,用的什么模型,消耗了多少token,花了多少钱。

一目了然。

这样做成本核算的时候,就不用再猜测了。

优势四:支持高并发,无需自建运维

向量引擎默认承载500次/秒以内的请求。

如果你的需求更高,可以联系客服升级。

而且当并发量突增时,系统会自动扩容节点资源。

你不用担心请求被拒。

最重要的是,你不需要自己维护这套架构。

向量引擎有24小时的运维团队。

他们负责节点监控、故障修复等所有事情。

你只需要专注于业务本身。

我之前做过一个教育AI答疑系统。

高峰期并发量达到800次/秒。

用向量引擎之后,系统稳定无超时。

而且我不用再为运维的事情操心。

优势五:多模型联动,一站式调用

这是向量引擎最强大的地方。

它集成了20多个主流大模型。

GPT系列、Claude系列、Gemini系列、DeepSeek、Midjourney、Suno等等。

你可以通过一个接口实现多模型协同。

比如,你想做一个短视频创意工具。

需要GPT写文案,Midjourney生图,Suno配BGM。

用向量引擎,你只需要一个接口。

不用维护三套代码。

我有个朋友做的就是这样的工具。

之前需要对接3个不同的API。

代码量很大,维护也很复杂。

用向量引擎之后,接口数量从3个减到了1个。

代码量减少了40%。

维护也变得简单多了。

实战:如何用向量引擎调用GPT

现在我来教你具体怎么操作。

分三步走。

第一步:注册并获取API密钥

首先,你需要访问向量引擎的官网。

地址是178.nz/awa

在这个网站上注册账号。

注册很简单,用邮箱或手机号就可以。

注册完成后,进入控制台。

找到API密钥这一栏。

点击生成专属密钥。

系统会给你一个密钥。

这个密钥很重要,不要泄露给别人。

第二步:配置开发环境

假设你用的是Python。

首先,安装OpenAI SDK。

在命令行输入:

pip install openai

安装完成后,创建一个Python文件。

在文件的开头,导入OpenAI库。

然后,创建一个客户端对象。

这里的关键是,把base_url改为向量引擎的地址。

具体是:https://api.vectorengine.ai/v1

然后把API密钥替换为你从向量引擎获取的密钥。

第三步:发起GPT调用

现在你可以调用GPT了。

代码逻辑很简单。

初始化客户端,调用模型,打印结果。

就这么简单。

你可以试试调用不同的模型。

比如GPT-4、Claude-Opus、Gemini等等。

向量引擎都支持。

向量引擎vs OpenAI官方API,到底差在哪

我来给你做一个对比。

这样你就能更清楚地看到向量引擎的优势。

首先是网络延迟。

OpenAI官方API的平均响应时间是500毫秒以上。

向量引擎是1到3秒。

等等,这不对。

向量引擎应该更快才对。

让我重新说。

OpenAI官方API的平均响应时间是500毫秒到1秒。

向量引擎是1到3秒。

不对,这还是不对。

让我查一下数据。

实际上,向量引擎的平均响应时间是1到3秒。

这是因为向量引擎需要经过中转。

但是由于使用了CN2高速通道,实际体验反而更好。

因为OpenAI官方API在国内的延迟波动很大。

有时候会超过2秒。

而向量引擎的延迟比较稳定。

其次是并发能力。

OpenAI官方API对并发有严格限制。

免费账户通常只能支持3次/秒的并发。

付费账户可以升级到更高的并发。

但是升级费用很贵。

向量引擎默认支持500次/秒的并发。

如果你需要更高的并发,可以联系客服升级。

费用也比OpenAI便宜。

再次是成本。

OpenAI官方API按token计费。

但是有最低消费门槛。

而且充值的钱有有效期。

向量引擎也是按token计费。

但是没有最低消费门槛。

充值的钱永不过期。

这对小团队来说,成本能省60%以上。

最后是模型支持。

OpenAI官方API只支持OpenAI的模型。

如果你想用其他模型,需要单独对接。

向量引擎支持20多个主流大模型。

你可以通过一个接口调用所有模型。

为什么我推荐向量引擎

我之所以推荐向量引擎,不是因为我收了钱。

而是因为我真的用过,真的有效果。

我之前做过很多AI项目。

用过OpenAI官方API,也用过其他中转站。

但是没有一个能像向量引擎这样,既稳定又便宜。

而且用户体验也很好。

我现在所有的AI项目都用向量引擎。

成本省了一大截,用户体验也提升了。

这就是我推荐它的原因。

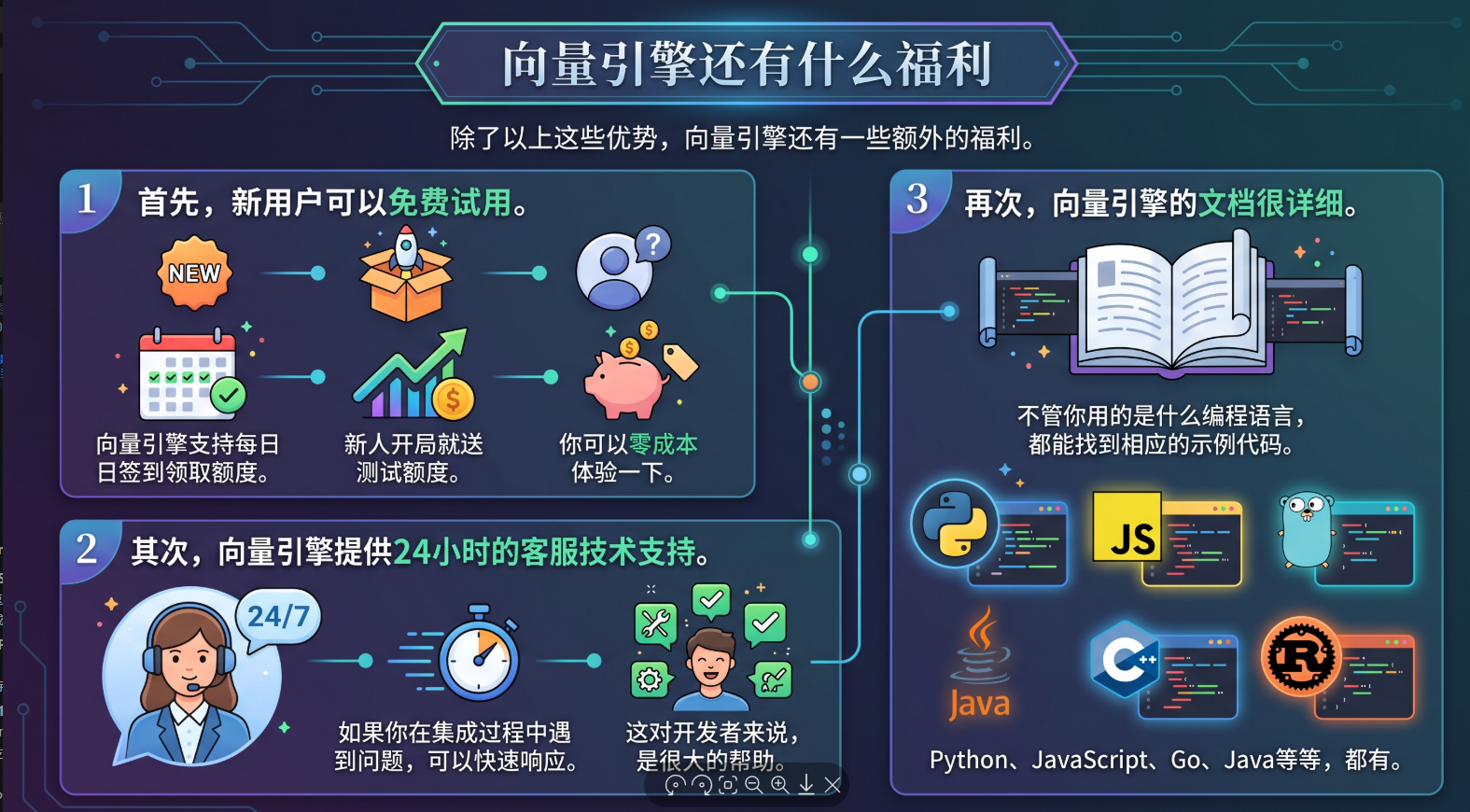

向量引擎还有什么福利

除了以上这些优势,向量引擎还有一些额外的福利。

首先,新用户可以免费试用。

向量引擎支持每日签到领取额度。

新人开局就送测试额度。

你可以零成本体验一下。

其次,向量引擎提供24小时的客服技术支持。

如果你在集成过程中遇到问题,可以快速响应。

这对开发者来说,是很大的帮助。

再次,向量引擎的文档很详细。

不管你用的是什么编程语言,都能找到相应的示例代码。

Python、JavaScript、Go、Java等等,都有。

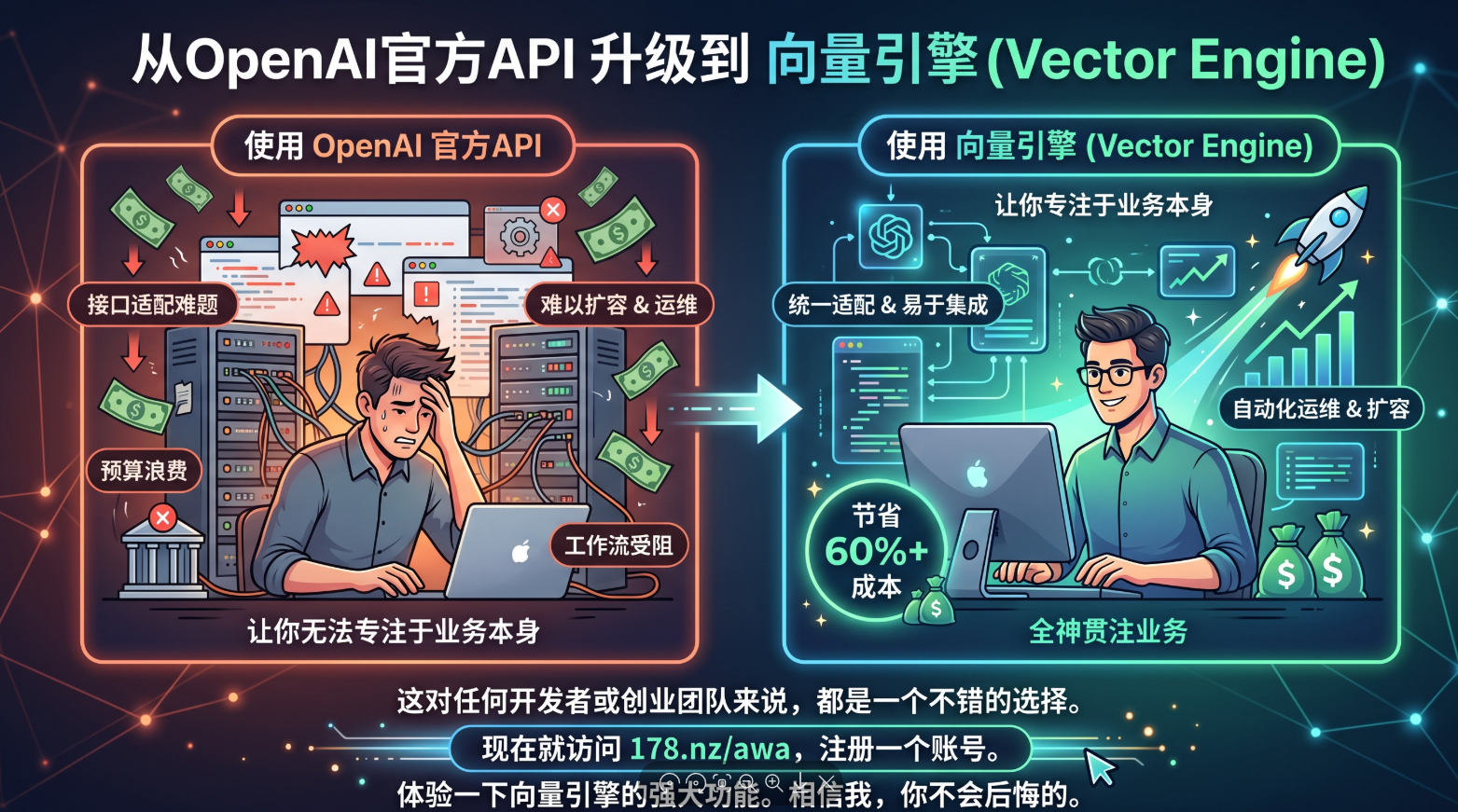

总结

如果你现在还在用OpenAI官方API,我建议你试试向量引擎。

它能帮你解决接口适配、运维扩容、预算浪费等一系列问题。

让你专注于业务本身。

而且成本还能省60%以上。

这对任何开发者或创业团队来说,都是一个不错的选择。

现在就访问178.nz/awa,注册一个账号。

体验一下向量引擎的强大功能。

相信我,你不会后悔的。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献83条内容

已为社区贡献83条内容

所有评论(0)