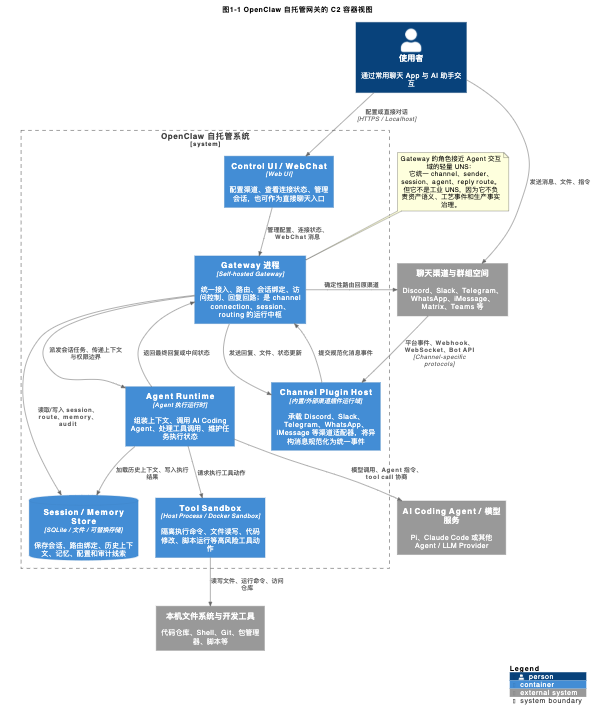

OpenClaw显式运行结构揭示的LLM应用发展路径

一、问题的起点:为什么“好用的对话”仍然不等于“可用的系统”

自 OpenAI 推出 ChatGPT 以来,大语言模型(LLM)迅速从研究走向应用。人们第一次可以用自然语言与系统直接交互,表达需求、获取结果,甚至驱动复杂操作。

然而,一个关键问题逐渐显现:

对话能力的提升,并没有自动转化为“可持续运行的系统能力”。

换句话说:

-

LLM 可以“回答问题”,但难以“长期工作”

-

可以“生成方案”,但难以“稳定执行”

-

可以“模拟推理”,但难以“承担责任”

这并不是模型能力不足,而是因为:

LLM本身并不是一个运行系统。

二、LLM的本质边界:表达引擎,而非执行系统

从计算本质来看,LLM更接近于一种:

基于概率的语义生成引擎

它擅长:

-

语义理解与表达

-

模式匹配与类推

-

上下文关联

但它并不具备系统级能力,例如:

-

稳定的状态管理(State)

-

可验证的执行路径(Execution Trace)

-

持续运行机制(Runtime)

-

明确的资源与权限约束(Constraints)

因此,当我们试图用LLM直接驱动现实任务时,会遇到一系列结构性问题:

-

不稳定性:同一输入产生不同输出

-

不可控性:行为难以约束

-

不可追踪性:无法复盘执行路径

-

不可持续性:缺乏任务生命周期

这些问题并非“优化prompt”可以解决,而是计算模型层面的缺口。

三、第一阶段:语言驱动的“半结构化执行”

当前主流的LLM应用,大多处于这样一个阶段:

User → Prompt → LLM → Tool → Result

在这一阶段,系统开始引入工具调用(Tool Use)、函数调用(Function Calling)等机制,使模型能够“做事”。

这类系统(如 AutoGPT、LangChain)确实推动了应用进化,但其核心问题依然存在:

-

工具调用仍由模型隐式决策

-

执行流程缺乏明确结构

-

状态依然依赖上下文拼接

-

系统行为难以审计

本质上,这一阶段仍然是:

用语言“模拟系统”,而不是构建系统。

四、转折点:显式运行结构的出现

OpenClaw 所代表的思路,标志着一个关键转折:

将“隐含在语言中的语义”,外化为“显式的运行结构”。

其核心结构包括:

-

Gateway(运行入口与调度)

-

Session(执行上下文)

-

Route(语义路由)

-

Agent(执行单元)

-

Tool / Sandbox(执行能力与约束环境)

-

Memory(状态与历史)

这些结构并不是“组件堆叠”,而是共同完成一件事:

把自然语言意图,转化为可执行、可约束、可追踪的运行过程。

五、从语言到运行:一个“语义编译”过程

如果从计算视角重新理解这一体系,可以发现:

OpenClaw 实际上引入了一种新的“语义编译链”。

1. 意图表达(Intent)

用户输入自然语言:

“帮我每周整理项目进展并生成报告”

2. 语义编译(Semantic Compilation)

系统将其转化为结构化对象:

Task {

trigger: weekly

action: generate_report

context: project_state

}

这一过程由以下结构协同完成:

-

Session:提供上下文

-

Route:解析意图

-

Agent:生成执行计划

-

Memory:补全语义约束

3. 执行与约束(Execution)

执行在受控环境中完成:

-

Tool:实际操作能力

-

Sandbox:安全与隔离

-

Constraints:权限与范围控制

4. 状态演化(State Evolution)

执行结果进入系统状态:

State(t) → Action → State(t+1)

👉 至此,系统完成从“语言”到“运行”的闭环。

六、为什么这是必经之路

显式运行结构的引入,并非优化路径,而是由以下五个必然性决定的:

1. 语义必须转化为状态

语言是瞬时的,而系统必须是持续的。

没有状态,就没有运行系统。

2. 意图必须受到约束

语言是开放的,而执行必须是受限的。

没有约束,就无法工程化。

3. 执行必须可追踪

复杂系统必须具备审计能力。

没有结构,就无法追踪。

4. 系统必须引入时间维度

真实任务涉及:

-

定时

-

长期运行

-

异步执行

没有时间,就没有“运行”。

5. 多Agent协同必须结构化

协同不能依赖语言隐含,而必须显式表达:

-

工作流(Workflow)

-

状态机(State Machine)

👉 结论是明确的:

不引入显式运行结构,LLM应用无法跨越“玩具系统”阶段。

七、架构意义:从工具到“语义操作系统”

一旦显式运行结构建立,系统的性质发生根本变化:

| 传统LLM应用 | 基于OpenClaw的系统 |

|---|---|

| 对话驱动 | 运行驱动 |

| 无状态 | 有状态 |

| 即时响应 | 持续执行 |

| 单Agent | 多Agent协同 |

| 不可追踪 | 可审计 |

这使得系统从:

LLM Tool

跃迁为:

Semantic Runtime System

甚至可以进一步理解为:

一种“以自然语言为指令接口的操作系统内核”。

八、发展路径:LLM应用的三阶段演进

结合上述分析,可以清晰地看到一条发展路径:

第一阶段:语言增强(Language Augmentation)

-

ChatGPT类应用

-

提高表达与获取信息能力

第二阶段:语言驱动执行(Language-driven Execution)

-

工具调用

-

Agent框架

-

半结构化流程

第三阶段:语义运行系统(Semantic Runtime System)

-

显式运行结构

-

状态 + 时间 + 约束

-

多任务持续运行

👉 OpenClaw 所处的位置,正是第三阶段的起点。

九、结语:从“理解世界”到“运行世界”

大语言模型的突破,让机器第一次可以“理解并表达人类意图”。

但真正的工程目标,并不止于理解,而在于:

让意图在现实系统中稳定、可控、持续地运行。

实现这一目标的关键,不在于更强的模型,而在于:

把语义变成结构,把结构变成运行。

OpenClaw 所揭示的显式运行结构,正是这一转变的核心路径。

一句话总结:

语言让系统理解世界,而结构让系统能够运行世界。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)